Você está procurando personalizar o robots.txt do seu site? Este artigo irá ajudar.

O módulo robots.txt em All in One SEO permite que você gerencie o robots.txt que o WordPress cria.

Isso permite que você tenha maior controle sobre as instruções que você dá aos rastreadores da web sobre o seu site.

Neste Artigo

- Vídeo Tutorial

- Sobre o Robots.txt no WordPress

- Usando o Editor Robots.txt em All in One SEO

- Regras Padrão do Robots.txt no WordPress

- Adding Rules Using the Rule Builder

- Editando Regras Usando o Construtor de Regras

- Excluindo uma Regra no Construtor de Regras

- Alterando a Ordem das Regras no Construtor de Regras

- Importando Seu Próprio Robots.txt para All in One SEO

- Usando Regras Avançadas no Construtor de Regras

- Bloqueando Rastreadores Indesejados

- Bloquear o Rastreamento de URLs de Pesquisa Interna do Site

- Editor Robots.txt para WordPress Multisite

Vídeo Tutorial

Aqui está um vídeo sobre como usar a ferramenta Robots.txt em All in One SEO:

Sobre o Robots.txt no WordPress

Primeiro, é importante entender que o WordPress gera um robots.txt dinâmico para cada site WordPress.

Este robots.txt padrão contém as regras padrão para qualquer site rodando no WordPress.

Segundo, como o WordPress gera um robots.txt dinâmico, não há um arquivo estático para ser encontrado no seu servidor. O conteúdo do robots.txt é armazenado no seu banco de dados WordPress e exibido em um navegador web. Isso é perfeitamente normal e é muito melhor do que usar um arquivo físico no seu servidor.

Por último, All in One SEO não gera um robots.txt, ele apenas fornece uma maneira muito fácil de adicionar regras personalizadas ao robots.txt padrão que o WordPress gera.

OBSERVAÇÃO:

Embora o robots.txt gerado pelo WordPress seja uma página gerada dinamicamente e não um arquivo de texto estático no seu servidor, deve-se ter cuidado na criação de um robots.txt grande por dois motivos:

- Um robots.txt grande indica um conjunto potencialmente complexo de regras que pode ser difícil de manter

- O Google propôs um tamanho máximo de arquivo de 512KB para aliviar a carga nos servidores devido a longos tempos de conexão.

Usando o Editor Robots.txt em All in One SEO

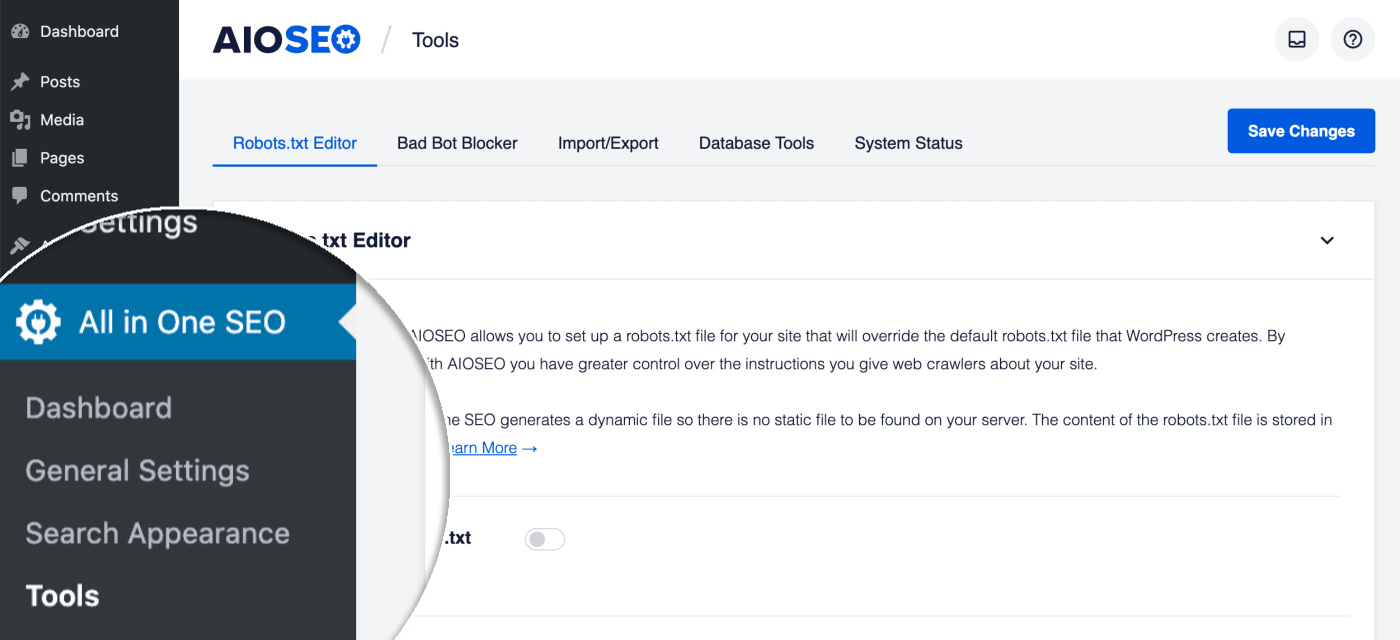

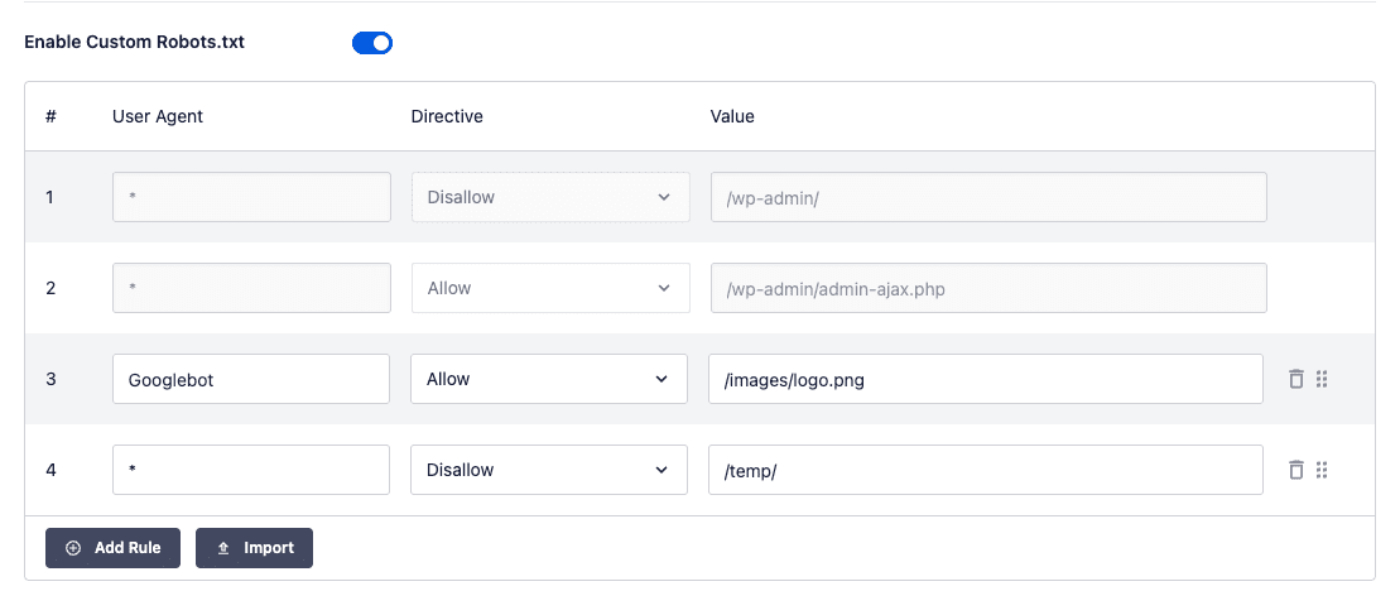

Para começar, clique em Ferramentas no menu All in One SEO.

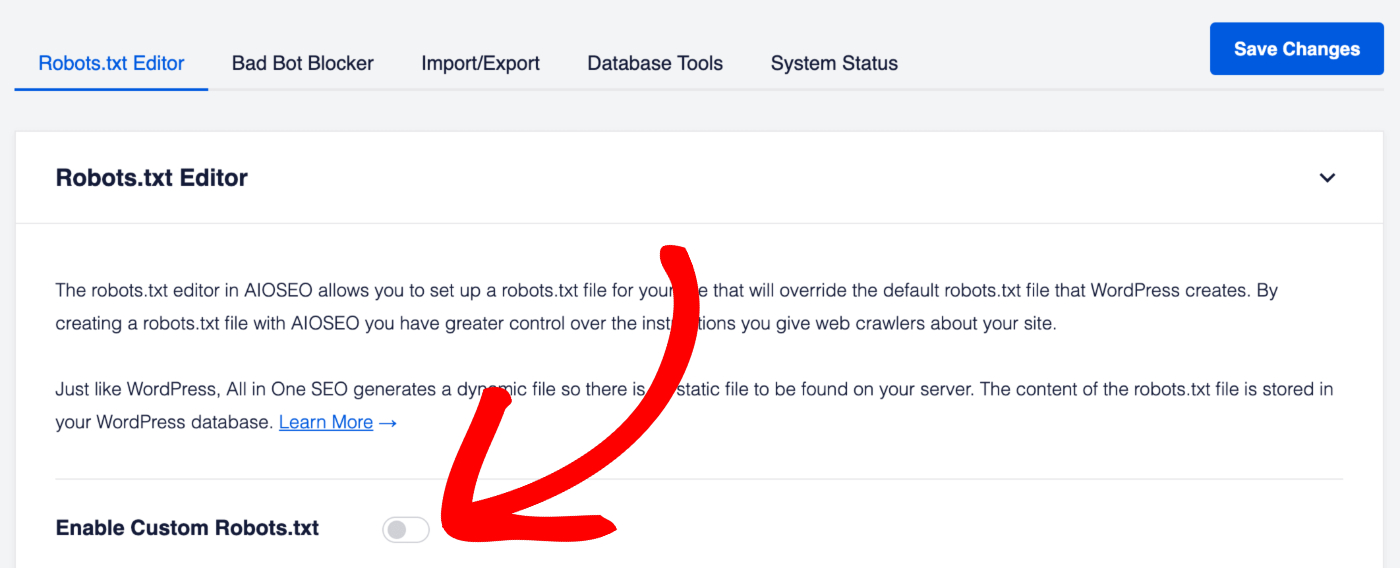

Você deverá ver o Editor Robots.txt e a primeira configuração será Habilitar Robots.txt Personalizado. Clique no alternador para habilitar o editor de robots.txt personalizado.

IMPORTANTE:

Você não precisa habilitar o Robots.txt Personalizado, a menos que tenha um motivo específico para adicionar uma regra personalizada.

O robots.txt padrão gerado pelo WordPress é perfeito para 99% de todos os sites. O recurso Robots.txt Personalizado é para aqueles usuários que precisam de regras personalizadas.

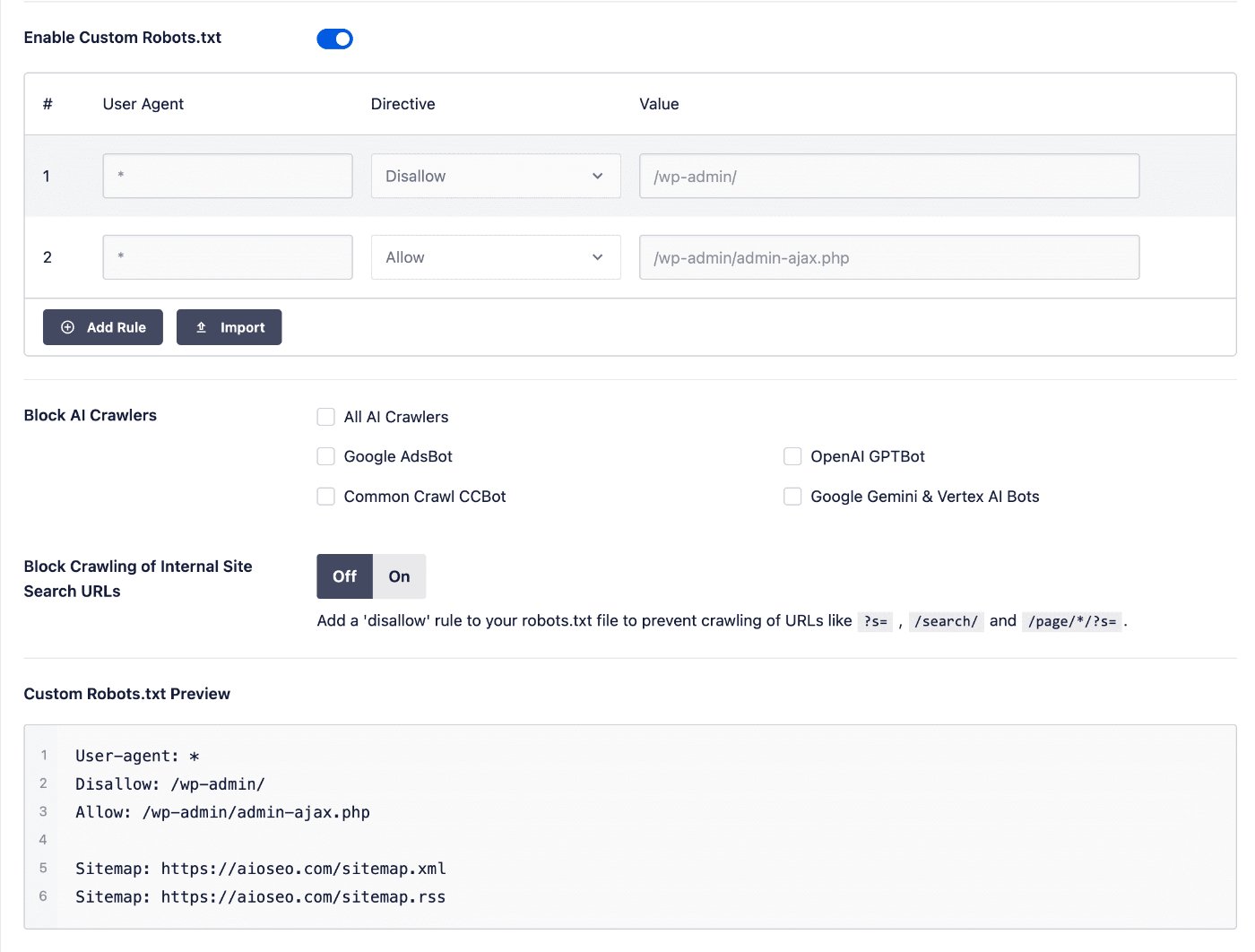

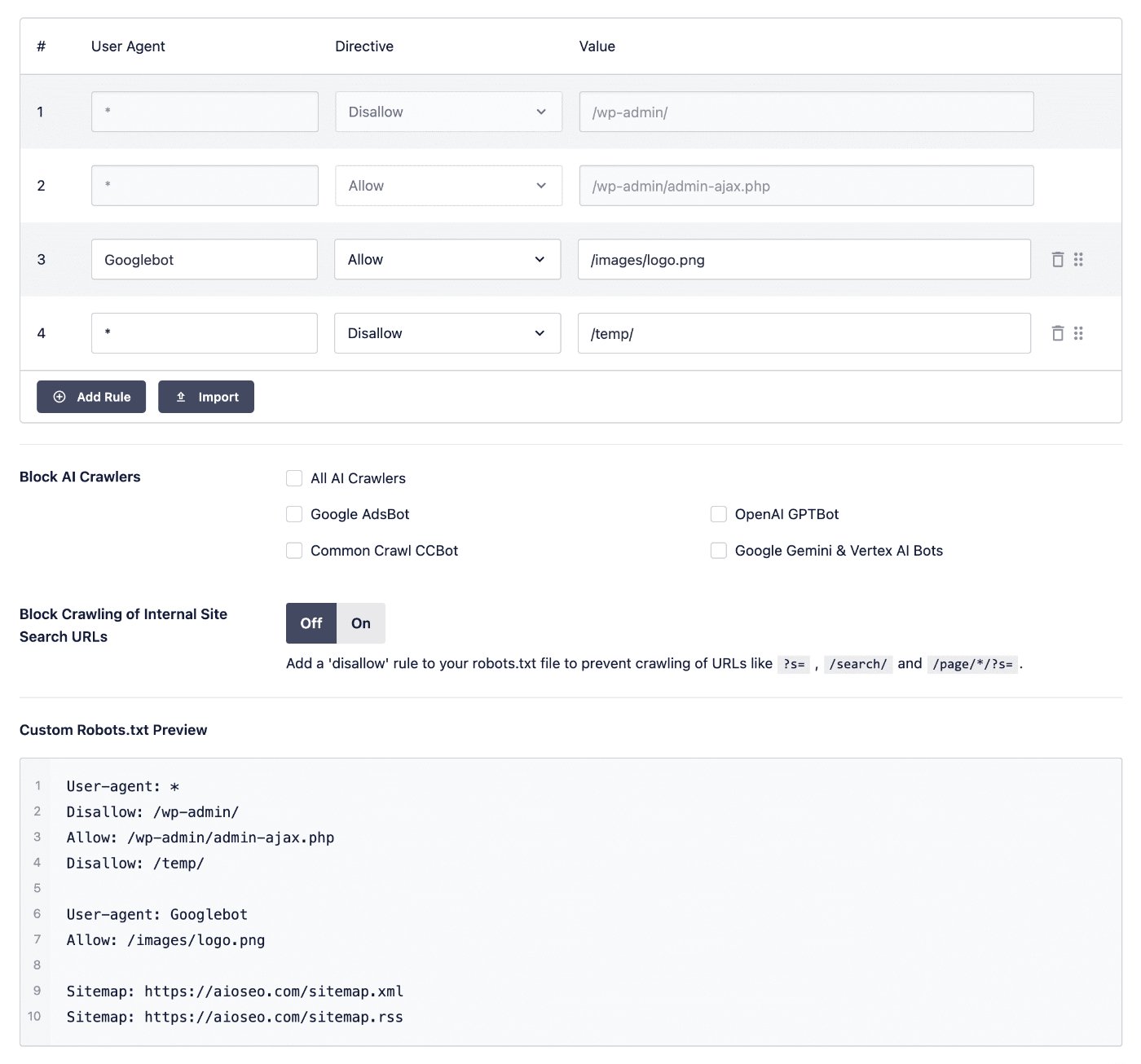

Você deve ver a seção Visualizar Robots.txt Personalizado na parte inferior da tela, que mostra as regras padrão adicionadas pelo WordPress.

Regras Padrão do Robots.txt no WordPress

As regras padrão que aparecem na seção Visualizar Robots.txt Personalizado (mostrada na captura de tela acima) pedem aos robôs para não rastrear seus arquivos principais do WordPress. É desnecessário que os mecanismos de busca acessem esses arquivos diretamente, pois eles não contêm nenhum conteúdo relevante do site.

Se, por algum motivo, você quiser remover as regras padrão adicionadas pelo WordPress, precisará usar o gancho de filtro robots_txt no WordPress.

Adicionando Regras Usando o Construtor de Regras

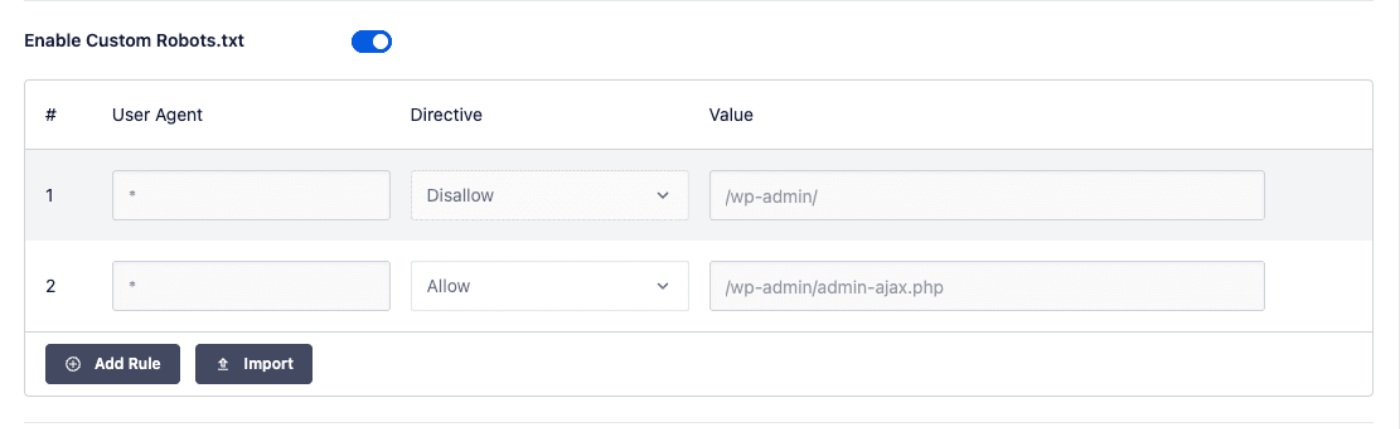

O construtor de regras é usado para adicionar suas próprias regras personalizadas para caminhos específicos em seu site.

Por exemplo, se você quiser adicionar uma regra para bloquear todos os robôs de um diretório temporário, poderá usar o construtor de regras para adicioná-la.

Para adicionar uma regra, clique no botão Adicionar Regra e, em seguida, preencha os campos descritos abaixo.

User Agent

Primeiro, insira o agente do usuário no campo Agente do Usuário.

Por exemplo, se você quiser especificar o rastreador do Google, insira "Googlebot" no campo Agente do Usuário.

Se você quiser uma regra que se aplique a todos os agentes de usuário, insira * no campo Agente do Usuário.

Diretiva

Em seguida, selecione o tipo de regra no menu suspenso Diretiva. Existem quatro tipos de regras que você pode selecionar:

- Permitir permitirá que os rastreadores com o agente de usuário especificado acessem o diretório ou arquivo no campo Valor.

- Bloquear bloqueará os rastreadores com o agente de usuário especificado de acessar o diretório ou arquivo no campo Valor.

- Clean-param permite excluir páginas com parâmetros de URL que podem fornecer o mesmo conteúdo com um URL diferente. O Yandex, o único mecanismo de busca que atualmente suporta essa diretiva, tem uma boa explicação com exemplos aqui.

- Crawl-delay informa aos rastreadores com que frequência eles podem rastrear seu conteúdo. Por exemplo, um atraso de rastreamento de 10 informa aos rastreadores para não rastrear seu conteúdo mais de uma vez a cada 10 segundos.

Atualmente, essa diretiva é suportada apenas por Bing, Yahoo e Yandex. Você pode alterar a taxa de rastreamento do rastreador do Google no Google Search Console.

Valor

Em seguida, insira o caminho do diretório ou o nome do arquivo no campo Valor.

Você pode inserir um caminho de diretório como /wp-content/backups/ e caminhos de arquivo como /wp-content/backups/temp.png.

Você também pode usar * como um curinga, como /wp-content/backup-*.

Se você quiser adicionar mais regras, clique no botão Adicionar Regra e repita as etapas acima.

Quando terminar, clique no botão Salvar Alterações.

Suas regras aparecerão na seção Visualizar Robots.txt Personalizado e em seu robots.txt, que você pode visualizar clicando no botão Abrir Robots.txt.

Editando Regras Usando o Construtor de Regras

Para editar qualquer regra que você adicionou, basta alterar os detalhes no construtor de regras e clicar no botão Salvar Alterações.

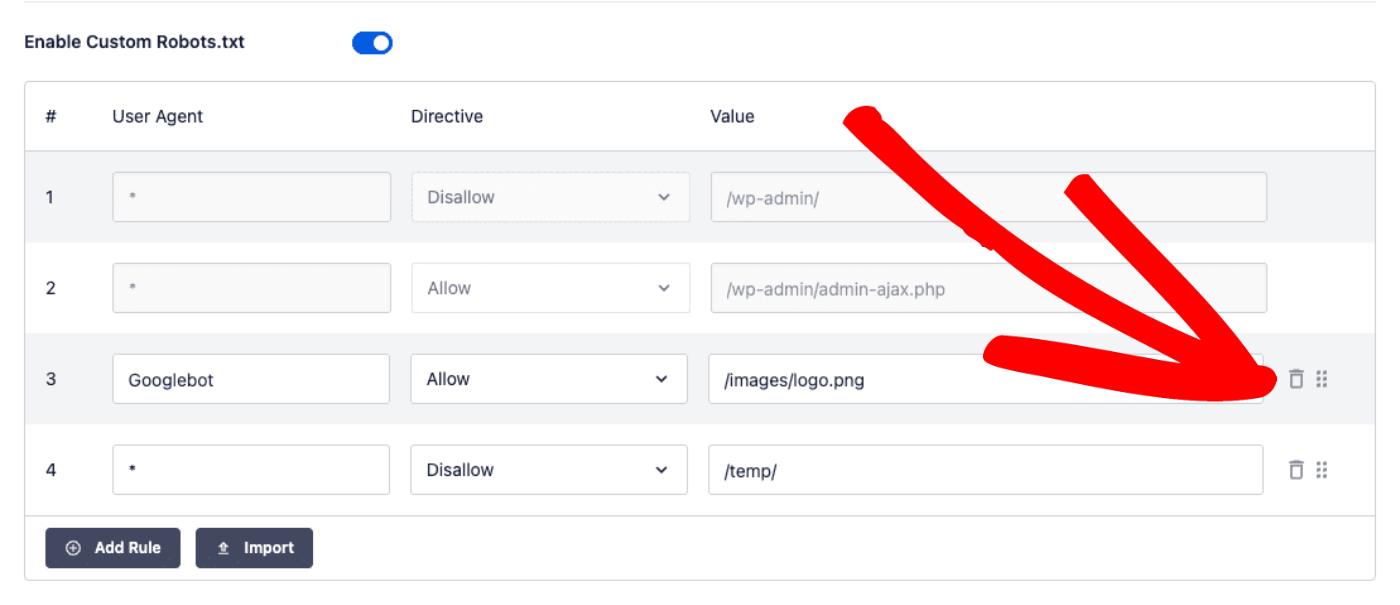

Excluindo uma Regra no Construtor de Regras

Para excluir uma regra que você adicionou, clique no ícone de lixeira à direita da regra.

Alterando a Ordem das Regras no Construtor de Regras

Você pode facilmente alterar a ordem em que suas regras personalizadas aparecem no seu robots.txt arrastando e soltando as entradas no construtor de regras.

Clique e segure o ícone de arrastar e soltar à direita da regra e mova a regra para onde você deseja que ela apareça, como visto abaixo.

Importando Seu Próprio Robots.txt para All in One SEO

Você pode importar seu próprio robots.txt ou regras de outra fonte com muita facilidade.

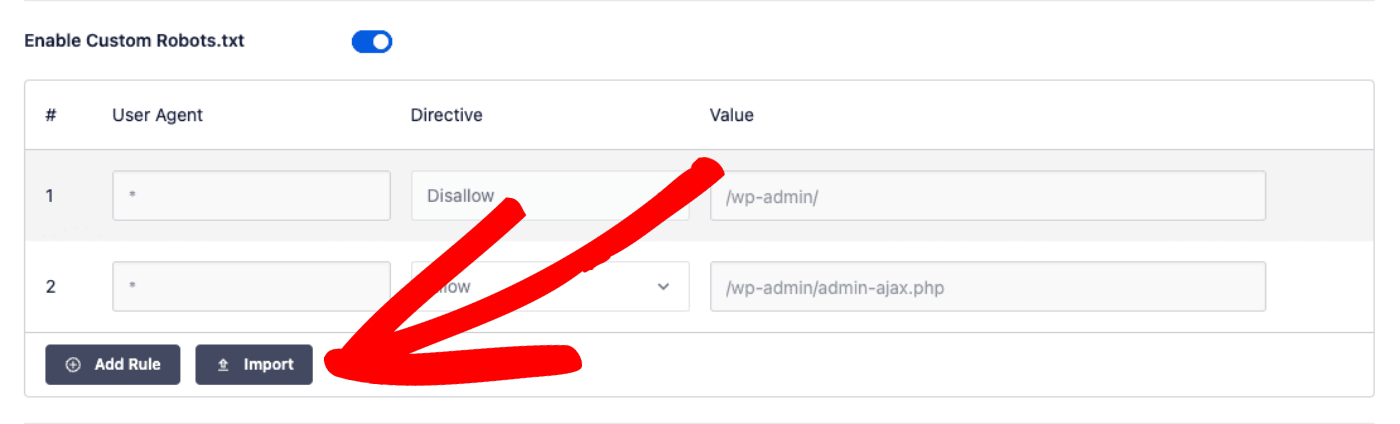

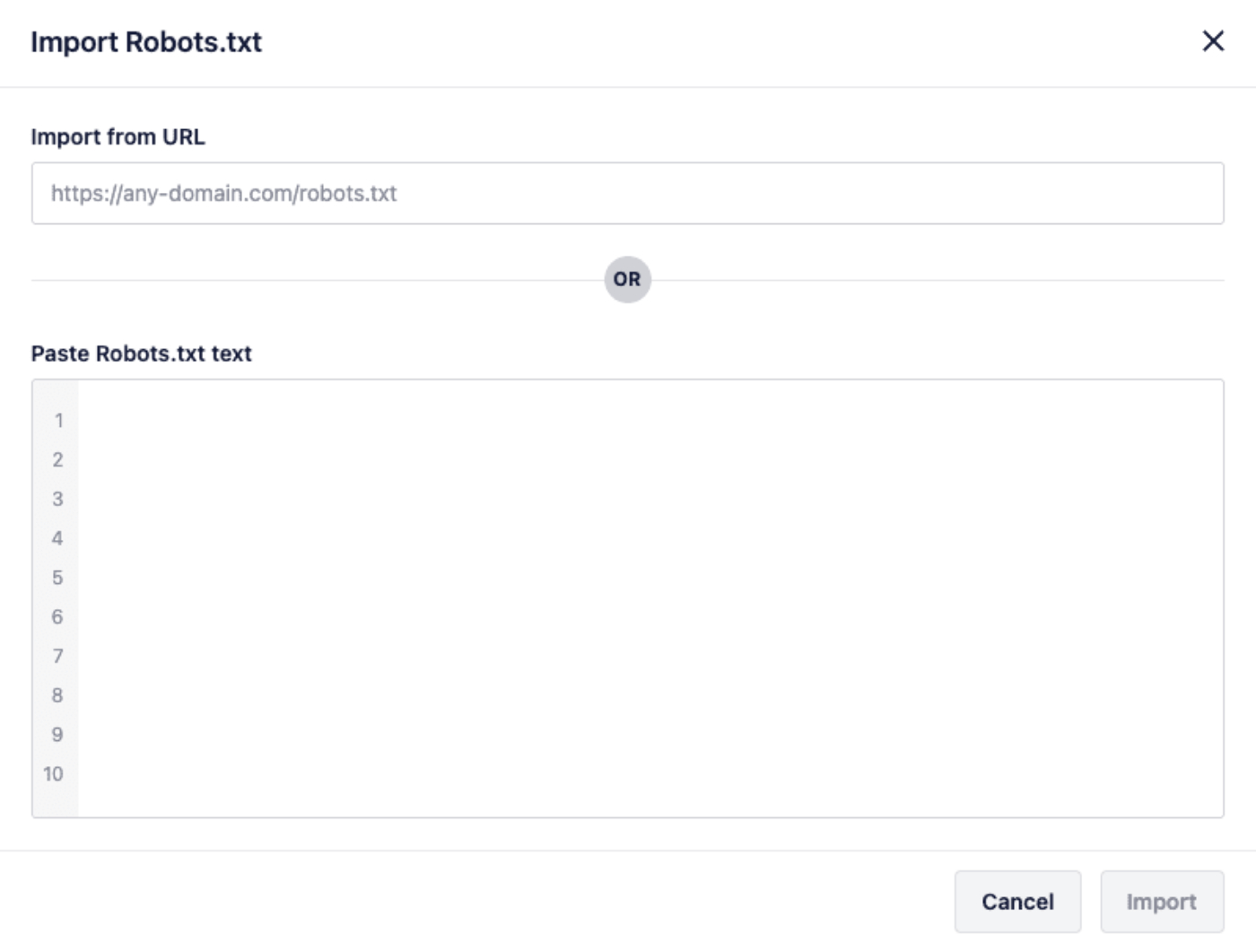

Primeiro, clique no botão Importar para abrir a janela Importar Robots.txt.

Na janela Importar Robots.txt, você pode importar de uma URL inserindo a URL de um robots.txt no campo Importar de URL ou pode colar o conteúdo de um robots.txt no campo Colar texto do Robots.txt.

Depois de fazer isso, clique no botão Importar.

Usando Regras Avançadas no Construtor de Regras

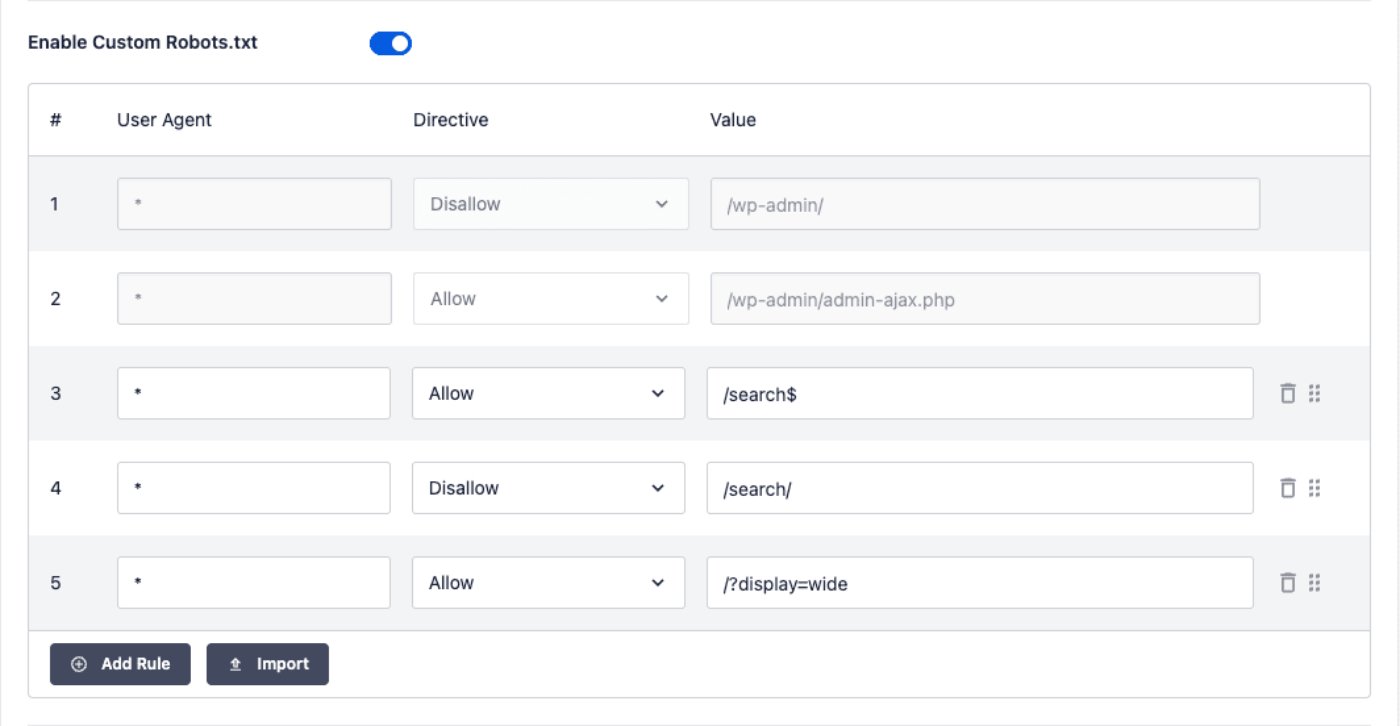

O Construtor de Regras do Robots.txt também suporta o uso de regras avançadas. Isso inclui padrões regex, bem como parâmetros de URL.

Aqui estão três exemplos de como as regras avançadas podem ser usadas:

Nos exemplos acima, estas regras avançadas são mostradas:

- /search$ – isso usa regex para permitir o acesso ao caminho exato “/search”

- /search/ – isso bloqueia o acesso a caminhos que começam com “/search/” mas não são uma correspondência exata

- /?display=wide – isso permite o acesso à página inicial com o parâmetro de URL correspondente

Regras avançadas como estas permitem controle granular sobre o arquivo robots.txt do seu site, para que você tenha controle total sobre como os user agents acessam seu site.

Bloqueando Rastreadores Indesejados

Você pode usar Bloquear Rastreadores de IA para adicionar regras ao seu robots.txt que bloqueiam rastreadores conhecidos, como rastreadores de IA e Google AdsBot.

Você pode selecionar cada um dos rastreadores para bloqueá-los, ou pode selecionar Todos os Rastreadores de IA para bloquear todos os listados.

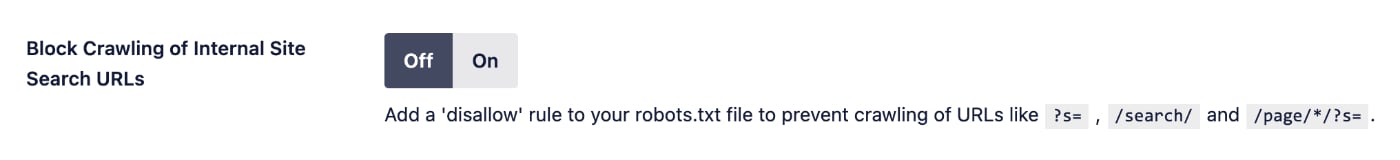

Bloquear o Rastreamento de URLs de Pesquisa Interna do Site

Você pode usar a configuração Bloquear Rastreamento de URLs de Pesquisa Interna do Site para adicionar regras ao seu robots.txt para impedir o rastreamento de URLs de páginas de pesquisa. Isso reduz o rastreamento desnecessário do seu site.

Editor Robots.txt para WordPress Multisite

Há também um Editor de Robots.txt para Redes Multissite. Os detalhes podem ser encontrados em nossa documentação sobre o Editor de Robots.txt para Redes Multissite aqui.