Vuoi aumentare le possibilità che i tuoi contenuti vengano correttamente scansionati e indicizzati?

Allora sarai entusiasta quanto noi del nostro ultimo aggiornamento del plugin!

Abbiamo ascoltato i tuoi feedback e aggiunto più potenza e funzionalità al nostro editor robots.txt.

In questo articolo

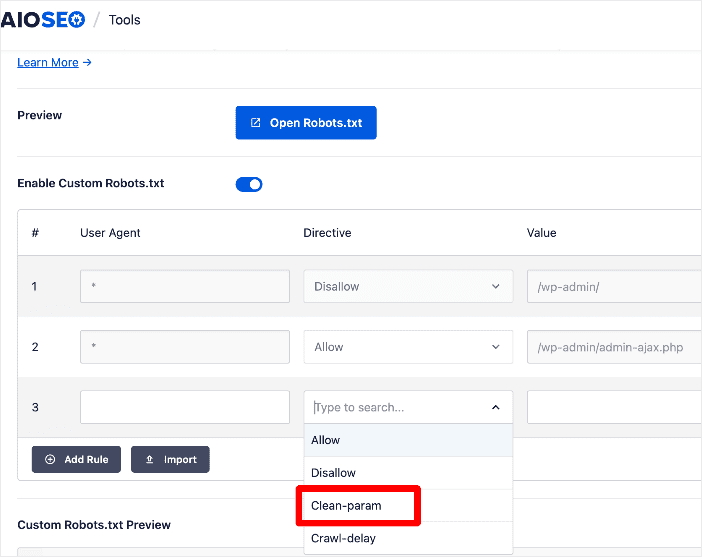

Clean-param: Riduci le scansioni non necessarie

Una delle nuove direttive di scansione che abbiamo aggiunto al nostro editor robots.txt è la direttiva Clean-param.

Questa potente direttiva istruisce i bot di ricerca a ignorare i parametri dell'URL come i parametri GET (come gli ID di sessione) e i tag (UTM). Questi possono causare molti problemi per la tua SEO, tra cui:

- Problemi di contenuti duplicati

- Spreco del budget di scansione

- Problemi di indicizzazione

Questi fattori fanno sì che i motori di ricerca impieghino più tempo per raggiungere e scansionare le pagine importanti del tuo sito.

Clean-param è una funzionalità potente che ti offre un controllo più granulare su come i motori di ricerca scansionano il tuo sito. Di conseguenza, aumenti le possibilità che le pagine giuste si posizionino sui motori di ricerca.

Nota: Clean-param è attualmente supportato solo da Yandex.

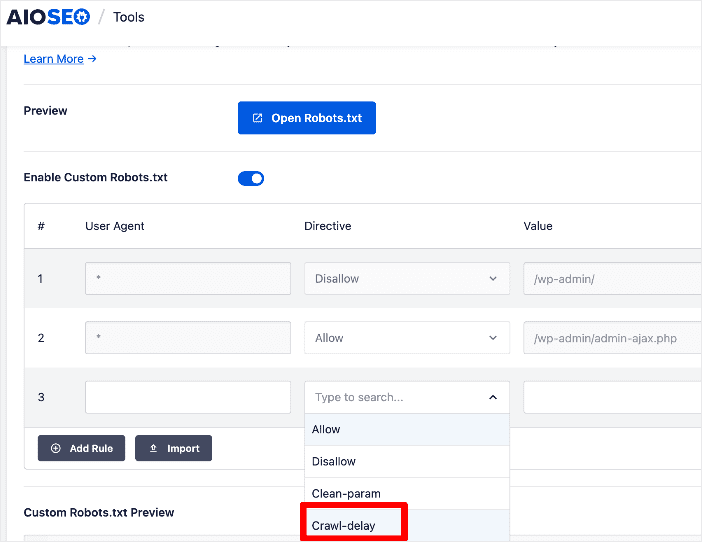

Crawl-delay: Regola la frequenza di scansione

Un'altra nuova direttiva nel nostro editor robots.txt è la direttiva Crawl-delay.

Crawl-delay è una direttiva utilizzata nel file robots.txt per istruire i bot dei motori di ricerca sulla velocità con cui dovrebbero accedere e scansionare il tuo sito. Questa direttiva è particolarmente utile quando si desidera controllare la frequenza delle visite dei bot per evitare di sovraccaricare il server, specialmente se si hanno risorse del server limitate o traffico elevato. Ciò può influire sulle prestazioni del tuo sito web o, in alcuni casi estremi, renderlo inaccessibile.

Aggiungere la direttiva crawl delay può aiutarti a evitare di sovraccaricare il tuo server durante i periodi in cui prevedi molto traffico.

Nota: Crawl-delay è supportato solo da Bing, Yahoo e Yandex.

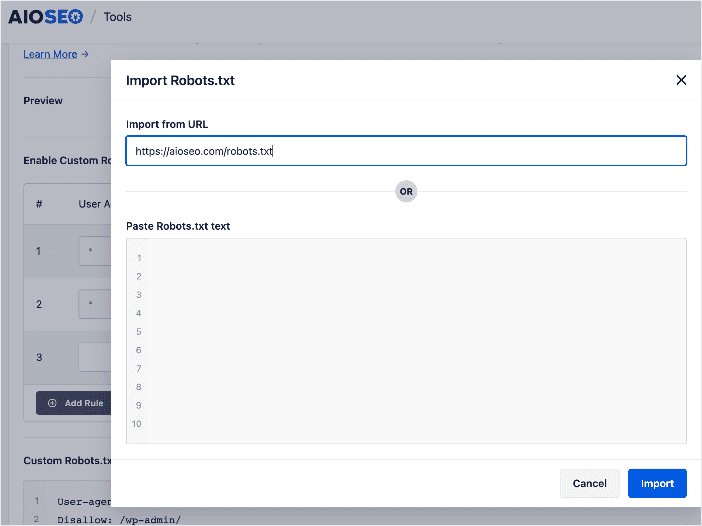

Importa regole robots.txt da qualsiasi sito

Se stai configurando un nuovo sito web e vuoi implementare un file robots.txt di base, puoi risparmiare tempo e fatica utilizzando semplicemente le regole di un sito esistente come punto di partenza.

Per aiutarti in questo, abbiamo aggiunto una funzione Importa al nostro editor robots.txt.

Puoi utilizzare questa funzione per importare un file robots.txt da un sito inserendo l'URL o visitando il sito e quindi copiando e incollando il file robots.txt.

Se stai lavorando su un sito web simile a un altro, potresti scoprire che hanno implementato regole utili che sono applicabili anche al tuo sito. Questo può farti risparmiare tempo nella creazione delle tue regole. Può anche aiutarti a evitare errori se sei ancora nuovo nell'editing dei file robots.txt.

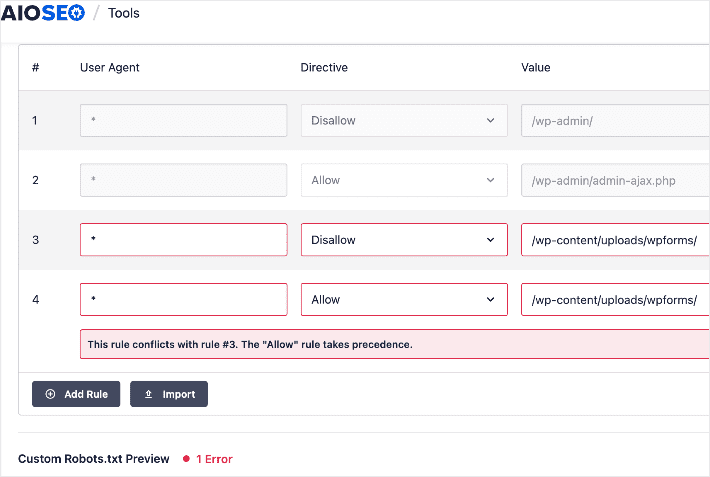

Validazione delle regole e gestione degli errori migliorate

Oltre alle potenti direttive e alla funzionalità di importazione, abbiamo anche migliorato la validazione delle regole e la gestione degli errori nel nostro editor robots.txt. Questo ti aiuta a individuare rapidamente regole in conflitto o altri errori nel tuo robots.txt.

Puoi facilmente eliminare la regola errata facendo clic sull'icona del cestino accanto ad essa.

Con queste ultime aggiunte al nostro plugin, migliorare la tua crawlability e indicizzabilità è diventato più facile. Di conseguenza, il tuo sito e i tuoi contenuti hanno maggiori possibilità di posizionarsi in alto nelle pagine dei risultati dei motori di ricerca.

Abbiamo anche aggiunto funzionalità avanzate aggiuntive nel nostro editor robots.txt. Dai un'occhiata a questa documentazione per maggiori dettagli.

Oltre a questo importante aggiornamento, abbiamo apportato diversi miglioramenti degni di nota a molte funzionalità che ami. Puoi vedere tutte le nostre modifiche nel nostro changelog completo del prodotto.

Cosa stai aspettando?

Aggiorna il tuo sito ad AIOSEO 4.4.4 per sbloccare queste potenti nuove funzionalità e posizionare i tuoi contenuti più in alto nelle SERP.

E se non stai ancora usando AIOSEO, assicurati di installare e attivare il plugin oggi stesso.

Se hai domande su queste funzionalità, commenta qui sotto o contatta il nostro team di supporto clienti. Siamo sempre pronti ad aiutarti. Il nostro impegno a rendere AIOSEO il plugin SEO WordPress più facile e migliore diventa solo più forte mentre continuiamo a vincere insieme ai nostri clienti.

Siamo così grati per il tuo continuo supporto, feedback e suggerimenti. Continuate a inviarci suggerimenti e richieste di funzionalità!

Speriamo che ti piaccia usare queste nuove funzionalità SEO tanto quanto ci è piaciuto crearle.

-Benjamin Rojas (Presidente di AIOSEO).

Divulgazione: I nostri contenuti sono supportati dai lettori. Ciò significa che se fai clic su alcuni dei nostri link, potremmo guadagnare una commissione. Raccomandiamo solo prodotti che crediamo aggiungeranno valore ai nostri lettori.

Potrebbe ancora essere più facile per una conoscenza tecnica di livello intermedio. Ancora dopo 2 anni non so bene se uso tutte le funzioni/correttamente.

Grazie per aver pubblicato su questo argomento. I clienti chiedono sempre come ottimizzare il crawling!

Salute a buoni contenuti :)

Quali impostazioni dovremmo usare per la migliore SEO?