Gostaria de saber como editar arquivos robots.txt no WordPress?

Eu costumava ficar intimidado ao editar arquivos robots.txt no WordPress. Como alguém que construiu e gerenciou mais de uma dúzia de sites WordPress, lembro-me de encarar minha tela, preocupado que um movimento em falso pudesse prejudicar o SEO do meu site.

O arquivo robots.txt pode parecer assustador, mas na verdade é um arquivo de texto simples que informa aos mecanismos de busca quais partes do seu site eles podem ou não acessar. Após anos trabalhando com WordPress, aprendi que editar este arquivo não precisa ser complicado.

Neste guia passo a passo, mostrarei as maneiras mais fáceis e seguras de editar seu arquivo robots.txt no WordPress. Se você deseja bloquear certas páginas de mecanismos de busca ou corrigir problemas de SEO, aprenderá exatamente o que fazer.

Não se preocupe - vou guiá-lo por cada etapa, para que você não quebre nada.

Neste Artigo

O Que É um Arquivo Robots.txt?

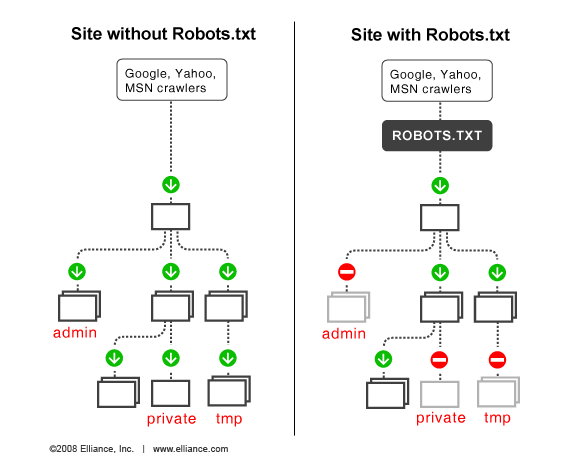

Um arquivo robots.txt informa aos mecanismos de busca como rastrear seu site - para onde eles têm permissão para ir ou não.

Mecanismos de busca como o Google usam esses rastreadores da web, às vezes chamados de robôs da web, para arquivar e categorizar sites.

A maioria dos bots é configurada para procurar um arquivo robots.txt no servidor antes de ler qualquer outro arquivo do seu site. Ele faz isso para ver se você adicionou instruções especiais sobre como rastrear e indexar seu site.

O arquivo robots.txt é normalmente armazenado no diretório raiz, também conhecido como a pasta principal do seu site.

A URL pode parecer com isto:

http://www.example.com/robots.txt

Para verificar o arquivo robots.txt do seu site, basta substituir http://www.example.com/ pelo seu domínio e adicionar robots.txt no final.

Agora, vamos dar uma olhada em como é o formato básico de um arquivo robots.txt:

User-agent: [user-agent name]

Disallow: [URL string not to be crawled]

User-agent: [user-agent name]

Allow: [URL string to be crawled]

Sitemap: [URL of your XML Sitemap]

User-agent refere-se ao bot ou robô do mecanismo de busca que você deseja bloquear ou permitir que rastreie seu site (por exemplo, o rastreador Googlebot).

Ao editar seu arquivo robots.txt, você pode incluir várias instruções para Permitir ou Negar URLs específicas, além de adicionar vários sitemaps. Você também pode excluir parâmetros de URL usando a diretiva Clean-param e definir a frequência de visitas por bots de busca usando a diretiva Crawl-delay.

Arquivo Robots.txt Padrão no WordPress

Por padrão, o WordPress cria automaticamente um arquivo robots.txt para o seu site. Portanto, mesmo que você não faça nada, seu site já deve ter o arquivo robots.txt padrão do WordPress.

Mas quando você o personaliza posteriormente com suas próprias regras, o conteúdo padrão é substituído.

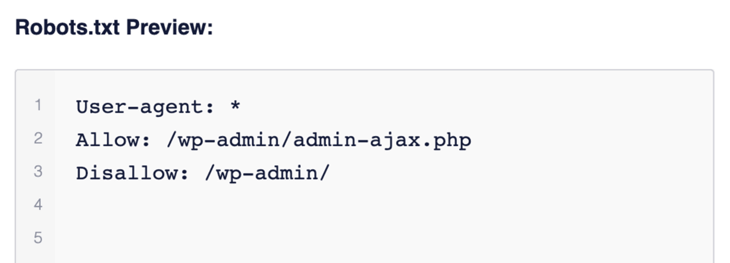

Veja como o arquivo robots.txt padrão do WordPress se parece:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

O asterisco após User-agent: * significa que o arquivo robots.txt é para todos os robôs da web que visitam seu site. Como mencionado, o Disallow: /wp-admin/ instrui os robôs a não visitarem sua página wp-admin.

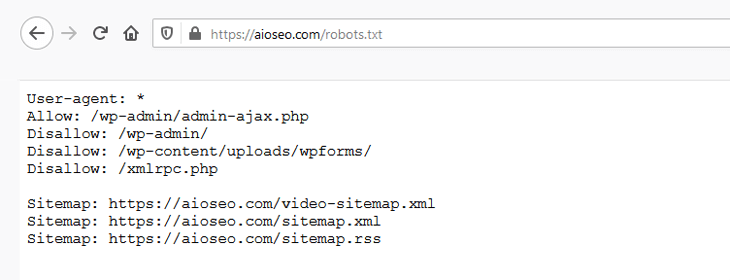

Você pode testar seu arquivo robots.txt adicionando /robots.txt ao final do nome do seu domínio. Por exemplo, se você digitar “https://aioseo.com/robots.txt” em seu navegador, ele exibirá o arquivo robots.txt do AIOSEO:

Agora que você sabe o que é um arquivo robots.txt e como ele funciona, vamos ver por que o arquivo robots.txt é importante em primeiro lugar.

Por que o Arquivo Robots.txt é Importante?

O arquivo robots.txt é importante se você deseja:

- Otimizar a Velocidade de Carregamento do seu Site — ao dizer aos bots para não perderem tempo em páginas que você não quer que eles rastreiem e indexem, você pode liberar recursos e aumentar a velocidade de carregamento do seu site.

- Otimizar o Uso do seu Servidor — bloquear bots que estão desperdiçando recursos limpa seu servidor e reduz erros 404.

Quando Usar a Tag Meta Noindex em Vez de Robots.txt

Se seu objetivo principal é impedir que certas páginas sejam incluídas nos resultados dos motores de busca, usar uma meta tag noindex é a abordagem correta.

Isso ocorre porque o robots.txt não está dizendo diretamente aos motores de busca para não indexar o conteúdo – está apenas dizendo a eles para não rastreá-lo.

Em outras palavras, você pode usar o robots.txt para adicionar regras específicas sobre como os motores de busca e outros bots interagem com seu site, mas ele não controlará explicitamente se seu conteúdo será indexado ou não.

Dito isso, vamos mostrar como editar facilmente seu arquivo robots.txt no WordPress passo a passo usando o AIOSEO.

Editando seu Robots.txt no WordPress Usando AIOSEO

A maneira mais fácil de editar o arquivo robots.txt é usar o melhor plugin de SEO para WordPress, o All in One SEO (AIOSEO).

AIOSEO é um plugin de SEO poderoso, porém fácil de usar, que conta com mais de 3 milhões de usuários. Isso significa que milhões de blogueiros inteligentes usam o AIOSEO para ajudá-los a impulsionar seus rankings nos motores de busca e direcionar tráfego qualificado para seus blogs. Isso ocorre porque o plugin possui muitos recursos e módulos poderosos projetados para ajudá-lo a configurar corretamente suas configurações de SEO. Exemplos incluem:

- Estatísticas de Pesquisa: Esta poderosa integração com o Google Search Console permite que você acompanhe suas classificações de palavras-chave e veja métricas importantes de SEO com 1 clique, e mais.

- Gerador de Schema de próxima geração: Este gerador de schema sem código permite aos usuários gerar e exibir qualquer marcação de schema em seu site.

- Gerenciador de Redirecionamento: Ajuda você a gerenciar redirecionamentos e eliminar erros 404, facilitando para os mecanismos de pesquisa rastrear e indexar seu site.

- Assistente de Links: Poderosa ferramenta de linkagem interna que automatiza a construção de links entre páginas do seu site. Ele também fornece uma auditoria de links de saída.

- Pré-visualização de SEO: Isso oferece uma visão geral de seus snippets de pesquisa e sociais e SEO geral para que você possa melhorar sua otimização.

- IndexNow: Para indexação rápida em motores de busca que suportam o protocolo IndexNow (como Bing e Yandex).

- Gerador de Sitemap: Gere automaticamente diferentes tipos de sitemaps para notificar todos os mecanismos de pesquisa sobre quaisquer atualizações em seu site.

- E mais.

Uma razão pela qual os usuários amam o plugin é que ele oferece maior controle sobre como os motores de busca rastreiam seu site. Isso graças ao editor avançado de robots.txt que permite configurar facilmente seu arquivo robots.txt, permitindo que você substitua o arquivo padrão do WordPress.

Confira nossa lista dos melhores geradores de robots.txt.

Confira nossa lista dos melhores geradores de robots.txt.

Então, vamos editar seu arquivo robots.txt.

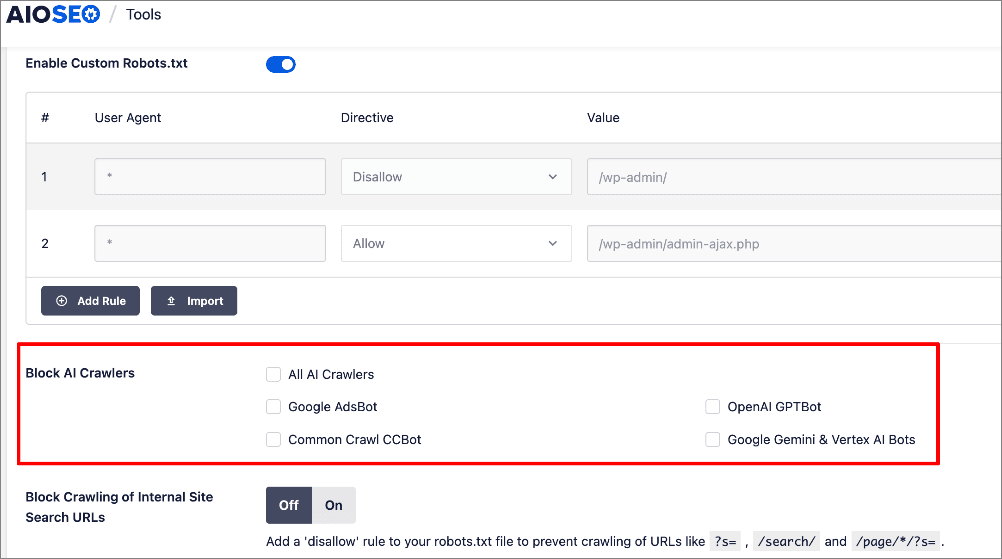

Para Editar Seu Arquivo Robots.txt, Primeiro Ative o Robots.txt Personalizado

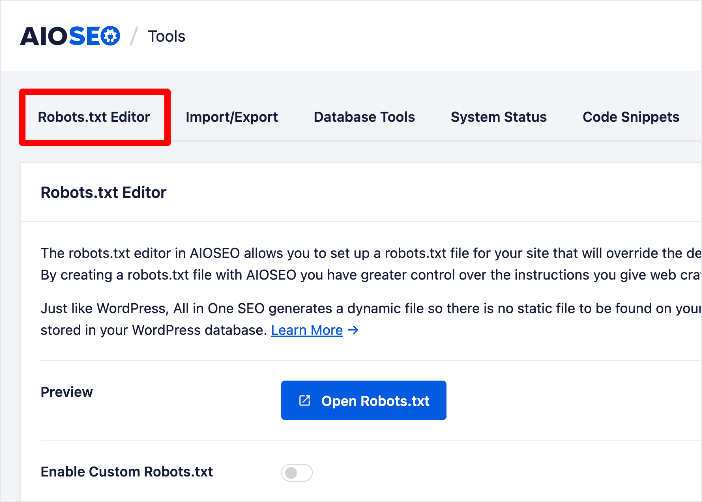

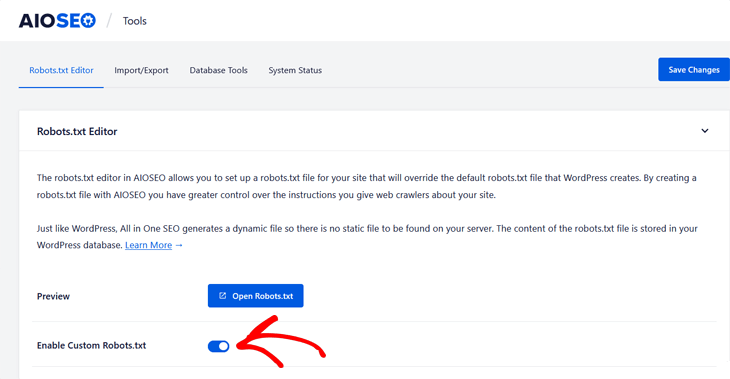

Para editar seu arquivo robots.txt, clique em Ferramentas no menu All in One SEO e, em seguida, clique na guia Editor de Robots.txt.

O AIOSEO gerará então um arquivo robots.txt dinâmico. Seu conteúdo é armazenado no seu banco de dados WordPress e pode ser visualizado no seu navegador, como mostraremos em breve.

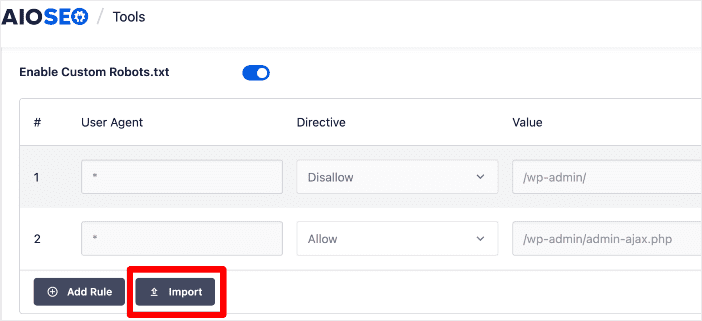

Depois de acessar o Editor de Robots.txt, você precisa Ativar Robots.txt Personalizado.

Clique no botão para que ele fique azul.

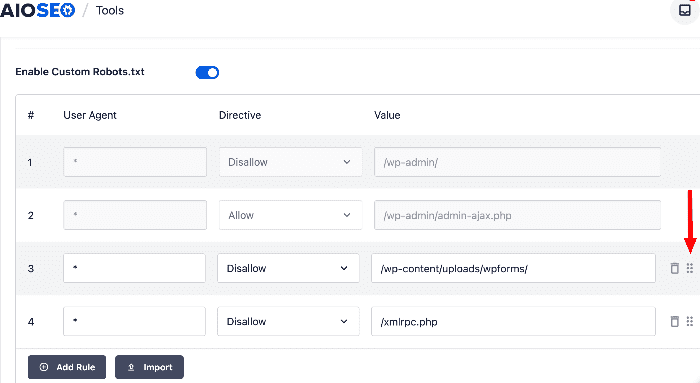

Você verá então a seção Pré-visualização de Robots.txt na parte inferior da tela, que mostra as regras padrão do WordPress que você pode substituir pelas suas. As regras padrão instruem os robôs a não rastrear seus arquivos principais do WordPress (páginas de administração).

Agora, vamos adicionar suas próprias regras. Você pode fazer isso de 2 maneiras: usando o construtor de regras ou importando um arquivo robots.txt de outro site.

Método 1: Adicionar Regras Usando o Construtor de Regras

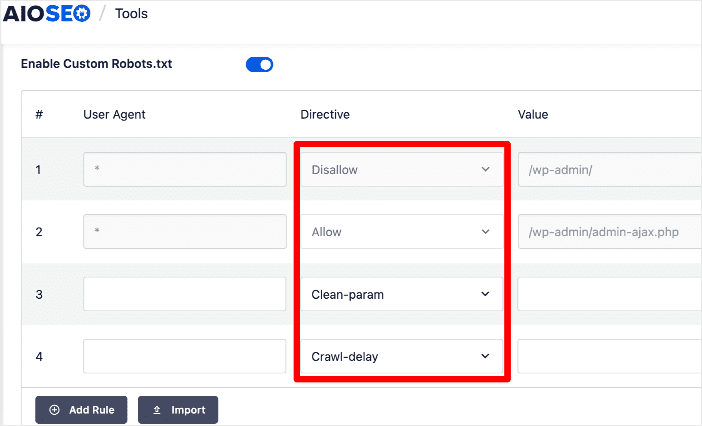

O construtor de regras é usado para adicionar suas próprias regras personalizadas sobre quais páginas os robôs devem rastrear ou não.

Por exemplo, você pode usar o construtor de regras se quiser adicionar uma regra que bloqueie todos os robôs de um diretório temporário.

Para adicionar uma regra personalizada, insira o User Agent (por exemplo, o rastreador Googlebot) no campo User Agent. Ou você pode usar o símbolo * para aplicar sua regra a todos os user agents (robôs).

Em seguida, selecione uma das diretivas predefinidas do robots.txt: Allow, Disallow, Clean-param ou Crawl-delay.

Você também pode adicionar mais diretivas clicando no botão Adicionar Regra.

Depois de decidir a diretiva a ser aplicada, você precisa inserir o caminho do diretório ou o nome do arquivo no campo Valor.

Feito isso, você pode clicar no botão Salvar Alterações no canto inferior direito da página.

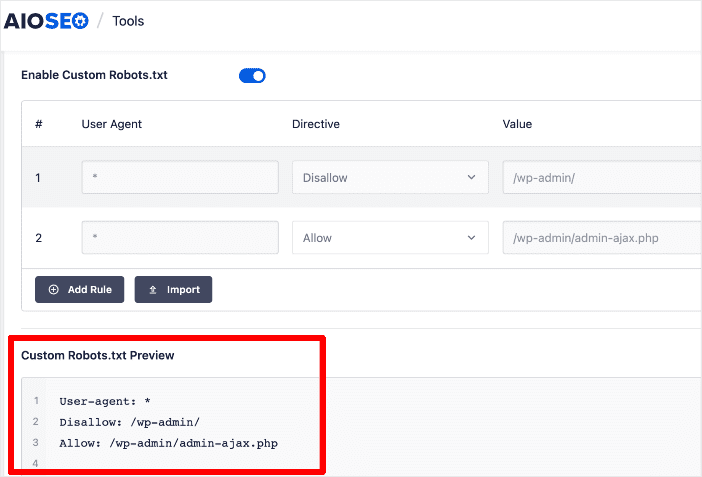

Quando você salvar suas novas regras, elas aparecerão na seção Pré-visualização de Robots.txt.

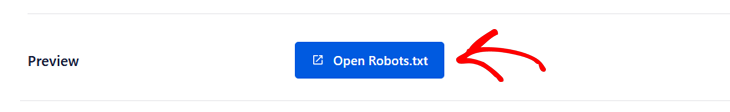

Para visualizar seu arquivo robots.txt, clique no botão Abrir Robots.txt.

Isso o levará ao URL onde seu robots.txt está hospedado.

Método 2: Importar Regras de Outro Site

Outra maneira fácil de adicionar diretivas ao seu robots.txt é importá-las de outro site. Essa função é útil se você criou um site ou conhece um com um arquivo robots.txt que gostaria de replicar.

Para importar um arquivo robots.txt de outro site, vá ao menu AIOSEO, depois Ferramentas » Robots.txt » Ativar Robots.txt Personalizado.

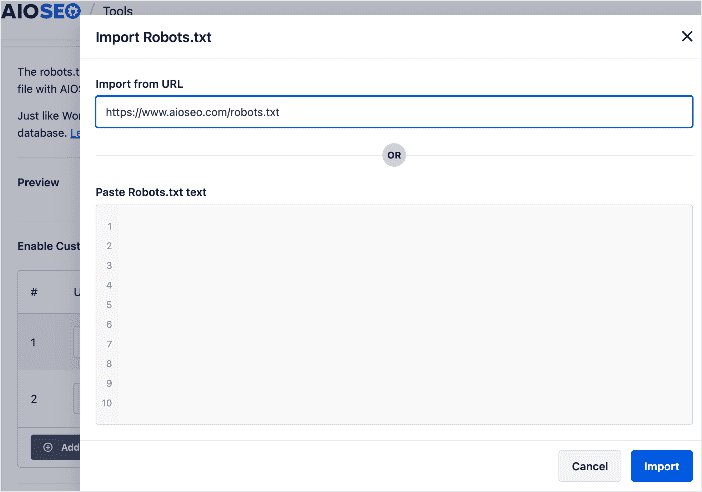

Em seguida, clique na opção Importar.

Isso abrirá uma janela onde você pode colar o URL do site do qual deseja obter o arquivo robots.txt.

Clique em Importar, e você será solicitado a recarregar seu site. Recarregue e o plugin buscará o arquivo robots.txt e o implementará em seu site.

Alternativamente, você pode copiar o arquivo robots.txt do seu site de destino e colá-lo no espaço fornecido. Novamente, clique em Importar, e o arquivo robots.txt será adicionado ao seu site.

Esta é provavelmente a maneira mais fácil de adicionar um arquivo robots.txt personalizado ao seu site WordPress.

Editando as Regras do Robots.txt Usando o Construtor de Regras

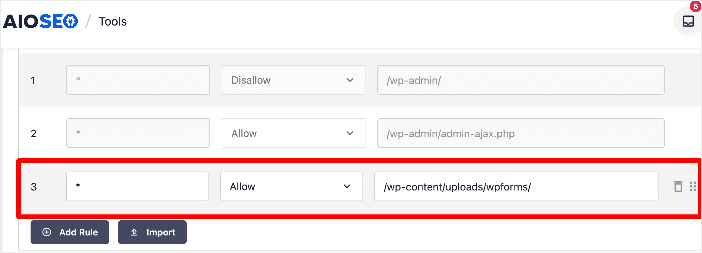

Para editar suas regras de robots.txt, você pode alterar os detalhes no construtor de regras.

Você também pode excluir uma regra no arquivo robots.txt clicando no ícone da lixeira à direita da regra.

E isso não é tudo! O editor robots.txt do AIOSEO permite que você mova regras para cima ou para baixo para colocá-las em ordem de prioridade. Para fazer isso, clique e segure os 6 pontos ao lado da lixeira para arrastar e reposicionar uma regra.

Quando terminar de editar seu robots.txt, clique no botão Salvar Alterações para salvar suas novas regras.

Funções Bônus de Edição de Robots.txt

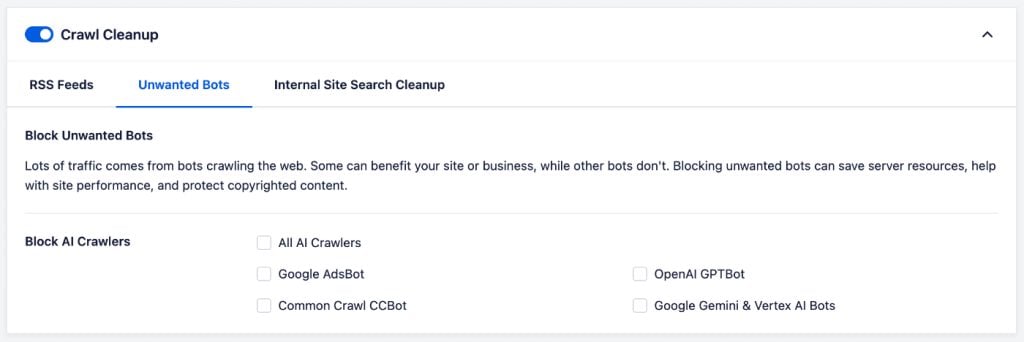

Bloqueando Bots ou Rastreadores da Web Indesejados [Maneira Fácil]

Rastreadores da web, também conhecidos como bots ou spiders, são uma faca de dois gumes. Muitos, como os mecanismos de busca, são necessários para o sucesso do seu site. No entanto, alguns podem simplesmente consumir os recursos do seu servidor, deixar seu site lento ou até roubar seu conteúdo.

Como eu costumo lidar com isso?

Como não tenho formação técnica, sempre procuro o caminho mais fácil 😜. A maneira mais fácil de impedir que bots indesejados rastreiem seu site é usar o recurso Crawl Cleanup do AIOSEO. Ele vem com configurações que ajudam você a gerenciar o tráfego de bots em seu site.

Este recurso permite que você selecione os bots que deseja impedir de rastrear seu site. Tudo o que você precisa fazer é selecionar aqueles que deseja bloquear.

Quando você bloqueia um bot indesejado, o AIOSEO edita o arquivo robots.txt com as diretivas disallow. Este recurso também está integrado ao editor robots.txt para facilitar isso.

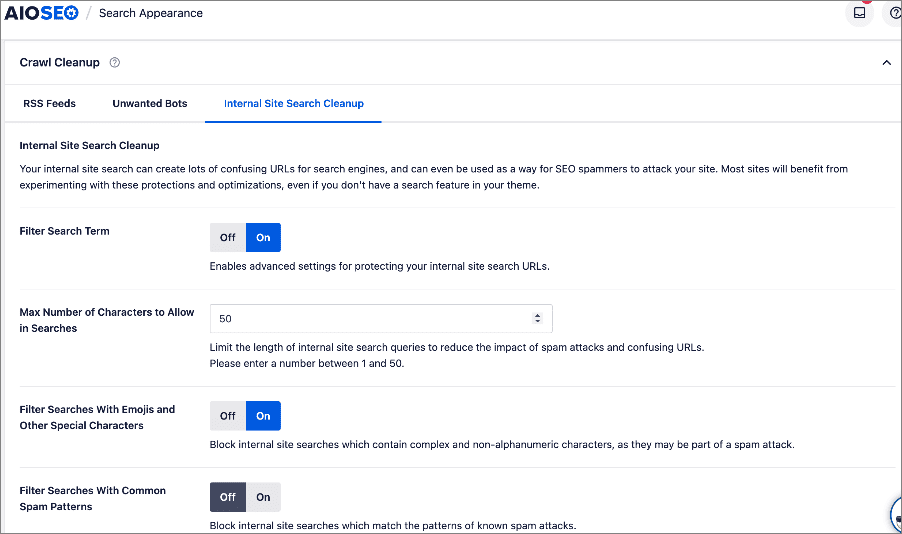

Bloqueando Pesquisas Internas do Site

Sites frequentemente geram URLs desnecessárias de pesquisas internas, levando a orçamentos de rastreamento desperdiçados e potencial spam. Novamente, isso pode ser facilmente resolvido usando o Crawl Cleanup do AIOSEO. Tudo o que você precisa fazer é configurar os filtros usando os toggles.

O AIOSEO lhe dá o poder de controlar como os mecanismos de busca e outros bots interagem com os URLs criados por pesquisas internas do site. Você pode:

- Definir um limite máximo de caracteres para consultas de pesquisa, evitando URLs de pesquisa inchadas.

- Filtrar automaticamente emojis e caracteres especiais para evitar termos de pesquisa confusos ou sem sentido.

- Bloquear padrões comuns de spam, impedindo que pesquisas inúteis criem URLs indexáveis desnecessárias.

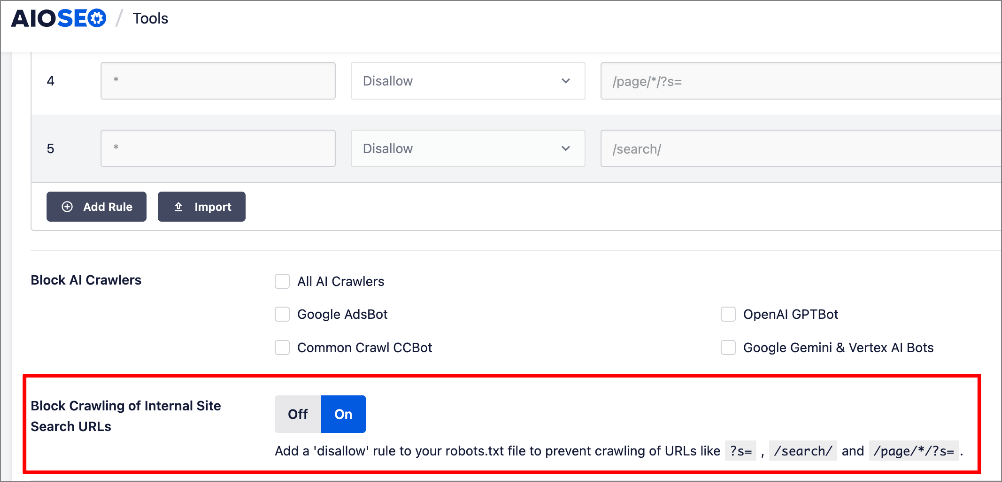

Novamente, o AIOSEO edita seu arquivo robots.txt em segundo plano. Alternativamente, você também pode configurar essas configurações em seu editor robots.txt:

Simples assim!

Você editou seu arquivo robots.txt.

Editando Arquivos Robots.txt: Suas Perguntas Frequentes Respondidas

O que é um arquivo robots.txt?

Um arquivo robots.txt é um arquivo de texto que os proprietários de sites usam para se comunicar com rastreadores da web ou robôs sobre quais partes de seu site devem ser rastreadas e indexadas pelos mecanismos de busca.

Onde o arquivo robots.txt está localizado?

O arquivo robots.txt geralmente está localizado no diretório raiz de um site. Seu URL é normalmente https://www.example.com/robots.txt.

Qual é a melhor maneira de editar arquivos robots.txt?

A melhor maneira de editar seu arquivo robots.txt é usar um plugin como o All In One SEO (AIOSEO). É o melhor plugin de SEO para WordPress e possui um editor avançado de robots.txt que torna a otimização de arquivos robots.txt super fácil.

Esperamos que este tutorial tenha mostrado como editar facilmente um arquivo robots.txt no WordPress. Você também pode querer conferir outros artigos em nosso blog, como nossas dicas sobre como ser indexado no Google ou nosso guia sobre como usar Estatísticas de Pesquisa para impulsionar seus rankings.

Se você achou este artigo útil, inscreva-se em nosso Canal do YouTube. Você encontrará muitos outros tutoriais úteis lá. Você também pode nos seguir no X (Twitter), LinkedIn ou Facebook para ficar por dentro.

Aviso: Nosso conteúdo é apoiado pelo leitor. Isso significa que se você clicar em alguns de nossos links, poderemos ganhar uma comissão. Recomendamos apenas produtos que acreditamos que agregarão valor aos nossos leitores.

Olá, obrigado pelo artigo.

Recentemente li seu artigo sobre decadência de conteúdo. Um dos nossos problemas é a velocidade da página e tenho trabalhado para reduzir o tempo de carregamento. No entanto, não sou profissional de codificação ou qualquer coisa remotamente relacionada a coisas técnicas. Eu geralmente lido com marketing e design.

Então, com esse histórico, minha pergunta é a seguinte: ao fazer upload de imagens e escrever suas legendas e tags alt, eu quero que elas apareçam nos resultados de pesquisa para buscas de imagens, mas não quero causar inchaço no índice.

Existem táticas que você recomenda que eu use para evitar isso? Eu já desativei o sitemap de imagens (hoje mesmo), depois de ler que ele não é necessário e não removerá minhas imagens atuais do site.

Isso também me leva a fazer uma segunda pergunta: como saberei (alguém que não sabe ler html, js ou qualquer coisa dessa natureza) se desativar o sitemap de imagens foi eficaz em melhorar a velocidade de carregamento? Obrigado pela ajuda!