Robots.txt é um arquivo de texto colocado no diretório raiz de um site que instrui os robôs da web (como os rastreadores de mecanismos de busca crawlers) sobre quais páginas ou seções do site eles têm permissão para acessar e indexar. Este arquivo atua como um conjunto de instruções para esses bots automatizados.

Exemplos de como o robots.txt é usado:

- Desautorizando diretórios específicos: User-agent: * Disallow: /private/ Isso diz a todos os robôs para não acessarem o diretório "/private/" e seu conteúdo.

- Permitindo robôs específicos enquanto desautoriza outros: User-agent: Googlebot Allow: / User-agent: * Disallow: / Isso permite que o rastreador do Google acesse todas as páginas, enquanto desautoriza todos os outros robôs.

- Especificando a localização do sitemap: Sitemap: https://example.com/sitemap.xml Isso direciona os robôs para a localização do sitemap do site, o que os ajuda a rastrear o site de forma eficiente.

- Desautorizando o acesso a tipos de arquivo específicos: User-agent: * Disallow: /*.pdf$ Isso impede que os robôs acessem quaisquer arquivos PDF no site.

Lembre-se que o robots.txt é um arquivo publicamente acessível e não deve ser usado para ocultar informações sensíveis, pois pode ser facilmente visualizado por qualquer pessoa.

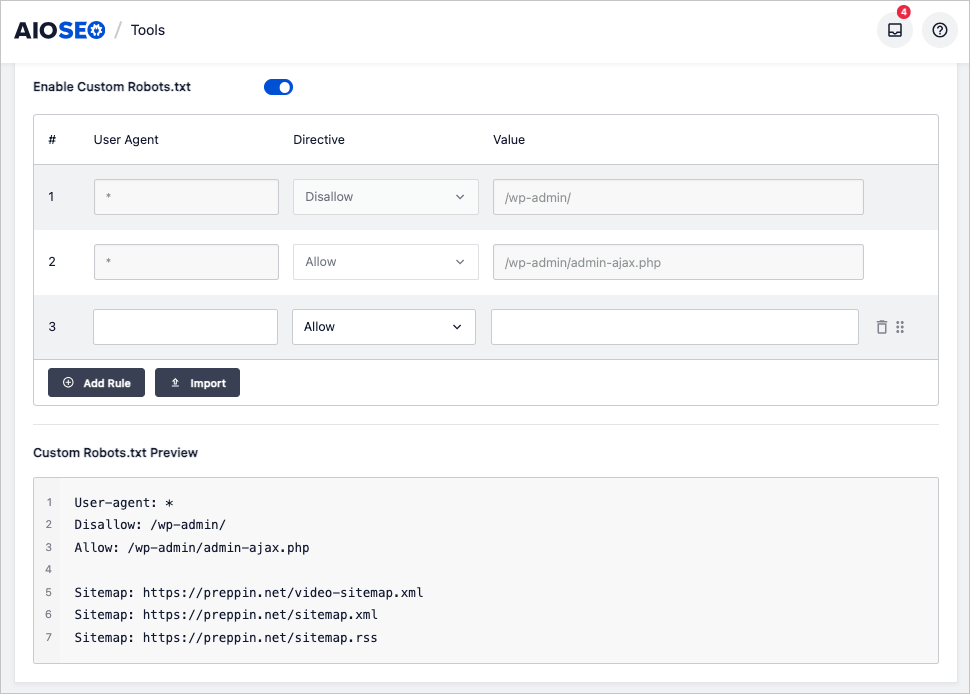

Robots.txt no WordPress

All in One SEO oferece um editor de robots.txt fácil de usar. Não há necessidade de lidar com código. Os usuários podem editar seu arquivo robots.txt preenchendo campos de formulário.

Relacionado: