Souhaitez-vous augmenter les chances que votre contenu soit correctement exploré et indexé ?

Alors vous serez aussi enthousiastes que nous à l'idée de notre dernière mise à jour de plugin !

Nous avons écouté vos commentaires et ajouté plus de puissance et de fonctionnalités à notre éditeur robots.txt.

Dans cet article

Clean-param : Réduire les explorations inutiles

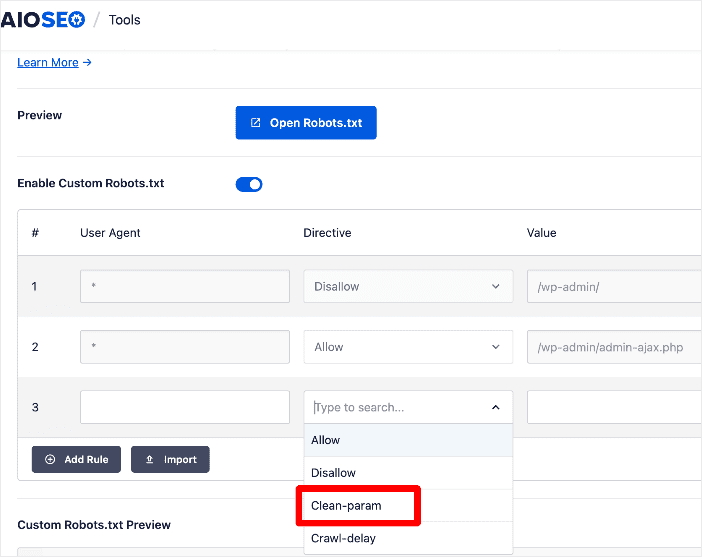

L'une des nouvelles directives d'exploration que nous avons ajoutées à notre éditeur robots.txt est la directive Clean-param.

Cette directive puissante indique aux robots d'exploration d'ignorer les paramètres d'URL tels que les paramètres GET (comme les identifiants de session) et les balises (UTM). Ceux-ci peuvent entraîner de nombreux problèmes pour votre SEO, notamment :

- Problèmes de contenu dupliqué

- Gaspillage du budget d'exploration

- Problèmes d'indexation

Ces facteurs entraînent une augmentation du temps nécessaire aux moteurs de recherche pour atteindre et explorer les pages importantes de votre site.

Le Clean-param est une fonctionnalité puissante qui vous donne un contrôle plus granulaire sur la manière dont les moteurs de recherche explorent votre site. En conséquence, vous augmentez les chances que les bonnes pages se classent sur les moteurs de recherche.

Note : Clean-param n'est actuellement pris en charge que par Yandex.

Crawl-delay : Réguler la fréquence d'exploration

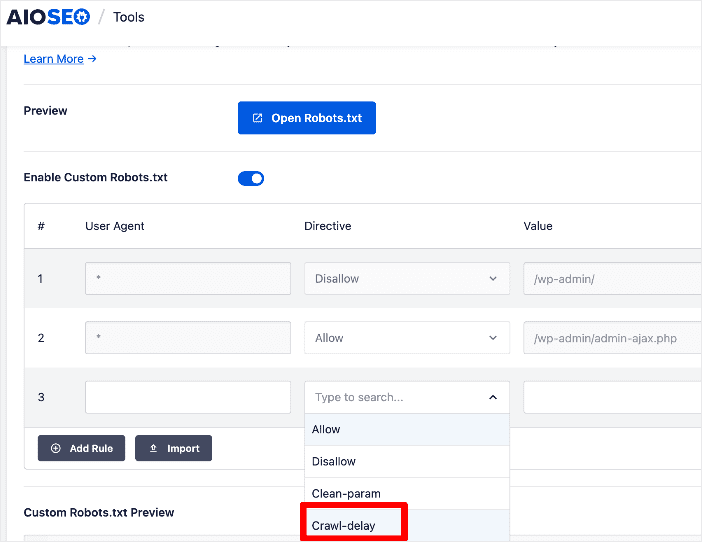

Une autre nouvelle directive dans notre éditeur robots.txt est la directive Crawl-delay.

Crawl-delay est une directive utilisée dans le fichier robots.txt pour indiquer aux robots des moteurs de recherche le rythme auquel ils doivent accéder et explorer votre site. Cette directive est particulièrement utile lorsque vous souhaitez contrôler la fréquence des visites des robots afin d'éviter de surcharger votre serveur, surtout si vous avez des ressources serveur limitées ou un trafic élevé. Cela peut avoir un impact sur les performances de votre site Web ou, dans certains cas extrêmes, le rendre inaccessible.

L'ajout de la directive crawl delay peut vous aider à éviter de surcharger votre serveur pendant les périodes où vous anticipez beaucoup de trafic.

Note : Crawl-delay n'est pris en charge que par Bing, Yahoo et Yandex.

Importer les règles robots.txt de n'importe quel site

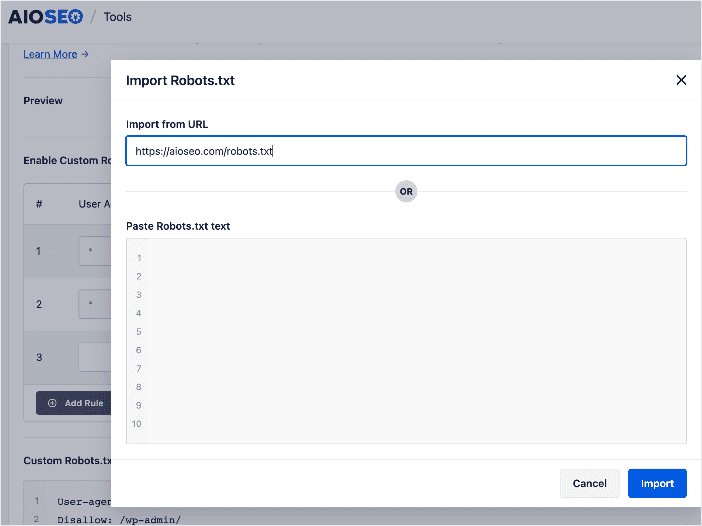

Si vous créez un nouveau site Web et que vous souhaitez implémenter un fichier robots.txt de base, vous pouvez gagner du temps et des efforts en utilisant simplement les règles d'un site existant comme point de départ.

Pour vous aider dans cette démarche, nous avons ajouté une fonction Importer à notre éditeur robots.txt.

Vous pouvez utiliser cette fonction pour importer un fichier robots.txt d'un site en saisissant l'URL ou en visitant le site, puis en copiant et collant le fichier robots.txt.

Si vous travaillez sur un site Web similaire à un autre, vous pourriez constater qu'ils ont implémenté des règles utiles qui s'appliquent également à votre site. Cela peut vous faire gagner du temps dans la création de vos propres règles. Cela peut également vous aider à éviter de faire des erreurs si vous êtes encore novice en matière d'édition de fichiers robots.txt.

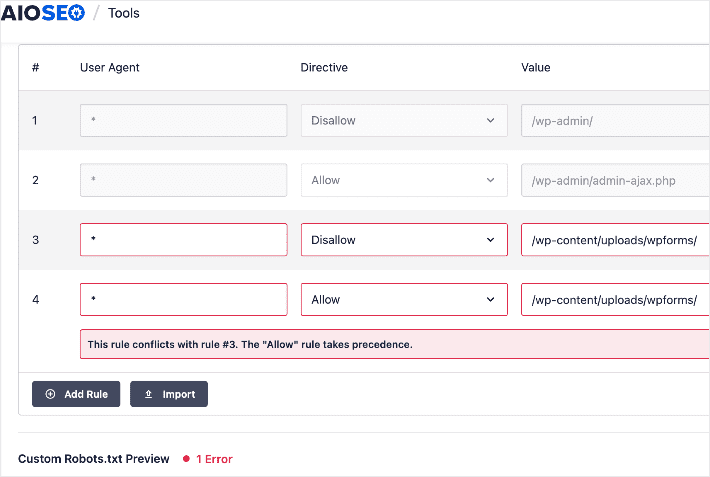

Validation des règles et gestion des erreurs améliorées

Outre les directives puissantes et la fonctionnalité d'importation, nous avons également amélioré la validation des règles et la gestion des erreurs dans notre éditeur robots.txt. Cela vous aide à repérer rapidement les règles conflictuelles ou d'autres erreurs dans votre robots.txt.

Vous pouvez facilement supprimer la règle erronée en cliquant sur l'icône de la corbeille à côté de celle-ci.

Avec ces derniers ajouts à notre plugin, améliorer votre crawlabilité et votre indexabilité est devenu plus facile. Par conséquent, votre site et votre contenu ont une meilleure chance de se classer en bonne position sur les pages de résultats des moteurs de recherche.

Nous avons également ajouté des fonctionnalités avancées supplémentaires dans notre éditeur robots.txt. Consultez cette documentation pour plus de détails.

En plus de cette mise à jour importante, nous avons apporté plusieurs améliorations notables à de nombreuses fonctionnalités que vous aimez. Vous pouvez voir toutes nos modifications dans notre journal complet des modifications du produit.

Qu'attendez-vous ?

Mettez à jour votre site vers AIOSEO 4.4.4 pour débloquer ces nouvelles fonctionnalités puissantes et classer votre contenu plus haut dans les SERP.

Et si vous n'utilisez pas encore AIOSEO, assurez-vous d'installer et d'activer le plugin dès aujourd'hui.

Si vous avez des questions sur ces fonctionnalités, veuillez commenter ci-dessous ou contacter notre équipe de support client. Nous sommes toujours prêts à vous aider. Notre engagement à faire d'AIOSEO le plugin SEO WordPress le plus simple et le meilleur ne cesse de se renforcer à mesure que nous continuons à gagner ensemble avec nos clients.

Nous sommes très reconnaissants de votre soutien continu, de vos commentaires et de vos suggestions. Continuez à nous faire part de vos suggestions et demandes de fonctionnalités !

Nous espérons que vous apprécierez l'utilisation de ces nouvelles fonctionnalités SEO autant que nous avons apprécié de les créer.

-Benjamin Rojas (Président d'AIOSEO).

Divulgation : Notre contenu est financé par nos lecteurs. Cela signifie que si vous cliquez sur certains de nos liens, nous pouvons gagner une commission. Nous ne recommandons que les produits qui, selon nous, apporteront de la valeur à nos lecteurs.

Cela pourrait encore être plus simple pour les personnes ayant des connaissances techniques intermédiaires. Après 2 ans, je ne sais toujours pas totalement si j'utilise toutes les fonctions / correctement.

Merci d'avoir publié sur ce sujet. Les clients demandent toujours comment optimiser le crawlage !

Santé au bon contenu 🙂

Quels paramètres devons-nous utiliser pour le meilleur référencement ?