Stai cercando di personalizzare il robots.txt sul tuo sito? Questo articolo ti aiuterà.

Il modulo robots.txt in All in One SEO ti consente di gestire il robots.txt che WordPress crea.

Ciò ti consente di avere un maggiore controllo sulle istruzioni che fornisci ai crawler web riguardo al tuo sito.

In questo articolo

- Video tutorial

- Informazioni sul Robots.txt in WordPress

- Utilizzo dell'editor Robots.txt in All in One SEO

- Regole predefinite di Robots.txt in WordPress

- Adding Rules Using the Rule Builder

- Modifica delle regole utilizzando il Generatore di regole

- Eliminazione di una regola nel Generatore di regole

- Modifica dell'ordine delle regole nel Generatore di regole

- Importazione del tuo Robots.txt in All in One SEO

- Utilizzo di regole avanzate nel Generatore di regole

- Blocco di crawler indesiderati

- Blocca l'indicizzazione degli URL di ricerca interna del sito

- Editor Robots.txt per WordPress Multisite

Video tutorial

Ecco un video su come utilizzare lo strumento Robots.txt in All in One SEO:

Informazioni sul Robots.txt in WordPress

Innanzitutto, è importante capire che WordPress genera un robots.txt dinamico per ogni sito WordPress.

Questo robots.txt predefinito contiene le regole standard per qualsiasi sito in esecuzione su WordPress.

In secondo luogo, poiché WordPress genera un robots.txt dinamico, non esiste un file statico da trovare sul tuo server. Il contenuto del robots.txt è memorizzato nel tuo database WordPress e visualizzato in un browser web. Questo è perfettamente normale ed è molto meglio che utilizzare un file fisico sul tuo server.

Infine, All in One SEO non genera un robots.txt, fornisce solo un modo molto semplice per aggiungere regole personalizzate al robots.txt predefinito che WordPress genera.

NOTA:

Anche se il robots.txt generato da WordPress è una pagina generata dinamicamente e non un file di testo statico sul tuo server, è necessario prestare attenzione nella creazione di un robots.txt di grandi dimensioni per due motivi:

- Un robots.txt di grandi dimensioni indica un set di regole potenzialmente complesso che potrebbe essere difficile da mantenere

- Google ha proposto una dimensione massima del file di 512 KB per alleviare il carico sui server dovuto ai lunghi tempi di connessione.

Utilizzo dell'editor Robots.txt in All in One SEO

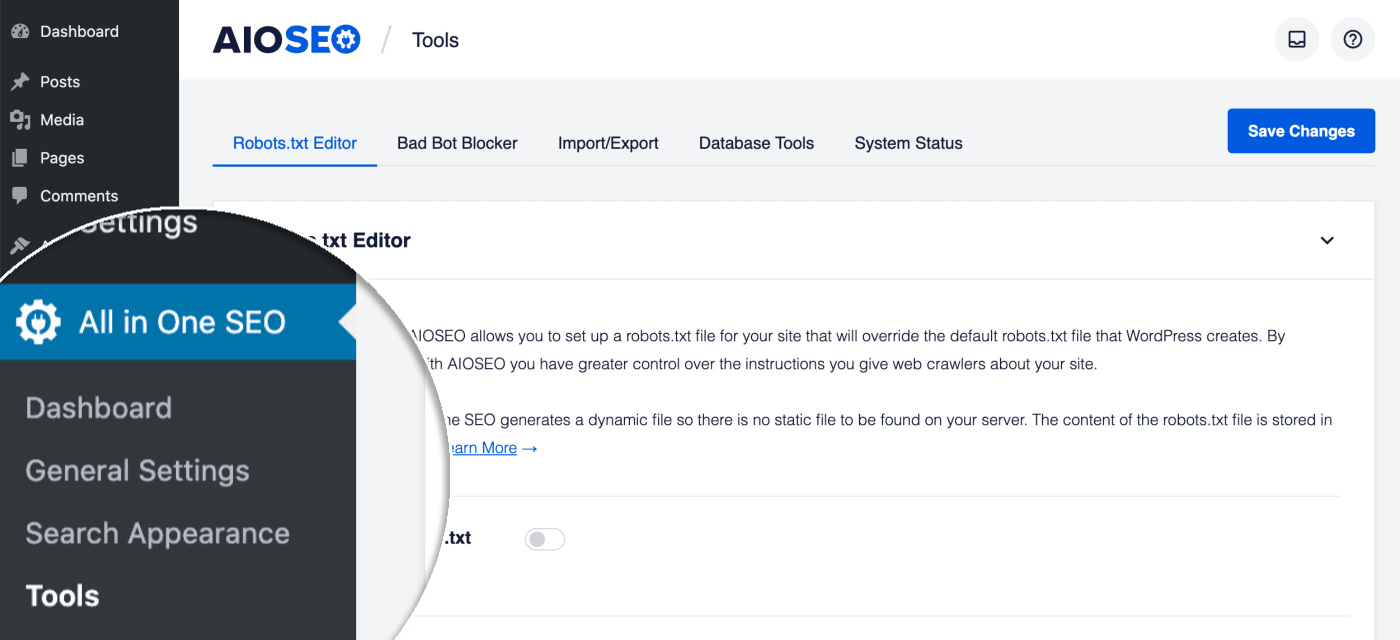

Per iniziare, fai clic su Strumenti nel menu All in One SEO.

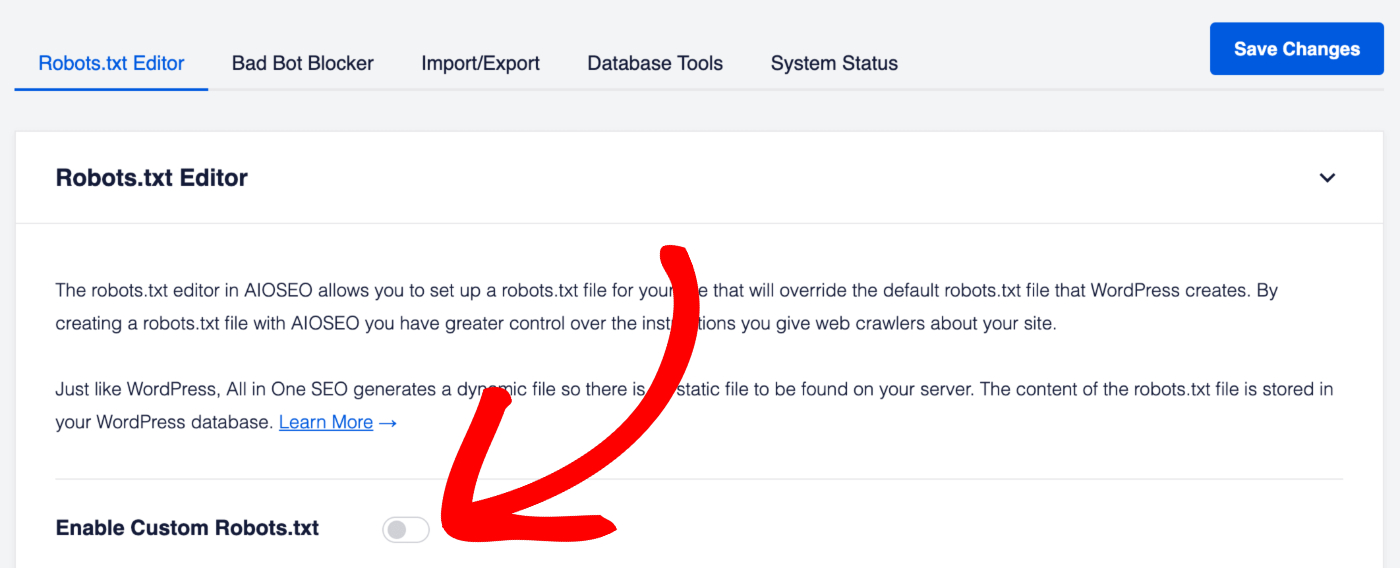

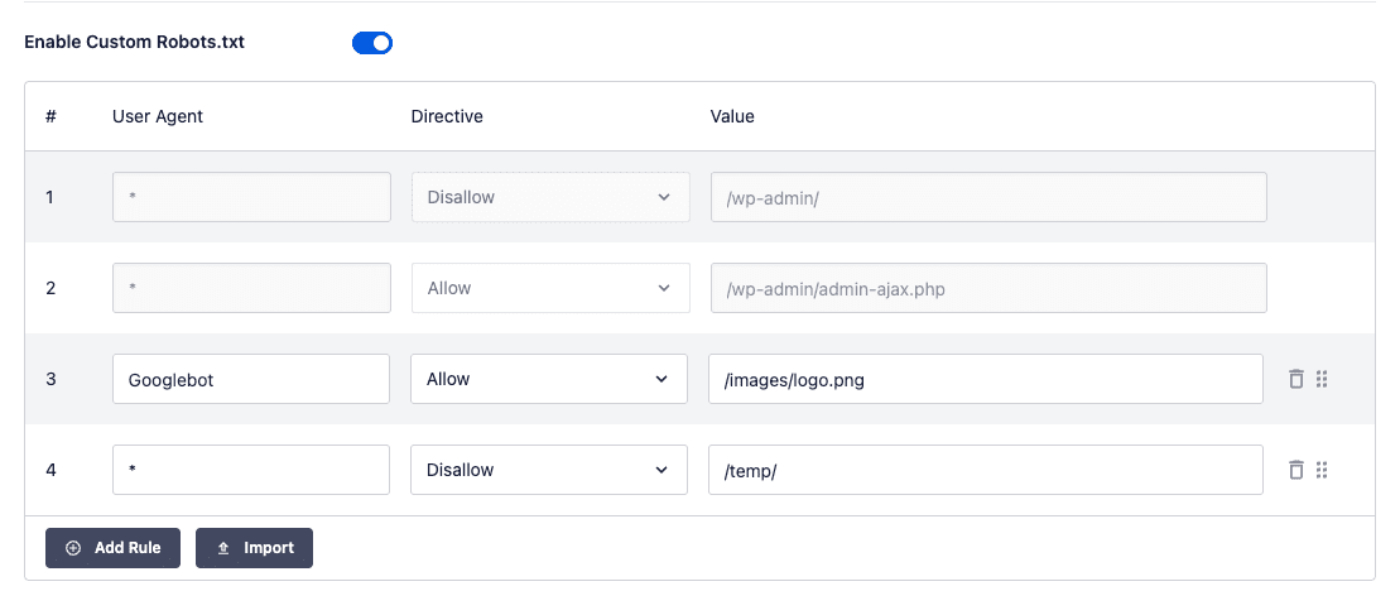

Dovresti vedere l'Editor Robots.txt e la prima impostazione sarà Abilita Robots.txt personalizzato. Fai clic sull'interruttore per abilitare l'editor robots.txt personalizzato.

IMPORTANTE:

Non è necessario abilitare il Robots.txt personalizzato a meno che non si abbia un motivo specifico per aggiungere una regola personalizzata.

Il robots.txt predefinito generato da WordPress è perfetto per il 99% di tutti i siti. La funzione Custom Robots.txt è per quegli utenti che necessitano di regole personalizzate.

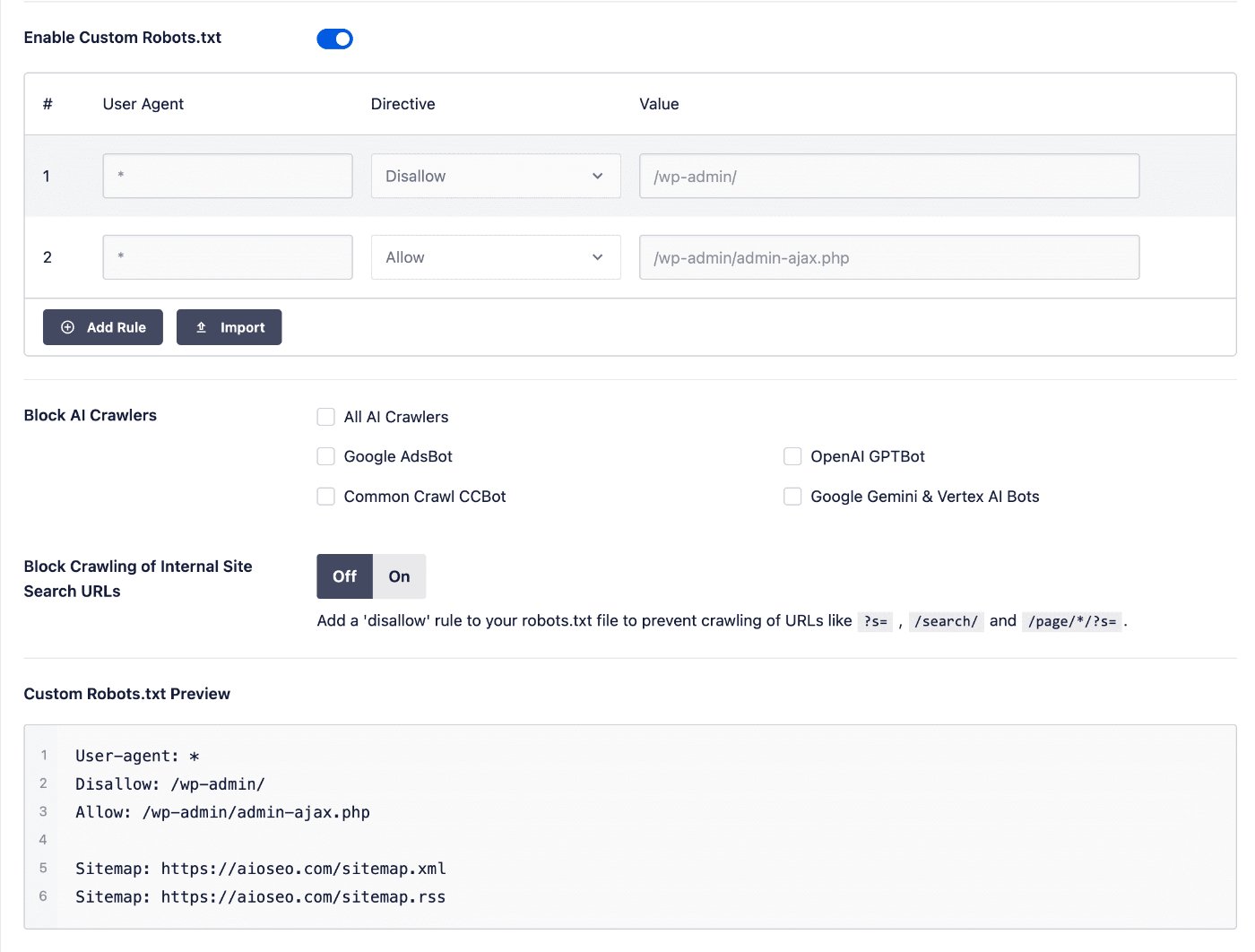

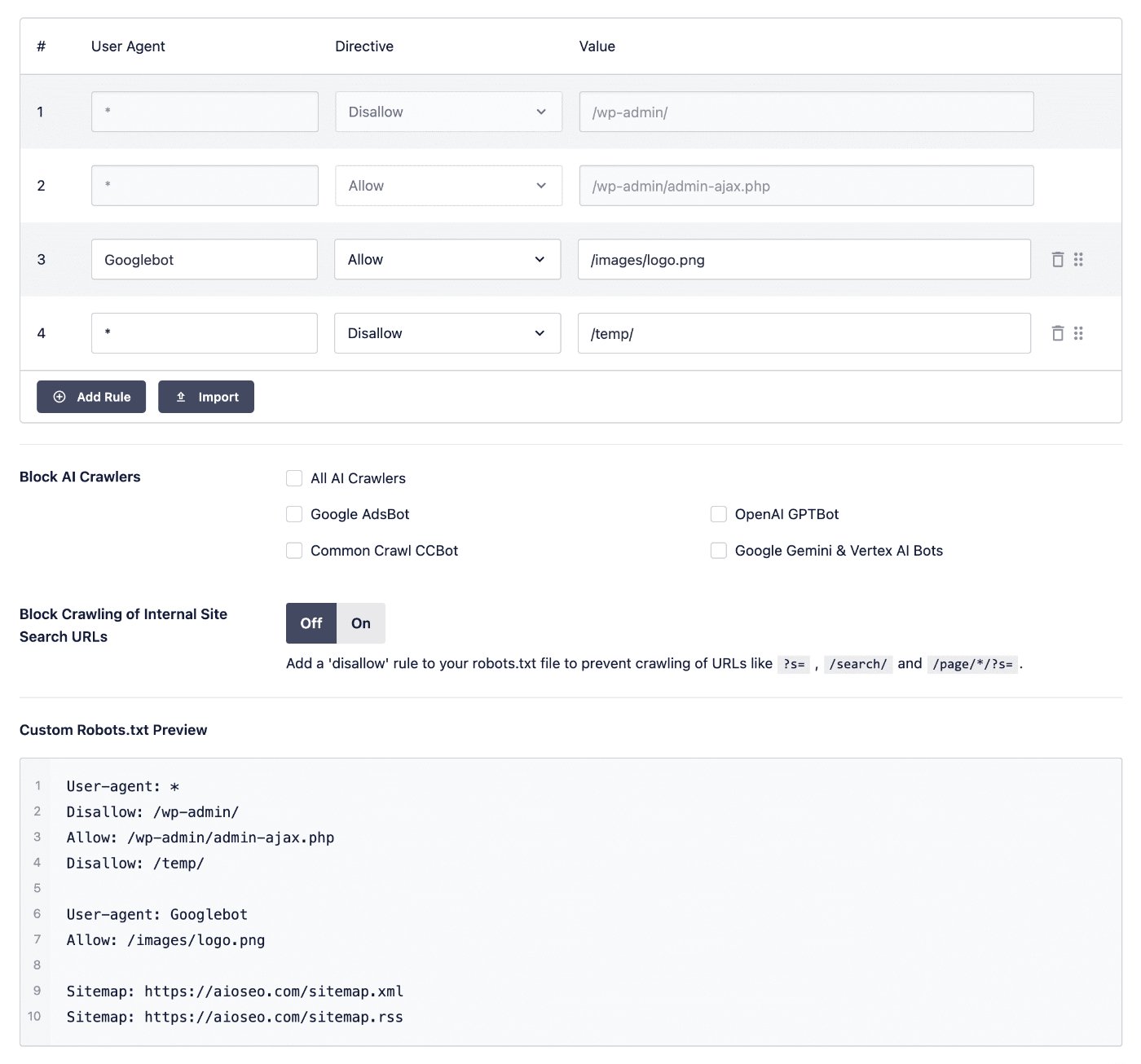

Dovresti vedere la sezione Anteprima Custom Robots.txt in fondo alla pagina, che mostra le regole predefinite aggiunte da WordPress.

Regole predefinite di Robots.txt in WordPress

Le regole predefinite che appaiono nella sezione Anteprima Custom Robots.txt (mostrata nello screenshot sopra) chiedono ai robot di non eseguire la scansione dei file principali di WordPress. È inutile che i motori di ricerca accedano direttamente a questi file perché non contengono contenuti rilevanti del sito.

Se per qualche motivo desideri rimuovere le regole predefinite aggiunte da WordPress, dovrai utilizzare l'hook del filtro robots_txt in WordPress.

Aggiungere Regole Utilizzando il Generatore di Regole

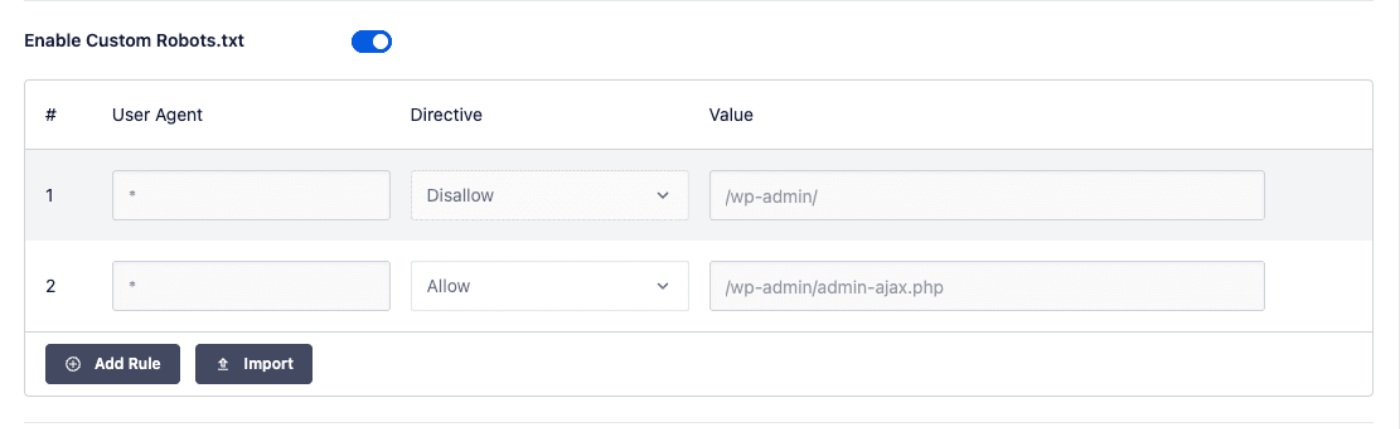

Il generatore di regole viene utilizzato per aggiungere le tue regole personalizzate per percorsi specifici sul tuo sito.

Ad esempio, se desideri aggiungere una regola per bloccare tutti i robot da una directory temporanea, puoi utilizzare il generatore di regole per aggiungerla.

Per aggiungere una regola, fai clic sul pulsante Aggiungi Regola e quindi completa i campi descritti di seguito.

User Agent

Innanzitutto, inserisci l'user agent nel campo User Agent.

Ad esempio, se desideri specificare il crawler di Google, inserisci "Googlebot" nel campo User Agent.

Se desideri una regola che si applichi a tutti gli user agent, inserisci * nel campo User Agent.

Direttiva

Successivamente, seleziona il tipo di regola nel menu a discesa Direttiva. Ci sono quattro tipi di regole tra cui puoi scegliere:

- Allow consentirà ai crawler con lo user agent specificato di accedere alla directory o al file nel campo Valore.

- Block bloccherà ai crawler con lo user agent specificato l'accesso alla directory o al file nel campo Valore.

- Clean-param ti consente di escludere pagine con parametri URL che possono fornire lo stesso contenuto con un URL diverso. Yandex, l'unico motore di ricerca che attualmente supporta questa direttiva, ha una buona spiegazione con esempi qui.

- Crawl-delay indica ai crawler quanto frequentemente possono eseguire la scansione dei tuoi contenuti. Ad esempio, un crawl delay di 10 indica ai crawler di non eseguire la scansione dei tuoi contenuti più di ogni 10 secondi.

Attualmente questa direttiva è supportata solo da Bing, Yahoo e Yandex. Puoi modificare la frequenza di scansione del crawler di Google in Google Search Console.

Valore

Successivamente, inserisci il percorso della directory o il nome del file nel campo Valore.

Puoi inserire un percorso di directory come /wp-content/backups/ e percorsi di file come /wp-content/backups/temp.png.

Puoi anche usare * come carattere jolly, ad esempio /wp-content/backup-*.

Se desideri aggiungere altre regole, fai clic sul pulsante Aggiungi Regola e ripeti i passaggi precedenti.

Al termine, fai clic sul pulsante Salva Modifiche.

Le tue regole appariranno nella sezione Anteprima Custom Robots.txt e nel tuo robots.txt, che puoi visualizzare facendo clic sul pulsante Apri Robots.txt.

Modifica delle regole utilizzando il Generatore di regole

Per modificare qualsiasi regola che hai aggiunto, cambia semplicemente i dettagli nella struttura delle regole e fai clic sul pulsante Salva modifiche.

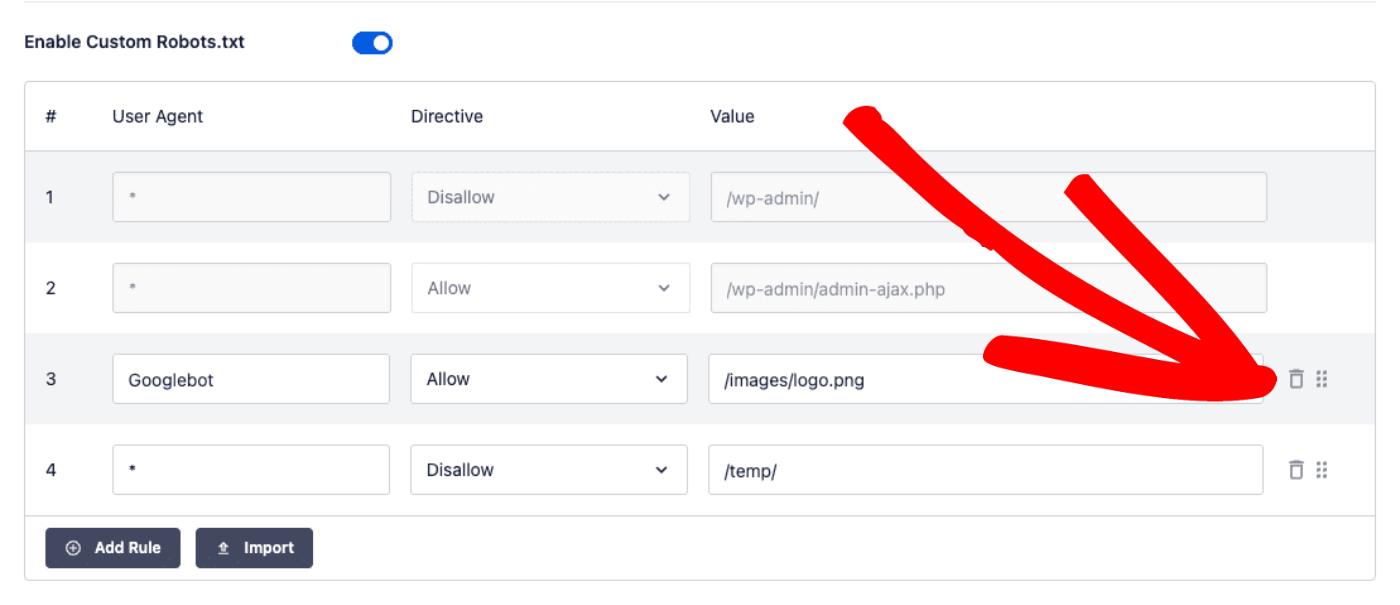

Eliminazione di una regola nel Generatore di regole

Per eliminare una regola che hai aggiunto, fai clic sull'icona del cestino a destra della regola.

Modifica dell'ordine delle regole nel Generatore di regole

Puoi facilmente cambiare l'ordine in cui le tue regole personalizzate appaiono nel tuo robots.txt trascinando e rilasciando le voci nella struttura delle regole.

Fai clic e tieni premuta l'icona di trascinamento a destra della regola e spostala dove desideri che appaia, come mostrato di seguito.

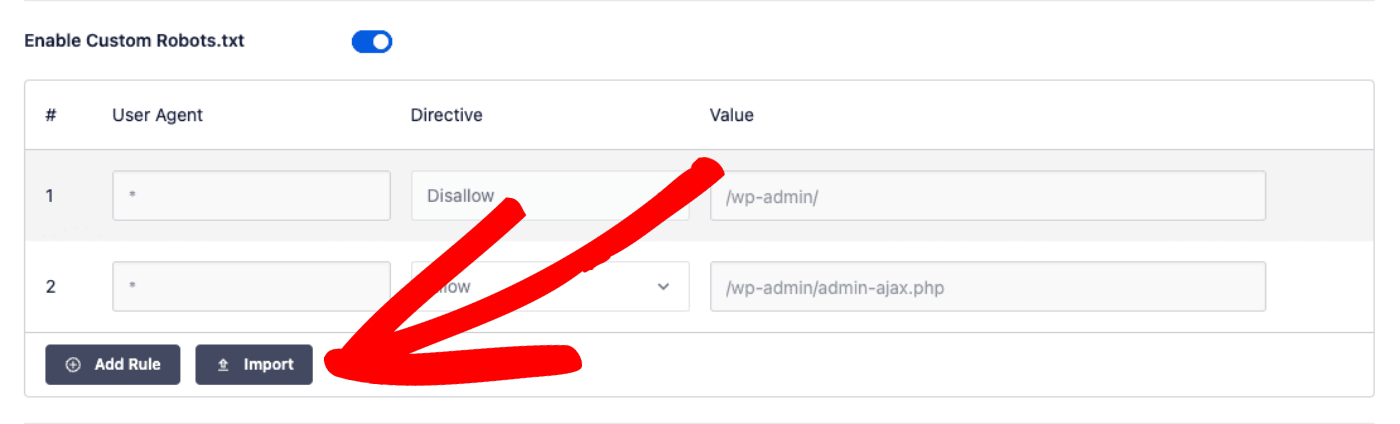

Importazione del tuo Robots.txt in All in One SEO

Puoi importare il tuo robots.txt o le regole da un'altra fonte molto facilmente.

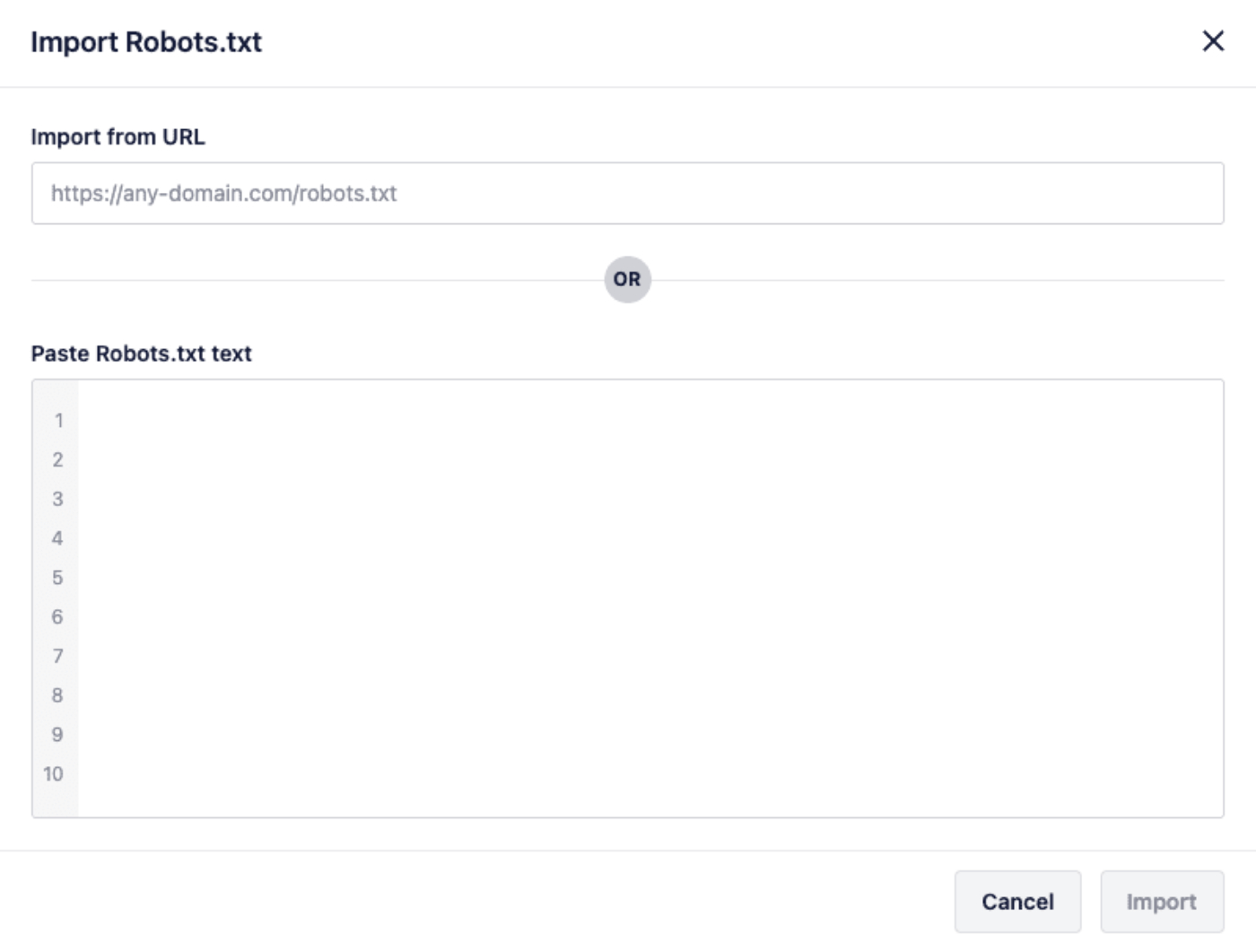

Per prima cosa, fai clic sul pulsante Importa per aprire la finestra Importa Robots.txt.

Nella finestra Importa Robots.txt puoi importare da un URL inserendo l'URL di un robots.txt nel campo Importa da URL oppure puoi incollare il contenuto di un robots.txt nel campo Incolla testo Robots.txt.

Una volta fatto ciò, fai clic sul pulsante Importa.

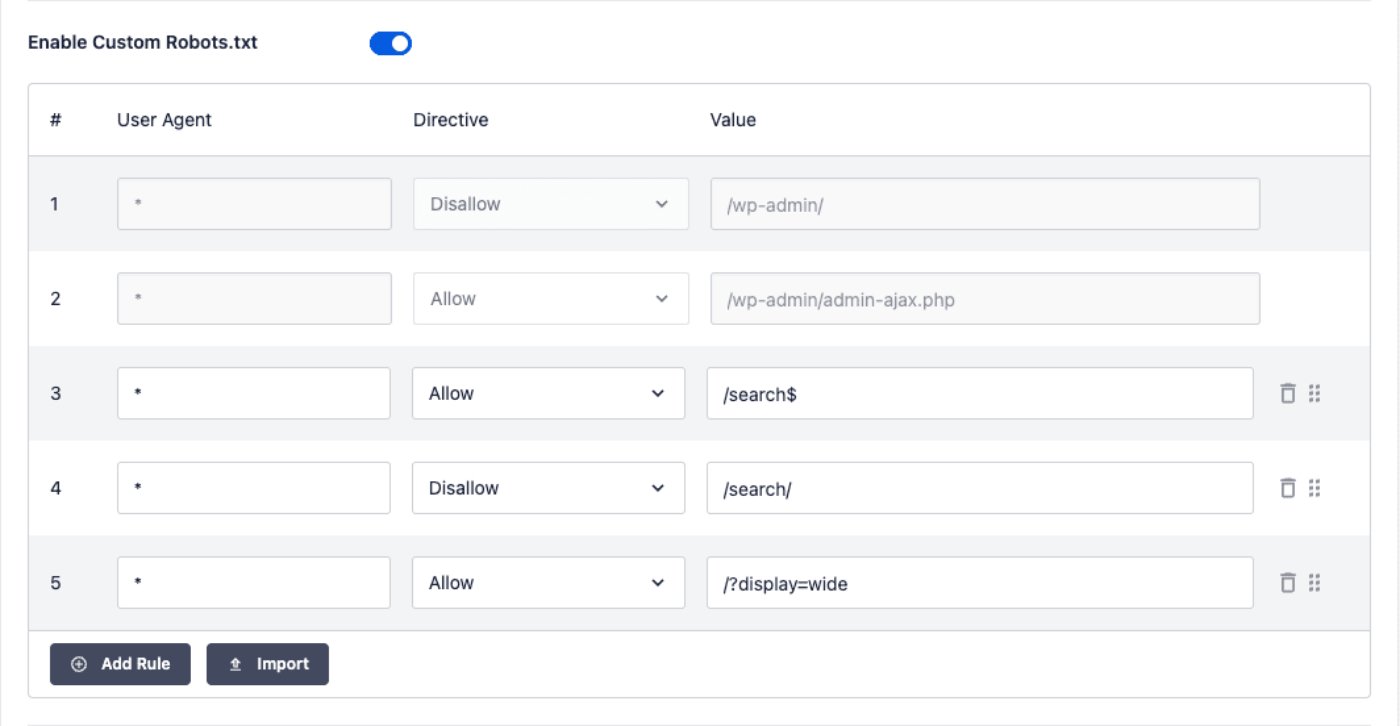

Utilizzo di regole avanzate nel Generatore di regole

Il Costruttore di Regole Robots.txt supporta anche l'uso di regole avanzate. Ciò include pattern regex e parametri URL.

Ecco tre esempi di come possono essere utilizzate le regole avanzate:

Negli esempi sopra, queste regole avanzate sono mostrate:

- /search$ – questo utilizza regex per consentire l'accesso al percorso esatto "/search"

- /search/ – questo blocca l'accesso ai percorsi che iniziano con "/search/" ma non sono una corrispondenza esatta

- /?display=wide – questo consente l'accesso alla homepage con il parametro URL corrispondente

Regole avanzate come queste consentono un controllo granulare sul file robots.txt del tuo sito in modo da avere il pieno controllo su come gli user agent accedono al tuo sito web.

Blocco di crawler indesiderati

Puoi usare Blocca Crawler AI per aggiungere regole al tuo robots.txt che bloccano crawler noti come crawler AI e Google AdsBot.

Puoi selezionare ciascuno dei crawler per bloccarli, oppure puoi selezionare Tutti i Crawler AI per bloccare tutti quelli elencati.

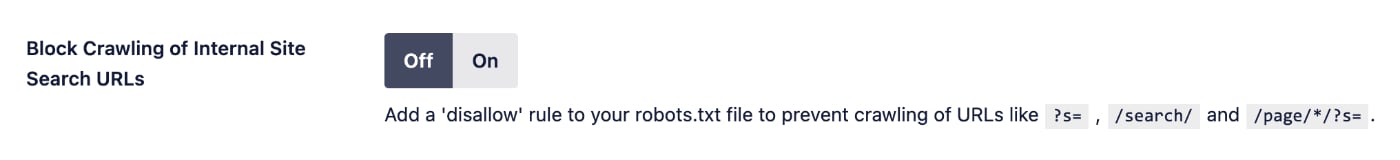

Blocca l'indicizzazione degli URL di ricerca interna del sito

Puoi usare l'impostazione Blocca Scansione URL di Ricerca Interna del Sito per aggiungere regole al tuo robots.txt per impedire la scansione delle pagine di ricerca. Ciò riduce la scansione non necessaria del tuo sito.

Editor Robots.txt per WordPress Multisite

Esiste anche un Editor Robots.txt per Reti Multisito. I dettagli sono disponibili nella nostra documentazione sull'Editor Robots.txt per Reti Multisito qui.