Souhaitez-vous savoir comment modifier les fichiers robots.txt dans WordPress ?

J'avais l'habitude d'être intimidé par la modification des fichiers robots.txt dans WordPress. En tant que personne ayant créé et géré plus d'une douzaine de sites WordPress, je me souviens avoir regardé mon écran, craignant qu'un seul faux pas ne ruine le référencement de mon site.

Le fichier robots.txt peut sembler effrayant, mais c'est en fait un simple fichier texte qui indique aux moteurs de recherche quelles parties de votre site ils peuvent ou ne peuvent pas accéder. Après des années de travail avec WordPress, j'ai appris que la modification de ce fichier n'a pas à être compliquée du tout.

Dans ce guide étape par étape, je vais vous montrer les moyens les plus simples et les plus sûrs de modifier votre fichier robots.txt dans WordPress. Que vous souhaitiez bloquer certaines pages des moteurs de recherche ou résoudre des problèmes de référencement, vous apprendrez exactement quoi faire.

Ne vous inquiétez pas, je vous guiderai à travers chaque étape, donc vous ne casserez rien.

Dans cet article

Qu'est-ce qu'un fichier Robots.txt ?

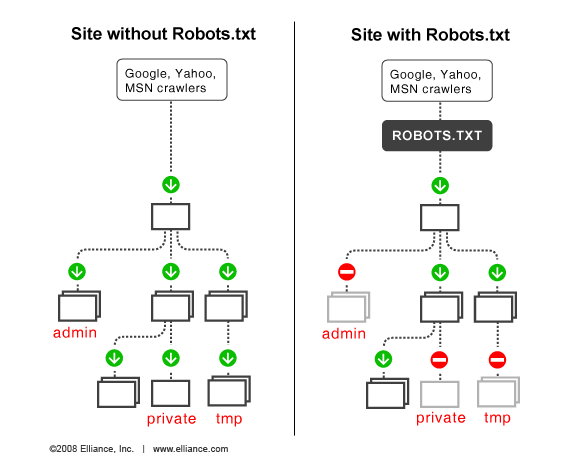

Un fichier robots.txt indique aux moteurs de recherche comment explorer votre site, où ils sont autorisés à aller ou non.

Les moteurs de recherche comme Google utilisent ces robots d'exploration, parfois appelés robots web, pour archiver et catégoriser les sites Web.

La plupart des robots sont configurés pour rechercher un fichier robots.txt sur le serveur avant de lire tout autre fichier de votre site. Ils le font pour voir si vous avez ajouté des instructions spéciales sur la façon d'explorer et d'indexer votre site.

Le fichier robots.txt est généralement stocké dans le répertoire racine, également appelé dossier principal de votre site Web.

L'URL peut ressembler à ceci :

http://www.example.com/robots.txt

Pour vérifier le fichier robots.txt de votre site Web, remplacez simplement http://www.example.com/ par votre domaine et ajoutez robots.txt à la fin.

Maintenant, jetons un coup d'œil à ce à quoi ressemble le format de base d'un fichier robots.txt :

User-agent: [user-agent name]

Disallow: [URL string not to be crawled]

User-agent: [user-agent name]

Allow: [URL string to be crawled]

Sitemap: [URL of your XML Sitemap]

User-agent fait référence au bot ou au robot de moteur de recherche que vous souhaitez bloquer ou autoriser à explorer votre site (par exemple, le robot Googlebot).

Lors de la modification de votre fichier robots.txt, vous pouvez inclure plusieurs instructions pour Autoriser ou Refuser des URL spécifiques, ainsi qu'ajouter plusieurs sitemaps. Vous pouvez également exclure des paramètres d'URL à l'aide de la directive Clean-param et définir la fréquence des visites par les robots d'exploration à l'aide de la directive Crawl-delay.

Fichier Robots.txt par défaut dans WordPress

Par défaut, WordPress crée automatiquement un fichier robots.txt pour votre site. Ainsi, même si vous ne faites rien, votre site devrait déjà avoir le fichier robots.txt par défaut de WordPress.

Mais lorsque vous le personnalisez plus tard avec vos propres règles, le contenu par défaut est remplacé.

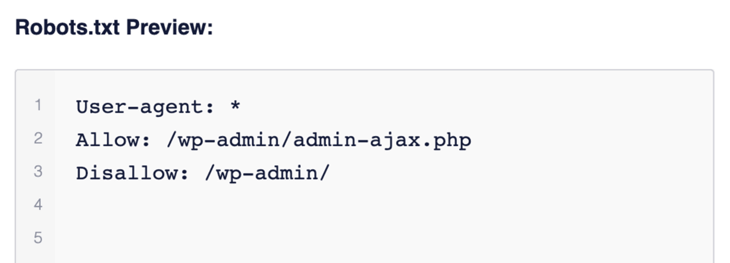

Voici à quoi ressemble le fichier robots.txt par défaut de WordPress :

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

L'astérisque après User-agent: * signifie que le fichier robots.txt s'adresse à tous les robots web qui visitent votre site. Comme mentionné, Disallow: /wp-admin/ indique aux robots de ne pas visiter votre page wp-admin.

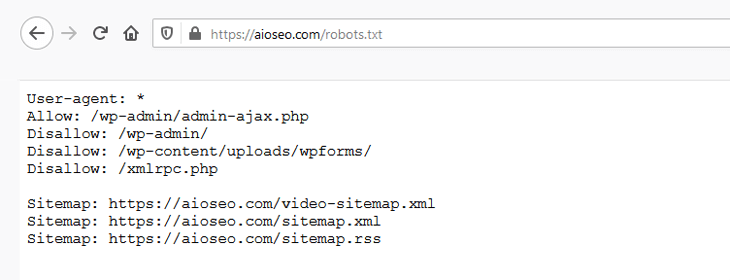

Vous pouvez tester votre fichier robots.txt en ajoutant /robots.txt à la fin de votre nom de domaine. Par exemple, si vous entrez « https://aioseo.com/robots.txt » dans votre navigateur Web, il affiche le fichier robots.txt pour AIOSEO :

Maintenant que vous savez ce qu’est un fichier robots.txt et comment il fonctionne, examinons pourquoi le fichier robots.txt est important en premier lieu.

Pourquoi le fichier Robots.txt est-il important ?

Le fichier robots.txt est important si vous souhaitez :

- Optimiser la vitesse de chargement de votre site — en indiquant aux robots de ne pas perdre de temps sur les pages que vous ne souhaitez pas qu’ils explorent et indexent, vous pouvez libérer des ressources et augmenter la vitesse de chargement de votre site.

- Optimiser l’utilisation de votre serveur — bloquer les robots qui gaspillent des ressources nettoiera votre serveur et réduira les erreurs 404.

Quand utiliser la balise Meta Noindex à la place de Robots.txt

Si votre objectif principal est d’empêcher certaines pages d’être incluses dans les résultats des moteurs de recherche, l’utilisation d’une balise meta noindex est l’approche appropriée.

Ceci est dû au fait que robots.txt n’indique pas directement aux moteurs de recherche de ne pas indexer le contenu – il leur indique simplement de ne pas l’explorer.

En d’autres termes, vous pouvez utiliser robots.txt pour ajouter des règles spécifiques sur la manière dont les moteurs de recherche et autres robots interagissent avec votre site, mais cela ne contrôlera pas explicitement si votre contenu est indexé ou non.

Cela dit, nous allons vous montrer comment modifier facilement votre fichier robots.txt dans WordPress étape par étape à l’aide d’AIOSEO.

Modification de votre Robots.txt dans WordPress à l’aide d’AIOSEO

La manière la plus simple de modifier le fichier robots.txt est d’utiliser le meilleur plugin SEO WordPress, All in One SEO (AIOSEO).

AIOSEO est un plugin SEO puissant mais facile à utiliser qui compte plus de 3 millions d’utilisateurs. Cela signifie que des millions de blogueurs avisés utilisent AIOSEO pour les aider à améliorer leur classement dans les moteurs de recherche et à générer du trafic qualifié vers leurs blogs. C’est parce que le plugin dispose de nombreuses fonctionnalités et modules puissants conçus pour vous aider à configurer correctement vos paramètres SEO. Voici quelques exemples :

- Statistiques de recherche : Cette puissante intégration Google Search Console vous permet de suivre vos classements de mots-clés et de voir les métriques SEO importantes en 1 clic, et plus encore.

- Générateur de schéma nouvelle génération : ce générateur de schéma sans code permet aux utilisateurs de générer et de publier n’importe quel balisage de schéma sur votre site.

- Gestionnaire de Redirections : Aide à gérer les redirections et à éliminer les erreurs 404, ce qui facilite l'exploration et l'indexation de votre site par les moteurs de recherche.

- Link Assistant : Puissant outil de maillage interne qui automatise la création de liens entre les pages de votre site. Il vous fournit également un audit des liens sortants.

- Aperçu SEO : Cela vous donne un aperçu de vos extraits de recherche et sociaux et du SEO général afin que vous puissiez améliorer votre optimisation.

- IndexNow : Pour un indexage rapide sur les moteurs de recherche qui prennent en charge le protocole IndexNow (comme Bing et Yandex).

- Générateur de sitemap : Générez automatiquement différents types de sitemaps pour informer tous les moteurs de recherche de toute mise à jour sur votre site.

- Et plus encore.

Une des raisons pour lesquelles les utilisateurs adorent ce plugin est qu’il vous donne un plus grand contrôle sur la façon dont les moteurs de recherche explorent votre site. Ceci est grâce à l’éditeur avancé de robots.txt qui vous permet de configurer facilement votre fichier robots.txt, vous permettant de remplacer le fichier par défaut de WordPress.

Consultez notre liste des meilleurs générateurs de robots.txt.

Consultez notre liste des meilleurs générateurs de robots.txt.

Alors, passons à la modification de votre fichier robots.txt.

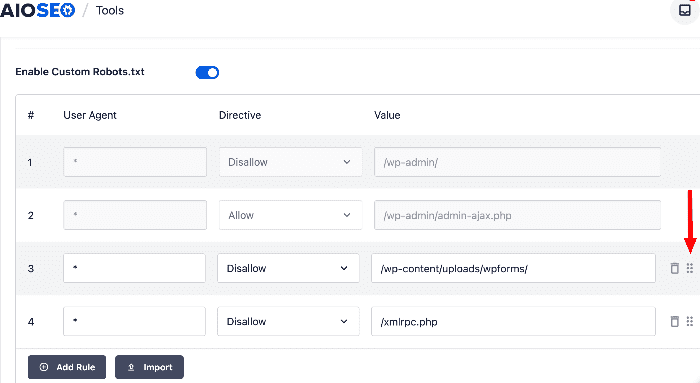

Pour modifier votre fichier Robots.txt, activez d'abord Robots.txt personnalisé

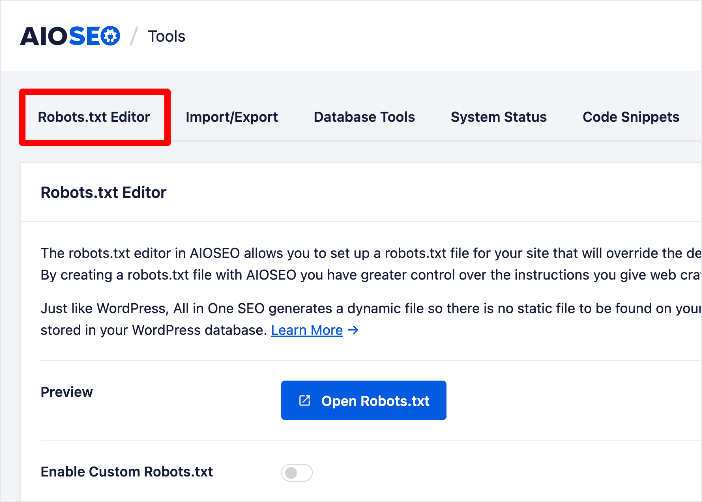

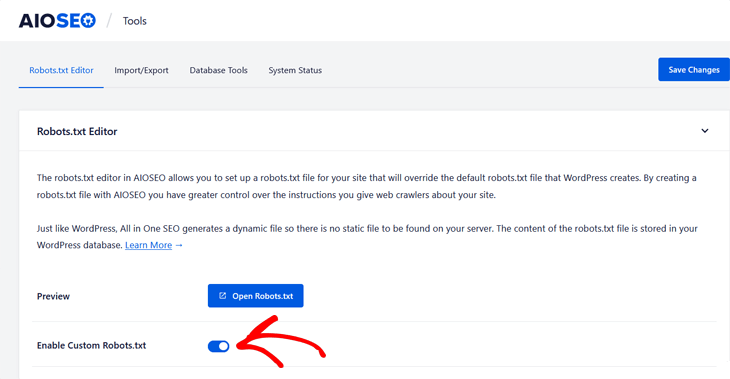

Pour modifier votre fichier robots.txt, cliquez sur Outils dans le menu All in One SEO, puis cliquez sur l’onglet Éditeur Robots.txt.

AIOSEO générera alors un fichier robots.txt dynamique. Son contenu est stocké dans votre base de données WordPress et peut être consulté dans votre navigateur Web, comme nous allons vous le montrer bientôt.

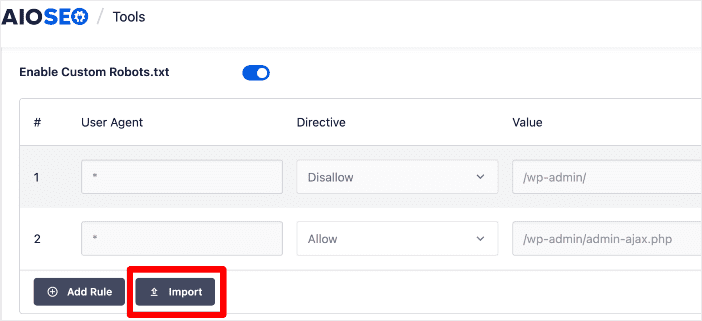

Une fois que vous êtes dans l'Éditeur Robots.txt, vous devez Activer le fichier Robots.txt personnalisé.

Cliquez sur le bouton pour qu'il devienne bleu.

Vous verrez alors la section Aperçu du Robots.txt en bas de l'écran, qui affiche les règles par défaut de WordPress que vous pouvez remplacer par les vôtres. Les règles par défaut indiquent aux robots de ne pas explorer vos fichiers WordPress principaux (pages d'administration).

Maintenant, passons à l'ajout de vos propres règles. Vous pouvez le faire de l'une des 2 manières suivantes : en utilisant le générateur de règles ou en important un fichier robots.txt d'un autre site.

Méthode 1 : Ajouter des règles à l'aide du générateur de règles

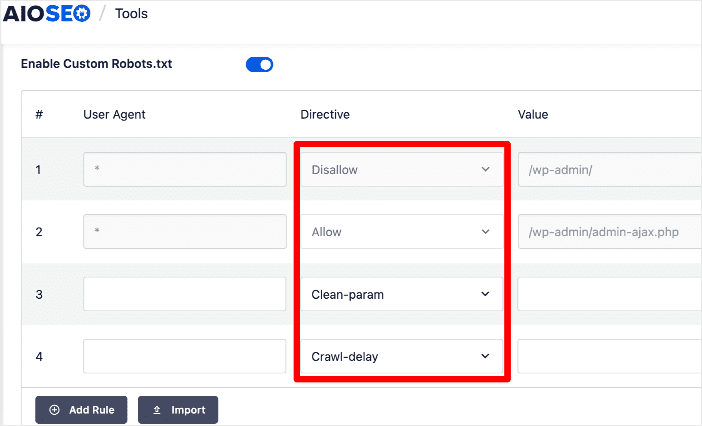

Le générateur de règles est utilisé pour ajouter vos propres règles personnalisées sur les pages que les robots doivent explorer ou non.

Par exemple, vous pouvez utiliser le générateur de règles si vous souhaitez ajouter une règle qui bloque tous les robots d'un répertoire temporaire.

Pour ajouter une règle personnalisée, entrez l'User Agent (par exemple, le robot d'exploration Googlebot) dans le champ User Agent. Ou vous pouvez utiliser le symbole * pour appliquer votre règle à tous les agents utilisateurs (robots).

Sélectionnez ensuite l'une des directives prédéfinies de robots.txt : Allow, Disallow, Clean-param ou Crawl-delay.

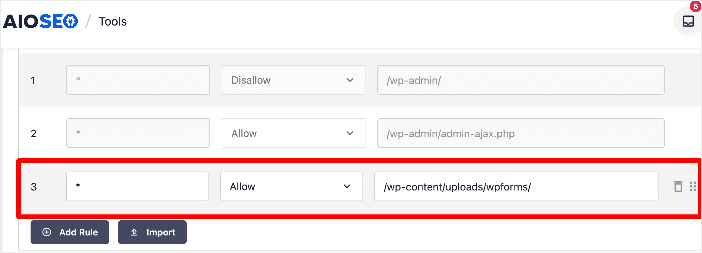

Vous pouvez également ajouter d'autres directives en cliquant sur le bouton Ajouter une règle.

Une fois que vous avez choisi la directive à appliquer, vous devez entrer le chemin du répertoire ou le nom du fichier dans le champ Valeur.

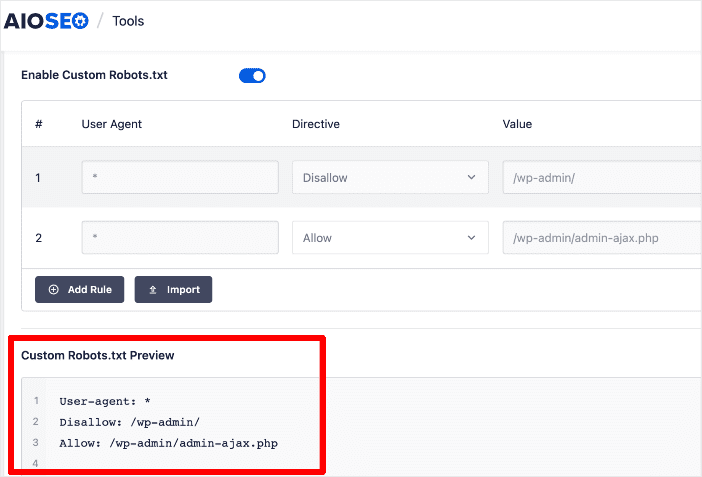

Une fois cela fait, vous pouvez cliquer sur le bouton Enregistrer les modifications dans le coin inférieur droit de la page.

Lorsque vous avez enregistré vos nouvelles règles, elles apparaîtront dans la section Aperçu du Robots.txt.

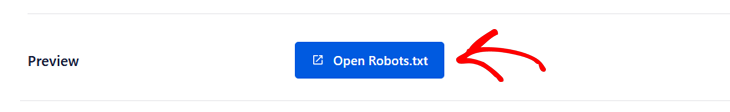

Pour afficher votre fichier robots.txt, cliquez sur le bouton Ouvrir Robots.txt.

Cela vous mènera à l'URL où votre robots.txt est hébergé.

Méthode 2 : Importer des règles d'un autre site

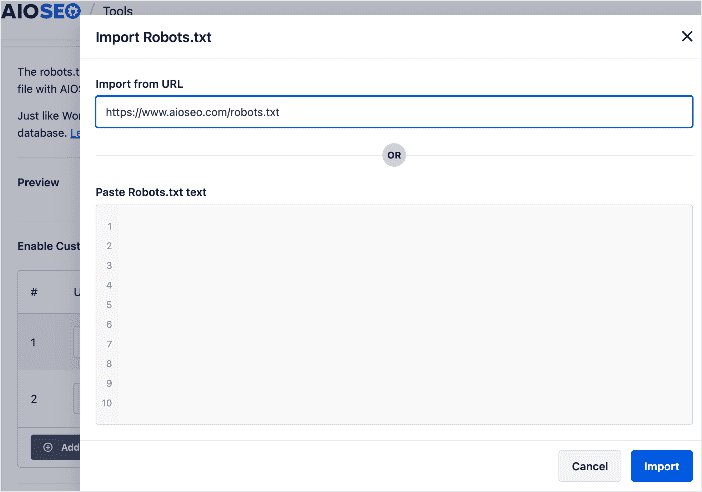

Une autre façon simple d'ajouter des directives dans votre robots.txt est de les importer d'un autre site. Cette fonction est utile si vous avez créé un site ou si vous en connaissez un avec un fichier robots.txt que vous aimeriez reproduire.

Pour importer un fichier robots.txt d'un autre site, allez dans le menu AIOSEO, puis Outils » Robots.txt » Activer le fichier Robots.txt personnalisé.

Ensuite, cliquez sur l'option Importer.

Cela ouvrira une fenêtre où vous pourrez coller l'URL du site à partir duquel vous souhaitez extraire le fichier robots.txt.

Cliquez sur Importer, et vous serez invité à recharger votre site. Rechargez et le plugin extraira le fichier robots.txt et l'implémentera sur votre site.

Alternativement, vous pouvez copier le fichier robots.txt de votre site cible et le coller dans l'espace fourni. Encore une fois, cliquez sur Importer, et le fichier robots.txt sera ajouté à votre site.

C'est probablement le moyen le plus simple d'ajouter un fichier robots.txt personnalisé à votre site WordPress.

Modification des règles de Robots.txt à l'aide du générateur de règles

Pour modifier vos règles robots.txt, vous pouvez changer les détails dans le générateur de règles.

Vous pouvez également supprimer une règle dans le fichier robots.txt en cliquant sur l'icône de corbeille à droite de la règle.

Et ce n'est pas tout ! L'éditeur robots.txt d'AIOSEO vous permet de déplacer les règles de haut en bas pour les classer par ordre de priorité. Pour ce faire, cliquez sur les 6 points à côté de la corbeille et maintenez-les enfoncés pour faire glisser et repositionner une règle.

Une fois que vous avez terminé de modifier votre robots.txt, cliquez sur le bouton Enregistrer les modifications pour sauvegarder vos nouvelles règles.

Fonctions bonus d'édition de Robots.txt

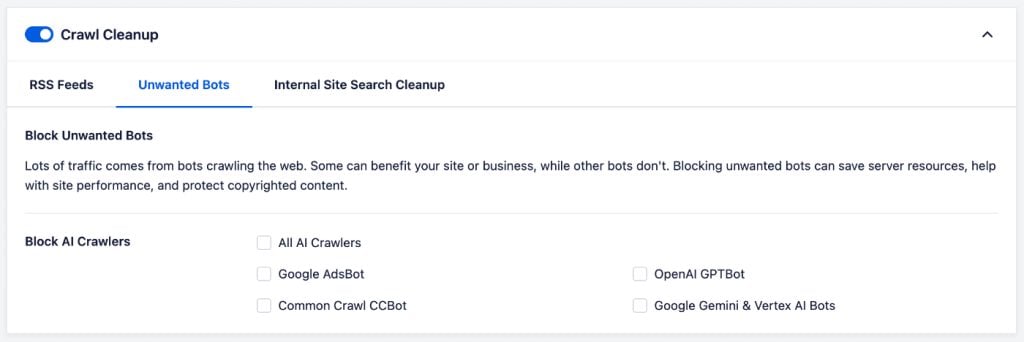

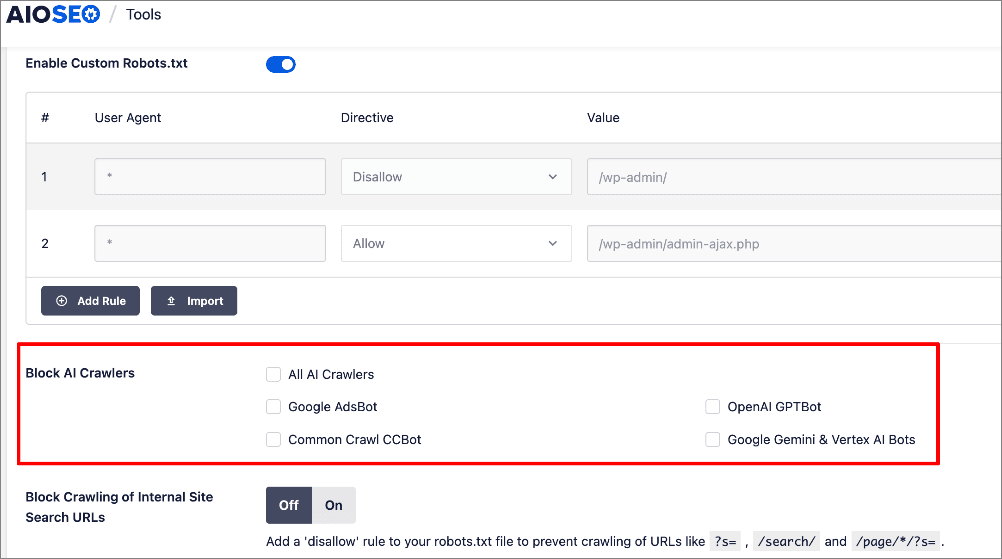

Blocage des robots ou des robots d'exploration indésirables [Moyen facile]

Les robots d'exploration Web, alias les bots ou les spiders, sont une arme à double tranchant. Beaucoup, comme les moteurs de recherche, sont nécessaires au succès de votre site. Cependant, certains peuvent simplement épuiser les ressources de votre serveur, ralentir votre site, voire voler votre contenu.

Comment je gère généralement ça ?

Comme je n'ai pas de formation technique, je cherche toujours la voie facile 😜. Le moyen le plus simple d'empêcher les robots indésirables d'explorer votre site est d'utiliser la fonction Crawl Cleanup d'AIOSEO. Celle-ci est dotée de paramètres qui vous aident à gérer le trafic des robots sur votre site.

Cette fonctionnalité vous permet de sélectionner les robots que vous souhaitez empêcher d'explorer votre site. Il vous suffit de sélectionner ceux que vous voulez bloquer.

Lorsque vous bloquez un robot indésirable, AIOSEO modifie le fichier robots.txt avec les directives disallow. Cette fonctionnalité est également intégrée à l'éditeur robots.txt pour faciliter les choses.

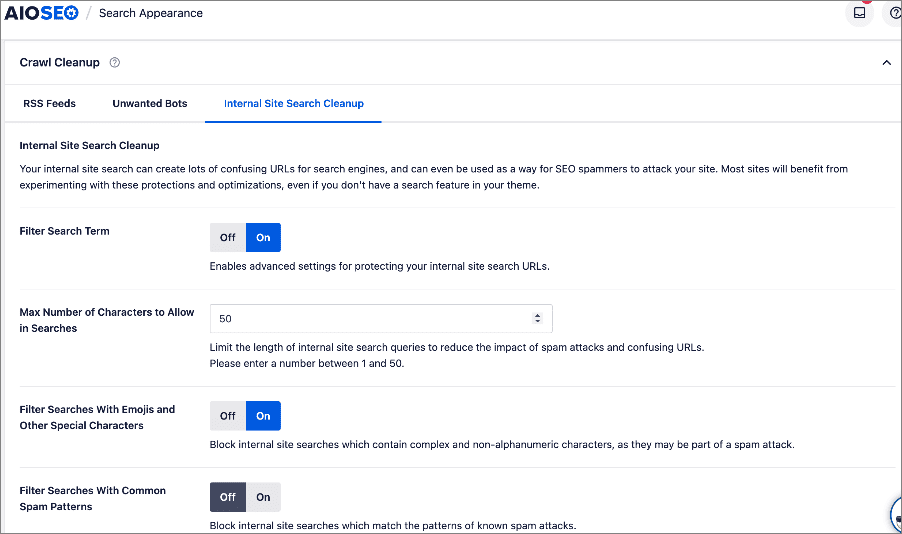

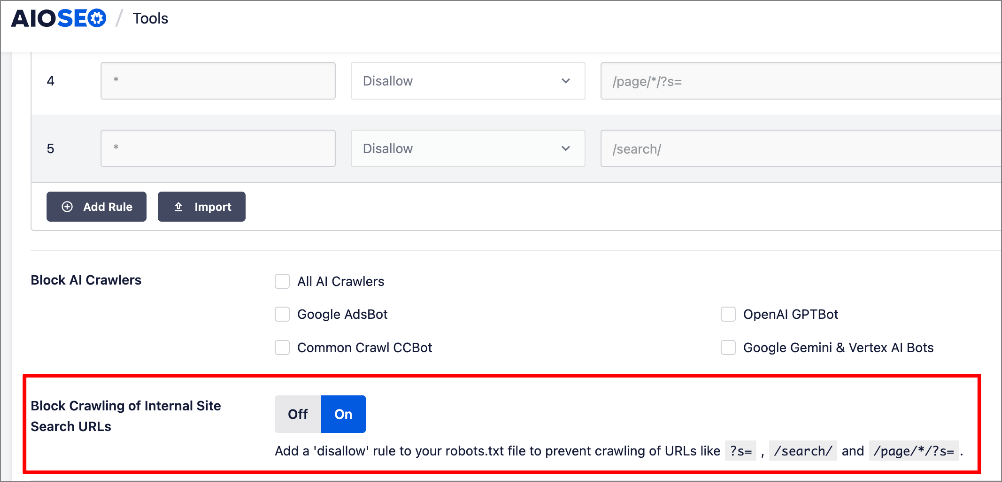

Blocage des recherches internes du site

Les sites Web génèrent souvent des URL inutiles à partir de recherches internes, ce qui entraîne un gaspillage de budgets d'exploration et de spam potentiel. Encore une fois, cela peut être facilement résolu en utilisant Crawl Cleanup d'AIOSEO. Il vous suffit de configurer les filtres à l'aide des bascules.

AIOSEO vous donne le pouvoir de contrôler la façon dont les moteurs de recherche et autres robots interagissent avec les URL créées par les recherches internes du site. Vous pouvez :

- Définir une limite maximale de caractères pour les requêtes de recherche, empêchant ainsi les URL de recherche volumineuses.

- Filtrer automatiquement les émojis et les caractères spéciaux pour éviter les termes de recherche encombrés ou absurdes.

- Bloquer les modèles de spam courants, empêchant les recherches indésirables de créer des URL indexables inutiles.

Encore une fois, AIOSEO modifie votre fichier robots.txt en arrière-plan. Alternativement, vous pouvez également configurer ces paramètres dans votre éditeur robots.txt :

Aussi simple que cela !

Vous avez modifié votre fichier robots.txt.

Modification des fichiers Robots.txt : Vos FAQ répondues

Qu'est-ce qu'un fichier robots.txt ?

Un fichier robots.txt est un fichier texte que les propriétaires de sites Web utilisent pour communiquer avec les robots d'exploration ou les robots sur les parties de leur site qui doivent être explorées et indexées par les moteurs de recherche.

Où se trouve le fichier robots.txt ?

Le fichier robots.txt est généralement situé dans le répertoire racine d'un site Web. Son URL est généralement https://www.example.com/robots.txt.

Quelle est la meilleure façon de modifier les fichiers robots.txt ?

La meilleure façon de modifier votre fichier robots.txt est d'utiliser un plugin comme All In One SEO (AIOSEO). C'est le meilleur plugin SEO WordPress et il dispose d'un éditeur robots.txt avancé qui rend l'optimisation des fichiers robots.txt super facile.

Nous espérons que ce tutoriel vous a montré comment modifier facilement un fichier robots.txt dans WordPress. Vous voudrez peut-être aussi consulter d'autres articles sur notre blog, comme nos conseils pour être indexé sur Google ou notre guide sur l'utilisation des statistiques de recherche pour améliorer votre classement.

Si vous avez trouvé cet article utile, alors abonnez-vous à notre chaîne YouTube. Vous y trouverez de nombreux autres tutoriels utiles. Vous pouvez également nous suivre sur X (Twitter), LinkedIn ou Facebook pour rester informé.

Divulgation : Notre contenu est financé par nos lecteurs. Cela signifie que si vous cliquez sur certains de nos liens, nous pouvons gagner une commission. Nous ne recommandons que les produits qui, selon nous, apporteront de la valeur à nos lecteurs.

Bonjour, merci pour l'article.

J'ai récemment lu votre article sur la dégradation du contenu. L'un de nos problèmes est la vitesse des pages et j'ai travaillé à réduire le temps de chargement. Cependant, je ne suis pas un pro du codage ou quoi que ce soit de remotement lié aux trucs techniques. Je m'occupe généralement du marketing et du design.

Avec ce contexte, ma question est la suivante : lors du téléchargement d'images et de la rédaction de leurs légendes et de leurs balises alt, je souhaite qu'elles apparaissent dans les SERP pour les recherches d'images, mais je ne veux pas provoquer de gonflement de l'index.

Y a-t-il des tactiques que vous me recommandez d'utiliser pour éviter cela ? J'ai déjà désactivé le sitemap d'images (aujourd'hui même), après avoir lu qu'il n'était pas nécessaire et qu'il ne supprimerait pas mes images actuelles du site.

Cela m'amène également à poser une deuxième question : comment saurai-je (en tant que personne qui ne sait pas lire le HTML, le JS ou quoi que ce soit de ce genre) si la désactivation du sitemap d'images a été efficace pour améliorer la vitesse de chargement ? Merci pour votre aide !