Gostaria de saber tudo sobre os arquivos robots.txt do WordPress?

Os arquivos Robots.txt ajudam você a controlar como os bots de busca interagem com seu site. Isso o torna uma ferramenta de SEO muito útil para quem sabe usá-la.

Neste artigo, mostraremos tudo o que você precisa saber sobre os arquivos robots.txt do WordPress.

Neste Artigo

- O que são Arquivos Robots.txt do WordPress

- 6 Reasons You Need a WordPress Robots.txt File

- How to Generate a WordPress Robots.txt File

- Tips for Optimizing WordPress Robots.txt Files

- Como Testar Seus Arquivos Robots.txt do WordPress

- WordPress Robots.txt Files: Your FAQs Answered

- Use o Poder do Seu Arquivo Robots.txt do WordPress com Sabedoria

O que são Arquivos Robots.txt do WordPress

Os arquivos robots.txt do WordPress são arquivos de texto simples que os proprietários de sites criam para instruir os bots de motores de busca sobre como interagir com seus sites, principalmente quais páginas rastrear e quais ignorar. O arquivo é armazenado no diretório raiz de um site, também conhecido como pasta principal.

Em essência, um arquivo robots.txt do WordPress atua como o porteiro do seu site.

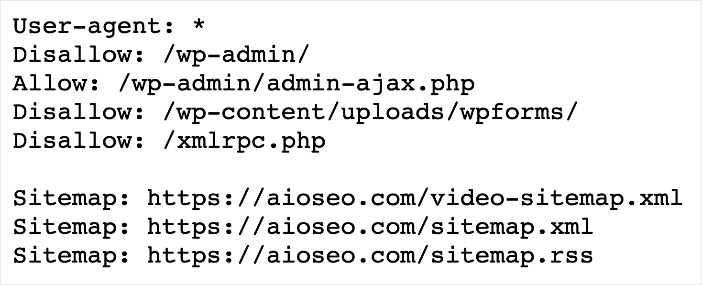

É assim que ele se parece:

Você pode acessar seu arquivo robots.txt visitando https://seusite.com/robots.txt.

Isso não deve ser confundido com tags meta robots, que são tags HTML incorporadas no cabeçalho de uma página da web. A tag se aplica apenas à página em que está.

6 Razões Pelas Quais Você Precisa de um Arquivo Robots.txt do WordPress

Agora que você sabe o que é um arquivo robots.txt do WordPress, vamos ver brevemente por que você precisa de um.

1. Controle de Rastreamento de Motores de Busca

O principal propósito de um arquivo robots.txt do WordPress é controlar quais partes do seu site os motores de busca (e outros bots) podem e não podem rastrear. Isso é crucial para garantir que os motores de busca se concentrem em descobrir o conteúdo que você deseja que apareça nas páginas de resultados dos motores de busca (SERPs), enquanto evitam páginas sensíveis ou irrelevantes.

2. Melhore a Indexação

Outra razão pela qual você deve otimizar seu arquivo robots.txt é que ele ajuda a melhorar a indexação do seu site. Você pode configurar seu arquivo robots.txt para priorizar o rastreamento e a indexação de páginas importantes. Como resultado, você garante que as páginas que mais importam para o seu negócio tenham uma chance maior de ranquear.

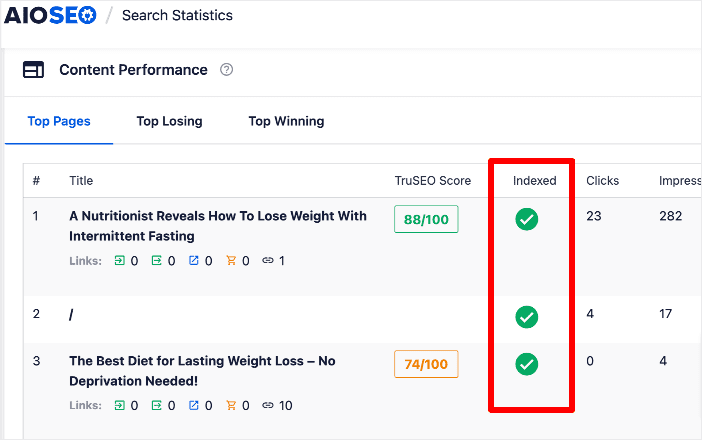

Você pode usar facilmente o AIOSEO para verificar o status de indexação de suas postagens e páginas.

Isso o ajudará a acompanhar facilmente o status de indexação de suas páginas.

3. Evite Conteúdo Duplicado

Conteúdo duplicado refere-se a páginas ou postagens com conteúdo exato ou semelhante. Isso pode impactar negativamente seu SEO se não for tratado corretamente.

Um arquivo robots.txt pode ser usado para impedir que os mecanismos de busca indexem várias versões do mesmo conteúdo. Fazer isso ajudará a garantir que a página que você deseja classificar seja rastreada e indexada pelos mecanismos de busca.

4. Conservação de Largura de Banda

Crawlers de mecanismos de busca consomem recursos do servidor e largura de banda ao rastrear seu site. Especificar quais páginas ou diretórios devem ser rastreados pode ajudar a conservar os recursos do servidor e melhorar o desempenho do seu site.

Ele também pode ser usado para otimizar o orçamento de rastreamento, pois pode ajudá-lo a priorizar as páginas e postagens a serem rastreadas.

5. Proteção de Privacidade

Se você tem partes do seu site contendo informações sensíveis ou dados confidenciais, pode impedir que os mecanismos de busca as rastreiem e indexem. Tudo o que você precisa fazer é bloquear o acesso a essas áreas em seu robots.txt, ajudando assim a proteger sua privacidade e segurança.

6. Melhore a Experiência do Usuário

Ao controlar quais páginas podem ser rastreadas e indexadas pelos mecanismos de busca, você pode garantir que os usuários sejam direcionados para o conteúdo mais relevante e atualizado do seu site. Isso ajuda a aprimorar a experiência geral deles.

Como você pode ver, um arquivo robots.txt do WordPress é fundamental para o gerenciamento de sites. Configurado corretamente, ele pode impactar significativamente o desempenho do seu site e a visibilidade nos resultados dos mecanismos de busca.

Como Gerar um Arquivo Robots.txt do WordPress

Gerar um arquivo robots.txt do WordPress é muito fácil. Aqui estão os passos para fazer isso — nenhum código é necessário.

Passo 1: Instalar AIOSEO

O primeiro passo para gerar arquivos robots.txt personalizados é instalar e ativar o All In One SEO (AIOSEO).

AIOSEO é um plugin de SEO poderoso, porém fácil de usar, que ostenta mais de 3 milhões de instalações ativas. Milhões de blogueiros inteligentes usam o AIOSEO para ajudá-los a impulsionar seus rankings nos mecanismos de busca e direcionar tráfego qualificado para seus blogs. Isso porque o plugin possui muitos recursos e módulos poderosos projetados para ajudá-lo a configurar corretamente suas configurações de SEO. Exemplos incluem:

- Estatísticas de Pesquisa: Esta poderosa integração com o Google Search Console permite que você acompanhe suas classificações de palavras-chave e veja métricas importantes de SEO com 1 clique, e mais.

- Gerador de Schema de próxima geração: Este gerador de schema sem código permite aos usuários gerar e exibir qualquer marcação de schema em seu site.

- Gerenciador de Redirecionamento: Ajuda você a gerenciar redirecionamentos e eliminar erros 404, facilitando o rastreamento e a indexação do seu site pelos mecanismos de busca.

- Link Assistant: Poderosa ferramenta de linkagem interna que automatiza a criação de links entre páginas do seu site. Ela também fornece uma auditoria de links de saída.

- Pré-visualização de SEO: Isso oferece uma visão geral de seus snippets de pesquisa e sociais e SEO geral para que você possa melhorar sua otimização.

- IndexNow: Para indexação rápida em motores de busca que suportam o protocolo IndexNow (como Bing e Yandex).

- Gerador de Sitemap: Gere automaticamente diferentes tipos de sitemaps para notificar todos os mecanismos de pesquisa sobre quaisquer atualizações em seu site.

- E mais.

Para instruções passo a passo sobre como instalar o AIOSEO, confira nosso guia de instalação.

Um dos recursos mais amados é o editor de robots.txt avançado. Esta poderosa ferramenta facilita a configuração e personalização do seu arquivo robots.txt do WordPress.

Observação: O WordPress gera automaticamente um arquivo robots.txt para cada site. No entanto, ele não é personalizável de imediato. Para isso, você precisará de um plugin. É aqui que entram ferramentas como o AIOSEO.

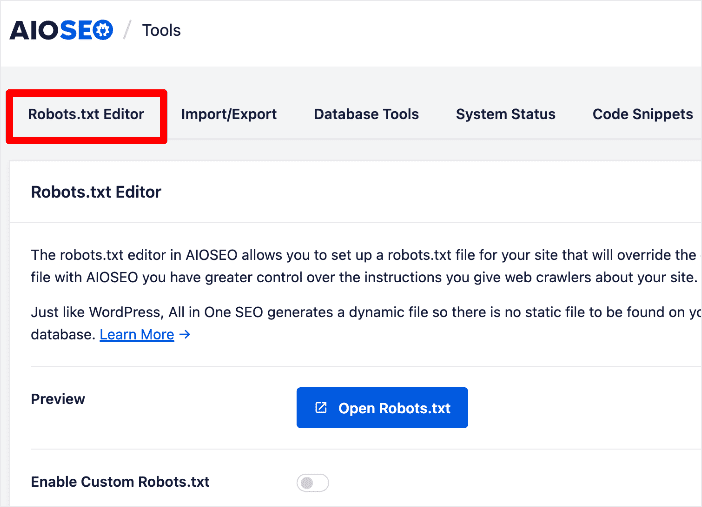

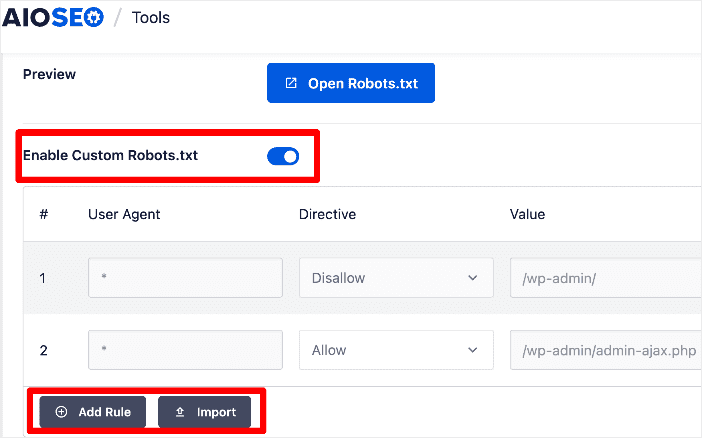

Passo 2: Abra o Editor do Arquivo Robots.txt do WordPress

Depois de ativar o AIOSEO, o próximo passo é abrir seu arquivo robots.txt do WordPress no modo editor. Para fazer isso, vá até o menu AIOSEO e clique em Ferramentas » Editor de Robots.txt.

Em seguida, clique no botão Ativar Robots.txt Personalizado para permitir a edição do seu arquivo robots.txt.

Confira nossa lista dos melhores geradores de robots.txt para mais opções.

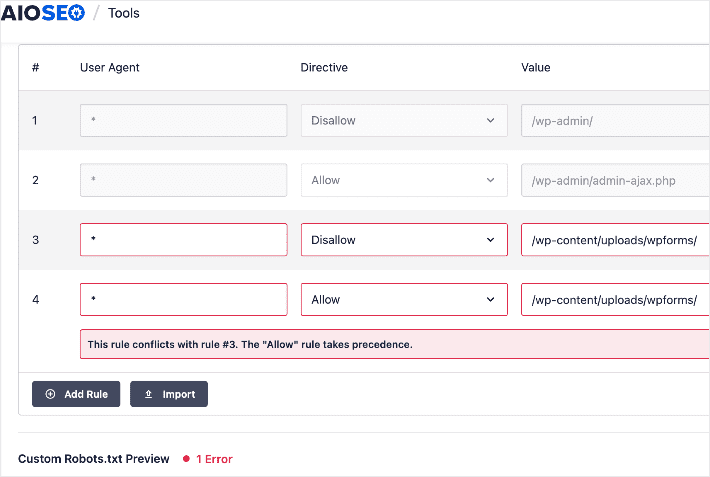

Passo 3: Configure as Diretivas do Seu Robots.txt

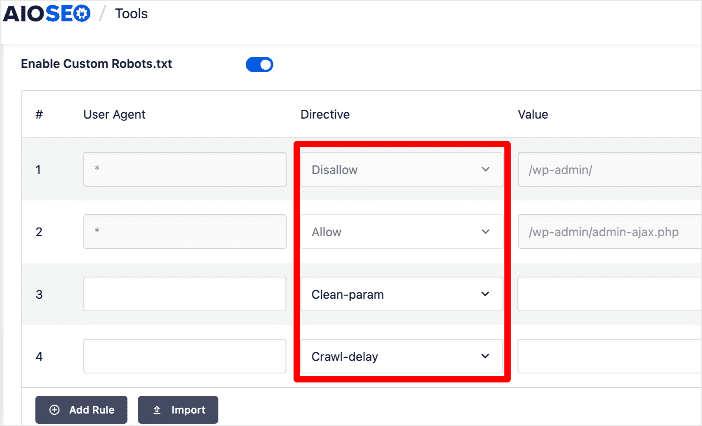

Depois de ativar a edição dos seus arquivos robots.txt, o próximo passo é configurar diretivas personalizadas no seu arquivo robots.txt. Você também pode definir quais user agents (bots) devem seguir essas diretivas.

Diretivas são as instruções que você deseja que os bots de busca sigam. Exemplos de diretivas que você encontrará no editor robots.txt do AIOSEO incluem Allow, Disallow, Clean-param e Crawl delay.

Aqui está o que cada diretiva significa:

- Allow: Permite que os agentes de usuário (bots) rastreiem o URL.

- Disallow: Proíbe os agentes de usuário (bots) de rastrear o URL.

- Clean-param: Diz aos bots de busca para ignorar todos os URLs com os parâmetros de URL especificados.

- Crawl-delay: Define os intervalos para os bots de busca rastrearem a URL.

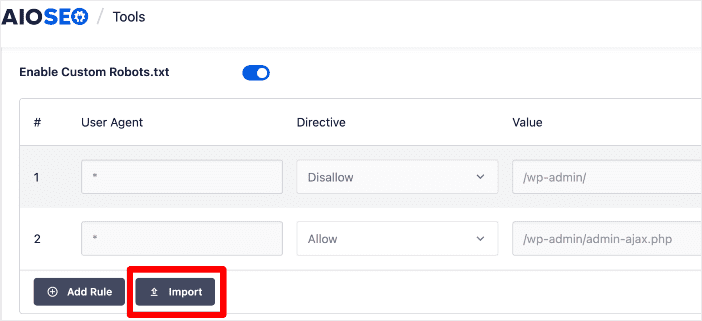

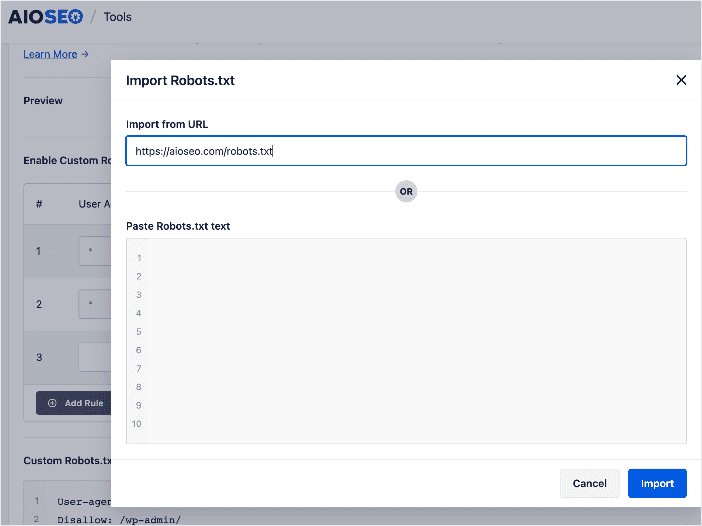

Além de adicionar manualmente suas diretivas, você pode importar um arquivo robots.txt pré-configurado de outro site usando a função Importar.

Clicar no botão Importar abrirá uma janela com 2 opções para importar seu arquivo robots.txt escolhido: Importar da URL e Colar texto do Robots.txt.

Este método é melhor se o site do qual você está importando o arquivo robots.txt tiver diretivas que você gostaria de implementar em seu site.

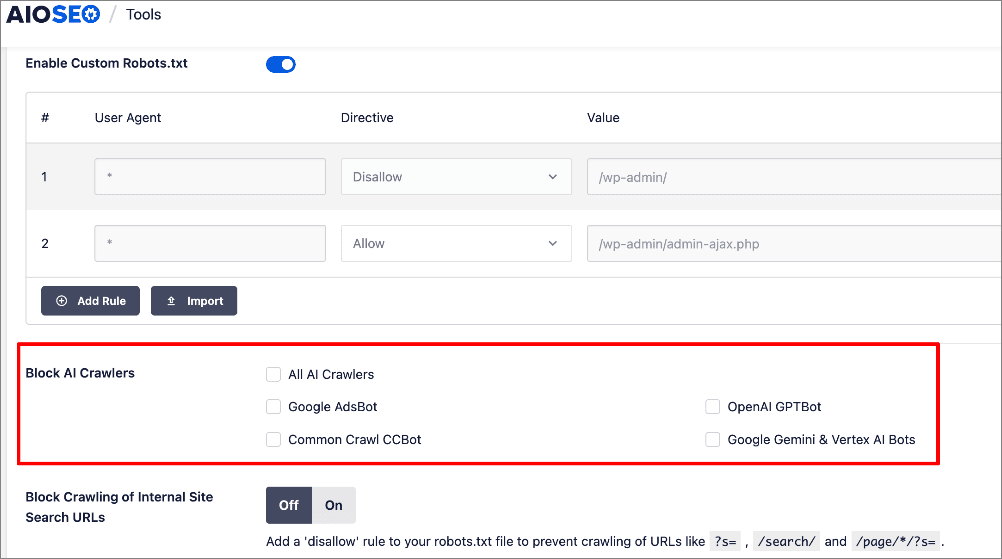

4. Bloqueie Bots Indesejados

Outra funcionalidade super legal no Editor Robots.txt do AIOSEO é a seção Bloquear Rastreadores de IA. Isso permite que você bloqueie bots não autorizados de rastrear seu site. Eles podem causar problemas de desempenho, segurança e SEO.

Para saber mais sobre isso, confira nosso tutorial sobre bloquear tráfego indesejado de bots em seu site.

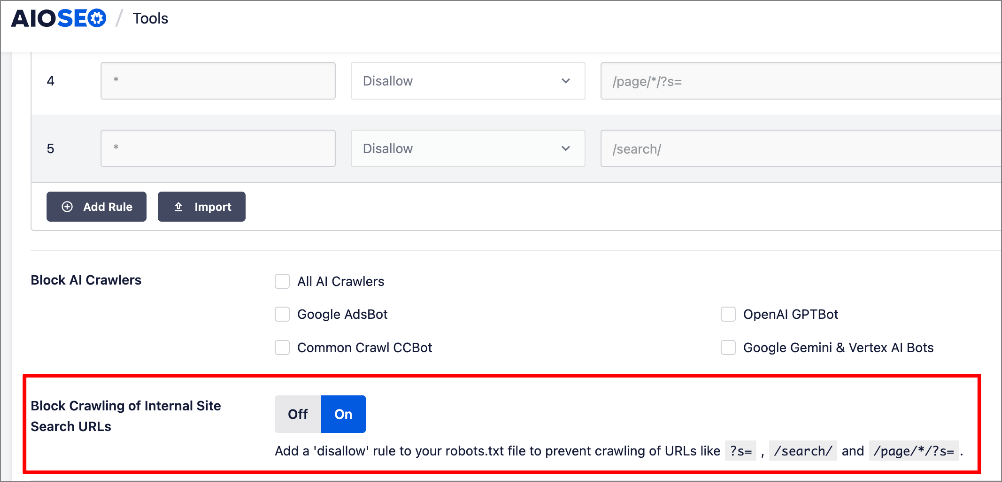

5. Evite o Rastreamento de URLs de Pesquisa Interna do Site

Sites frequentemente geram URLs em excesso de pesquisas internas quando os visitantes procuram por conteúdo ou produtos. Essas URLs geradas por pesquisa contêm parâmetros que os motores de busca percebem como únicos, fazendo com que rastreiem páginas desnecessárias. Isso desperdiça seu orçamento de rastreamento e pode impedir que suas páginas mais importantes sejam indexadas.

Você pode facilmente evitar isso no Editor Robots.txt do AIOSEO.

O AIOSEO adiciona uma regra "disallow" em seu arquivo robots.txt sem que você precise fazer isso para cada parâmetro gerado pela busca.

Para mais informações, confira nosso tutorial sobre editar seu arquivo robots.txt.

Dicas para Otimizar Arquivos Robots.txt do WordPress

Inclua a URL do seu Sitemap

Incluir um link para o seu sitemap é essencial para ajudar os bots de busca a rastrear e indexar suas páginas importantes. Embora omiti-lo do seu arquivo robots.txt possa não prejudicar seu SEO, ele inquestionavelmente tem um impacto positivo. Felizmente, o AIOSEO adiciona automaticamente a URL do seu sitemap quando ele gera um arquivo robots.txt, portanto, nenhuma personalização adicional é necessária.

Entenda e Use Caracteres Curinga com Sabedoria

Um curinga é um caractere que pode representar um ou mais caracteres. O curinga mais comum é o asterisco (*).

Se você tem muitas páginas que deseja bloquear, pode ser demorado adicionar uma regra para cada uma. Felizmente, você pode usar curingas para simplificar suas instruções.

Curingas são caracteres especiais que permitem criar regras baseadas em padrões em seus arquivos robots.txt do WordPress. Eles fornecem uma maneira de aplicar diretivas a um grupo de URLs que compartilham um padrão comum, em vez de especificar cada URL individualmente. Existem dois tipos principais de curingas usados em robots.txt:

- Curinga Asterisco (*): Representa qualquer sequência de caracteres e é usado para corresponder a URLs que correspondem a um padrão especificado. Por exemplo, User-agent: * significa que todos os user agents devem seguir a diretiva prescrita.

- Curinga Sinal de Dólar ($): É usado para corresponder ao final de uma URL. Digamos que você queira bloquear o acesso a todas as URLs que terminam com “.pdf”, você pode usar o sinal de dólar em uma diretiva como esta — Disallow: /*.pdf$.

No entanto, os curingas devem ser usados com cautela, pois o uso indevido deles pode bloquear ou permitir o acesso não intencional a várias páginas ou diretórios.

Use Comentários para Clareza

Adicione comentários em seu arquivo robots.txt para explicar suas diretivas. Isso ajudará você e outras pessoas a entender o propósito de cada regra. Para adicionar um comentário, coloque um hashtag (#) no início do comentário. Os bots de busca ignorarão tudo após o #.

Como Testar Seus Arquivos Robots.txt do WordPress

Depois de terminar de gerar e configurar seu arquivo robots.txt do WordPress, você pode testá-lo para quaisquer erros. Você pode usar ferramentas como a ferramenta de teste de robots.txt do Google Search Console.

No entanto, você não precisará delas se usar o editor de robots.txt do AIOSEO, pois ele possui validação de regras e tratamento de erros integrados.

Arquivos Robots.txt do WordPress: Suas Perguntas Frequentes Respondidas

O que é um arquivo robots.txt no WordPress?

Um arquivo robots.txt é um arquivo de texto simples colocado no diretório raiz de um site WordPress. Ele instrui os rastreadores de mecanismos de busca sobre quais partes do site devem ser rastreadas e indexadas e quais partes devem ser excluídas.

Como posso gerar robots.txt no WordPress?

Você pode facilmente gerar um arquivo robots.txt no WordPress usando um plugin como o All In One SEO (AIOSEO). Você nem precisa de conhecimento de codificação ou técnico.

Posso usar o robots.txt para melhorar o SEO?

Sim, otimizar seu arquivo robots.txt pode contribuir para um melhor SEO. Você pode melhorar a visibilidade e o ranking do seu site nos resultados de pesquisa, orientando os bots dos motores de busca a rastrear e indexar seu conteúdo mais valioso, enquanto exclui conteúdo duplicado ou irrelevante.

Use o Poder do Seu Arquivo Robots.txt do WordPress com Sabedoria

Seu arquivo robots.txt do WordPress é uma ferramenta poderosa que pode ajudar a melhorar sua rastreabilidade, indexação e rankings nas SERPs.

Esperamos que este post tenha ajudado você a obter um conhecimento abrangente sobre os arquivos robots.txt do WordPress e por que é importante otimizar o seu. Você também pode conferir outros artigos em nosso blog, como nosso guia sobre criar conteúdo escaneável ou nosso tutorial sobre usar um gerador de títulos de SEO para impulsionar seus rankings e CTR.

Se você achou este artigo útil, por favor, inscreva-se em nosso Canal do YouTube. Você encontrará muitos outros tutoriais úteis lá. Você também pode nos seguir no X (Twitter), LinkedIn ou Facebook para ficar por dentro.

Aviso: Nosso conteúdo é apoiado pelo leitor. Isso significa que se você clicar em alguns de nossos links, poderemos ganhar uma comissão. Recomendamos apenas produtos que acreditamos que agregarão valor aos nossos leitores.