¿Te gustaría saber cómo editar archivos robots.txt en WordPress?

Solía intimidarme editar archivos robots.txt en WordPress. Como alguien que ha creado y administrado más de una docena de sitios de WordPress, recuerdo mirar fijamente mi pantalla, preocupado de que un movimiento en falso pudiera arruinar el SEO de mi sitio.

El archivo robots.txt puede parecer aterrador, pero en realidad es un archivo de texto simple que le dice a los motores de búsqueda a qué partes de tu sitio pueden o no acceder. Después de años trabajando con WordPress, he aprendido que editar este archivo no tiene por qué ser complicado en absoluto.

En esta guía paso a paso, te mostraré las formas más fáciles y seguras de editar tu archivo robots.txt en WordPress. Ya sea que desees bloquear ciertas páginas de los motores de búsqueda o solucionar problemas de SEO, aprenderás exactamente qué hacer.

No te preocupes, te guiaré en cada paso, así que no romperás nada.

En este artículo

¿Qué es un archivo robots.txt?

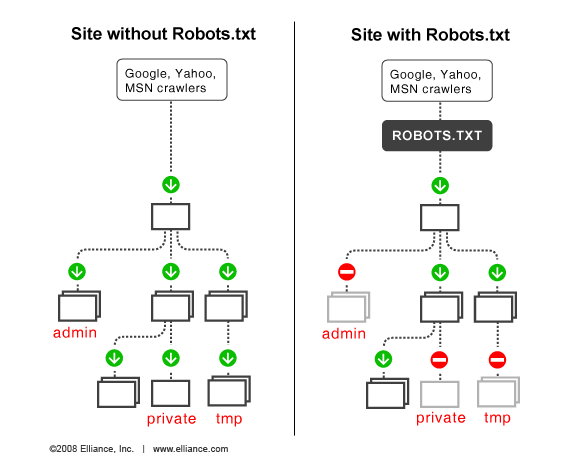

Un archivo robots.txt le dice a los motores de búsqueda cómo rastrear tu sitio, a dónde tienen permitido ir o no.

Los motores de búsqueda como Google utilizan estos rastreadores web, a veces llamados robots web, para archivar y categorizar sitios web.

La mayoría de los bots están configurados para buscar un archivo robots.txt en el servidor antes de leer cualquier otro archivo de tu sitio. Lo hace para ver si has agregado instrucciones especiales sobre cómo rastrear e indexar tu sitio.

El archivo robots.txt se almacena típicamente en el directorio raíz, también conocido como la carpeta principal de tu sitio web.

La URL puede verse así:

http://www.example.com/robots.txt

Para comprobar el archivo robots.txt de tu sitio web, simplemente reemplaza http://www.example.com/ con tu dominio y añade robots.txt al final.

Ahora, veamos cómo es el formato básico de un archivo robots.txt:

User-agent: [user-agent name]

Disallow: [URL string not to be crawled]

User-agent: [user-agent name]

Allow: [URL string to be crawled]

Sitemap: [URL of your XML Sitemap]

User-agent se refiere al bot o robot del motor de búsqueda que deseas bloquear o permitir que rastree tu sitio (por ejemplo, el rastreador Googlebot).

Al editar tu archivo robots.txt, puedes incluir múltiples instrucciones para Permitir o Denegar URLs específicas, además de añadir múltiples sitemaps. También puedes excluir parámetros de URL usando la directiva Clean-param y establecer la frecuencia de las visitas de los bots de búsqueda usando la directiva Crawl-delay.

Archivo robots.txt predeterminado en WordPress

Por defecto, WordPress crea automáticamente un archivo robots.txt para tu sitio. Por lo tanto, incluso si no haces nada, tu sitio ya debería tener el archivo robots.txt predeterminado de WordPress.

Pero cuando lo personalizas más tarde con tus propias reglas, el contenido predeterminado se reemplaza.

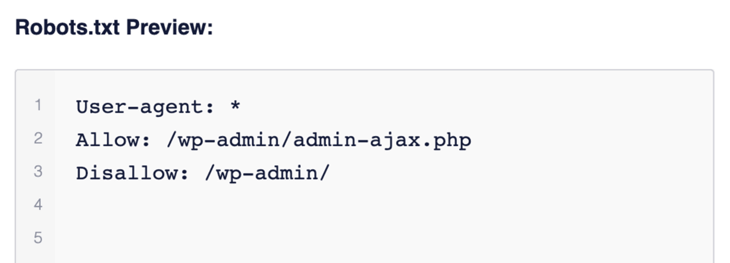

Así es como se ve el archivo robots.txt predeterminado de WordPress:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

El asterisco después de User-agent: * significa que el archivo robots.txt es para todos los robots web que visitan tu sitio. Como se mencionó, el Disallow: /wp-admin/ indica a los robots que no visiten tu página wp-admin.

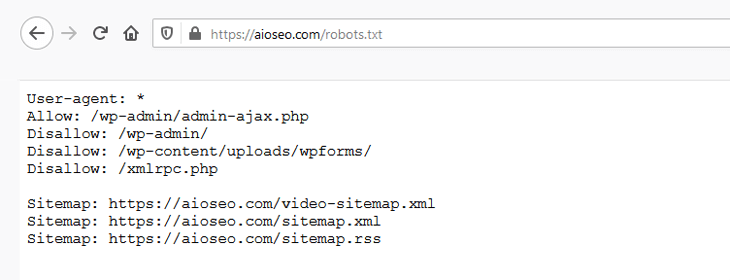

Puedes probar tu archivo robots.txt añadiendo /robots.txt al final del nombre de tu dominio. Por ejemplo, si introduces “https://aioseo.com/robots.txt” en tu navegador web, se mostrará el archivo robots.txt de AIOSEO:

Ahora que sabes qué es un archivo robots.txt y cómo funciona, veamos por qué el archivo robots.txt es importante en primer lugar.

¿Por qué es importante el archivo robots.txt?

El archivo robots.txt es importante si quieres:

- Optimizar la velocidad de carga de tu sitio: al indicar a los bots que no pierdan tiempo en páginas que no quieres que rastreen e indexen, puedes liberar recursos y aumentar la velocidad de carga de tu sitio.

- Optimizar el uso de tu servidor: bloquear bots que malgastan recursos limpiará tu servidor y reducirá los errores 404.

Cuándo usar la etiqueta Meta Noindex en lugar de Robots.txt

Si tu objetivo principal es evitar que ciertas páginas se incluyan en los resultados de los motores de búsqueda, usar una etiqueta meta noindex es el enfoque adecuado.

Esto se debe a que robots.txt no indica directamente a los motores de búsqueda que no indexen contenido, solo les indica que no lo rastreen.

En otras palabras, puedes usar robots.txt para añadir reglas específicas sobre cómo interactúan los motores de búsqueda y otros bots con tu sitio, pero no controlará explícitamente si tu contenido se indexa o no.

Dicho esto, te mostraremos cómo editar fácilmente tu archivo robots.txt en WordPress paso a paso usando AIOSEO.

Edición de tu robots.txt en WordPress usando AIOSEO

La forma más fácil de editar el archivo robots.txt es usar el mejor plugin de SEO para WordPress, All in One SEO (AIOSEO).

AIOSEO es un plugin de SEO potente pero fácil de usar que cuenta con más de 3 millones de usuarios. Eso significa que millones de bloggers inteligentes usan AIOSEO para ayudarles a mejorar sus rankings en los motores de búsqueda y dirigir tráfico cualificado a sus blogs. Esto se debe a que el plugin tiene muchas funciones y módulos potentes diseñados para ayudarte a configurar correctamente tus ajustes de SEO. Los ejemplos incluyen:

- Estadísticas de búsqueda: Esta potente integración de Google Search Console te permite rastrear tus rankings de palabras clave y ver métricas SEO importantes con 1 clic, y más.

- Generador de Schema de próxima generación: Este generador de schema sin código permite a los usuarios generar y mostrar cualquier marcado de schema en tu sitio.

- Administrador de redirecciones: Le ayuda a administrar las redirecciones y a eliminar los errores 404, lo que facilita que los motores de búsqueda rastreen e indexen su sitio.

- Asistente de enlaces: Potente herramienta de enlaces internos que automatiza la creación de enlaces entre las páginas de su sitio. También le proporciona una auditoría de los enlaces salientes.

- Vista Previa de SEO: Esto te da una visión general de tus fragmentos de búsqueda y sociales y del SEO general para que puedas mejorar tu optimización.

- IndexNow: Para una indexación rápida en motores de búsqueda que admiten el protocolo IndexNow (como Bing y Yandex).

- Generador de sitemaps: Genera automáticamente diferentes tipos de sitemaps para notificar a todos los motores de búsqueda sobre cualquier actualización en tu sitio.

- Y más.

Una razón por la que los usuarios aman el plugin es que te da un mayor control sobre cómo los motores de búsqueda rastrean tu sitio. Esto es gracias al editor avanzado de robots.txt que te permite configurar fácilmente tu archivo robots.txt, permitiéndote anular el archivo predeterminado de WordPress.

Consulta nuestra lista de los mejores generadores de robots.txt.

Consulta nuestra lista de los mejores generadores de robots.txt.

Así que, vamos a editar tu archivo robots.txt.

Para editar tu archivo robots.txt, primero habilita robots.txt personalizado

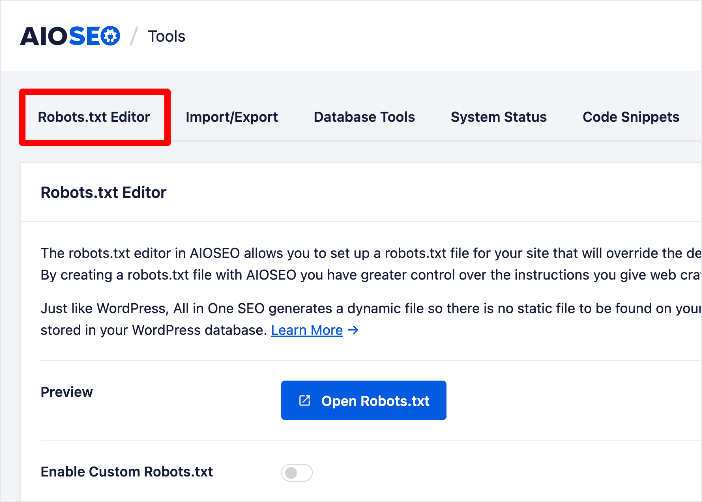

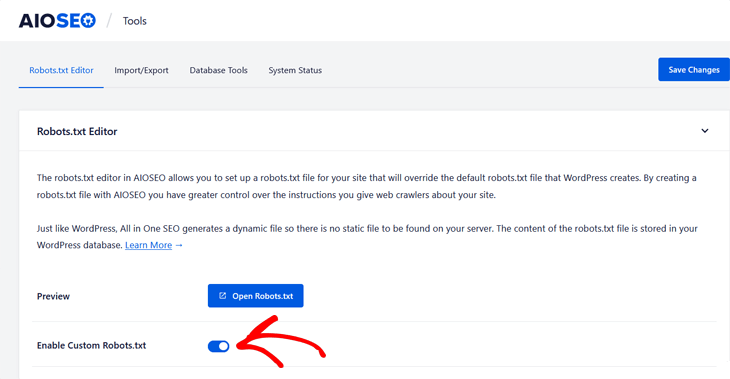

Para editar tu archivo robots.txt, haz clic en Herramientas en el menú de All in One SEO, y luego haz clic en la pestaña Editor de Robots.txt.

AIOSEO generará entonces un archivo robots.txt dinámico. Su contenido se almacena en tu base de datos de WordPress y se puede ver en tu navegador web, como te mostraremos en un momento.

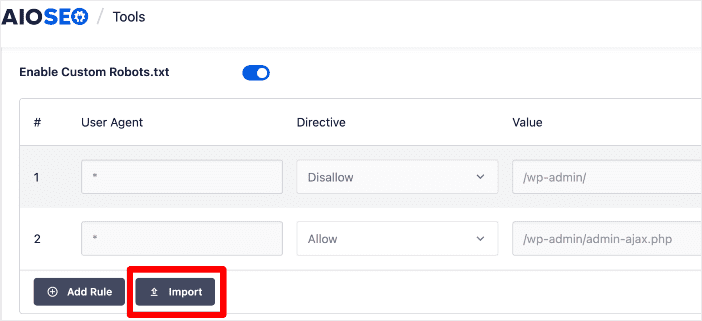

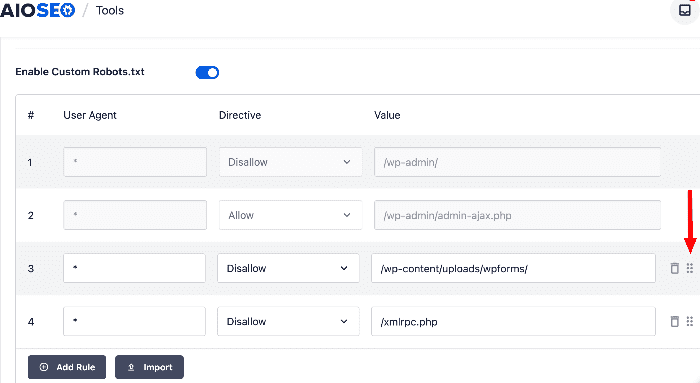

Una vez que haya entrado en el Editor de Robots.txt, necesita Habilitar Robots.txt Personalizado.

Haga clic en el botón para que se ponga azul.

A continuación, verá la sección Vista previa de Robots.txt en la parte inferior de la pantalla, que muestra las reglas predeterminadas de WordPress que puede sobrescribir con las suyas. Las reglas predeterminadas indican a los robots que no rastreen sus archivos principales de WordPress (páginas de administración).

Ahora, pasemos a añadir sus propias reglas. Puede hacerlo de 2 maneras: usando el generador de reglas o importando un archivo robots.txt de otro sitio.

Método 1: Añadir reglas usando el creador de reglas

El generador de reglas se utiliza para añadir sus propias reglas personalizadas sobre qué páginas deben rastrear los robots o no.

Por ejemplo, puede usar el generador de reglas si desea añadir una regla que bloquee a todos los robots de un directorio temporal.

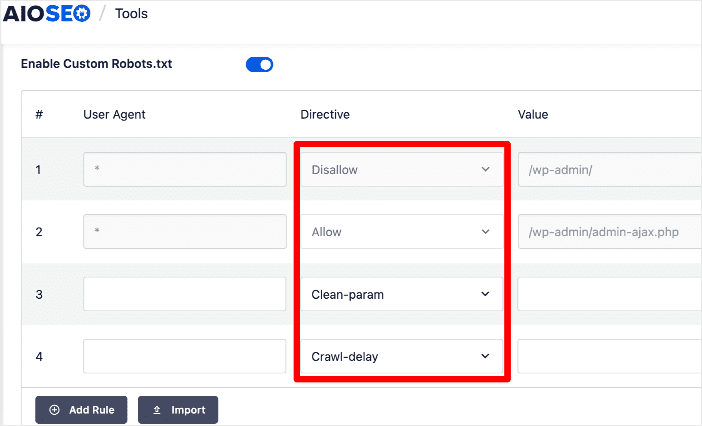

Para añadir una regla personalizada, introduzca el Agente de Usuario (por ejemplo, el rastreador Googlebot) en el campo Agente de Usuario. O puede usar el símbolo * para aplicar su regla a todos los agentes de usuario (robots).

A continuación, seleccione una de las directivas preestablecidas de robots.txt: Permitir, Denegar, Clean-param o Crawl-delay.

También puede añadir más directivas haciendo clic en el botón Añadir Regla.

Una vez que haya decidido la directiva a aplicar, debe introducir la ruta del directorio o el nombre del archivo en el campo Valor.

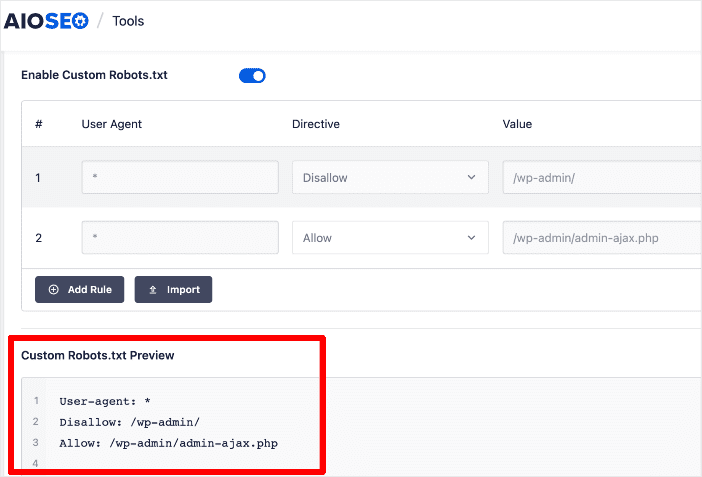

Una vez hecho esto, puede proceder a hacer clic en el botón Guardar Cambios en la esquina inferior derecha de la página.

Cuando haya guardado sus nuevas reglas, aparecerán en la sección Vista previa de Robots.txt.

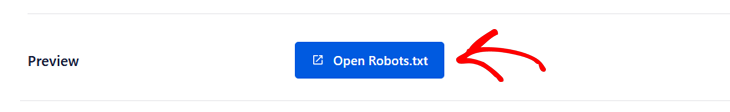

Para ver su archivo robots.txt, haga clic en el botón Abrir Robots.txt.

Esto le llevará a la URL donde está alojado su robots.txt.

Método 2: Importar reglas de otro sitio

Otra forma sencilla de añadir directivas en su robots.txt es importarlas de otro sitio. Esta función es útil si ha creado un sitio o conoce uno con un archivo robots.txt que le gustaría replicar.

Para importar un archivo robots.txt de otro sitio, vaya al menú de AIOSEO, luego a Herramientas » Robots.txt » Habilitar Robots.txt Personalizado.

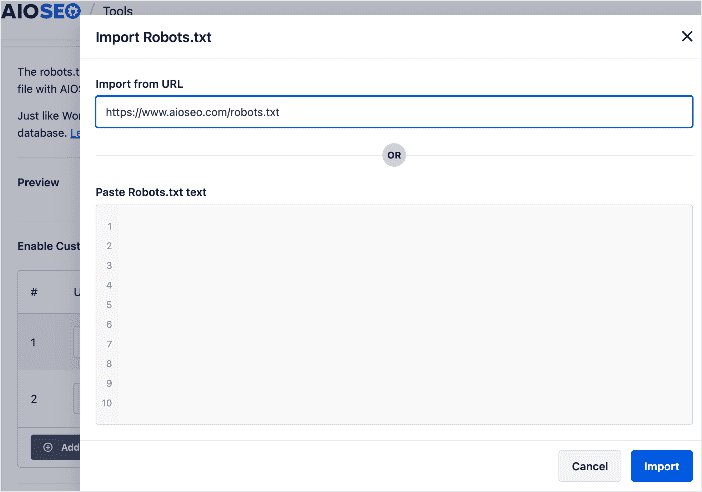

A continuación, haga clic en la opción Importar.

Esto abrirá una ventana donde puede pegar la URL del sitio del que desea extraer el archivo robots.txt.

Haga clic en Importar, y se le pedirá que recargue su sitio. Recargue y el plugin extraerá el archivo robots.txt y lo implementará en su sitio.

Alternativamente, puede copiar el archivo robots.txt de su sitio de destino y pegarlo en el espacio proporcionado. De nuevo, haga clic en Importar, y el archivo robots.txt se añadirá a su sitio.

Esta es probablemente la forma más fácil de añadir un archivo robots.txt personalizado a su sitio de WordPress.

Edición de las reglas de robots.txt usando el creador de reglas

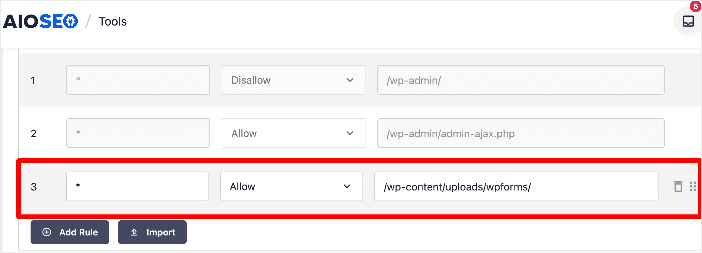

Para editar sus reglas de robots.txt, puede cambiar los detalles en el generador de reglas.

También puede eliminar una regla en el archivo robots.txt haciendo clic en el icono de la papelera a la derecha de la regla.

¡Y eso no es todo! El editor robots.txt de AIOSEO te permite mover reglas hacia arriba o hacia abajo para colocarlas en orden de prioridad. Para hacerlo, haz clic y mantén presionados los 6 puntos junto al icono de la papelera para arrastrar y reposicionar una regla.

Una vez que hayas terminado de editar tu robots.txt, haz clic en el botón Guardar Cambios para guardar tus nuevas reglas.

Funciones Adicionales de Edición de Robots.txt

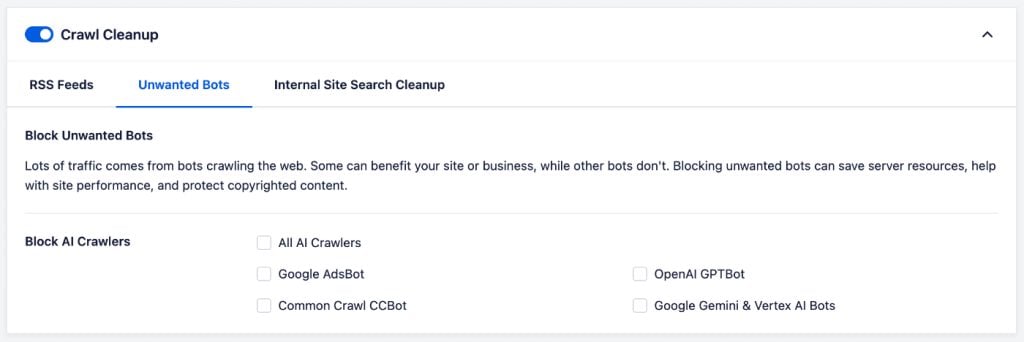

Bloqueo de bots o rastreadores web no deseados [Forma fácil]

Los rastreadores web, también conocidos como bots o arañas, son un arma de doble filo. Muchos, como los motores de búsqueda, son necesarios para el éxito de tu sitio. Sin embargo, algunos pueden consumir los recursos de tu servidor, ralentizar tu sitio o incluso robar tu contenido.

¿Cómo suelo lidiar con esto?

Como no tengo formación técnica, siempre busco la manera fácil 😜. La forma más sencilla de evitar que bots no deseados rastreen tu sitio es usar la función de Limpieza de Rastreo de AIOSEO. Esta viene con ajustes que te ayudan a gestionar el tráfico de bots en tu sitio.

Esta función te permite seleccionar los bots que deseas evitar que rastreen tu sitio. Todo lo que tienes que hacer es seleccionar los que quieres bloquear.

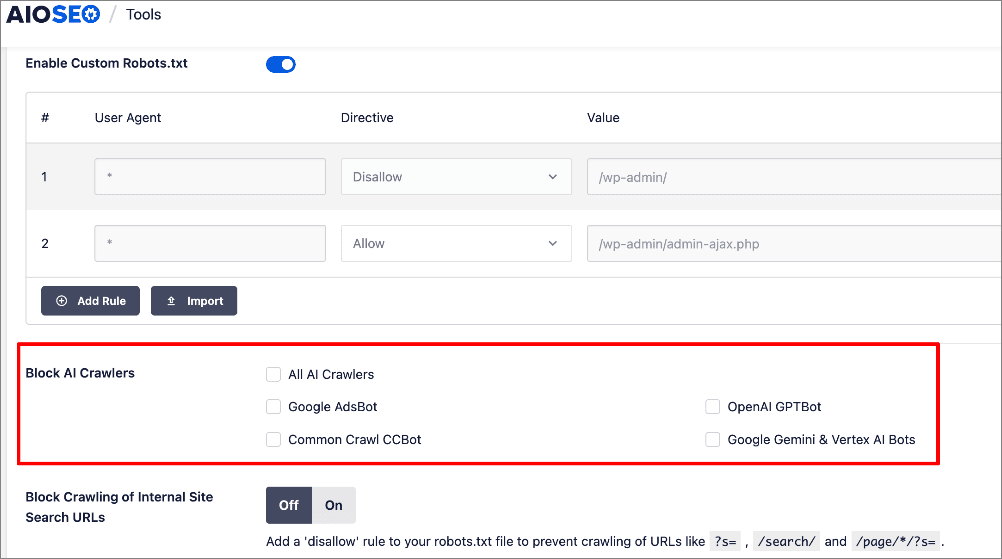

Cuando bloqueas un bot no deseado, AIOSEO edita el archivo robots.txt con las directivas de 'disallow'. Esta función también está integrada en el editor robots.txt para facilitar esto.

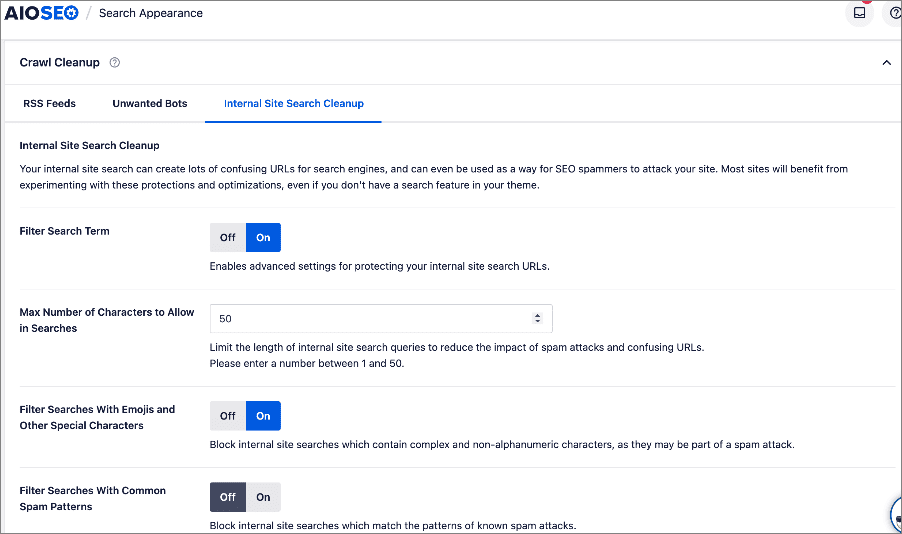

Bloqueo de búsquedas internas del sitio

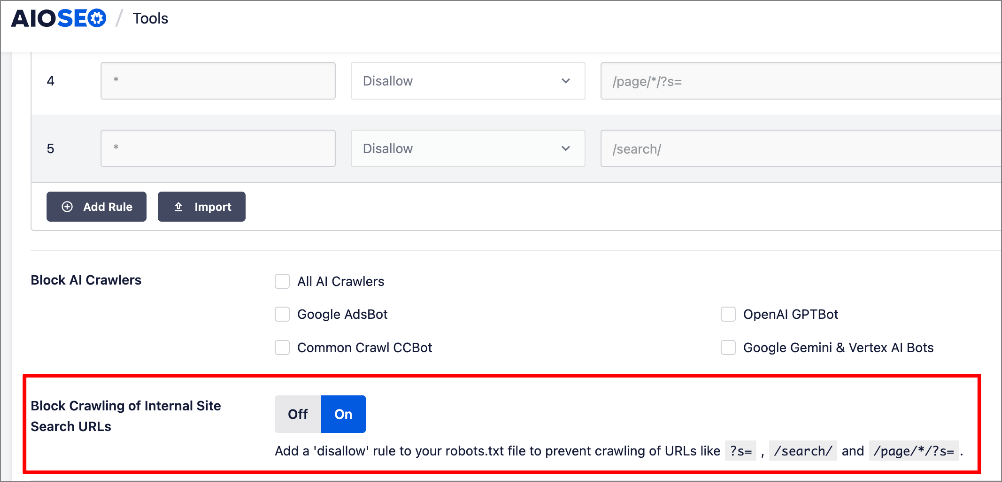

Los sitios web a menudo generan URLs innecesarias a partir de búsquedas internas, lo que provoca un desperdicio de presupuestos de rastreo y spam potencial. De nuevo, esto se puede solucionar fácilmente usando la Limpieza de Rastreo de AIOSEO. Todo lo que tienes que hacer es configurar los filtros usando los interruptores.

AIOSEO te da el poder de controlar cómo los motores de búsqueda y otros bots interactúan con las URLs creadas por las búsquedas internas del sitio. Puedes:

- Establecer un límite máximo de caracteres para las consultas de búsqueda, evitando URL de búsqueda infladas.

- Filtrar automáticamente emojis y caracteres especiales para evitar términos de búsqueda desordenados o sin sentido.

- Bloquear patrones comunes de spam, evitando que las búsquedas basura creen URL indexables innecesarias.

De nuevo, AIOSEO edita tu archivo robots.txt en segundo plano. Alternativamente, también puedes configurar estos ajustes en tu editor robots.txt:

¡Así de simple!

Has editado tu archivo robots.txt.

Edición de Archivos Robots.txt: Tus Preguntas Frecuentes Respondidas

¿Qué es un archivo robots.txt?

Un archivo robots.txt es un archivo de texto que los propietarios de sitios web utilizan para comunicarse con los rastreadores web o robots sobre qué partes de su sitio deben ser rastreadas e indexadas por los motores de búsqueda.

¿Dónde se encuentra el archivo robots.txt?

El archivo robots.txt se encuentra típicamente en el directorio raíz de un sitio web. Su URL suele ser https://www.example.com/robots.txt.

¿Cuál es la mejor manera de editar archivos robots.txt?

La mejor manera de editar tu archivo robots.txt es usar un plugin como All In One SEO (AIOSEO). Es el mejor plugin de SEO para WordPress y tiene un editor avanzado de robots.txt que hace que la optimización de los archivos robots.txt sea súper fácil.

Esperamos que este tutorial te haya mostrado cómo editar fácilmente un archivo robots.txt en WordPress. También puedes consultar otros artículos de nuestro blog, como nuestros consejos sobre cómo indexar en Google o nuestra guía sobre cómo usar Estadísticas de Búsqueda para mejorar tus rankings.

Si encontraste útil este artículo, suscríbete a nuestro Canal de YouTube. Encontrarás muchos más tutoriales útiles allí. También puedes seguirnos en X (Twitter), LinkedIn o Facebook para estar al tanto.

Descargo de responsabilidad: Nuestro contenido es compatible con los lectores. Esto significa que si haces clic en algunos de nuestros enlaces, podemos ganar una comisión. Solo recomendamos productos que creemos que añadirán valor a nuestros lectores.

Hola, gracias por el artículo.

Recientemente leí tu artículo sobre la decadencia del contenido. Uno de nuestros problemas es la velocidad de la página y he estado trabajando en reducir el tiempo de carga. Sin embargo, no soy un profesional de la codificación ni nada remotamente relacionado con cosas técnicas. Normalmente me encargo de marketing y diseño.

Así que con ese contexto, mi pregunta es la siguiente: al subir imágenes y escribir sus leyendas y etiquetas alternativas, quiero que aparezcan en los resultados de búsqueda de imágenes, pero no quiero causar hinchazón del índice.

¿Hay alguna táctica que recomiendes que use para evitar esto? Ya he deshabilitado el sitemap de imágenes (justo hoy), después de leer que no es necesario y que no eliminará mis imágenes actuales del sitio.

Esto también me lleva a hacer una segunda pregunta: ¿cómo sabré (como alguien que no sabe leer html, js ni nada de eso) si deshabilitar el sitemap de imágenes ha sido efectivo para mejorar la velocidad de carga? ¡Gracias por la ayuda!