Vous voulez savoir comment empêcher le trafic des bots de nuire aux performances de votre site ?

Si vous avez remarqué une activité inhabituelle sur votre site Web — comme des pics soudains de trafic provenant d'endroits inconnus, des taux de rebond étrangement élevés ou une expérience utilisateur lente — vous pourriez avoir affaire à du trafic de bots.

Bien que certains bots soient inoffensifs, voire utiles, beaucoup sont malveillants et peuvent faire des ravages sur les performances, l'analyse et la sécurité de votre site.

Le trafic des bots peut fausser vos données analytiques, surcharger vos serveurs et même exposer votre site à des menaces de sécurité telles que des violations de données ou des attaques DDoS. Comprendre comment identifier et arrêter le trafic des mauvais bots est essentiel pour maintenir un site Web sain et efficace.

Dans ce guide, je vais vous expliquer comment empêcher le trafic des bots d'interférer avec les performances de votre site.

Alerte spoiler : Vous pouvez résoudre les problèmes de trafic des bots directement depuis votre tableau de bord WordPress en utilisant les bons outils.

Plongeons et reprenons le contrôle de votre site !

Dans cet article

Qu'est-ce que le trafic des bots ?

Premièrement, qu'est-ce que le trafic des bots exactement ?

Le trafic des bots fait référence aux visiteurs non humains accédant à votre site Web. Les bots sont des applications logicielles qui effectuent des tâches automatisées sur Internet. Ils se présentent sous différentes formes et servent à des fins diverses.

Certains bots sont bénéfiques, aidant votre site Web à être indexé par les moteurs de recherche ou fournissant des fonctionnalités utiles. Cependant, tous les bots ne sont pas bons. Les bots malveillants peuvent causer de graves problèmes, allant du ralentissement de votre site au vol d'informations sensibles.

Comprendre les différents types de bots est crucial pour gérer efficacement le trafic des bots.

Types de trafic des bots

Laissez-moi décomposer les types de trafic des bots en deux catégories : bons bots et mauvais bots.

Bons Bots

Les bons bots jouent un rôle essentiel dans l'écosystème Internet. Voici quelques exemples :

- Robots d'exploration des moteurs de recherche : Les bots des moteurs de recherche comme Googlebot (Google) et Bingbot (Bing) explorent votre site pour indexer votre contenu. Ce processus est essentiel pour que votre site apparaisse dans les résultats de recherche.

- Assistants numériques : Les bots utilisés par les assistants numériques comme Siri, Alexa et Google Assistant récupèrent des informations sur le Web pour répondre aux requêtes des utilisateurs.

- Bots de médias sociaux : Les bots des plateformes sociales comme Facebook et X (Twitter) qui récupèrent les données d'aperçu lorsque votre contenu est partagé.

- Outils de surveillance : Des services tels que les moniteurs de disponibilité et les analyseurs de performances utilisent des robots pour vérifier si votre site est en ligne et fonctionne correctement. Un exemple populaire est Screaming Frog.

Ces robots suivent les protocoles standard, respectent le fichier robots.txt de votre site et n'ont généralement pas d'impact négatif sur votre site Web.

Mauvais Bots

Malheureusement, tous les robots ne sont pas amicaux. Les mauvais robots peuvent nuire à votre site de diverses manières. Voici quelques types courants :

- Robots spammeurs : Ces robots publient des commentaires de spam ou des soumissions de formulaires, encombrant votre site de contenu indésirable.

- Robots d'écrémage : Ils volent votre contenu ou vos données, que les concurrents peuvent utiliser à des fins malveillantes.

- Robots d'attaque par force brute : Robots qui tentent de se connecter à des comptes utilisateurs en utilisant des combinaisons de noms d'utilisateur et de mots de passe volés.

- Robots d'attaque DDoS : Les robots d'attaque par déni de service distribué inondent votre serveur de requêtes, provoquant un ralentissement ou un crash de votre site.

- Robots de fraude au clic : Ils génèrent de faux clics sur les publicités, épuisant votre budget publicitaire et faussant les données de votre campagne.

- Robots de stockage d'inventaire : Robots qui ajoutent des produits aux paniers ou réservent des billets sans finaliser les achats, affectant la gestion de votre inventaire.

Ces robots ignorent souvent les protocoles standard et peuvent être difficiles à détecter et à bloquer.

Pourquoi il est important d'arrêter le trafic indésirable des robots

Vous vous dites peut-être : « Le trafic des robots est-il vraiment si important ? »

S'il s'agit de mauvais robots, absolument. Voici pourquoi :

Protéger les performances du site Web

Les mauvais robots peuvent consommer des ressources serveur importantes, entraînant des temps de chargement plus lents, voire des interruptions. Cela affecte l'expérience utilisateur et peut nuire à vos classements SEO.

Protéger les performances du site Web permet également d'économiser de l'énergie, ce qui réduit l'empreinte carbone.

Assurer l'exactitude des analyses

Le trafic des robots peut fausser vos données analytiques. Lorsque vous vous fiez à ces données pour prendre des décisions concernant le contenu, les stratégies marketing ou les améliorations de l'expérience utilisateur, des données inexactes conduisent à de mauvais choix.

Garantir la confiance des utilisateurs et la réputation de l'entreprise

Les violations de sécurité érodent la confiance des utilisateurs. Si les clients estiment que leurs données ne sont pas en sécurité avec vous, ils iront ailleurs. De plus, une réputation de sécurité médiocre peut être difficile à changer.

Comment arrêter le trafic indésirable des robots sur votre site [Édition WordPress]

Passons maintenant aux étapes pratiques pour arrêter le trafic des robots sur votre site WordPress. Si les informations ci-dessus vous semblent écrasantes et trop techniques, ne vous inquiétez pas. La solution que je vais vous montrer aujourd'hui est très facile à utiliser. Et il ne faut que quelques minutes et quelques clics pour la mettre en œuvre.

De plus, vous n'avez même pas besoin de connaissances en codage ou techniques.

Cela semble trop beau pour être vrai ?

C'est exactement ce que j'ai pensé avant d'utiliser cette méthode.

Dans cette section, je vais vous montrer comment utiliser le plugin All in One SEO (AIOSEO) pour gérer efficacement le trafic des robots.

Étape 1 : Installer All In One SEO (AIOSEO)

La première étape pour arrêter le trafic des robots sur votre site (la manière facile) est d'installer All In One SEO (AIOSEO).

AIOSEO est le meilleur plugin SEO pour WordPress du marché. Plus de 3 millions de propriétaires de sites web et de spécialistes du marketing avisés lui font confiance pour les aider à dominer les SERP (pages de résultats des moteurs de recherche) et à générer du trafic pertinent sur leur site.

Le plugin dispose de nombreuses fonctionnalités et modules SEO puissants pour vous aider à optimiser votre site pour les moteurs de recherche et les utilisateurs, même sans connaissances en codage ou techniques. Concernant le blocage des robots ou des crawlers indésirables, AIOSEO dispose d'une fonctionnalité avancée appelée Nettoyage des Crawls. Mais nous y reviendrons plus tard.

Besoin d'instructions étape par étape sur comment installer AIOSEO ?

Consultez alors notre guide d'installation détaillé.

Étape 2 : Ouvrir le nettoyage des robots d'exploration

Une fois AIOSEO installé et activé, il est temps d'accéder à la puissante fonctionnalité Nettoyage des Crawls. Pour ce faire, dans votre tableau de bord WordPress, allez dans Paramètres AIOSEO » Apparence de la recherche » Avancé.

Ensuite, faites défiler jusqu'au bouton Nettoyage des Crawls et assurez-vous qu'il est réglé sur « Activé ».

Le Nettoyage des Crawls dispose de nombreux paramètres pour vous aider à optimiser la crawlabilité et les performances de votre site. Les exemples incluent des paramètres pour :

- Flux RSS

- Robots indésirables

- Nettoyage de la recherche interne du site

La fonctionnalité Nettoyage des Crawls vous aide à contrôler l'accès des robots, à réduire la charge du serveur et à améliorer les performances du site.

Dans notre cas, cependant, nous voulons l'option Robots indésirables.

Étape 3 : Sélectionner les robots d'exploration Web que vous souhaitez bloquer

Une fois que vous avez cliqué sur l'onglet Robots indésirables, plusieurs options vous seront présentées. Maintenant, laissez-moi vous montrer comment configurer les robots à bloquer, et c'est étonnamment facile !

Tout ce que vous avez à faire est de sélectionner les robots que vous souhaitez bloquer.

Selon ce que vous voulez accomplir, vous pouvez :

- Bloquer tous les robots indésirables, vous donnant plus de contrôle sur votre budget de crawl.

- Cibler principalement les crawlers IA, les empêchant d'indexer votre contenu sans permission.

En conséquence, vous pouvez protéger votre site contre le scraping de contenu. Vous économisez également des ressources serveur, ce qui contribue également à sauver la planète car moins d'énergie est utilisée.

Ces modifications modifieront votre fichier robots.txt, en ajoutant des directives disallow pour les robots choisis. Pour éviter les erreurs, AIOSEO affiche une alerte jaune chaque fois que vous ajoutez un robot à bloquer. De cette façon, vous pouvez examiner et suivre les mises à jour.

Étape 4 : Modifier robots.txt (Facultatif)

Vous voulez un contrôle plus avancé sur le trafic des robots ?

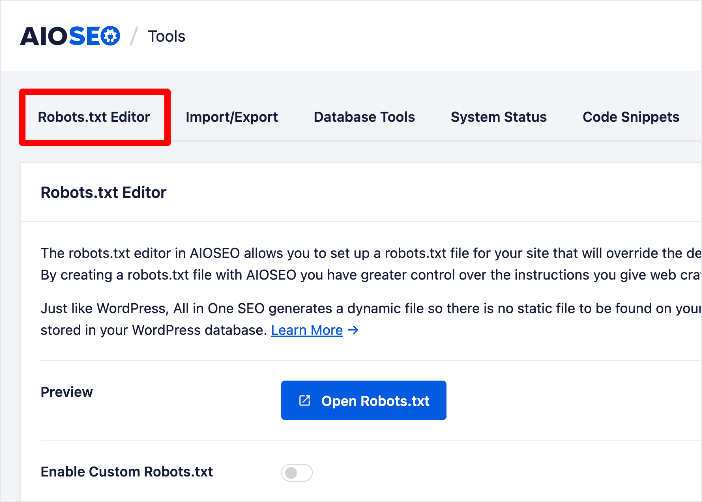

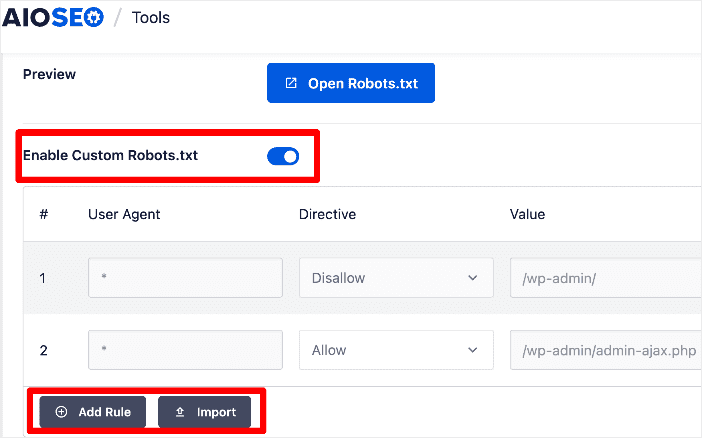

Une autre option consiste à définir des directives de crawl dans le fichier robots.txt de votre site directement dans AIOSEO. Pour accéder à l'éditeur robots.txt, allez dans le menu All in One SEO » Outils » Éditeur Robots.txt.

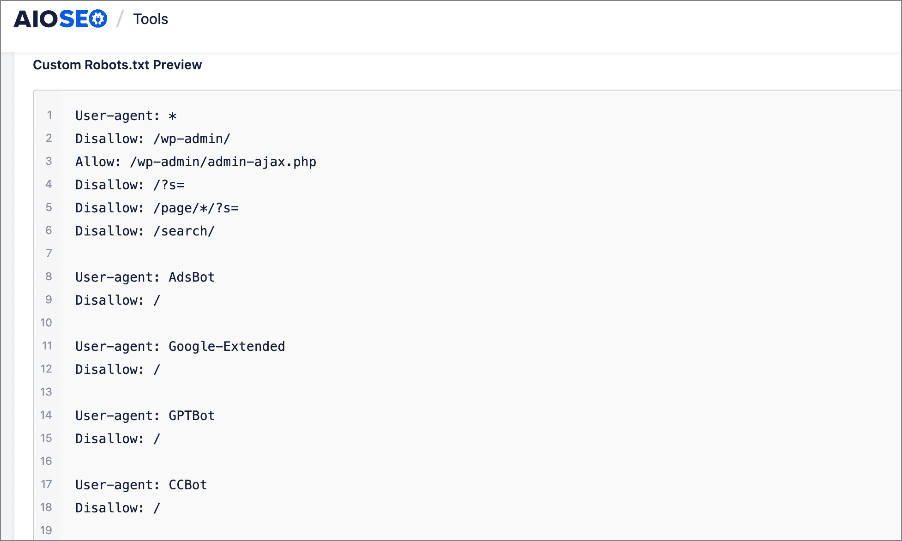

Le fichier robots.txt indique aux robots quelles parties de votre site ils peuvent ou ne peuvent pas accéder. Vous pouvez ajouter des directives pour interdire aux robots d'accéder à des répertoires ou fichiers spécifiques.

Vous pouvez même importer des directives d'un autre site, ce qui facilite grandement l'application de directives d'un de vos autres sites ou d'un site que vous aimez. Voici un exemple ci-dessous :

Remarque :

- robots.txt est public : N'importe qui peut consulter votre fichier robots.txt. N'y incluez pas d'informations sensibles.

- Tous les bots n'obéissent pas à robots.txt : Les bots malveillants ignorent souvent ces directives. Pour eux, vous aurez besoin de mesures supplémentaires comme des plugins de sécurité ou des blocages au niveau du serveur.

C'est tout !

Vous savez maintenant comment empêcher le trafic des bots de nuire aux performances de votre site.

Comment arrêter le trafic des bots sur votre site : Vos FAQ répondues

Qu'est-ce que le trafic des bots ?

Les bots sont des applications logicielles automatisées qui peuvent être soit bénéfiques, comme aider à l'indexation par les moteurs de recherche, soit malveillantes, causant des problèmes tels que le ralentissement du site ou le vol d'informations sensibles.

Les bots peuvent-ils ignorer robots.txt ?

Oui, malheureusement, de nombreux bots malveillants ignorent les directives de robots.txt. C'est pourquoi il est important d'utiliser des défenses supplémentaires comme des plugins de sécurité et des WAF (pare-feu d'applications Web).

Le blocage des bots affectera-t-il mon référencement ?

Bloquer les bons bots, comme le robot d'exploration de Google, peut nuire à votre SEO en empêchant votre site d'être indexé. Vérifiez toujours quels bots vous bloquez pour vous assurer que vous n'arrêtez que les bots malveillants.

Existe-t-il un moyen de bloquer les bots sans plugin ?

Oui, vous pouvez bloquer les bots en modifiant votre fichier .htaccess ou en configurant le pare-feu de votre serveur. Cependant, ces méthodes nécessitent des connaissances techniques et peuvent être risquées. Des erreurs de configuration peuvent rendre votre site inaccessible.

Nous espérons que cet article vous a aidé à apprendre comment arrêter le trafic indésirable des bots qui affecte les performances de votre site. Vous voudrez peut-être également consulter d'autres articles de notre blog, comme notre guide sur les fichiers robots.txt ou notre tutoriel sur le suivi de vos classements de mots-clés dans WordPress.

Si vous avez trouvé cet article utile, alors abonnez-vous à notre chaîne YouTube. Vous y trouverez de nombreux autres tutoriels utiles. Vous pouvez également nous suivre sur X (Twitter), LinkedIn ou Facebook pour rester informé.

Divulgation : Notre contenu est financé par nos lecteurs. Cela signifie que si vous cliquez sur certains de nos liens, nous pouvons gagner une commission. Nous ne recommandons que les produits qui, selon nous, apporteront de la valeur à nos lecteurs.