Qu'est-ce que robots.txt dans WordPress ?

Chaque fois que vous effectuez une vérification rapide des astuces pour améliorer votre classement dans les moteurs de recherche, il y a de fortes chances que le fichier robots.txt apparaisse. C'est parce qu'il s'agit d'une partie importante de votre site et qu'il doit être pris en compte si vous souhaitez améliorer votre classement sur les pages de résultats des moteurs de recherche (SERP).

Dans cet article, nous répondrons à la question : « Qu'est-ce que robots.txt dans WordPress ? ». Nous vous montrerons également comment générer un fichier robots.txt pour votre site.

Dans cet article

Qu'est-ce que Robots.txt ?

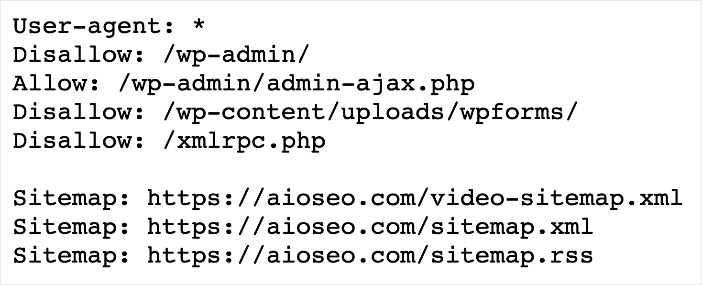

Robots.txt est un fichier texte que les propriétaires de sites Web peuvent créer pour indiquer aux robots des moteurs de recherche comment interagir avec leurs sites, principalement quelles pages explorer et lesquelles ignorer. C'est un fichier texte brut stocké dans le répertoire racine de votre site Web (également appelé dossier principal). Dans notre cas, l'URL de notre robots.txt est :

https://aioseo.com/robots.txtEt voici à quoi il ressemble :

Cela ne doit pas être confondu avec les balises meta robots, qui sont des balises HTML intégrées dans l'en-tête d'une page Web. La balise ne s'applique qu'à la page sur laquelle elle se trouve.

Que signifie tout cela ?

Pour mieux comprendre cela, revenons un peu en arrière et définissons ce qu'est un robot. Dans ce contexte, les robots sont tout « bot » ou robot d'exploration Web qui visite des sites Web sur Internet. Ceux-ci sont appelés agents utilisateurs dans le fichier robots.txt. Les plus courants sont les robots d'exploration des moteurs de recherche, également appelés robots d'exploration ou spiders de moteurs de recherche, parmi de nombreux autres noms. Ces robots explorent le Web pour aider les moteurs de recherche à découvrir votre contenu et ainsi l'indexer plus rapidement afin qu'ils puissent le proposer aux utilisateurs en réponse à des termes de recherche pertinents.

En général, les robots d'exploration sont bons pour Internet et pour votre site. Cependant, aussi utiles soient-ils, il existe des cas où vous voudrez peut-être contrôler la façon dont ils interagissent avec votre site.

C'est là qu'intervient le fichier robots.txt.

Que fait un fichier Robots.txt ?

Comme nous l'avons déjà vu, un fichier robots.txt sert d'ensemble d'instructions pour guider les robots des moteurs de recherche et autres robots d'exploration Web sur la manière d'interagir avec le contenu de votre site Web. Il agit comme un gardien numérique qui influence la façon dont les moteurs de recherche perçoivent et interagissent avec votre site Web.

Voici quelques utilisations possibles d'un fichier robots.txt :

Contrôler l'exploration

Les robots des moteurs de recherche explorent les sites Web pour découvrir et indexer du contenu. Un fichier robots.txt informe ces robots quelles parties de votre site Web sont ouvertes à l'exploration et lesquelles sont interdites. Vous pouvez contrôler quelles pages ils peuvent accéder en spécifiant des règles pour différents agents utilisateurs (robots).

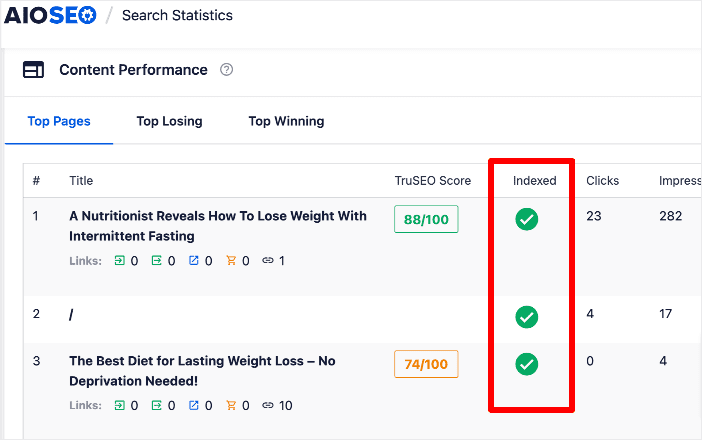

Diriger l'indexation

Alors que l'exploration implique la découverte de contenu, l'indexation implique l'ajout du contenu découvert à la base de données du moteur de recherche. En utilisant un fichier robots.txt, vous pouvez guider les robots sur le contenu à indexer et celui à exclure. Cela vous permet de prioriser l'indexation des pages importantes tout en empêchant le contenu non pertinent d'encombrer les résultats de recherche.

Vous pouvez facilement utiliser AIOSEO pour vérifier le statut d'indexation de vos articles et pages.

Cela vous aidera à garder facilement un œil sur le statut d'indexation de vos pages.

Prévenir les problèmes de contenu dupliqué

Le contenu dupliqué peut confondre les moteurs de recherche et nuire au référencement de votre site. Avec robots.txt, vous pouvez empêcher les robots d'explorer et d'indexer le contenu dupliqué, en vous assurant que seule la version la plus pertinente de votre contenu est prise en compte pour les résultats de recherche.

Protéger les informations sensibles

Certaines zones de votre site Web peuvent contenir des données sensibles que vous ne souhaitez pas exposer au public ou faire indexer par les moteurs de recherche. Un fichier robots.txt bien structuré peut empêcher les robots d'accéder et d'indexer ces zones, améliorant ainsi la confidentialité et la sécurité de votre site Web.

Optimise le budget d'exploration

Les moteurs de recherche allouent un budget d'exploration à chaque site Web, déterminant la fréquence et la profondeur auxquelles les robots explorent votre site. En utilisant robots.txt, vous pouvez guider les robots vers vos pages les plus précieuses et pertinentes, garantissant une utilisation efficace de votre budget d'exploration.

Améliore les performances du site

Permettre aux robots d'explorer votre site sans restriction peut consommer des ressources serveur et impacter les performances du site. En contrôlant l'exploration avec robots.txt, vous pouvez réduire la charge de votre serveur, ce qui entraîne des temps de chargement plus rapides et une meilleure expérience utilisateur.

Comment générer un fichier Robots.txt dans WordPress

Générer un fichier robots.txt dans WordPress est très facile. C'est particulièrement vrai si vous avez un puissant plugin SEO pour WordPress comme All In One SEO (AIOSEO).

AIOSEO est le meilleur plugin SEO pour WordPress du marché, avec plus de 3 millions d'installations actives. Des millions de propriétaires de sites Web et de spécialistes du marketing avisés font confiance au plugin pour les aider à dominer les SERP et à générer du trafic pertinent vers leur site. C'est parce que le plugin possède de nombreuses fonctionnalités et modules SEO puissants pour vous aider à optimiser votre site Web pour les moteurs de recherche et les utilisateurs. Voici quelques exemples des fonctionnalités que vous trouverez dans AIOSEO :

Ce sont des fonctionnalités telles que :

- Statistiques de recherche : Cette puissante intégration Google Search Console vous permet de suivre vos classements de mots-clés et de voir les métriques SEO importantes en 1 clic, et plus encore.

- Générateur de schéma de nouvelle génération : Il s'agit d'un générateur de schéma sans code qui permet aux utilisateurs de générer et de publier tout type de balisage de schéma sur votre site.

- Gestionnaire de Redirections : Aide à gérer les redirections et à éliminer les erreurs 404, ce qui facilite l'exploration et l'indexation de votre site par les moteurs de recherche.

- Assistant de liens : Un puissant outil de liens internes qui automatise la création de liens entre les pages de votre site. Il vous donne également un audit des liens sortants.

- IndexNow : Pour un indexage rapide sur les moteurs de recherche qui prennent en charge le protocole IndexNow (comme Bing et Yandex).

- Générateur de sitemap : Générez automatiquement différents types de sitemaps pour informer tous les moteurs de recherche de toute mise à jour sur votre site.

- Et plus encore.

Pour des instructions étape par étape sur la façon d'installer AIOSEO, consultez notre guide d'installation.

L'une des fonctionnalités originales et les plus appréciées d'AIOSEO est l'éditeur Robots.txt. Ce module puissant permet de générer et de modifier facilement les fichiers robots.txt, même sans connaissances en codage ou techniques.

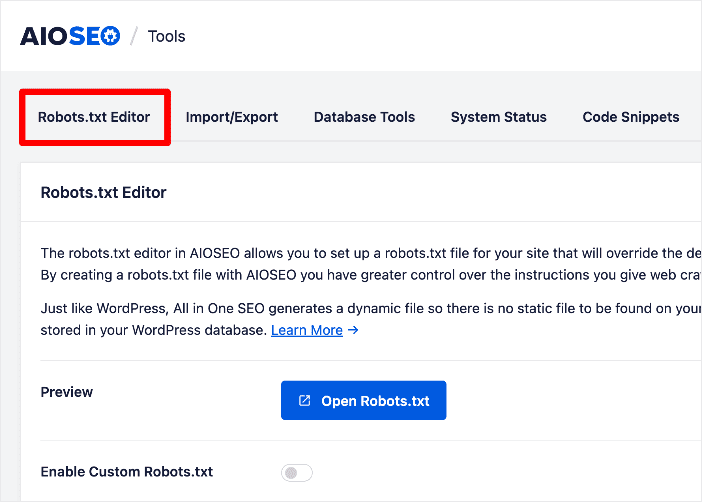

Vous pouvez trouver l'éditeur robots.txt en cliquant sur Outils dans votre menu AIOSEO.

L'une des premières choses que vous remarquerez est un bouton bleu Ouvrir Robots.txt. C'est parce que WordPress génère automatiquement un fichier robots.txt pour vous. Mais comme il n'est pas optimisé, vous voudrez le modifier. Voici les étapes à suivre pour y parvenir :

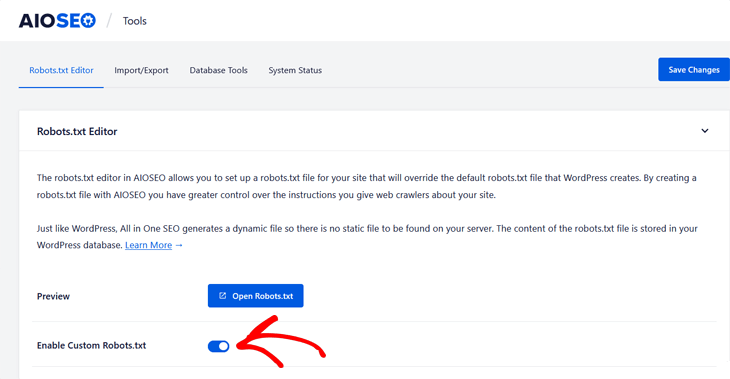

Étape 1 : Activer le fichier robots.txt personnalisé

Vous pouvez le faire en cliquant sur le bouton Activer le robots.txt personnalisé. Cela ouvrira une fenêtre vous permettant de modifier votre fichier robots.txt.

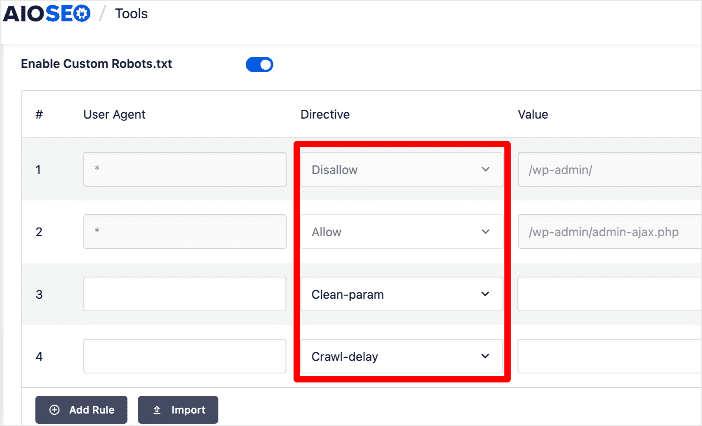

Étape 2 Personnaliser vos directives

Ce sont les instructions que vous souhaitez que les robots d'exploration suivent. Les exemples incluent Allow, Disallow, Clean-param et Crawl delay.

Dans cette section, vous pouvez également déterminer quels agents utilisateurs (robots d'exploration de recherche) doivent suivre la directive. Vous devrez également spécifier la valeur (URL, paramètres d'URL ou fréquence) de la directive.

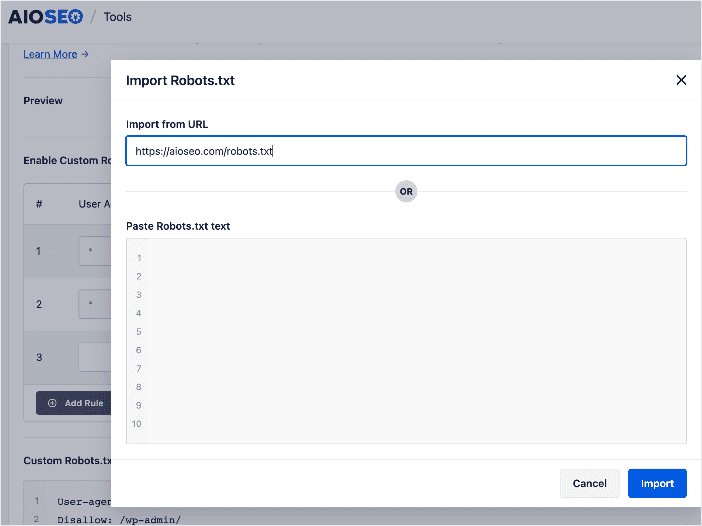

S'il existe un site avec un fichier robots.txt que vous souhaitez imiter, vous pouvez utiliser le bouton Importer pour le copier à l'aide d'une URL ou de la fonction copier-coller.

3. Importer un fichier Robots.txt (facultatif)

Alternativement, vous pouvez choisir d'importer un fichier robots.txt à partir d'un autre site. Pour ce faire, cliquez sur le bouton Importer. Cela ouvrira une fenêtre où vous pourrez importer votre fichier à l'aide d'une URL ou copier-coller le fichier souhaité.

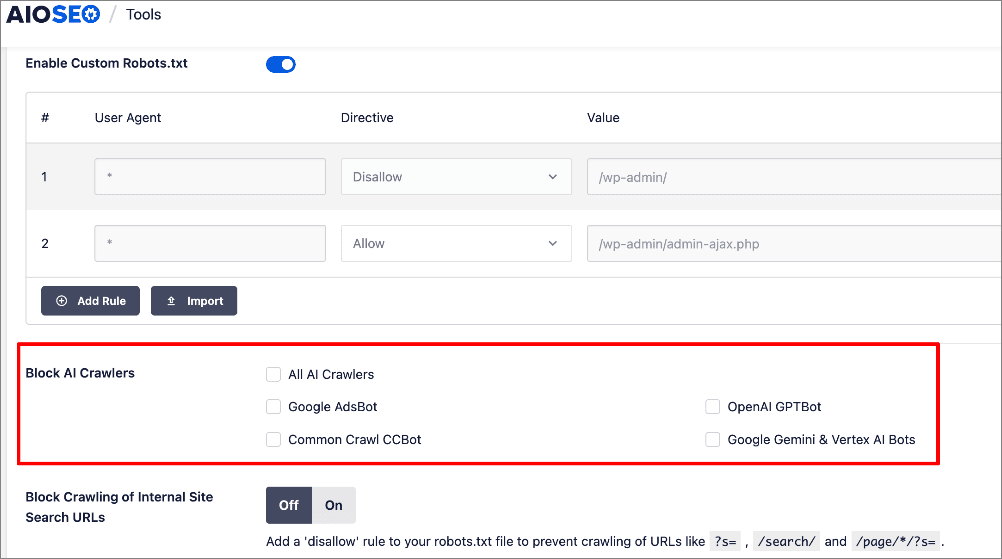

4. Bloquer les robots indésirables

Une autre fonctionnalité très intéressante de l'éditeur de fichier robots.txt d'AIOSEO est la section Bloquer les robots d'IA. Cela vous permet de bloquer les robots non autorisés d'explorer votre site. Ceux-ci peuvent entraîner des problèmes de performance, de sécurité et de référencement.

Pour en savoir plus, consultez notre tutoriel sur le blocage du trafic indésirable des robots sur votre site.

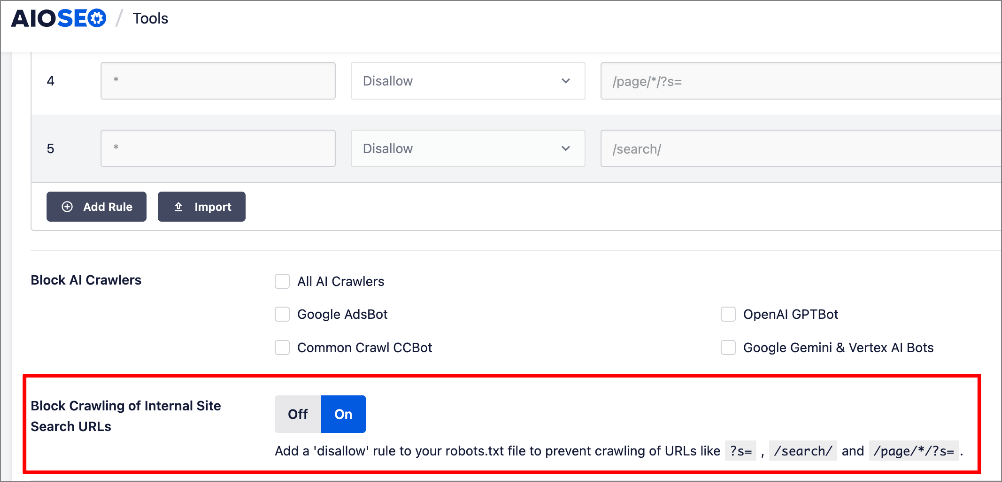

5. Empêcher l'exploration des URL de recherche interne du site

Les sites Web génèrent souvent un excès d'URL à partir de recherches internes lorsque les visiteurs recherchent du contenu ou des produits. Ces URL générées par la recherche contiennent des paramètres que les moteurs de recherche perçoivent comme uniques, ce qui les amène à explorer des pages inutiles. Cela gaspille votre budget d'exploration et peut empêcher vos pages les plus importantes d'être indexées.

Vous pouvez facilement éviter cela dans l'éditeur de fichier robots.txt d'AIOSEO.

AIOSEO ajoute une règle « disallow » dans votre fichier robots.txt sans que vous ayez à le faire pour chaque paramètre généré par la recherche.

Personnaliser votre fichier robots.txt est aussi simple que cela.

Pour des instructions étape par étape sur la modification de votre fichier robots.txt, consultez ce tutoriel.

Qu'est-ce que Robots.txt ? Vos FAQ répondues

Qu'est-ce que robots.txt ?

Un fichier robots.txt est un fichier texte brut placé dans le répertoire racine d'un site Web pour fournir des instructions aux robots des moteurs de recherche et autres robots d'exploration Web sur les parties du site qui doivent être explorées ou exclues de l'exploration. Il agit comme un ensemble de directives que ces robots doivent suivre lorsqu'ils interagissent avec le contenu du site Web.

Comment créer un fichier robots.txt ?

Vous pouvez facilement créer un fichier robots.txt à l'aide d'un plugin comme AIOSEO. Alternativement, vous pouvez choisir la voie la plus longue et créer un fichier texte brut nommé robots.txt et le téléverser dans le répertoire racine de votre site.

Puis-je utiliser robots.txt pour améliorer mon SEO ?

Oui, l'optimisation de votre fichier robots.txt peut contribuer à un meilleur SEO. En guidant les robots des moteurs de recherche pour explorer et indexer votre contenu le plus précieux tout en excluant le contenu dupliqué ou non pertinent, vous pouvez améliorer la visibilité et le classement de votre site Web dans les résultats de recherche.

Qu'est-ce que Robots.txt ? Maintenant que vous le savez, optimisez le vôtre

W

Comme vous pouvez le constater, un fichier robots.txt est une partie cruciale de tout site Web. L'optimisation du vôtre garantit que vos pages les plus importantes sont explorées et indexées, ce qui entraîne de meilleurs classements de recherche.

Alors, allez-y et utilisez l'éditeur robots.txt d'AIOSEO pour optimiser le vôtre.

Nous espérons que cet article vous a aidé à comprendre ce qu'est robots.txt dans WordPress et pourquoi il est important de l'optimiser. Vous voudrez peut-être également consulter d'autres articles de notre blog, comme notre guide sur l'indexation sur Google ou nos conseils sur l'utilisation des statistiques de recherche pour améliorer vos classements.

Si vous avez trouvé cet article utile, veuillez vous abonner à notre chaîne YouTube. Vous y trouverez de nombreux autres tutoriels utiles. Vous pouvez également nous suivre sur Twitter, LinkedIn ou Facebook pour rester informé.

Divulgation : Notre contenu est financé par nos lecteurs. Cela signifie que si vous cliquez sur certains de nos liens, nous pouvons gagner une commission. Nous ne recommandons que les produits qui, selon nous, apporteront de la valeur à nos lecteurs.