Robots.txt è un file di testo posizionato nella directory principale di un sito web che istruisce i robot web (come i crawler dei motori di ricerca) quali pagine o sezioni del sito web possono accedere e indicizzare. Questo file funge da insieme di istruzioni per questi bot automatizzati.

Esempi di come viene utilizzato robots.txt:

- Disabilitare directory specifiche: User-agent: * Disallow: /private/ Questo indica a tutti i robot di non accedere alla directory "/private/" e ai suoi contenuti.

- Consentire robot specifici disabilitandone altri: User-agent: Googlebot Allow: / User-agent: * Disallow: / Questo consente al crawler di Google di accedere a tutte le pagine, disabilitando tutti gli altri robot.

- Specificare la posizione della sitemap: Sitemap: https://example.com/sitemap.xml Questo indirizza i robot alla posizione della sitemap del sito web, aiutandoli a scansionare il sito in modo efficiente.

- Disabilitare l'accesso a tipi di file specifici: User-agent: * Disallow: /*.pdf$ Questo impedisce ai robot di accedere a qualsiasi file PDF sul sito web.

Ricorda che robots.txt è un file pubblicamente accessibile e non dovrebbe essere utilizzato per nascondere informazioni sensibili, poiché può essere facilmente visualizzato da chiunque.

Robots.txt in WordPress

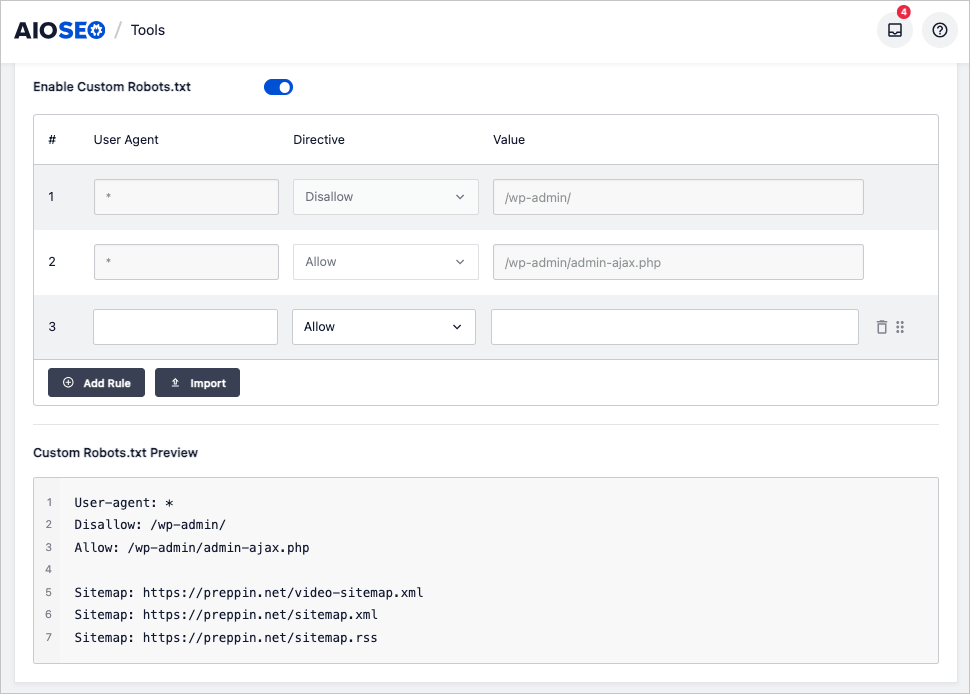

All in One SEO fornisce un editor robots.txt intuitivo. Non c'è bisogno di gestire il codice. Gli utenti possono modificare il loro file robots.txt compilando campi del modulo.

Correlati: