Cos'è robots.txt in WordPress?

Ogni volta che fai un controllo casuale per suggerimenti su come migliorare il tuo posizionamento sui motori di ricerca, è probabile che il file robots.txt salti fuori. Questo perché è una parte importante del tuo sito e dovrebbe essere preso in considerazione se vuoi migliorare il tuo posizionamento nelle pagine dei risultati dei motori di ricerca (SERP).

In questo articolo, risponderemo alla domanda: "Cos'è robots.txt in WordPress?". Ti mostreremo anche come generare un file robots.txt per il tuo sito.

In questo articolo

Cos'è Robots.txt?

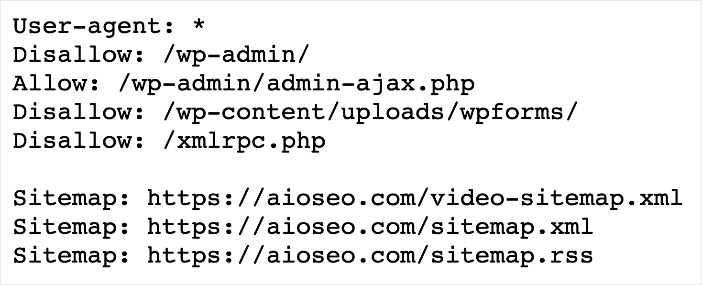

Robots.txt è un file di testo che i proprietari di siti web possono creare per indicare ai bot dei motori di ricerca come interagire con i loro siti, principalmente quali pagine scansionare e quali ignorare. È un file di testo semplice memorizzato nella directory principale del tuo sito web (nota anche come cartella principale). Nel nostro caso, l'URL del nostro robots.txt è:

https://aioseo.com/robots.txtEd ecco come appare:

Questo non va confuso con i tag meta robots, che sono tag HTML incorporati nell'intestazione di una pagina web. Il tag si applica solo alla pagina su cui si trova.

Cosa significa tutto questo?

Per capire meglio, facciamo un passo indietro e definiamo cos'è un robot. In questo contesto, i robot sono qualsiasi "bot" o web crawler che visita siti web su Internet. Questi sono chiamati user agent nel file robots.txt. I più comuni sono i crawler dei motori di ricerca, chiamati anche bot di ricerca o spider dei motori di ricerca, tra molti altri nomi. Questi bot scansionano il web per aiutare i motori di ricerca a scoprire i tuoi contenuti e quindi indicizzarli più velocemente in modo che possano servirli agli utenti in risposta a termini di ricerca pertinenti.

In generale, i bot di ricerca fanno bene a Internet e al tuo sito. Tuttavia, per quanto utili siano, ci sono casi in cui potresti voler controllare come interagiscono con il tuo sito.

È qui che entra in gioco il file robots.txt.

Cosa fa un file Robots.txt?

Come già visto, un file robots.txt funge da insieme di istruzioni per guidare i bot dei motori di ricerca e altri web crawler su come interagire con i contenuti del tuo sito web. Agisce come un guardiano digitale che influenza il modo in cui i motori di ricerca percepiscono e interagiscono con il tuo sito web.

Ecco alcune cose per cui puoi usare un file robots.txt:

Controlla il Crawling

I bot dei motori di ricerca scansionano i siti web per scoprire e indicizzare i contenuti. Un file robots.txt informa questi bot quali parti del tuo sito web sono aperte al crawling e quali sono off-limits. Puoi controllare a quali pagine possono accedere specificando regole per diversi user agent (bot).

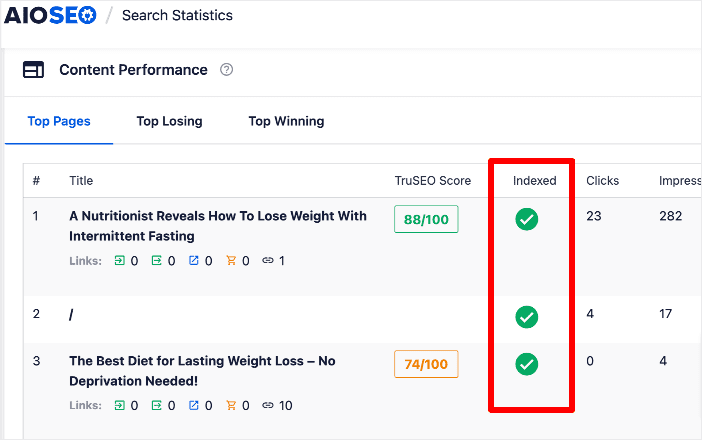

Indirizza l'Indicizzazione

Mentre il crawling implica la scoperta di contenuti, l'indicizzazione implica l'aggiunta dei contenuti scoperti al database del motore di ricerca. Utilizzando un file robots.txt, puoi guidare i bot su quali contenuti indicizzare e quali escludere. Ciò ti consente di dare priorità all'indicizzazione delle pagine importanti, impedendo al contempo che contenuti irrilevanti affollino i risultati di ricerca.

Puoi facilmente usare AIOSEO per controllare lo stato di indicizzazione dei tuoi post e delle tue pagine.

Questo ti aiuterà a tenere facilmente sotto controllo lo stato di indicizzazione delle tue pagine.

Previene problemi di contenuto duplicato

Contenuti duplicati possono confondere i motori di ricerca e influire negativamente sulla SEO del tuo sito. Con robots.txt, puoi impedire ai bot di eseguire la scansione e l'indicizzazione di contenuti duplicati, assicurando che solo la versione più pertinente dei tuoi contenuti venga considerata per i risultati di ricerca.

Protegge informazioni sensibili

Alcune aree del tuo sito web potrebbero contenere dati sensibili che non vuoi esporre al pubblico o che vengano indicizzati dai motori di ricerca. Un file robots.txt ben strutturato può impedire ai bot di accedere e indicizzare queste aree, migliorando la privacy e la sicurezza del tuo sito web.

Ottimizza il Budget di Scansione

I motori di ricerca allocano un budget di scansione a ciascun sito web, determinando la frequenza e la profondità con cui i bot scansionano il tuo sito. Utilizzando robots.txt, puoi guidare i bot verso le tue pagine più preziose e pertinenti, garantendo un uso efficiente del tuo budget di scansione.

Migliora le Prestazioni del Sito

Consentire ai bot di scansionare il tuo sito senza restrizioni può consumare risorse del server e influire sulle prestazioni del sito. Controllando la scansione con robots.txt, puoi ridurre il carico sul tuo server, portando a tempi di caricamento più rapidi e a migliori esperienze utente.

Come Generare un File Robots.txt in WordPress

Generare un file robots.txt in WordPress è facilissimo. Ciò è particolarmente vero se hai un potente plugin SEO per WordPress come All In One SEO (AIOSEO).

AIOSEO è il miglior plugin SEO per WordPress sul mercato, con oltre 3 milioni di installazioni attive. Milioni di proprietari di siti web e marketer esperti si affidano al plugin per aiutarli a dominare le SERP e generare traffico pertinente al sito. Questo perché il plugin ha molte potenti funzionalità e moduli SEO per aiutarti a ottimizzare il tuo sito web per i motori di ricerca e gli utenti. Esempi delle funzionalità che troverai in AIOSEO includono:

Queste sono funzionalità come:

- Statistiche di ricerca: Questa potente integrazione con Google Search Console ti consente di monitorare il tuo posizionamento per parole chiave e vedere metriche SEO importanti con 1 clic, e altro ancora.

- Generatore Schema di nuova generazione: Questo è un generatore di schema no-code che consente agli utenti di generare e produrre qualsiasi tipo di markup schema sul tuo sito.

- Gestore Reindirizzamenti: Ti aiuta a gestire i reindirizzamenti ed eliminare gli errori 404, rendendo più facile per i motori di ricerca scansionare e indicizzare il tuo sito.

- Link Assistant: Potente strumento di collegamento interno che automatizza la creazione di collegamenti tra le pagine del tuo sito. Ti fornisce anche un audit dei link in uscita.

- IndexNow: Per un'indicizzazione rapida sui motori di ricerca che supportano il protocollo IndexNow (come Bing e Yandex).

- Generatore di Sitemap: Genera automaticamente diversi tipi di sitemap per notificare a tutti i motori di ricerca eventuali aggiornamenti sul tuo sito.

- E altro ancora.

Per istruzioni passo passo su come installare AIOSEO, consulta la nostra guida all'installazione.

Una delle funzionalità originali e più apprezzate in AIOSEO è l'Editor Robots.txt. Questo potente modulo rende facile generare e modificare i file robots.txt, anche senza conoscenze di codifica o tecniche.

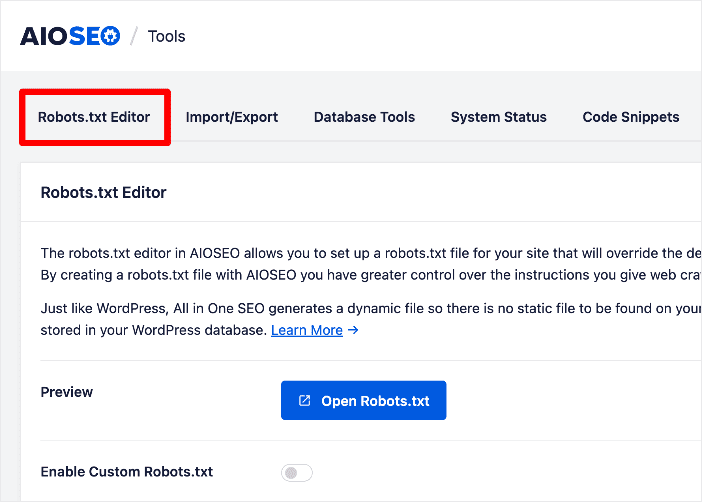

Puoi trovare l'editor robots.txt facendo clic su Strumenti nel menu AIOSEO.

Una delle prime cose che noterai è un pulsante blu Apri Robots.txt. Questo perché WordPress genera automaticamente un file robots.txt per te. Ma poiché non è ottimizzato, vorrai modificarlo. Ecco i passaggi che devi seguire per farlo:

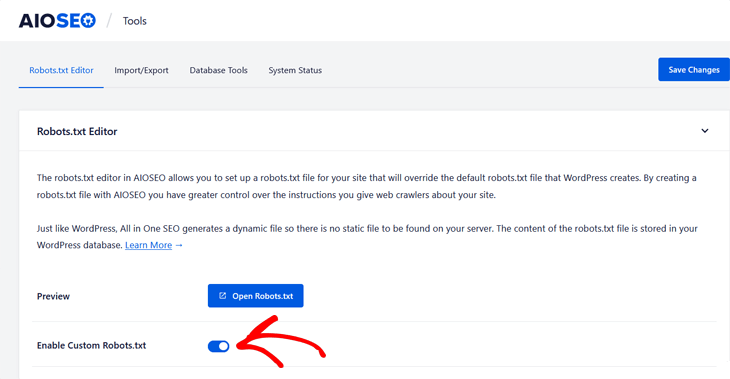

Passaggio 1: Abilita robots.txt personalizzato

Puoi farlo facendo clic sul pulsante Abilita Robots.txt personalizzato. Questo aprirà una finestra che ti consentirà di modificare il tuo file robots.txt.

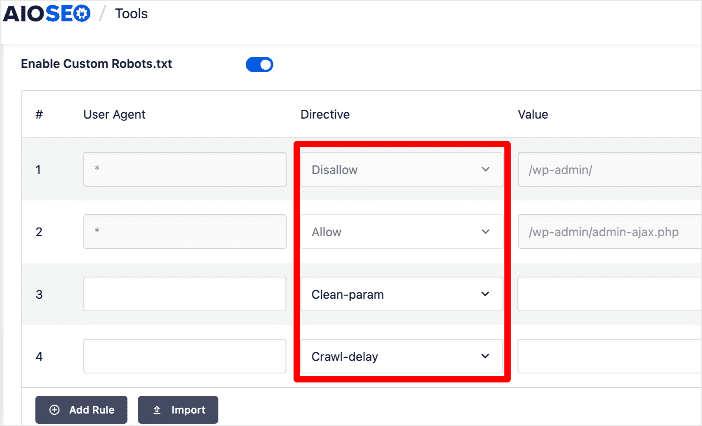

Passaggio 2 Personalizza le tue direttive

Queste sono le istruzioni che vuoi che i bot di ricerca seguano. Gli esempi includono Allow, Disallow, Clean-param e Crawl delay.

In questa sezione, puoi anche determinare quali user agent (crawler di ricerca) devono seguire la direttiva. Dovrai anche specificare il valore (URL, parametri URL o frequenza) della direttiva.

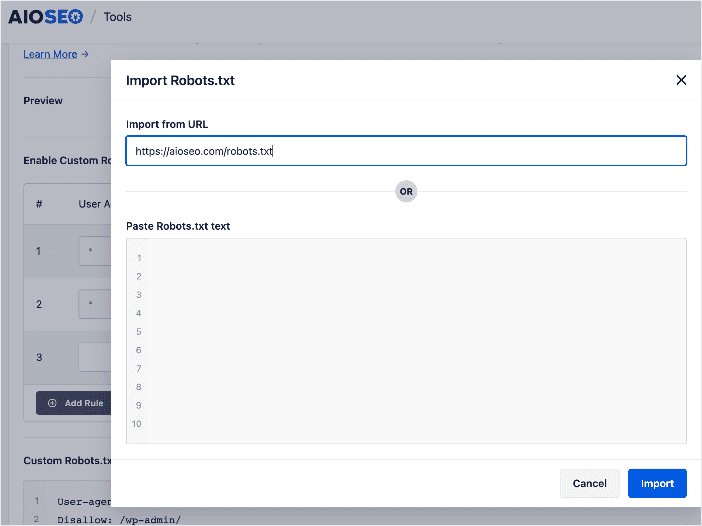

Se c'è un sito con un file robots.txt che vuoi emulare, puoi usare il pulsante Importa per copiarlo utilizzando un URL o la funzione copia-incolla.

3. Importa un file Robots.txt (Opzionale)

In alternativa, puoi scegliere di importare un file robots.txt da un altro sito. Per farlo, fai clic sul pulsante Importa. Verrà aperta una finestra in cui potrai importare il tuo file utilizzando un URL o copiando e incollando il file desiderato.

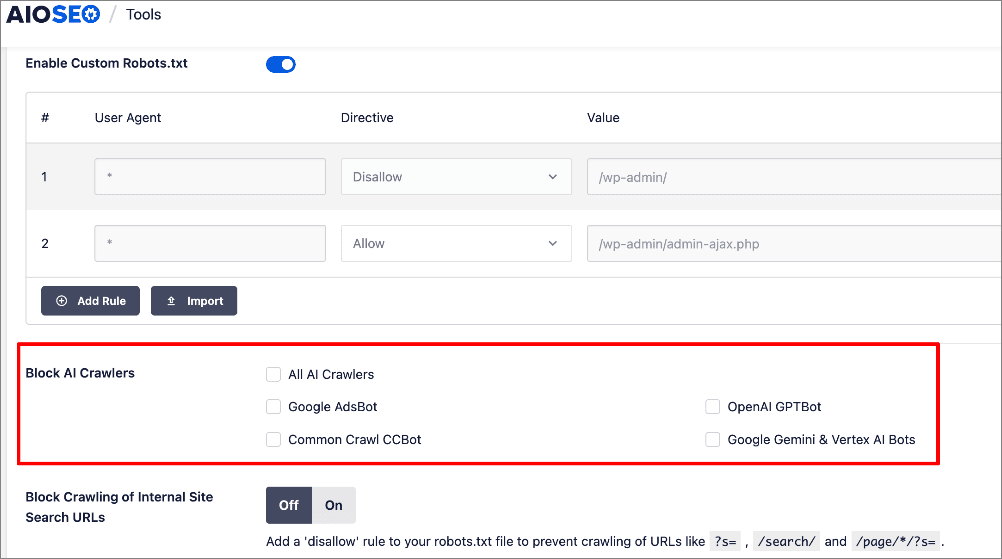

4. Blocca bot indesiderati

Un'altra fantastica funzionalità nell'Editor Robots.txt di AIOSEO è la sezione Blocca crawler AI. Questo ti consente di bloccare bot non autorizzati dall'indicizzazione del tuo sito. Questi possono causare problemi di prestazioni, sicurezza e SEO.

Per saperne di più, consulta il nostro tutorial su come bloccare il traffico di bot indesiderato sul tuo sito.

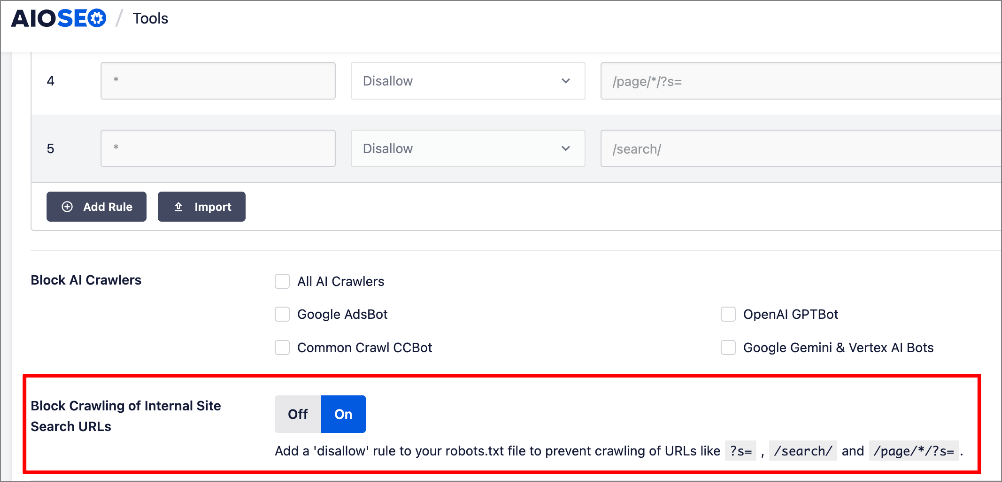

5. Impedisci il crawling degli URL di ricerca interna del sito

I siti web generano spesso URL in eccesso dalle ricerche interne quando i visitatori cercano contenuti o prodotti. Questi URL generati dalla ricerca contengono parametri che i motori di ricerca percepiscono come unici, inducendoli a scansionare pagine non necessarie. Ciò spreca il tuo budget di scansione e può impedire l'indicizzazione delle tue pagine più importanti.

Puoi facilmente impedirlo nell'Editor Robots.txt di AIOSEO.

AIOSEO aggiunge una regola "disallow" nel tuo file robots.txt senza che tu debba farlo per ogni parametro generato dalla ricerca.

Personalizzare il tuo file robots.txt è così facile.

Per istruzioni passo passo sulla modifica del tuo file robots.txt, dai un'occhiata a questo tutorial.

Cos'è Robots.txt? Le tue FAQ hanno risposta

Cos'è robots.txt?

Un file robots.txt è un file di testo normale posizionato nella directory principale di un sito web per fornire istruzioni ai bot dei motori di ricerca e ad altri crawler web su quali parti del sito devono essere sottoposte a scansione o escluse dalla scansione. Agisce come un insieme di linee guida che questi bot devono seguire quando interagiscono con i contenuti del sito web.

Come creo un file robots.txt?

Puoi creare facilmente un file robots.txt utilizzando un plugin come AIOSEO. In alternativa, puoi percorrere la strada più lunga, creare un file di testo semplice chiamato robots.txt e caricarlo nella directory principale del tuo sito.

Posso usare robots.txt per migliorare la SEO?

Sì, ottimizzare il tuo file robots.txt può contribuire a un migliore SEO. Guidando i bot dei motori di ricerca a scansionare e indicizzare i tuoi contenuti più preziosi, escludendo al contempo contenuti duplicati o irrilevanti, puoi migliorare la visibilità e il posizionamento del tuo sito web nei risultati di ricerca.

Cos'è Robots.txt? Ora che lo sai, ottimizzalo

W

Come puoi vedere, un file robots.txt è una parte cruciale di qualsiasi sito web. Ottimizzare il tuo assicura che le tue pagine più importanti vengano scansionate e indicizzate, portando a migliori posizionamenti nei motori di ricerca.

Quindi, procedi e usa l'editor robots.txt di AIOSEO per ottimizzare il tuo.

Speriamo che questo post ti abbia aiutato a capire cos'è robots.txt in WordPress e perché è importante ottimizzarlo. Potresti anche voler consultare altri articoli sul nostro blog, come la nostra guida su come farsi indicizzare su Google o i nostri suggerimenti su come utilizzare le Statistiche di ricerca per migliorare il tuo posizionamento.

Se hai trovato utile questo articolo, iscriviti al nostro Canale YouTube. Troverai molti altri tutorial utili lì. Puoi anche seguirci su Twitter, LinkedIn o Facebook per rimanere aggiornato.

Divulgazione: I nostri contenuti sono supportati dai lettori. Ciò significa che se fai clic su alcuni dei nostri link, potremmo guadagnare una commissione. Raccomandiamo solo prodotti che crediamo aggiungeranno valore ai nostri lettori.