WordPressでrobots.txtファイルを生成する方法を知りたいですか?

WordPressサイトの管理を始めたばかりの頃、robots.txtファイルが何なのか全く知りませんでした。SEOランキングは不安定で、検索エンジンがなぜランダムなページをインデックスし、重要なコンテンツを見逃しているのか理解できませんでした。

そこで、WordPressは最適化されたrobots.txtファイルを自動的に作成しないことを発見しました。多くの小規模ビジネスオーナーがこの同じフラストレーションに直面しています。検索エンジンは、重要でないページにクロールバジェットを浪費して、非効率的にサイトをクロールします。

長年にわたり数十のWordPressサイトを管理してきた経験から、適切に設定されたrobots.txtファイルがSEOの成功に不可欠であることを学びました。これにより、検索エンジンはどのページに焦点を当て、どのページをスキップすべきかを正確に把握できます。

良いニュースは?WordPressでrobots.txtファイルを生成・最適化するためにコーディングスキルは必要ありません。すべてを処理してくれる、シンプルで使いやすいツールがあります。

このガイドでは、コード不要のソリューションを使用してrobots.txtファイルを生成・カスタマイズする方法を具体的に説明します。ブロックすべきページ、優先すべきページ、SEOランキングを損なう可能性のある一般的な間違いを回避する方法を学びます。

この記事では

Robots.txtファイルとは

Robots.txtは、ウェブサイトの所有者が検索エンジンのボットにサイトとの対話方法、主にどのページをクロールし、どのページを無視するかを指示するために作成できるテキストファイルです。本質的に、それはあなたのサイトのゲートキーパーとして機能し、ウェブサイトのルートディレクトリ(メインフォルダとも呼ばれます)に保存されます。

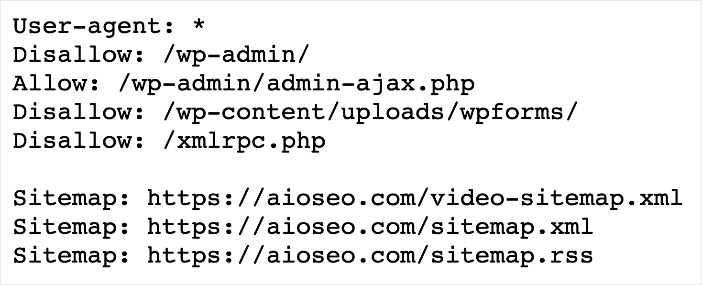

これは次のようなものです:

https://yoursite.com/robots.txtにアクセスすると、robots.txtファイルに簡単にアクセスできます。

これは、ウェブページのhead内に埋め込まれたHTMLタグであるrobotsメタタグと混同しないでください。このタグは、それが配置されているページにのみ適用されます。

Robots.txtファイルの重要性

Robots.txtファイルは次のような目的で使用できます:

- クロールを制御する

- インデックスを改善する

- 重複コンテンツの問題を防ぐ

- 機密情報を保護する

- クロールバジェットを最適化する

- サイトパフォーマンスを向上させる

単純なテキストファイルであるにもかかわらず、最適化されたrobots.txtファイルを持つことは、SEOに大きな影響を与える可能性があります。

WordPressでRobots.txtファイルを生成する方法

Robots.txtファイルを生成する準備はできましたか?

注意:WordPressはサイトのrobots.txtファイルを自動生成しますが、通常はデフォルトのファイルを最適化する必要があります。

以下の手順でカスタムrobots.txtファイルを生成する方法を説明します。心配いりません。コードや技術的な知識は必要ありません。

ステップ1:AIOSEOをインストールする

カスタムrobots.txtファイルを生成するための最初のステップは、All In One SEO(AIOSEO)をインストールして有効化することです。

AIOSEOは、300万以上のアクティブインストールを誇る、強力でありながら使いやすいSEOプラグインです。何百万人ものスマートなブロガーがAIOSEOを使用して、検索エンジンのランキングを向上させ、ターゲットトラフィックをブログに誘導しています。このプラグインには、SEO設定を適切に構成するための多くの強力な機能とモジュールがあります。例としては次のものが挙げられます。

- コーナーストーンコンテンツ: トピックの権威を構築し、セマンティックSEOを強化するのに役立ちます。

- 検索統計: この強力なGoogle Search Console連携により、キーワードランキングを追跡し、重要なSEOメトリックを1クリックで確認できます。

- 高度なRobots.txtジェネレーター: クロールとインデックス作成を改善するために、robots.txtファイルを簡単に生成およびカスタマイズできます。

- キーワードランクトラッカー: WordPressダッシュボード内でGoogleでのキーワードパフォーマンスを追跡できます。

- AIライティングアシスタント: 関連キーワードを特定し、可読性を向上させ、検索エンジン向けにコンテンツを最適化して、検索結果でのランキングを向上させます。

- 次世代スキーマジェネレーター:このノーコードスキーマジェネレーターにより、ユーザーはサイト上のあらゆるスキーママークアップを生成して出力できます。

- リダイレクトマネージャー:リダイレクトを管理し、404エラーを排除するのに役立ち、検索エンジンがサイトをクロールしてインデックス作成しやすくします。

- リンクアシスタント:サイト内のページ間のリンク構築を自動化する強力な内部リンクツールです。また、外部リンクの監査も提供します。

- サイトマップジェネレーター: サイトの更新をすべての検索エンジンに通知するために、さまざまな種類のサイトマップを自動生成します。

- その他多数

AIOSEOのインストール方法については、インストールガイドをご覧ください。

そして最も愛されている機能の1つが、高度なrobots.txtエディターです。この強力なツールを使用すると、ニーズに合わせてrobots.txtファイルを簡単にカスタマイズできます。さらに、サイトマップのURLもrobots.txtファイルに自動的に追加されます!

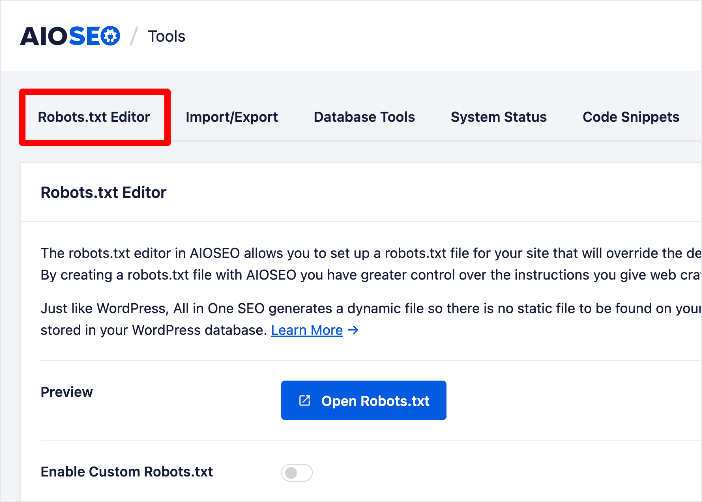

ステップ2:Robots.txtエディタにアクセスする

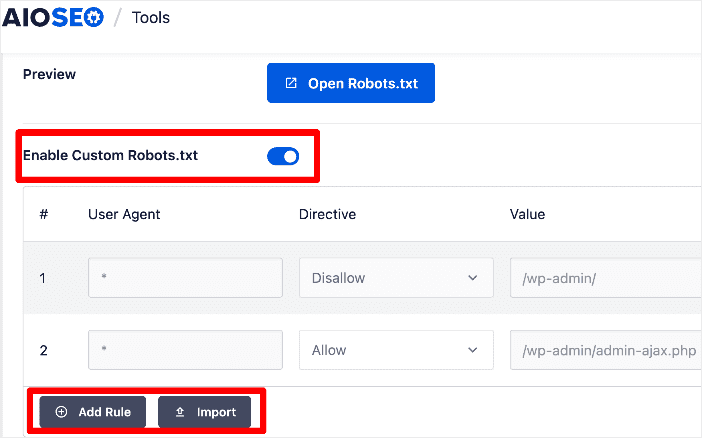

AIOSEOをアクティブ化した後、次のステップはAIOSEOのRobots.txtエディターにアクセスすることです。これを行うには、AIOSEOメニューに移動し、ツール » Robots.txtエディターをクリックします。

次に、カスタムrobots.txtを有効にするトグルをクリックします。これにより、robots.txtファイルを編集できるようになります。

より多くのrobots.txtツールについては、最適なrobots.txtジェネレーターのリストをご覧ください。

ステップ3:Robots.txtディレクティブを追加する

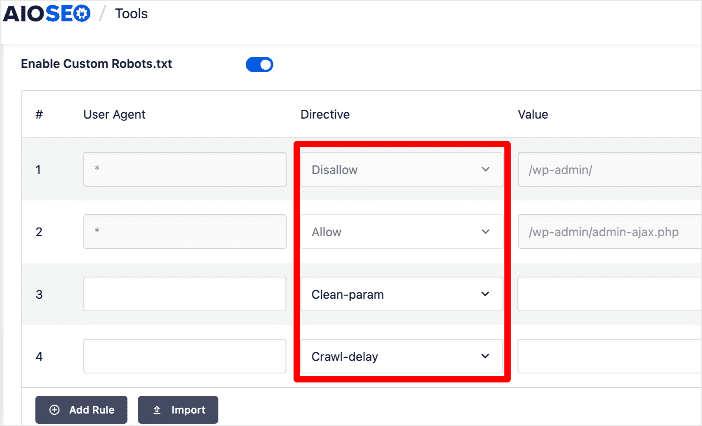

robots.txtファイルの編集を有効にしたら、次のステップはカスタムディレクティブを追加することです。

これらは、検索ボットにフォローさせたい指示です。例としては、Allow、Disallow、Clean-param、Crawl delayなどがあります。

各ディレクティブの意味は次のとおりです。

- Allow: ユーザーエージェント(ボット)がURLをクロールすることを許可します。

- Disallow: ユーザーエージェント(ボット)がURLをクロールすることを禁止します。

- Clean-param: 指定されたURLパラメータを持つすべてのURLを無視するように検索ボットに指示します。

- Crawl delay: 検索ボットがURLをクロールする間隔を設定します。

このセクションでは、どのユーザーエージェントがディレクティブに従うべきかを決定することもできます。また、ディレクティブの値(URL、URLパラメータ、または頻度)を指定する必要があります。

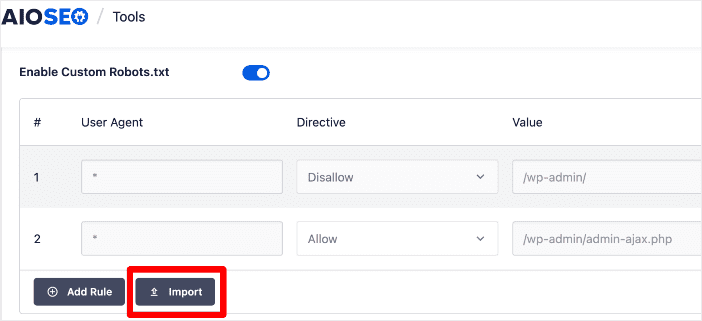

ステップ4:別のサイトからRobots.txtディレクティブをインポートする(オプション)

WordPressでrobots.txtファイルを生成する簡単な方法は、インポート機能を使用することです。

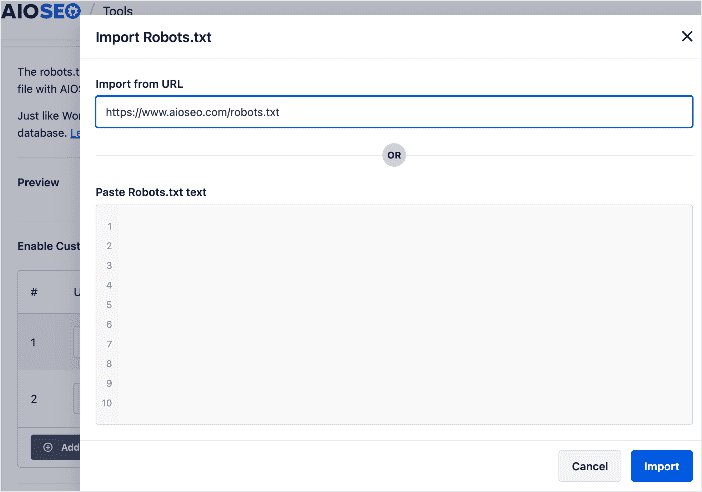

インポートボタンをクリックすると、選択したrobots.txtファイルをインポートするための2つのオプションがあるウィンドウが開きます。

URLからインポート:インポートしたいrobots.txtファイルのURL(https://examplesite.com/robots.txt)を貼り付けて、インポートをクリックするだけです。robots.txtファイルがサイトにインポートされます。

Robots.txtテキストを貼り付け:インポートしたいrobots.txtファイルがあるURLを開き、テキストをコピーします。次に、サイトに戻り、提供されたフィールドに貼り付けて、インポートをクリックします。

この方法は、robots.txtファイルをインポートしようとしているサイトに、ご自身のサイトで実装したいディレクティブがある場合に最適です。

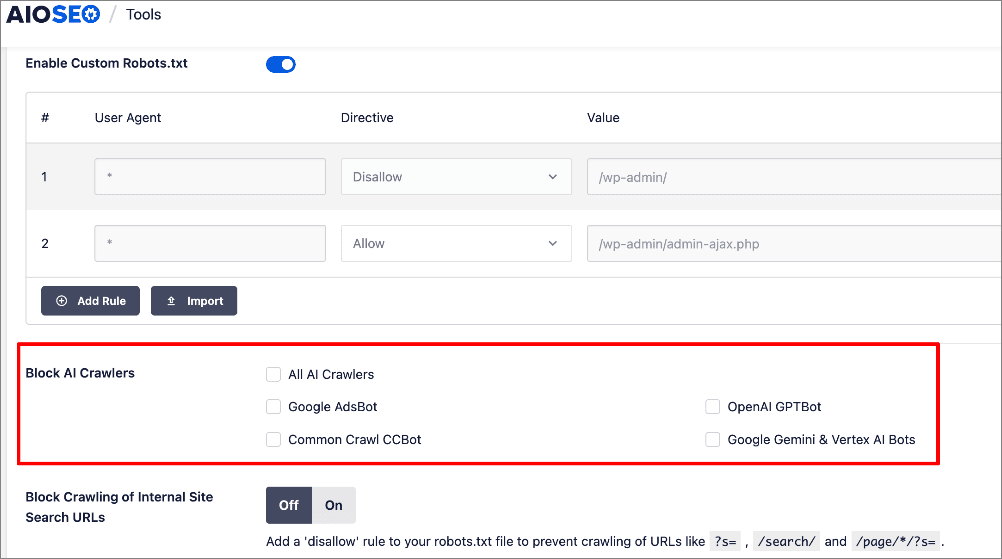

ステップ5:不要なボットをブロックする(オプション)

AIOSEOのRobots.txtエディターには、もう一つ非常に便利な機能として「AIクローラーをブロック」セクションがあります。これにより、不正なボットがサイトをクロールするのをブロックできます。これらはパフォーマンス、セキュリティ、SEOの問題につながる可能性があります。

これについて詳しくは、サイトで不要なボットトラフィックをブロックする方法に関するチュートリアルをご覧ください。

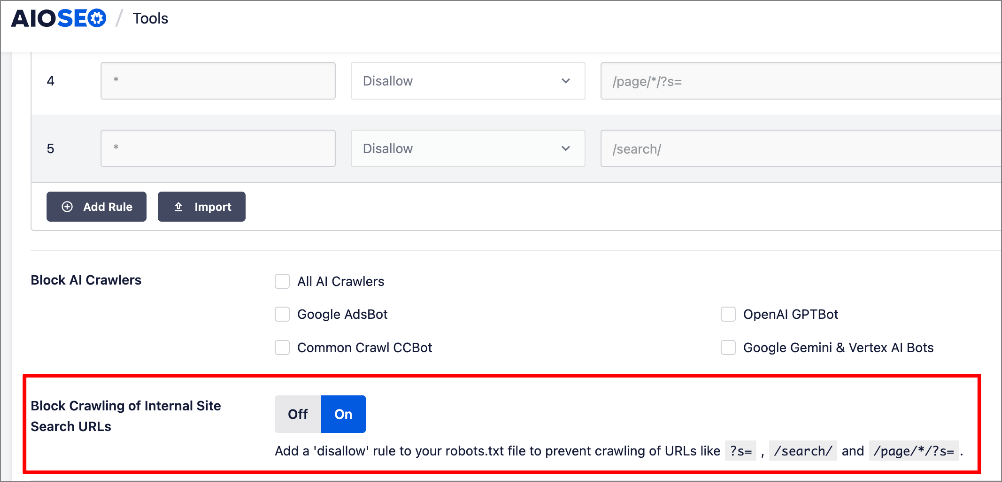

ステップ6:サイト内検索URLのクロールを防ぐ(オプション)

ウェブサイトでは、訪問者が内部検索機能を使用してコンテンツや製品を見つける際に、余分なURLが生成されることがよくあります。これらの動的に生成されたURLには通常、検索エンジンが個別のページとして扱うパラメータが含まれています。その結果、検索エンジンはこれらの不要なURLをクロールするのに時間を浪費する可能性があり、クロール予算を使い果たし、最も重要なページのインデックス作成を妨げる可能性があります。

AIOSEOのRobots.txtエディターでこれを簡単に防ぐことができます。

AIOSEOは、検索生成パラメータごとに手動で設定することなく、robots.txtファイルに「disallow」ルールを追加します。

詳細については、robots.txtファイルを編集する方法に関するチュートリアルをご覧ください。

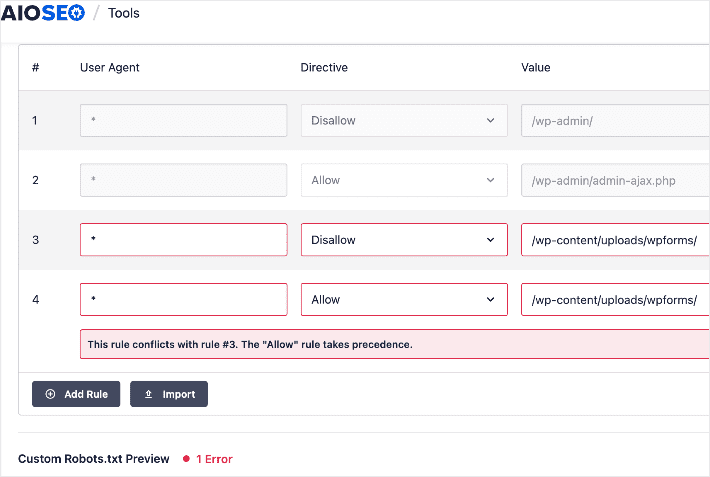

ステップ7:Robots.txtファイルをテストする

robots.txtファイルを生成したら、エラーがないかテストできます。ただし、AIOSEOのrobots.txtエディタを使用している場合は、組み込みのルール検証とエラー処理があるため、これは非常にまれです。

ただし、robots.txtファイルにエラーがないことを再確認したい場合は、Google Search Consoleのrobots.txtテスターを使用できます。プロパティを入力するだけで、ツールがrobots.txtファイルを自動的に取得し、エラーをハイライト表示します。

WordPressでrobots.txtファイルを生成する方法:よくある質問にお答えします

Robots.txtファイルの目的は何ですか?

robots.txtファイルは、ウェブサイトのどの部分へのアクセスやインデックス作成を許可するかを検索エンジンクローラーに指示するものです。これにより、検索エンジンがサイトのコンテンツとどのようにやり取りするかを制御できます。

WordPressでrobots.txtを生成するにはどうすればよいですか?

All In One SEO(AIOSEO)のようなプラグインを使用すると、WordPressでrobots.txtファイルを簡単に生成できます。コーディングや技術的な知識は必要ありません。

WordPressサイト用にrobots.txtファイルを手動で作成できますか?

はい、テキストエディタを使用してrobots.txtファイルを自分で作成し、サイトのルートディレクトリに配置することができます。ただし、AIOSEOのようなプラグインを使用するよりも時間がかかり、高度なWordPressの知識が必要です。

この投稿が、WordPressにおけるrobots.txtとは何か、そしてそれを最適化することがなぜ重要なのかを知るのに役立ったことを願っています。また、ブログの他の記事、例えばクロールとインデックス作成に関するガイドとそのSEOへの影響や、Googleでのインデックス作成を改善するためのヒントなどもご覧ください。

この記事がお役に立った場合は、YouTubeチャンネルにご登録ください。そこには、他にも多くの役立つチュートリアルがあります。また、Twitter、LinkedIn、Facebookでフォローして、最新情報を入手することもできます。

開示:当社のコンテンツは読者によってサポートされています。これは、当社のリンクの一部をクリックすると、手数料が発生する可能性があることを意味します。当社は、読者に価値をもたらすと信じる製品のみをお勧めします。