WordPressにおけるrobots.txtとは?

検索エンジンのランキングを向上させるためのヒントをカジュアルにチェックすると、robots.txtファイルがよく話題に上るでしょう。これは、サイトの重要な一部であり、検索エンジンの結果ページ(SERP)でのランキングを向上させたい場合に考慮すべきだからです。

この記事では、「WordPressにおけるrobots.txtとは何か?」という疑問にお答えします。また、サイト用のrobots.txtファイルの生成方法もご紹介します。

この記事では

Robots.txtとは?

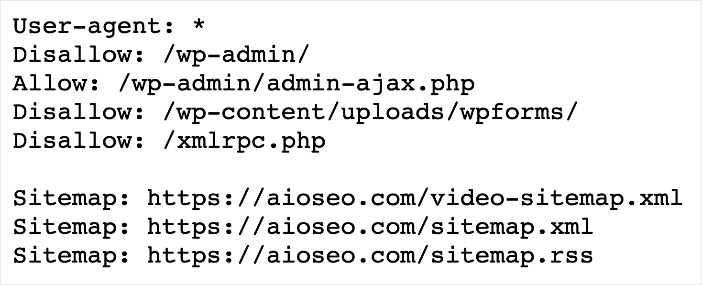

Robots.txtは、ウェブサイトの所有者が作成できるテキストファイルで、検索エンジンのボットにサイトとの対話方法、主にどのページをクロールし、どれを無視するかを指示します。これは、ウェブサイトのルートディレクトリ(メインフォルダとも呼ばれます)に保存されるプレーンテキストファイルです。私たちの場合は、robots.txtのURLは次のとおりです。

https://aioseo.com/robots.txtそして、それはこのようになります。

これは、ウェブページのhead内に埋め込まれたHTMLタグであるrobotsメタタグと混同しないでください。このタグは、それが配置されているページにのみ適用されます。

これはすべて何を意味するのでしょうか?

これをよりよく理解するために、少し戻ってロボットとは何かを定義しましょう。この文脈では、ロボットとは、インターネット上のウェブサイトを訪問する「ボット」またはウェブクローラーのことです。これらはrobots.txtファイルではユーザーエージェントと呼ばれます。最も一般的なのは検索エンジンのクローラーで、検索ボットや検索エンジンスパイダーなど、さまざまな名前で呼ばれます。これらのボットは、検索エンジンがコンテンツを発見し、それによってより速くインデックス化できるようにウェブをクロールし、関連する検索用語に応答してユーザーに提供できるようにします。

一般的に、検索ボットはインターネットとあなたのサイトにとって有益です。しかし、それらがどれほど役立つとしても、サイトとの対話を制御したい場合があります。

ここでrobots.txtファイルが登場します。

Robots.txtファイルは何をするのか?

すでに見たように、robots.txtファイルは、検索エンジンのボットやその他のウェブクローラーにウェブサイトのコンテンツとの対話を指示するための指示セットとして機能します。これは、検索エンジンがウェブサイトをどのように認識し、対話するかを左右するデジタルゲートキーパーとして機能します。

Robots.txtファイルは次のような目的で使用できます:

クロールを制御する

検索エンジンのボットは、コンテンツを発見してインデックス化するためにウェブサイトをクロールします。robots.txtファイルは、これらのボットにウェブサイトのどの部分がクロール可能で、どの部分がアクセス禁止であるかを通知します。さまざまなユーザーエージェント(ボット)に対してルールを指定することで、アクセスできるページを制御できます。

インデックスを指示する

クロールはコンテンツの発見を伴いますが、インデックス作成は発見されたコンテンツを検索エンジンのデータベースに追加することを伴います。robots.txtファイルを利用することで、どのコンテンツをインデックス化し、どれを除外するかについてボットをガイドできます。これにより、関連性のないコンテンツが検索結果を散らかすのを防ぎながら、重要なページのインデックス作成を優先することができます。

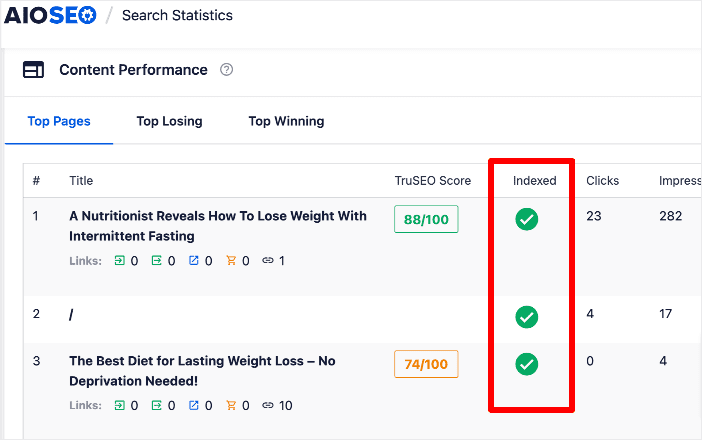

AIOSEOを使用すると、投稿やページのインデックスステータスを確認することができます。

これにより、ページのインデックスステータスを簡単に把握できます。

重複コンテンツの問題を防ぐ

重複コンテンツは検索エンジンを混乱させ、サイトのSEOに悪影響を与える可能性があります。robots.txtを使用すると、ボットが重複コンテンツをクロールおよびインデックス化するのを防ぎ、検索結果で最も関連性の高いバージョンのコンテンツのみが考慮されるようにすることができます。

機密情報を保護する

ウェブサイトの一部の領域には、一般に公開したり、検索エンジンにインデックス化されたりしたくない機密データが含まれている場合があります。適切に構造化されたrobots.txtファイルは、ボットがこれらの領域にアクセスしてインデックス化するのを防ぎ、ウェブサイトのプライバシーとセキュリティを強化できます。

クロールバジェットの最適化

検索エンジンは各ウェブサイトにクロールバジェットを割り当て、ボットがサイトをどのくらいの頻度でどのくらいの深さでクロールするかを決定します。robots.txtを使用すると、ボットを最も価値のある関連性の高いページに誘導し、クロールバジェットを効率的に使用できます。

サイトパフォーマンスの向上

ボットが制限なくサイトをクロールできるようにすると、サーバーリソースを消費し、サイトのパフォーマンスに影響を与える可能性があります。robots.txtでクロールを制御することにより、サーバーへの負荷を軽減し、読み込み時間の短縮とユーザーエクスペリエンスの向上につながります。

WordPressでrobots.txtファイルを生成する方法

WordPressでrobots.txtファイルを生成するのは非常に簡単です。All In One SEO(AIOSEO)のような強力なWordPress SEOプラグインを使用している場合は、特にそうです。

AIOSEOは、市場で最高のWordPress SEOプラグインであり、300万以上のアクティブインストールを誇っています。何百万人もの目の肥えたウェブサイト所有者やマーケターが、SERPを支配し、関連性の高いサイトトラフィックを促進するためにこのプラグインを信頼しています。これは、プラグインに、ウェブサイトを検索エンジンとユーザーのために最適化するのに役立つ多くの強力なSEO機能とモジュールがあるためです。AIOSEOで見つかる機能の例は次のとおりです。

これらは次のような機能です。

- 検索統計: この強力なGoogle Search Console連携により、キーワードランキングの追跡や重要なSEO指標の確認がワンクリックで行えます。

- 次世代スキーマジェネレーター:これは、ユーザーがサイト上のあらゆる種類のスキーママークアップを生成および出力できるノーコードスキーマジェネレーターです。

- リダイレクトマネージャー:リダイレクトを管理し、404エラーを排除するのに役立ち、検索エンジンがサイトをクロールおよびインデックス登録しやすくします。

- リンクアシスタント: サイト内のページ間のリンク構築を自動化する強力な内部リンクツールです。アウトバウンドリンクの監査も提供します。

- IndexNow: IndexNowプロトコル(BingやYandexなど)をサポートする検索エンジンでの高速インデックス作成に。

- サイトマップジェネレーター: さまざまな種類のサイトマップを自動生成し、サイトの更新をすべての検索エンジンに通知します。

- その他多数。

AIOSEOのインストール方法については、インストールガイドをご覧ください。

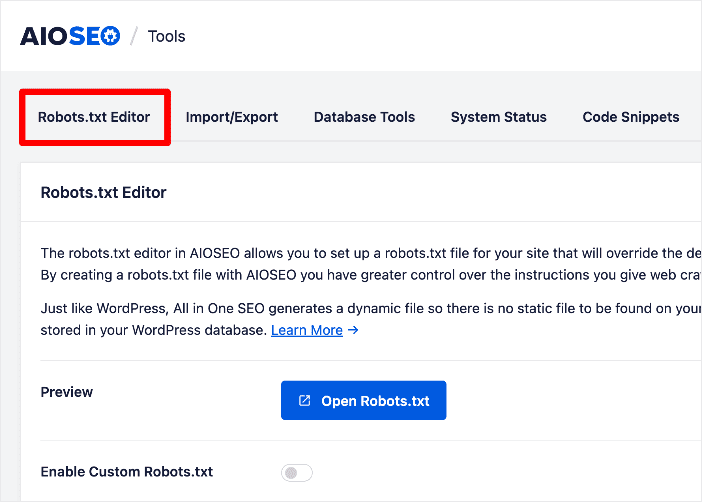

AIOSEOの最初から最も愛されている機能の1つは、Robots.txtエディターです。この強力なモジュールにより、コーディングや技術的な知識がなくても、robots.txtファイルを簡単に生成および編集できます。

AIOSEOメニューのツールをクリックすると、robots.txtエディターを見つけることができます。

最初に気づくことの1つは、青い[Robots.txtを開く]ボタンです。これは、WordPressが自動的にrobots.txtファイルを生成するためです。しかし、最適化されていないため、編集したいはずです。そのための手順は次のとおりです。

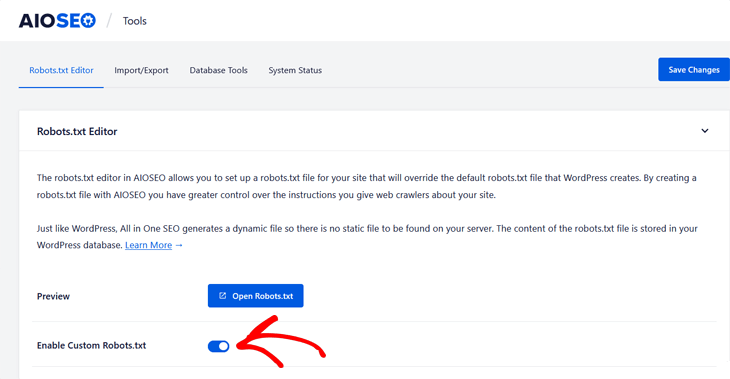

ステップ1:カスタムrobots.txtを有効にする

これを行うには、カスタムrobots.txtを有効にするボタンをクリックします。これにより、robots.txtファイルを編集できるウィンドウが開きます。

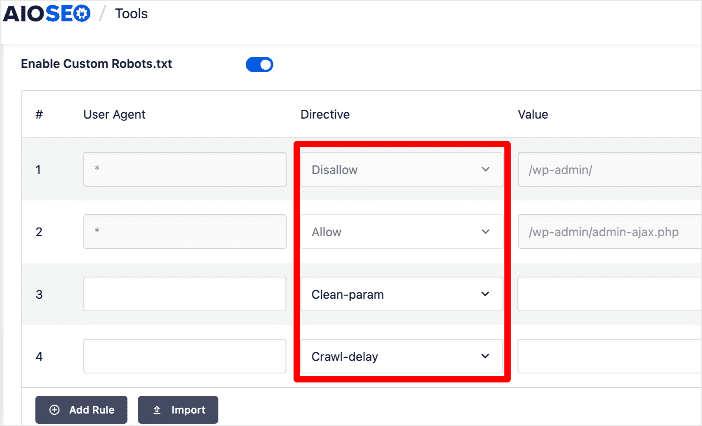

ステップ2:ディレクティブをカスタマイズする

これらは、検索ボットにフォローさせたい指示です。例としては、Allow、Disallow、Clean-param、Crawl delayなどがあります。

このセクションでは、どのユーザーエージェント(検索クローラー)がディレクティブに従うべきかを決定することもできます。また、ディレクティブの値(URL、URLパラメータ、または頻度)を指定する必要もあります。

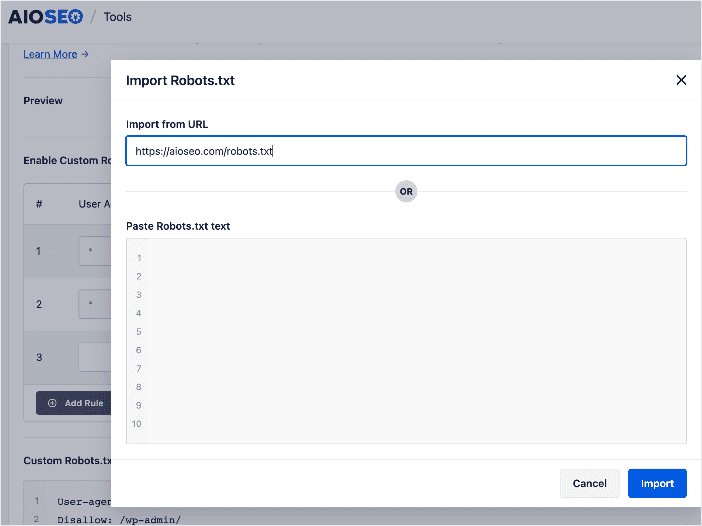

エミュレートしたいrobots.txtファイルを持つサイトがある場合は、[インポート]ボタンを使用して、URLまたはコピー&ペースト機能を使用してコピーできます。

3. Robots.txtファイルをインポートする(オプション)

または、別のサイトからrobots.txtファイルをインポートすることもできます。これを行うには、[インポート]ボタンをクリックします。これによりウィンドウが開き、URLを使用してファイルをインポートするか、目的のファイルをコピーして貼り付けることができます。

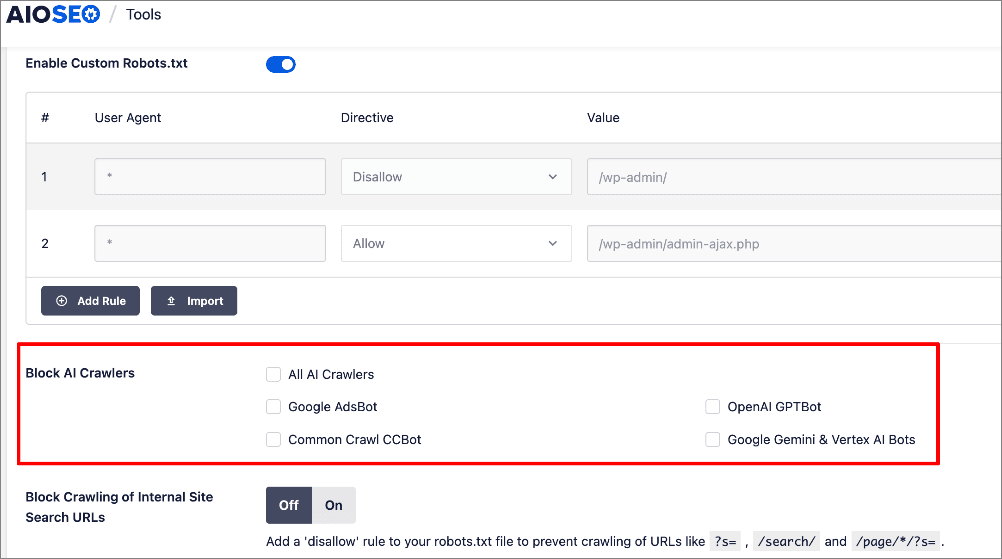

4. 不要なボットをブロックする

AIOSEOのRobots.txtエディターには、もう一つ非常に便利な機能として「AIクローラーをブロック」セクションがあります。これにより、不正なボットがサイトをクロールするのをブロックできます。これらはパフォーマンス、セキュリティ、SEOの問題につながる可能性があります。

これについて詳しくは、サイトで不要なボットトラフィックをブロックする方法に関するチュートリアルをご覧ください。

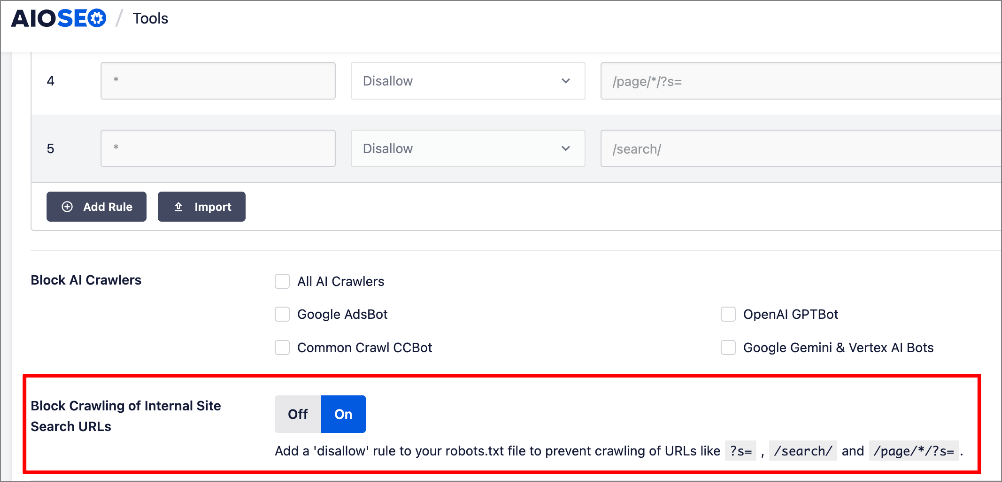

5. サイト内検索URLのクロールを防ぐ

ウェブサイトでは、訪問者がコンテンツや商品を検索する際に、内部検索によって過剰なURLが生成されることがよくあります。これらの検索生成URLにはパラメータが含まれており、検索エンジンはこれをユニークなものと認識するため、不要なページがクロールされてしまいます。これによりクロール予算が無駄になり、最も重要なページがインデックスされない可能性があります。

AIOSEOのRobots.txtエディターでこれを簡単に防ぐことができます。

AIOSEOは、検索生成パラメータごとに手動で設定することなく、robots.txtファイルに「disallow」ルールを追加します。

robots.txtファイルをカスタマイズするのは簡単です。

robots.txtファイルの編集方法については、このチュートリアルをご覧ください。

robots.txtとは?よくある質問にお答えします

Robots.txtとは?

robots.txtファイルは、ウェブサイトのルートディレクトリに配置されるプレーンテキストファイルで、検索エンジンのボットやその他のウェブクローラーに対し、サイトのどの部分をクロールすべきか、またはクロールから除外すべきかについての指示を提供します。これは、これらのボットがウェブサイトのコンテンツとやり取りする際に従うべきガイドラインのセットとして機能します。

robots.txtファイルを作成するにはどうすればよいですか?

AIOSEOのようなプラグインを使用すると、robots.txtファイルを簡単に作成できます。または、手間のかかる方法を選択して、robots.txtという名前のプレーンテキストファイルを作成し、サイトのルートディレクトリにアップロードすることもできます。

robots.txtを使用してSEOを改善できますか?

はい、robots.txtファイルを最適化することで、SEOの向上に貢献できます。検索エンジンのボットに最も価値のあるコンテンツをクロールおよびインデックスするように誘導し、重複または無関係なコンテンツを除外することで、検索結果でのウェブサイトの可視性とランキングを向上させることができます。

Robots.txtとは?理解したら、最適化しましょう

W

ご覧のとおり、robots.txtファイルはあらゆるウェブサイトの重要な部分です。それを最適化することで、最も重要なページがクロールおよびインデックスされるようになり、検索ランキングが向上します。

したがって、AIOSEOのrobots.txtエディターを使用して最適化してください。

この投稿が、WordPressのrobots.txtとは何か、そしてそれを最適化することがなぜ重要なのかを知るのに役立ったことを願っています。また、Googleにインデックス登録してもらう方法や、検索統計を使用してランキングを向上させるためのヒントなど、他のブログ記事も確認することをお勧めします。

この記事がお役に立った場合は、YouTubeチャンネルを購読してください。そこには、さらに多くの役立つチュートリアルがあります。また、Twitter、LinkedIn、またはFacebookでフォローして、最新情報を入手してください。

開示:当社のコンテンツは読者によってサポートされています。これは、当社のリンクの一部をクリックすると、手数料が発生する可能性があることを意味します。当社は、読者に価値をもたらすと信じる製品のみをお勧めします。