Wenn Sie ein WordPress Multisite-Netzwerk haben, können Sie globale robots.txt-Regeln verwalten, die für alle Websites im Netzwerk gelten.

WICHTIG:

Diese Funktion funktioniert derzeit nur für WordPress Multisite-Netzwerke, die als Subdomains eingerichtet sind. Sie funktioniert nicht für solche, die als Unterverzeichnisse eingerichtet sind.

In diesem Artikel

Video-Anleitung

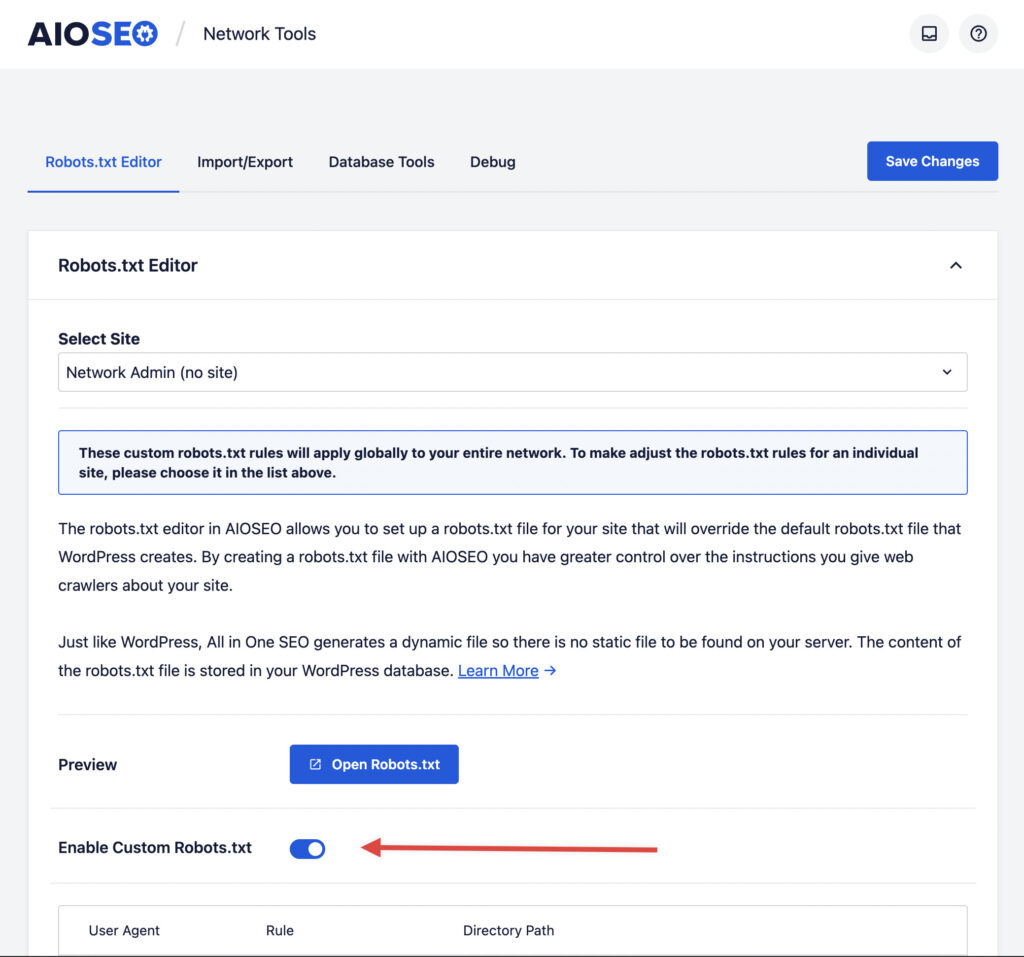

Um zu beginnen, gehen Sie zum Netzwerkadministrator und klicken Sie dann im linken Menü auf All in One SEO > Netzwerk-Tools.

Sie sehen unseren Standard-Robots.txt-Editor, in dem Sie benutzerdefinierte Regeln für Ihre robots.txt aktivieren und verwalten können.

Klicken Sie auf den Schalter Benutzerdefinierte Robots.txt aktivieren, um den Regel-Editor zu aktivieren.

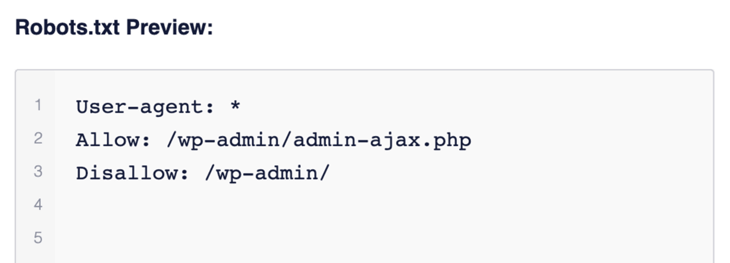

Unten auf dem Bildschirm sollte der Abschnitt Robots.txt-Vorschau erscheinen, der die von WordPress hinzugefügten Standardregeln anzeigt.

Standard-Robots.txt-Regeln in WordPress

Die Standardregeln, die im Abschnitt Robots.txt-Vorschau (siehe obige Bildschirmaufnahme) angezeigt werden, fordern Crawler auf, Ihre Kern-WordPress-Dateien nicht zu crawlen. Es ist für Suchmaschinen unnötig, auf diese Dateien direkt zuzugreifen, da sie keine relevanten Website-Inhalte enthalten.

Wenn Sie aus irgendeinem Grund die von WordPress hinzugefügten Standardregeln entfernen möchten, müssen Sie den robots_txt Filter Hook in WordPress verwenden.

Regeln mit dem Regel-Builder hinzufügen

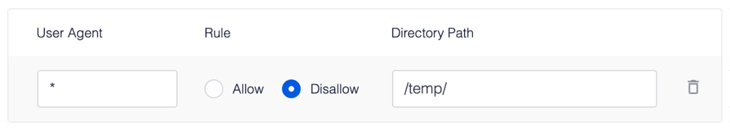

Der Regel-Builder wird verwendet, um Ihre eigenen benutzerdefinierten Regeln für bestimmte Pfade auf Ihrer Website hinzuzufügen.

Wenn Sie beispielsweise eine Regel hinzufügen möchten, um alle Crawler aus einem temporären Verzeichnis zu blockieren, können Sie den Regel-Builder verwenden, um dies hinzuzufügen.

Um eine Regel hinzuzufügen, geben Sie den User-Agenten in das Feld User Agent ein. Die Verwendung von * wendet die Regel auf alle User-Agents an.

Wählen Sie als Nächstes entweder Zulassen oder Verbieten, um den User-Agenten zuzulassen oder zu blockieren.

Geben Sie als Nächstes den Verzeichnispfad oder Dateinamen in das Feld Verzeichnispfad ein.

Klicken Sie abschließend auf die Schaltfläche Änderungen speichern.

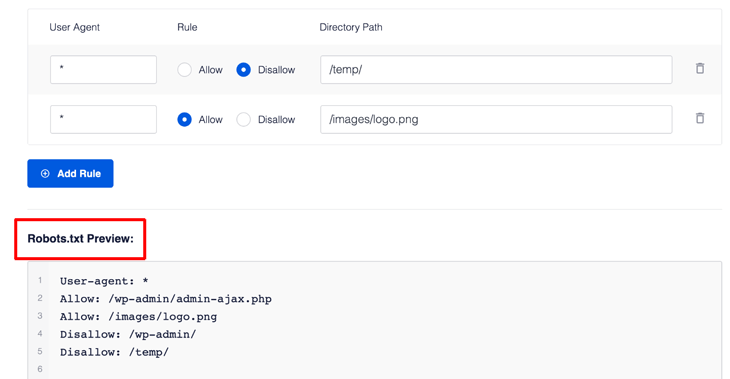

Wenn Sie weitere Regeln hinzufügen möchten, klicken Sie auf die Schaltfläche Regel hinzufügen und wiederholen Sie die obigen Schritte und klicken Sie auf die Schaltfläche Änderungen speichern.

Ihre Regeln werden im Abschnitt Robots.txt-Vorschau und in Ihrer robots.txt angezeigt, die Sie durch Klicken auf die Schaltfläche Robots.txt öffnen anzeigen können.

Jede Regel, die Sie hier hinzufügen, gilt für alle Websites in Ihrem Netzwerk und kann nicht auf individueller Website-Ebene überschrieben werden.

Regeln mit dem Regel-Builder bearbeiten

Um eine von Ihnen hinzugefügte Regel zu bearbeiten, ändern Sie einfach die Details im Regel-Builder und klicken Sie auf die Schaltfläche Änderungen speichern.

Eine Regel im Regel-Builder löschen

Um eine Regel zu löschen, die Sie hinzugefügt haben, klicken Sie auf das Papierkorbsymbol rechts neben der Regel.

Unerwünschte Crawler blockieren

Sie können „KI-Crawler blockieren“ verwenden, um Regeln zu Ihrer robots.txt hinzuzufügen, die bekannte Crawler wie KI-Crawler und Google AdsBot blockieren.

Sie können jeden der Crawler auswählen, um sie zu blockieren, oder Sie können Alle KI-Crawler auswählen, um alle aufgeführten zu blockieren.

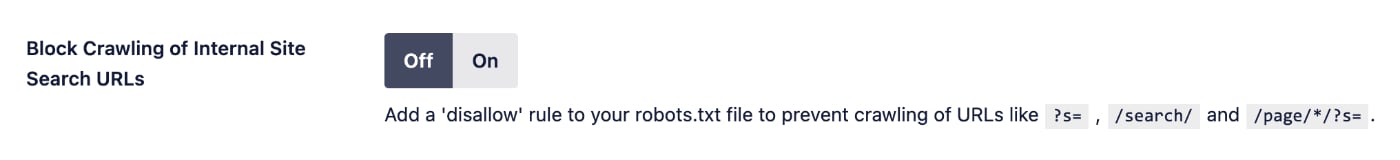

Crawling von internen Website-Such-URLs blockieren

Sie können die Einstellung „Crawling von internen Websuche-URLs blockieren“ verwenden, um Regeln zu Ihrer robots.txt hinzuzufügen, um das Crawling von Suchseiten-URLs zu verhindern. Dies reduziert unnötiges Crawling Ihrer Website.

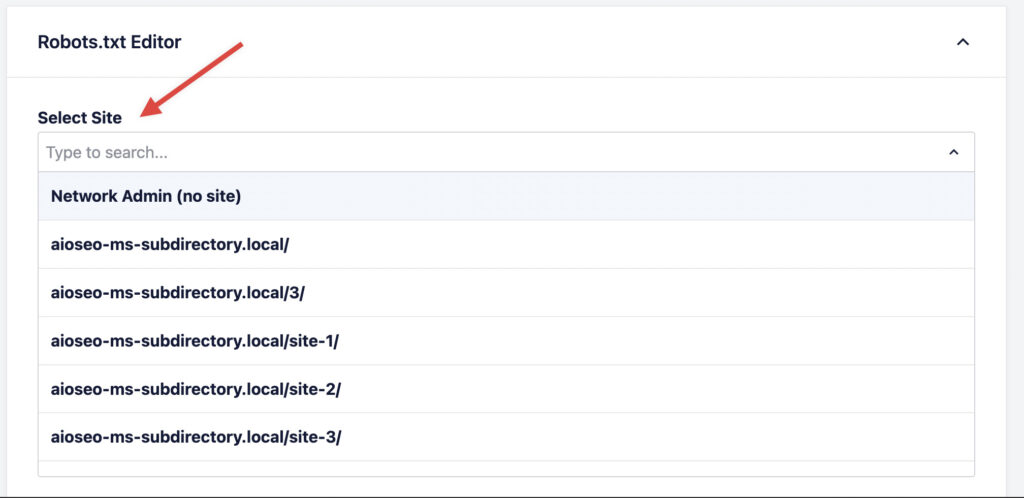

Robots.txt für Unterseiten verwalten

Im Multisite Robots.txt Editor ist es sehr einfach, Robots-Regeln für jede Website in Ihrem Netzwerk zu bearbeiten.

Klicken Sie zunächst einfach auf das Dropdown-Menü für die Website-Auswahl oben im Robots.txt Editor. Wählen Sie von dort die Website aus, für die Sie die Regeln bearbeiten möchten, oder suchen Sie sie, indem Sie die Domain eingeben:

Sobald Sie eine Website ausgewählt haben, werden die unten stehenden Regeln automatisch aktualisiert und Sie können die Regeln nur für diese Website ändern. Stellen Sie sicher, dass Sie nach der Änderung der Regeln für die Unterwebsite auf „Änderungen speichern“ klicken.