Möchten Sie die robots.txt auf Ihrer Website anpassen? Dieser Artikel hilft Ihnen dabei.

Das robots.txt-Modul in All in One SEO ermöglicht es Ihnen, die robots.txt zu verwalten, die WordPress erstellt.

Dies gibt Ihnen mehr Kontrolle über die Anweisungen, die Sie Webcrawlern über Ihre Website geben.

In diesem Artikel

- Video-Anleitung

- Über die Robots.txt in WordPress

- Verwendung des Robots.txt-Editors in All in One SEO

- Standard-Robots.txt-Regeln in WordPress

- Adding Rules Using the Rule Builder

- Regeln mit dem Regel-Builder bearbeiten

- Eine Regel im Regel-Builder löschen

- Ändern der Reihenfolge von Regeln im Regel-Builder

- Importieren Ihrer eigenen Robots.txt in All in One SEO

- Verwendung von erweiterten Regeln im Regel-Builder

- Unerwünschte Crawler blockieren

- Crawling von internen Website-Such-URLs blockieren

- Robots.txt-Editor für WordPress Multisite

Video-Anleitung

Hier ist ein Video, das zeigt, wie das Robots.txt-Tool in All in One SEO verwendet wird:

Über die Robots.txt in WordPress

Zunächst ist es wichtig zu verstehen, dass WordPress für jede WordPress-Site eine dynamische robots.txt generiert.

Diese Standard-robots.txt enthält die Standardregeln für jede Website, die mit WordPress läuft.

Zweitens gibt es keine statische Datei auf Ihrem Server, da WordPress eine dynamische robots.txt generiert. Der Inhalt der robots.txt wird in Ihrer WordPress-Datenbank gespeichert und in einem Webbrowser angezeigt. Dies ist völlig normal und viel besser, als eine physische Datei auf Ihrem Server zu verwenden.

Schließlich generiert All in One SEO keine robots.txt, sondern bietet Ihnen lediglich eine sehr einfache Möglichkeit, benutzerdefinierte Regeln zur Standard-robots.txt hinzuzufügen, die WordPress generiert.

HINWEIS:

Obwohl die von WordPress generierte robots.txt eine dynamisch generierte Seite und keine statische Textdatei auf Ihrem Server ist, sollten Sie bei der Erstellung einer großen robots.txt aus zwei Gründen vorsichtig sein:

- Eine große robots.txt deutet auf eine potenziell komplexe Reihe von Regeln hin, die schwer zu warten sein könnten

- Google hat eine maximale Dateigröße von 512 KB vorgeschlagen, um die Serverlast durch lange Verbindungszeiten zu verringern.

Verwendung des Robots.txt-Editors in All in One SEO

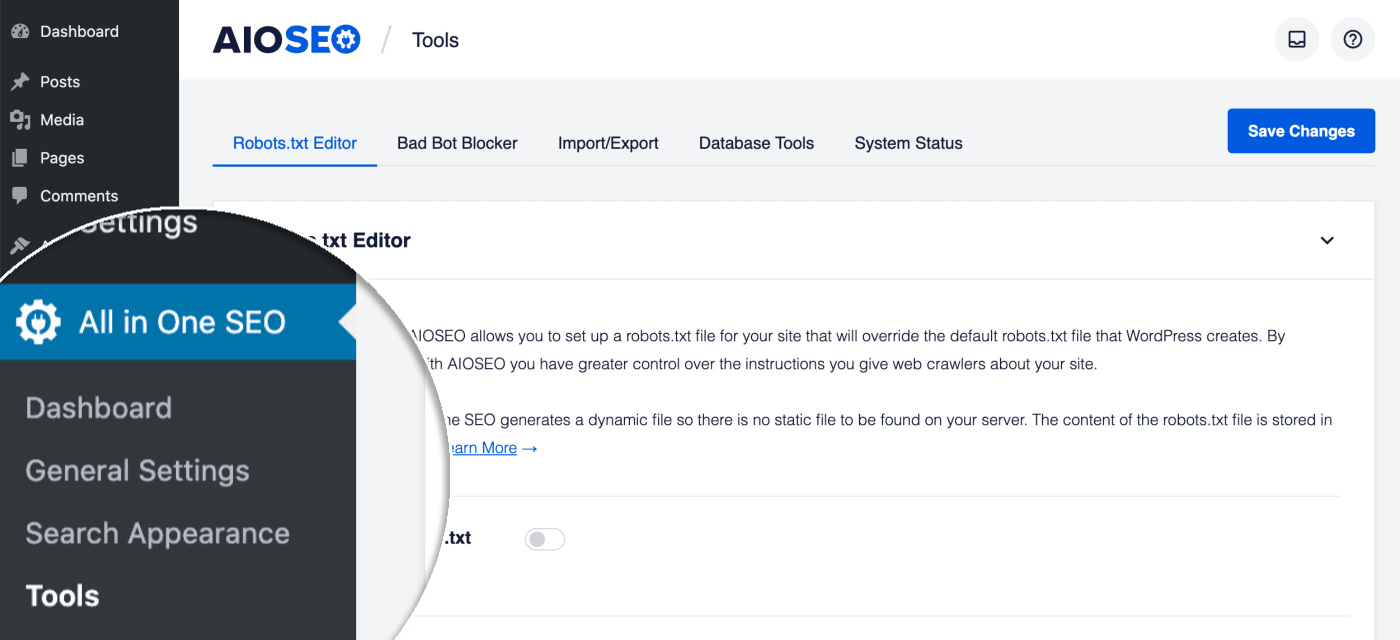

Klicken Sie zunächst im Menü All in One SEO auf Tools.

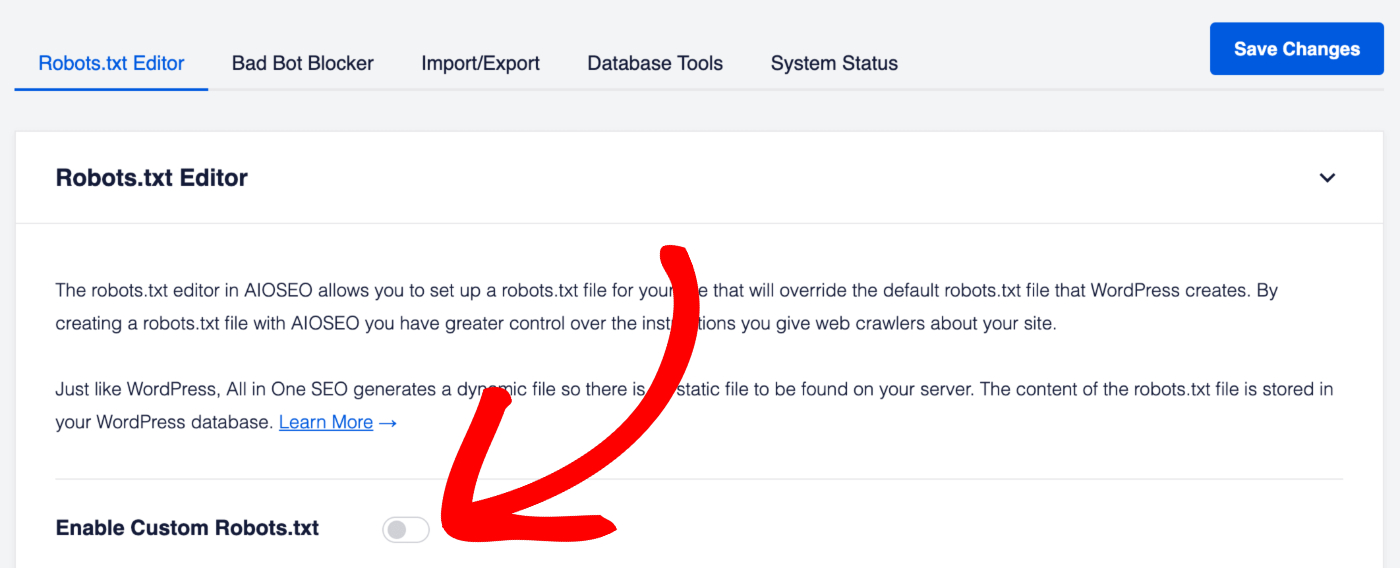

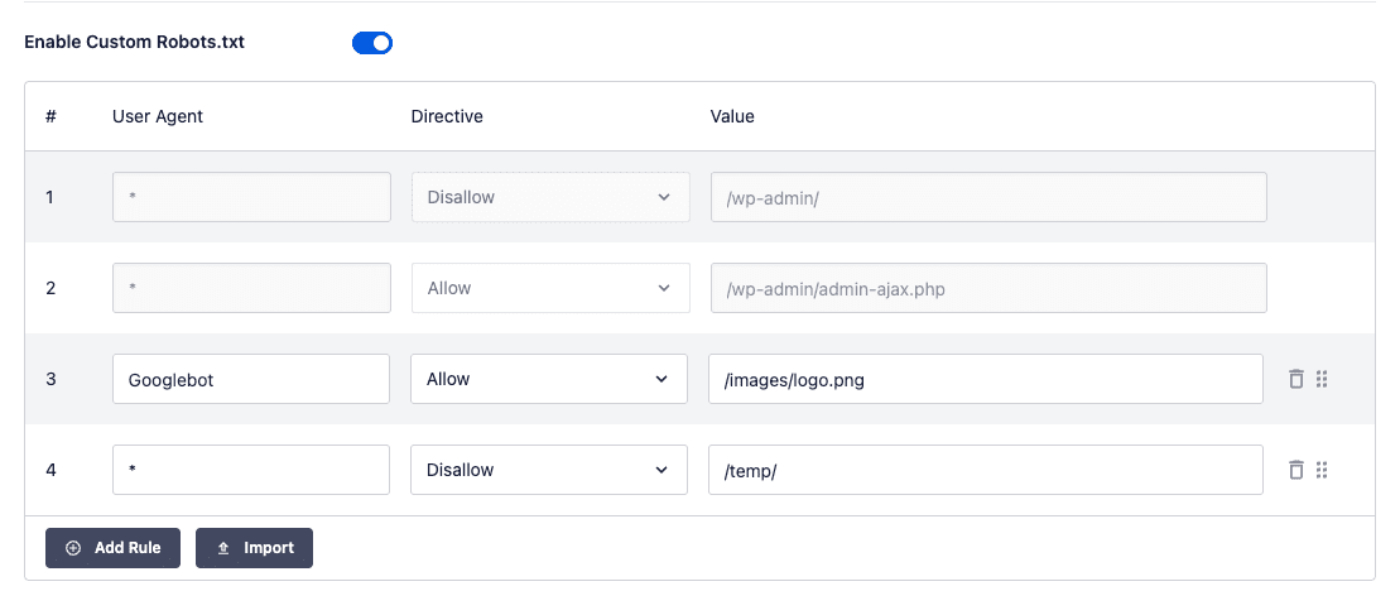

Sie sollten den Robots.txt-Editor sehen, und die erste Einstellung ist Benutzerdefinierte Robots.txt aktivieren. Klicken Sie auf den Schalter, um den benutzerdefinierten Robots.txt-Editor zu aktivieren.

WICHTIG:

Sie müssen die benutzerdefinierte Robots.txt nicht aktivieren, es sei denn, Sie haben einen bestimmten Grund, eine benutzerdefinierte Regel hinzuzufügen.

Die von WordPress generierte Standard-robots.txt ist für 99 % aller Websites perfekt. Die Funktion „Benutzerdefinierte Robots.txt“ ist für Benutzer gedacht, die benutzerdefinierte Regeln benötigen.

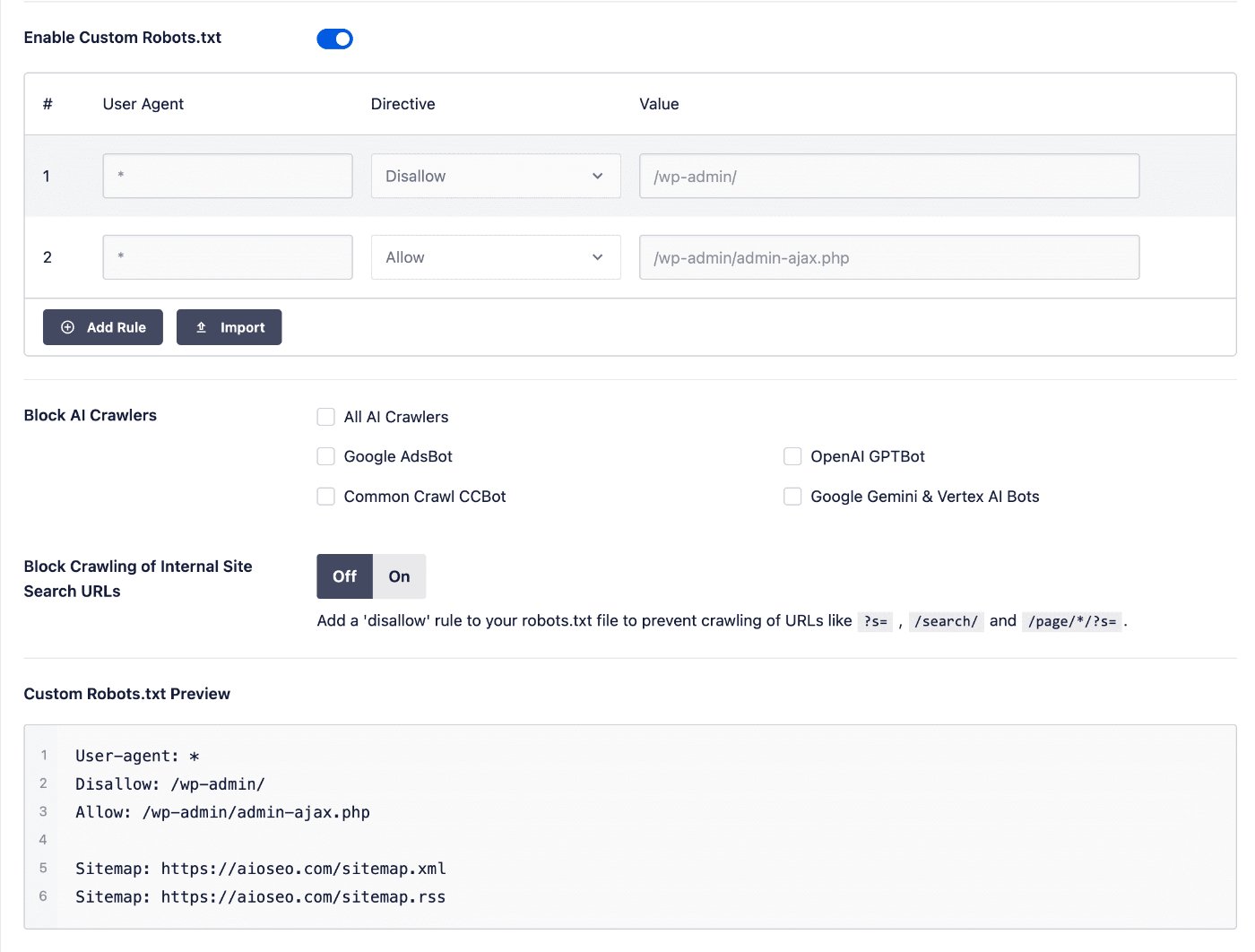

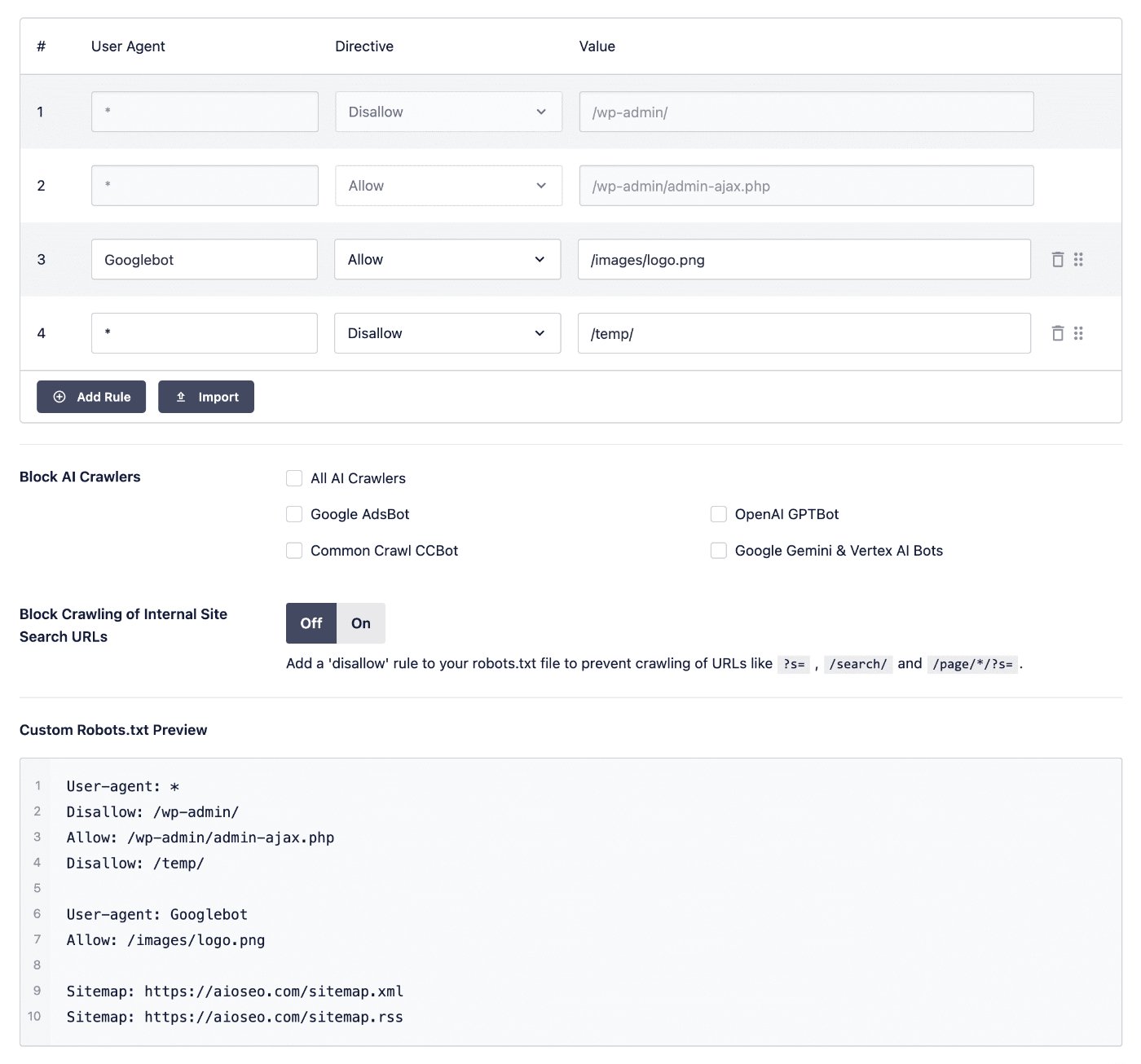

Sie sollten den Abschnitt Vorschau der benutzerdefinierten Robots.txt am unteren Bildschirmrand sehen, der die von WordPress hinzugefügten Standardregeln anzeigt.

Standard-Robots.txt-Regeln in WordPress

Die Standardregeln, die im Abschnitt Vorschau der benutzerdefinierten Robots.txt angezeigt werden (siehe obige Abbildung), weisen Robots an, Ihre Kern-WordPress-Dateien nicht zu crawlen. Es ist für Suchmaschinen unnötig, auf diese Dateien direkt zuzugreifen, da sie keinen relevanten Website-Inhalt enthalten.

Wenn Sie aus irgendeinem Grund die von WordPress hinzugefügten Standardregeln entfernen möchten, müssen Sie den robots_txt Filter Hook in WordPress verwenden.

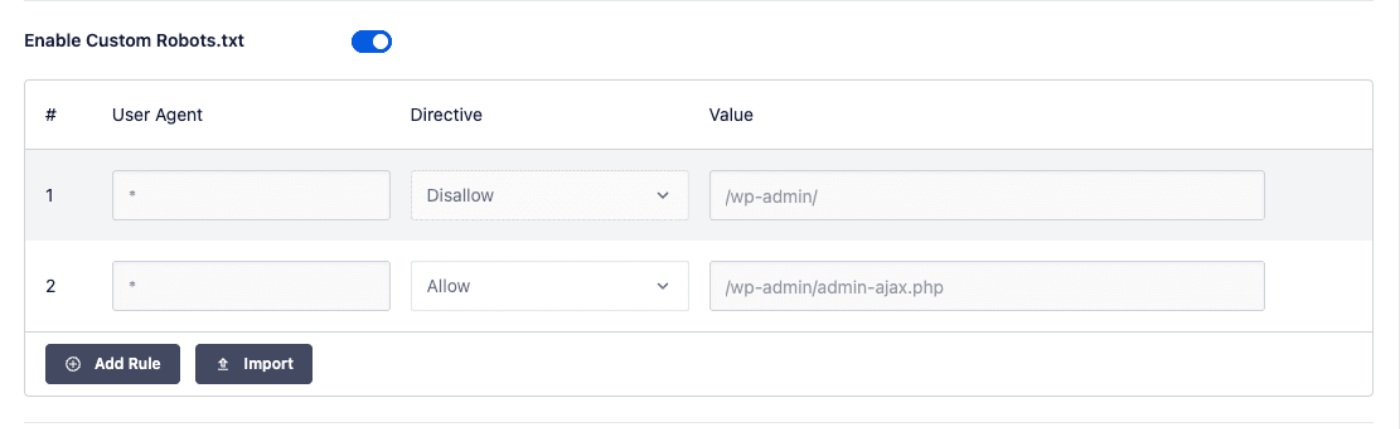

Regeln mit dem Regel-Builder hinzufügen

Der Regel-Builder wird verwendet, um Ihre eigenen benutzerdefinierten Regeln für bestimmte Pfade auf Ihrer Website hinzuzufügen.

Wenn Sie beispielsweise eine Regel hinzufügen möchten, um alle Crawler aus einem temporären Verzeichnis zu blockieren, können Sie den Regel-Builder verwenden, um dies hinzuzufügen.

Um eine Regel hinzuzufügen, klicken Sie auf die Schaltfläche Regel hinzufügen und füllen Sie dann die unten beschriebenen Felder aus.

User-Agent

Geben Sie zuerst den User-Agenten in das Feld User Agent ein.

Wenn Sie beispielsweise den Google-Crawler angeben möchten, geben Sie „Googlebot“ in das Feld User Agent ein.

Wenn Sie eine Regel wünschen, die für alle User-Agents gilt, geben Sie * in das Feld User Agent ein.

Direktive

Wählen Sie als Nächstes den Regeltyp im Dropdown-Menü Directive aus. Es gibt vier Regeltypen, aus denen Sie auswählen können:

- Allow erlaubt Crawlern mit dem angegebenen User-Agent den Zugriff auf das Verzeichnis oder die Datei im Feld Value.

- Block blockiert Crawlern mit dem angegebenen User-Agent den Zugriff auf das Verzeichnis oder die Datei im Feld Value.

- Clean-param ermöglicht es Ihnen, Seiten mit URL-Parametern auszuschließen, die denselben Inhalt mit einer anderen URL liefern können. Yandex, die einzige Suchmaschine, die diese Direktive derzeit unterstützt, hat hier eine gute Erklärung mit Beispielen.

- Crawl-delay teilt Crawlern mit, wie häufig sie Ihre Inhalte abrufen dürfen. Ein Crawl-Delay von 10 bedeutet beispielsweise, dass Crawler Ihre Inhalte nicht öfter als alle 10 Sekunden abrufen sollen.

Derzeit wird diese Direktive nur von Bing, Yahoo und Yandex unterstützt. Sie können die Crawl-Rate von Googles Crawler in der Google Search Console ändern.

Wert

Geben Sie als Nächstes den Verzeichnispfad oder Dateinamen in das Feld Value ein.

Sie können einen Verzeichnispfad wie /wp-content/backups/ und Dateipfade wie /wp-content/backups/temp.png eingeben.

Sie können auch * als Platzhalter verwenden, z. B. /wp-content/backup-*.

Wenn Sie weitere Regeln hinzufügen möchten, klicken Sie auf die Schaltfläche Add Rule und wiederholen Sie die obigen Schritte.

Wenn Sie fertig sind, klicken Sie auf die Schaltfläche Save Changes.

Ihre Regeln werden im Abschnitt Custom Robots.txt Preview und in Ihrer robots.txt angezeigt, die Sie durch Klicken auf die Schaltfläche Open Robots.txt anzeigen können.

Regeln mit dem Regel-Builder bearbeiten

Um eine von Ihnen hinzugefügte Regel zu bearbeiten, ändern Sie einfach die Details im Regel-Builder und klicken Sie auf die Schaltfläche Save Changes.

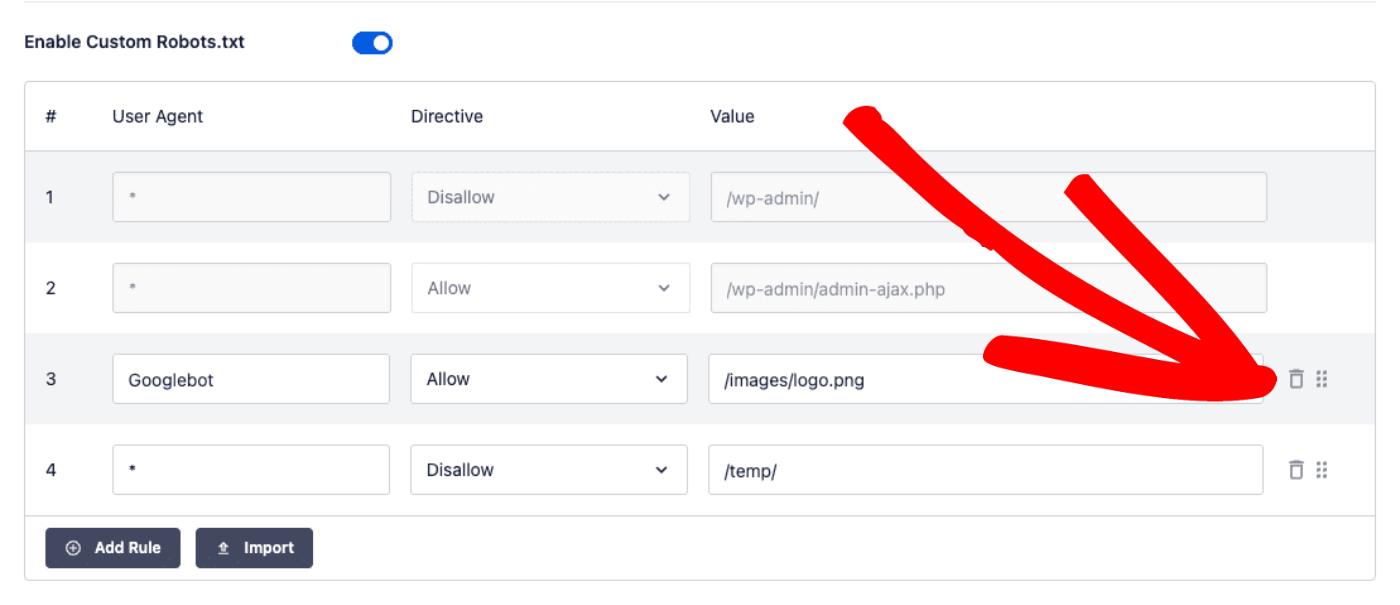

Eine Regel im Regel-Builder löschen

Um eine von Ihnen hinzugefügte Regel zu löschen, klicken Sie auf das Papierkorbsymbol rechts neben der Regel.

Ändern der Reihenfolge von Regeln im Regel-Builder

Sie können die Reihenfolge, in der Ihre benutzerdefinierten Regeln in Ihrer robots.txt erscheinen, einfach ändern, indem Sie die Einträge im Regel-Builder per Drag & Drop verschieben.

Klicken und halten Sie das Drag & Drop-Symbol rechts neben der Regel und verschieben Sie die Regel an die gewünschte Stelle, wie unten gezeigt.

Importieren Ihrer eigenen Robots.txt in All in One SEO

Sie können Ihre eigene robots.txt oder Regeln aus einer anderen Quelle sehr einfach importieren.

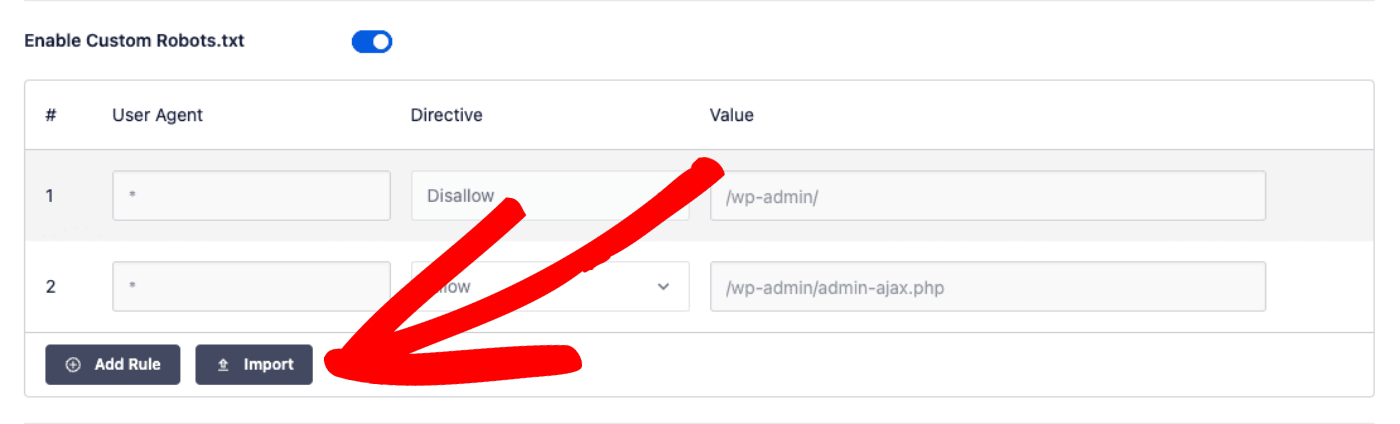

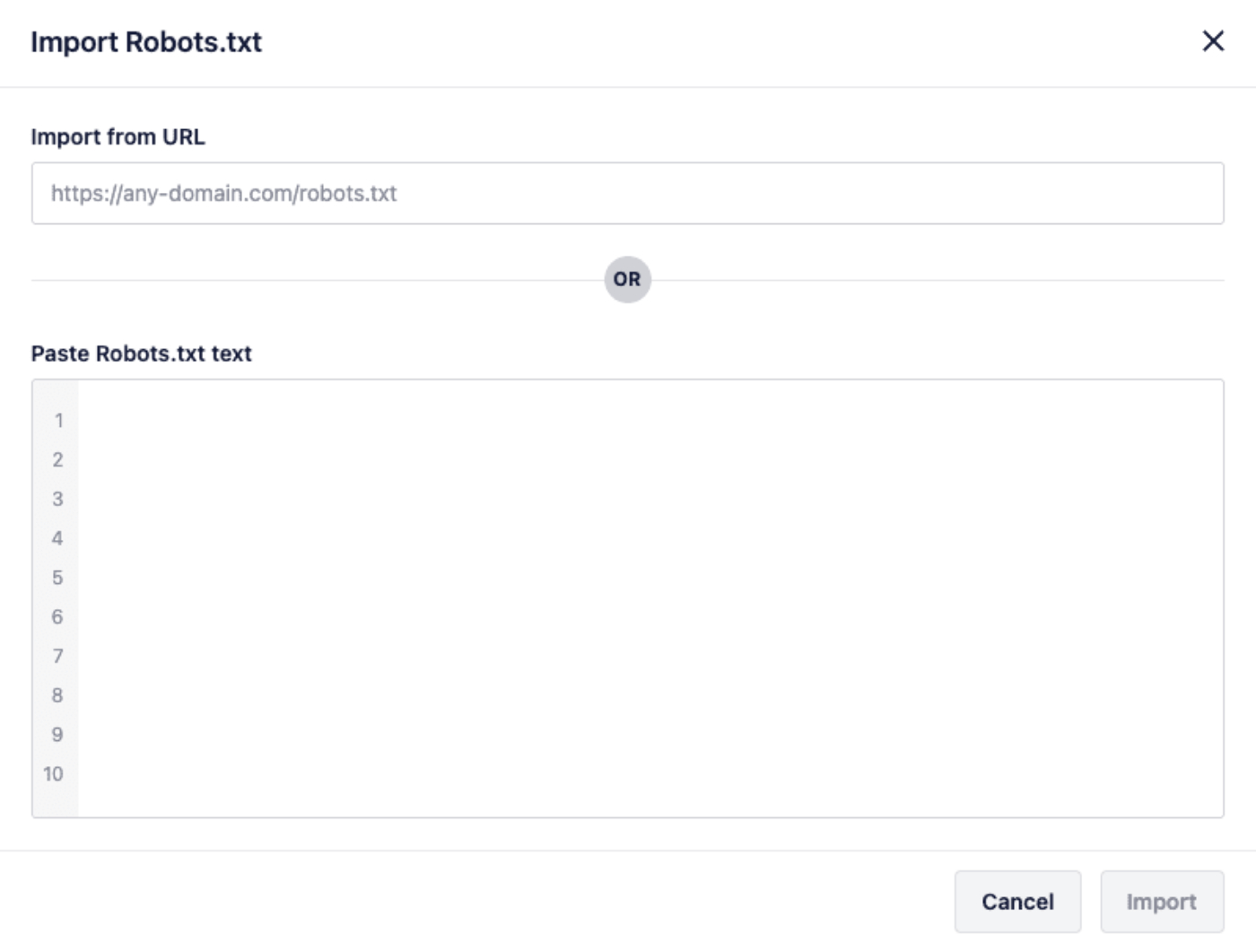

Klicken Sie zuerst auf die Schaltfläche Import, um das Fenster Import Robots.txt zu öffnen.

Im Fenster Import Robots.txt können Sie entweder aus einer URL importieren, indem Sie die URL einer robots.txt in das Feld Import from URL eingeben, oder Sie können den Inhalt einer robots.txt in das Feld Paste Robots.txt text einfügen.

Sobald Sie dies getan haben, klicken Sie auf die Schaltfläche Import.

Verwendung von erweiterten Regeln im Regel-Builder

Der Robots.txt Rule Builder unterstützt auch die Verwendung von erweiterten Regeln. Dazu gehören Regex-Muster sowie URL-Parameter.

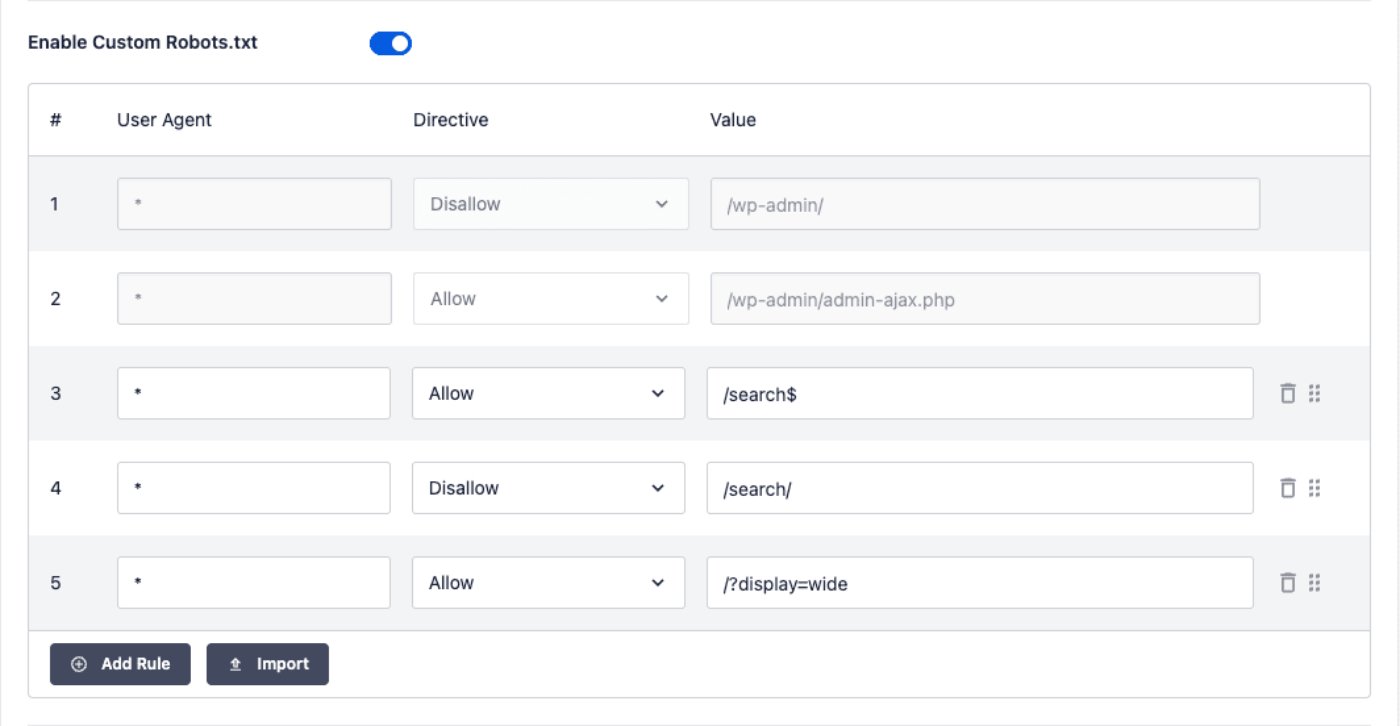

Hier sind drei Beispiele dafür, wie erweiterte Regeln verwendet werden können:

In den obigen Beispielen werden diese erweiterten Regeln gezeigt:

- /search$ – dies verwendet Regex, um den Zugriff auf den exakten Pfad „/search“ zu ermöglichen

- /search/ – dies blockiert den Zugriff auf Pfade, die mit „/search/“ beginnen, aber keine exakte Übereinstimmung sind

- /?display=wide – dies ermöglicht den Zugriff auf die Homepage mit dem übereinstimmenden URL-Parameter

Erweiterte Regeln wie diese ermöglichen eine granulare Steuerung Ihrer robots.txt-Datei, sodass Sie die vollständige Kontrolle darüber haben, wie User-Agents auf Ihre Website zugreifen.

Unerwünschte Crawler blockieren

Sie können „KI-Crawler blockieren“ verwenden, um Regeln zu Ihrer robots.txt hinzuzufügen, die bekannte Crawler wie KI-Crawler und Google AdsBot blockieren.

Sie können jeden der Crawler auswählen, um sie zu blockieren, oder Sie können Alle KI-Crawler auswählen, um alle aufgeführten zu blockieren.

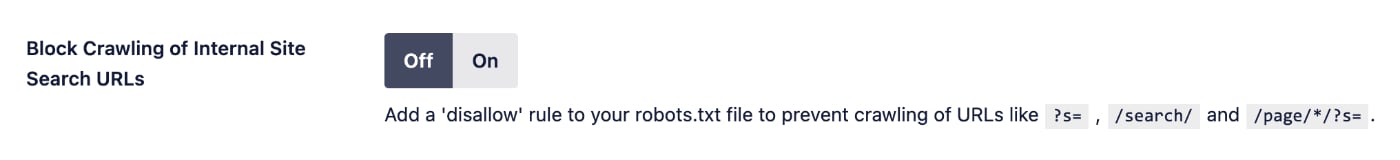

Crawling von internen Website-Such-URLs blockieren

Sie können die Einstellung „Crawling von internen Websuche-URLs blockieren“ verwenden, um Regeln zu Ihrer robots.txt hinzuzufügen, um das Crawling von Suchseiten-URLs zu verhindern. Dies reduziert unnötiges Crawling Ihrer Website.

Robots.txt-Editor für WordPress Multisite

Es gibt auch einen Robots.txt-Editor für Multisite-Netzwerke. Details finden Sie in unserer Dokumentation zum Robots.txt-Editor für Multisite-Netzwerke hier.