Möchten Sie die Chancen erhöhen, dass Ihre Inhalte richtig gecrawlt und indexiert werden?

Dann werden Sie genauso begeistert sein wie wir von unserem neuesten Plugin-Update!

Wir haben Ihr Feedback berücksichtigt und unserem robots.txt-Editor mehr Leistung und Funktionalität verliehen.

In diesem Artikel

Clean-param: Reduzieren Sie unnötige Crawls

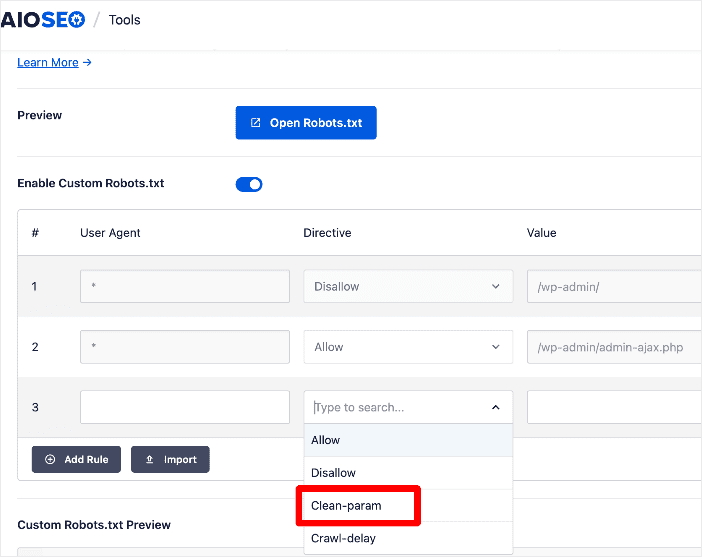

Eine der neuen Crawl-Direktiven, die wir unserem robots.txt-Editor hinzugefügt haben, ist die Clean-param-Direktive.

Diese leistungsstarke Direktive weist Suchbots an, URL-Parameter wie GET-Parameter (z. B. Sitzungs-IDs) und Tags (UTMs) zu ignorieren. Diese können zu vielen Problemen für Ihre SEO führen, darunter:

- Probleme mit doppeltem Inhalt

- Verschwendetes Crawl-Budget

- Indexierungsprobleme

Diese Faktoren führen dazu, dass Suchmaschinen länger brauchen, um wichtige Seiten auf Ihrer Website zu erreichen und zu crawlen.

Clean-param ist eine leistungsstarke Funktion, die Ihnen eine feinere Kontrolle darüber gibt, wie Suchmaschinen Ihre Website crawlen. Infolgedessen erhöhen Sie die Chancen, dass die richtigen Seiten in Suchmaschinen gut ranken.

Hinweis: Clean-param wird derzeit nur von Yandex unterstützt.

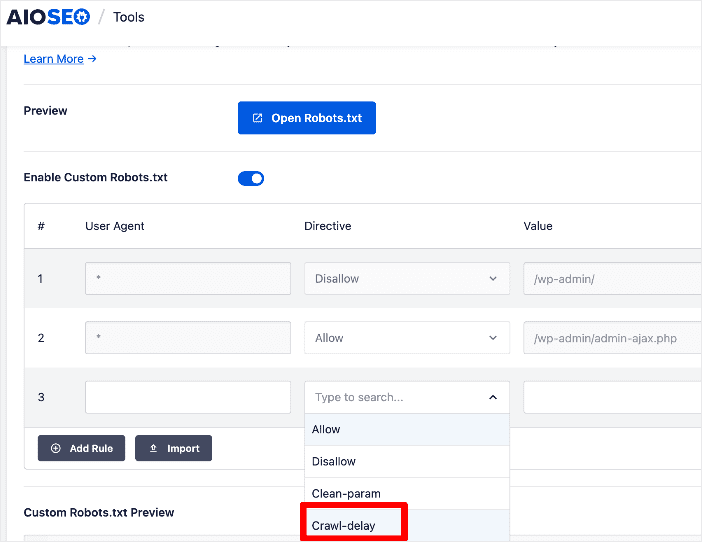

Crawl-delay: Regulieren Sie die Crawling-Frequenz

Eine weitere neue Direktive in unserem robots.txt-Editor ist die Crawl-delay-Direktive.

Crawl-delay ist eine Direktive, die in der robots.txt-Datei verwendet wird, um Suchmaschinen-Bots anzuweisen, mit welcher Rate sie Ihre Website abrufen und crawlen sollen. Diese Direktive ist besonders nützlich, wenn Sie die Häufigkeit von Bot-Besuchen steuern möchten, um eine Überlastung Ihres Servers zu vermeiden, insbesondere wenn Sie über begrenzte Serverressourcen oder hohen Traffic verfügen. Dies kann die Leistung Ihrer Website beeinträchtigen oder sie in einigen extremen Fällen unzugänglich machen.

Das Hinzufügen der Crawl-Delay-Direktive kann Ihnen helfen, eine Überlastung Ihres Servers während Zeiten mit hohem Traffic zu vermeiden.

Hinweis: Crawl-delay wird nur von Bing, Yahoo und Yandex unterstützt.

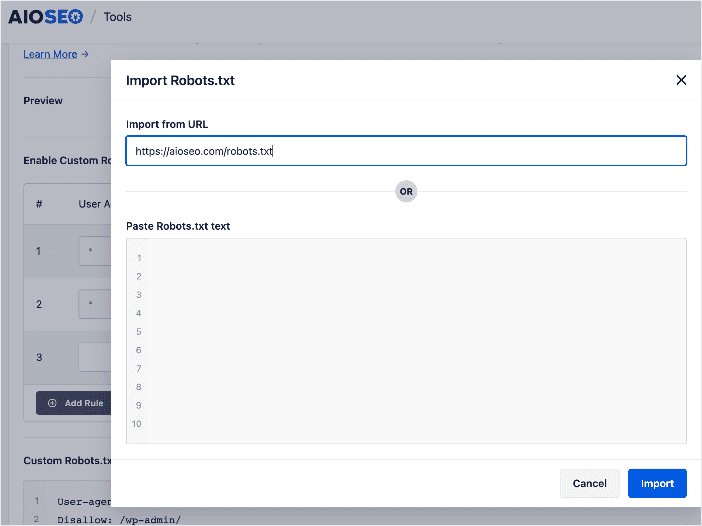

Importieren Sie Robots.txt-Regeln von jeder Website

Wenn Sie eine neue Website einrichten und eine grundlegende robots.txt-Datei implementieren möchten, können Sie Zeit und Mühe sparen, indem Sie einfach die Regeln einer vorhandenen Website als Ausgangspunkt verwenden.

Um Ihnen dabei zu helfen, haben wir unserem robots.txt-Editor eine Import-Funktion hinzugefügt.

Sie können diese Funktion verwenden, um eine robots.txt-Datei von einer Website zu importieren, indem Sie die URL eingeben oder die Website besuchen und dann die robots.txt-Datei kopieren und einfügen.

Wenn Sie an einer Website arbeiten, die einer anderen ähnelt, stellen Sie möglicherweise fest, dass diese nützliche Regeln implementiert haben, die auch für Ihre Website gelten. Dies kann Ihnen Zeit bei der Erstellung Ihrer eigenen Regeln sparen. Es kann Ihnen auch helfen, Fehler zu vermeiden, wenn Sie noch neu bei der Bearbeitung von robots.txt-Dateien sind.

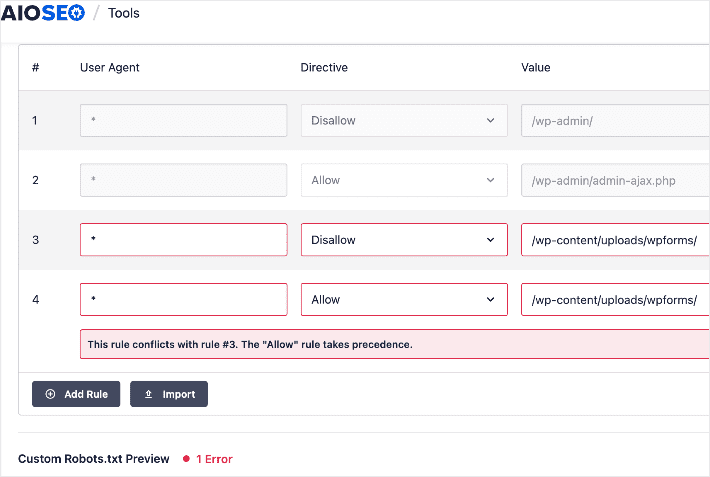

Verbesserte Regelvalidierung und Fehlerbehandlung

Neben den leistungsstarken Direktiven und der Importfunktion haben wir auch die Regelvalidierung und Fehlerbehandlung in unserem robots.txt-Editor verbessert. Dies hilft Ihnen, widersprüchliche Regeln oder andere Fehler in Ihrer robots.txt schnell zu erkennen.

Sie können die fehlerhafte Regel einfach löschen, indem Sie auf das Papierkorbsymbol daneben klicken.

Mit diesen neuesten Ergänzungen zu unserem Plugin ist es jetzt einfacher geworden, Ihre Crawlbarkeit und Indexierbarkeit zu verbessern. Infolgedessen haben Ihre Website und Ihre Inhalte eine bessere Chance, in den Suchergebnissen von Suchmaschinen hoch zu ranken.

Wir haben auch zusätzliche erweiterte Funktionen in unserem robots.txt-Editor hinzugefügt. Lesen Sie diese Dokumentation für weitere Details.

Neben diesem bedeutenden Update haben wir mehrere bemerkenswerte Verbesserungen an vielen Funktionen vorgenommen, die Sie lieben. Alle unsere Änderungen finden Sie in unserem vollständigen Produkt-Changelog.

Worauf warten Sie noch?

Aktualisieren Sie Ihre Website auf AIOSEO 4.4.4, um diese leistungsstarken neuen Funktionen freizuschalten und Ihre Inhalte auf SERPs höher zu ranken.

Und wenn Sie AIOSEO noch nicht verwenden, stellen Sie sicher, dass Sie das Plugin noch heute installieren und aktivieren.

Wenn Sie Fragen zu diesen Funktionen haben, kommentieren Sie bitte unten oder kontaktieren Sie unseren Kundensupport. Wir sind immer bereit zu helfen. Unser Engagement, AIOSEO zum einfachsten und besten WordPress-SEO-Plugin zu machen, wird immer stärker, während wir gemeinsam mit unseren Kunden weiter erfolgreich sind.

Wir sind Ihnen für Ihre anhaltende Unterstützung, Ihr Feedback und Ihre Vorschläge sehr dankbar. Bitte reichen Sie weiterhin Ihre Vorschläge und Funktionswünsche ein!

Wir hoffen, dass Ihnen die Nutzung dieser neuen SEO-Funktionen genauso viel Freude bereitet, wie uns die Erstellung.

- Benjamin Rojas (Präsident von AIOSEO).

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.

Könnte für technisch mittelbegabte immer noch einfacher sein. Ich weiß nach 2 Jahren immer noch nicht ganz, ob ich alle Funktionen nutze/richtig nutze.

Danke für den Beitrag zu diesem Thema. Kunden fragen immer, wie das Crawling optimiert werden kann!

Prost auf gute Inhalte 🙂

Welche Einstellungen sollten wir für bestes SEO verwenden?