Nr. 1 WordPress Robots.txt Generator & Editor

Steuern Sie, wie Suchmaschinen Ihre Website crawlen, ohne Code

Schluss mit dem Kampf mit robots.txt-Regeln. AIOSEOs Robot.txt-Editor hilft Ihnen, Suchmaschinen-Crawler mühelos zu steuern, Indexierungsfehler zu vermeiden und sensible Inhalte zu schützen.

Visueller

Editor

Regel

Validierung

Crawl-

Kontrolle

Fehler-

Vermeidung

Schnell

Importieren

Sofortige

Aktualisierungen

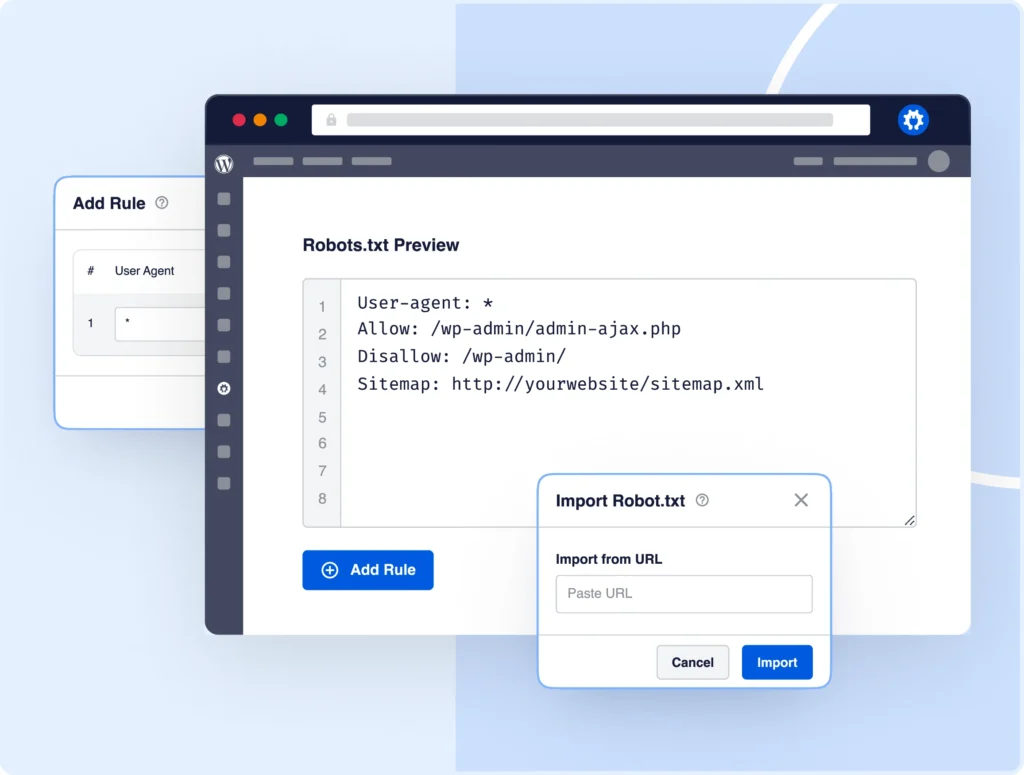

Komplexe Crawler-Regeln mit visueller Bearbeitung vereinfachen

Erstellen und verwalten Sie Ihre WordPress robots.txt-Datei, ohne Code anzufassen. Unser visueller Editor hilft Ihnen, den Zugriff von Suchmaschinen zu steuern und kostspielige Fehler zu vermeiden.

Visueller Robots.txt-Editor

Erstellen und ändern Sie Crawler-Regeln mit einer intuitiven Oberfläche. Vereinfacht komplexe technische SEO-Aufgaben.

Sofortige Regelvalidierung

Erkennen Sie potenzielle Fehler, bevor sie Ihre Website beeinträchtigen. Unser Validator stellt sicher, dass Ihre Regeln genau wie beabsichtigt funktionieren.

Kontrolle über geschützte Inhalte

Verhindern Sie einfach, dass Suchmaschinen auf sensible Bereiche Ihrer Website zugreifen, während wichtige Inhalte indiziert bleiben.

Multisite-Unterstützung

Verwalten Sie robots.txt-Dateien in Ihrem gesamten WordPress-Netzwerk von einem zentralen Dashboard aus.

Crawl-Rate-Kontrolle

Optimieren Sie, wie Suchmaschinen Ihre Website crawlen, um eine Serverüberlastung zu vermeiden und gleichzeitig eine ordnungsgemäße Indexierung sicherzustellen.

1-Klick-Updates

Wenden Sie robots.txt-Änderungen sofort ohne FTP oder Dateibearbeitung an. Perfekt für die schnelle Crawler-Verwaltung.

Der leistungsstärkste Robots.txt-Editor für WordPress

Übernehmen Sie die Kontrolle über das Crawling und die Indexierung Ihrer Website… worauf warten Sie noch?

Warum über 3 Mio. Websites AIOSEOs Robots.txt-Editor vertrauen ❤

AIOSEOs Robots.txt-Editor ist die vertrauenswürdigste Lösung zur Steuerung des Suchmaschinen-Zugriffs auf WordPress-Websites. Hier erfahren Sie, warum Website-Besitzer und SEO-Experten unseren Editor wählen, um sensible Inhalte zu schützen und gleichzeitig Crawl-Budgets zu optimieren.

VISUELLE OBERFLÄCHE

Robots.txt ohne Code bearbeiten

Hören Sie auf, sich mit komplizierter robots.txt-Syntax und potenziellen SEO-Fehlern herumzuschlagen. Unser visueller Editor wandelt komplexe Anweisungen in einfache Point-and-Click-Steuerelemente um, die jeder verwenden kann.

Mit Echtzeit-Validierung und intelligenten Vorschlägen können Sie den Crawler-Zugriff vertrauensvoll verwalten, ohne eine einzige Codezeile anzufassen.

CRAWLER-SCHUTZ

Halten Sie sensible Daten von Suchmaschinen fern

Riskieren Sie nicht, sensible Inhalte für Suchmaschinen preiszugeben. Unser intelligentes Pfad-Erkennungssystem hilft Ihnen, private Bereiche Ihrer Website mit wenigen Klicks zu identifizieren und zu schützen.

Fortschrittliche Mustererkennung und Verzeichnis-Scans sorgen für eine vollständige Abdeckung, während unser Validierungssystem die versehentliche Offenlegung geschützter Inhalte verhindert.

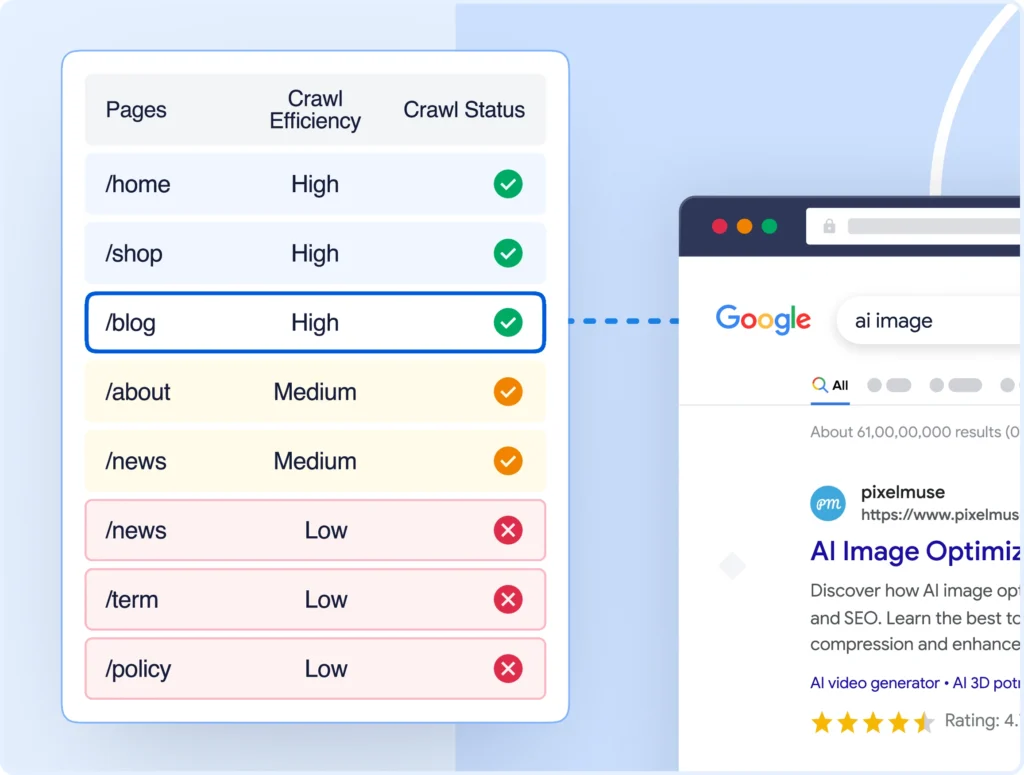

CRAWL-OPTIMIERUNG

Maximieren Sie Ihr Crawl-Budget

Verschwenden Sie kein wertvolles Crawl-Budget mehr für unwichtige Seiten. Unser intelligenter Crawl-Analysator hilft Ihnen, Ihre wertvollsten Inhalte für Suchmaschinen zu identifizieren und zu priorisieren.

Integrierte Crawl-Effizienz-Tools zeigen Ihnen genau, wie Suchmaschinen mit Ihrer Website interagieren, und helfen Ihnen, Indexierungsmuster für bessere SEO-Ergebnisse zu optimieren.

FEHLERVERMEIDUNG

Brechen Sie Ihre SEO nie wieder

Herkömmliche robots.txt-Editoren können kostspielige SEO-Fehler nicht verhindern. Unser Validierungssystem fängt Fehler ab, bevor sie auftreten, und stellt sicher, dass Ihre Anweisungen immer syntaktisch korrekt und logisch einwandfrei sind.

Echtzeit-Tests bieten ein Sicherheitsnetz, mit dem Sie zuversichtlich experimentieren können, in dem Wissen, dass Sie immer eine funktionierende Version wiederherstellen können.

PFAD-VERWALTUNG

Erstellen Sie sofort perfekte Crawler-Pfade

Das Erstellen präziser Crawler-Pfade sollte keine RegEx-Expertise erfordern. Unser Builder ermöglicht es Ihnen, Muster über eine intuitive Oberfläche zu erstellen, die die gesamte komplexe Syntax für Sie übernimmt.

Der Robots.txt-Editor macht es einfach, genau anzugeben, auf welche Inhalte Suchmaschinen zugreifen sollen.

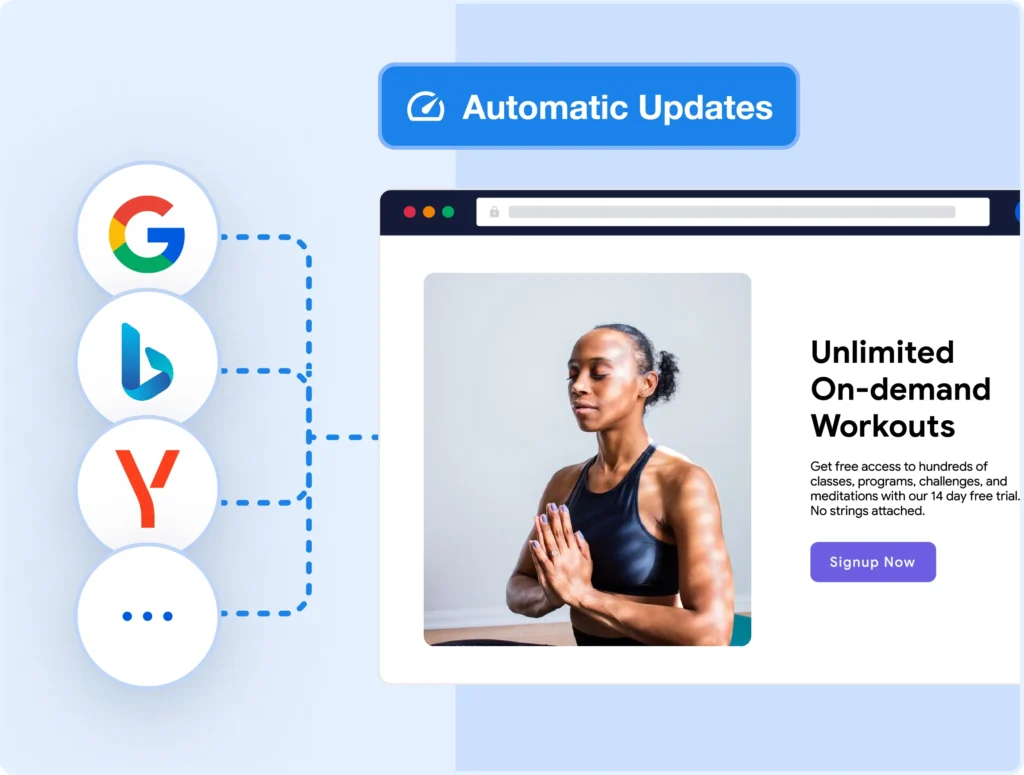

AUTOMATISCHE UPDATES

Bleiben Sie über Änderungen von Suchmaschinen auf dem Laufenden

Suchmaschinen entwickeln ihr Crawler-Verhalten ständig weiter. Unser System wird automatisch aktualisiert, um neue User-Agent-Strings und Crawler-Anweisungen zu unterstützen, sobald sie veröffentlicht werden.

AIOSEO stellt sicher, dass Ihre robots.txt-Datei immer den aktuellen Best Practices aller wichtigen Suchmaschinen entspricht.

Und Sie müssen uns nicht nur beim Wort nehmen…

Das sagen unsere Benutzer

Dieses SEO-Plugin ist fantastisch! Nach der Installation hat sich das Ranking meiner Website verbessert und meine Seiten werden viel schneller indexiert.

Egal, ob Sie Anfänger oder SEO-Experte sind, AIOSEO ist eine Revolution. Es hält alle meine Websites ohne Aufwand optimiert.

Ich bin mit dem Produkt zufrieden, aber noch mehr bin ich mit dem exzellenten und schnellen Support des Teams zufrieden!

Robots.txt ist ein Teil einer starken SEO-Strategie. Entfesseln Sie das volle Potenzial Ihrer Website mit All in One SEO.

AIOSEO ist vollgepackt mit leistungsstarken Funktionen, um Ihre Rankings auf ganzer Linie zu verbessern. Hier ist eine Vorschau auf das, was Sie mit unserem Robots.txt-Generator noch erhalten können.

Das beste All-in-One-SEO-Plugin für WordPress

Beginnen Sie noch heute damit, mehr Traffic zu generieren und Suchergebnisse zu dominieren!

FAQs zu AIOSEOs Robots.txt-Editor

Erhalten Sie schnelle Antworten zur Verwaltung Ihrer WordPress robots.txt-Datei mit All in One SEO. Wenn Ihre Frage hier nicht aufgeführt ist, kontaktieren Sie uns bitte.

Eine robots.txt-Datei teilt Suchmaschinen mit, welche Teile Ihrer Website sie aufrufen dürfen und welche nicht. Sie ist entscheidend für die Steuerung des Crawlings Ihrer Website und den Schutz sensibler Inhalte.

Nein! Unser visueller Editor macht technisches Wissen überflüssig. Erstellen und ändern Sie Regeln mit einfachen Point-and-Click-Steuerelementen – keine Programmierung erforderlich.

AIOSEO validiert Ihre robots.txt-Regeln automatisch in Echtzeit und stellt sicher, dass sie korrekt formatiert sind und wie beabsichtigt funktionieren. Dies verhindert häufige Fehler, die die Indexierung Ihrer Website beeinträchtigen könnten.

Ja! Wenn Sie ein WordPress Multisite-Netzwerk betreiben, können Sie die robots.txt-Dateien für alle Ihre Websites von einem zentralen Dashboard aus verwalten.

Weitere Informationen finden Sie unter: Robots.txt-Editor für Multisite-Netzwerke.

Absolut! Erstellen Sie spezifische Regeln für verschiedene Suchmaschinen, um präzise zu steuern, welche Crawler auf Ihre Inhalte zugreifen können.

Ja! AIOSEO erkennt automatisch Ihre vorhandenen robots.txt-Regeln und importiert sie in den visuellen Editor zur einfachen Verwaltung.

Keine Sorge! Unser Validierungssystem erkennt Fehler, bevor sie live gehen, und Sie können Änderungen bei Bedarf einfach rückgängig machen. Das Crawling Ihrer Website bleibt geschützt.