Puede ver nuestro vídeo sobre cómo usar All in One SEO en Redes WordPress Multisitio aquí.

Si tiene una Red WordPress Multisitio, puede gestionar reglas globales de robots.txt que se aplicarán a todos los sitios de la red.

IMPORTANTE:

Esta función actualmente solo funciona para Redes WordPress Multisitio configuradas como subdominios. No funciona para las configuradas como subdirectorios.

En este artículo

- Vídeo tutorial

- Reglas predeterminadas de Robots.txt en WordPress

- Añadir reglas usando el constructor de reglas

- Edición de reglas usando el constructor de reglas

- Eliminación de una regla en el constructor de reglas

- Bloqueo de rastreadores no deseados

- Bloquear el rastreo de URLs de búsqueda interna del sitio

- Gestión de Robots.txt para Subsitios

Vídeo tutorial

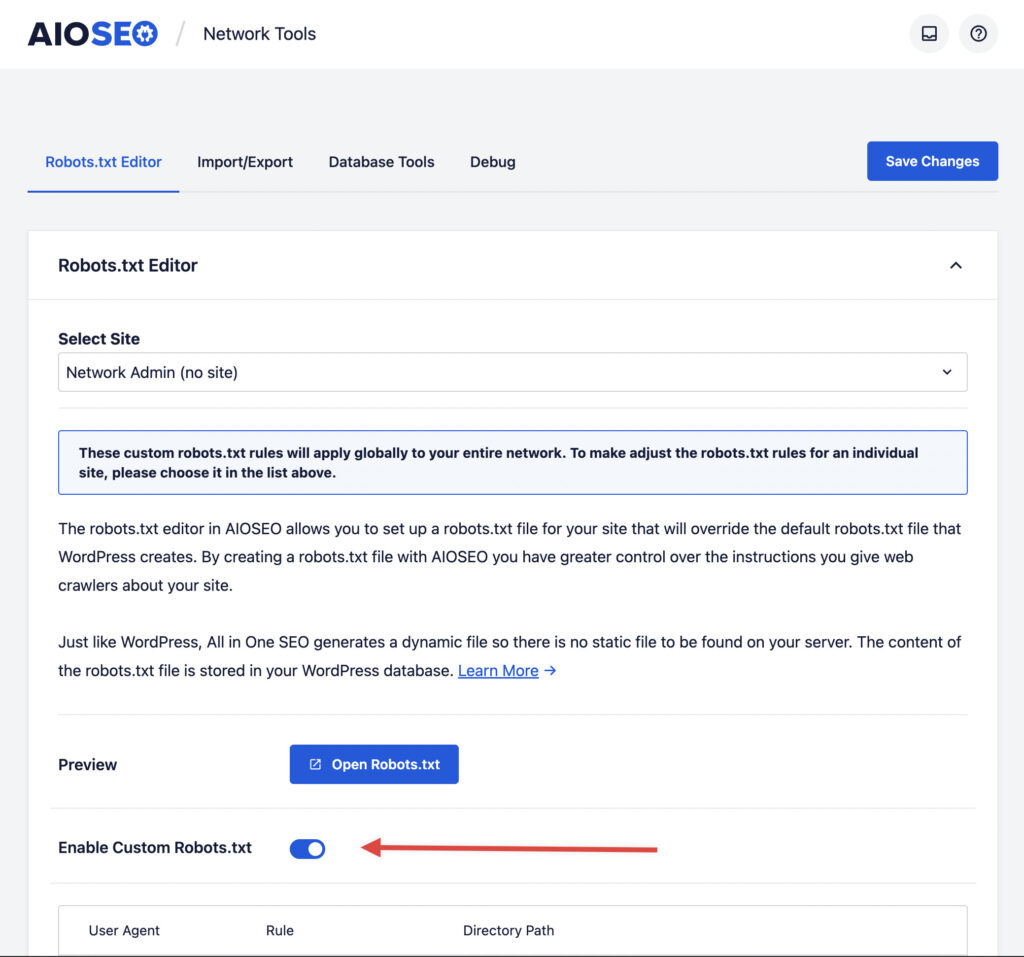

Para empezar, vaya a Administración de la Red y luego haga clic en All in One SEO > Herramientas de Red en el menú de la izquierda.

Verá nuestro Editor de Robots.txt estándar donde puede habilitar y gestionar reglas personalizadas para su robots.txt.

Haga clic en el interruptor Habilitar Robots.txt Personalizado para activar el editor de reglas.

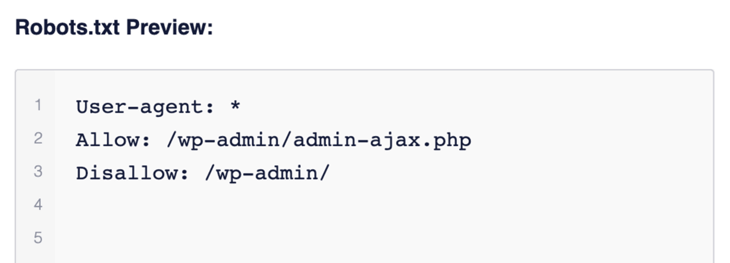

Debería ver la sección Vista previa de Robots.txt en la parte inferior de la pantalla, que muestra las reglas predeterminadas añadidas por WordPress.

Reglas predeterminadas de Robots.txt en WordPress

Las reglas predeterminadas que se muestran en la sección Vista previa de Robots.txt (mostrada en la captura de pantalla anterior) piden a los robots que no rastreen sus archivos principales de WordPress. Es innecesario que los motores de búsqueda accedan a estos archivos directamente porque no contienen ningún contenido relevante del sitio.

Si por alguna razón desea eliminar las reglas predeterminadas que añade WordPress, necesitará usar el hook de filtro robots_txt en WordPress.

Añadir reglas usando el constructor de reglas

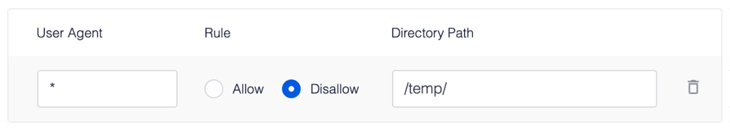

El constructor de reglas se utiliza para añadir tus propias reglas personalizadas para rutas específicas en tu sitio.

Por ejemplo, si deseas añadir una regla para bloquear todos los robots de un directorio temporal, puedes usar el constructor de reglas para añadirla.

Para añadir una regla, introduzca el agente de usuario en el campo Agente de Usuario. Usar * aplicará la regla a todos los agentes de usuario.

A continuación, seleccione Permitir o Denegar para permitir o bloquear el agente de usuario.

A continuación, introduzca la ruta del directorio o el nombre del archivo en el campo Ruta del Directorio.

Finalmente, haga clic en el botón Guardar Cambios.

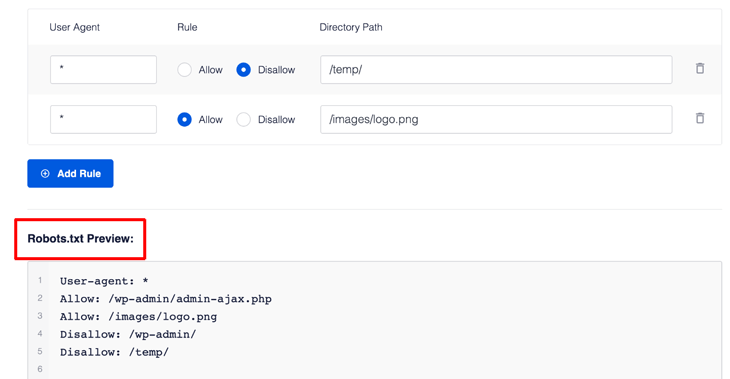

Si desea añadir más reglas, haga clic en el botón Añadir Regla y repita los pasos anteriores y haga clic en el botón Guardar Cambios.

Sus reglas aparecerán en la sección Vista previa de Robots.txt y en su robots.txt, que puede ver haciendo clic en el botón Abrir Robots.txt.

Cualquier regla que añada aquí se aplicará a todos los sitios de su red y no podrá ser anulada a nivel de sitio individual.

Edición de reglas usando el constructor de reglas

Para editar cualquier regla que haya añadido, simplemente cambie los detalles en el constructor de reglas y haga clic en el botón Guardar Cambios.

Eliminación de una regla en el constructor de reglas

Para eliminar una regla que haya añadido, haga clic en el icono de la papelera a la derecha de la regla.

Bloqueo de rastreadores no deseados

Puedes usar Bloquear Rastreadores de IA para agregar reglas a tu robots.txt que bloqueen rastreadores conocidos como rastreadores de IA y Google AdsBot.

Puedes seleccionar cada uno de los rastreadores para bloquearlos, o puedes seleccionar Todos los Rastreadores de IA para bloquear a todos los listados.

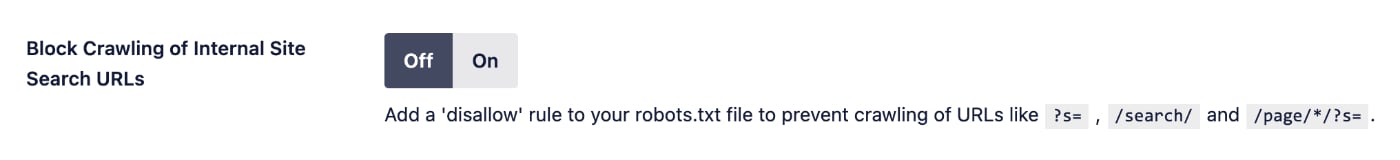

Bloquear el rastreo de URLs de búsqueda interna del sitio

Puedes usar la configuración Bloquear Rastreo de URLs de Búsqueda Interna del Sitio para agregar reglas a tu robots.txt para evitar el rastreo de URLs de páginas de búsqueda. Esto reduce el rastreo innecesario de tu sitio.

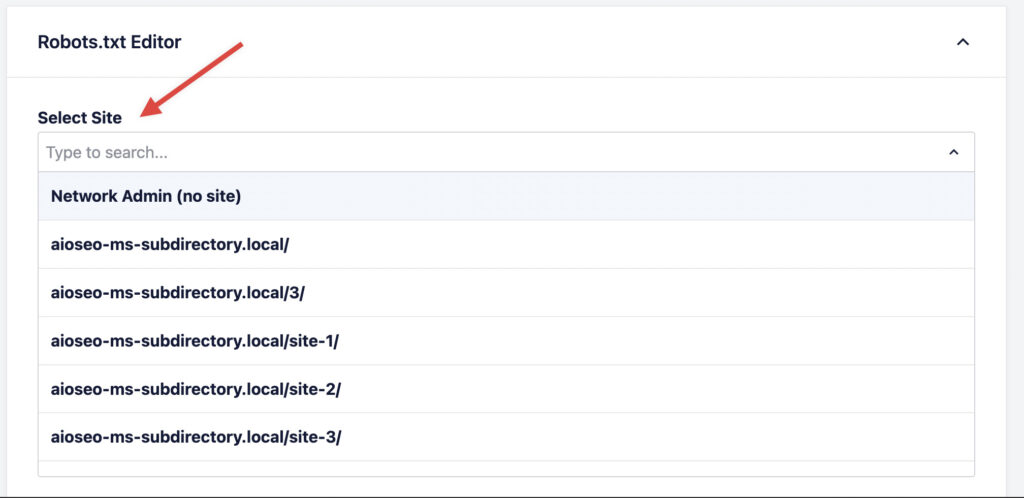

Gestión de Robots.txt para Subsitios

En el Editor de Robots.txt multisitio, es muy fácil editar reglas de robots para cualquier sitio de su red.

Para empezar, simplemente haga clic en el menú desplegable selector de sitios en la parte superior del Editor de Robots.txt. Desde allí, seleccione el sitio para el que desea editar las reglas, o búsquelo escribiendo el dominio:

Una vez que haya seleccionado un sitio, las reglas a continuación se actualizarán automáticamente y podrá modificar/cambiar las reglas solo para ese sitio. Asegúrese de hacer clic en Guardar cambios después de modificar las reglas para el sub sitio.