¿Buscas personalizar el robots.txt de tu sitio? Este artículo te ayudará.

El módulo robots.txt en All in One SEO te permite gestionar el robots.txt que WordPress crea.

Esto te permite tener un mayor control sobre las instrucciones que das a los rastreadores web sobre tu sitio.

En este artículo

- Vídeo tutorial

- Acerca de Robots.txt en WordPress

- Uso del editor Robots.txt en All in One SEO

- Reglas predeterminadas de Robots.txt en WordPress

- Adding Rules Using the Rule Builder

- Edición de reglas usando el constructor de reglas

- Eliminación de una regla en el constructor de reglas

- Cambio del orden de las reglas en el constructor de reglas

- Importación de tu propio Robots.txt en All in One SEO

- Uso de reglas avanzadas en el constructor de reglas

- Bloqueo de rastreadores no deseados

- Bloquear el rastreo de URLs de búsqueda interna del sitio

- Editor Robots.txt para WordPress Multisite

Vídeo tutorial

Aquí tienes un vídeo sobre cómo usar la herramienta Robots.txt en All in One SEO:

Acerca de Robots.txt en WordPress

En primer lugar, es importante entender que WordPress genera un robots.txt dinámico para cada sitio de WordPress.

Este robots.txt predeterminado contiene las reglas estándar para cualquier sitio que funcione con WordPress.

En segundo lugar, dado que WordPress genera un robots.txt dinámico, no hay un archivo estático que encontrar en tu servidor. El contenido del robots.txt se almacena en tu base de datos de WordPress y se muestra en un navegador web. Esto es perfectamente normal y es mucho mejor que usar un archivo físico en tu servidor.

Por último, All in One SEO no genera un robots.txt, solo te proporciona una forma muy sencilla de añadir reglas personalizadas al robots.txt predeterminado que genera WordPress.

NOTA:

Aunque el robots.txt generado por WordPress es una página generada dinámicamente y no un archivo de texto estático en tu servidor, se debe tener cuidado al crear un robots.txt grande por dos razones:

- Un robots.txt grande indica un conjunto de reglas potencialmente complejo que podría ser difícil de mantener

- Google ha propuesto un tamaño máximo de archivo de 512 KB para aliviar la carga en los servidores por tiempos de conexión largos.

Uso del editor Robots.txt en All in One SEO

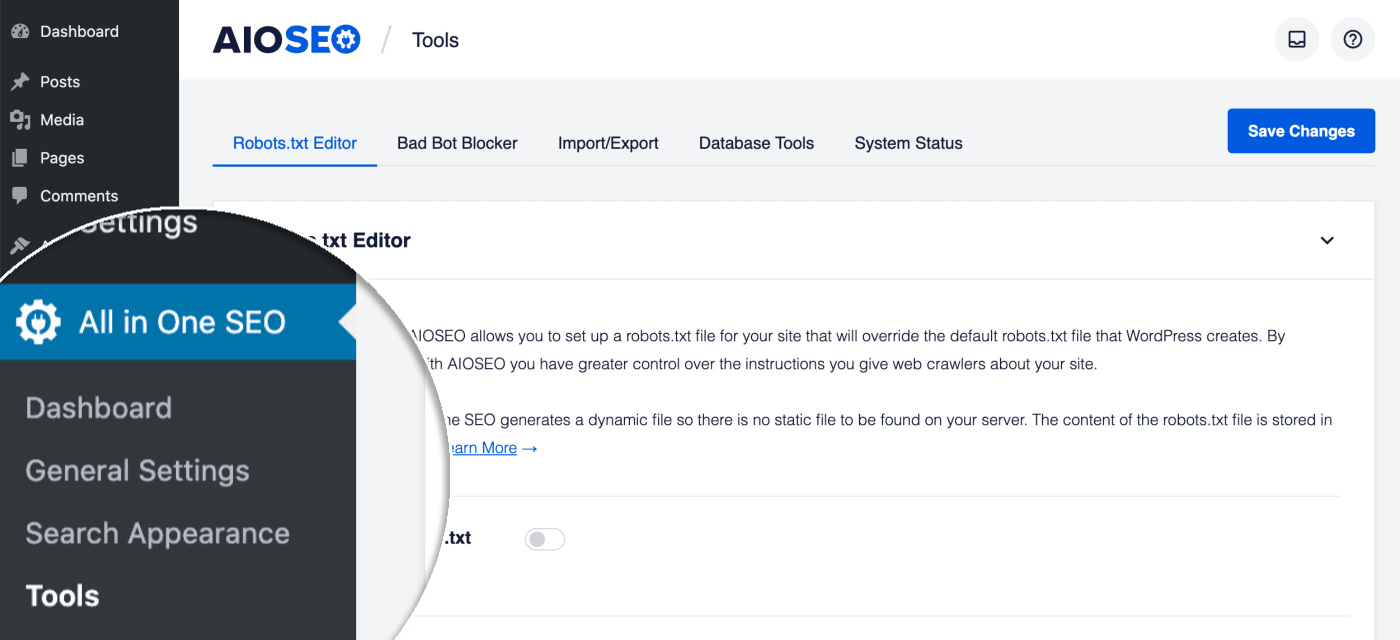

Para empezar, haz clic en Herramientas en el menú de All in One SEO.

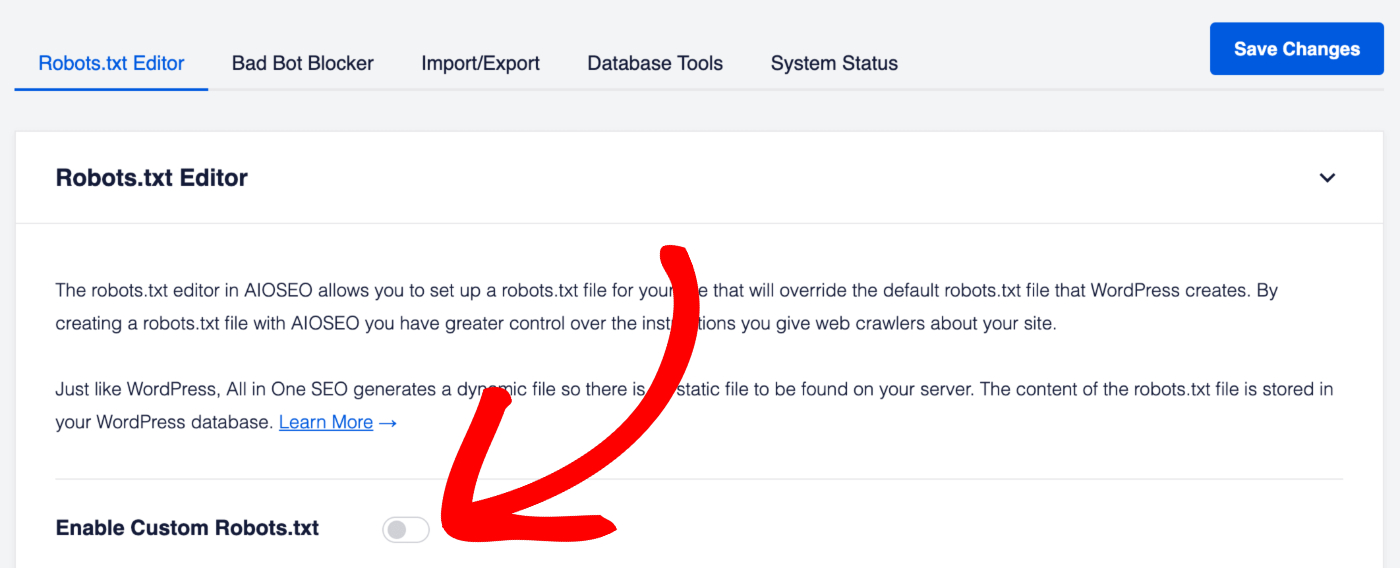

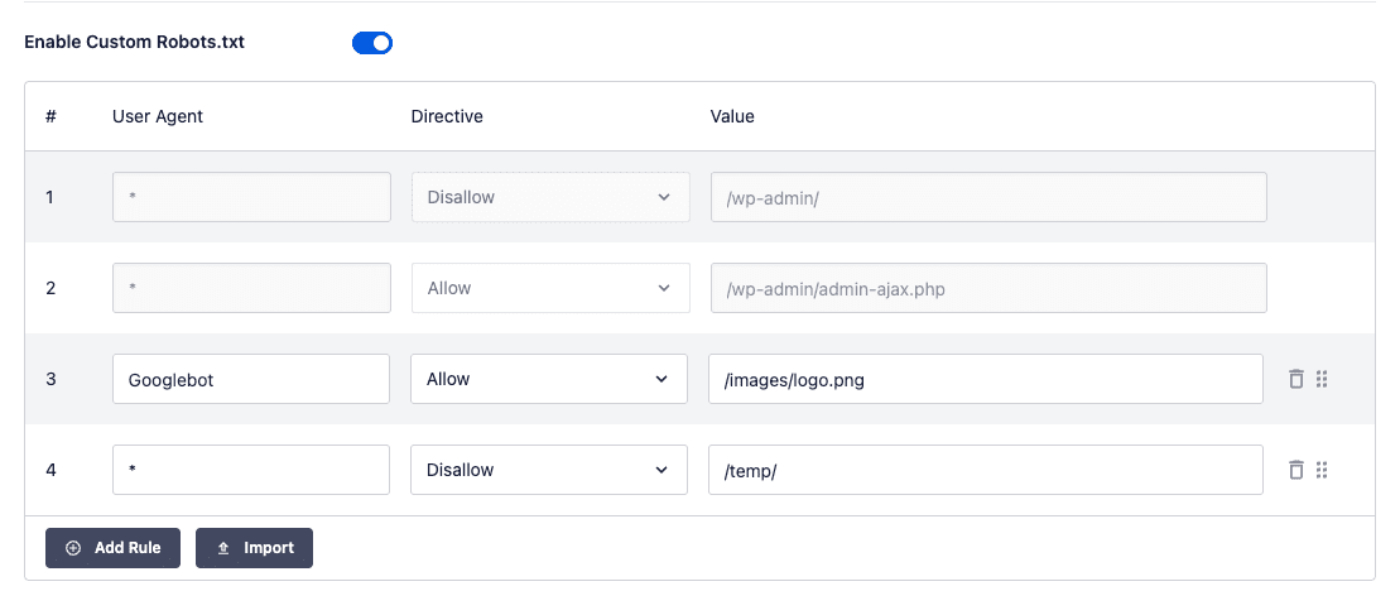

Deberías ver el Editor de Robots.txt y el primer ajuste será Habilitar Robots.txt Personalizado. Haz clic en el interruptor para habilitar el editor de robots.txt personalizado.

IMPORTANTE:

No necesitas habilitar el Robots.txt Personalizado a menos que tengas una razón específica para añadir una regla personalizada.

El robots.txt predeterminado que genera WordPress es perfecto para el 99% de todos los sitios. La función de Robots.txt Personalizado es para aquellos usuarios que necesitan reglas personalizadas.

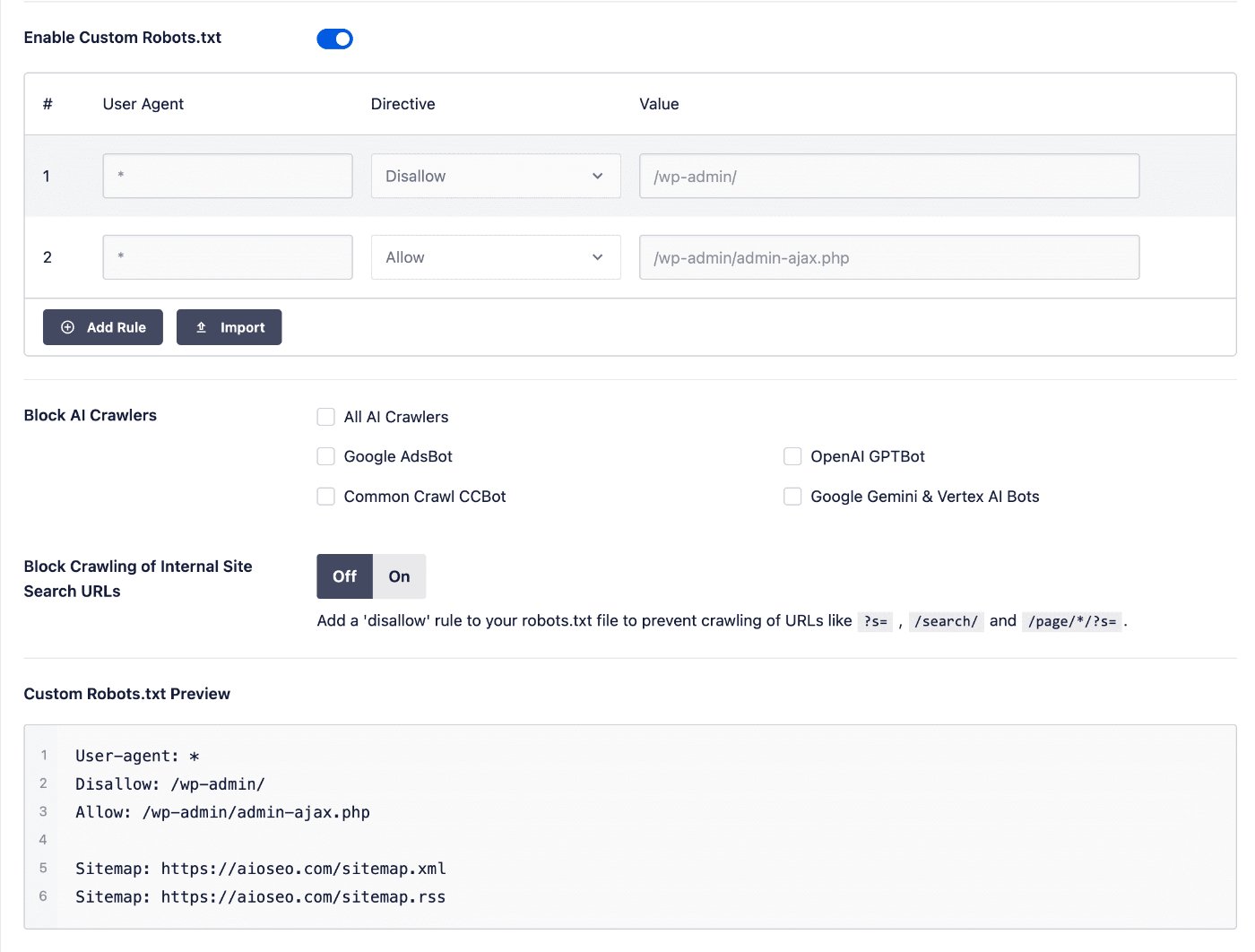

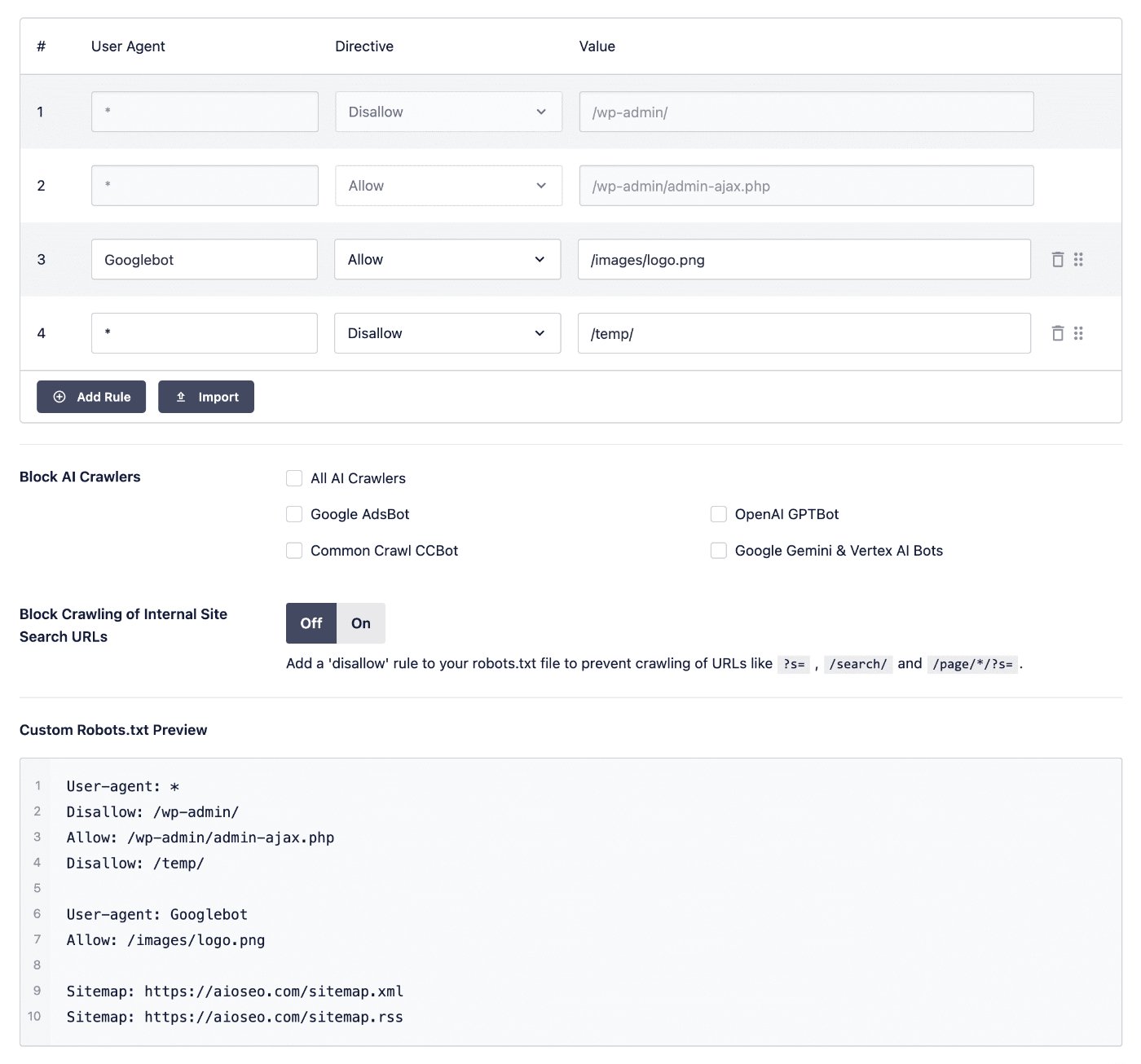

Deberías ver la sección Vista previa personalizada de robots.txt en la parte inferior de la pantalla, que muestra las reglas predeterminadas añadidas por WordPress.

Reglas predeterminadas de Robots.txt en WordPress

Las reglas predeterminadas que se muestran en la sección Vista previa personalizada de robots.txt (mostrada en la captura de pantalla anterior) piden a los robots que no rastreen tus archivos principales de WordPress. Es innecesario que los motores de búsqueda accedan a estos archivos directamente porque no contienen ningún contenido relevante del sitio.

Si por alguna razón deseas eliminar las reglas predeterminadas que añade WordPress, necesitarás usar el hook de filtro robots_txt en WordPress.

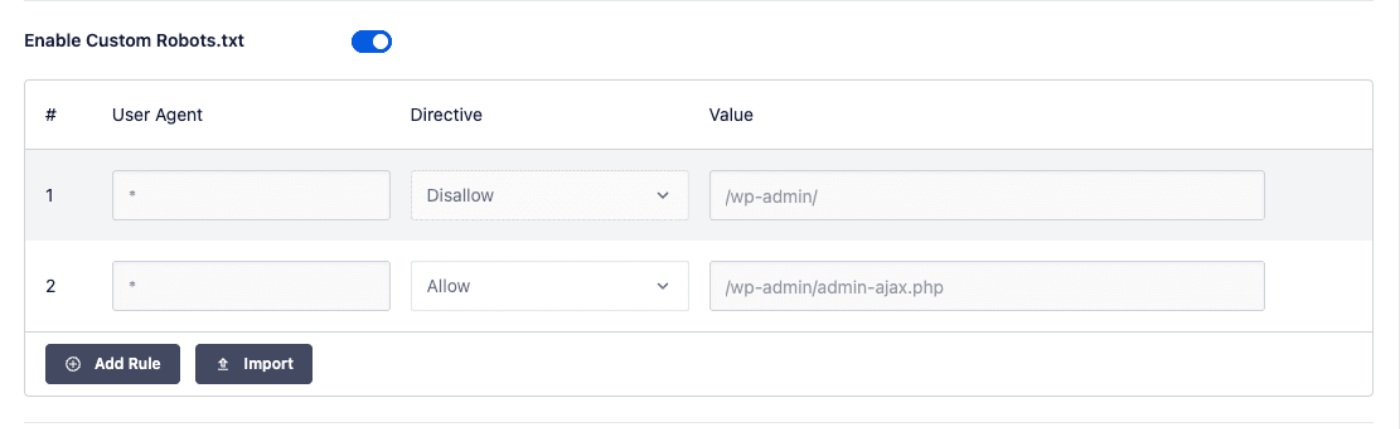

Añadir reglas usando el constructor de reglas

El constructor de reglas se utiliza para añadir tus propias reglas personalizadas para rutas específicas en tu sitio.

Por ejemplo, si deseas añadir una regla para bloquear todos los robots de un directorio temporal, puedes usar el constructor de reglas para añadirla.

Para añadir una regla, haz clic en el botón Añadir regla y luego completa los campos que se describen a continuación.

Agente de usuario

Primero, introduce el agente de usuario en el campo Agente de usuario.

Por ejemplo, si deseas especificar el rastreador de Google, introduce “Googlebot” en el campo Agente de usuario.

Si deseas una regla que se aplique a todos los agentes de usuario, introduce * en el campo Agente de usuario.

Directiva

A continuación, selecciona el tipo de regla en el menú desplegable Directiva. Hay cuatro tipos de reglas que puedes seleccionar:

- Permitir permitirá a los rastreadores con el agente de usuario especificado acceder al directorio o archivo en el campo Valor.

- Bloquear bloqueará a los rastreadores con el agente de usuario especificado el acceso al directorio o archivo en el campo Valor.

- Clean-param te permite excluir páginas con parámetros de URL que pueden dar el mismo contenido con una URL diferente. Yandex, el único motor de búsqueda que actualmente soporta esta directiva, tiene una buena explicación con ejemplos aquí.

- Crawl-delay indica a los rastreadores con qué frecuencia pueden rastrear tu contenido. Por ejemplo, un retraso de rastreo de 10 indica a los rastreadores que no rastreen tu contenido más de una vez cada 10 segundos.

Actualmente, esta directiva solo es compatible con Bing, Yahoo y Yandex. Puedes cambiar la tasa de rastreo del rastreador de Google en Google Search Console.

Valor

A continuación, introduce la ruta del directorio o el nombre del archivo en el campo Valor.

Puedes introducir una ruta de directorio como /wp-content/backups/ y rutas de archivo como /wp-content/backups/temp.png.

También puedes usar * como comodín, como /wp-content/backup-*.

Si deseas añadir más reglas, haz clic en el botón Añadir regla y repite los pasos anteriores.

Cuando hayas terminado, haz clic en el botón Guardar cambios.

Tus reglas aparecerán en la sección Vista previa personalizada de robots.txt y en tu robots.txt, que puedes ver haciendo clic en el botón Abrir robots.txt.

Edición de reglas usando el constructor de reglas

Para editar cualquier regla que hayas añadido, simplemente cambia los detalles en el constructor de reglas y haz clic en el botón Guardar cambios.

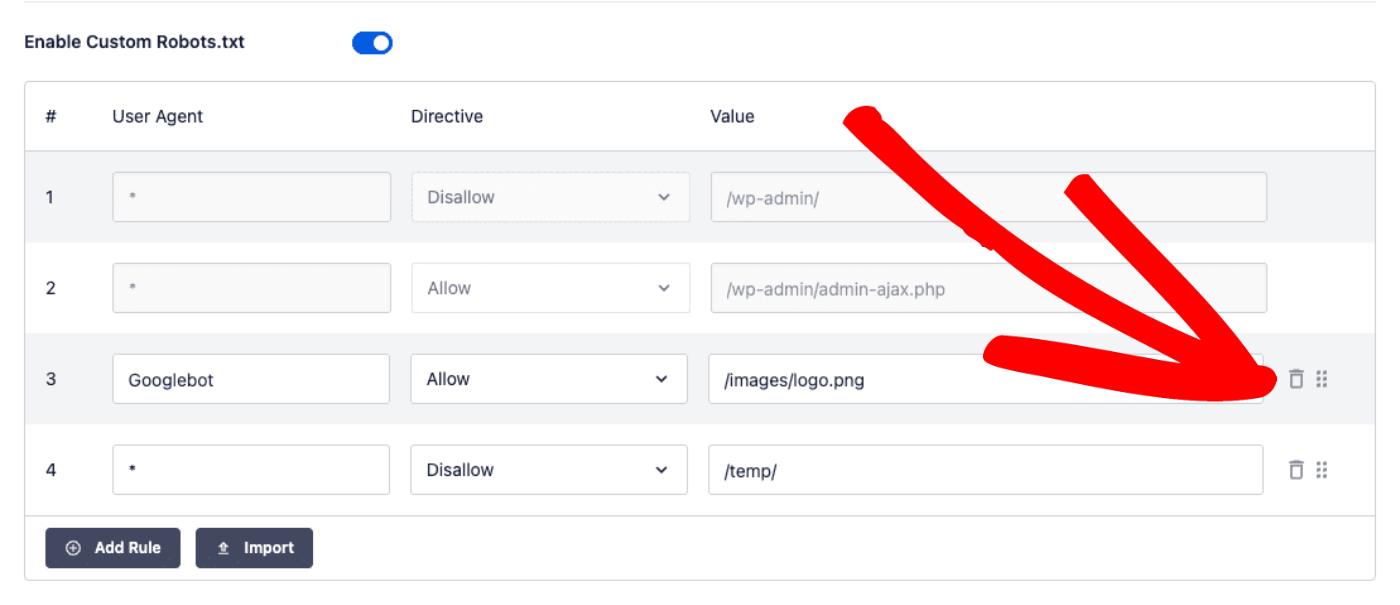

Eliminación de una regla en el constructor de reglas

Para eliminar una regla que hayas agregado, haz clic en el icono de la papelera a la derecha de la regla.

Cambio del orden de las reglas en el constructor de reglas

Puedes cambiar fácilmente el orden en que aparecen tus reglas personalizadas en tu robots.txt arrastrando y soltando las entradas en el constructor de reglas.

Haz clic y mantén presionado el icono de arrastrar y soltar a la derecha de la regla y muévela a donde quieras que aparezca, como se ve a continuación.

Importación de tu propio Robots.txt en All in One SEO

Puedes importar tu propio robots.txt o reglas de otra fuente muy fácilmente.

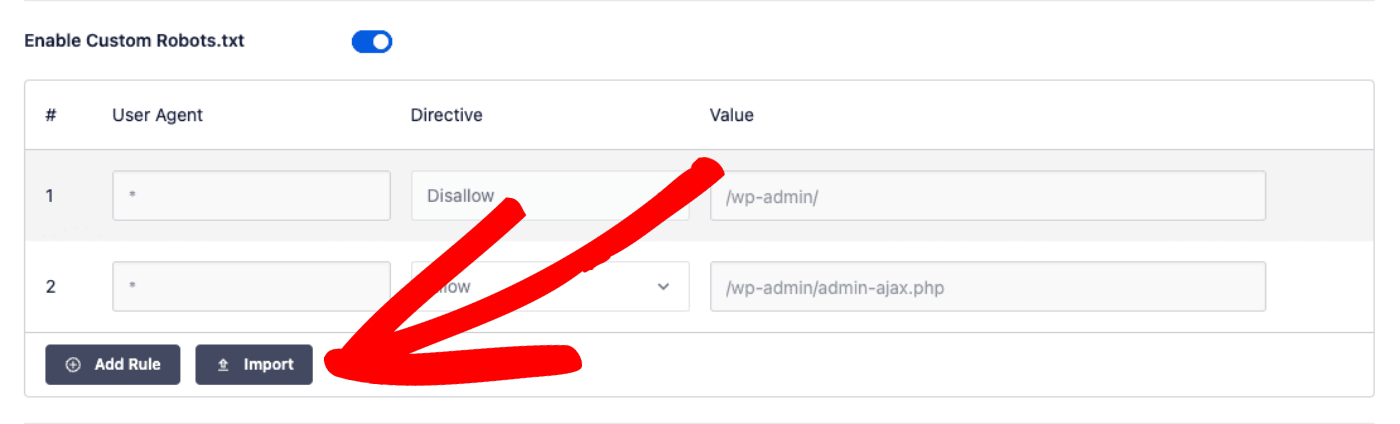

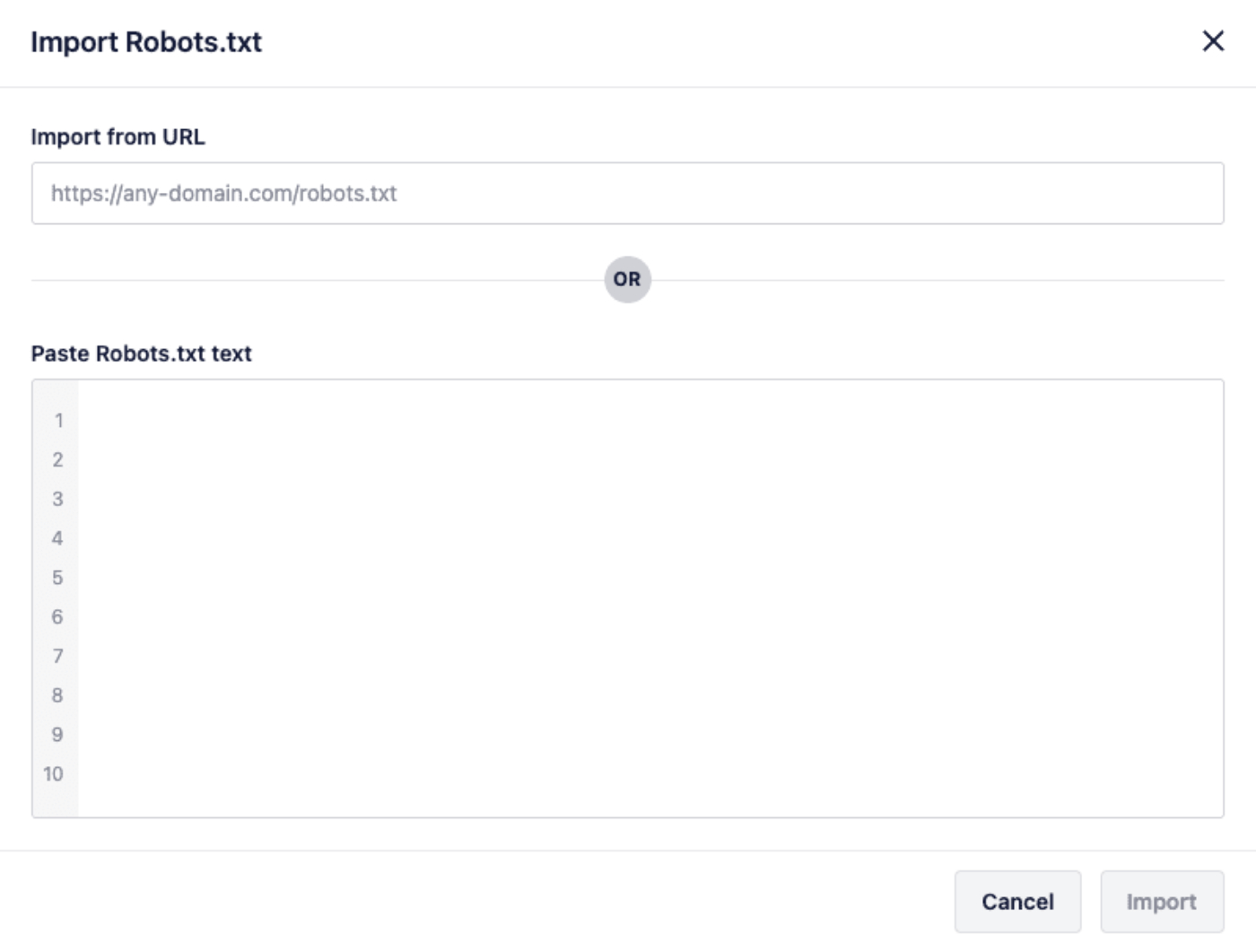

Primero, haz clic en el botón Importar para abrir la ventana Importar Robots.txt.

En la ventana Importar Robots.txt, puedes importar desde una URL introduciendo la URL de un robots.txt en el campo Importar desde URL o puedes pegar el contenido de un robots.txt en el campo Pegar texto de Robots.txt.

Una vez que hayas hecho esto, haz clic en el botón Importar.

Uso de reglas avanzadas en el constructor de reglas

El Constructor de Reglas de Robots.txt también admite el uso de reglas avanzadas. Esto incluye patrones de expresiones regulares, así como parámetros de URL.

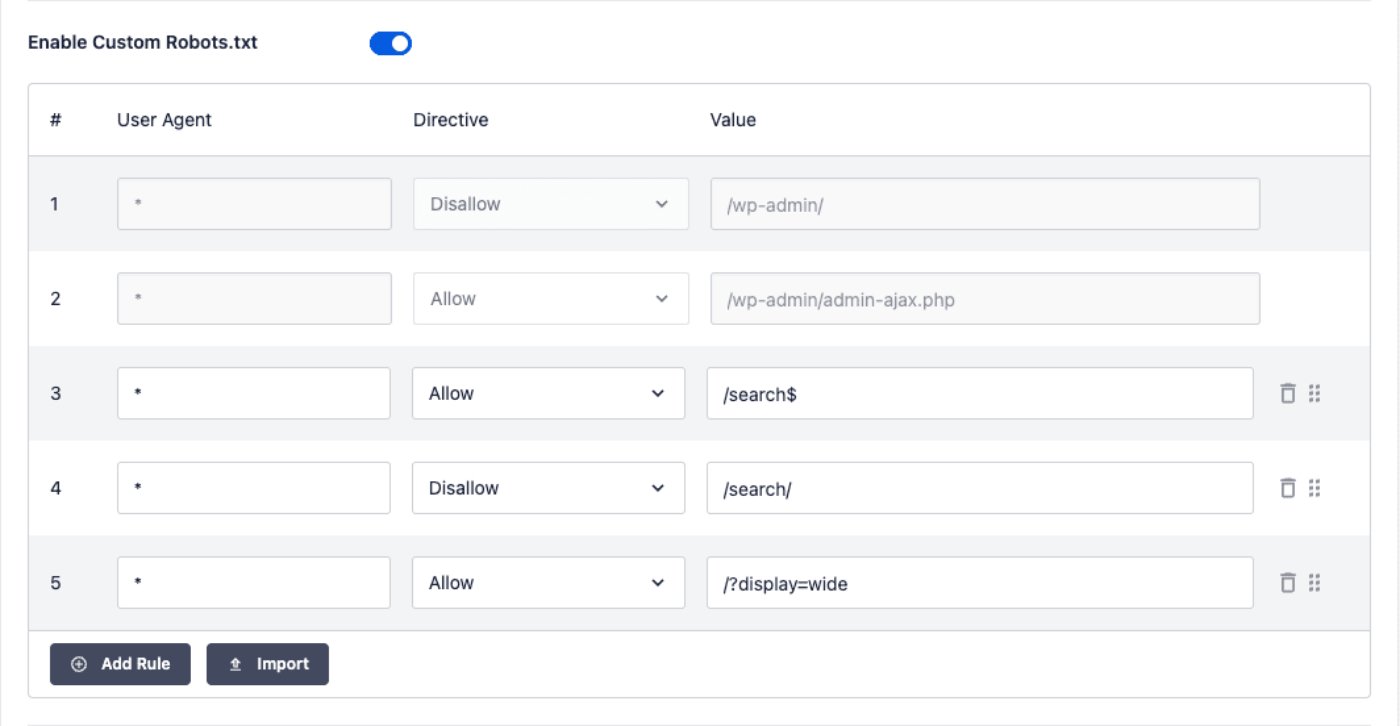

Aquí tienes tres ejemplos de cómo se pueden usar las reglas avanzadas:

En los ejemplos anteriores, se muestran estas reglas avanzadas:

- /search$ – esto usa expresiones regulares para permitir el acceso a la ruta exacta "/search"

- /search/ – esto bloquea el acceso a rutas que comienzan con "/search/" pero no son una coincidencia exacta

- /?display=wide – esto permite el acceso a la página de inicio con el parámetro de URL coincidente

Las reglas avanzadas como estas permiten un control granular sobre el archivo robots.txt de tu sitio para que tengas control total sobre cómo los agentes de usuario acceden a tu sitio web.

Bloqueo de rastreadores no deseados

Puedes usar Bloquear Rastreadores de IA para agregar reglas a tu robots.txt que bloqueen rastreadores conocidos como rastreadores de IA y Google AdsBot.

Puedes seleccionar cada uno de los rastreadores para bloquearlos, o puedes seleccionar Todos los Rastreadores de IA para bloquear a todos los listados.

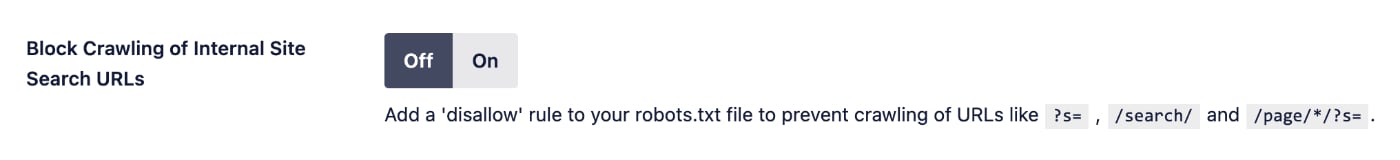

Bloquear el rastreo de URLs de búsqueda interna del sitio

Puedes usar la configuración Bloquear Rastreo de URLs de Búsqueda Interna del Sitio para agregar reglas a tu robots.txt para evitar el rastreo de URLs de páginas de búsqueda. Esto reduce el rastreo innecesario de tu sitio.

Editor Robots.txt para WordPress Multisite

También hay un Editor de Robots.txt para Redes Multisitio. Los detalles se pueden encontrar en nuestra documentación sobre el Editor de Robots.txt para Redes Multisitio aquí.