Robots.txt es un archivo de texto colocado en el directorio raíz de un sitio web que indica a los robots web (como los rastreadores de motores de búsqueda) qué páginas o secciones del sitio web tienen permitido acceder e indexar. Este archivo actúa como un conjunto de instrucciones para estos bots automatizados.

Ejemplos de cómo se utiliza robots.txt:

- No permitir directorios específicos: User-agent: * Disallow: /private/ Esto indica a todos los robots que no accedan al directorio "/private/" y su contenido.

- Permitir robots específicos mientras se deniegan otros: User-agent: Googlebot Allow: / User-agent: * Disallow: / Esto permite que el rastreador de Google acceda a todas las páginas, mientras que se deniega el acceso a todos los demás robots.

- Especificar la ubicación del sitemap: Sitemap: https://example.com/sitemap.xml Esto dirige a los robots a la ubicación del sitemap del sitio web, lo que les ayuda a rastrear el sitio de manera eficiente.

- No permitir el acceso a tipos de archivo específicos: User-agent: * Disallow: /*.pdf$ Esto evita que los robots accedan a cualquier archivo PDF en el sitio web.

Recuerda que robots.txt es un archivo accesible públicamente y no debe usarse para ocultar información sensible, ya que puede ser visto fácilmente por cualquier persona.

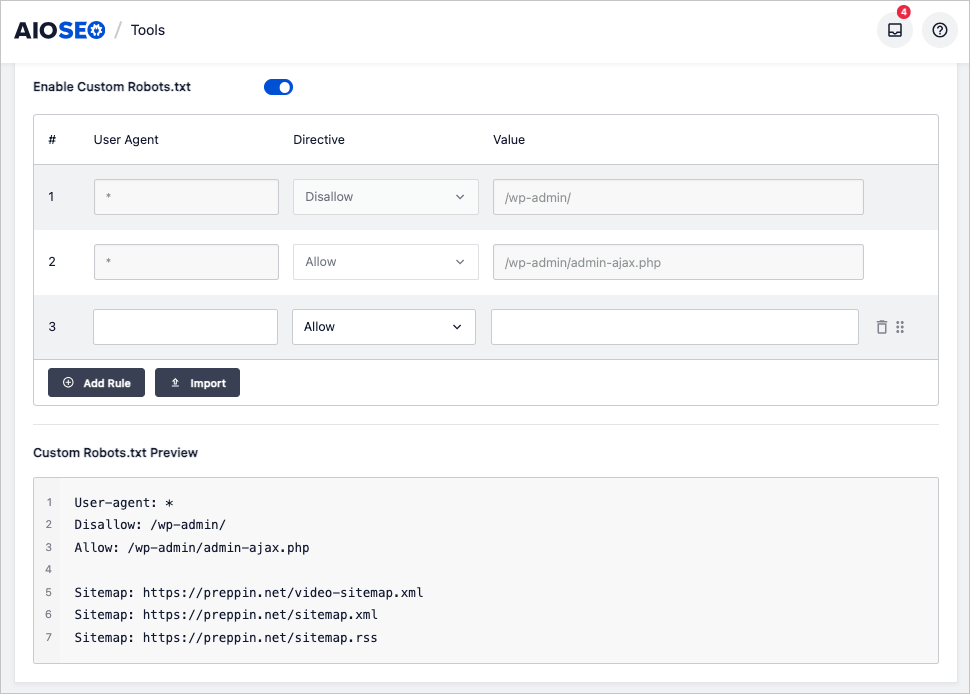

Robots.txt en WordPress

All in One SEO proporciona un editor de robots.txt fácil de usar. No es necesario lidiar con código. Los usuarios pueden editar su archivo robots.txt rellenando campos de formulario.

Relacionado: