Vous cherchez à personnaliser le fichier robots.txt de votre site ? Cet article vous aidera.

Le module robots.txt dans All in One SEO vous permet de gérer le fichier robots.txt que WordPress crée.

Cela vous permet d'avoir un plus grand contrôle sur les instructions que vous donnez aux robots d'exploration concernant votre site.

Dans cet article

- Vidéo tutoriel

- À propos du fichier Robots.txt dans WordPress

- Utilisation de l'éditeur Robots.txt dans All in One SEO

- Règles par défaut du fichier Robots.txt dans WordPress

- Adding Rules Using the Rule Builder

- Modification des règles à l'aide du générateur de règles

- Suppression d'une règle dans le générateur de règles

- Modification de l'ordre des règles dans le générateur de règles

- Importation de votre propre fichier Robots.txt dans All in One SEO

- Utilisation des règles avancées dans le générateur de règles

- Blocage des robots d'exploration indésirables

- Blocage de l'exploration des URL de recherche interne du site

- Éditeur Robots.txt pour WordPress Multisite

Vidéo tutoriel

Voici une vidéo sur la façon d'utiliser l'outil Robots.txt dans All in One SEO :

À propos du fichier Robots.txt dans WordPress

Tout d'abord, il est important de comprendre que WordPress génère un fichier robots.txt dynamique pour chaque site WordPress.

Ce fichier robots.txt par défaut contient les règles standard pour tout site fonctionnant sous WordPress.

Deuxièmement, comme WordPress génère un fichier robots.txt dynamique, il n'y a pas de fichier statique à trouver sur votre serveur. Le contenu du fichier robots.txt est stocké dans votre base de données WordPress et affiché dans un navigateur Web. C'est tout à fait normal et c'est bien mieux que d'utiliser un fichier physique sur votre serveur.

Enfin, All in One SEO ne génère pas de fichier robots.txt, il vous fournit simplement un moyen très simple d'ajouter des règles personnalisées au fichier robots.txt par défaut que WordPress génère.

NOTE :

Bien que le fichier robots.txt généré par WordPress soit une page générée dynamiquement et non un fichier texte statique sur votre serveur, il convient d'être prudent lors de la création d'un fichier robots.txt volumineux pour deux raisons :

- Un fichier robots.txt volumineux indique un ensemble de règles potentiellement complexe et difficile à maintenir

- Google a proposé une taille de fichier maximale de 512 Ko pour alléger la charge des serveurs due aux longs temps de connexion.

Utilisation de l'éditeur Robots.txt dans All in One SEO

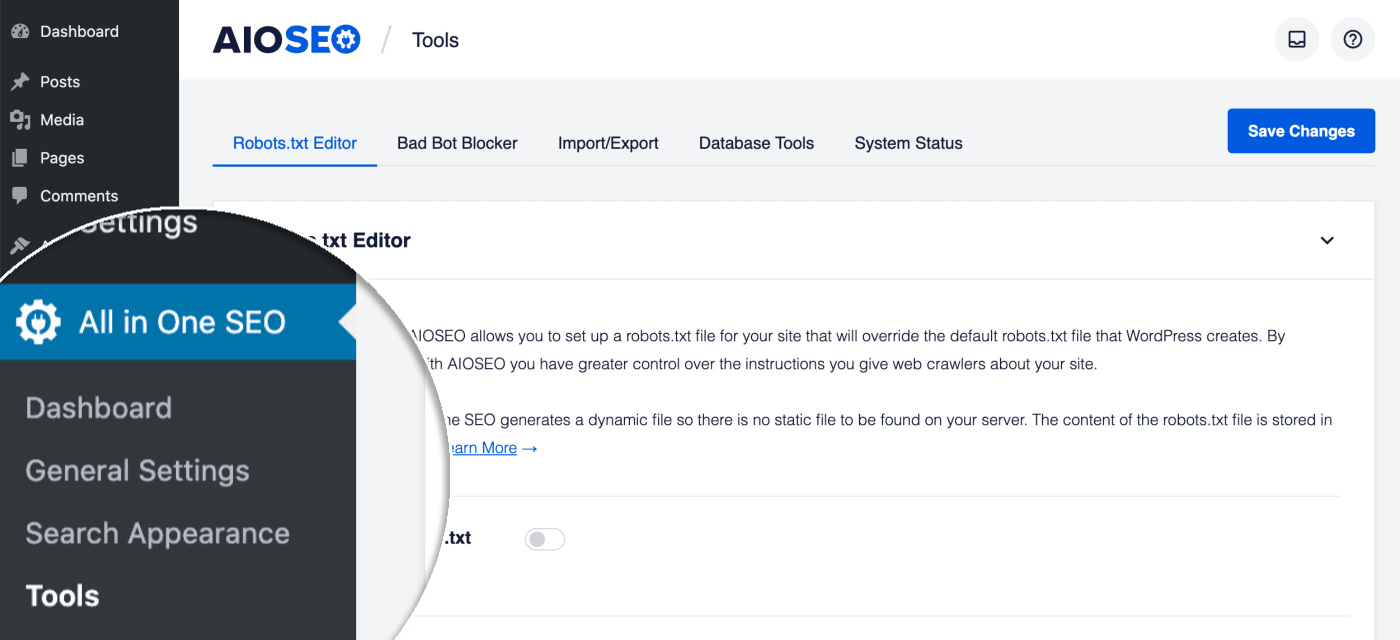

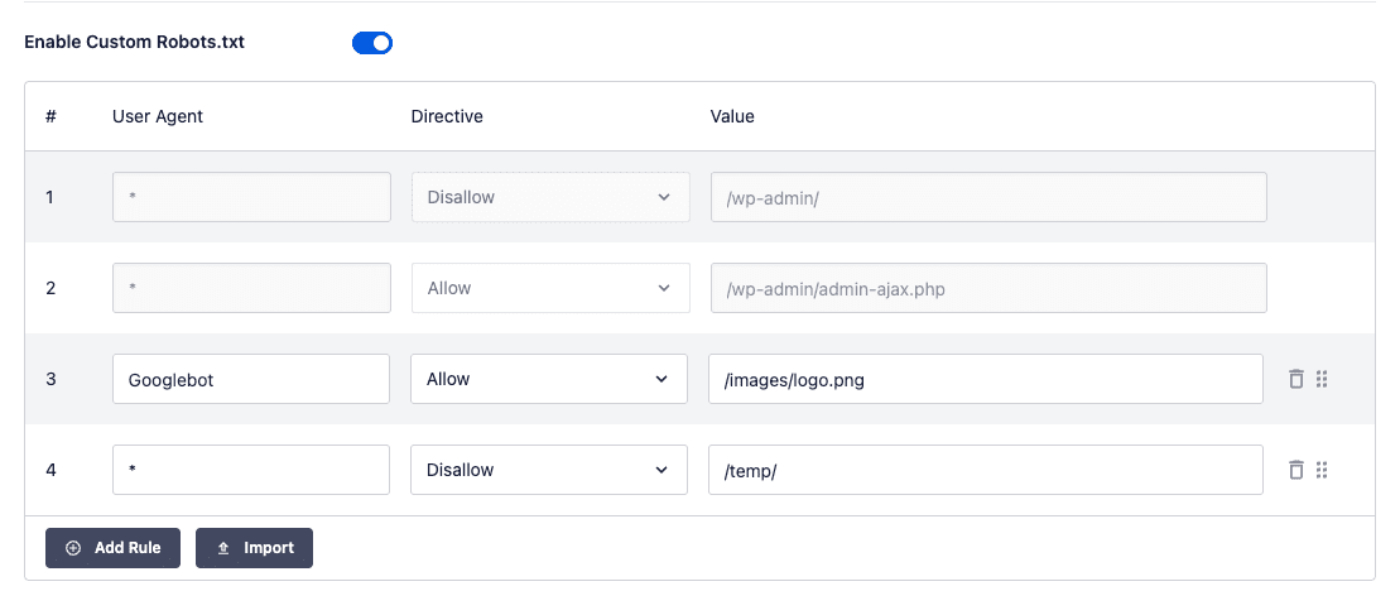

Pour commencer, cliquez sur Outils dans le menu All in One SEO.

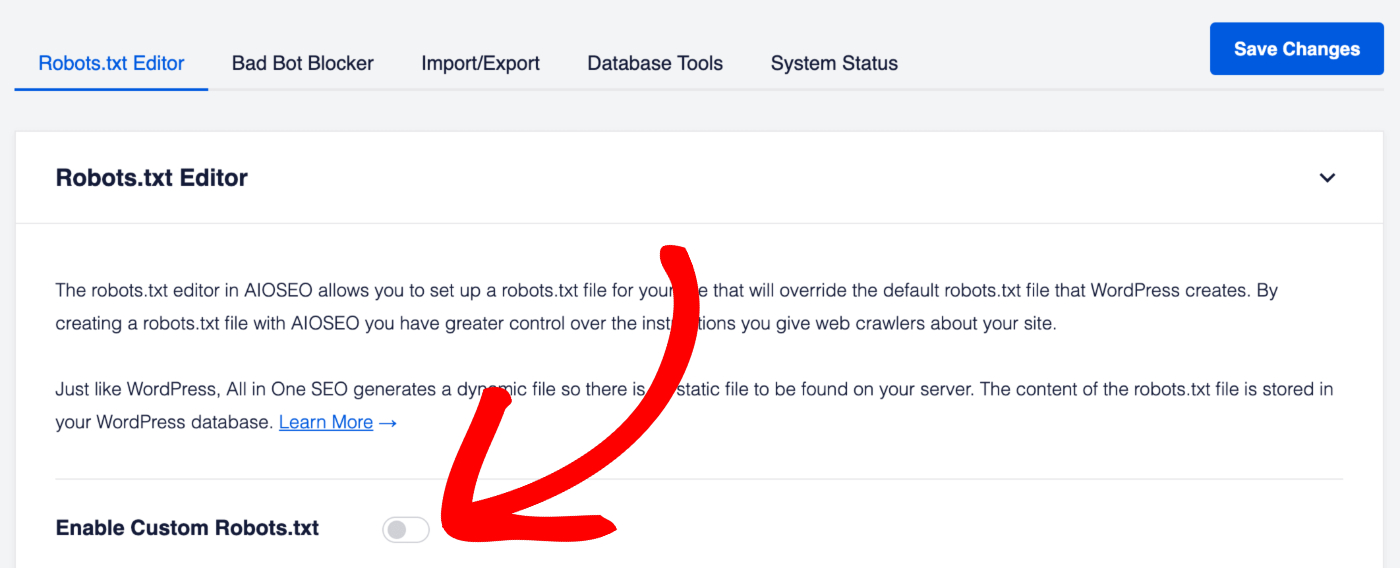

Vous devriez voir l'option Éditeur Robots.txt et le premier réglage sera Activer le fichier Robots.txt personnalisé. Cliquez sur le commutateur pour activer l'éditeur de fichier robots.txt personnalisé.

IMPORTANT :

Vous n'avez pas besoin d'activer le fichier Robots.txt personnalisé, sauf si vous avez une raison spécifique d'ajouter une règle personnalisée.

Le fichier robots.txt par défaut généré par WordPress est parfait pour 99 % de tous les sites. La fonctionnalité Robots.txt personnalisé est destinée aux utilisateurs qui ont besoin de règles personnalisées.

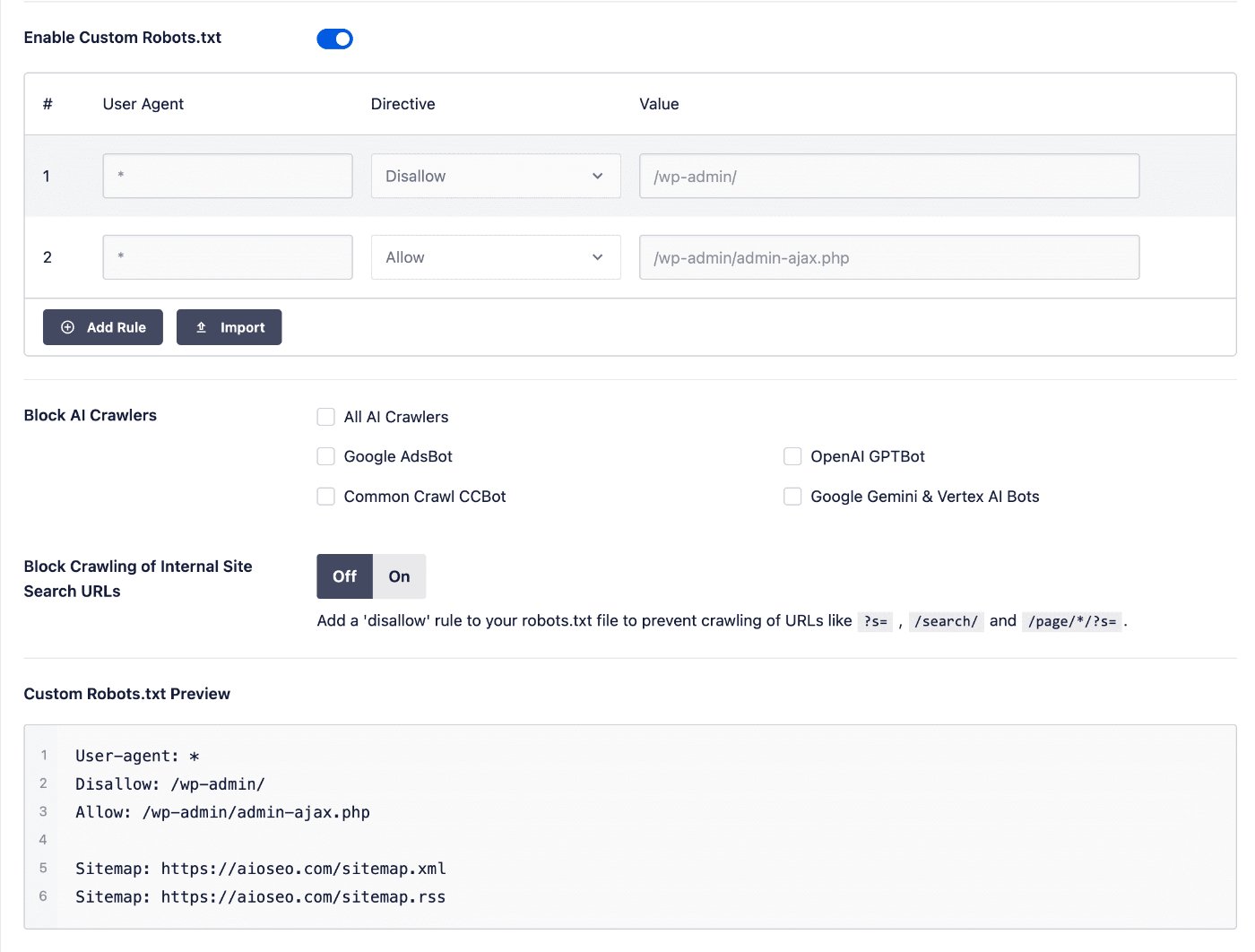

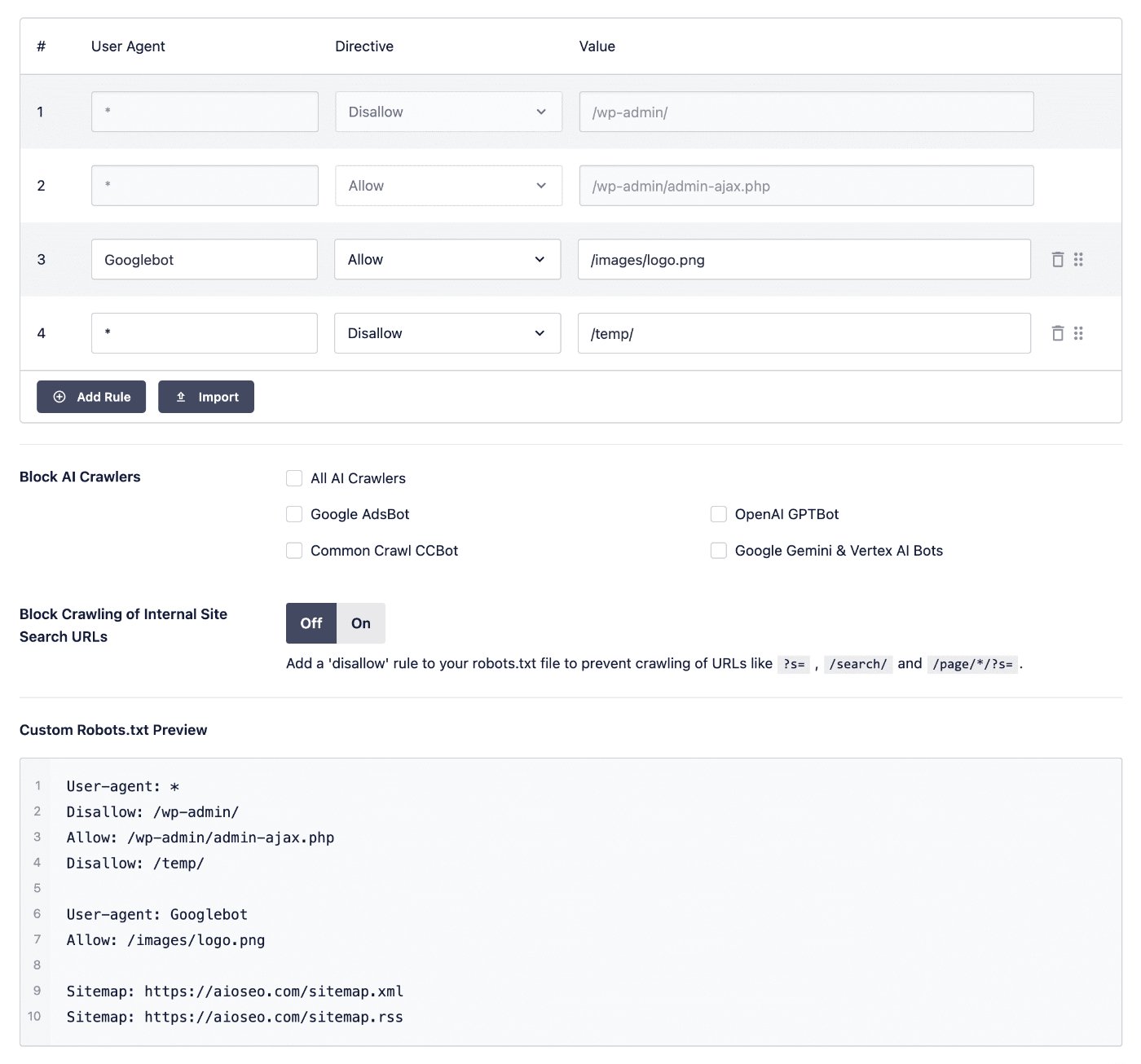

Vous devriez voir la section Aperçu du fichier Robots.txt personnalisé en bas de l'écran, qui affiche les règles par défaut ajoutées par WordPress.

Règles par défaut du fichier Robots.txt dans WordPress

Les règles par défaut qui s'affichent dans la section Aperçu personnalisé du fichier robots.txt (illustrée dans la capture d'écran ci-dessus) demandent aux robots de ne pas explorer vos fichiers WordPress principaux. Il est inutile que les moteurs de recherche accèdent directement à ces fichiers car ils ne contiennent aucun contenu pertinent pour le site.

Si pour une raison quelconque vous souhaitez supprimer les règles par défaut ajoutées par WordPress, vous devrez utiliser le hook de filtre robots_txt dans WordPress.

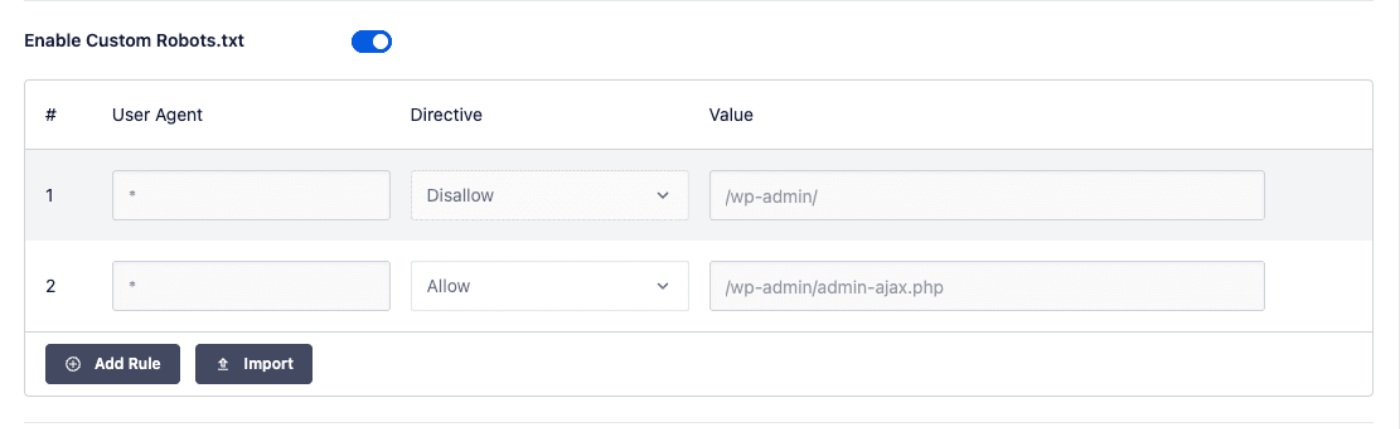

Ajouter des règles à l'aide du générateur de règles

Le générateur de règles est utilisé pour ajouter vos propres règles personnalisées pour des chemins spécifiques sur votre site.

Par exemple, si vous souhaitez ajouter une règle pour bloquer tous les robots d'un répertoire temporaire, vous pouvez utiliser le générateur de règles pour l'ajouter.

Pour ajouter une règle, cliquez sur le bouton Ajouter une règle, puis complétez les champs décrits ci-dessous.

Agent utilisateur

Tout d'abord, saisissez l'agent utilisateur dans le champ Agent utilisateur.

Par exemple, si vous souhaitez spécifier le robot d'exploration de Google, saisissez « Googlebot » dans le champ Agent utilisateur.

Si vous souhaitez une règle qui s'applique à tous les agents utilisateurs, saisissez * dans le champ Agent utilisateur.

Directive

Ensuite, sélectionnez le type de règle dans le menu déroulant Directive. Il existe quatre types de règles que vous pouvez sélectionner :

- Autoriser autorisera les robots d'exploration avec l'agent utilisateur spécifié à accéder au répertoire ou au fichier dans le champ Valeur.

- Bloquer bloquera les robots d'exploration avec l'agent utilisateur spécifié à accéder au répertoire ou au fichier dans le champ Valeur.

- Clean-param vous permet d'exclure les pages avec des paramètres d'URL qui peuvent donner le même contenu avec une URL différente. Yandex, le seul moteur de recherche qui prend actuellement en charge cette directive, a une bonne explication avec des exemples ici.

- Crawl-delay indique aux robots d'exploration à quelle fréquence ils peuvent explorer votre contenu. Par exemple, un délai d'exploration de 10 indique aux robots d'exploration de ne pas explorer votre contenu plus d'une fois toutes les 10 secondes.

Actuellement, cette directive n'est prise en charge que par Bing, Yahoo et Yandex. Vous pouvez modifier le taux d'exploration du robot de Google dans la Google Search Console.

Valeur

Ensuite, saisissez le chemin du répertoire ou le nom du fichier dans le champ Valeur.

Vous pouvez saisir un chemin de répertoire tel que /wp-content/backups/ et des chemins de fichiers tels que /wp-content/backups/temp.png.

Vous pouvez également utiliser * comme caractère générique, par exemple /wp-content/backup-*.

Si vous souhaitez ajouter d'autres règles, cliquez sur le bouton Ajouter une règle et répétez les étapes ci-dessus.

Lorsque vous avez terminé, cliquez sur le bouton Enregistrer les modifications.

Vos règles apparaîtront dans la section Aperçu personnalisé du fichier robots.txt et dans votre fichier robots.txt, que vous pouvez afficher en cliquant sur le bouton Ouvrir le fichier robots.txt.

Modification des règles à l'aide du générateur de règles

Pour modifier une règle que vous avez ajoutée, modifiez simplement les détails dans le générateur de règles et cliquez sur le bouton Enregistrer les modifications.

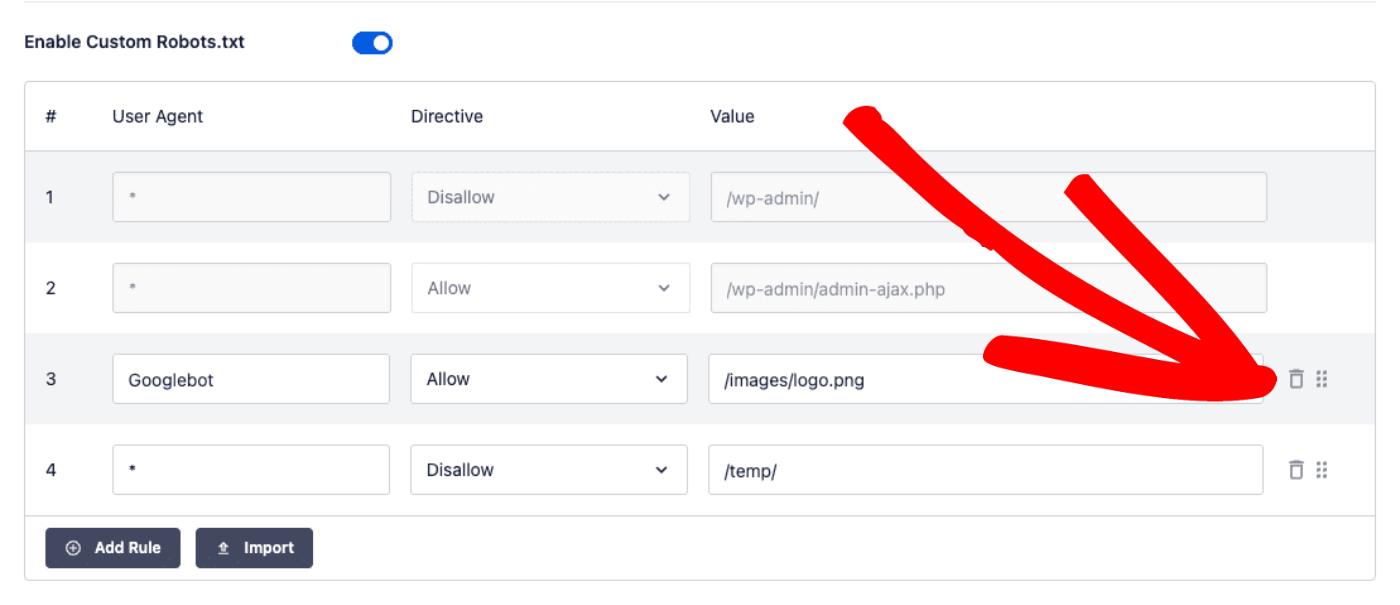

Suppression d'une règle dans le générateur de règles

Pour supprimer une règle que vous avez ajoutée, cliquez sur l'icône de corbeille à droite de la règle.

Modification de l'ordre des règles dans le générateur de règles

Vous pouvez facilement modifier l'ordre dans lequel vos règles personnalisées apparaissent dans votre fichier robots.txt en faisant glisser et déposer les entrées dans le générateur de règles.

Cliquez et maintenez l'icône de glisser-déposer à droite de la règle et déplacez la règle à l'endroit où vous souhaitez qu'elle apparaisse, comme indiqué ci-dessous.

Importation de votre propre fichier Robots.txt dans All in One SEO

Vous pouvez importer votre propre robots.txt ou des règles d'une autre source très facilement.

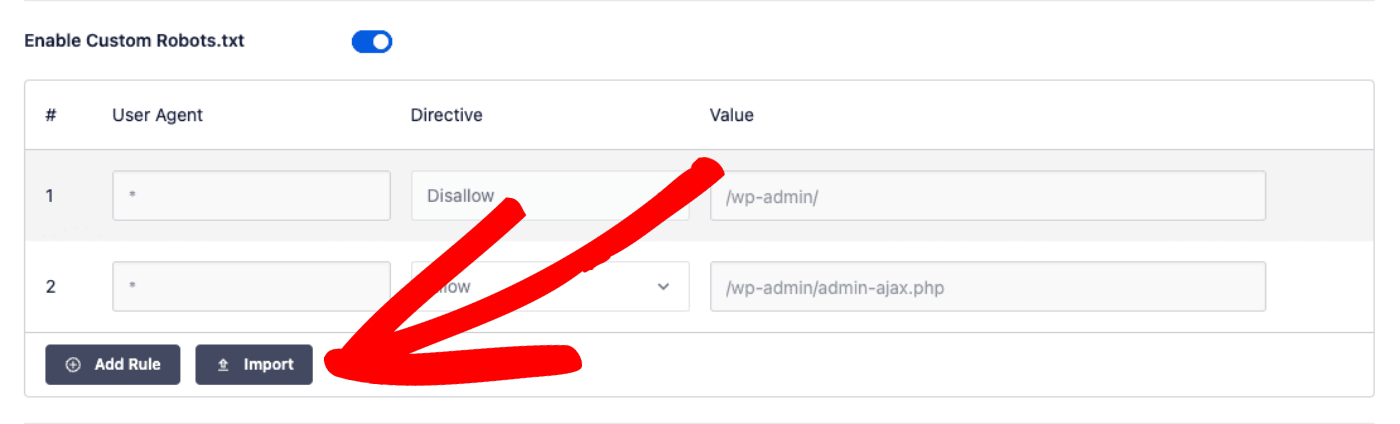

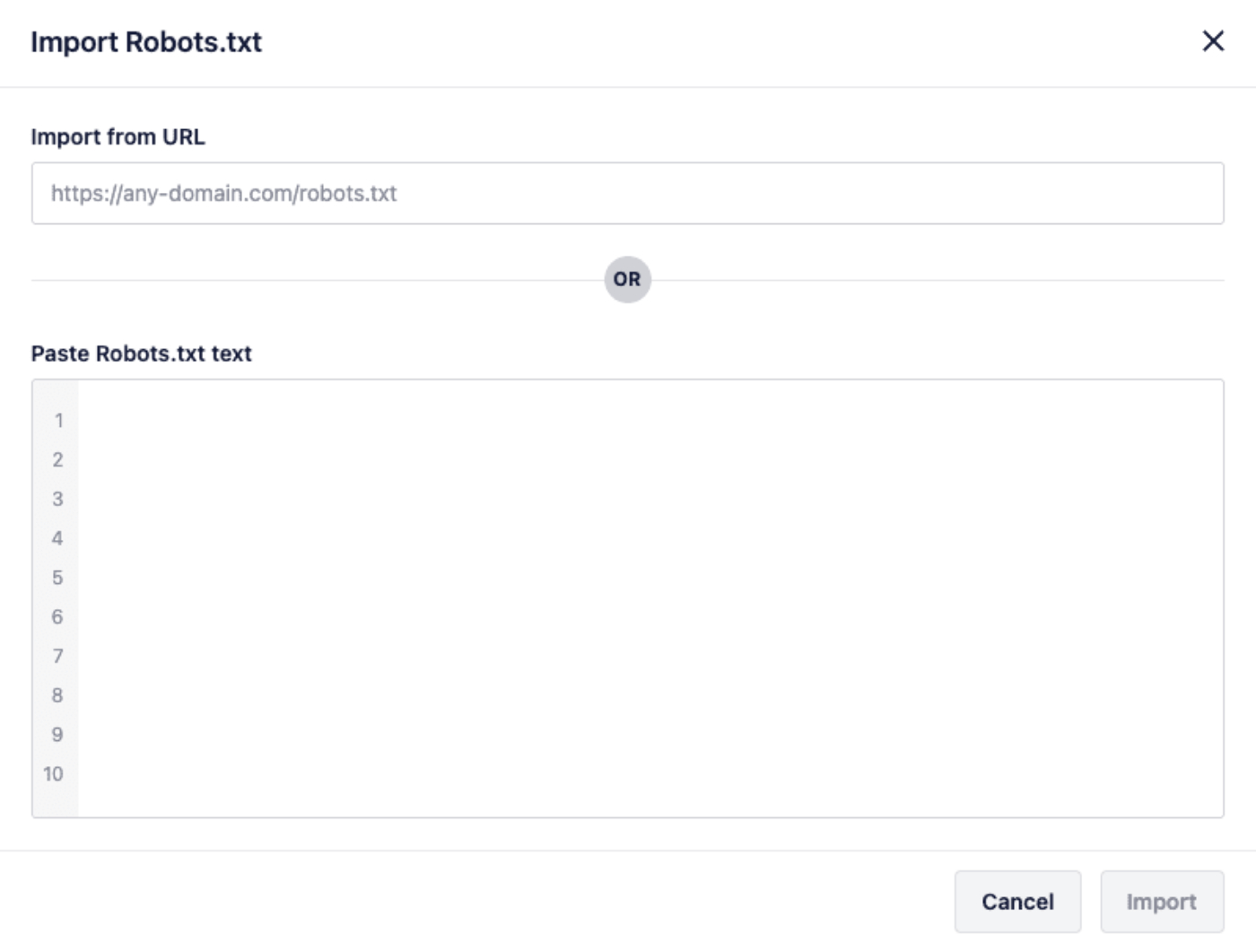

Tout d'abord, cliquez sur le bouton Importer pour ouvrir la fenêtre Importer Robots.txt.

Dans la fenêtre Importer Robots.txt, vous pouvez importer à partir d'une URL en saisissant l'URL d'un robots.txt dans le champ Importer depuis l'URL ou vous pouvez coller le contenu d'un robots.txt dans le champ Coller le texte Robots.txt.

Une fois que vous avez fait cela, cliquez sur le bouton Importer.

Utilisation des règles avancées dans le générateur de règles

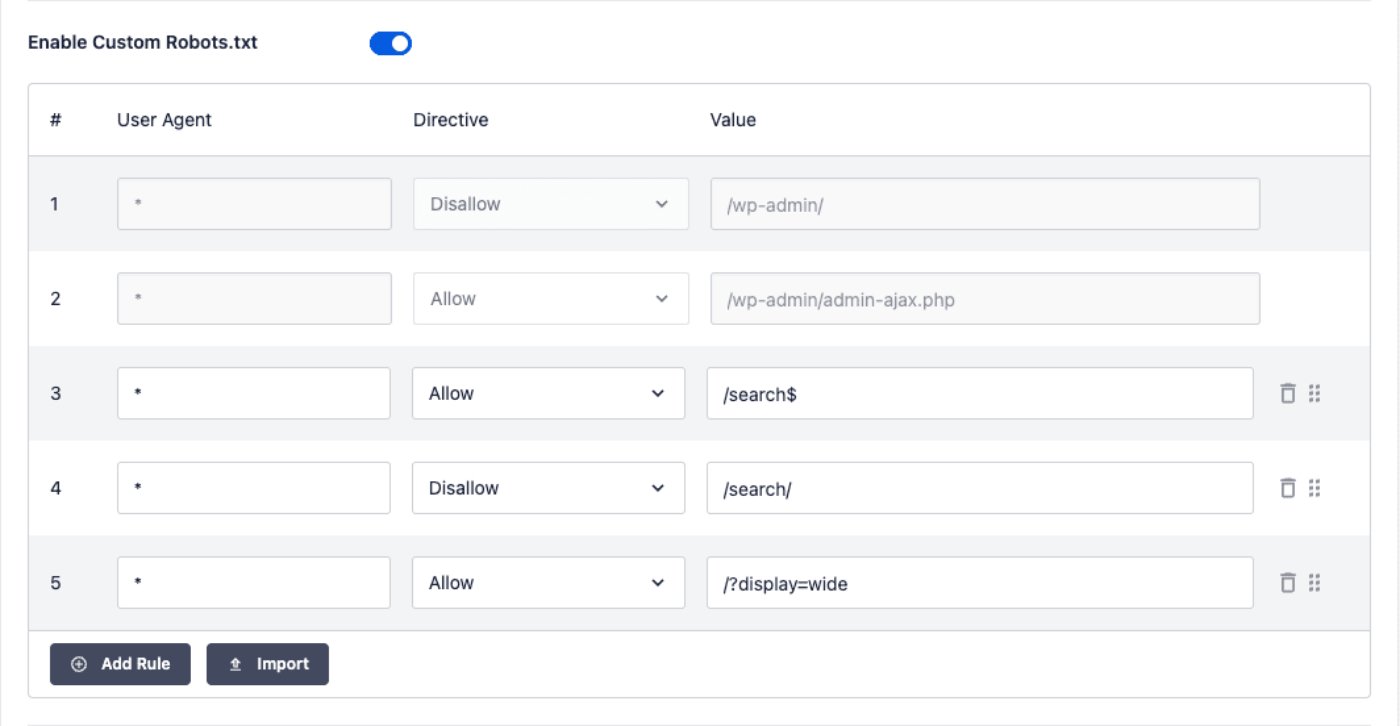

Le générateur de règles Robots.txt prend également en charge l'utilisation de règles avancées. Cela inclut les modèles regex ainsi que les paramètres d'URL.

Voici trois exemples d'utilisation des règles avancées :

Dans les exemples ci-dessus, ces règles avancées sont présentées :

- /search$ – ceci utilise regex pour autoriser l'accès au chemin exact « /search »

- /search/ – ceci bloque l'accès aux chemins qui commencent par « /search/ » mais ne correspondent pas exactement

- /?display=wide – ceci autorise l'accès à la page d'accueil avec le paramètre d'URL correspondant

Des règles avancées comme celles-ci permettent un contrôle granulaire sur le fichier robots.txt de votre site afin que vous ayez un contrôle total sur la manière dont les agents utilisateurs accèdent à votre site Web.

Blocage des robots d'exploration indésirables

Vous pouvez utiliser Bloquer les robots d'IA pour ajouter des règles à votre robots.txt qui bloquent les robots connus tels que les robots d'IA et Google AdsBot.

Vous pouvez sélectionner chacun des robots pour les bloquer, ou vous pouvez sélectionner Tous les robots d'IA pour bloquer tous ceux qui sont listés.

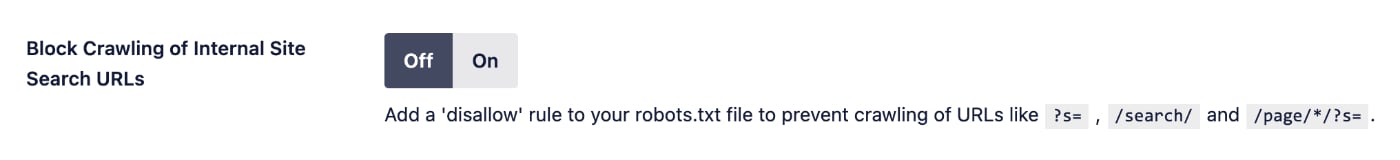

Blocage de l'exploration des URL de recherche interne du site

Vous pouvez utiliser le paramètre Bloquer l'exploration des URL de recherche interne du site pour ajouter des règles à votre robots.txt afin d'empêcher l'exploration des URL des pages de recherche. Cela réduit l'exploration inutile de votre site.

Éditeur Robots.txt pour WordPress Multisite

Il existe également un éditeur Robots.txt pour les réseaux multisites. Les détails peuvent être trouvés dans notre documentation sur l'éditeur Robots.txt pour les réseaux multisites ici.