Robots.txt est un fichier texte placé dans le répertoire racine d'un site web qui indique aux robots web (tels que les robots d'exploration des moteurs de recherche) quelles pages ou sections du site web ils sont autorisés à accéder et à indexer. Ce fichier agit comme un ensemble d'instructions pour ces robots automatisés.

Exemples d'utilisation de robots.txt :

- Refuser l'accès à des répertoires spécifiques : User-agent: * Disallow: /private/ Ceci indique à tous les robots de ne pas accéder au répertoire « /private/ » et à son contenu.

- Autoriser certains robots tout en en refusant d'autres : User-agent: Googlebot Allow: / User-agent: * Disallow: / Ceci autorise le robot de Google à accéder à toutes les pages, tout en refusant l'accès à tous les autres robots.

- Spécifier l'emplacement du sitemap : Sitemap: https://example.com/sitemap.xml Ceci indique aux robots l'emplacement du sitemap du site web, ce qui les aide à explorer le site efficacement.

- Refuser l'accès à des types de fichiers spécifiques : User-agent: * Disallow: /*.pdf$ Ceci empêche les robots d'accéder à tous les fichiers PDF sur le site web.

N'oubliez pas que robots.txt est un fichier accessible publiquement et ne doit pas être utilisé pour masquer des informations sensibles, car il peut être facilement consulté par n'importe qui.

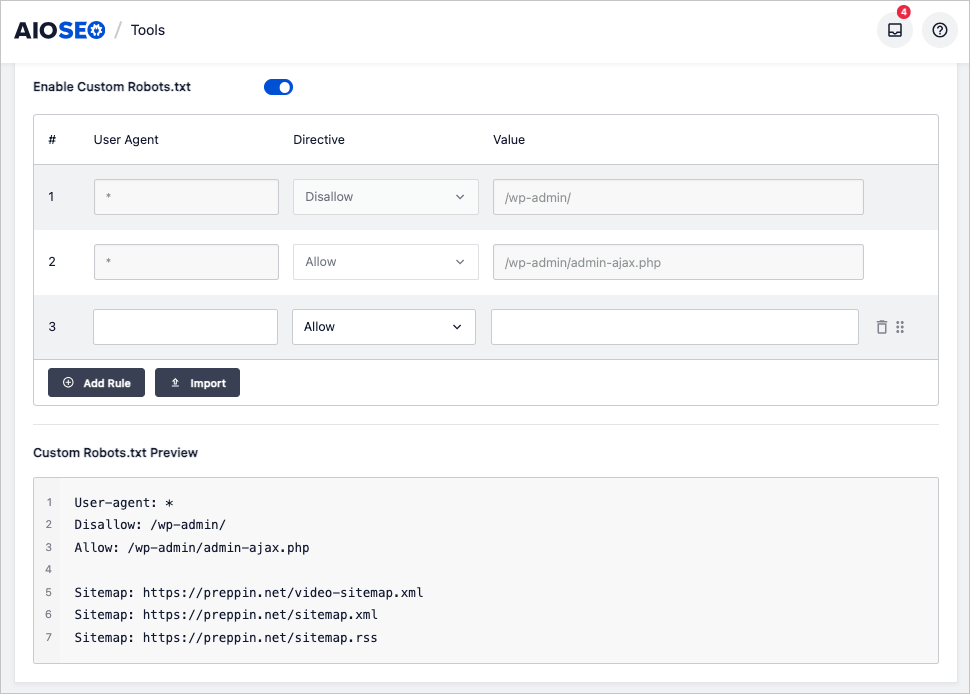

Robots.txt dans WordPress

All in One SEO fournit un éditeur robots.txt convivial. Il n'est pas nécessaire de manipuler du code. Les utilisateurs peuvent modifier leur fichier robots.txt en remplissant des champs de formulaire.

Articles similaires :