Vuoi sapere come bloccare un web crawler indesiderato dal tuo sito?

Mentre i web crawler legittimi, come quelli dei motori di ricerca, sono essenziali per indicizzare il tuo sito e migliorare la visibilità nei risultati di ricerca, i bot crawler indesiderati possono causare danni consumando larghezza di banda, raschiando contenuti e presentando rischi per la sicurezza.

In questa guida, esploreremo come bloccare i crawler indesiderati dal tuo sito per proteggere i tuoi dati, migliorare le prestazioni e salvaguardare i tuoi sforzi SEO.

Ti mostrerò il modo più semplice per gestire i crawler del sito web sul tuo sito, e non avrai nemmeno bisogno di alcuna conoscenza tecnica per implementarlo.

Bonus: bastano pochi clic!

In questo articolo

Cos'è un Web Crawler?

Un web crawler, noto anche come bot o spider, è un programma automatizzato che naviga sistematicamente su Internet per indicizzare e raccogliere informazioni dai siti web. Questi bot crawler sono fondamentali affinché i motori di ricerca comprendano e classifichino correttamente i siti web. I tipi di web crawler includono:

- Crawler dei motori di ricerca: Indicizzano i siti web per visualizzarli nei risultati di ricerca.

- Data scraper: Estraggono informazioni, spesso per uso non autorizzato.

- Bot dannosi: Svolgono attività dannose, come spam o tentativi di hacking.

- Bot AI: Scansionano il tuo sito e utilizzano i tuoi contenuti senza autorizzazione.

È a causa del tipo dannoso che devi avere il pieno controllo su quali crawler hanno accesso al tuo sito.

Come funzionano i crawler

I web crawler navigano nel tuo sito seguendo i link da una pagina all'altra. Iniziano con un elenco di URL, spesso fornito tramite una sitemap XML, che è una mappa della struttura del tuo sito web. I crawler utilizzano questa sitemap per indicizzare le tue pagine in modo efficiente.

La buona notizia è che puoi comunicare con i web crawler utilizzando un file robots.txt. Questo file di testo semplice fornisce istruzioni su quali pagine o directory scansionare o evitare. Tuttavia, non tutti i bot rispettano queste istruzioni, specialmente quelli dannosi.

Perché bloccare un Web Crawler indesiderato?

Quindi, perché dovresti investire tempo, energia e risorse per bloccare i crawler indesiderati?

Lascia che ti dia le mie prime 4 ragioni.

1. Preoccupazioni per la sicurezza

I web crawler indesiderati possono rappresentare significativi rischi per la sicurezza. Potrebbero tentare di accedere a dati sensibili, sfruttare vulnerabilità o iniettare codice dannoso nel tuo sito web.

2. Problemi di prestazioni

Scansioni eccessive possono sovraccaricare il tuo server, causando prestazioni lente del sito web o persino interruzioni. Ciò può influire negativamente sull'esperienza utente e sulla reputazione del tuo sito.

3. Protezione della privacy

Bloccando i bot non autorizzati, impedisci loro di accedere ed eventualmente esporre informazioni riservate o dati proprietari.

4. Impatto sulla SEO

Crawler dannosi potrebbero duplicare i tuoi contenuti altrove, portando a penalità per contenuti duplicati da parte dei motori di ricerca. Possono anche abusare dei tuoi contenuti, influenzando il tuo posizionamento nei motori di ricerca e la credibilità del marchio.

Come bloccare un crawler web indesiderato: Il modo super facile

Ora che conosci i pericoli che i crawler indesiderati possono rappresentare, tuffiamoci rapidamente in come bloccarli dall'interferire con il tuo sito.

Passaggio 1: Installa AIOSEO

Il primo passo per gestire un crawler web indesiderato è installare il plugin All in One SEO (AIOSEO) sul tuo sito WordPress.

AIOSEO è il miglior plugin SEO per WordPress sul mercato. Oltre 3 milioni di proprietari di siti web e marketer esperti si fidano di esso per aiutarli a dominare le pagine dei risultati dei motori di ricerca (SERP) e generare traffico pertinente al sito.

Il plugin ha molte potenti funzionalità e moduli SEO per aiutarti a ottimizzare il tuo sito per i motori di ricerca e gli utenti, anche senza conoscenze di codifica o tecniche. AIOSEO è uno strumento potente che semplifica la gestione della SEO e fornisce funzionalità avanzate per controllare l'accesso dei crawler.

A questo proposito, AIOSEO ha una funzionalità avanzata chiamata Crawl Cleanup. Ma ne parleremo più avanti.

Hai bisogno di istruzioni passo passo su come installare AIOSEO?

Quindi, consulta la nostra guida dettagliata all'installazione.

Passaggio 2: Apri Pulizia Crawl

Nella tua bacheca di WordPress, vai su AIOSEO » Aspetto della ricerca » Avanzate.

Successivamente, scorri verso il basso fino all'interruttore Crawl Cleanup e assicurati che sia impostato su "On".

Questa funzionalità ti consente di gestire facilmente come i motori di ricerca e i bot interagiscono con il tuo sito web.

Crawl Cleanup ha molte impostazioni per aiutarti a ottimizzare la crawlability e le prestazioni del tuo sito. Esempi includono impostazioni per:

- Feed RSS

- Bot indesiderati

- Pulizia della ricerca interna del sito

Crawl Cleanup è uno strumento indispensabile in qualsiasi plugin SEO, poiché ti aiuta a controllare l'accesso dei bot, ridurre il carico del server e migliorare le prestazioni del sito.

Nel nostro caso, tuttavia, vogliamo l'opzione Bot indesiderati.

Passaggio 3: Seleziona il Web Crawler che Vuoi Bloccare

Nella sezione Bot indesiderati, troverai un elenco di bot e crawler noti.

Seleziona semplicemente le caselle accanto ai bot indesiderati che desideri bloccare.

In alternativa, puoi:

- Bloccare tutti i bot indesiderati, dandoti maggiore controllo sul tuo budget di scansione.

- Targetizzare principalmente i crawler AI, impedendo loro di indicizzare i tuoi contenuti senza permesso.

Quando fai ciò, AIOSEO aggiornerà automaticamente il tuo file robots.txt e applicherà le impostazioni necessarie per impedire a tali bot indesiderati di accedere al tuo sito.

Passaggio 4: Modifica robots.txt (Facoltativo)

Vuoi un controllo più avanzato sulla gestione dei crawler web indesiderati?

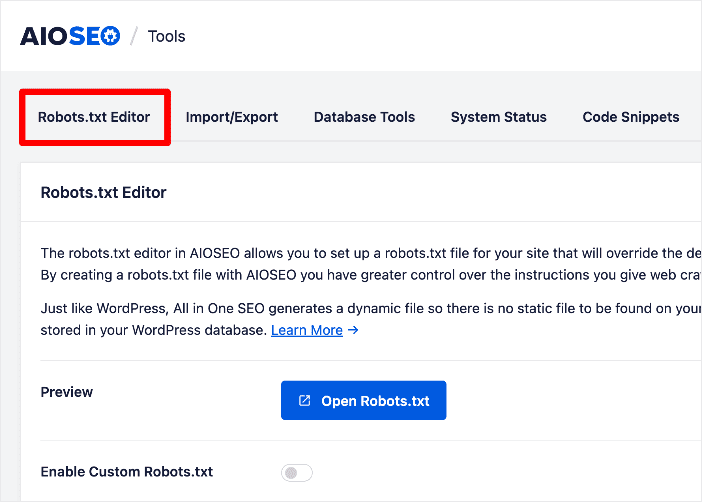

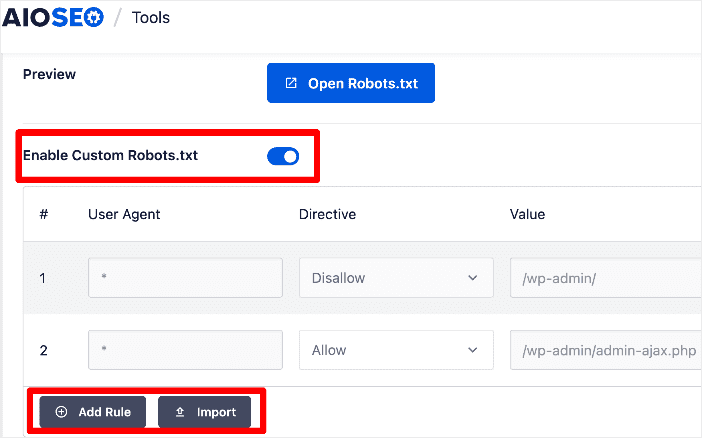

Puoi anche considerare di impostare le direttive di scansione nel file robots.txt del tuo sito direttamente all'interno di AIOSEO. Per farlo, vai al menu All in One SEO » Strumenti » Editor Robots.txt.

Il file robots.txt dice ai bot quali parti del tuo sito possono o non possono accedere. Puoi aggiungere direttive per impedire ai bot di accedere a determinate directory o file.

Puoi persino importare direttive da un altro sito, rendendo molto facile applicare direttive da uno dei tuoi altri siti o da un sito che ti piace.

Utilizzando l'Editor Robots.txt di AIOSEO, puoi personalizzare le tue istruzioni per i robot senza dover gestire codice complesso.

Come bloccare un crawler web indesiderato: le tue FAQ hanno trovato risposta

Come posso impedire ai web crawler di accedere al mio intero sito web?

Il modo migliore per impedire ai crawler indesiderati di accedere al tuo sito è utilizzare la funzione Crawl Cleanup di AIOSEO. Puoi proteggere il tuo sito da scansioni non autorizzate con pochi clic.

Come posso fermare un crawler di Google?

Se hai bisogno di bloccare Googlebot, aggiungi quanto segue al tuo file robots.txt:

User-agent: Googlebot

Disallow: /

In alternativa, se vuoi bloccare Google da pagine specifiche, usa la funzione Meta Tag Robots in AIOSEO per impostare direttive noindex su quelle pagine.

Quale file viene utilizzato per bloccare i web crawler indesiderati su un sito web?

Il file robots.txt è il mezzo principale per comunicare con i crawler. Inoltre, puoi utilizzare i meta tag robots all'interno delle singole pagine per istruire i crawler a non indicizzare o seguire i link su quella pagina.

Spero che questo post ti abbia aiutato a imparare come bloccare i crawler web indesiderati dall'accedere al tuo sito. Potresti anche voler consultare altri articoli sul nostro blog, come la nostra guida ai tag canonici o il nostro elenco dei migliori plugin WordPress.

Se hai trovato utile questo articolo, iscriviti al nostro Canale YouTube. Troverai molti altri tutorial utili lì. Puoi anche seguirci su X (Twitter), LinkedIn o Facebook per rimanere aggiornato.

Divulgazione: I nostri contenuti sono supportati dai lettori. Ciò significa che se fai clic su alcuni dei nostri link, potremmo guadagnare una commissione. Raccomandiamo solo prodotti che crediamo aggiungeranno valore ai nostri lettori.