Vuoi sapere come modificare i file robots.txt in WordPress?

Ero intimidito dalla modifica dei file robots.txt in WordPress. Come persona che ha creato e gestito oltre una dozzina di siti WordPress, ricordo di aver fissato il mio schermo, preoccupato che un'unica mossa sbagliata potesse compromettere la SEO del mio sito.

Il file robots.txt può sembrare spaventoso, ma in realtà è un semplice file di testo che indica ai motori di ricerca quali parti del tuo sito possono e non possono accedere. Dopo anni di lavoro con WordPress, ho imparato che modificare questo file non deve essere affatto complicato.

In questa guida passo passo, ti mostrerò i modi più semplici e sicuri per modificare il tuo file robots.txt in WordPress. Sia che tu voglia bloccare determinate pagine dai motori di ricerca o risolvere problemi di SEO, imparerai esattamente cosa fare.

Non preoccuparti, ti guiderò attraverso ogni passaggio, così non romperai nulla.

In questo articolo

Cos'è un file Robots.txt?

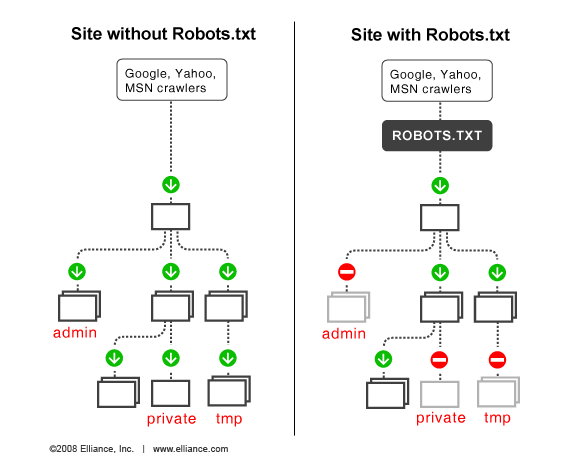

Un file robots.txt indica ai motori di ricerca come scansionare il tuo sito, dove è loro permesso andare o meno.

I motori di ricerca come Google utilizzano questi crawler web, a volte chiamati robot web, per archiviare e categorizzare i siti web.

La maggior parte dei bot è configurata per cercare un file robots.txt sul server prima di leggere qualsiasi altro file dal tuo sito. Fa questo per vedere se hai aggiunto istruzioni speciali su come scansionare e indicizzare il tuo sito.

Il file robots.txt è tipicamente memorizzato nella directory principale, nota anche come cartella principale del tuo sito web.

L'URL può apparire così:

http://www.example.com/robots.txt

Per controllare il file robots.txt del tuo sito web, sostituisci semplicemente http://www.example.com/ con il tuo dominio e aggiungi robots.txt alla fine.

Ora, diamo un'occhiata a come appare il formato base di un file robots.txt:

User-agent: [user-agent name]

Disallow: [URL string not to be crawled]

User-agent: [user-agent name]

Allow: [URL string to be crawled]

Sitemap: [URL of your XML Sitemap]

User-agent si riferisce al bot o robot del motore di ricerca che desideri bloccare o consentire di scansionare il tuo sito (ad esempio, il crawler Googlebot).

Quando modifichi il tuo file robots.txt, puoi includere più istruzioni per Consentire o Negare URL specifici, oltre ad aggiungere più sitemap. Puoi anche escludere parametri URL usando la direttiva Clean-param e impostare la frequenza delle visite dei bot di ricerca usando la direttiva Crawl-delay.

File Robots.txt Predefinito in WordPress

Per impostazione predefinita, WordPress crea automaticamente un file robots.txt per il tuo sito. Quindi, anche se non fai nulla, il tuo sito dovrebbe già avere il file robots.txt predefinito di WordPress.

Ma quando in seguito lo personalizzi con le tue regole, il contenuto predefinito viene sostituito.

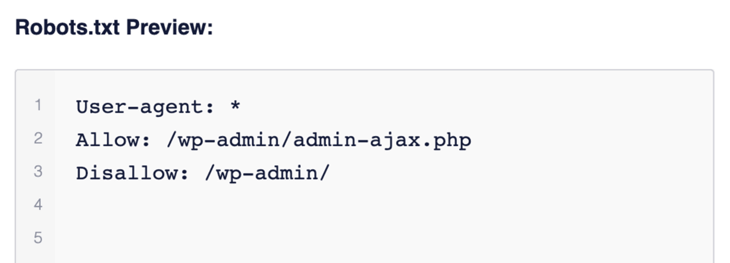

Ecco come appare il file robots.txt predefinito di WordPress:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

L'asterisco dopo User-agent: * significa che il file robots.txt è per tutti i robot web che visitano il tuo sito. Come accennato, Disallow: /wp-admin/ dice ai robot di non visitare la tua pagina wp-admin.

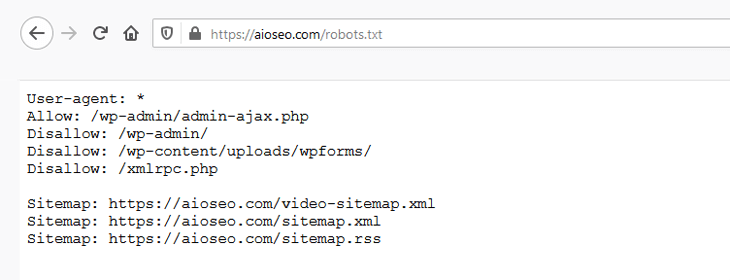

Puoi testare il tuo file robots.txt aggiungendo /robots.txt alla fine del nome del tuo dominio. Ad esempio, se inserisci "https://aioseo.com/robots.txt" nel tuo browser web, verrà visualizzato il file robots.txt per AIOSEO:

Ora che sai cos'è un file robots.txt e come funziona, vediamo perché il file robots.txt è importante in primo luogo.

Perché il file Robots.txt è importante?

Il file robots.txt è importante se vuoi:

- Ottimizzare la velocità di caricamento del tuo sito — dicendo ai bot di non sprecare tempo su pagine che non vuoi che vengano scansionate e indicizzate, puoi liberare risorse e aumentare la velocità di caricamento del tuo sito.

- Ottimizzare l'utilizzo del tuo server — bloccare i bot che sprecano risorse pulirà il tuo server e ridurrà gli errori 404.

Quando usare il tag Meta Noindex invece di Robots.txt

Se il tuo obiettivo principale è impedire che determinate pagine vengano incluse nei risultati dei motori di ricerca, utilizzare un meta tag noindex è l'approccio corretto.

Questo perché robots.txt non dice direttamente ai motori di ricerca di non indicizzare il contenuto, ma solo di non scansionarlo.

In altre parole, puoi usare robots.txt per aggiungere regole specifiche su come i motori di ricerca e altri bot interagiscono con il tuo sito, ma non controllerà esplicitamente se il tuo contenuto viene indicizzato o meno.

Detto questo, ti mostreremo come modificare facilmente il tuo file robots.txt in WordPress passo dopo passo utilizzando AIOSEO.

Modifica del tuo Robots.txt in WordPress con AIOSEO

Il modo più semplice per modificare il file robots.txt è utilizzare il miglior plugin SEO per WordPress, All in One SEO (AIOSEO).

AIOSEO è un plugin SEO potente ma facile da usare, che vanta oltre 3 milioni di utenti. Ciò significa che milioni di blogger intelligenti utilizzano AIOSEO per aiutarli a migliorare il loro posizionamento sui motori di ricerca e a portare traffico qualificato ai loro blog. Questo perché il plugin dispone di molte potenti funzionalità e moduli progettati per aiutarti a configurare correttamente le tue impostazioni SEO. Esempi includono:

- Statistiche di ricerca: Questa potente integrazione con Google Search Console ti consente di monitorare il tuo posizionamento per parole chiave e vedere metriche SEO importanti con 1 clic, e altro ancora.

- Generatore di Schema di nuova generazione: questo generatore di schema no-code consente agli utenti di generare e pubblicare qualsiasi markup schema sul tuo sito.

- Gestore Reindirizzamenti: Ti aiuta a gestire i reindirizzamenti ed eliminare gli errori 404, rendendo più facile per i motori di ricerca scansionare e indicizzare il tuo sito.

- Link Assistant: Potente strumento di collegamento interno che automatizza la creazione di link tra le pagine del tuo sito. Ti fornisce anche un audit dei link in uscita.

- SEO Preview: Offre una panoramica dei tuoi snippet di ricerca e social e della SEO generale in modo da poter migliorare la tua ottimizzazione.

- IndexNow: Per un'indicizzazione rapida sui motori di ricerca che supportano il protocollo IndexNow (come Bing e Yandex).

- Generatore di Sitemap: Genera automaticamente diversi tipi di sitemap per notificare a tutti i motori di ricerca eventuali aggiornamenti sul tuo sito.

- E altro ancora.

Un motivo per cui gli utenti amano il plugin è che ti dà un maggiore controllo su come i motori di ricerca scansionano il tuo sito. Questo grazie all'editor avanzato di robots.txt che ti consente di configurare facilmente il tuo file robots.txt, permettendoti di sovrascrivere il file predefinito di WordPress.

Dai un'occhiata alla nostra lista dei migliori generatori di robots.txt.

Dai un'occhiata alla nostra lista dei migliori generatori di robots.txt.

Quindi, mettiamoci a modificare il tuo file robots.txt.

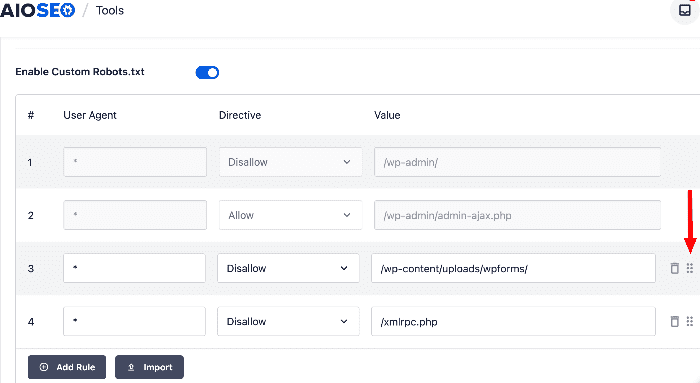

Per modificare il tuo file robots.txt, prima abilita Robots.txt personalizzato

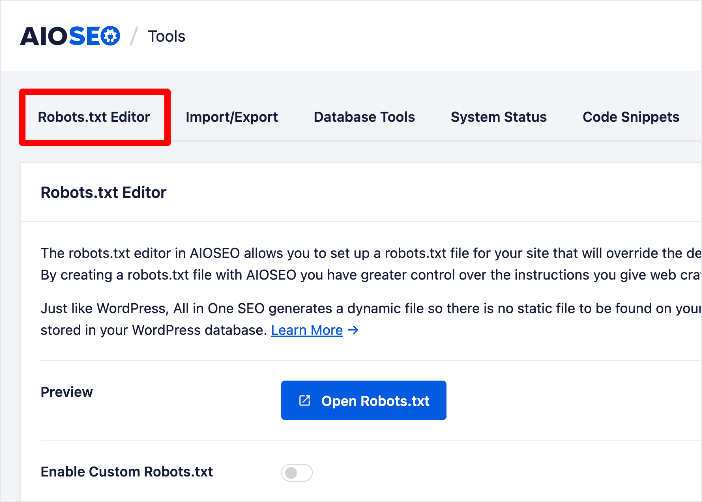

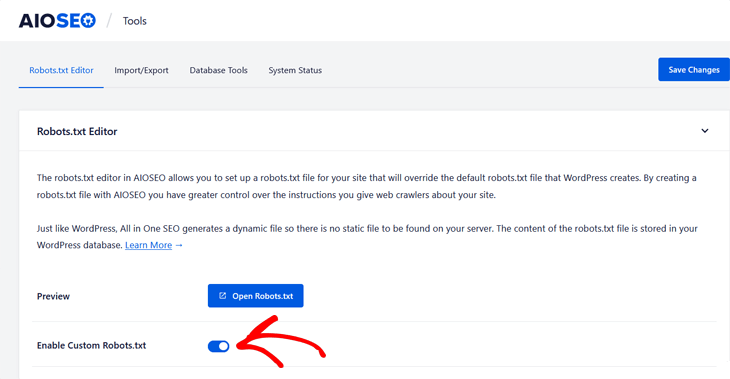

Per modificare il tuo file robots.txt, fai clic su Strumenti nel menu All in One SEO, quindi fai clic sulla scheda Editor Robots.txt.

AIOSEO genererà quindi un file robots.txt dinamico. Il suo contenuto è memorizzato nel tuo database WordPress e può essere visualizzato nel tuo browser web, come ti mostreremo tra poco.

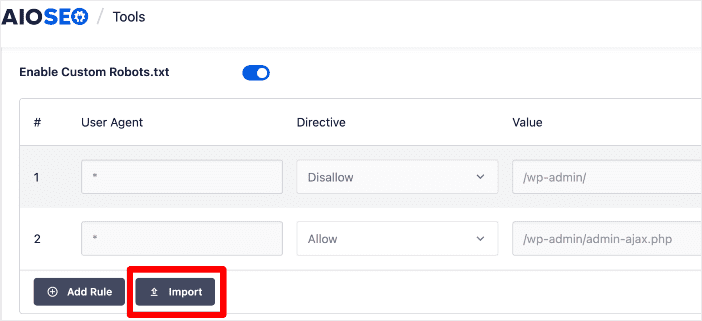

Una volta entrato nell'Editor Robots.txt, devi Abilitare Robots.txt Personalizzato.

Fai clic sul pulsante in modo che diventi blu.

Vedrai quindi la sezione Anteprima Robots.txt in fondo alla schermata, che mostra le regole predefinite di WordPress che puoi sovrascrivere con le tue. Le regole predefinite indicano ai robot di non eseguire la scansione dei tuoi file WordPress principali (pagine di amministrazione).

Ora, passiamo all'aggiunta delle tue regole. Puoi farlo in 2 modi: utilizzando il generatore di regole o importando un file robots.txt da un altro sito.

Metodo 1: Aggiungi regole usando il Costruttore di Regole

Il generatore di regole viene utilizzato per aggiungere le tue regole personalizzate su quali pagine i robot devono o non devono eseguire la scansione.

Ad esempio, puoi utilizzare il generatore di regole se desideri aggiungere una regola che blocchi tutti i robot da una directory temporanea.

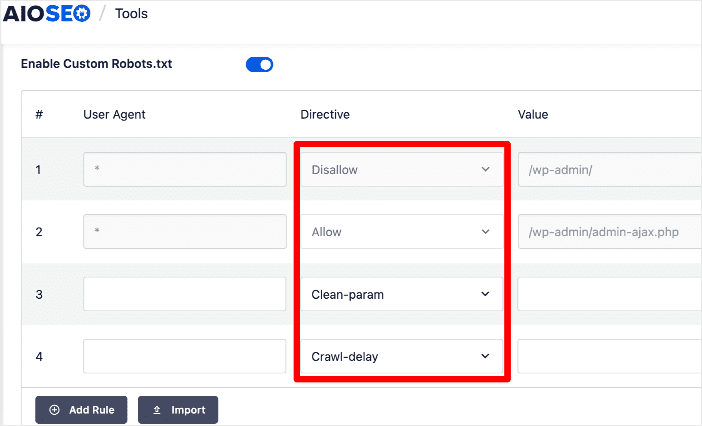

Per aggiungere una regola personalizzata, inserisci l'User Agent (ad esempio, il crawler Googlebot) nel campo User Agent. Oppure puoi usare il simbolo * per applicare la tua regola a tutti gli user agent (robot).

Successivamente, seleziona una delle direttive preimpostate di robots.txt: Allow, Disallow, Clean-param o Crawl-delay.

Puoi anche aggiungere altre direttive facendo clic sul pulsante Aggiungi Regola.

Dopo aver deciso la direttiva da applicare, devi inserire il percorso della directory o il nome del file nel campo Valore.

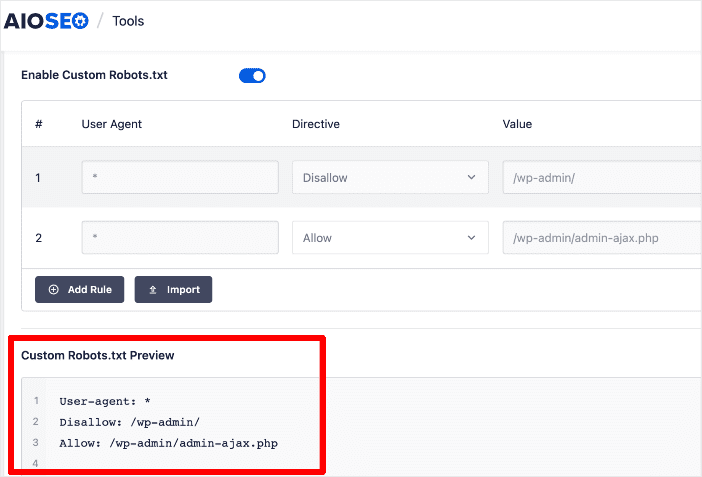

Una volta fatto ciò, puoi procedere e fare clic sul pulsante Salva Modifiche nell'angolo in basso a destra della pagina.

Una volta salvate le tue nuove regole, appariranno nella sezione Anteprima Robots.txt.

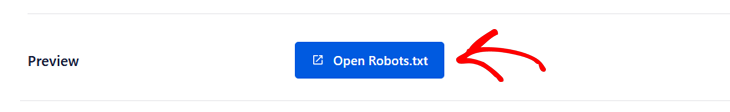

Per visualizzare il tuo file robots.txt, fai clic sul pulsante Apri Robots.txt.

Questo ti porterà all'URL in cui è ospitato il tuo robots.txt.

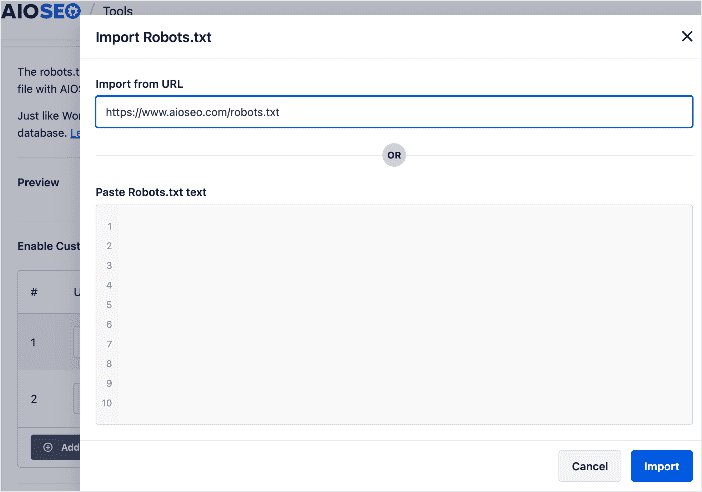

Metodo 2: Importa regole da un altro sito

Un altro modo semplice per aggiungere direttive nel tuo robots.txt è importarle da un altro sito. Questa funzione è utile se hai creato un sito o ne conosci uno con un file robots.txt che vorresti replicare.

Per importare un file robots.txt da un altro sito, vai al menu AIOSEO, quindi Strumenti » Robots.txt » Abilita Robots.txt Personalizzato.

Successivamente, fai clic sull'opzione Importa.

Si aprirà una finestra in cui puoi incollare l'URL del sito da cui desideri estrarre il file robots.txt.

Fai clic su Importa e ti verrà chiesto di ricaricare il tuo sito. Ricarica e il plugin estrarrà il file robots.txt e lo implementerà sul tuo sito.

In alternativa, puoi copiare il file robots.txt dal tuo sito di destinazione e incollarlo nello spazio fornito. Ancora una volta, fai clic su Importa e il file robots.txt verrà aggiunto al tuo sito.

Questo è probabilmente il modo più semplice per aggiungere un file robots.txt personalizzato al tuo sito WordPress.

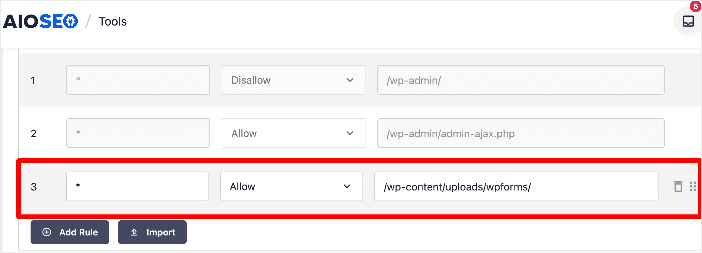

Modifica delle regole di robots.txt usando il Costruttore di Regole

Per modificare le tue regole robots.txt, puoi cambiare i dettagli nel generatore di regole.

Puoi anche eliminare una regola nel file robots.txt facendo clic sull'icona del cestino a destra della regola.

E non è tutto! L'editor robots.txt di AIOSEO ti consente di spostare le regole su o giù per posizionarle in ordine di priorità. Per farlo, fai clic e tieni premuti i 6 punti accanto al cestino per trascinare e riposizionare una regola.

Una volta terminata la modifica del tuo robots.txt, fai clic sul pulsante Salva modifiche per salvare le tue nuove regole.

Funzioni bonus di modifica Robots.txt

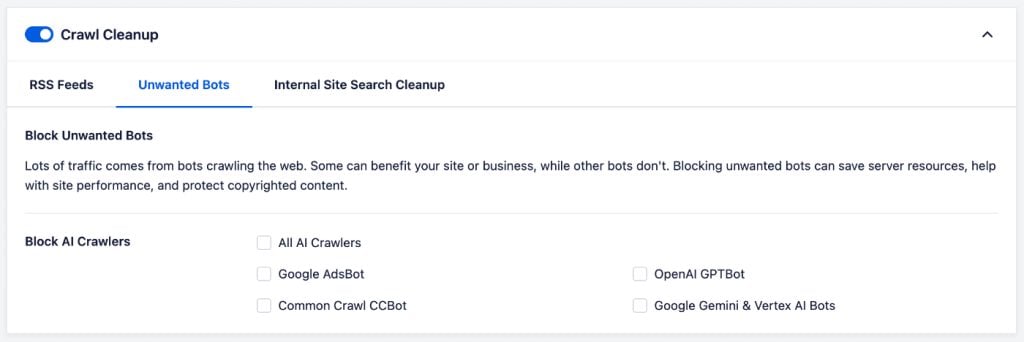

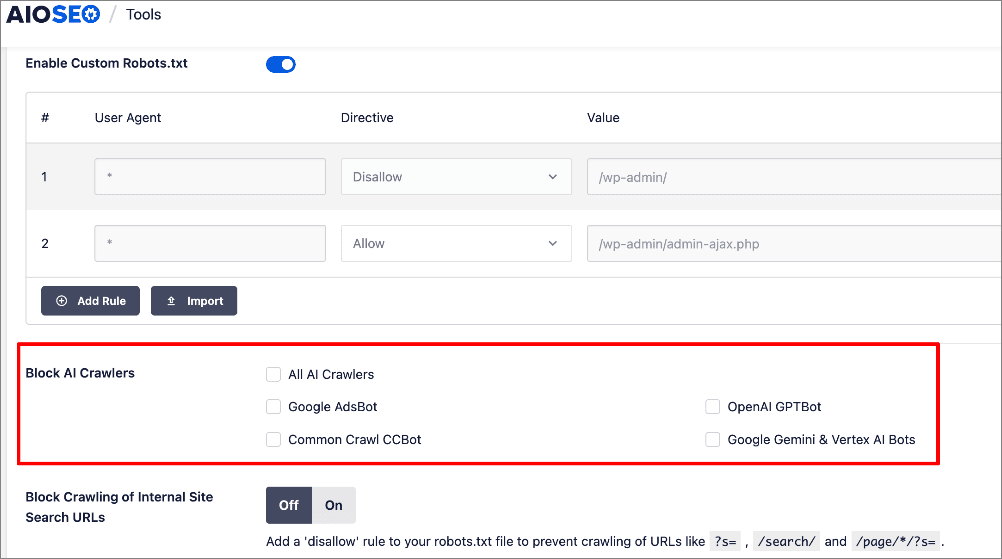

Blocco di bot o crawler indesiderati [Modo facile]

I web crawler, alias bot o spider, sono un'arma a doppio taglio. Molti, come i motori di ricerca, sono necessari per il successo del tuo sito. Tuttavia, alcuni possono semplicemente consumare le risorse del tuo server, rallentare il tuo sito o persino rubare i tuoi contenuti.

Come gestisco di solito questa cosa?

Poiché non ho un background tecnico, cerco sempre la via facile 😜. Il modo più semplice per impedire ai bot indesiderati di scansionare il tuo sito è utilizzare la funzione Crawl Cleanup di AIOSEO. Questa è dotata di impostazioni che ti aiutano a gestire il traffico dei bot sul tuo sito.

Questa funzione ti consente di selezionare i bot che desideri impedire di scansionare il tuo sito. Tutto quello che devi fare è selezionare quelli che desideri bloccare.

Quando blocchi un bot indesiderato, AIOSEO modifica il file robots.txt con le direttive disallow. Questa funzione è integrata anche nell'editor robots.txt per semplificare le cose.

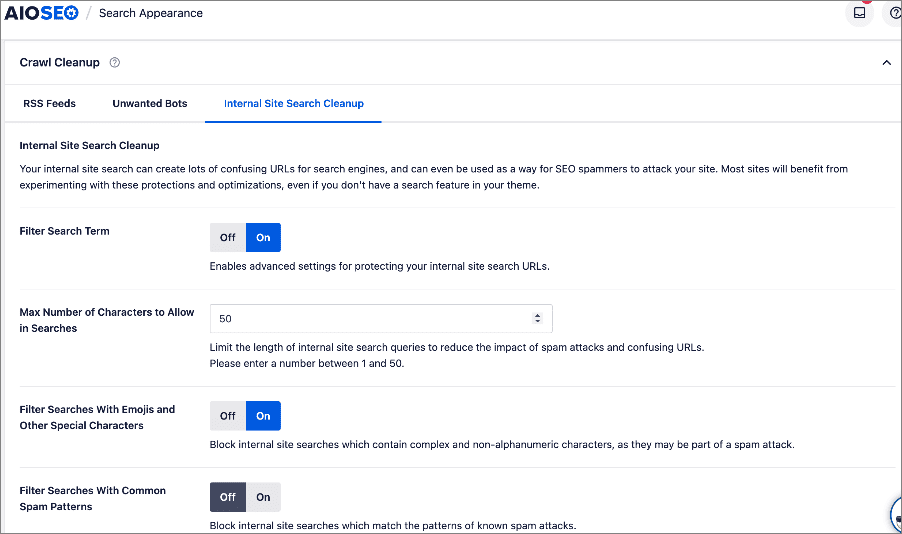

Blocco delle ricerche interne del sito

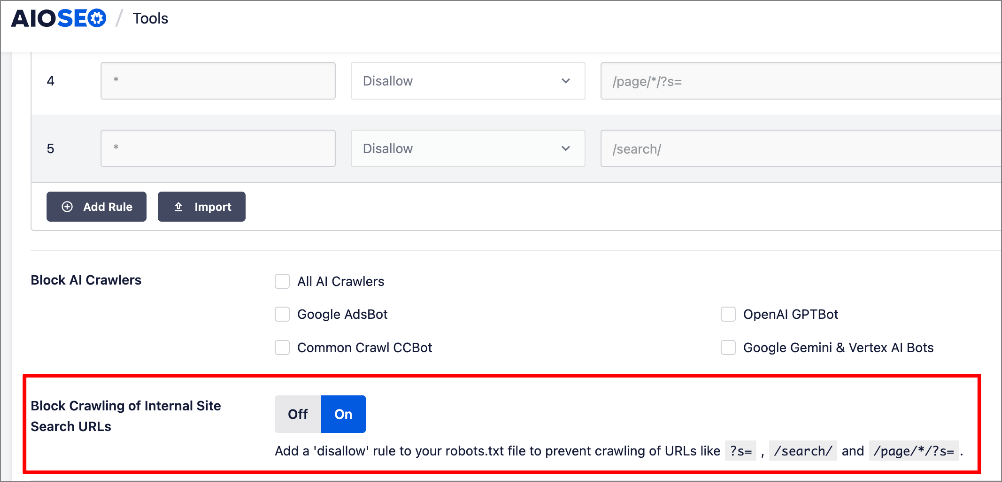

I siti Web generano spesso URL non necessari da ricerche interne, portando a budget di scansione sprecati e potenziali spam. Ancora una volta, questo può essere facilmente risolto utilizzando Crawl Cleanup di AIOSEO. Tutto quello che devi fare è configurare i filtri utilizzando i toggle.

AIOSEO ti dà il potere di controllare come i motori di ricerca e altri bot interagiscono con gli URL creati dalle ricerche interne del sito. Puoi:

- Impostare un limite massimo di caratteri per le query di ricerca, prevenendo URL di ricerca gonfiati.

- Filtrare automaticamente emoji e caratteri speciali per evitare termini di ricerca disordinati o senza senso.

- Bloccare schemi di spam comuni, impedendo alle ricerche spazzatura di creare URL indicizzabili non necessari.

Ancora una volta, AIOSEO modifica il tuo file robots.txt in backend. In alternativa, puoi anche configurare queste impostazioni nel tuo editor robots.txt:

Semplice come questo!

Hai modificato il tuo file robots.txt.

Modifica dei file Robots.txt: le tue FAQ hanno risposta

Cos'è un file robots.txt?

Un file robots.txt è un file di testo che i proprietari di siti Web utilizzano per comunicare con i web crawler o i bot riguardo a quali parti del loro sito dovrebbero essere scansionate e indicizzate dai motori di ricerca.

Dove si trova il file robots.txt?

Il file robots.txt si trova in genere nella directory principale di un sito Web. Il suo URL è solitamente https://www.example.com/robots.txt.

Qual è il modo migliore per modificare i file robots.txt?

Il modo migliore per modificare il tuo file robots.txt è utilizzare un plugin come All In One SEO (AIOSEO). È il miglior plugin SEO per WordPress e dispone di un editor robots.txt avanzato che rende l'ottimizzazione dei file robots.txt super facile.

Speriamo che questo tutorial ti abbia mostrato come modificare facilmente un file robots.txt in WordPress. Potresti anche voler consultare altri articoli sul nostro blog, come i nostri suggerimenti su come essere indicizzato su Google o la nostra guida su come utilizzare le statistiche di ricerca per aumentare il tuo posizionamento.

Se hai trovato utile questo articolo, iscriviti al nostro Canale YouTube. Troverai molti altri tutorial utili lì. Puoi anche seguirci su X (Twitter), LinkedIn o Facebook per rimanere aggiornato.

Divulgazione: I nostri contenuti sono supportati dai lettori. Ciò significa che se fai clic su alcuni dei nostri link, potremmo guadagnare una commissione. Raccomandiamo solo prodotti che crediamo aggiungeranno valore ai nostri lettori.

Ciao, grazie per l'articolo.

Ho recentemente letto il tuo articolo sul decadimento dei contenuti. Uno dei nostri problemi è la velocità delle pagine e ho lavorato per ridurre i tempi di caricamento. Tuttavia, non sono un professionista del codice o di qualcosa di remotamente correlato a cose tecniche. Di solito mi occupo di marketing e design.

Quindi, con questo background, la mia domanda è questa: quando carico immagini e scrivo le loro didascalie e i tag alt, voglio che appaiano nei risultati di ricerca per le ricerche di immagini, ma non voglio causare un gonfiore dell'indice.

Ci sono tattiche che mi consigli di usare per evitarlo? Ho già disabilitato la sitemap delle immagini (solo oggi), dopo aver letto che non è necessaria e non rimuoverà le mie immagini attuali dal sito.

Questo mi porta anche a fare una seconda domanda: come farò a sapere (come qualcuno che non sa leggere html, js o altro di questo tipo) se la disabilitazione della sitemap delle immagini è stata efficace nel migliorare la velocità di caricamento? Grazie per l'aiuto!