Vuoi sapere tutto quello che c'è da sapere sui file robots.txt di WordPress?

I file Robots.txt ti aiutano a controllare come i bot di ricerca interagiscono con il tuo sito. Questo lo rende uno strumento SEO molto utile per chi sa come usarlo.

In questo articolo, ti mostreremo tutto ciò che devi sapere sui file robots.txt di WordPress.

In questo articolo

- Cosa sono i file Robots.txt di WordPress

- 6 Reasons You Need a WordPress Robots.txt File

- How to Generate a WordPress Robots.txt File

- Tips for Optimizing WordPress Robots.txt Files

- Come testare i tuoi file Robots.txt di WordPress

- WordPress Robots.txt Files: Your FAQs Answered

- Usa saggiamente il potere del tuo file Robots.txt di WordPress

Cosa sono i file Robots.txt di WordPress

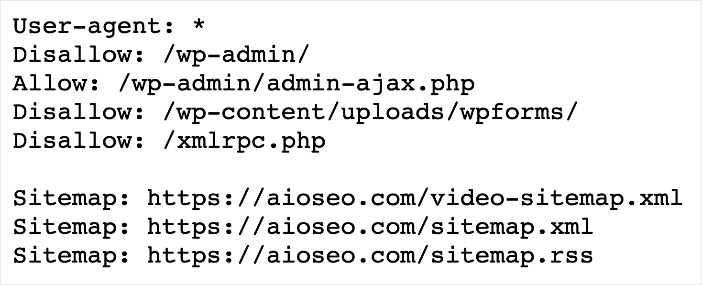

I file robots.txt di WordPress sono file di testo semplice che i proprietari di siti web creano per istruire i bot dei motori di ricerca su come interagire con i loro siti, principalmente quali pagine scansionare e quali ignorare. Il file è memorizzato nella directory principale di un sito web, nota anche come cartella principale.

In sostanza, un file robots.txt di WordPress agisce come il guardiano del tuo sito.

Ecco come appare:

Puoi accedere al tuo file robots.txt visitando https://tuosito.com/robots.txt.

Questo non va confuso con i tag meta robots, che sono tag HTML incorporati nell'intestazione di una pagina web. Il tag si applica solo alla pagina su cui si trova.

6 motivi per cui hai bisogno di un file Robots.txt di WordPress

Ora che sai cos'è un file robots.txt di WordPress, diamo una breve occhiata al motivo per cui ne hai bisogno.

1. Controlla il crawling dei motori di ricerca

Lo scopo principale di un file robots.txt di WordPress è controllare quali parti del tuo sito web i motori di ricerca (e altri bot) possono e non possono scansionare. Questo è fondamentale per garantire che i motori di ricerca si concentrino sulla scoperta dei contenuti che desideri appaiano sulle pagine dei risultati dei motori di ricerca (SERP), evitando pagine sensibili o irrilevanti.

2. Migliora l'indicizzazione

Un altro motivo per ottimizzare il tuo file robots.txt è che aiuta a migliorare l'indicizzazione del tuo sito. Puoi configurare il tuo file robots.txt per dare priorità al crawling e all'indicizzazione delle pagine importanti. Di conseguenza, ti assicuri che le pagine che contano di più per la tua attività abbiano maggiori possibilità di posizionarsi.

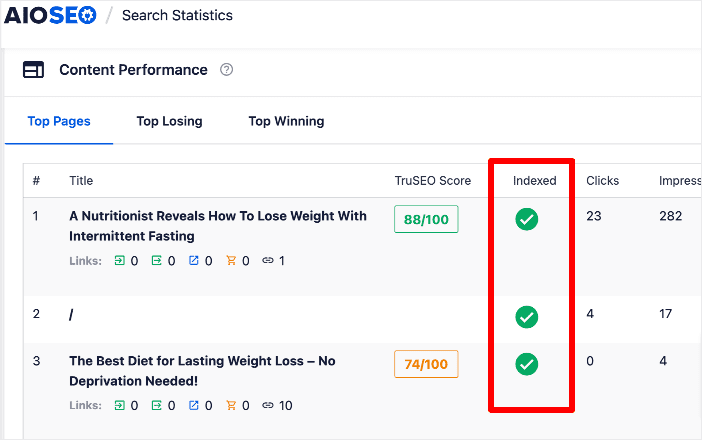

Puoi facilmente usare AIOSEO per controllare lo stato di indicizzazione dei tuoi post e delle tue pagine.

Questo ti aiuterà a tenere facilmente sotto controllo lo stato di indicizzazione delle tue pagine.

3. Evita contenuti duplicati

Contenuti duplicati si riferisce a pagine o post con contenuti identici o simili. Questo può influire negativamente sulla tua SEO se non gestito correttamente.

Un file robots.txt può essere utilizzato per impedire ai motori di ricerca di indicizzare più versioni dello stesso contenuto. Ciò contribuirà a garantire che la pagina che desideri posizionare venga sottoposta a scansione e indicizzata dai motori di ricerca.

4. Conservazione della larghezza di banda

I crawler dei motori di ricerca consumano risorse del server e larghezza di banda durante la scansione del tuo sito. Specificare quali pagine o directory devono essere sottoposte a scansione può aiutare a conservare le risorse del server e migliorare le prestazioni del tuo sito.

Può anche essere utilizzato per ottimizzare il budget di scansione, in quanto può aiutarti a dare priorità alle pagine e ai post da sottoporre a scansione.

5. Protezione della privacy

Se hai parti del tuo sito web contenenti informazioni sensibili o dati riservati, puoi impedire ai motori di ricerca di eseguirne la scansione e l'indicizzazione. Tutto ciò che devi fare è bloccare l'accesso a tali aree nel tuo robots.txt, contribuendo così a proteggere la tua privacy e sicurezza.

6. Migliora l'esperienza utente

Controllando quali pagine possono essere sottoposte a scansione e indicizzate dai motori di ricerca, puoi garantire che gli utenti vengano indirizzati ai contenuti più pertinenti e aggiornati del tuo sito. Ciò contribuisce a migliorare la loro esperienza complessiva.

Come puoi vedere, un file robots.txt di WordPress è fondamentale per la gestione del sito web. Se configurato correttamente, può avere un impatto significativo sulle prestazioni del tuo sito e sulla sua visibilità nei risultati dei motori di ricerca.

Come generare un file robots.txt di WordPress

Generare un file robots.txt di WordPress è abbastanza facile. Ecco i passaggi per farlo, senza bisogno di codice.

Passaggio 1: Installa AIOSEO

Il primo passo per generare file robots.txt personalizzati è installare e attivare All In One SEO (AIOSEO).

AIOSEO è un plugin SEO potente ma facile da usare che vanta oltre 3 milioni di installazioni attive. Milioni di blogger intelligenti utilizzano AIOSEO per aiutarli a migliorare i loro posizionamenti sui motori di ricerca e a generare traffico qualificato verso i loro blog. Questo perché il plugin dispone di molte potenti funzionalità e moduli progettati per aiutarti a configurare correttamente le tue impostazioni SEO. Gli esempi includono:

- Statistiche di ricerca: Questa potente integrazione con Google Search Console ti consente di monitorare il tuo posizionamento per parole chiave e vedere metriche SEO importanti con 1 clic, e altro ancora.

- Generatore di Schema di nuova generazione: questo generatore di schema no-code consente agli utenti di generare e pubblicare qualsiasi markup schema sul tuo sito.

- Gestore di reindirizzamenti: ti aiuta a gestire i reindirizzamenti ed eliminare gli errori 404, rendendo più facile per i motori di ricerca scansionare e indicizzare il tuo sito.

- Link Assistant: Potente strumento di collegamento interno che automatizza la creazione di collegamenti tra le pagine del tuo sito. Ti fornisce anche un audit dei link in uscita.

- SEO Preview: Offre una panoramica dei tuoi snippet di ricerca e social e della SEO generale in modo da poter migliorare la tua ottimizzazione.

- IndexNow: Per un'indicizzazione rapida sui motori di ricerca che supportano il protocollo IndexNow (come Bing e Yandex).

- Generatore di Sitemap: Genera automaticamente diversi tipi di sitemap per notificare a tutti i motori di ricerca eventuali aggiornamenti sul tuo sito.

- E altro ancora.

Per istruzioni passo passo su come installare AIOSEO, consulta la nostra guida all'installazione.

Una delle funzionalità più apprezzate è l'avanzato editor robots.txt. Questo potente strumento rende facile configurare e personalizzare il tuo file robots.txt di WordPress.

Nota: WordPress genera automaticamente un file robots.txt per ogni sito. Tuttavia, non è personalizzabile "out of the box". Per questo, avrai bisogno di un plugin. È qui che entrano in gioco strumenti come AIOSEO.

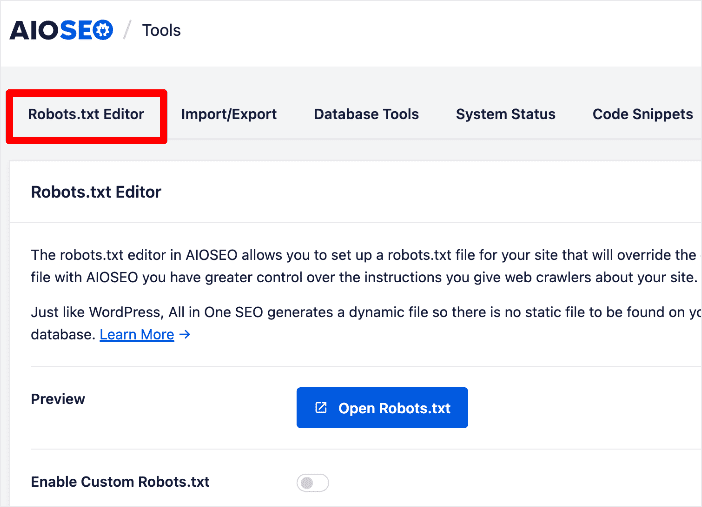

Passaggio 2: Apri l'editor del file Robots.txt di WordPress

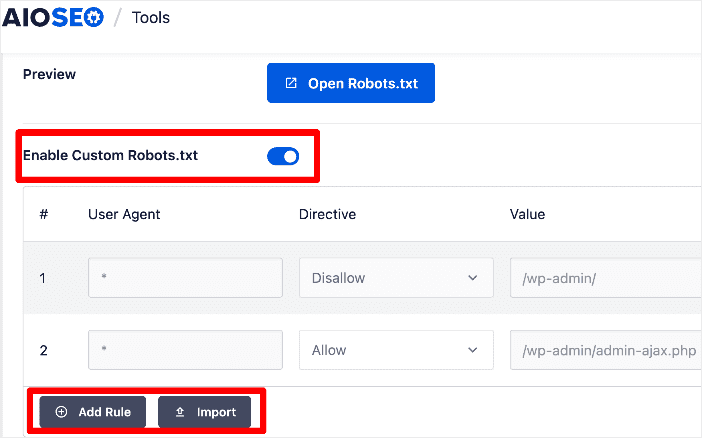

Una volta attivato AIOSEO, il passo successivo è aprire il tuo file robots.txt di WordPress in modalità editor. Per farlo, vai al menu AIOSEO e fai clic su Strumenti » Editor Robots.txt.

Successivamente, fai clic sull'interruttore Abilita Robots.txt personalizzato per abilitare la modifica del tuo file robots.txt.

Dai un'occhiata al nostro elenco dei migliori generatori di robots.txt per ulteriori opzioni.

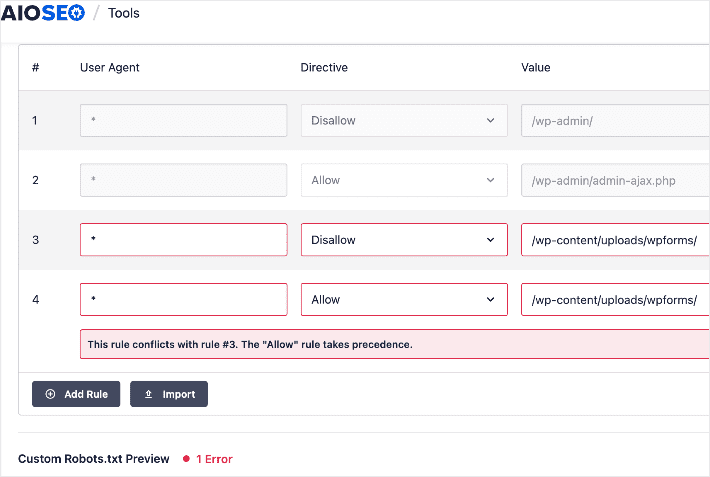

Passaggio 3: Configura le direttive del tuo Robots.txt

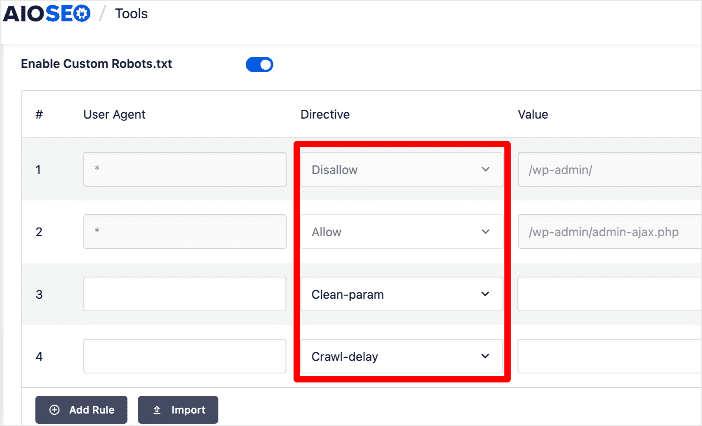

Una volta abilitata la modifica dei tuoi file robots.txt, il passo successivo è configurare direttive personalizzate nel tuo file robots.txt. Puoi anche impostare quali user agent (bot) devono seguire tali direttive.

Le direttive sono le istruzioni che vuoi che i bot di ricerca seguano. Esempi di direttive che troverai nell'editor robots.txt di AIOSEO includono Allow, Disallow, Clean-param e Crawl delay.

Ecco cosa significa ogni direttiva:

- Allow: Consente agli user agent (bot) di eseguire la scansione dell'URL.

- Disallow: Impedisce agli user agent (bot) di eseguire la scansione dell'URL.

- Clean-param: Indica ai bot di ricerca di ignorare tutti gli URL con i parametri URL specificati.

- Crawl-delay: Imposta gli intervalli per i bot di ricerca per eseguire la scansione dell'URL.

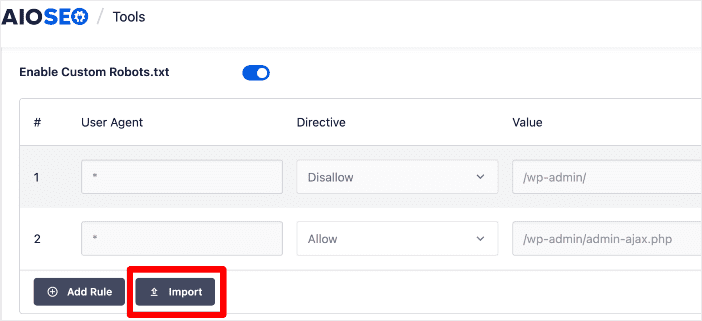

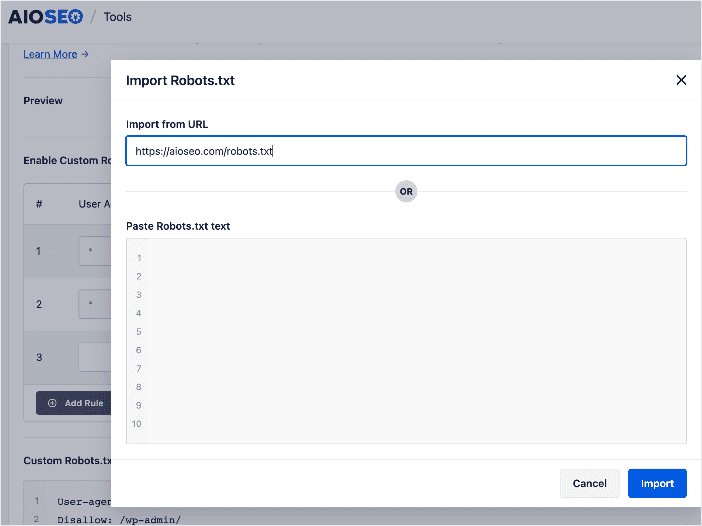

Oltre ad aggiungere manualmente le tue direttive, puoi importare un file robots.txt preconfigurato da un altro sito utilizzando la funzione Importa.

Facendo clic sul pulsante Importa si aprirà una finestra con 2 opzioni per importare il file robots.txt scelto: Importa da URL e Incolla testo Robots.txt.

Questo metodo è il migliore se il sito da cui stai importando il file robots.txt ha direttive che vorresti implementare sul tuo sito.

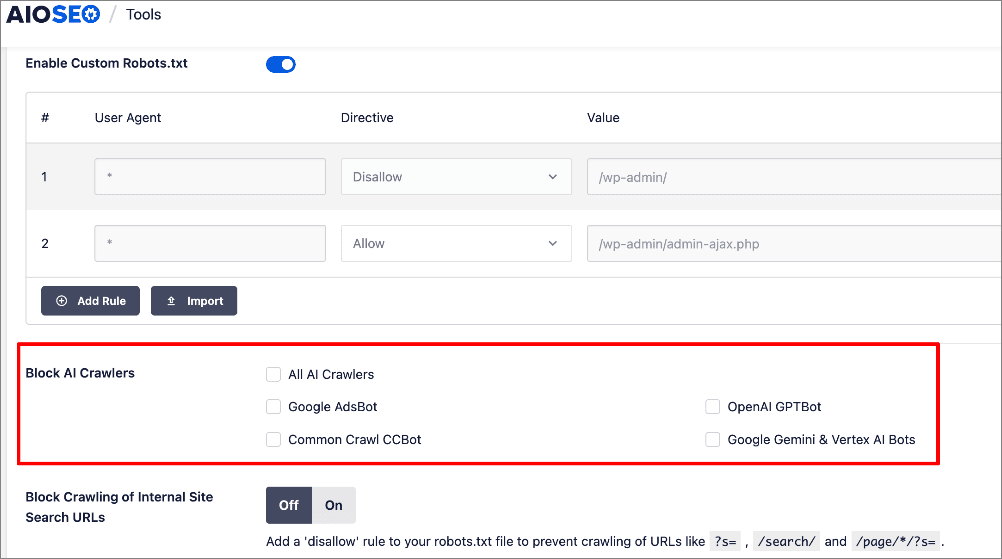

4. Blocca bot indesiderati

Un'altra fantastica funzionalità nell'Editor Robots.txt di AIOSEO è la sezione Blocca crawler AI. Questo ti consente di bloccare bot non autorizzati dall'indicizzazione del tuo sito. Questi possono causare problemi di prestazioni, sicurezza e SEO.

Per saperne di più, consulta il nostro tutorial su come bloccare il traffico di bot indesiderato sul tuo sito.

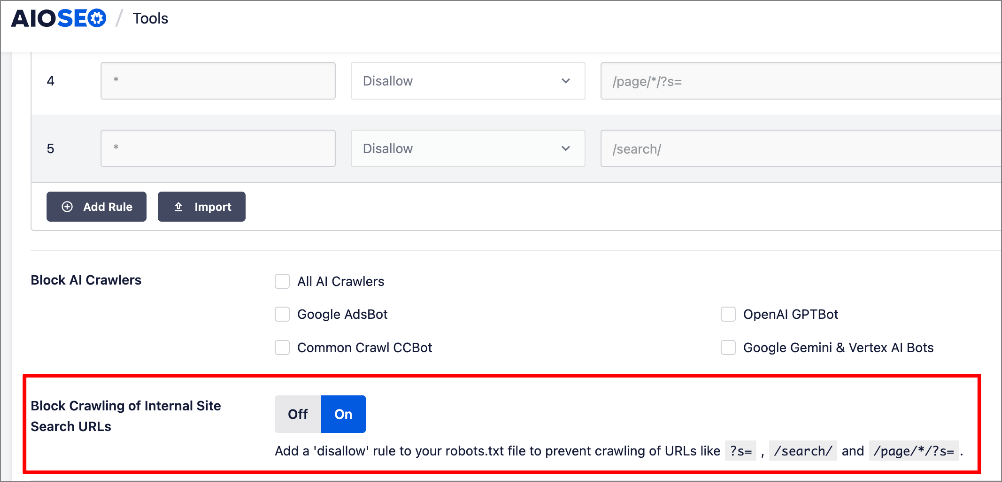

5. Impedisci il crawling degli URL di ricerca interna del sito

I siti web generano spesso URL in eccesso dalle ricerche interne quando i visitatori cercano contenuti o prodotti. Questi URL generati dalla ricerca contengono parametri che i motori di ricerca percepiscono come unici, inducendoli a scansionare pagine non necessarie. Ciò spreca il tuo budget di scansione e può impedire l'indicizzazione delle tue pagine più importanti.

Puoi facilmente impedirlo nell'Editor Robots.txt di AIOSEO.

AIOSEO aggiunge una regola "disallow" nel tuo file robots.txt senza che tu debba farlo per ogni parametro generato dalla ricerca.

Per maggiori informazioni, consulta il nostro tutorial su come modificare il tuo file robots.txt.

Suggerimenti per l'ottimizzazione dei file robots.txt di WordPress

Includi l'URL della tua Sitemap

Includere un link alla tua sitemap è essenziale per aiutare i bot di ricerca a scansionare e indicizzare le tue pagine importanti. Sebbene ometterlo dal tuo file robots.txt potrebbe non danneggiare la tua SEO, ha indubbiamente un impatto positivo. Fortunatamente, AIOSEO aggiunge automaticamente l'URL della tua sitemap quando genera un file robots.txt, quindi non è richiesta alcuna personalizzazione aggiuntiva.

Comprendi e usa i caratteri jolly con saggezza

Un carattere jolly è un carattere che può rappresentare uno o più caratteri. Il carattere jolly più comune è l'asterisco (*).

Se hai molte pagine che vuoi bloccare, può essere dispendioso in termini di tempo aggiungere una regola per ciascuna. Fortunatamente, puoi usare i caratteri jolly per semplificare le tue istruzioni.

I caratteri jolly sono caratteri speciali che consentono di creare regole basate su modelli nei file robots.txt di WordPress. Forniscono un modo per applicare direttive a un gruppo di URL che condividono un modello comune anziché specificare ogni URL individualmente. Esistono due tipi principali di caratteri jolly utilizzati in robots.txt:

- Carattere Jolly Asterisco (*): Rappresenta qualsiasi sequenza di caratteri ed è utilizzato per corrispondere agli URL che corrispondono a un modello specificato. Ad esempio, User-agent: * significa che tutti gli user agent devono seguire la direttiva prescritta.

- Carattere Jolly Segno del Dollaro ($): Viene utilizzato per corrispondere alla fine di un URL. Supponiamo che tu voglia bloccare l'accesso a tutti gli URL che terminano con “.pdf”, puoi usare il segno del dollaro in una direttiva come questa — Disallow: /*.pdf$.

Tuttavia, i caratteri jolly dovrebbero essere usati con cautela, poiché un uso improprio può bloccare o consentire involontariamente l'accesso a più pagine o directory.

Usa commenti per chiarezza

Aggiungi commenti nel tuo file robots.txt per spiegare le tue direttive. Questo aiuterà te e gli altri a capire lo scopo di ogni regola. Per aggiungere un commento, metti un cancelletto (#) all'inizio del commento. I bot di ricerca ignoreranno tutto ciò che segue il #.

Come testare i tuoi file Robots.txt di WordPress

Una volta terminata la generazione e la configurazione del tuo file robots.txt di WordPress, puoi testarlo per eventuali errori. Puoi utilizzare strumenti come il strumento di test robots.txt di Google Search Console.

Tuttavia, non ne avrai bisogno se utilizzi l'editor robots.txt di AIOSEO, poiché dispone di convalida delle regole e gestione degli errori integrate.

File robots.txt di WordPress: le tue FAQ hanno risposte

Cos'è un file robots.txt in WordPress?

Un file robots.txt è un file di testo normale posizionato nella directory principale di un sito web WordPress. Istruisce i crawler dei motori di ricerca riguardo a quali parti del sito devono essere scansionate e indicizzate e quali parti devono essere escluse.

Come posso generare robots.txt in WordPress?

Puoi facilmente generare un file robots.txt in WordPress utilizzando un plugin come All In One SEO (AIOSEO). Non hai nemmeno bisogno di conoscenze di programmazione o tecniche.

Posso usare robots.txt per migliorare la SEO?

Sì, ottimizzare il tuo file robots.txt può contribuire a un migliore SEO. Puoi migliorare la visibilità e il posizionamento del tuo sito web nei risultati di ricerca guidando i bot dei motori di ricerca a scansionare e indicizzare i tuoi contenuti più preziosi, escludendo al contempo contenuti duplicati o irrilevanti.

Usa saggiamente il potere del tuo file Robots.txt di WordPress

Il tuo file robots.txt di WordPress è uno strumento potente che può aiutarti a migliorare la tua scansionabilità, indicizzazione e posizionamento nelle SERP.

Speriamo che questo post ti abbia aiutato ad acquisire una conoscenza completa dei file robots.txt di WordPress e perché è importante ottimizzare il tuo. Potresti anche voler consultare altri articoli sul nostro blog, come la nostra guida su come creare contenuti scansionabili o il nostro tutorial su come utilizzare un generatore di titoli SEO per aumentare il tuo posizionamento e CTR.

Se hai trovato utile questo articolo, iscriviti al nostro Canale YouTube. Troverai molti altri tutorial utili lì. Puoi anche seguirci su X (Twitter), LinkedIn o Facebook per rimanere aggiornato.

Divulgazione: I nostri contenuti sono supportati dai lettori. Ciò significa che se fai clic su alcuni dei nostri link, potremmo guadagnare una commissione. Raccomandiamo solo prodotti che crediamo aggiungeranno valore ai nostri lettori.