Möchtest du wissen, wie du robots.txt-Dateien in WordPress bearbeitest?

Früher hat mich die Bearbeitung von robots.txt-Dateien in WordPress eingeschüchtert. Als jemand, der über ein Dutzend WordPress-Seiten erstellt und verwaltet hat, erinnere ich mich, wie ich auf meinen Bildschirm gestarrt habe, besorgt, dass ein falscher Schritt die SEO meiner Website ruinieren könnte.

Die robots.txt-Datei mag beängstigend wirken, aber es ist eigentlich eine einfache Textdatei, die Suchmaschinen mitteilt, welche Teile deiner Website sie zugreifen dürfen und welche nicht. Nach Jahren der Arbeit mit WordPress habe ich gelernt, dass die Bearbeitung dieser Datei überhaupt nicht kompliziert sein muss.

In dieser Schritt-für-Schritt-Anleitung zeige ich dir die einfachsten und sichersten Wege, deine robots.txt-Datei in WordPress zu bearbeiten. Egal, ob du bestimmte Seiten vor Suchmaschinen blockieren oder SEO-Probleme beheben möchtest, du wirst genau lernen, was zu tun ist.

Keine Sorge – ich führe dich durch jeden Schritt, damit du nichts kaputt machst.

In diesem Artikel

Was ist eine robots.txt-Datei?

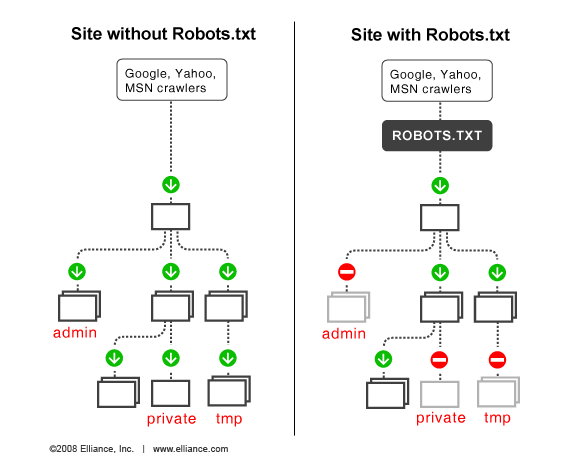

Eine robots.txt-Datei teilt Suchmaschinen mit, wie sie deine Website crawlen sollen – wohin sie gehen dürfen oder nicht.

Suchmaschinen wie Google verwenden diese Webcrawler, manchmal auch Web-Roboter genannt, um Websites zu archivieren und zu kategorisieren.

Die meisten Bots sind so konfiguriert, dass sie zuerst nach einer robots.txt-Datei auf dem Server suchen, bevor sie andere Dateien von deiner Website lesen. Dies geschieht, um zu sehen, ob du spezielle Anweisungen hinzugefügt hast, wie deine Website gecrawlt und indexiert werden soll.

Die robots.txt-Datei wird normalerweise im Stammverzeichnis, auch Hauptordner deiner Website genannt, gespeichert.

Die URL kann so aussehen:

http://www.example.com/robots.txt

Um die robots.txt-Datei für deine Website zu überprüfen, ersetzt du einfach http://www.example.com/ durch deine Domain und fügst robots.txt am Ende hinzu.

Schauen wir uns nun an, wie das grundlegende Format einer robots.txt-Datei aussieht:

User-agent: [user-agent name]

Disallow: [URL string not to be crawled]

User-agent: [user-agent name]

Allow: [URL string to be crawled]

Sitemap: [URL of your XML Sitemap]

User-agent bezieht sich auf den Suchmaschinen-Bot oder Roboter, den du blockieren oder dem du das Crawlen deiner Website erlauben möchtest (z. B. den Googlebot-Crawler).

Beim Bearbeiten deiner robots.txt-Datei kannst du mehrere Anweisungen einfügen, um bestimmte URLs zu erlauben oder zu verbieten, sowie mehrere Sitemaps hinzufügen. Du kannst auch URL-Parameter mit der Clean-param-Direktive ausschließen und die Häufigkeit der Besuche durch Suchbots mit der Crawl-delay-Direktive festlegen.

Standard-robots.txt-Datei in WordPress

Standardmäßig erstellt WordPress automatisch eine robots.txt-Datei für deine Website. Selbst wenn du keinen Finger rührst, sollte deine Website also bereits die Standard-WordPress-robots.txt-Datei haben.

Aber wenn Sie ihn später mit Ihren eigenen Regeln anpassen, werden die Standardinhalte ersetzt.

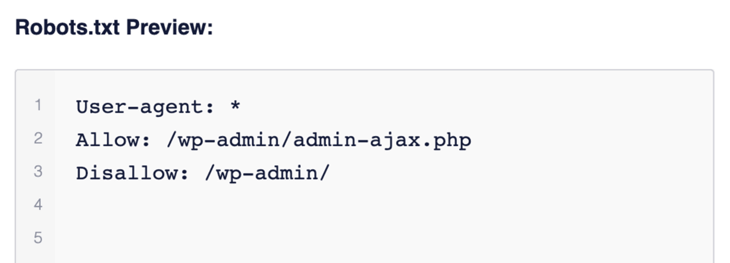

Hier ist, wie die Standard-WordPress-robots.txt-Datei aussieht:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Das Sternchen nach User-agent: * bedeutet, dass die robots.txt-Datei für alle Web-Robots gilt, die Ihre Website besuchen. Wie bereits erwähnt, weist Disallow: /wp-admin/ die Robots an, Ihre wp-admin-Seite nicht zu besuchen.

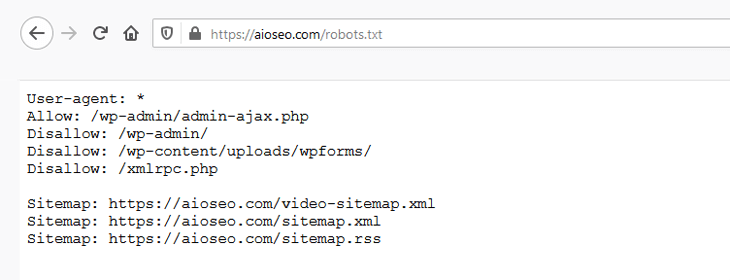

Sie können Ihre robots.txt-Datei testen, indem Sie /robots.txt am Ende Ihres Domainnamens hinzufügen. Wenn Sie beispielsweise „https://aioseo.com/robots.txt“ in Ihren Webbrowser eingeben, wird die robots.txt-Datei für AIOSEO angezeigt:

Nachdem Sie nun wissen, was eine robots.txt-Datei ist und wie sie funktioniert, wollen wir uns ansehen, warum die robots.txt-Datei überhaupt wichtig ist.

Warum ist die robots.txt-Datei wichtig?

Die robots.txt-Datei ist wichtig, wenn Sie:

- Optimieren Sie die Ladezeit Ihrer Website – Indem Sie Bots anweisen, keine Zeit mit Seiten zu verschwenden, die sie nicht crawlen und indizieren sollen, können Sie Ressourcen freigeben und die Ladezeit Ihrer Website erhöhen.

- Optimieren Sie Ihre Servernutzung – Das Blockieren von Bots, die Ressourcen verschwenden, bereinigt Ihren Server und reduziert 404-Fehler.

Wann du stattdessen das Meta-Noindex-Tag anstelle von robots.txt verwenden solltest

Wenn Ihr Hauptziel darin besteht, bestimmte Seiten von den Suchmaschinenergebnissen auszuschließen, ist die Verwendung eines Noindex-Meta-Tags der richtige Ansatz.

Dies liegt daran, dass robots.txt Suchmaschinen nicht direkt anweist, Inhalte nicht zu indizieren – es weist sie nur an, sie nicht zu crawlen.

Mit anderen Worten, Sie können robots.txt verwenden, um spezifische Regeln für die Interaktion von Suchmaschinen und anderen Bots mit Ihrer Website festzulegen, aber es wird nicht explizit gesteuert, ob Ihre Inhalte indiziert werden oder nicht.

Nachdem dies gesagt ist, zeigen wir Ihnen, wie Sie Ihre robots.txt-Datei in WordPress Schritt für Schritt mit AIOSEO bearbeiten können.

Bearbeiten Ihrer robots.txt in WordPress mit AIOSEO

Der einfachste Weg, die robots.txt-Datei zu bearbeiten, ist die Verwendung des besten WordPress-SEO-Plugins, All in One SEO (AIOSEO).

AIOSEO ist ein leistungsstarkes und dennoch einfach zu bedienendes SEO-Plugin, das über 3 Millionen Nutzer hat. Das bedeutet, dass Millionen von klugen Bloggern AIOSEO nutzen, um ihre Suchmaschinenrankings zu verbessern und qualifizierten Traffic auf ihre Blogs zu lenken. Das liegt daran, dass das Plugin viele leistungsstarke Funktionen und Module bietet, die Ihnen helfen, Ihre SEO-Einstellungen richtig zu konfigurieren. Beispiele hierfür sind:

- Suchstatistiken: Diese leistungsstarke Google Search Console-Integration ermöglicht es Ihnen, Ihre Keyword-Rankings zu verfolgen und wichtige SEO-Metriken mit einem Klick zu sehen und mehr.

- Next-Gen Schema-Generator: Dieser No-Code-Schema-Generator ermöglicht es Benutzern, beliebige Schema-Markup auf Ihrer Website zu generieren und auszugeben.

- Redirect Manager: Hilft Ihnen, Weiterleitungen zu verwalten und 404-Fehler zu eliminieren, wodurch es für Suchmaschinen einfacher wird, Ihre Website zu crawlen und zu indexieren.

- Link Assistant: Leistungsstarkes internes Verknüpfungstool, das automatisch Links zwischen Seiten auf Ihrer Website erstellt. Es gibt Ihnen auch eine Überprüfung der ausgehenden Links.

- SEO-Vorschau: Dies gibt Ihnen einen Überblick über Ihre Such- und Social-Snippets und allgemeine SEO, damit Sie Ihre Optimierung verbessern können.

- IndexNow: Für schnelle Indexierung auf Suchmaschinen, die das IndexNow-Protokoll unterstützen (wie Bing und Yandex).

- Sitemap-Generator: Generiert automatisch verschiedene Arten von Sitemaps, um alle Suchmaschinen über Aktualisierungen auf Ihrer Website zu informieren.

- Und mehr.

Ein Grund, warum Benutzer das Plugin lieben, ist, dass es Ihnen mehr Kontrolle darüber gibt, wie Suchmaschinen Ihre Website crawlen. Dies ist dank des erweiterten robots.txt-Editors möglich, mit dem Sie Ihre robots.txt-Datei einfach konfigurieren und die Standarddatei von WordPress überschreiben können.

Schauen Sie sich unsere Liste der besten robots.txt-Generatoren an.

Schauen Sie sich unsere Liste der besten robots.txt-Generatoren an.

Lassen Sie uns also Ihre robots.txt-Datei bearbeiten.

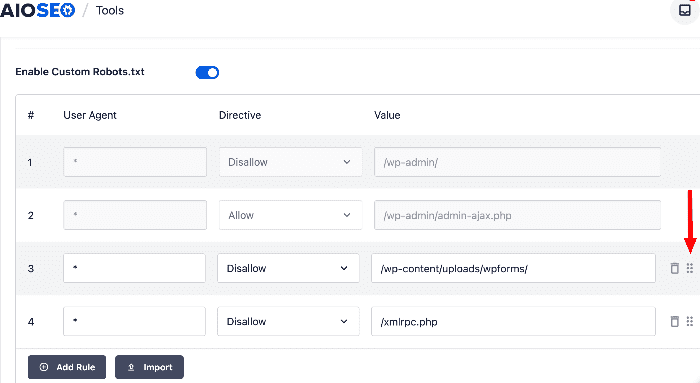

Um deine robots.txt-Datei zu bearbeiten, aktiviere zuerst benutzerdefinierte robots.txt

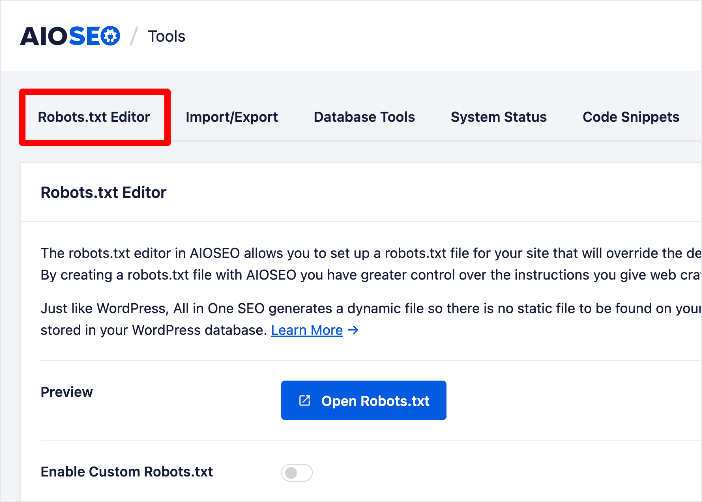

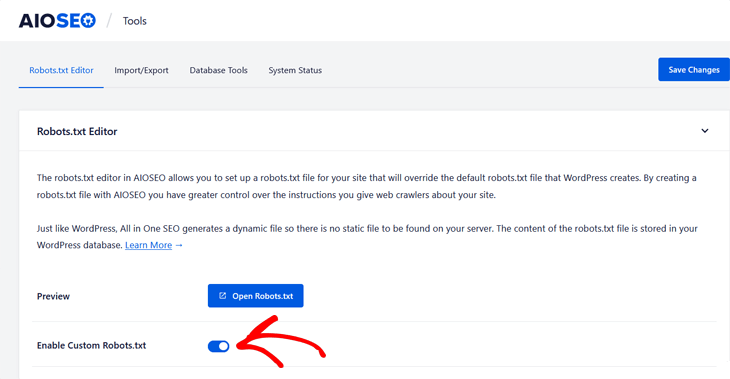

Um Ihre robots.txt-Datei zu bearbeiten, klicken Sie im All in One SEO-Menü auf Tools und dann auf die Registerkarte Robots.txt Editor.

AIOSEO generiert dann eine dynamische robots.txt-Datei. Ihr Inhalt wird in Ihrer WordPress-Datenbank gespeichert und kann in Ihrem Webbrowser angezeigt werden, wie wir Ihnen gleich zeigen werden.

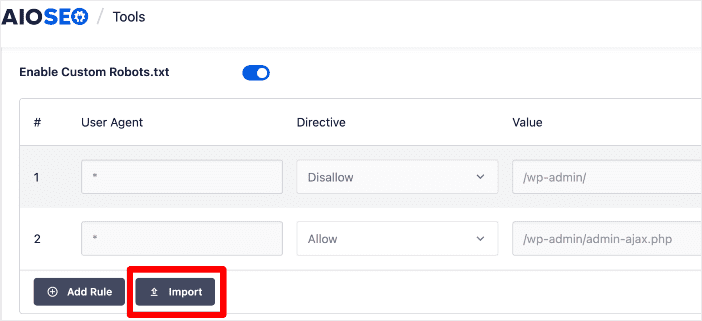

Sobald Sie den Robots.txt-Editor aufgerufen haben, müssen Sie Benutzerdefinierte Robots.txt aktivieren.

Klicken Sie auf die Schaltfläche, damit sie blau wird.

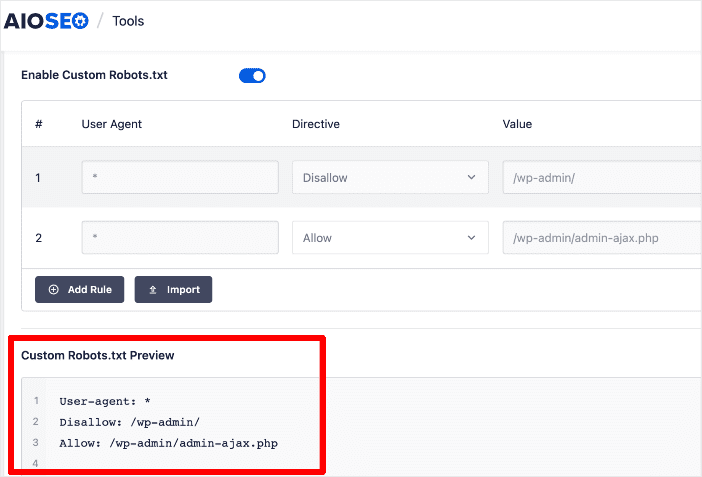

Anschließend sehen Sie unten auf dem Bildschirm den Abschnitt Robots.txt-Vorschau, der die Standardregeln von WordPress anzeigt, die Sie mit Ihren eigenen überschreiben können. Die Standardregeln weisen Bots an, Ihre Kern-WordPress-Dateien (Admin-Seiten) nicht zu crawlen.

Nun wollen wir Ihre eigenen Regeln hinzufügen. Sie können dies auf eine von zwei Arten tun: über den Regel-Builder oder durch Importieren einer robots.txt-Datei von einer anderen Website.

Methode 1: Regeln mit dem Regel-Builder hinzufügen

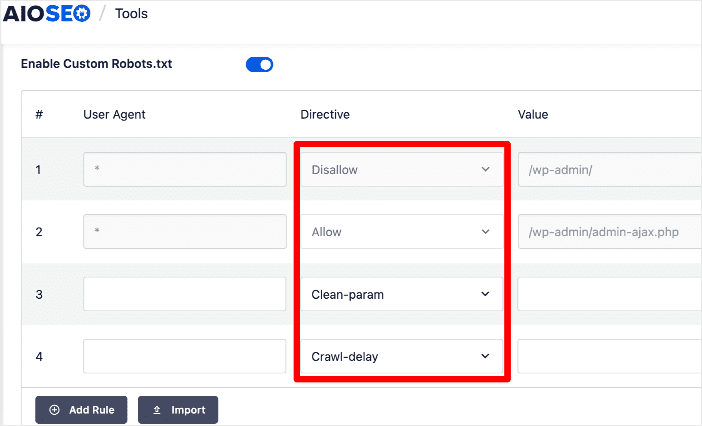

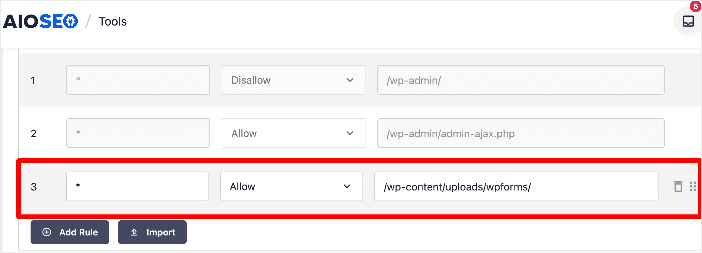

Der Regel-Builder wird verwendet, um Ihre eigenen benutzerdefinierten Regeln dafür hinzuzufügen, welche Seiten die Bots crawlen sollen oder nicht.

Sie können zum Beispiel den Regel-Builder verwenden, wenn Sie eine Regel hinzufügen möchten, die alle Bots aus einem temporären Verzeichnis blockiert.

Um eine benutzerdefinierte Regel hinzuzufügen, geben Sie den User-Agent (z. B. Googlebot-Crawler) in das Feld User-Agent ein. Oder Sie können das * Symbol verwenden, um Ihre Regel auf alle User-Agents (Bots) anzuwenden.

Wählen Sie als Nächstes eine der voreingestellten robots.txt-Direktiven aus: Allow, Disallow, Clean-param oder Crawl-delay.

Sie können weitere Direktiven hinzufügen, indem Sie auf die Schaltfläche Regel hinzufügen klicken.

Nachdem Sie sich für die anzuwendende Direktive entschieden haben, müssen Sie den Verzeichnispfad oder Dateinamen in das Feld Wert eingeben.

Sobald dies erledigt ist, können Sie auf die Schaltfläche Änderungen speichern unten rechts auf der Seite klicken.

Wenn Sie Ihre neuen Regeln gespeichert haben, werden sie im Abschnitt Robots.txt-Vorschau angezeigt.

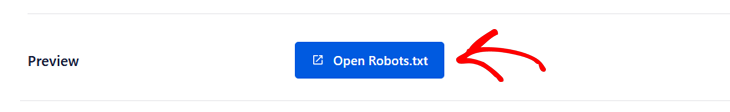

Um Ihre robots.txt-Datei anzuzeigen, klicken Sie auf die Schaltfläche Robots.txt öffnen.

Dies führt Sie zu der URL, auf der Ihre robots.txt gehostet wird.

Methode 2: Regeln von einer anderen Website importieren

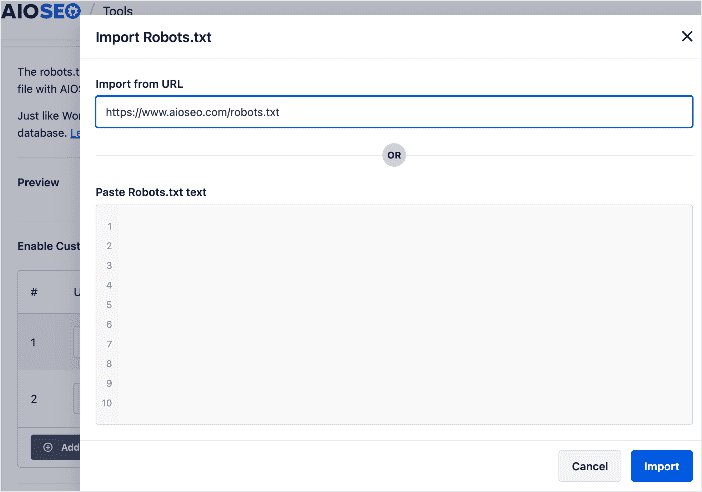

Eine weitere einfache Möglichkeit, Direktiven in Ihre robots.txt einzufügen, ist der Import von einer anderen Website. Diese Funktion ist praktisch, wenn Sie eine Website erstellt haben oder eine kennen, deren robots.txt-Datei Sie replizieren möchten.

Um eine robots.txt-Datei von einer anderen Website zu importieren, gehen Sie zum AIOSEO-Menü, dann zu Tools » Robots.txt » Benutzerdefinierte Robots.txt aktivieren.

Klicken Sie anschließend auf die Option Importieren.

Dadurch wird ein Fenster geöffnet, in das Sie die URL der Website einfügen können, von der Sie die robots.txt-Datei abrufen möchten.

Klicken Sie auf Importieren, und Sie werden aufgefordert, Ihre Website neu zu laden. Laden Sie neu, und das Plugin ruft die robots.txt-Datei ab und implementiert sie auf Ihrer Website.

Alternativ können Sie die robots.txt-Datei von Ihrer Ziel-Website kopieren und in den bereitgestellten Bereich einfügen. Klicken Sie erneut auf Importieren, und die robots.txt-Datei wird Ihrer Website hinzugefügt.

Dies ist wahrscheinlich der einfachste Weg, eine benutzerdefinierte robots.txt-Datei zu Ihrer WordPress-Website hinzuzufügen.

Bearbeiten der robots.txt-Regeln mit dem Regel-Builder

Um Ihre robots.txt-Regeln zu bearbeiten, können Sie die Details im Regel-Builder ändern.

Sie können auch eine Regel in der robots.txt-Datei löschen, indem Sie auf das Papierkorb-Symbol rechts neben der Regel klicken.

Und das ist noch nicht alles! Der robots.txt-Editor von AIOSEO ermöglicht es Ihnen, Regeln nach oben oder unten zu verschieben, um sie nach Priorität zu ordnen. Klicken Sie dazu auf die 6 Punkte neben dem Papierkorb, halten Sie sie gedrückt und ziehen Sie sie, um eine Regel neu zu positionieren.

Wenn Sie mit der Bearbeitung Ihrer robots.txt fertig sind, klicken Sie auf die Schaltfläche Änderungen speichern, um Ihre neuen Regeln zu sichern.

Zusätzliche Funktionen zur Bearbeitung von Robots.txt

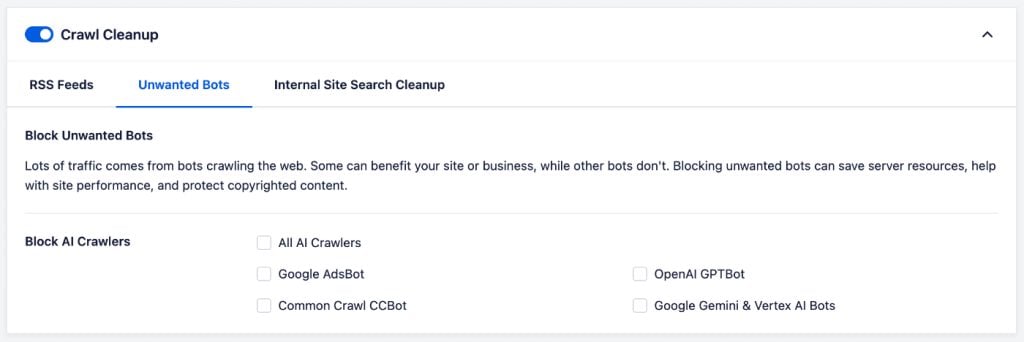

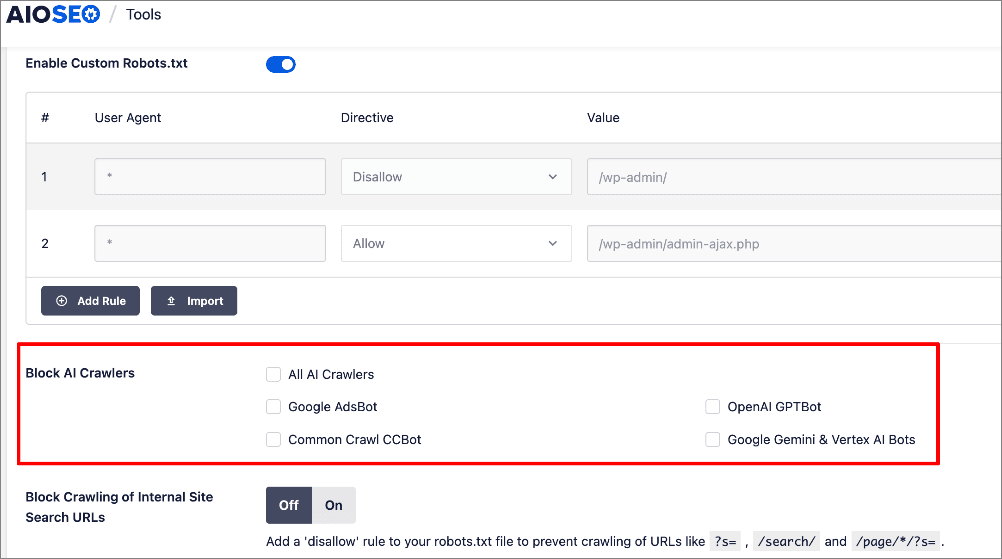

Blockieren unerwünschter Bots oder Webcrawler [Einfacher Weg]

Web-Crawler, auch bekannt als Bots oder Spider, sind ein zweischneidiges Schwert. Viele, wie Suchmaschinen, sind für den Erfolg Ihrer Website unerlässlich. Andere können jedoch einfach Ihre Serverressourcen beanspruchen, Ihre Website verlangsamen oder sogar Ihre Inhalte stehlen.

Wie gehe ich normalerweise damit um?

Da ich keinen technischen Hintergrund habe, suche ich immer nach dem einfachen Weg 😜. Der einfachste Weg, unerwünschte Bots vom Crawlen Ihrer Website abzuhalten, ist die Verwendung der Crawl Cleanup-Funktion von AIOSEO. Diese verfügt über Einstellungen, die Ihnen helfen, den Bot-Traffic auf Ihrer Website zu verwalten.

Diese Funktion ermöglicht es Ihnen, die Bots auszuwählen, die Sie von der Indizierung Ihrer Website ausschließen möchten. Sie müssen nur die auswählen, die Sie blockieren möchten.

Wenn Sie einen unerwünschten Bot blockieren, bearbeitet AIOSEO die robots.txt-Datei mit den Disallow-Direktiven. Diese Funktion ist auch in den robots.txt-Editor integriert, um dies zu erleichtern.

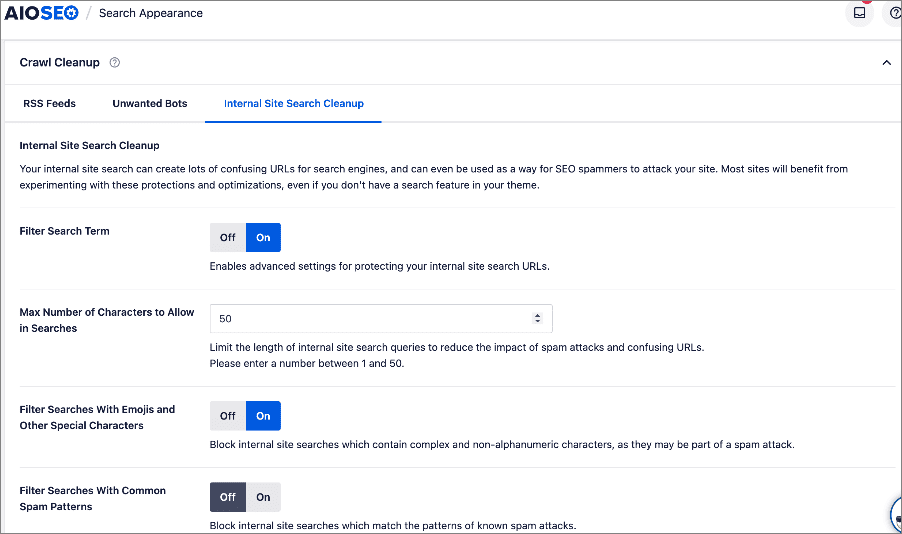

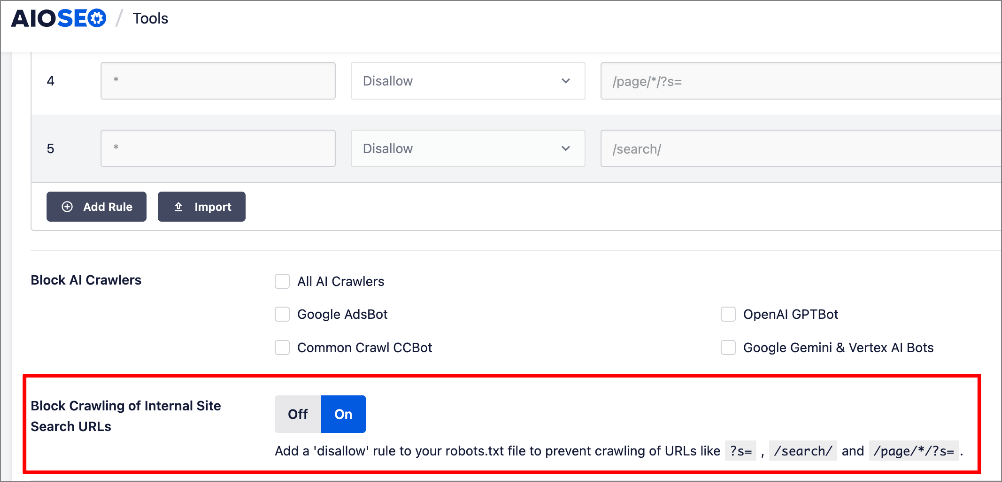

Blockieren interner Websuchen

Websites generieren oft unnötige URLs aus internen Suchen, was zu verschwendeten Crawl-Budgets und potenziellem Spam führt. Auch dies kann leicht mit AIOSEOs Crawl Cleanup gelöst werden. Sie müssen nur die Filter mit Schaltern konfigurieren.

AIOSEO gibt Ihnen die Kontrolle darüber, wie Suchmaschinen und andere Bots mit URLs interagieren, die von internen Websuchen erstellt wurden. Sie können:

- Eine maximale Zeichenbegrenzung für Suchanfragen festlegen, um überladene Such-URLs zu verhindern.

- Emojis und Sonderzeichen automatisch herausfiltern, um unübersichtliche oder unsinnige Suchbegriffe zu vermeiden.

- Gängige Spam-Muster blockieren, damit Junk-Suchen keine unnötigen indexierbaren URLs erstellen.

Auch hier bearbeitet AIOSEO Ihre robots.txt-Datei im Backend. Alternativ können Sie diese Einstellungen auch in Ihrem robots.txt-Editor konfigurieren:

So einfach ist das!

Sie haben Ihre robots.txt-Datei bearbeitet.

Bearbeitung von Robots.txt-Dateien: Ihre FAQs beantwortet

Was ist eine robots.txt-Datei?

Eine robots.txt-Datei ist eine Textdatei, die Website-Besitzer verwenden, um mit Web-Crawlern oder Bots zu kommunizieren, welche Teile ihrer Website von Suchmaschinen gecrawlt und indiziert werden sollen.

Wo befindet sich die robots.txt-Datei?

Die robots.txt-Datei befindet sich normalerweise im Stammverzeichnis einer Website. Ihre URL ist normalerweise https://www.example.com/robots.txt.

Was ist der beste Weg, robots.txt-Dateien zu bearbeiten?

Der beste Weg, Ihre robots.txt-Datei zu bearbeiten, ist die Verwendung eines Plugins wie All In One SEO (AIOSEO). Es ist das beste WordPress-SEO-Plugin und verfügt über einen fortschrittlichen robots.txt-Editor, der die Optimierung von robots.txt-Dateien super einfach macht.

Wir hoffen, dieses Tutorial hat Ihnen gezeigt, wie Sie eine robots.txt-Datei in WordPress einfach bearbeiten können. Möglicherweise möchten Sie auch andere Artikel in unserem Blog lesen, wie z. B. unsere Tipps zum Indexieren bei Google oder unseren Leitfaden zur Verwendung von Suchstatistiken zur Steigerung Ihrer Rankings.

Wenn Sie diesen Artikel hilfreich fanden, abonnieren Sie bitte unseren YouTube-Kanal. Dort finden Sie viele weitere hilfreiche Tutorials. Sie können uns auch auf X (Twitter), LinkedIn oder Facebook folgen, um auf dem Laufenden zu bleiben.

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.

Hallo, danke für den Artikel.

Ich habe mich kürzlich mit Ihrem Artikel über Content Decay beschäftigt. Eines unserer Probleme ist die Seitengeschwindigkeit, und ich habe daran gearbeitet, die Ladezeit zu verkürzen. Allerdings bin ich kein Profi im Programmieren oder in irgendetwas, das mit Technik zu tun hat. Ich beschäftige mich normalerweise mit Marketing und Design.

Mit diesem Hintergrund lautet meine Frage: Wenn ich Bilder hochlade und ihre Bildunterschriften und Alt-Tags schreibe, möchte ich, dass sie in den Suchergebnissen für Bildersuchen erscheinen, aber ich möchte keinen Index-Bloat verursachen.

Gibt es Taktiken, die Sie mir empfehlen, um dies zu vermeiden? Ich habe die Bilder-Sitemap bereits deaktiviert (gerade heute), nachdem ich gelesen hatte, dass sie nicht notwendig ist und meine aktuellen Bilder nicht von der Website entfernt werden.

Das führt mich auch zu einer zweiten Frage: Woher weiß ich (als jemand, der kein HTML, JS oder Ähnliches lesen kann), ob die Deaktivierung der Bilder-Sitemap die Ladezeit verbessert hat? Danke für die Hilfe!