Voulez-vous tout savoir sur les fichiers robots.txt de WordPress ?

Les fichiers robots.txt vous aident à contrôler la manière dont les robots d'exploration des moteurs de recherche interagissent avec votre site. C'est donc un outil SEO très utile pour ceux qui savent l'utiliser.

Dans cet article, nous vous montrerons tout ce que vous devez savoir sur les fichiers robots.txt de WordPress.

Dans cet article

- Que sont les fichiers Robots.txt de WordPress

- 6 Reasons You Need a WordPress Robots.txt File

- How to Generate a WordPress Robots.txt File

- Tips for Optimizing WordPress Robots.txt Files

- Comment tester vos fichiers Robots.txt WordPress

- WordPress Robots.txt Files: Your FAQs Answered

- Utilisez judicieusement la puissance de votre fichier Robots.txt WordPress

Que sont les fichiers Robots.txt de WordPress

Les fichiers robots.txt de WordPress sont des fichiers texte brut que les propriétaires de sites Web créent pour indiquer aux robots des moteurs de recherche comment interagir avec leurs sites, principalement quelles pages explorer et lesquelles ignorer. Le fichier est stocké dans le répertoire racine d'un site Web, également connu sous le nom de dossier principal.

Essentiellement, un fichier robots.txt WordPress agit comme le gardien de votre site.

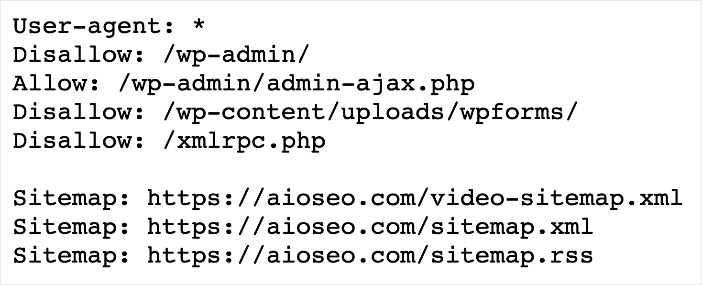

Voici à quoi il ressemble :

Vous pouvez accéder à votre fichier robots.txt en visitant https://votresite.com/robots.txt.

Cela ne doit pas être confondu avec les balises meta robots, qui sont des balises HTML intégrées dans l'en-tête d'une page Web. La balise ne s'applique qu'à la page sur laquelle elle se trouve.

6 raisons pour lesquelles vous avez besoin d'un fichier Robots.txt WordPress

Maintenant que vous savez ce qu'est un fichier robots.txt WordPress, examinons brièvement pourquoi vous en avez besoin.

1. Contrôler l'exploration par les moteurs de recherche

L'objectif principal d'un fichier robots.txt WordPress est de contrôler quelles parties de votre site Web les moteurs de recherche (et autres robots) peuvent et ne peuvent pas explorer. Ceci est crucial pour s'assurer que les moteurs de recherche se concentrent sur la découverte du contenu que vous souhaitez voir apparaître sur les pages de résultats des moteurs de recherche (SERP) tout en évitant les pages sensibles ou non pertinentes.

2. Améliorer l'indexation

Une autre raison pour laquelle vous devriez optimiser votre fichier robots.txt est qu'il permet d'améliorer l'indexation de votre site. Vous pouvez configurer votre fichier robots.txt pour prioriser l'exploration et l'indexation des pages importantes. Par conséquent, vous vous assurez que les pages les plus importantes pour votre entreprise ont une meilleure chance de se classer.

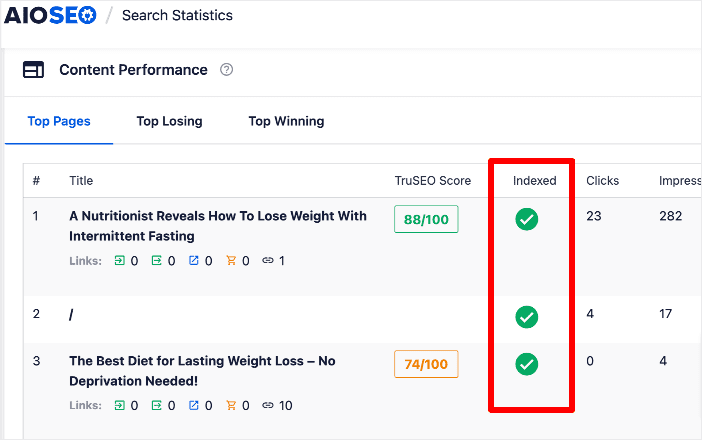

Vous pouvez facilement utiliser AIOSEO pour vérifier le statut d'indexation de vos articles et pages.

Cela vous aidera à garder facilement un œil sur le statut d'indexation de vos pages.

3. Éviter le contenu dupliqué

Le contenu dupliqué fait référence à des pages ou des articles avec un contenu identique ou similaire. Cela peut avoir un impact négatif sur votre SEO si cela n'est pas traité correctement.

Un fichier robots.txt peut être utilisé pour empêcher les moteurs de recherche d'indexer plusieurs versions du même contenu. Cela permettra de garantir que la page que vous souhaitez classer soit explorée et indexée par les moteurs de recherche.

4. Conservation de la bande passante

Les robots d'exploration des moteurs de recherche consomment des ressources serveur et de la bande passante lors de l'exploration de votre site. Spécifier quelles pages ou répertoires doivent être explorés peut aider à conserver les ressources serveur et à améliorer les performances de votre site.

Il peut également être utilisé pour optimiser le budget d'exploration, car il peut vous aider à prioriser les pages et les articles à explorer.

5. Protection de la vie privée

Si vous avez des parties de votre site Web contenant des informations sensibles ou des données confidentielles, vous pouvez empêcher les moteurs de recherche de les explorer et de les indexer. Il vous suffit de bloquer l'accès à ces zones dans votre robots.txt, protégeant ainsi votre vie privée et votre sécurité.

6. Améliorer l'expérience utilisateur

En contrôlant quelles pages peuvent être explorées et indexées par les moteurs de recherche, vous pouvez vous assurer que les utilisateurs sont dirigés vers le contenu le plus pertinent et le plus récent de votre site. Cela contribue à améliorer leur expérience globale.

Comme vous pouvez le constater, un fichier robots.txt WordPress est fondamental pour la gestion d'un site Web. Configurément correctement, il peut avoir un impact significatif sur les performances de votre site et sa visibilité dans les résultats des moteurs de recherche.

Comment générer un fichier robots.txt WordPress

Générer un fichier robots.txt WordPress est assez facile. Voici les étapes à suivre — aucun code n'est requis.

Étape 1 : Installer AIOSEO

La première étape pour générer des fichiers robots.txt personnalisés consiste à installer et activer All In One SEO (AIOSEO).

AIOSEO est un plugin SEO puissant mais facile à utiliser qui compte plus de 3 millions d'installations actives. Des millions de blogueurs avisés utilisent AIOSEO pour les aider à améliorer leur classement dans les moteurs de recherche et à générer du trafic qualifié vers leurs blogs. C'est parce que le plugin dispose de nombreuses fonctionnalités et modules puissants conçus pour vous aider à configurer correctement vos paramètres SEO. Exemples :

- Statistiques de recherche : Cette puissante intégration Google Search Console vous permet de suivre vos classements de mots-clés et de voir les métriques SEO importantes en 1 clic, et plus encore.

- Générateur de schéma nouvelle génération : ce générateur de schéma sans code permet aux utilisateurs de générer et de publier n’importe quel balisage de schéma sur votre site.

- Gestionnaire de redirections : Vous aide à gérer les redirections et à éliminer les erreurs 404, ce qui facilite l'exploration et l'indexation de votre site par les moteurs de recherche.

- Assistant de liens : Un puissant outil de liens internes qui automatise la création de liens entre les pages de votre site. Il vous donne également un audit des liens sortants.

- Aperçu SEO : Cela vous donne un aperçu de vos extraits de recherche et sociaux et du SEO général afin que vous puissiez améliorer votre optimisation.

- IndexNow : Pour un indexage rapide sur les moteurs de recherche qui prennent en charge le protocole IndexNow (comme Bing et Yandex).

- Générateur de sitemap : Générez automatiquement différents types de sitemaps pour informer tous les moteurs de recherche de toute mise à jour sur votre site.

- Et plus encore.

Pour des instructions étape par étape sur la façon d'installer AIOSEO, consultez notre guide d'installation.

L'une des fonctionnalités les plus appréciées est l'éditeur robots.txt avancé. Cet outil puissant facilite la configuration et la personnalisation de votre fichier robots.txt WordPress.

Note : WordPress génère automatiquement un fichier robots.txt pour chaque site. Cependant, il n'est pas personnalisable tel quel. Pour cela, vous aurez besoin d'un plugin. C'est là qu'interviennent des outils comme AIOSEO.

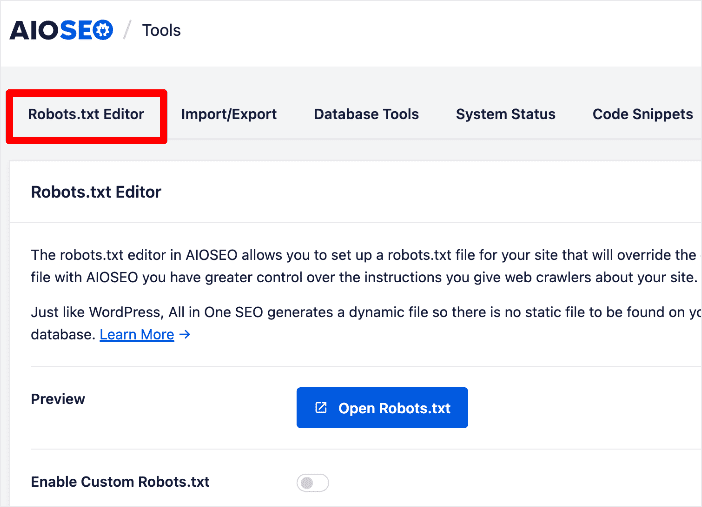

Étape 2 : Ouvrez l'éditeur de votre fichier Robots.txt WordPress

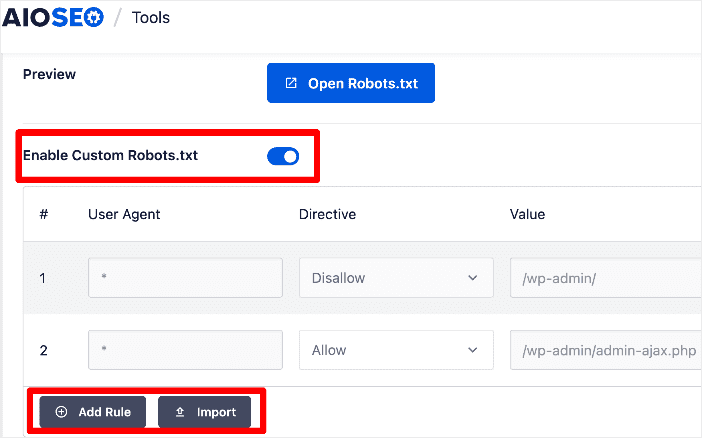

Une fois que vous avez activé AIOSEO, l'étape suivante consiste à ouvrir votre fichier robots.txt WordPress en mode édition. Pour ce faire, allez dans votre menu AIOSEO et cliquez sur Outils » Éditeur Robots.txt.

Ensuite, cliquez sur le bouton Activer le Robots.txt personnalisé pour activer la modification de votre fichier robots.txt.

Consultez notre liste des meilleurs générateurs de robots.txt pour plus d'options.

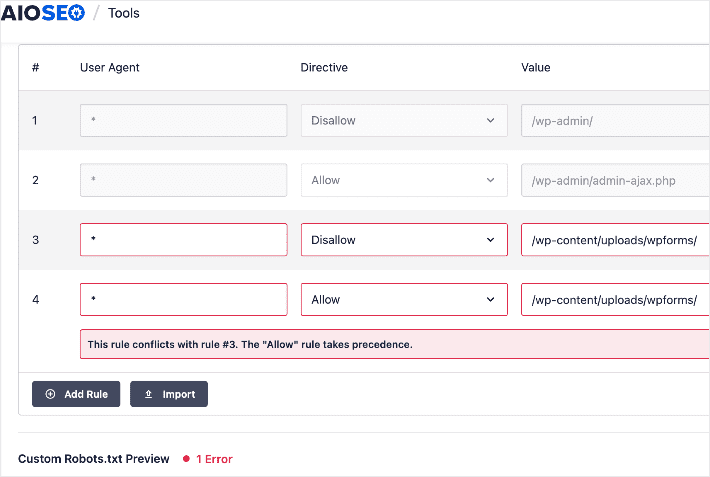

Étape 3 : Configurez vos directives Robots.txt

Une fois que vous avez activé la modification de vos fichiers robots.txt, l'étape suivante consiste à configurer des directives personnalisées dans votre fichier robots.txt. Vous pouvez également définir quels agents utilisateurs (bots) doivent suivre lesdites directives.

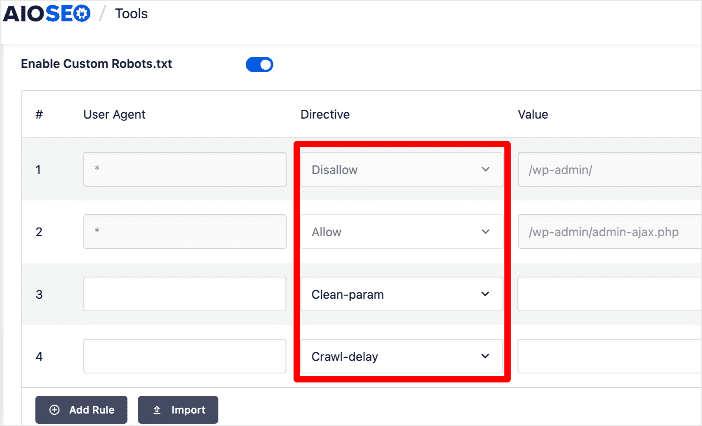

Les directives sont les instructions que vous souhaitez que les robots de recherche suivent. Les exemples de directives que vous trouverez dans l'éditeur robots.txt d'AIOSEO incluent Allow, Disallow, Clean-param et Crawl delay.

Voici ce que signifie chaque directive :

- Allow : Permet aux agents utilisateurs (robots) d'explorer l'URL.

- Disallow : Interdit aux agents utilisateurs (robots) d'explorer l'URL.

- Clean-param : Indique aux robots d'exploration d'ignorer toutes les URL avec les paramètres d'URL spécifiés.

- Crawl-delay : Définit les intervalles pour que les robots d'exploration explorent l'URL.

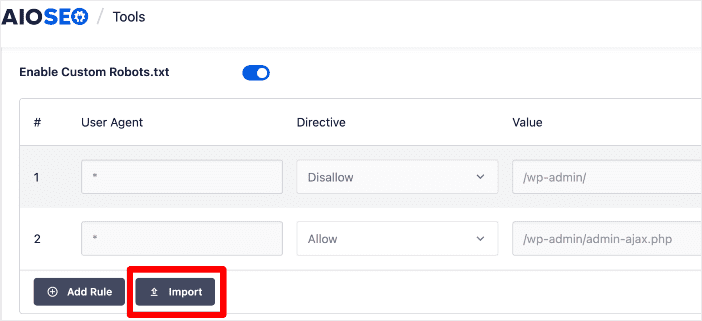

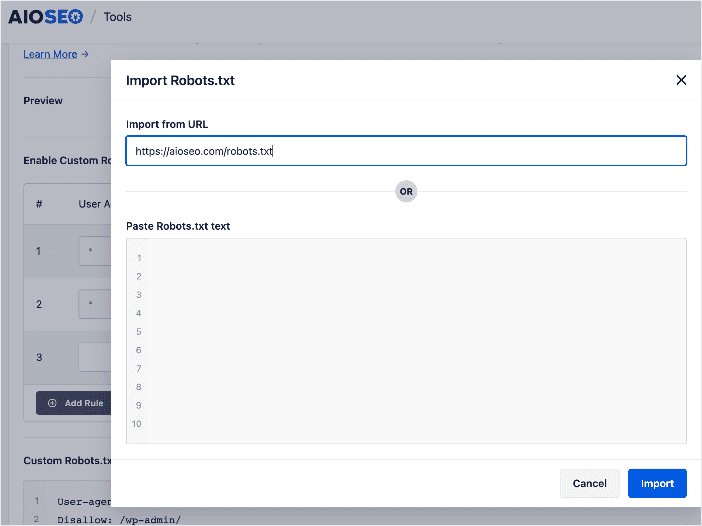

En plus d'ajouter manuellement vos directives, vous pouvez importer un fichier robots.txt préconfiguré d'un autre site en utilisant la fonction Importer.

Cliquer sur le bouton Importer ouvrira une fenêtre avec 2 options pour importer le fichier robots.txt choisi : Importer depuis une URL et Coller le texte Robots.txt.

Cette méthode est préférable si le site à partir duquel vous importez le fichier robots.txt contient des directives que vous souhaitez implémenter sur votre site.

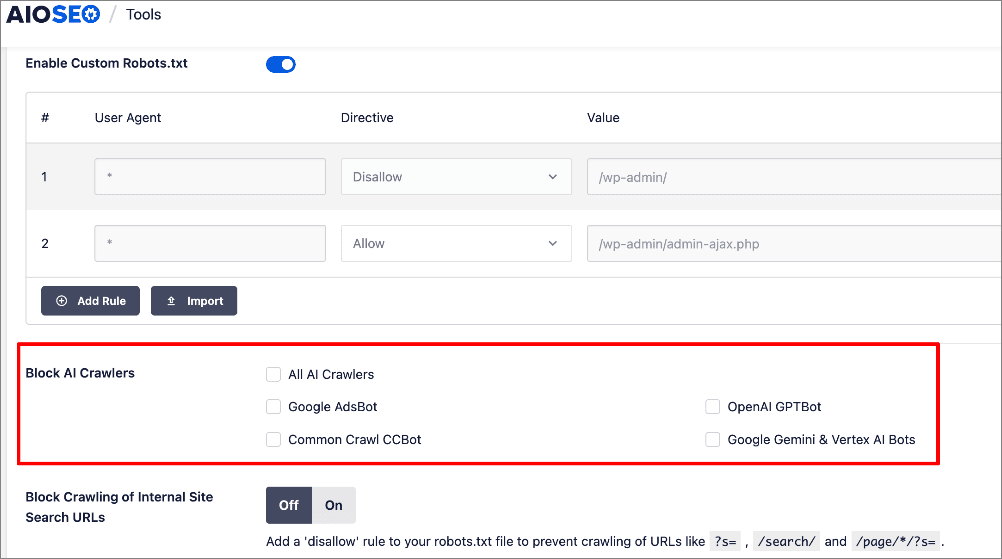

4. Bloquer les robots indésirables

Une autre fonctionnalité très intéressante de l'éditeur de fichier robots.txt d'AIOSEO est la section Bloquer les robots d'IA. Cela vous permet de bloquer les robots non autorisés d'explorer votre site. Ceux-ci peuvent entraîner des problèmes de performance, de sécurité et de référencement.

Pour en savoir plus, consultez notre tutoriel sur le blocage du trafic indésirable des robots sur votre site.

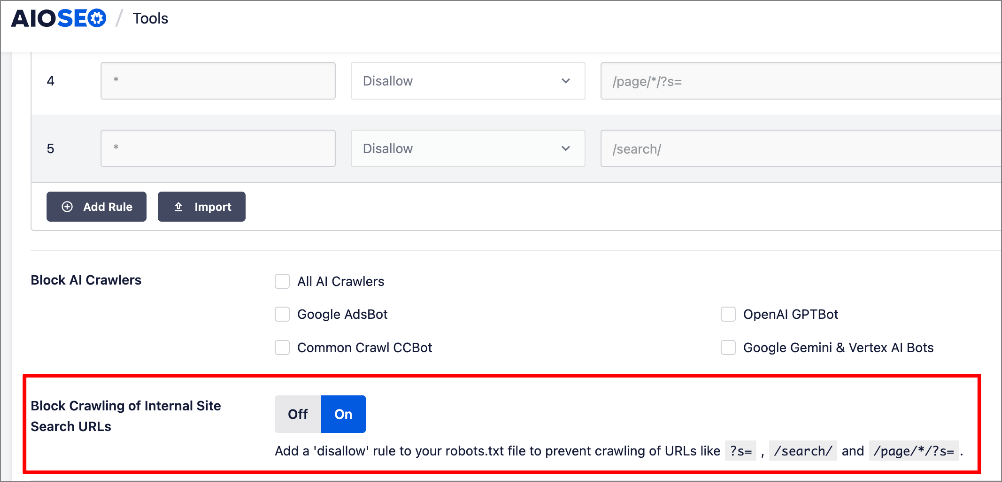

5. Empêcher l'exploration des URL de recherche interne du site

Les sites Web génèrent souvent un excès d'URL à partir de recherches internes lorsque les visiteurs recherchent du contenu ou des produits. Ces URL générées par la recherche contiennent des paramètres que les moteurs de recherche perçoivent comme uniques, ce qui les amène à explorer des pages inutiles. Cela gaspille votre budget d'exploration et peut empêcher vos pages les plus importantes d'être indexées.

Vous pouvez facilement éviter cela dans l'éditeur de fichier robots.txt d'AIOSEO.

AIOSEO ajoute une règle « disallow » dans votre fichier robots.txt sans que vous ayez à le faire pour chaque paramètre généré par la recherche.

Pour plus d'informations, consultez notre tutoriel sur la modification de votre fichier robots.txt.

Conseils pour optimiser les fichiers Robots.txt de WordPress

Inclure l'URL de votre sitemap

Inclure un lien vers votre sitemap est essentiel pour aider les robots d'exploration à explorer et indexer vos pages importantes. Bien que son omission de votre fichier robots.txt puisse ne pas nuire à votre SEO, elle a sans aucun doute un impact positif. Heureusement, AIOSEO ajoute automatiquement l'URL de votre sitemap lorsqu'il génère un fichier robots.txt, aucune personnalisation supplémentaire n'est donc requise.

Comprendre et utiliser judicieusement les caractères génériques

Un joker est un caractère qui peut représenter un ou plusieurs caractères. Le joker le plus courant est l'astérisque (*).

Si vous avez de nombreuses pages que vous souhaitez bloquer, cela peut prendre beaucoup de temps pour ajouter une règle pour chacune d'elles. Heureusement, vous pouvez utiliser des jokers pour simplifier vos instructions.

Les jokers sont des caractères spéciaux qui vous permettent de créer des règles basées sur des modèles dans vos fichiers robots.txt WordPress. Ils offrent un moyen d'appliquer des directives à un groupe d'URL partageant un modèle commun plutôt que de spécifier chaque URL individuellement. Il existe deux principaux types de jokers utilisés dans robots.txt :

- Joker Astérisque (*) : Il représente toute séquence de caractères et est utilisé pour faire correspondre les URL qui correspondent à un modèle spécifié. Par exemple, User-agent: * signifie que tous les agents utilisateurs doivent suivre la directive prescrite.

- Joker Signe Dollar ($) : Il est utilisé pour faire correspondre la fin d'une URL. Disons que vous souhaitez bloquer l'accès à toutes les URL se terminant par « .pdf », vous pouvez utiliser le signe dollar dans une directive comme celle-ci — Disallow: /*.pdf$.

Cependant, les jokers doivent être utilisés avec prudence, car une mauvaise utilisation peut bloquer ou autoriser involontairement l'accès à plusieurs pages ou répertoires.

Utiliser des commentaires pour plus de clarté

Ajoutez des commentaires dans votre fichier robots.txt pour expliquer vos directives. Cela vous aidera, ainsi que d'autres, à comprendre le but de chaque règle. Pour ajouter un commentaire, placez un hashtag (#) au début du commentaire. Les robots d'exploration ignoreront tout ce qui suit le #.

Comment tester vos fichiers Robots.txt WordPress

Une fois que vous avez terminé de générer et de configurer votre fichier robots.txt WordPress, vous pouvez le tester pour détecter toute erreur. Vous pouvez utiliser des outils tels que l'outil de test robots.txt de Google Search Console robots.txt.

Cependant, vous n'en aurez pas besoin si vous utilisez l'éditeur robots.txt d'AIOSEO, car il dispose d'une validation des règles et d'une gestion des erreurs intégrées.

Fichiers Robots.txt WordPress : Vos FAQ répondues

Qu'est-ce qu'un fichier robots.txt dans WordPress ?

Un fichier robots.txt est un fichier texte brut placé dans le répertoire racine d'un site Web WordPress. Il indique aux robots d'exploration des moteurs de recherche quelles parties du site doivent être explorées et indexées, et quelles parties doivent être exclues.

Comment puis-je générer un robots.txt dans WordPress ?

Vous pouvez facilement générer un fichier robots.txt dans WordPress en utilisant un plugin comme All In One SEO (AIOSEO). Vous n'avez même pas besoin de connaissances en codage ou techniques.

Puis-je utiliser robots.txt pour améliorer mon SEO ?

Oui, l'optimisation de votre fichier robots.txt peut contribuer à un meilleur référencement. Vous pouvez améliorer la visibilité et le classement de votre site Web dans les résultats de recherche en guidant les robots des moteurs de recherche pour qu'ils explorent et indexent votre contenu le plus précieux tout en excluant le contenu dupliqué ou non pertinent.

Utilisez judicieusement la puissance de votre fichier Robots.txt WordPress

Votre fichier robots.txt WordPress est un outil puissant qui peut vous aider à améliorer votre explorabilité, votre indexation et vos classements dans les SERP.

Nous espérons que cet article vous a aidé à acquérir une connaissance approfondie des fichiers robots.txt WordPress et pourquoi il est important d'optimiser le vôtre. Vous voudrez peut-être également consulter d'autres articles sur notre blog, tels que notre guide sur la création de contenu analysable ou notre tutoriel sur l'utilisation d'un générateur de titres SEO pour améliorer vos classements et votre CTR.

Si vous avez trouvé cet article utile, veuillez vous abonner à notre chaîne YouTube. Vous y trouverez de nombreux autres tutoriels utiles. Vous pouvez également nous suivre sur X (Twitter), LinkedIn ou Facebook pour rester informé.

Divulgation : Notre contenu est financé par nos lecteurs. Cela signifie que si vous cliquez sur certains de nos liens, nous pouvons gagner une commission. Nous ne recommandons que les produits qui, selon nous, apporteront de la valeur à nos lecteurs.