サイトの robots.txt をカスタマイズしたいですか?この記事がお役に立ちます。

All in One SEO の robots.txt モジュールを使用すると、WordPress が作成する robots.txt を管理できます。

これにより、ウェブクローラーにサイトについて与える指示をより細かく制御できるようになります。

この記事では

- チュートリアルビデオ

- WordPress の Robots.txt について

- All in One SEO の Robots.txt エディターの使用方法

- WordPress のデフォルト Robots.txt ルール

- Adding Rules Using the Rule Builder

- ルールビルダーを使用したルールの編集

- ルールビルダーでのルールの削除

- ルールビルダーでのルールの順序変更

- Robots.txt を All in One SEO にインポートする

- ルールビルダーでの高度なルールの使用

- 不要なクローラーのブロック

- サイト内検索 URL のクロールをブロックする

- WordPress マルチサイト用の Robots.txt エディター

チュートリアルビデオ

All in One SEO の Robots.txt ツールの使用方法に関する動画はこちらです:

WordPress の Robots.txt について

まず、WordPress がすべての WordPress サイトに対して動的な robots.txt を生成することを理解することが重要です。

このデフォルトの robots.txt には、WordPress で実行されているすべてのサイトの標準ルールが含まれています。

次に、WordPress は動的な robots.txt を生成するため、サーバー上に静的なファイルは見つかりません。robots.txt の内容は WordPress データベースに保存され、ウェブブラウザに表示されます。これは完全に正常であり、サーバー上の物理ファイルを使用するよりもはるかに優れています。

最後に、All in One SEO は robots.txt を生成しません。WordPress が生成するデフォルトの robots.txt にカスタムルールを追加するための非常に簡単な方法を提供するだけです。

注意:

WordPress によって生成される robots.txt は動的に生成されるページであり、サーバー上の静的なテキストファイルではありませんが、次の 2 つの理由から、大きな robots.txt の作成には注意が必要です。

- 大きな robots.txt は、管理が難しい可能性のある複雑なルールのセットを示しています

- Google は、長い接続時間によるサーバーへの負荷を軽減するために、最大ファイルサイズ 512KB を提案しています。

All in One SEO の Robots.txt エディターの使用方法

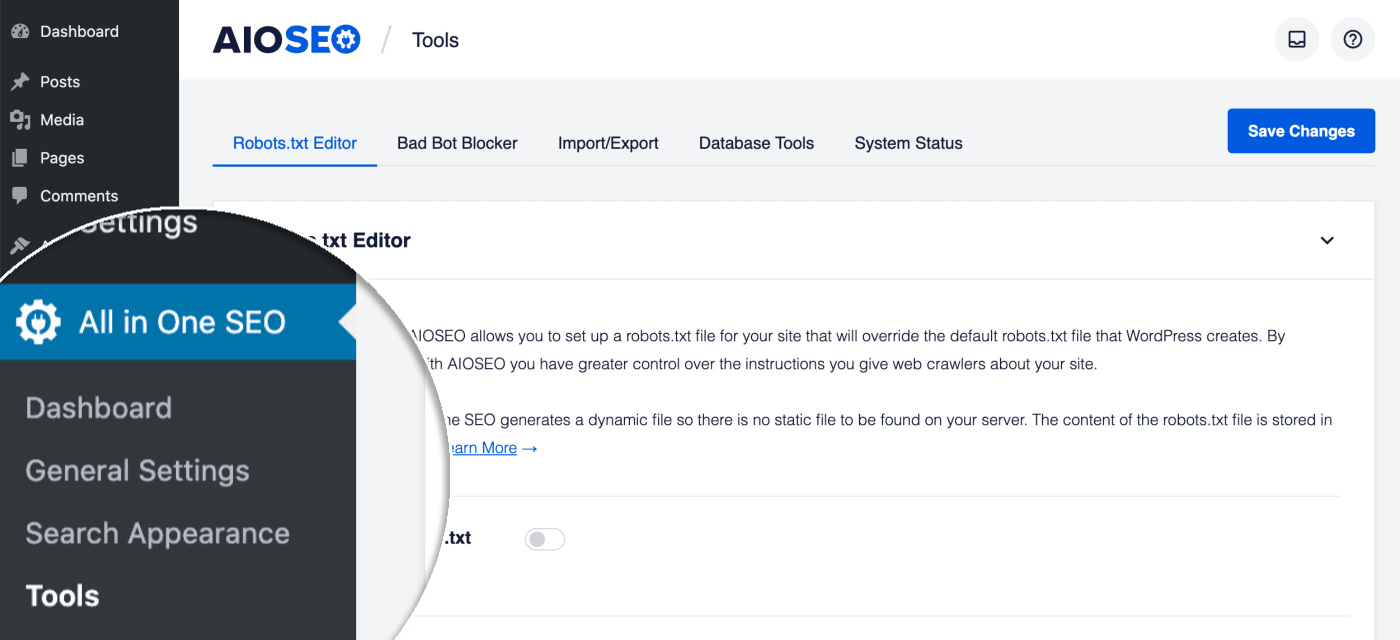

開始するには、All in One SEO メニューの ツール をクリックします。

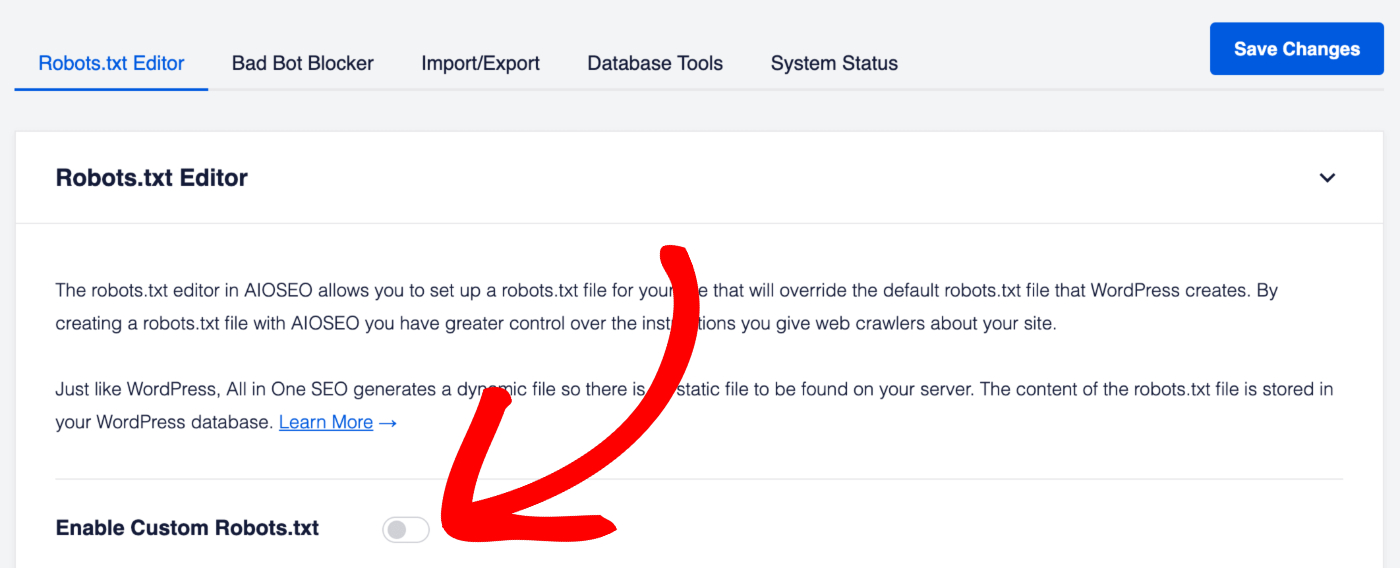

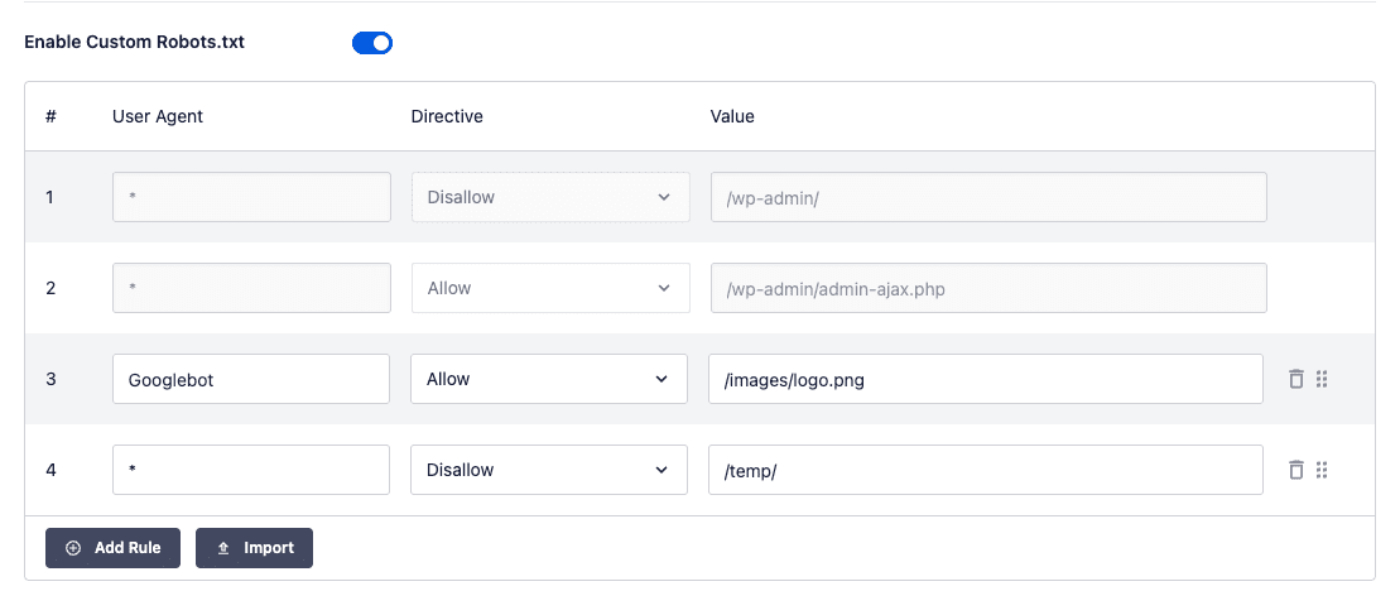

Robots.txt エディター が表示され、最初の設定は カスタム Robots.txt を有効にする になります。カスタム robots.txt エディターを有効にするには、トグルをクリックします。

重要:

カスタムルールを追加する特別な理由がない限り、カスタム Robots.txt を有効にする必要はありません。

WordPressによって生成されるデフォルトのrobots.txtは、すべてのサイトの99%に最適です。カスタムrobots.txt機能は、カスタムルールが必要なユーザー向けです。

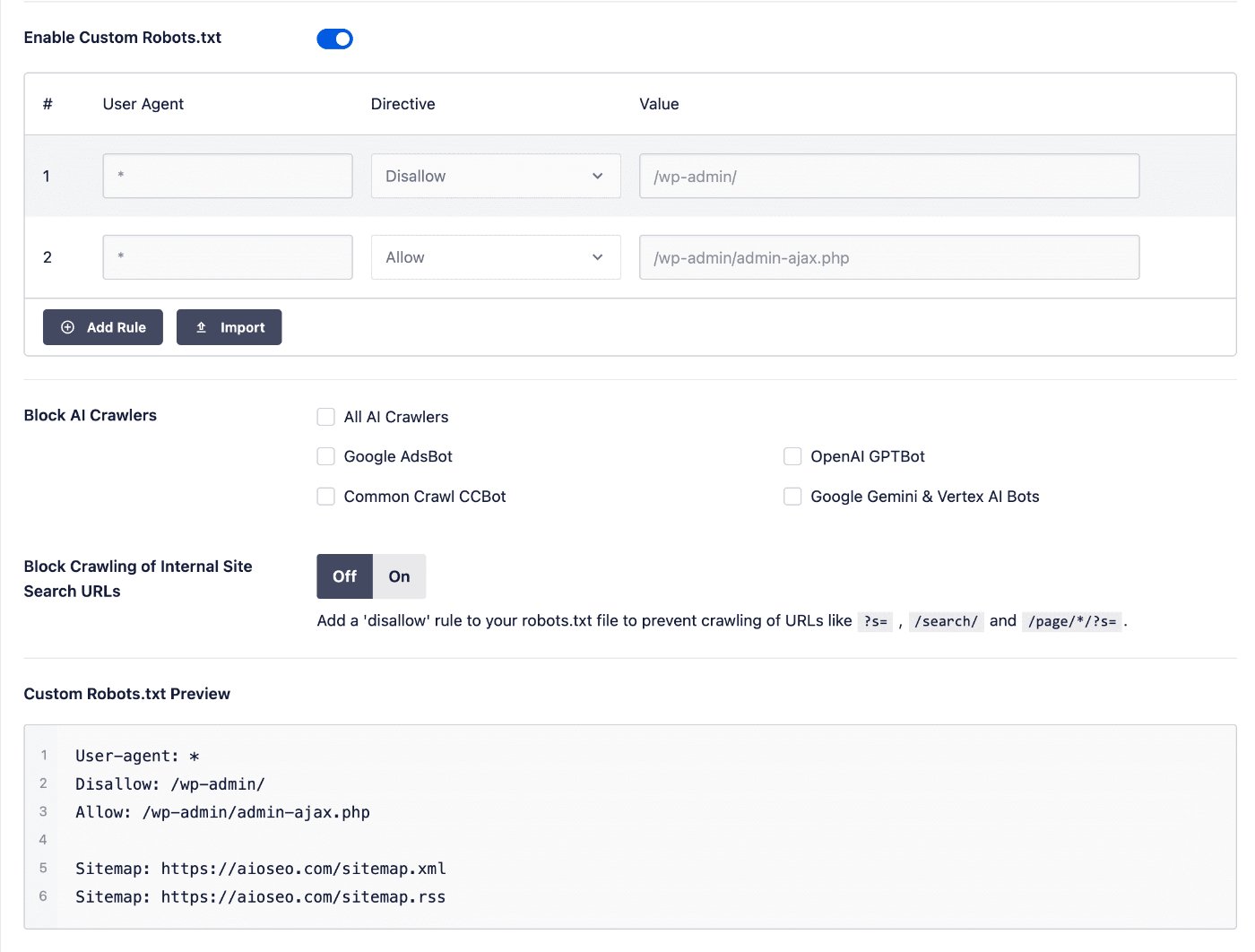

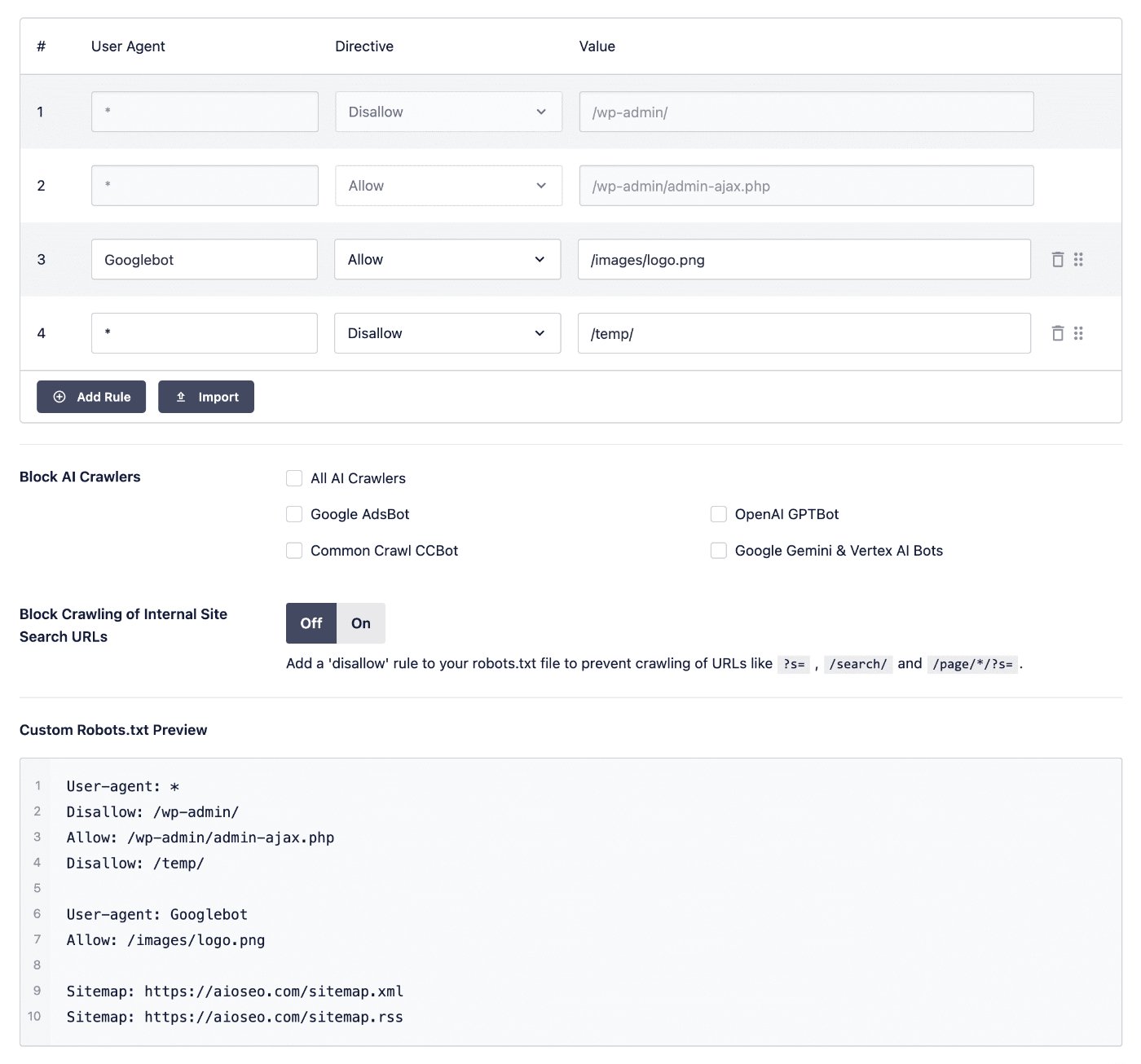

画面下部にあるカスタムrobots.txtプレビューセクションが表示され、WordPressによって追加されたデフォルトのルールが表示されます。

WordPress のデフォルト Robots.txt ルール

カスタムrobots.txtプレビューセクション(上記のスクリーンショットに表示)に表示されるデフォルトのルールは、ロボットにWordPressのコアファイルをクロールしないように要求します。これらのファイルには関連するサイトコンテンツが含まれていないため、検索エンジンがこれらのファイルに直接アクセスする必要はありません。

何らかの理由でWordPressによって追加されたデフォルトのルールを削除したい場合は、WordPressのrobots_txtフィルターフックを使用する必要があります。

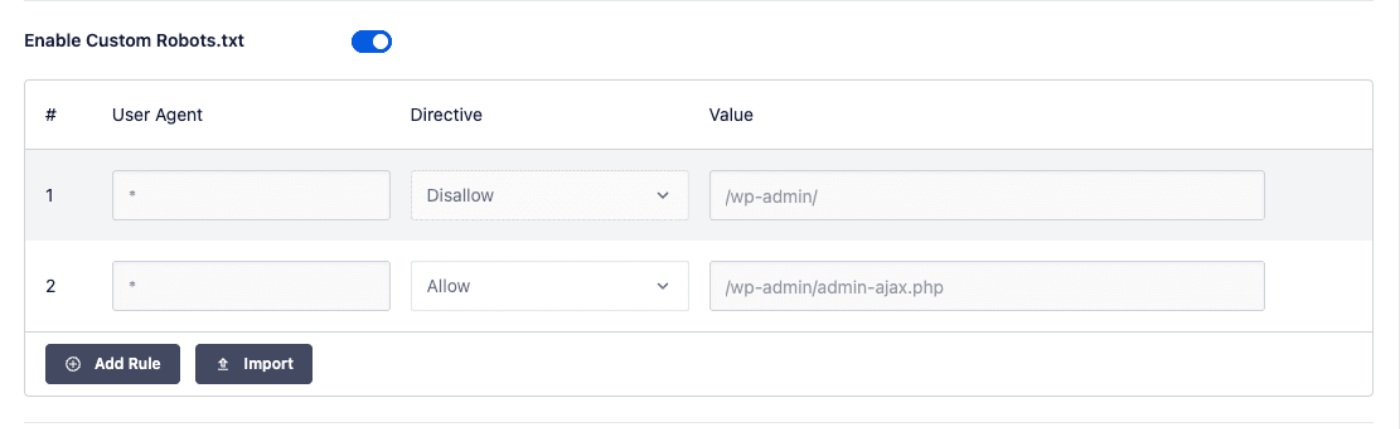

ルールビルダーを使用したルールの追加

ルールビルダーは、サイト上の特定のパスに対して独自のカスタムルールを追加するために使用されます。

たとえば、一時ディレクトリのすべてのロボットをブロックするルールを追加したい場合は、ルールビルダーを使用して追加できます。

ルールを追加するには、ルールを追加ボタンをクリックし、以下に説明するフィールドを完了します。

ユーザーエージェント

まず、ユーザーエージェントフィールドにユーザーエージェントを入力します。

たとえば、Googleのクローラーを指定したい場合は、ユーザーエージェントフィールドに「Googlebot」と入力します。

すべてのユーザーエージェントに適用されるルールが必要な場合は、ユーザーエージェントフィールドに*を入力します。

ディレクティブ

次に、ディレクティブドロップダウンでルールタイプを選択します。選択できるルールタイプは4つあります。

- 許可は、指定されたユーザーエージェントを持つクローラーに、値フィールドのディレクトリまたはファイルへのアクセスを許可します。

- ブロックは、指定されたユーザーエージェントを持つクローラーに、値フィールドのディレクトリまたはファイルへのアクセスをブロックします。

- クリーンパラメータを使用すると、URLパラメータを持つページを除外できます。これらのページは、異なるURLで同じコンテンツを提供できます。現在このディレクティブをサポートしている唯一の検索エンジンであるYandexには、ここに例とともに良い説明があります。

- クロール遅延は、クローラーがコンテンツをクロールできる頻度をクローラーに伝えます。たとえば、クロール遅延が10の場合、クローラーは10秒ごとにコンテンツをクロールするように指示されます。

現在、このディレクティブはBing、Yahoo、Yandexのみがサポートしています。Google Search ConsoleでGoogleクローラーのクロールレートを変更できます。

値

次に、値フィールドにディレクトリパスまたはファイル名を入力します。

/wp-content/backups/ のようなディレクトリパスや、 /wp-content/backups/temp.png のようなファイルパスを入力できます。

ワイルドカードとして * を使用して、 /wp-content/backup-* のようにすることもできます。

さらにルールを追加したい場合は、ルールを追加ボタンをクリックして、上記の手順を繰り返します。

完了したら、変更を保存ボタンをクリックします。

ルールは、カスタムrobots.txtプレビューセクションと、robots.txtを開くボタンをクリックして表示できるrobots.txtに表示されます。

ルールビルダーを使用したルールの編集

追加したルールを編集するには、ルールビルダーで詳細を変更し、変更を保存ボタンをクリックするだけです。

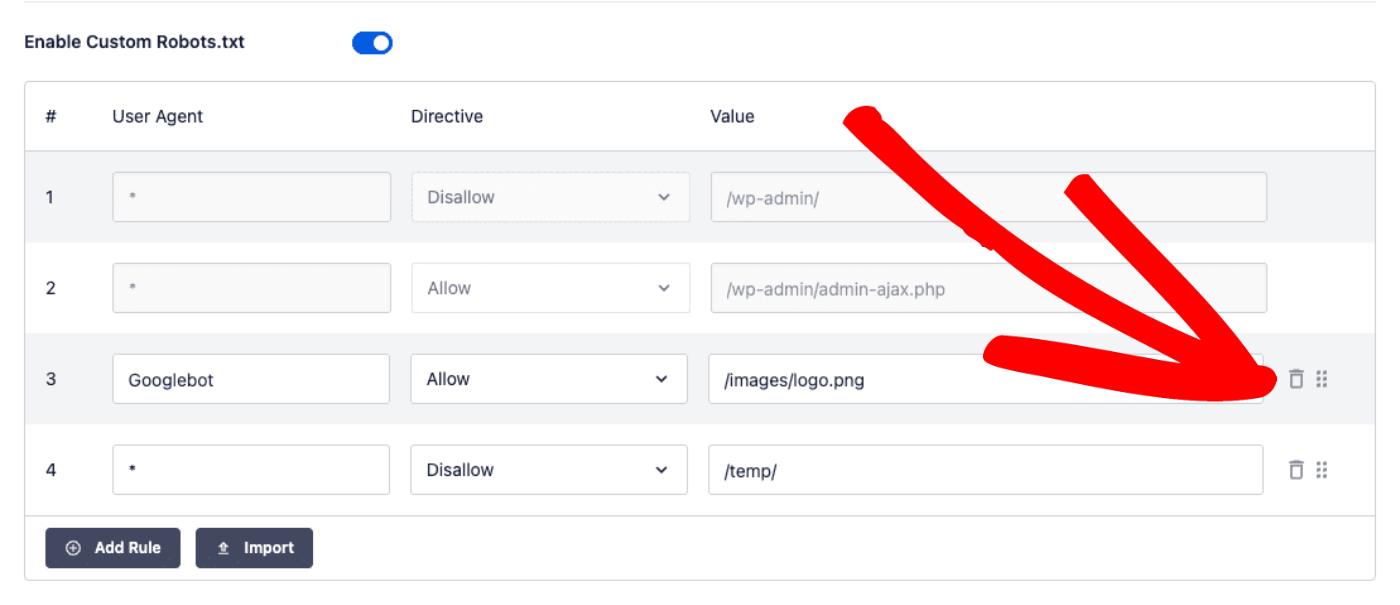

ルールビルダーでのルールの削除

追加したルールを削除するには、ルールの右側にあるゴミ箱アイコンをクリックします。

ルールビルダーでのルールの順序変更

ルールビルダーのエントリをドラッグアンドドロップすることで、robots.txtに表示されるカスタムルールの順序を簡単に変更できます。

ルールの右側にあるドラッグアンドドロップアイコンをクリックして保持し、以下に示すように表示したい場所にルールを移動します。

Googleは、ルールの配置順序が重要である理由について、ここで詳しく説明しています。

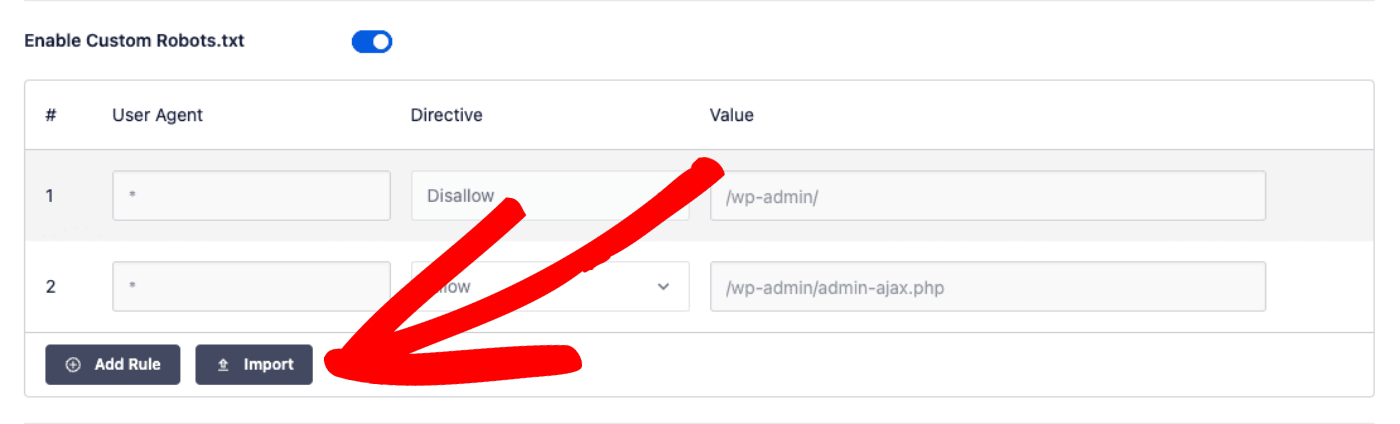

Robots.txt を All in One SEO にインポートする

独自のrobots.txtまたはルールを他のソースから非常に簡単にインポートできます。

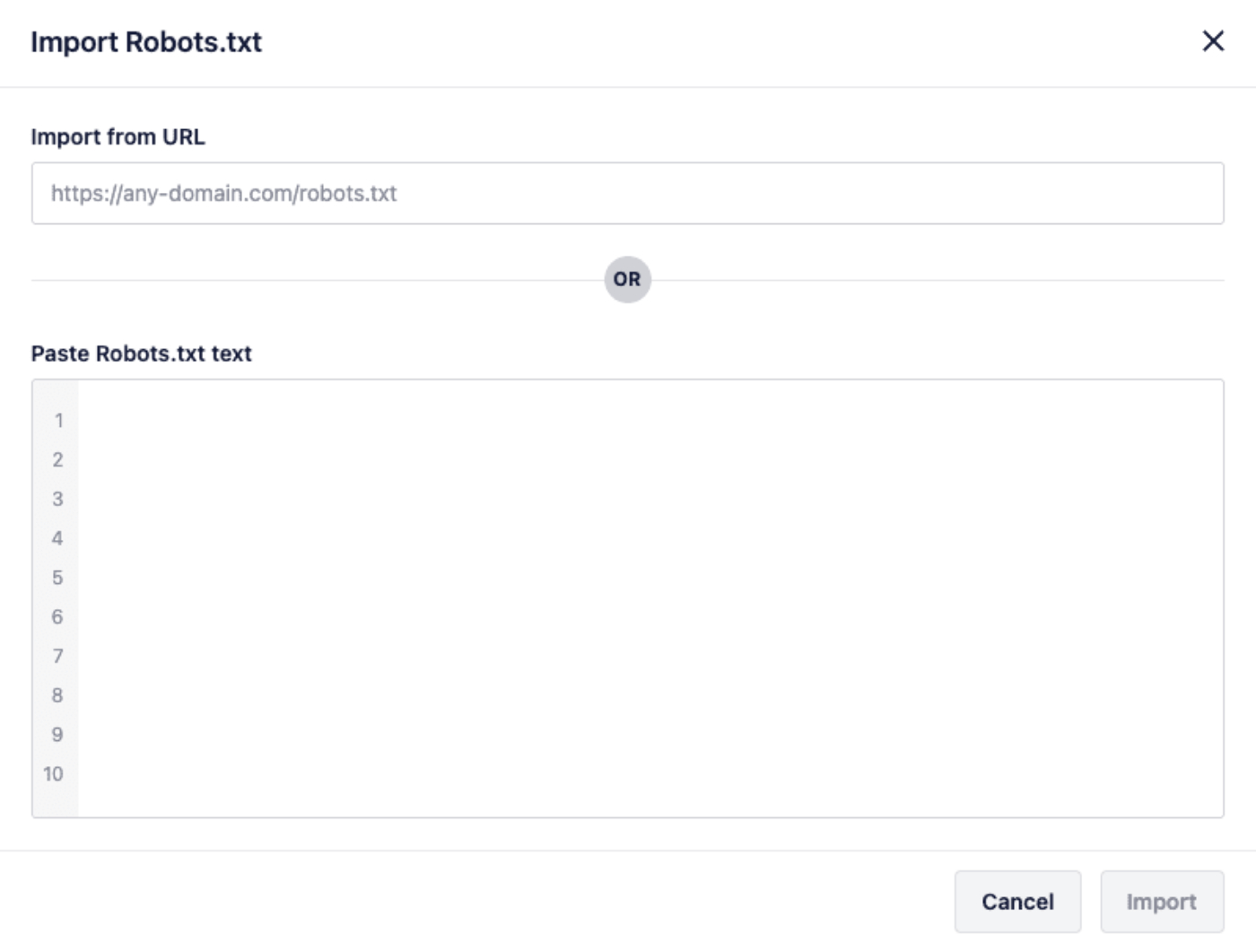

まず、インポートボタンをクリックして、robots.txtのインポートウィンドウを開きます。

robots.txtのインポートウィンドウでは、URLからインポートフィールドにrobots.txtのURLを入力してインポートするか、robots.txtテキストを貼り付けフィールドにrobots.txtの内容を貼り付けてインポートできます。

完了したら、インポートボタンをクリックします。

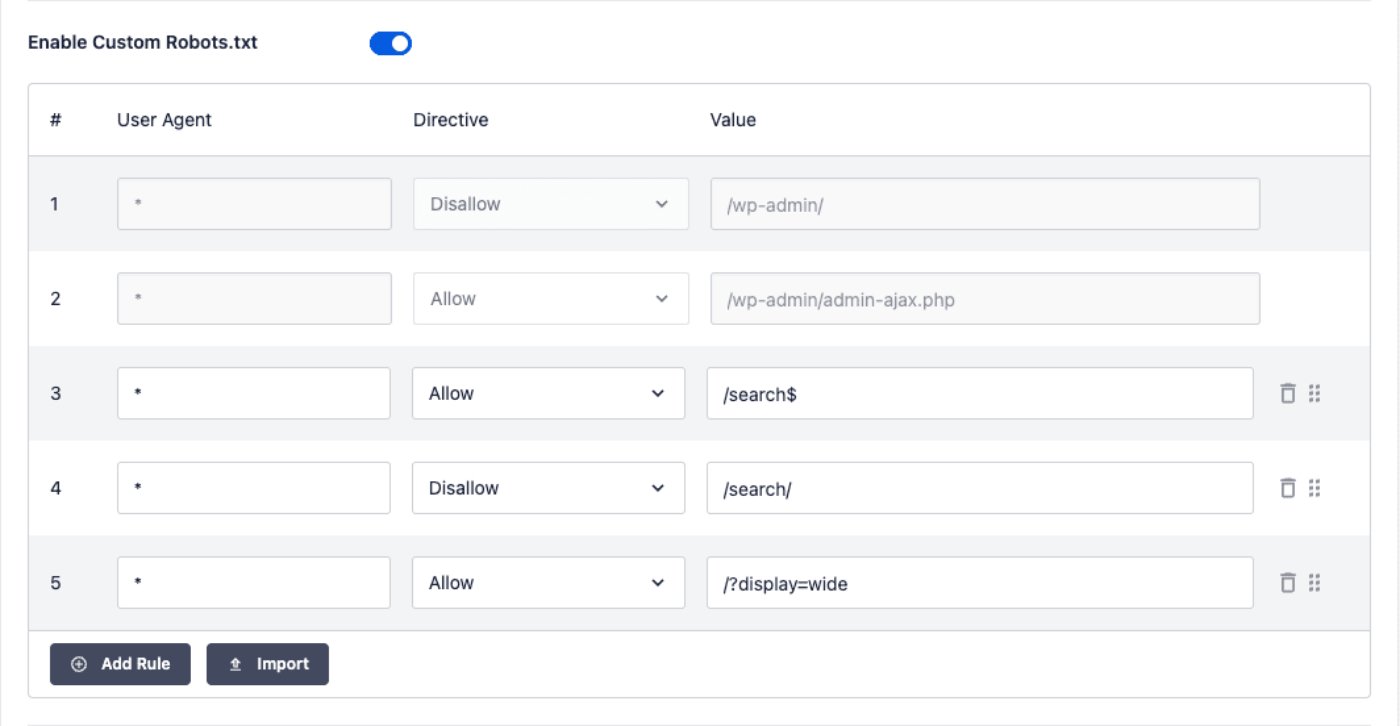

ルールビルダーでの高度なルールの使用

Robots.txtルールビルダーは、高度なルールの使用もサポートしています。これには、正規表現パターンとURLパラメータが含まれます。

高度なルールがどのように使用できるかの3つの例を次に示します。

上記の例では、これらの高度なルールが示されています。

- /search$ – これは正規表現を使用して、正確なパス「/search」へのアクセスを許可します

- /search/ – これは、「/search/」で始まるパスへのアクセスをブロックしますが、正確な一致ではありません

- /?display=wide – これは、一致するURLパラメータを持つホームページへのアクセスを許可します

このような高度なルールにより、サイトのrobots.txtファイルを細かく制御できるため、ユーザーエージェントがウェブサイトにアクセスする方法を完全に制御できます。

不要なクローラーのブロック

AIクローラーをブロックを使用して、AIクローラーやGoogle AdsBotなどの既知のクローラーをブロックするルールをrobots.txtに追加できます。

ブロックする各クローラーを選択するか、すべてのリストされているクローラーをブロックするために すべてのAIクローラー を選択できます。

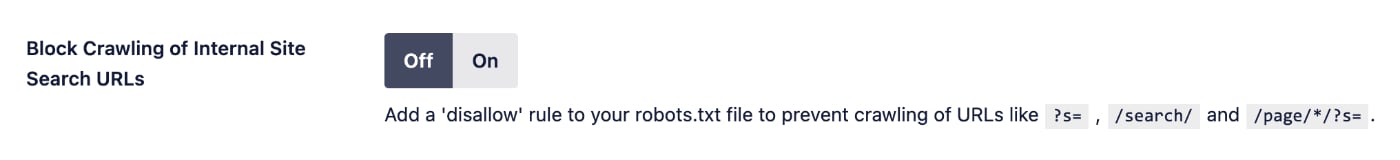

サイト内検索 URL のクロールをブロックする

サイト内検索URLのクロールをブロック設定を使用して、検索ページのURLのクロールを防ぐルールをrobots.txtに追加できます。これにより、サイトの不要なクロールが削減されます。

WordPress マルチサイト用の Robots.txt エディター

マルチサイトネットワーク用のRobots.txtエディタもあります。詳細は、マルチサイトネットワーク用のRobots.txtエディタに関するドキュメントで確認できます。