WordPressマルチサイトネットワークでのAll in One SEOの使用方法については、こちらのビデオをご覧ください。

WordPressマルチサイトネットワークをお持ちの場合、ネットワーク上のすべてのサイトに適用されるグローバルなrobots.txtルールを管理できます。

重要:

この機能は現在、サブドメインとして設定されたWordPressマルチサイトネットワークでのみ機能します。サブディレクトリとして設定されたものには機能しません。

この記事では

チュートリアルビデオ

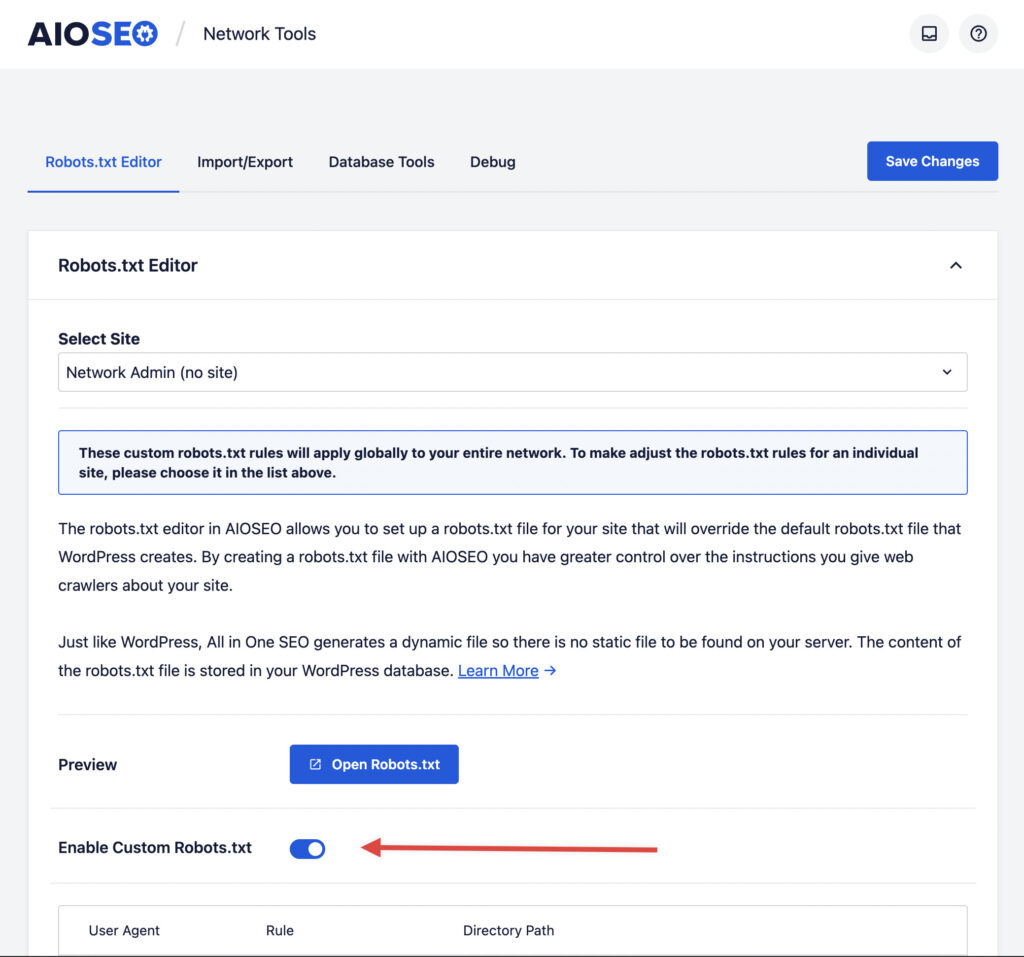

開始するには、ネットワーク管理に移動し、左側のメニューにあるAll in One SEO > Network Toolsをクリックします。

標準のRobots.txtエディターが表示され、robots.txtのカスタムルールを有効化および管理できます。

カスタムrobots.txtを有効にするトグルをクリックして、ルールエディターを有効にします。

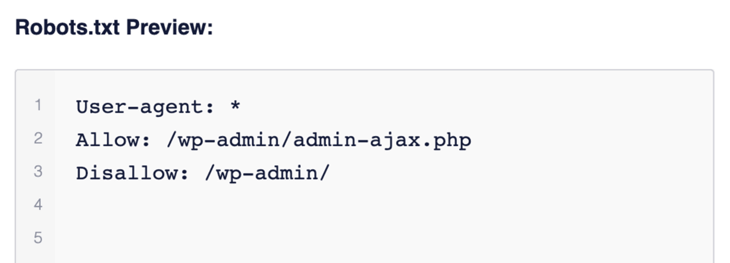

画面下部には Robots.txtプレビュー セクションが表示され、WordPressによって追加されたデフォルトのルールが表示されます。

WordPress のデフォルト Robots.txt ルール

Robots.txtプレビューセクション(上記のスクリーンショットに表示)に表示されるデフォルトのルールは、コアWordPressファイルをクロールしないようにロボットに指示します。これらのファイルには関連するサイトコンテンツが含まれていないため、検索エンジンが直接アクセスする必要はありません。

何らかの理由でWordPressによって追加されたデフォルトのルールを削除したい場合は、WordPressのrobots_txtフィルターフックを使用する必要があります。

ルールビルダーを使用したルールの追加

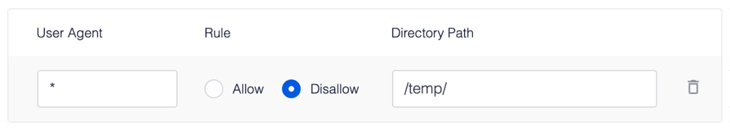

ルールビルダーは、サイト上の特定のパスに対して独自のカスタムルールを追加するために使用されます。

たとえば、一時ディレクトリのすべてのロボットをブロックするルールを追加したい場合は、ルールビルダーを使用して追加できます。

ルールを追加するには、User Agentフィールドにユーザーエージェントを入力します。*を使用すると、すべてのユーザーエージェントにルールが適用されます。

次に、ユーザーエージェントを許可またはブロックするために、AllowまたはDisallowのいずれかを選択します。

次に、Directory Pathフィールドにディレクトリパスまたはファイル名を入力します。

最後に、Save Changesボタンをクリックします。

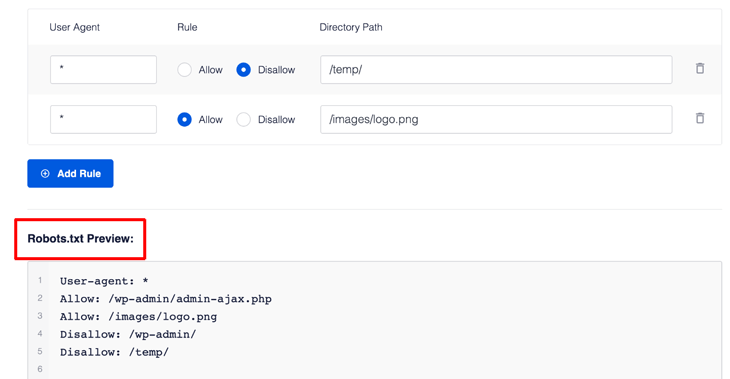

さらにルールを追加したい場合は、Add Ruleボタンをクリックして上記の手順を繰り返し、Save Changesボタンをクリックします。

ルールは Robots.txtプレビュー セクションとrobots.txtに表示され、Open Robots.txtボタンをクリックして表示できます。

ここに追加したルールはすべてネットワーク上のすべてのサイトに適用され、個々のサイトレベルで上書きすることはできません。

ルールビルダーを使用したルールの編集

追加したルールを編集するには、ルールビルダーで詳細を変更し、Save Changesボタンをクリックします。

ルールビルダーでのルールの削除

追加したルールを削除するには、ルールの右側にあるゴミ箱アイコンをクリックします。

不要なクローラーのブロック

AIクローラーをブロックを使用して、AIクローラーやGoogle AdsBotなどの既知のクローラーをブロックするルールをrobots.txtに追加できます。

ブロックする各クローラーを選択するか、すべてのリストされているクローラーをブロックするために すべてのAIクローラー を選択できます。

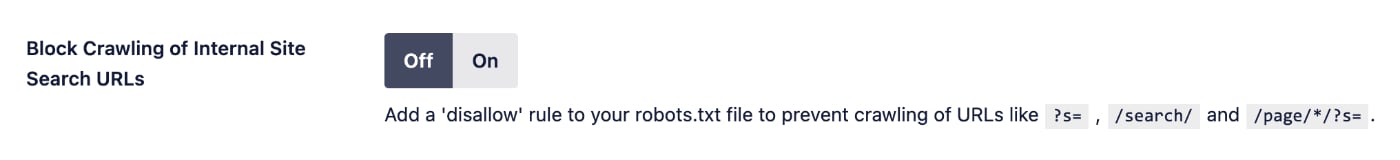

サイト内検索 URL のクロールをブロックする

サイト内検索URLのクロールをブロック設定を使用して、検索ページのURLのクロールを防ぐルールをrobots.txtに追加できます。これにより、サイトの不要なクロールが削減されます。

サブサイトのrobots.txtの管理

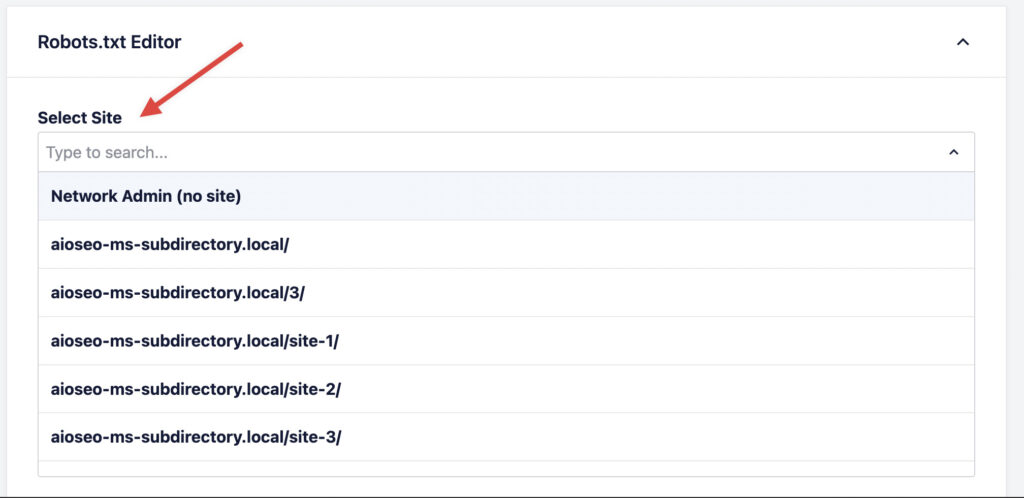

マルチサイトrobots.txtエディターでは、ネットワーク上の任意のサイトのロボットルールを簡単に編集できます。

開始するには、robots.txtエディターの上部にあるサイトセレクターのドロップダウンをクリックします。そこから、ルールの編集を希望するサイトを選択するか、ドメインを入力して検索します。

サイトを選択すると、以下のルールが自動的に更新され、そのサイト固有のルールを変更できます。サブサイトのルールを変更した後は、必ず「変更を保存」をクリックしてください。