WordPressでrobots.txtファイルを編集する方法を知りたいですか?

以前はWordPressでrobots.txtファイルを編集することに抵抗がありました。12以上のWordPressサイトを構築・管理してきた経験から、一度の間違いがサイトのSEOを台無しにするのではないかと心配しながら画面を見つめていたことを覚えています。

robots.txtファイルは恐ろしく見えるかもしれませんが、実際には検索エンジンにサイトのどの部分にアクセスできるか、できないかを伝える簡単なテキストファイルです。WordPressを長年扱ってきた経験から、このファイルを編集することは全く複雑である必要はないと学びました。

このステップバイステップガイドでは、WordPressでrobots.txtファイルを編集する最も簡単で安全な方法を紹介します。特定のページを検索エンジンからブロックしたい場合でも、SEOの問題を修正したい場合でも、正確な手順を学ぶことができます。

心配しないでください。各ステップを丁寧に説明するので、何も壊すことはありません。

この記事では

robots.txtファイルとは?

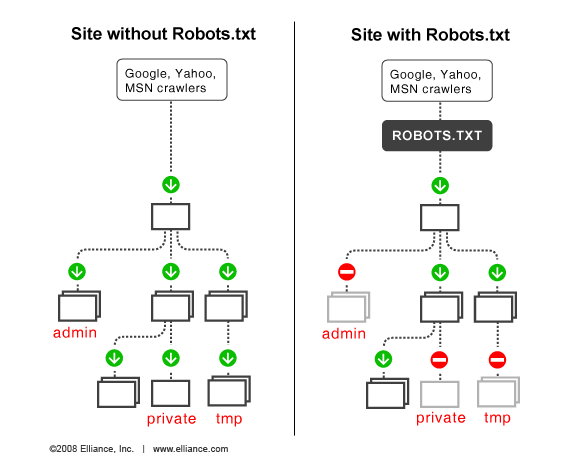

robots.txtファイルは、検索エンジンにサイトのクロール方法、つまりどこへのアクセスを許可または拒否するかを伝えます。

Googleなどの検索エンジンは、ウェブクローラー(ウェブボットとも呼ばれる)を使用して、ウェブサイトをアーカイブおよび分類します。

ほとんどのボットは、サイトの他のファイルを読み取る前に、サーバーでrobots.txtファイルを検索するように構成されています。これは、サイトのクロールとインデックス作成方法に関する特別な指示を追加したかどうかを確認するためです。

robots.txtファイルは通常、ウェブサイトのルートディレクトリ、またはメインフォルダに保存されます。

このURLは次のようになります。

http://www.example.com/robots.txt

ウェブサイトのrobots.txtファイルを確認するには、http://www.example.com/を自分のドメインに置き換え、末尾にrobots.txtを追加するだけです。

それでは、robots.txtファイルの基本的な形式を見てみましょう。

User-agent: [user-agent name]

Disallow: [URL string not to be crawled]

User-agent: [user-agent name]

Allow: [URL string to be crawled]

Sitemap: [URL of your XML Sitemap]

User-agentは、サイトのクロールをブロックまたは許可したい検索エンジンボットまたはロボット(例:Googlebotクローラー)を指します。

robots.txtファイルを編集する際には、特定のURLを許可または拒否する複数の指示を含めることができ、複数のサイトマップを追加することもできます。また、Clean-paramディレクティブを使用してURLパラメータを除外したり、Crawl-delayディレクティブを使用して検索ボットの訪問頻度を設定したりすることもできます。

WordPressのデフォルトのrobots.txtファイル

デフォルトでは、WordPressはサイトのrobots.txtファイルを自動的に作成します。そのため、何も操作しなくても、サイトにはすでにデフォルトのWordPress robots.txtファイルが存在するはずです。

しかし、後で独自のルールでカスタマイズすると、デフォルトのコンテンツは置き換えられます。

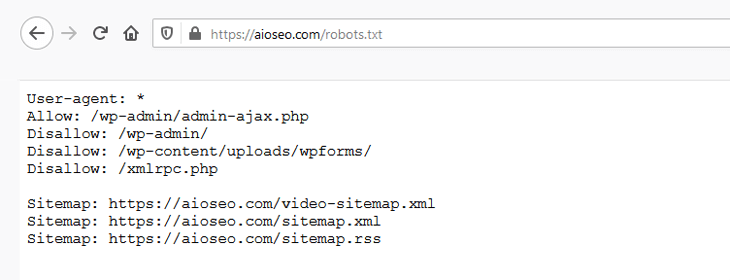

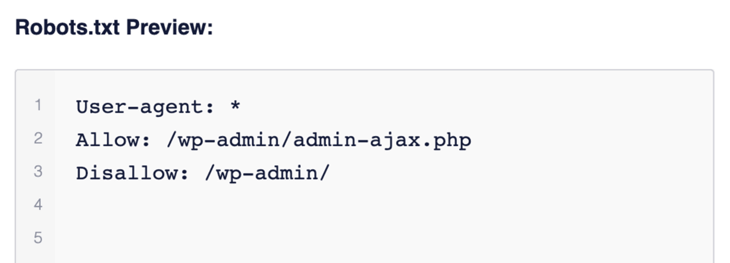

デフォルトのWordPressのrobots.txtファイルは次のようになります。

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

User-agent: * の後のアスタリスクは、robots.txtファイルがサイトにアクセスするすべてのウェブロボットを対象としていることを意味します。前述のように、Disallow: /wp-admin/ は、ロボットにwp-adminページにアクセスしないように指示します。

robots.txtファイルをテストするには、ドメイン名の末尾に/robots.txtを追加します。たとえば、ウェブブラウザに「https://aioseo.com/robots.txt」と入力すると、AIOSEOのrobots.txtファイルが表示されます。

robots.txtファイルとは何か、そしてどのように機能するかを理解したところで、なぜrobots.txtファイルがそもそも重要なのかを見ていきましょう。

robots.txtファイルが重要な理由

robots.txtファイルは、次のような場合に重要です。

- サイトの読み込み速度を最適化する — ボットに、クロールやインデックス作成してほしくないページで時間を無駄にしないように指示することで、リソースを解放し、サイトの読み込み速度を向上させることができます。

- サーバーの使用状況を最適化する — リソースを無駄にしているボットをブロックすることで、サーバーがクリーンになり、404エラーが削減されます。

robots.txtではなく、メタnoindexタグを使用する場合

特定のページを検索エンジンの結果に含めないことが主な目的の場合は、noindexメタタグを使用するのが適切な方法です。

これは、robots.txtが検索エンジンにコンテンツをインデックスしないように直接指示しているのではなく、単にクロールしないように指示しているだけだからです。

つまり、robots.txtを使用して、検索エンジンやその他のボットがサイトとどのようにやり取りするかについての特定のルールを追加できますが、コンテンツがインデックスされるかどうかを明示的に制御することはできません。

それでは、AIOSEOを使用してWordPressでrobots.txtファイルを簡単に編集する方法をステップバイステップでご紹介します。

AIOSEOを使用したWordPressでのrobots.txtの編集

robots.txtファイルを編集する最も簡単な方法は、最高のWordPress SEOプラグインであるAll in One SEO(AIOSEO)を使用することです。

AIOSEOは、300万人以上のユーザーを誇る、強力でありながら使いやすいSEOプラグインです。つまり、何百万人もの賢いブロガーがAIOSEOを使用して、検索エンジンのランキングを向上させ、ターゲットトラフィックをブログに誘導しています。これは、プラグインにSEO設定を適切に構成するための多くの強力な機能とモジュールが用意されているためです。例としては次のものが挙げられます。

- 検索統計: この強力なGoogle Search Console連携により、キーワードランキングの追跡や重要なSEO指標の確認がワンクリックで行えます。

- 次世代スキーマジェネレーター: このノーコードスキーマジェネレーターを使用すると、サイト上のあらゆるスキーママークアップを生成して出力できます。

- リダイレクトマネージャー:リダイレクトを管理し、404エラーを排除するのに役立ち、検索エンジンがサイトをクロールおよびインデックス登録しやすくします。

- リンクアシスタント:サイト上のページ間のリンク構築を自動化する強力な内部リンクツール。アウトバウンドリンクの監査も提供します。

- SEOプレビュー: 検索スニペットとソーシャルスニペットの概要、および一般的なSEOの概要を確認できるため、最適化を改善できます。

- IndexNow: IndexNowプロトコル(BingやYandexなど)をサポートする検索エンジンでの高速インデックス作成に。

- サイトマップジェネレーター: さまざまな種類のサイトマップを自動生成し、サイトの更新をすべての検索エンジンに通知します。

- その他多数。

ユーザーがこのプラグインを気に入っている理由の1つは、検索エンジンがサイトをクロールする方法をより細かく制御できることです。これは、高度なrobots.txtエディターのおかげで、robots.txtファイルを簡単に構成でき、デフォルトのWordPressファイルをオーバーライドできるようになります。

こちらで最適なrobots.txtジェネレーターのリストをご覧ください。

こちらで最適なrobots.txtジェネレーターのリストをご覧ください。

それでは、robots.txtファイルを編集しましょう。

robots.txtファイルを編集するには、まずカスタムrobots.txtを有効にする

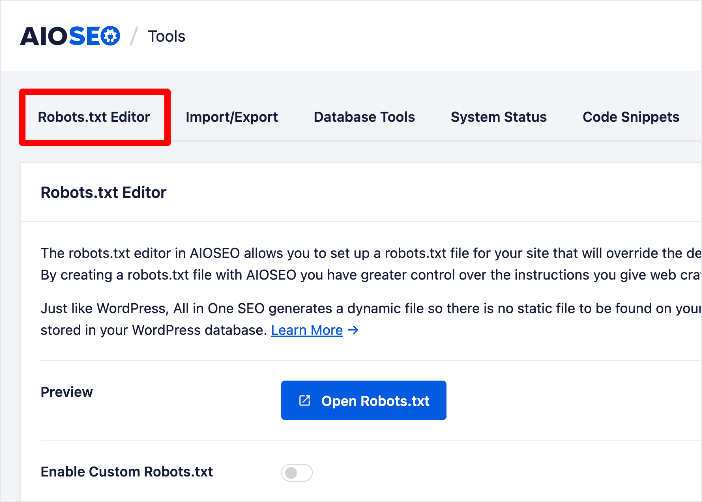

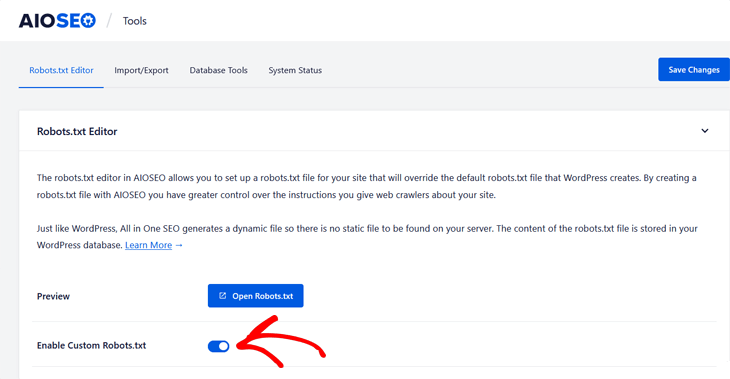

robots.txtファイルを編集するには、All in One SEOメニューのツールをクリックし、次にRobots.txtエディタータブをクリックします。

次に、AIOSEOは動的なrobots.txtファイルを生成します。そのコンテンツはWordPressデータベースに保存され、後ほど示すように、ウェブブラウザで表示できます。

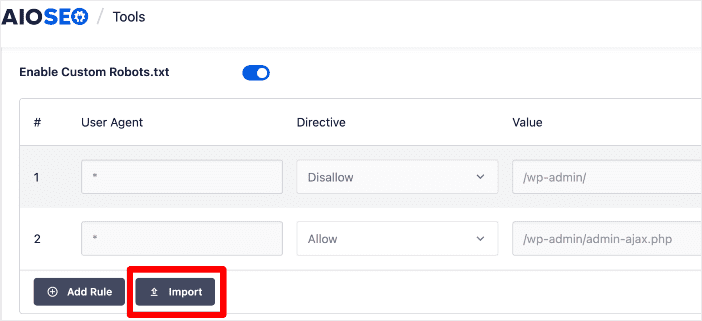

Robots.txtエディターに入ったら、カスタムRobots.txtを有効にする必要があります。

ボタンをクリックして青色に変わるようにします。

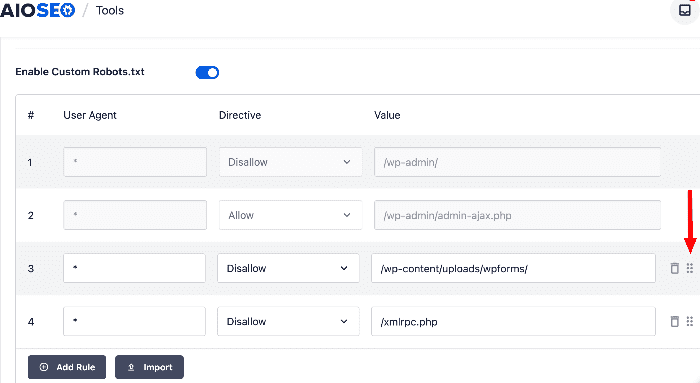

その後、画面下部にRobots.txtプレビューセクションが表示され、独自のルールで上書きできるWordPressのデフォルトルールが表示されます。 デフォルトのルールでは、ロボットがコアWordPressファイル(管理ページ)をクロールしないように指示しています。

次に、独自のルールを追加しましょう。ルールビルダーを使用するか、別のサイトからrobots.txtファイルをインポートするかのいずれかの方法で行うことができます。

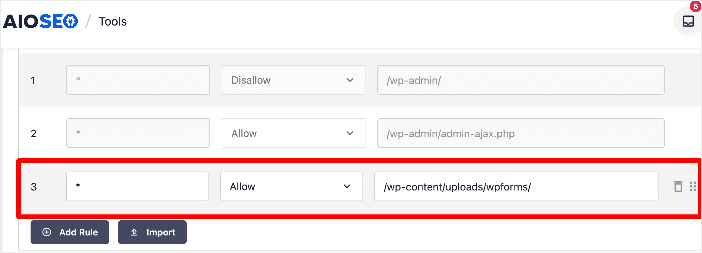

方法1:ルールビルダーを使用してルールを追加する

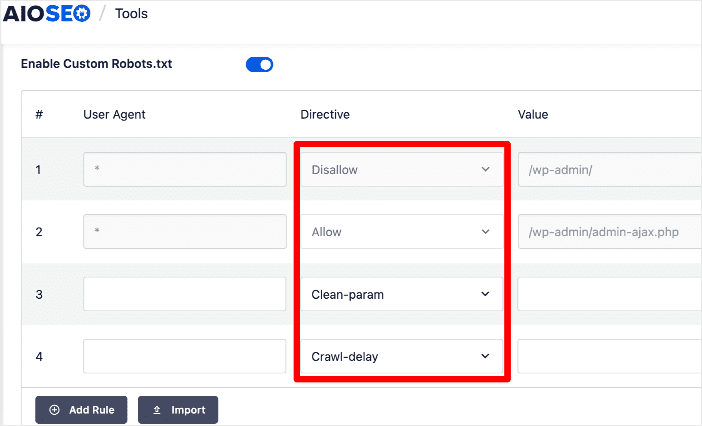

ルールビルダーは、ロボットがクロールすべきページまたはクロールすべきでないページに対して、独自のカスタムルールを追加するために使用されます。

たとえば、一時的なディレクトリからすべてのロボットをブロックするルールを追加したい場合は、ルールビルダーを使用できます。

カスタムルールを追加するには、ユーザーエージェントフィールドにユーザーエージェント(例:Googlebotクローラー)を入力します。または、*記号を使用して、すべてのユーザーエージェント(ロボット)にルールを適用することもできます。

次に、プリセットのrobots.txtディレクティブのいずれかを選択します:Allow、Disallow、Clean-param、またはCrawl-delay。

ルールを追加ボタンをクリックして、さらにディレクティブを追加することもできます。

適用するディレクティブを決定したら、値フィールドにディレクトリパスまたはファイル名を入力する必要があります。

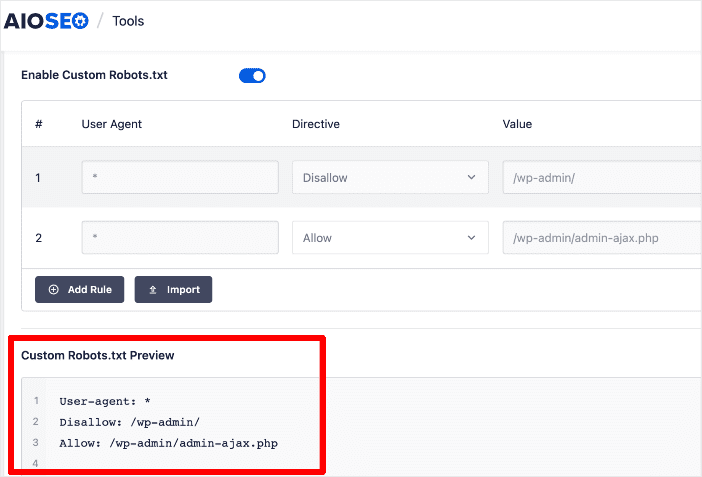

これが完了したら、ページ右下隅にある変更を保存ボタンをクリックして進めることができます。

新しいルールを保存すると、Robots.txtプレビューセクションに表示されます。

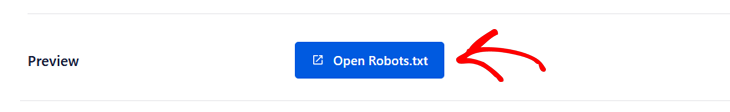

robots.txtファイルを表示するには、Robots.txtを開くボタンをクリックします。

これにより、robots.txtがホストされているURLに移動します。

方法2:他のサイトからルールをインポートする

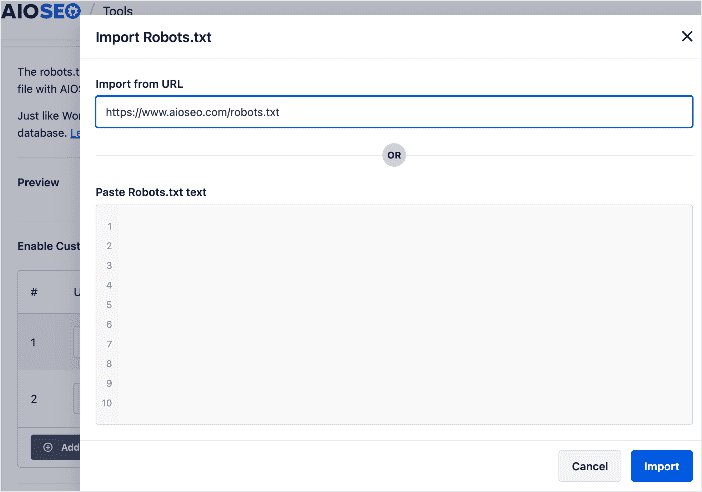

robots.txtにディレクティブを追加するもう1つの簡単な方法は、別のサイトからインポートすることです。これは、サイトを作成したばかりの場合や、複製したいrobots.txtファイルがあるサイトを知っている場合に便利な機能です。

別のサイトからrobots.txtファイルをインポートするには、AIOSEOメニューに移動し、ツール » Robots.txt » カスタムRobots.txtを有効にするを選択します。

次に、インポートオプションをクリックします。

これにより、robots.txtファイルをプルしたいサイトのURLを貼り付けることができるウィンドウが開きます。

インポートをクリックすると、サイトをリロードするように求められます。リロードすると、プラグインはrobots.txtファイルをプルしてサイトに実装します。

または、ターゲットサイトからrobots.txtファイルをコピーして、提供されたスペースに貼り付けることもできます。再度インポートをクリックすると、robots.txtファイルがサイトに追加されます。

これは、WordPressサイトにカスタムrobots.txtファイルを追加する最も簡単な方法でしょう。

ルールビルダーを使用したrobots.txtルールの編集

robots.txtルールを編集するには、ルールビルダーで詳細を変更できます。

また、ルールの右側にあるゴミ箱アイコンをクリックして、robots.txtファイル内のルールを削除することもできます。

さらに、AIOSEOのrobots.txtエディターでは、ルールを上下に移動させて優先順位を付けることができます。これを行うには、ゴミ箱の横にある6つのドットをクリックしてドラッグし、ルールの位置を変更します。

robots.txtの編集が完了したら、変更を保存ボタンをクリックして新しいルールを保存します。

robots.txt編集の追加機能

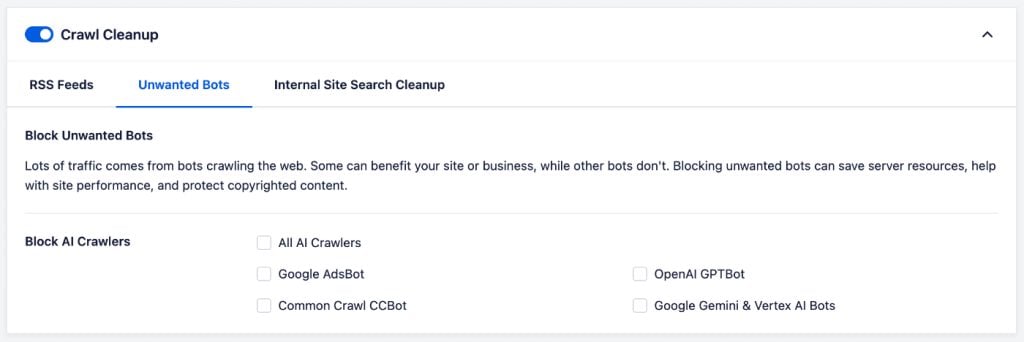

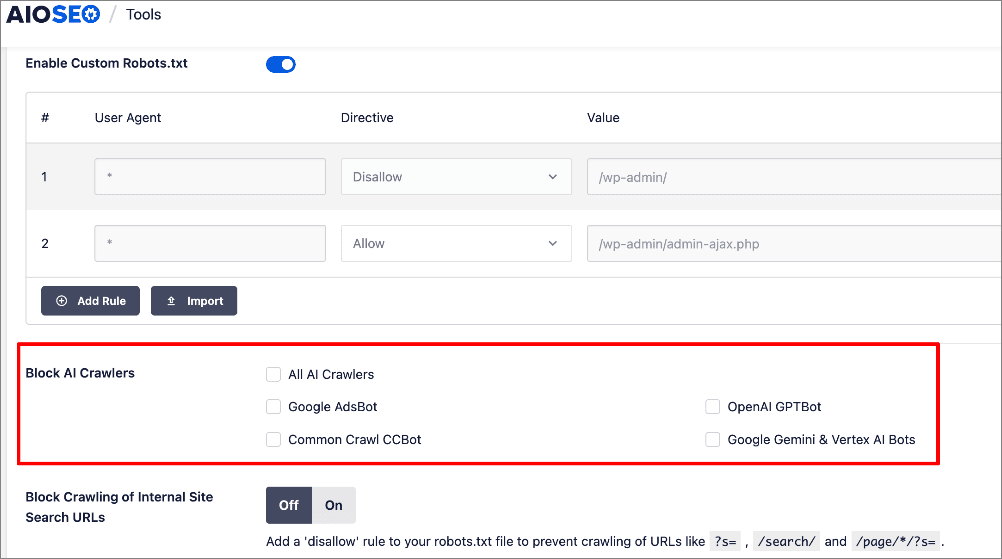

不要なボットやウェブクローラーをブロックする(簡単な方法)

ウェブクローラー、別名ボットまたはスパイダーは、諸刃の剣です。検索エンジンのようにサイトの成功に不可欠なものもあれば、サーバーリソースを消費したり、サイトを遅くしたり、コンテンツを盗んだりするものもあります。

通常、どうやって対処しますか?

技術的な知識がないため、常に簡単な方法を探しています😜。不要なボットがサイトをクロールするのを停止する最も簡単な方法は、AIOSEOのクロールクリーンアップ機能を使用することです。これにより、サイト上のボットトラフィックを管理するための設定が提供されます。

この機能を使用すると、サイトをクロールさせたくないボットを選択できます。ブロックしたいボットを選択するだけです。

不要なボットをブロックすると、AIOSEOはrobots.txtファイルをdisallowディレクティブで編集します。この機能はrobots.txtエディターにも組み込まれており、これを容易にします。

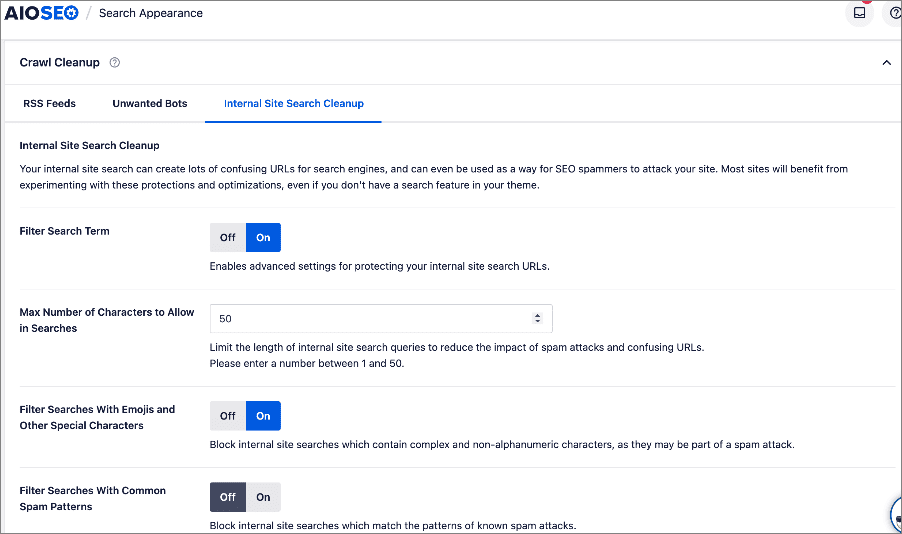

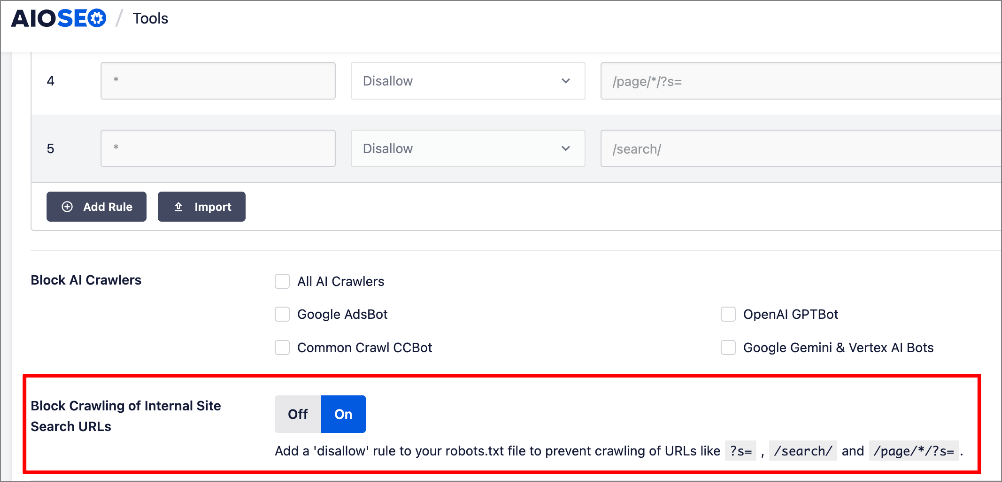

サイト内の検索をブロックする

ウェブサイトでは、内部検索から不要なURLが生成されることが多く、クロールバジェットの無駄遣いやスパムの可能性につながります。これも、AIOSEOのクロールクリーンアップを使用することで簡単に解決できます。トグルを使用してフィルターを設定するだけです。

AIOSEOは、検索エンジンやその他のボットがサイト内検索によって作成されたURLとどのようにやり取りするかを制御する機能を提供します。次のことができます:

- 検索クエリの最大文字数を設定し、肥大化した検索URLを防ぎます。

- 絵文字や特殊文字を自動的にフィルタリングし、乱雑または無意味な検索用語を回避します。

- 一般的なスパムパターンをブロックし、ジャンク検索から不要なインデックス可能なURLが作成されるのを防ぎます。

ここでも、AIOSEOはバックエンドでrobots.txtファイルを編集します。または、robots.txtエディターでこれらの設定を構成することもできます:

とても簡単です!

robots.txtファイルを編集しました。

robots.txtファイルの編集:よくある質問にお答えします

robots.txtファイルとは何ですか?

robots.txtファイルは、ウェブサイトの所有者がウェブクローラーまたはボットと通信するために使用するテキストファイルであり、サイトのどの部分を検索エンジンがクロールおよびインデックスすべきかを伝えます。

robots.txtファイルはどこにありますか?

robots.txtファイルは通常、ウェブサイトのルートディレクトリに配置されます。そのURLは通常https://www.example.com/robots.txtです。

robots.txtファイルを編集する最良の方法は何ですか?

robots.txtファイルを編集する最良の方法は、All In One SEO(AIOSEO)のようなプラグインを使用することです。これは最高のWordPress SEOプラグインであり、robots.txtファイルを非常に簡単に最適化できる高度なrobots.txtエディターを備えています。

このチュートリアルで、WordPressでrobots.txtファイルを簡単に編集する方法を理解していただけたことを願っています。また、ブログの他の記事も参照してください。たとえば、Googleにインデックス登録される方法に関するヒントや、検索統計を使用してランキングを向上させる方法に関するガイドなどです。

この記事がお役に立った場合は、YouTubeチャンネルを購読してください。そこには、さらに多くの役立つチュートリアルがあります。最新情報については、X(Twitter)、LinkedIn、またはFacebookでフォローすることもできます。

開示:当社のコンテンツは読者によってサポートされています。これは、当社のリンクの一部をクリックすると、手数料が発生する可能性があることを意味します。当社は、読者に価値をもたらすと信じる製品のみをお勧めします。

こんにちは、記事をありがとうございます。

最近、コンテンツの劣化に関する記事を読みました。私たちの問題の1つはページの速度であり、読み込み時間の短縮に取り組んできました。しかし、私はコーディングや技術的なことには全く詳しくありません。通常はマーケティングとデザインを担当しています。

そのような背景を踏まえて、私の質問はこうです。画像のアップロード、キャプション、代替テキストの作成において、画像検索のSERPに表示させたいのですが、インデックスの肥大化は避けたいのです。

これを避けるために推奨される戦術はありますか?(今日、画像サイトマップを無効にしました。これは不要であり、現在の画像をサイトから削除しないと読んだ後です。)

これはまた、第二の質問につながります。HTML、JSなどを読めない私のような人間が、画像サイトマップを無効にすることがロード速度の改善に効果があったかどうかを知るにはどうすればよいでしょうか?よろしくお願いします!