Möchten Sie wissen, wie Sie Bot-Traffic stoppen können, der die Leistung Ihrer Website beeinträchtigt?

Wenn Sie ungewöhnliche Aktivitäten auf Ihrer Website bemerkt haben – wie plötzliche Traffic-Spitzen aus unbekannten Orten, seltsam hohe Absprungraten oder eine langsame Benutzererfahrung –, haben Sie es möglicherweise mit Bot-Traffic zu tun.

Während einige Bots harmlos oder sogar hilfreich sind, sind viele bösartig und können die Leistung, Analysen und Sicherheit Ihrer Website erheblich beeinträchtigen.

Bot-Traffic kann Ihre Analysedaten verzerren, Ihre Server überlasten und Ihre Website sogar Sicherheitsbedrohungen wie Datenlecks oder DDoS-Angriffen aussetzen. Zu verstehen, wie man bösartigen Bot-Traffic identifiziert und stoppt, ist unerlässlich, um eine gesunde und effiziente Website aufrechtzuerhalten.

In diesem Leitfaden zeige ich Ihnen, wie Sie verhindern können, dass Bot-Traffic die Leistung Ihrer Website beeinträchtigt.

Spoiler-Alarm: Sie können Bot-Traffic-Probleme mit den richtigen Tools direkt über Ihr WordPress-Dashboard beheben.

Lassen Sie uns eintauchen und die Kontrolle über Ihre Website zurückgewinnen!

In diesem Artikel

Was ist Bot-Traffic?

Zuerst einmal: Was genau ist Bot-Traffic?

Bot-Traffic bezieht sich auf nicht-menschliche Besucher, die auf Ihre Website zugreifen. Bots sind Softwareanwendungen, die automatisierte Aufgaben über das Internet ausführen. Sie gibt es in verschiedenen Formen und sie dienen unterschiedlichen Zwecken.

Einige Bots sind vorteilhaft und helfen Ihrer Website, von Suchmaschinen indiziert zu werden, oder bieten nützliche Funktionen. Allerdings sind nicht alle Bots gut. Bösartige Bots können ernsthafte Probleme verursachen, von der Verlangsamung Ihrer Website bis zum Diebstahl sensibler Informationen.

Das Verständnis der verschiedenen Bot-Typen ist entscheidend für die effektive Verwaltung von Bot-Traffic.

Arten von Bot-Traffic

Ich werde die Arten von Bot-Traffic in zwei Kategorien unterteilen: gute Bots und böse Bots.

Gute Bots

Gute Bots spielen eine entscheidende Rolle im Internet-Ökosystem. Hier sind einige Beispiele:

- Suchmaschinen-Crawler: Bots von Suchmaschinen wie Googlebot (Google) und Bingbot (Bing) crawlen Ihre Website, um Ihre Inhalte zu indizieren. Dieser Prozess ist unerlässlich, damit Ihre Website in den Suchergebnissen erscheint.

- Digitale Assistenten: Bots, die von digitalen Assistenten wie Siri, Alexa und Google Assistant verwendet werden, rufen Informationen aus dem Web ab, um Benutzeranfragen zu beantworten.

- Social Media Bots: Bots von sozialen Plattformen wie Facebook und X (Twitter), die Vorschau-Daten abrufen, wenn Ihre Inhalte geteilt werden.

- Monitoring-Tools: Dienste wie Uptime-Monitore und Performance-Analysatoren verwenden Bots, um zu überprüfen, ob Ihre Website online ist und gut funktioniert. Ein beliebtes Beispiel ist Screaming Frog.

Diese Bots folgen Standardprotokollen, respektieren die robots.txt-Datei Ihrer Website und beeinträchtigen Ihre Website im Allgemeinen nicht negativ.

Böse Bots

Leider sind nicht alle Bots freundlich. Böse Bots können Ihrer Website auf verschiedene Weise schaden. Einige gängige Typen sind:

- Spam-Bots: Diese Bots posten Spam-Kommentare oder Formularübermittlungen und überfluten Ihre Website mit unerwünschten Inhalten.

- Scraping-Bots: Sie stehlen Ihre Inhalte oder Daten, die Wettbewerber für böswillige Zwecke verwenden können.

- Credential Stuffing Bots: Bots, die versuchen, sich mit gestohlenen Benutzername- und Passwortkombinationen in Benutzerkonten einzuloggen.

- DDoS-Angriffs-Bots: Distributed Denial of Service-Angriffs-Bots überfluten Ihren Server mit Anfragen, wodurch Ihre Website verlangsamt oder abstürzt.

- Click-Betrugs-Bots: Sie generieren gefälschte Klicks auf Anzeigen, was Ihr Werbebudget aufzehrt und Ihre Kampagnendaten verfälscht.

- Inventar-Hoarding-Bots: Bots, die Produkte in den Warenkorb legen oder Tickets reservieren, ohne den Kauf abzuschließen, was Ihre Bestandsverwaltung beeinträchtigt.

Diese Bots ignorieren oft Standardprotokolle und können schwer zu erkennen und zu blockieren sein.

Warum unerwünschten Bot-Traffic zu stoppen ist

Sie denken vielleicht: „Ist Bot-Traffic wirklich so ein großes Problem?“

Wenn es um böse Bots geht, absolut. Hier ist warum:

Schutz der Website-Leistung

Böse Bots können erhebliche Serverressourcen verbrauchen, was zu langsameren Ladezeiten oder sogar Ausfallzeiten führt. Dies beeinträchtigt die Benutzererfahrung und kann Ihre SEO-Rankings schädigen.

Der Schutz der Website-Performance hilft auch, Energie zu sparen, was zu einem kleineren CO2-Fußabdruck führt.

Sicherstellung genauer Analysen

Bot-Traffic kann Ihre Analysedaten verfälschen. Wenn Sie sich auf diese Daten verlassen, um Entscheidungen über Inhalte, Marketingstrategien oder Verbesserungen der Benutzererfahrung zu treffen, führen ungenaue Daten zu schlechten Entscheidungen.

Schutz des Nutzervertrauens und des Geschäftsrufs

Sicherheitsverletzungen untergraben das Vertrauen der Nutzer. Wenn Kunden das Gefühl haben, dass ihre Daten bei Ihnen nicht sicher sind, werden sie ihr Geschäft woanders hin verlagern. Außerdem kann ein Ruf für schlechte Sicherheit schwer abzuschütteln sein.

So stoppen Sie unerwünschten Bot-Traffic auf Ihrer Website [WordPress Edition]

Nun zu den praktischen Schritten, um Bot-Traffic auf Ihrer WordPress-Website zu stoppen. Wenn die obigen Informationen überwältigend und zu technisch erscheinen, machen Sie sich keine Sorgen. Die Lösung, die ich Ihnen heute zeigen werde, ist sehr einfach zu bedienen. Und es dauert nur ein paar Minuten und ein paar Klicks, um sie zu implementieren.

Außerdem benötigen Sie keinerlei Programmier- oder technische Kenntnisse.

Klingt zu gut, um wahr zu sein?

Genau das dachte ich auch, bevor ich diese Methode anwandte.

In diesem Abschnitt zeige ich Ihnen, wie Sie das All in One SEO (AIOSEO) Plugin verwenden, um Bot-Traffic effektiv zu verwalten.

Schritt 1: Installieren Sie All In One SEO (AIOSEO)

Der erste Schritt, um Bot-Traffic auf Ihrer Website zu stoppen (der einfache Weg), ist die Installation von All In One SEO (AIOSEO).

AIOSEO ist das beste WordPress SEO-Plugin auf dem Markt. Über 3 Millionen versierte Website-Besitzer und Vermarkter vertrauen darauf, dass es ihnen hilft, die SERPs (Suchmaschinenergebnisseiten) zu dominieren und relevanten Website-Traffic zu generieren.

Das Plugin verfügt über viele leistungsstarke SEO-Funktionen und Module, die Ihnen helfen, Ihre Website für Suchmaschinen und Benutzer zu optimieren, auch ohne Programmier- oder technische Kenntnisse. Um unerwünschte Bots oder Crawler zu blockieren, verfügt AIOSEO über eine erweiterte Funktion namens Crawl Cleanup. Aber dazu später mehr.

Benötigen Sie eine Schritt-für-Schritt-Anleitung zur Installation von AIOSEO?

Dann lesen Sie unsere detaillierte Installationsanleitung.

Schritt 2: Crawl-Bereinigung öffnen

Sobald AIOSEO installiert und aktiviert ist, ist es an der Zeit, auf die leistungsstarke Funktion Crawl Cleanup zuzugreifen. Gehen Sie dazu in Ihrem WordPress-Dashboard zu AIOSEO-Einstellungen » Such appearance » Erweitert.

Scrollen Sie als Nächstes zum Umschalter Crawl Cleanup und stellen Sie sicher, dass er auf "Ein" steht.

Crawl Cleanup bietet viele Einstellungen, die Ihnen helfen, die Crawlbarkeit und Leistung Ihrer Website zu optimieren. Beispiele hierfür sind Einstellungen für:

- RSS-Feeds

- Unerwünschte Bots

- Bereinigung der internen Websuche

Die Funktion Crawl Cleanup hilft Ihnen, den Bot-Zugriff zu steuern, die Serverlast zu reduzieren und die Website-Leistung zu verbessern.

In unserem Fall möchten wir jedoch die Option Unwanted Bots.

Schritt 3: Wählen Sie die Webcrawler aus, die Sie blockieren möchten

Sobald Sie auf den Tab Unwanted Bots geklickt haben, werden Ihnen mehrere Optionen angezeigt. Lassen Sie mich Ihnen nun zeigen, wie Sie konfigurieren, welche Bots blockiert werden sollen, und es ist überraschend einfach!

Sie müssen nur die Bots auswählen, die Sie blockieren möchten.

Je nachdem, was Sie erreichen möchten, können Sie:

- Alle unerwünschten Bots blockieren, um mehr Kontrolle über Ihr Crawl-Budget zu erhalten.

- Hauptsächlich KI-Crawler anvisieren, um zu verhindern, dass sie Ihre Inhalte ohne Erlaubnis indizieren.

Dadurch können Sie Ihre Website vor Content Scraping schützen. Sie sparen auch Serverressourcen, was auch dem Planeten hilft, da weniger Energie verbraucht wird.

Diese Änderungen ändern Ihre robots.txt-Datei und fügen Disallow-Direktiven für die ausgewählten Bots hinzu. Um Fehler zu vermeiden, zeigt AIOSEO eine gelbe Warnung an, wenn Sie einen Bot zum Blockieren hinzufügen. So können Sie Updates überprüfen und verfolgen.

Schritt 4: robots.txt bearbeiten (Optional)

Möchten Sie eine erweiterte Kontrolle über den Bot-Traffic?

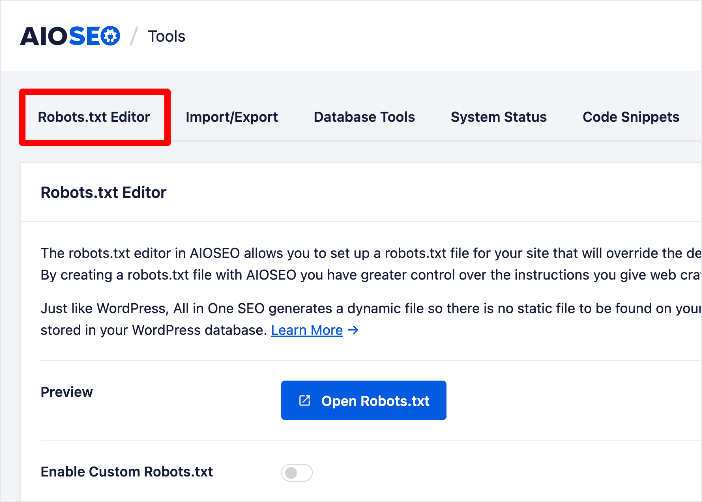

Eine weitere Option ist die Festlegung von Crawl-Direktiven in der robots.txt-Datei Ihrer Website direkt in AIOSEO. Um zum robots.txt-Editor zu gelangen, gehen Sie zum Menü All in One SEO » Tools » Robots.txt Editor.

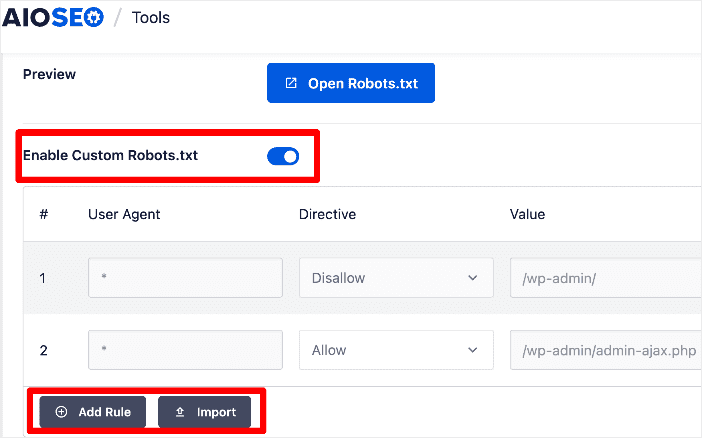

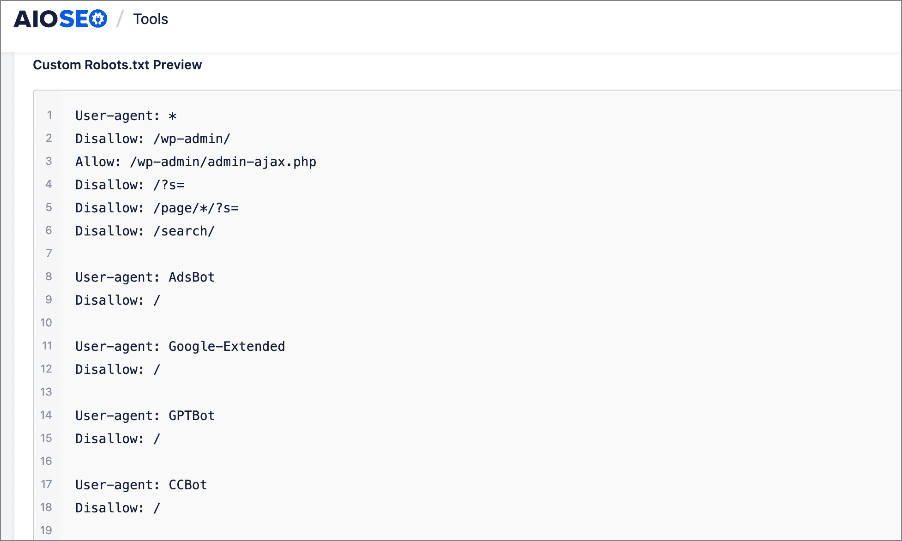

Die robots.txt-Datei teilt Bots mit, welche Teile Ihrer Website sie betreten dürfen oder nicht. Sie können Direktiven hinzufügen, um Bots den Zugriff auf bestimmte Verzeichnisse oder Dateien zu verweigern.

Sie können sogar Direktiven von einer anderen Website importieren, was es sehr einfach macht, Direktiven von einer Ihrer anderen Websites oder einer Website, die Sie mögen, anzuwenden. Hier ist ein Beispiel unten:

Hinweis:

- robots.txt ist öffentlich: Jeder kann Ihre robots.txt-Datei einsehen. Fügen Sie keine sensiblen Informationen hinzu.

- Nicht alle Bots befolgen robots.txt: Bösartige Bots ignorieren diese Direktiven oft. Für sie benötigen Sie zusätzliche Maßnahmen wie Sicherheit-Plugins oder serverseitige Sperren.

Das war's.

Sie wissen jetzt, wie Sie Bot-Traffic daran hindern können, die Leistung Ihrer Website zu beeinträchtigen.

So stoppen Sie Bot-Traffic auf Ihrer Website: Ihre FAQs beantwortet

Was ist Bot-Traffic?

Bots sind automatisierte Softwareanwendungen, die entweder nützlich sein können, z. B. bei der Indizierung durch Suchmaschinen, oder bösartig, was Probleme wie die Verlangsamung der Website oder den Diebstahl sensibler Informationen verursacht.

Können Bots robots.txt ignorieren?

Ja, leider ignorieren viele bösartige Bots robots.txt-Direktiven. Deshalb ist es wichtig, zusätzliche Abwehrmaßnahmen wie Sicherheit-Plugins und WAFs (Web Application Firewalls) zu verwenden.

Beeinträchtigt das Blockieren von Bots meine SEO?

Das Blockieren guter Bots, wie des Google-Crawlers, kann Ihrer SEO schaden, indem es verhindert, dass Ihre Website indiziert wird. Überprüfen Sie immer genau, welche Bots Sie blockieren, um sicherzustellen, dass Sie nur bösartige stoppen.

Gibt es eine Möglichkeit, Bots ohne Plugin zu blockieren?

Ja, Sie können Bots blockieren, indem Sie Ihre .htaccess-Datei bearbeiten oder die Firewall Ihres Servers konfigurieren. Diese Methoden erfordern jedoch technisches Wissen und können riskant sein. Fehlkonfigurationen können dazu führen, dass Ihre Website nicht mehr zugänglich ist.

Wir hoffen, dieser Beitrag hat Ihnen geholfen zu lernen, wie Sie unerwünschten Bot-Traffic daran hindern, die Leistung Ihrer Website zu beeinträchtigen. Möglicherweise möchten Sie auch andere Artikel in unserem Blog lesen, wie unseren Leitfaden zu robots.txt-Dateien oder unser Tutorial zum Verfolgen Ihrer Keyword-Rankings in WordPress.

Wenn Sie diesen Artikel hilfreich fanden, abonnieren Sie bitte unseren YouTube-Kanal. Dort finden Sie viele weitere hilfreiche Tutorials. Sie können uns auch auf X (Twitter), LinkedIn oder Facebook folgen, um auf dem Laufenden zu bleiben.

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.