Was ist robots.txt in WordPress?

Wenn Sie gelegentlich nach Tipps zur Verbesserung Ihres Suchmaschinenrankings suchen, werden Sie wahrscheinlich auf die robots.txt-Datei stoßen. Das liegt daran, dass sie ein wichtiger Teil Ihrer Website ist und berücksichtigt werden sollte, wenn Sie Ihr Ranking auf Suchmaschinenergebnisseiten (SERPs) verbessern möchten.

In diesem Artikel beantworten wir die Frage „Was ist robots.txt in WordPress?“. Wir zeigen Ihnen auch, wie Sie eine robots.txt-Datei für Ihre Website generieren.

In diesem Artikel

Was ist Robots.txt?

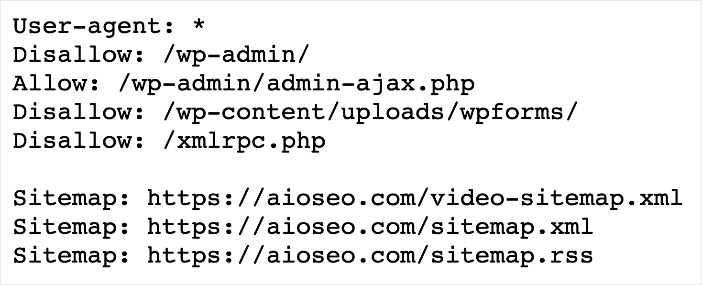

Robots.txt ist eine Textdatei, die Website-Besitzer erstellen können, um Suchmaschinen-Bots mitzuteilen, wie sie mit ihren Websites interagieren sollen, hauptsächlich welche Seiten gecrawlt und welche ignoriert werden sollen. Es ist eine einfache Textdatei, die im Stammverzeichnis Ihrer Website (auch bekannt als Hauptordner) gespeichert ist. In unserem Fall ist die URL unserer robots.txt:

https://aioseo.com/robots.txtUnd so sieht sie aus:

Dies sollte nicht mit Robots-Meta-Tags verwechselt werden, die HTML-Tags sind, die in den Kopf einer Webseite eingebettet sind. Der Tag gilt nur für die Seite, auf der er sich befindet.

Was bedeutet das alles?

Um dies besser zu verstehen, lassen Sie uns ein wenig zurückgehen und definieren, was ein Roboter ist. In diesem Zusammenhang sind Roboter jeder „Bot“ oder Webcrawler, der Websites im Internet besucht. Diese werden in der robots.txt-Datei als User Agents bezeichnet. Die häufigsten sind Suchmaschinen-Crawler, auch Suchbots oder Suchmaschinen-Spider genannt, unter vielen anderen Namen. Diese Bots durchsuchen das Web, um Suchmaschinen dabei zu helfen, Ihre Inhalte zu entdecken und somit schneller zu indexieren, damit sie den Nutzern als Antwort auf relevante Suchbegriffe zur Verfügung gestellt werden können.

Im Allgemeinen sind Suchbots gut für das Internet und Ihre Website. So nützlich sie auch sind, es gibt jedoch Fälle, in denen Sie steuern möchten, wie sie mit Ihrer Website interagieren.

Hier kommt die robots.txt-Datei ins Spiel.

Was macht eine robots.txt-Datei?

Wie bereits gesehen, dient eine robots.txt-Datei als eine Reihe von Anweisungen, um Suchmaschinen-Bots und andere Webcrawler anzuweisen, wie sie mit den Inhalten Ihrer Website interagieren sollen. Sie fungiert als digitaler Türsteher, der beeinflusst, wie Suchmaschinen Ihre Website wahrnehmen und mit ihr interagieren.

Hier sind einige Dinge, für die Sie eine robots.txt-Datei verwenden können:

Crawling steuern

Suchmaschinen-Bots durchsuchen Websites, um Inhalte zu entdecken und zu indexieren. Eine robots.txt-Datei informiert diese Bots, welche Teile Ihrer Website zum Crawling offen und welche gesperrt sind. Sie können steuern, welche Seiten sie aufrufen dürfen, indem Sie Regeln für verschiedene User Agents (Bots) festlegen.

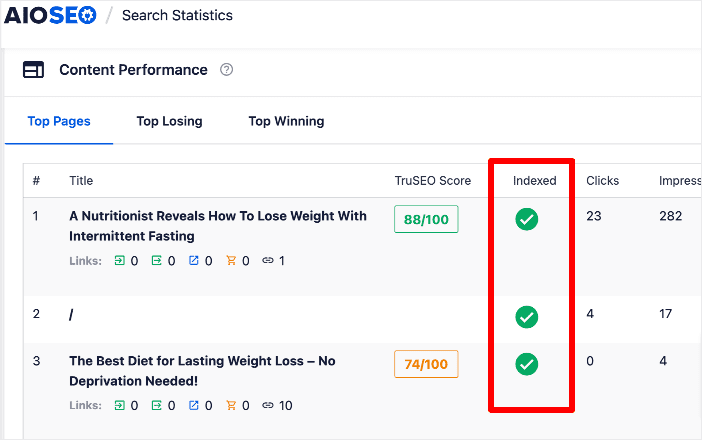

Indexierung steuern

Während das Crawling die Entdeckung von Inhalten beinhaltet, beinhaltet die Indexierung das Hinzufügen entdeckter Inhalte zur Datenbank der Suchmaschine. Durch die Verwendung einer robots.txt-Datei können Sie Bots anleiten, welche Inhalte indexiert und welche ausgeschlossen werden sollen. Dies ermöglicht es Ihnen, die Indexierung wichtiger Seiten zu priorisieren und gleichzeitig zu verhindern, dass irrelevante Inhalte die Suchergebnisse verstopfen.

Sie können AIOSEO einfach verwenden, um den Indexstatus Ihrer Beiträge und Seiten zu überprüfen.

Dies hilft Ihnen, den Indexstatus Ihrer Seiten leicht im Auge zu behalten.

Probleme mit doppeltem Inhalt verhindern

Doppelter Inhalt kann Suchmaschinen verwirren und sich negativ auf die SEO Ihrer Website auswirken. Mit robots.txt können Sie Bots daran hindern, doppelten Inhalt zu crawlen und zu indexieren, um sicherzustellen, dass nur die relevanteste Version Ihres Inhalts für Suchergebnisse berücksichtigt wird.

Sensible Informationen schützen

Einige Bereiche Ihrer Website können sensible Daten enthalten, die Sie nicht öffentlich preisgeben oder von Suchmaschinen indexieren lassen möchten. Eine gut strukturierte robots.txt-Datei kann Bots daran hindern, auf diese Bereiche zuzugreifen und sie zu indexieren, wodurch die Privatsphäre und Sicherheit Ihrer Website verbessert wird.

Optimiert das Crawl-Budget

Suchmaschinen weisen jeder Website ein Crawl-Budget zu, das bestimmt, wie häufig und tief Bots Ihre Website crawlen. Mit robots.txt können Sie Bots zu Ihren wertvollsten und relevantesten Seiten leiten und so eine effiziente Nutzung Ihres Crawl-Budgets sicherstellen.

Verbessert die Website-Leistung

Wenn Bots Ihre Website uneingeschränkt crawlen dürfen, kann dies Serverressourcen verbrauchen und die Website-Leistung beeinträchtigen. Durch die Steuerung des Crawlings mit robots.txt können Sie die Belastung Ihres Servers reduzieren, was zu schnelleren Ladezeiten und besseren Benutzererlebnissen führt.

So erstellen Sie eine robots.txt-Datei in WordPress

Das Erstellen einer robots.txt-Datei in WordPress ist super einfach. Das gilt insbesondere, wenn Sie ein leistungsstarkes WordPress-SEO-Plugin wie All In One SEO (AIOSEO) haben.

AIOSEO ist das beste WordPress-SEO-Plugin auf dem Markt und hat über 3 Millionen aktive Installationen. Millionen von versierten Website-Besitzern und Vermarktern vertrauen darauf, dass das Plugin ihnen hilft, SERPs zu dominieren und relevanten Website-Traffic zu generieren. Das liegt daran, dass das Plugin viele leistungsstarke SEO-Funktionen und Module bietet, die Ihnen helfen, Ihre Website für Suchmaschinen und Benutzer zu optimieren. Beispiele für die Funktionen, die Sie in AIOSEO finden, sind:

Dies sind Funktionen wie:

- Suchstatistiken: Diese leistungsstarke Google Search Console-Integration ermöglicht es Ihnen, Ihre Keyword-Rankings zu verfolgen und wichtige SEO-Metriken mit einem Klick zu sehen und mehr.

- Next-Gen Schema-Generator: Dies ist ein No-Code-Schema-Generator, der es Benutzern ermöglicht, jede Art von Schema-Markup auf Ihrer Website zu generieren und auszugeben.

- Redirect Manager: Hilft Ihnen, Weiterleitungen zu verwalten und 404-Fehler zu eliminieren, wodurch es für Suchmaschinen einfacher wird, Ihre Website zu crawlen und zu indexieren.

- Link Assistant: Leistungsstarkes Tool für interne Verlinkungen, das den Aufbau von Links zwischen Seiten Ihrer Website automatisiert. Es gibt Ihnen auch eine Überprüfung der ausgehenden Links.

- IndexNow: Für schnelle Indexierung auf Suchmaschinen, die das IndexNow-Protokoll unterstützen (wie Bing und Yandex).

- Sitemap-Generator: Generiert automatisch verschiedene Arten von Sitemaps, um alle Suchmaschinen über Aktualisierungen auf Ihrer Website zu informieren.

- Und mehr.

Für eine Schritt-für-Schritt-Anleitung zur Installation von AIOSEO lesen Sie unsere Installationsanleitung.

Eine der ursprünglichen und beliebtesten Funktionen in AIOSEO ist der Robots.txt-Editor. Dieses leistungsstarke Modul erleichtert die Erstellung und Bearbeitung von robots.txt-Dateien, auch ohne Programmier- oder technische Kenntnisse.

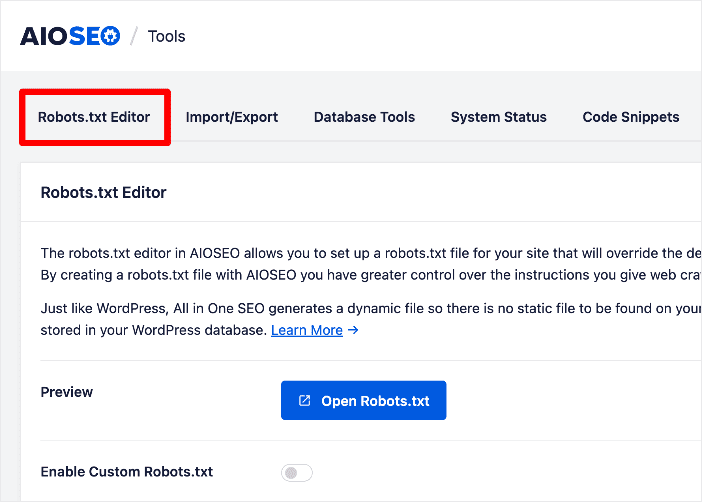

Sie finden den robots.txt-Editor, indem Sie im AIOSEO-Menü auf Tools klicken.

Eines der ersten Dinge, die Sie bemerken werden, ist eine blaue Schaltfläche „Robots.txt öffnen“. Das liegt daran, dass WordPress automatisch eine robots.txt-Datei für Sie generiert. Da sie jedoch nicht optimiert ist, möchten Sie sie bearbeiten. Hier sind die Schritte, die Sie dazu unternehmen müssen:

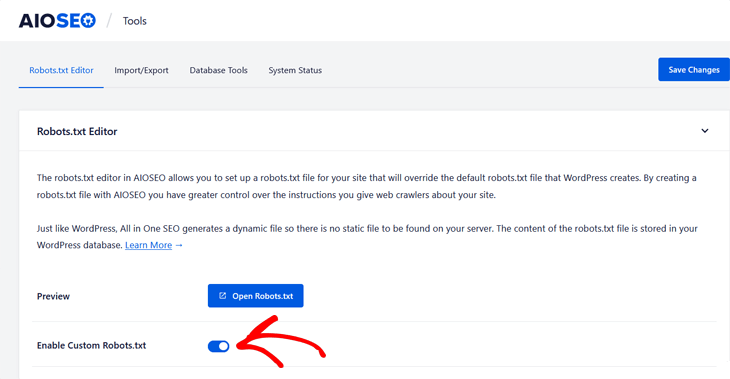

Schritt 1: Benutzerdefinierte robots.txt aktivieren

Sie können dies tun, indem Sie auf die Schaltfläche Benutzerdefinierte Robots.txt aktivieren klicken. Dadurch wird ein Fenster geöffnet, in dem Sie Ihre robots.txt-Datei bearbeiten können.

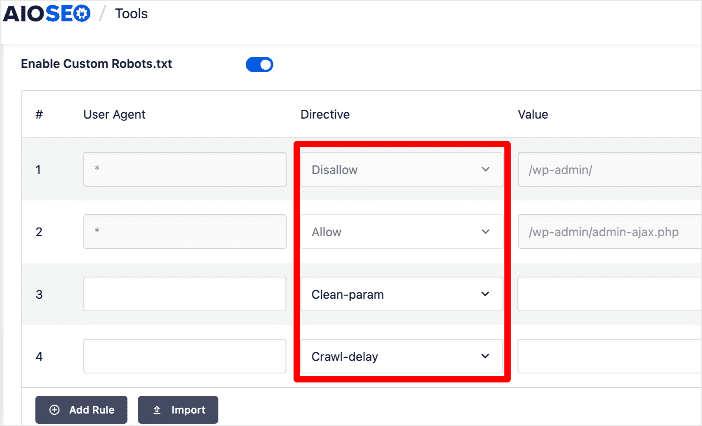

Schritt 2 Passen Sie Ihre Direktiven an

Dies sind die Anweisungen, die Suchbots befolgen sollen. Beispiele hierfür sind Allow, Disallow, Clean-param und Crawl delay.

In diesem Abschnitt können Sie auch festlegen, welche User Agents (Such-Crawler) die Direktive befolgen sollen. Sie müssen auch den Wert (URL, URL-Parameter oder Häufigkeit) der Direktive festlegen.

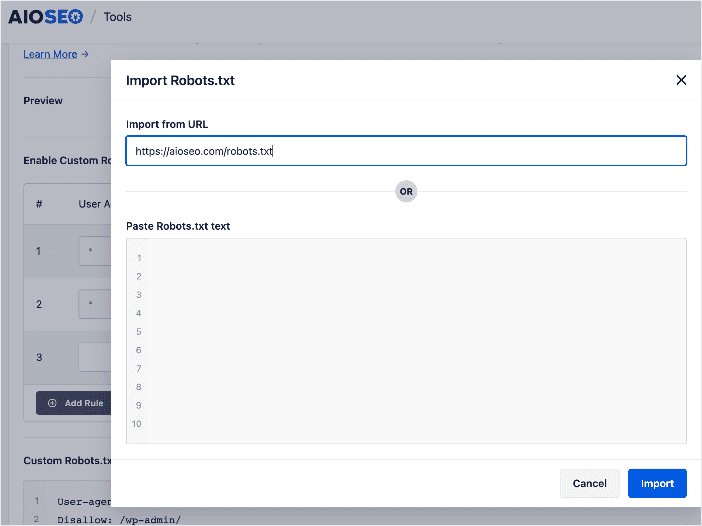

Wenn es eine Website mit einer robots.txt-Datei gibt, die Sie nachahmen möchten, können Sie die Schaltfläche „Importieren“ verwenden, um sie über eine URL oder die Kopieren-und-Einfügen-Funktion zu kopieren.

3. Robots.txt-Datei importieren (optional)

Alternativ können Sie eine robots.txt-Datei von einer anderen Website importieren. Klicken Sie dazu auf die Schaltfläche Importieren. Daraufhin öffnet sich ein Fenster, in dem Sie Ihre Datei entweder über eine URL importieren oder die gewünschte Datei kopieren und einfügen können.

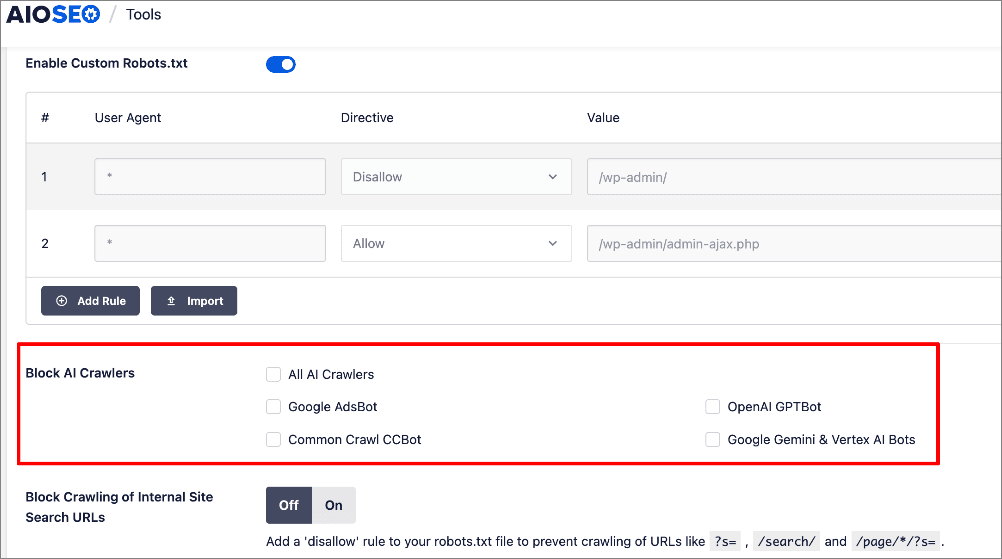

4. Unerwünschte Bots blockieren

Eine weitere supercoole Funktion im Robots.txt-Editor von AIOSEO ist der Abschnitt Block AI Crawlers. Dieser ermöglicht es Ihnen, unbefugte Bots am Crawlen Ihrer Website zu hindern. Diese können zu Leistungsproblemen, Sicherheitsproblemen und SEO-Problemen führen.

Weitere Informationen hierzu finden Sie in unserem Tutorial zum Blockieren unerwünschten Bot-Traffics auf Ihrer Website.

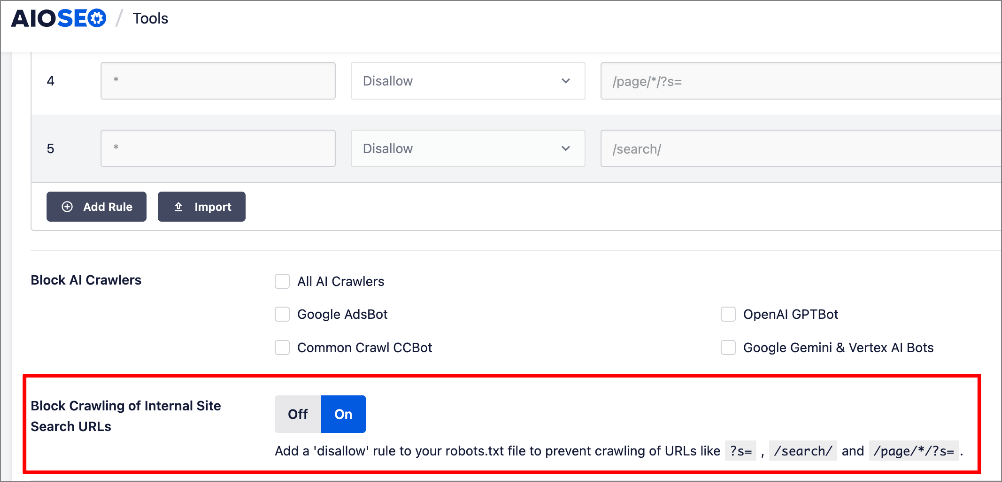

5. Crawling von internen Websuch-URLs verhindern

Websites generieren oft überflüssige URLs aus internen Suchen, wenn Besucher nach Inhalten oder Produkten suchen. Diese suchgenerierten URLs enthalten Parameter, die Suchmaschinen als eindeutig wahrnehmen, wodurch unnötige Seiten gecrawlt werden. Dies verschwendet Ihr Crawl-Budget und kann verhindern, dass Ihre wichtigsten Seiten indexiert werden.

Sie können dies im Robots.txt-Editor von AIOSEO einfach verhindern.

AIOSEO fügt eine „disallow“-Regel in Ihre robots.txt-Datei ein, ohne dass Sie dies für jeden suchgenerierten Parameter tun müssen.

Das Anpassen Ihrer robots.txt-Datei ist so einfach.

Schritt-für-Schritt-Anleitungen zur Bearbeitung Ihrer robots.txt-Datei finden Sie in diesem Tutorial.

Was ist Robots.txt? Ihre FAQs beantwortet

Was ist robots.txt?

Eine robots.txt-Datei ist eine einfache Textdatei, die im Stammverzeichnis einer Website platziert wird, um Suchmaschinen-Bots und anderen Web-Crawlern Anweisungen zu geben, welche Teile der Website gecrawlt oder vom Crawling ausgeschlossen werden sollen. Sie fungiert als Leitfaden für diese Bots, wenn sie mit den Inhalten der Website interagieren.

Wie erstelle ich eine robots.txt-Datei?

Sie können eine robots.txt-Datei einfach mit einem Plugin wie AIOSEO erstellen. Alternativ können Sie den längeren Weg gehen, eine einfache Textdatei namens robots.txt erstellen und sie in das Stammverzeichnis Ihrer Website hochladen.

Kann ich robots.txt zur Verbesserung der SEO verwenden?

Ja, die Optimierung Ihrer robots.txt-Datei kann zu einer besseren SEO beitragen. Indem Sie Suchmaschinen-Bots anweisen, Ihre wertvollsten Inhalte zu crawlen und zu indexieren, während Sie doppelte oder irrelevante Inhalte ausschließen, können Sie die Sichtbarkeit und das Ranking Ihrer Website in den Suchergebnissen verbessern.

Was ist Robots.txt? Jetzt, da Sie es wissen, optimieren Sie Ihre

W

Wie Sie sehen, ist eine robots.txt-Datei ein entscheidender Bestandteil jeder Website. Durch die Optimierung Ihrer Datei stellen Sie sicher, dass Ihre wichtigsten Seiten gecrawlt und indexiert werden, was zu besseren Suchrankings führt.

Nutzen Sie also den robots.txt-Editor von AIOSEO, um Ihre zu optimieren.

Wir hoffen, dieser Beitrag hat Ihnen geholfen zu verstehen, was robots.txt in WordPress ist und warum es wichtig ist, Ihre zu optimieren. Möglicherweise möchten Sie auch andere Artikel in unserem Blog lesen, wie z. B. unseren Leitfaden zum Indexieren bei Google oder unsere Tipps zur Verwendung von Suchstatistiken zur Steigerung Ihrer Rankings.

Wenn Sie diesen Artikel hilfreich fanden, abonnieren Sie bitte unseren YouTube-Kanal. Dort finden Sie viele weitere hilfreiche Tutorials. Sie können uns auch auf Twitter, LinkedIn oder Facebook folgen, um auf dem Laufenden zu bleiben.

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.