Robots.txt ist eine Textdatei, die im Stammverzeichnis einer Website platziert wird und Web-Roboter (wie Suchmaschinen-Crawlers) anweist, welche Seiten oder Bereiche der Website sie aufrufen und indexieren dürfen. Diese Datei dient als Anweisungssatz für diese automatisierten Bots.

Beispiele für die Verwendung von robots.txt:

- Spezifische Verzeichnisse verbieten: User-agent: * Disallow: /private/ Dies weist alle Roboter an, das Verzeichnis „/private/“ und dessen Inhalte nicht aufzurufen.

- Spezifische Roboter zulassen, während andere verboten werden: User-agent: Googlebot Allow: / User-agent: * Disallow: / Dies erlaubt dem Google-Crawler den Zugriff auf alle Seiten, während alle anderen Roboter verboten werden.

- Angabe des Speicherorts der Sitemap: Sitemap: https://example.com/sitemap.xml Dies weist Roboter auf den Speicherort der Sitemap der Website hin, was ihnen hilft, die Website effizient zu durchsuchen.

- Zugriff auf bestimmte Dateitypen verbieten: User-agent: * Disallow: /*.pdf$ Dies verhindert, dass Roboter auf PDF-Dateien auf der Website zugreifen.

Denken Sie daran, dass robots.txt eine öffentlich zugängliche Datei ist und nicht zum Verbergen sensibler Informationen verwendet werden sollte, da sie leicht von jedem eingesehen werden kann.

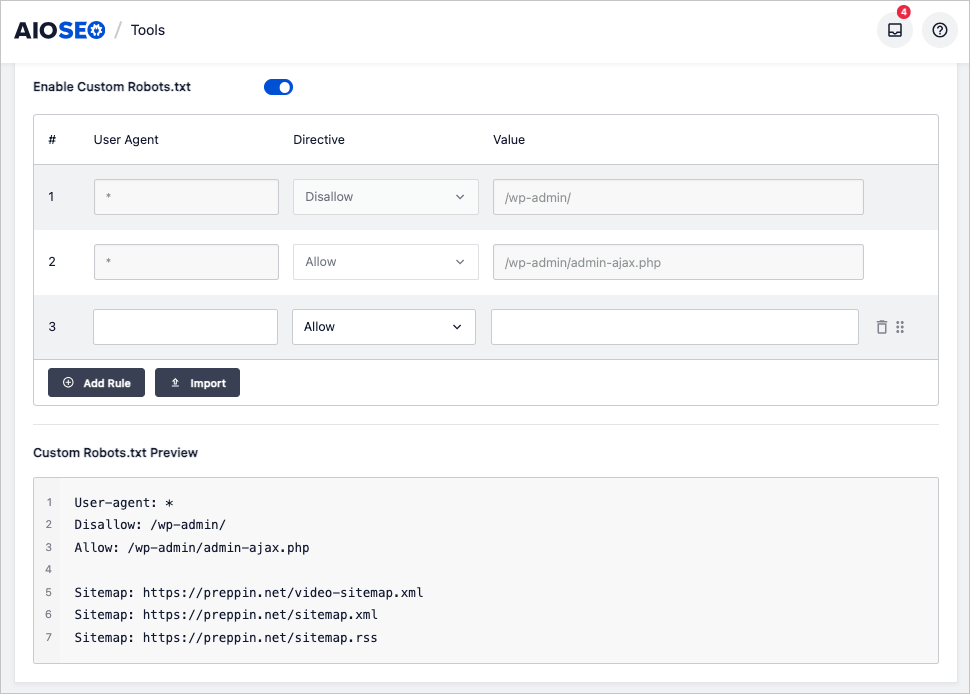

Robots.txt in WordPress

All in One SEO bietet einen benutzerfreundlichen robots.txt-Editor. Sie müssen sich nicht mit Code befassen. Benutzer können ihre robots.txt-Datei bearbeiten, indem sie Formularfelder ausfüllen.

Verwandt: