Möchten Sie wissen, wie Sie einen unerwünschten Webcrawler von Ihrer Website blockieren können?

Während legitime Webcrawler – wie die von Suchmaschinen – für die Indexierung Ihrer Website und die Verbesserung der Sichtbarkeit in Suchergebnissen unerlässlich sind, können unerwünschte Crawler-Bots Chaos anrichten, indem sie Bandbreite verbrauchen, Inhalte abgreifen und Sicherheitsrisiken darstellen.

In diesem Leitfaden erfahren Sie, wie Sie unerwünschte Crawler von Ihrer Website blockieren, um Ihre Daten zu schützen, die Leistung zu verbessern und Ihre SEO-Bemühungen zu sichern.

Ich zeige Ihnen die einfachste Methode, Website-Crawler auf Ihrer Website zu verwalten – und Sie benötigen nicht einmal technisches Wissen, um dies umzusetzen.

Bonus: Es dauert nur wenige Klicks!

In diesem Artikel

Was ist ein Webcrawler?

Ein Webcrawler, auch Bot oder Spider genannt, ist ein automatisiertes Programm, das systematisch das Internet durchsucht, um Informationen von Websites zu indexieren und zu sammeln. Diese Crawler-Bots sind entscheidend dafür, dass Suchmaschinen Websites richtig verstehen und ranken können. Arten von Webcrawlern sind:

- Suchmaschinen-Crawler: Indexieren Websites, um sie in Suchergebnissen anzuzeigen.

- Data Scraper: Extrahieren Informationen, oft zur unbefugten Nutzung.

- Bösartige Bots: Führen schädliche Aktivitäten aus, wie z. B. Spamming oder Hacking-Versuche.

- KI-Bots: Crawlen Ihre Website und nutzen Ihre Inhalte ohne Autorisierung.

Gerade wegen der schädlichen Art ist es wichtig, dass Sie die volle Kontrolle darüber haben, welche Crawler Zugriff auf Ihre Website haben.

Wie Crawler funktionieren

Webcrawler navigieren Ihre Website, indem sie Links von einer Seite zur nächsten folgen. Sie beginnen mit einer Liste von URLs, die oft über eine XML-Sitemap bereitgestellt wird, welche eine Art Fahrplan für die Struktur Ihrer Website ist. Crawler nutzen diese Sitemap, um Ihre Seiten effizient zu indexieren.

Die gute Nachricht ist, dass Sie mit Webcrawlern über eine robots.txt-Datei kommunizieren können. Diese einfache Textdatei enthält Anweisungen, welche Seiten oder Verzeichnisse gecrawlt oder vermieden werden sollen. Allerdings respektieren nicht alle Bots diese Anweisungen, insbesondere bösartige.

Warum einen unerwünschten Webcrawler blockieren?

Warum sollten Sie also Zeit, Energie und Ressourcen investieren, um unerwünschte Crawler zu blockieren?

Ich gebe Ihnen meine Top 4 Gründe.

1. Sicherheitsbedenken

Unerwünschte Webcrawler können erhebliche Sicherheitsrisiken darstellen. Sie könnten versuchen, auf sensible Daten zuzugreifen, Schwachstellen auszunutzen oder bösartigen Code in Ihre Website einzuschleusen.

2. Leistungsprobleme

Exzessives Crawling kann Ihren Server überlasten, was zu einer langsamen Website-Leistung oder sogar zu Ausfallzeiten führen kann. Dies kann sich negativ auf die Benutzererfahrung und den Ruf Ihrer Website auswirken.

3. Datenschutz

Durch das Blockieren nicht autorisierter Bots verhindern Sie, dass diese auf vertrauliche oder proprietäre Daten zugreifen und diese möglicherweise preisgeben.

4. SEO-Auswirkungen

Bösartige Crawler könnten Ihre Inhalte woanders duplizieren, was zu Strafen wegen doppelter Inhalte durch Suchmaschinen führt. Sie können Ihre Inhalte auch missbrauchen, was Ihre Suchrankings und die Glaubwürdigkeit Ihrer Marke beeinträchtigt.

So blockieren Sie einen unerwünschten Webcrawler: Der super-einfache Weg

Nachdem Sie nun die Gefahren kennen, die von unerwünschten Crawlern ausgehen können, tauchen wir schnell ein, wie Sie sie daran hindern, Ihre Website zu beeinträchtigen.

Schritt 1: AIOSEO installieren

Der erste Schritt im Umgang mit einem unerwünschten Webcrawler ist die Installation des All in One SEO (AIOSEO) Plugins auf Ihrer WordPress-Website.

AIOSEO ist das beste WordPress SEO-Plugin auf dem Markt. Über 3 Millionen versierte Website-Besitzer und Vermarkter vertrauen darauf, dass es ihnen hilft, die Suchergebnisseiten (SERPs) zu dominieren und relevanten Website-Traffic zu generieren.

Das Plugin verfügt über viele leistungsstarke SEO-Funktionen und Module, die Ihnen helfen, Ihre Website für Suchmaschinen und Benutzer zu optimieren, auch ohne Programmier- oder technische Kenntnisse. AIOSEO ist ein leistungsstarkes Tool, das die SEO-Verwaltung vereinfacht und erweiterte Funktionen zur Steuerung des Crawler-Zugriffs bietet.

Letzteres betrifft eine erweiterte Funktion von AIOSEO namens Crawl Cleanup. Aber mehr dazu gleich.

Benötigen Sie eine Schritt-für-Schritt-Anleitung zur Installation von AIOSEO?

Dann lesen Sie unsere detaillierte Installationsanleitung.

Schritt 2: Crawl-Bereinigung öffnen

Navigieren Sie in Ihrem WordPress-Dashboard zu AIOSEO » Such appearance » Erweitert.

Scrollen Sie als Nächstes zum Umschalter Crawl Cleanup und stellen Sie sicher, dass er auf "Ein" steht.

Diese Funktion ermöglicht es Ihnen, mühelos zu verwalten, wie Suchmaschinen und Bots mit Ihrer Website interagieren.

Crawl Cleanup verfügt über viele Einstellungen, die Ihnen helfen, die Crawlbarkeit und Leistung Ihrer Website zu optimieren. Beispiele hierfür sind Einstellungen für:

- RSS-Feeds

- Unerwünschte Bots

- Bereinigung der internen Websuche

Crawl Cleanup ist ein unverzichtbares Werkzeug in jedem SEO-Plugin, da es Ihnen hilft, den Bot-Zugriff zu steuern, die Serverauslastung zu reduzieren und die Website-Leistung zu verbessern.

In unserem Fall möchten wir jedoch die Option Unwanted Bots.

Schritt 3: Wählen Sie den Webcrawler aus, den Sie blockieren möchten

Im Abschnitt Unerwünschte Bots finden Sie eine Liste bekannter Bots und Crawler.

Aktivieren Sie einfach die Kontrollkästchen neben den unerwünschten Bots, die Sie blockieren möchten.

Alternativ können Sie:

- Alle unerwünschten Bots blockieren, was Ihnen mehr Kontrolle über Ihr Crawl-Budget gibt.

- Hauptsächlich KI-Crawler anvisieren, um zu verhindern, dass sie Ihre Inhalte ohne Erlaubnis indizieren.

Wenn Sie dies tun, wird AIOSEO automatisch Ihre robots.txt-Datei aktualisieren und die notwendigen Einstellungen anwenden, um zu verhindern, dass diese unerwünschten Bots auf Ihre Website zugreifen.

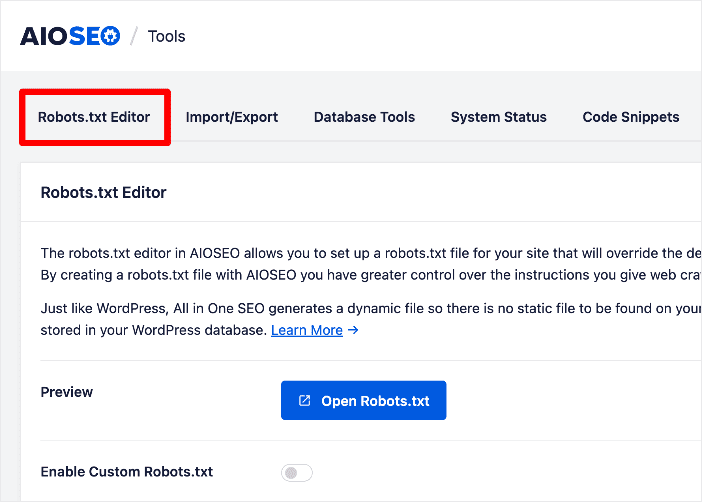

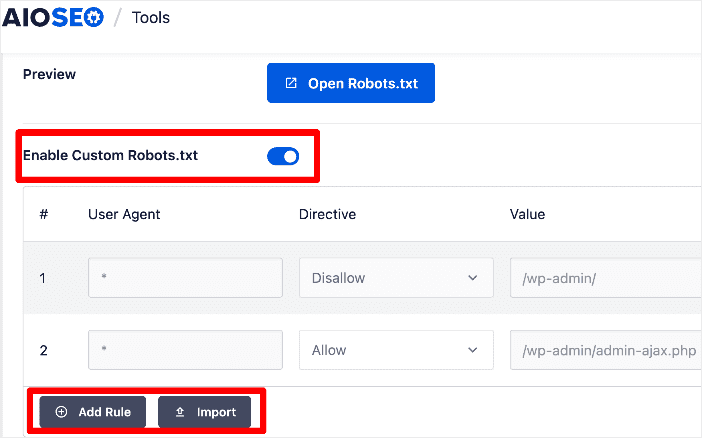

Schritt 4: robots.txt bearbeiten (Optional)

Möchten Sie erweiterte Kontrolle über die Verwaltung unerwünschter Webcrawler?

Sie können auch erwägen, Crawl-Direktiven direkt in AIOSEO in der robots.txt-Datei Ihrer Website festzulegen. Gehen Sie dazu im Menü All in One SEO zu » Tools » Robots.txt Editor.

Die robots.txt-Datei teilt Bots mit, auf welche Teile Ihrer Website sie zugreifen dürfen oder nicht. Sie können Direktiven hinzufügen, um Bots den Zugriff auf bestimmte Verzeichnisse oder Dateien zu verweigern.

Sie können sogar Direktiven von einer anderen Website importieren, was es sehr einfach macht, Direktiven von einer Ihrer anderen Websites oder einer Website, die Ihnen gefällt, anzuwenden.

Durch die Verwendung des Robots.txt Editors von AIOSEO können Sie Ihre Roboteranweisungen anpassen, ohne sich mit komplexem Code befassen zu müssen.

So blockieren Sie einen unerwünschten Webcrawler: Ihre FAQs beantwortet

Wie kann ich verhindern, dass Webcrawler auf meine gesamte Website zugreifen?

Der beste Weg, um zu verhindern, dass unerwünschte Crawler auf Ihre Website zugreifen, ist die Verwendung der Crawl Cleanup-Funktion von AIOSEO. Sie können Ihre Website mit nur wenigen Klicks vor unbefugtem Crawling schützen.

Wie kann ich einen Google-Crawler stoppen?

Wenn Sie Googlebot blockieren müssen, fügen Sie Ihrer robots.txt-Datei Folgendes hinzu:

User-Agent: Googlebot

Disallow: /

Alternativ können Sie, wenn Sie Google von bestimmten Seiten blockieren möchten, die Funktion Robots Meta Tags in AIOSEO verwenden, um noindex-Direktiven für diese Seiten festzulegen.

Welche Datei wird verwendet, um unerwünschte Webcrawler auf einer Website zu stoppen?

Die robots.txt-Datei ist das primäre Mittel zur Kommunikation mit Crawlern. Zusätzlich können Sie Robots-Meta-Tags auf einzelnen Seiten verwenden, um Crawler anzuweisen, Links auf dieser Seite nicht zu indexieren oder zu folgen.

Ich hoffe, dieser Beitrag hat Ihnen geholfen zu lernen, wie Sie unerwünschte Webcrawler von Ihrer Website fernhalten können. Vielleicht möchten Sie auch andere Artikel in unserem Blog lesen, wie unseren Leitfaden zu Canonical Tags oder unsere Liste der besten WordPress-Plugins.

Wenn Sie diesen Artikel hilfreich fanden, abonnieren Sie bitte unseren YouTube-Kanal. Dort finden Sie viele weitere hilfreiche Tutorials. Sie können uns auch auf X (Twitter), LinkedIn oder Facebook folgen, um auf dem Laufenden zu bleiben.

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.