¿Qué es robots.txt en WordPress?

Cuando buscas consejos para mejorar tu posicionamiento en los motores de búsqueda, es probable que el archivo robots.txt aparezca. Esto se debe a que es una parte importante de tu sitio y debe tenerse en cuenta si deseas mejorar tu posicionamiento en las páginas de resultados de los motores de búsqueda (SERPs).

En este artículo, responderemos a la pregunta: "¿Qué es robots.txt en WordPress?". También te mostraremos cómo generar un archivo robots.txt para tu sitio.

En este artículo

¿Qué es Robots.txt?

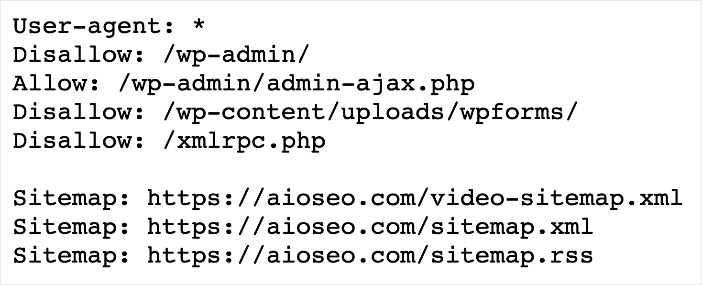

Robots.txt es un archivo de texto que los propietarios de sitios web pueden crear para indicar a los bots de los motores de búsqueda cómo interactuar con sus sitios, principalmente qué páginas rastrear y cuáles ignorar. Es un archivo de texto plano almacenado en el directorio raíz de tu sitio web (también conocido como la carpeta principal). En nuestro caso, la URL de nuestro robots.txt es:

https://aioseo.com/robots.txtY así es como se ve:

Esto no debe confundirse con las etiquetas meta robots, que son etiquetas HTML incrustadas en el encabezado de una página web. La etiqueta solo se aplica a la página en la que se encuentra.

¿Qué significa todo esto?

Para entenderlo mejor, retrocedamos un poco y definamos qué es un robot. En este contexto, los robots son cualquier "bot" o rastreador web que visita sitios web en Internet. Estos se denominan agentes de usuario en el archivo robots.txt. Los más comunes son los rastreadores de motores de búsqueda, también llamados bots de búsqueda o arañas de motores de búsqueda, entre muchos otros nombres. Estos bots rastrean la web para ayudar a los motores de búsqueda a descubrir tu contenido y así indexarlo más rápido para que puedan servirlo a los usuarios en respuesta a términos de búsqueda relevantes.

En general, los bots de búsqueda son buenos para Internet y para tu sitio. Sin embargo, por muy útiles que sean, hay casos en los que es posible que desees controlar cómo interactúan con tu sitio.

Aquí es donde entra el archivo robots.txt.

¿Qué hace un archivo Robots.txt?

Como ya se ha visto, un archivo robots.txt sirve como un conjunto de instrucciones para guiar a los bots de los motores de búsqueda y otros rastreadores web sobre cómo interactuar con el contenido de tu sitio web. Actúa como un guardián digital que influye en cómo los motores de búsqueda perciben e interactúan con tu sitio web.

Aquí tienes algunas cosas para las que puedes usar un archivo robots.txt:

Controlar el rastreo

Los bots de los motores de búsqueda rastrean sitios web para descubrir e indexar contenido. Un archivo robots.txt informa a estos bots qué partes de tu sitio web están abiertas para el rastreo y cuáles están prohibidas. Puedes controlar a qué páginas pueden acceder especificando reglas para diferentes agentes de usuario (bots).

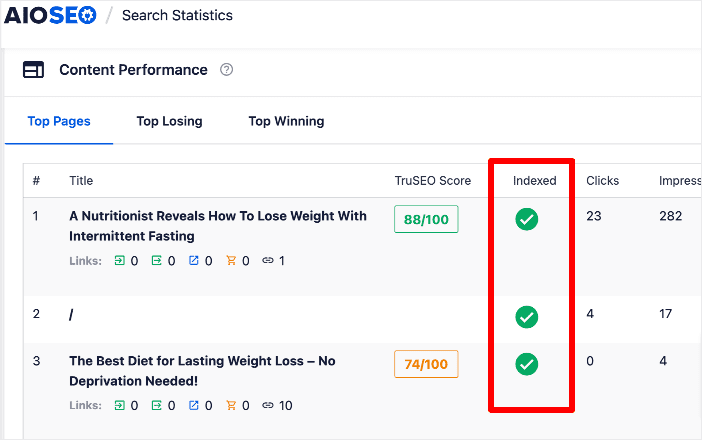

Dirigir la indexación

Mientras que el rastreo implica descubrir contenido, la indexación implica añadir el contenido descubierto a la base de datos del motor de búsqueda. Al utilizar un archivo robots.txt, puedes guiar a los bots sobre qué contenido indexar y cuál excluir. Esto te permite priorizar la indexación de páginas importantes mientras evitas que contenido irrelevante sature los resultados de búsqueda.

Puedes usar fácilmente AIOSEO para comprobar el estado de indexación de tus publicaciones y páginas.

Esto te ayudará a mantener un registro fácil del estado de indexación de tus páginas.

Prevenir problemas de contenido duplicado

El contenido duplicado puede confundir a los motores de búsqueda e impactar negativamente el SEO de tu sitio. Con robots.txt, puedes evitar que los bots rastreen e indexen contenido duplicado, asegurando que solo la versión más relevante de tu contenido se considere para los resultados de búsqueda.

Proteger información sensible

Algunas áreas de tu sitio web pueden contener datos confidenciales que no deseas exponer al público ni que sean indexados por los motores de búsqueda. Un archivo robots.txt bien estructurado puede evitar que los bots accedan e indexen estas áreas, mejorando la privacidad y seguridad de tu sitio web.

Optimiza el presupuesto de rastreo

Los motores de búsqueda asignan un presupuesto de rastreo a cada sitio web, determinando con qué frecuencia y profundidad los bots rastrean tu sitio. Usando robots.txt, puedes guiar a los bots hacia tus páginas más valiosas y relevantes, asegurando un uso eficiente de tu presupuesto de rastreo.

Mejora el rendimiento del sitio

Permitir que los bots rastreen tu sitio sin restricciones puede consumir recursos del servidor e impactar el rendimiento del sitio. Al controlar el rastreo con robots.txt, puedes reducir la carga en tu servidor, lo que lleva a tiempos de carga más rápidos y mejores experiencias de usuario.

Cómo generar un archivo Robots.txt en WordPress

Generar un archivo robots.txt en WordPress es muy fácil. Esto es especialmente cierto si tienes un potente plugin de SEO para WordPress como All In One SEO (AIOSEO).

AIOSEO es el mejor plugin de SEO para WordPress del mercado, con más de 3 millones de instalaciones activas. Millones de propietarios de sitios web y especialistas en marketing de confianza confían en el plugin para ayudarles a dominar las SERP y generar tráfico web relevante. Esto se debe a que el plugin tiene muchas potentes funciones y módulos de SEO para ayudarte a optimizar tu sitio web para motores de búsqueda y usuarios. Algunos ejemplos de las funciones que encontrarás en AIOSEO son:

Estas son funciones como:

- Estadísticas de búsqueda: Esta potente integración de Google Search Console te permite rastrear tus rankings de palabras clave y ver métricas SEO importantes con 1 clic, y más.

- Generador de Schema de próxima generación: Este es un generador de schema sin código que permite a los usuarios generar y mostrar cualquier tipo de marcado de schema en tu sitio.

- Administrador de redirecciones: Le ayuda a administrar las redirecciones y a eliminar los errores 404, lo que facilita que los motores de búsqueda rastreen e indexen su sitio.

- Asistente de Enlaces: Potente herramienta de enlaces internos que automatiza la creación de enlaces entre las páginas de tu sitio. También te proporciona una auditoría de enlaces salientes.

- IndexNow: Para una indexación rápida en motores de búsqueda que admiten el protocolo IndexNow (como Bing y Yandex).

- Generador de sitemaps: Genera automáticamente diferentes tipos de sitemaps para notificar a todos los motores de búsqueda sobre cualquier actualización en tu sitio.

- Y más.

Para obtener instrucciones paso a paso sobre c ilde{}^{a}mo instalar AIOSEO, consulta nuestra gu ilde{}^{a}a de instalaci ilde{}^{a}n.

Una de las funciones originales y más apreciadas de AIOSEO es el editor de Robots.txt. Este potente módulo facilita la generación y edición de archivos robots.txt, incluso sin conocimientos de codificación o técnicos.

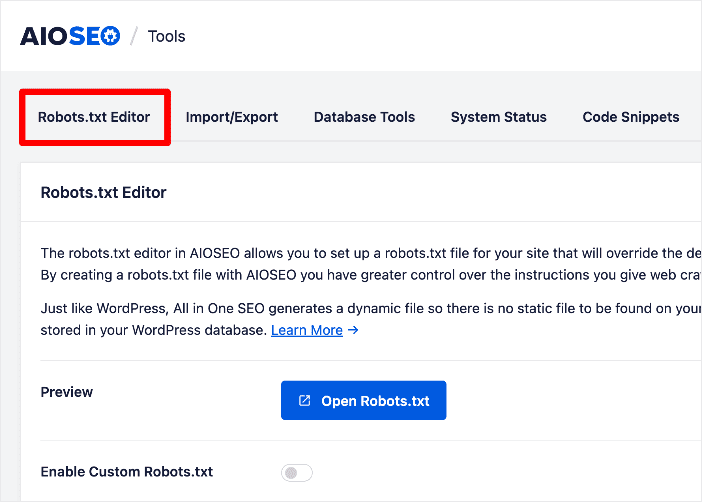

Puedes encontrar el editor de robots.txt haciendo clic en Herramientas en tu menú de AIOSEO.

Una de las primeras cosas que notarás es un botón azul Abrir Robots.txt. Esto se debe a que WordPress genera automáticamente un archivo robots.txt para ti. Pero como no está optimizado, querrás editarlo. Aquí tienes los pasos que necesitas seguir para hacerlo:

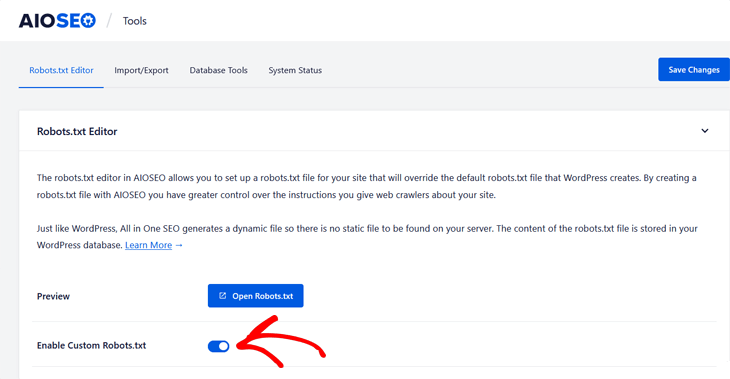

Paso 1: Habilitar robots.txt personalizado

Puedes hacer esto haciendo clic en el botón Habilitar Robots.txt Personalizado. Esto abrirá una ventana que te permitirá editar tu archivo robots.txt.

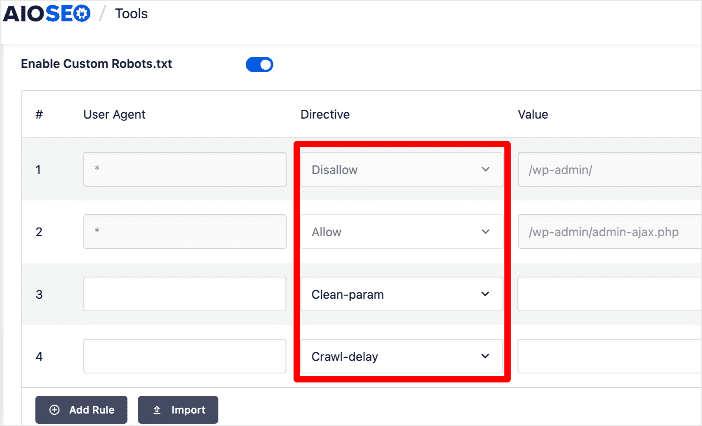

Paso 2 Personalizar tus directivas

Estas son las instrucciones que quieres que sigan los bots de búsqueda. Los ejemplos incluyen Allow, Disallow, Clean-param y Crawl delay.

En esta sección, también puedes determinar qué agentes de usuario (rastreadores de búsqueda) deben seguir la directiva. También tendrás que especificar el valor (URL, parámetros de URL o frecuencia) de la directiva.

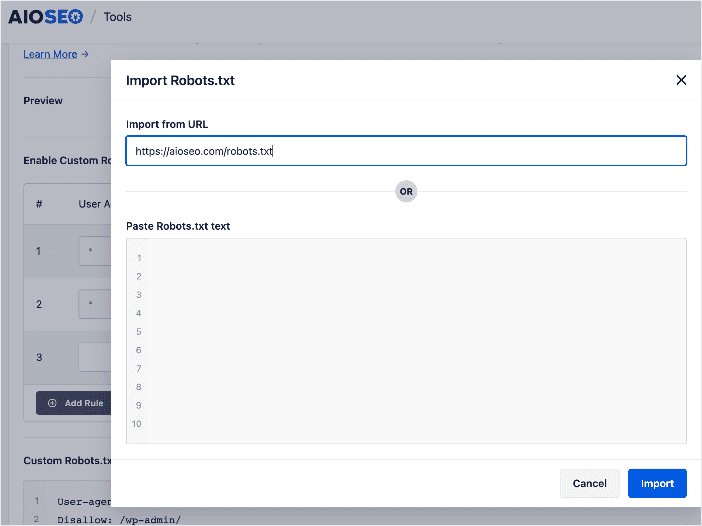

Si hay un sitio con un archivo robots.txt que deseas emular, puedes usar el botón Importar para copiarlo usando una URL o la función de copiar y pegar.

3. Importar un archivo Robots.txt (Opcional)

Alternativamente, puedes optar por importar un archivo robots.txt de otro sitio. Para ello, haz clic en el botón Importar. Al hacerlo, se abrirá una ventana donde podrás importar tu archivo usando una URL o copiando y pegando el archivo deseado.

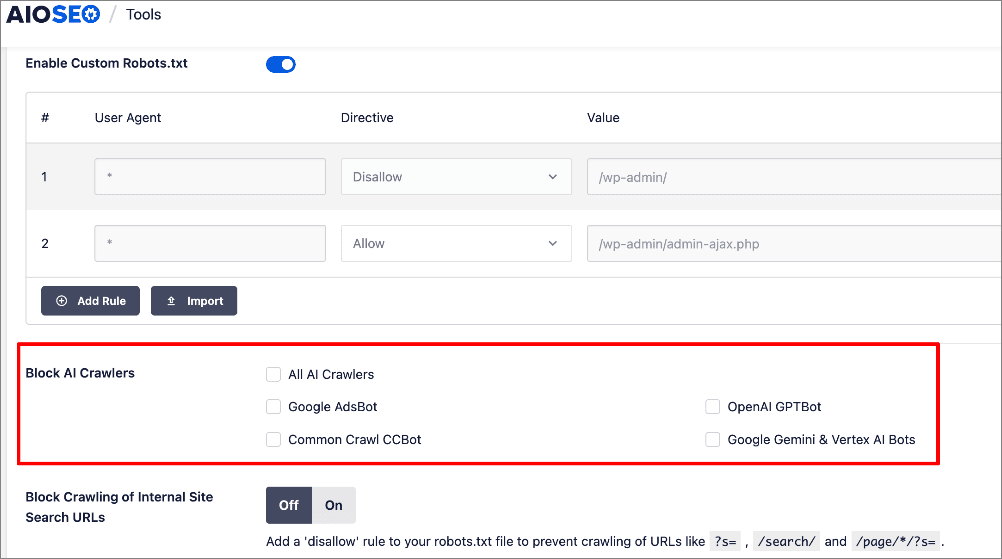

4. Bloquear bots no deseados

Otra característica genial de AIOSEO's Robots.txt Editor es la sección Bloquear rastreadores de IA. Esto te permite bloquear bots no autorizados de rastrear tu sitio. Estos pueden causar problemas de rendimiento, seguridad y SEO.

Para más información, consulta nuestro tutorial sobre cómo bloquear el tráfico no deseado de bots en tu sitio.

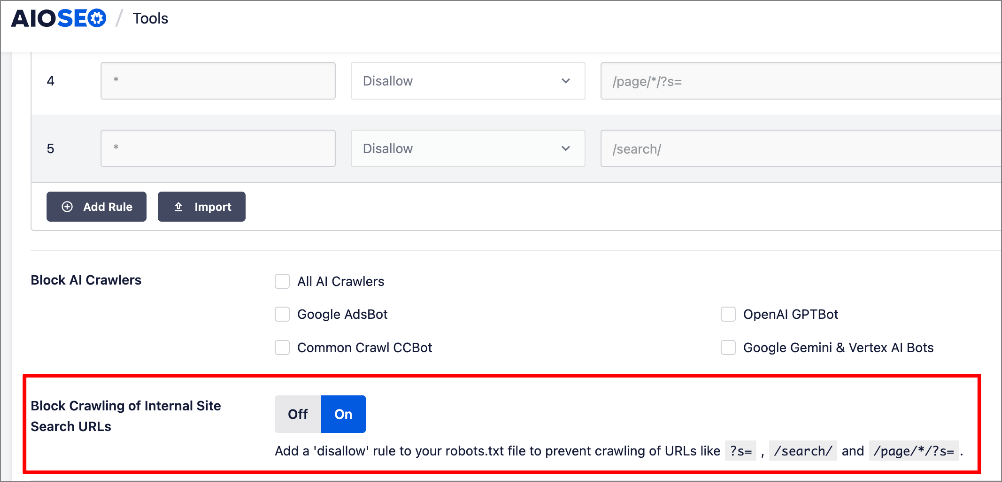

5. Prevenir el rastreo de URLs de búsqueda interna del sitio

Los sitios web a menudo generan URLs excesivas a partir de búsquedas internas cuando los visitantes buscan contenido o productos. Estas URLs generadas por búsquedas contienen parámetros que los motores de búsqueda perciben como únicos, lo que hace que rastreen páginas innecesarias. Esto desperdicia tu presupuesto de rastreo y puede impedir que tus páginas más importantes sean indexadas.

Puedes evitar esto fácilmente en AIOSEO's Robots.txt Editor.

AIOSEO añade una regla "disallow" en tu archivo robots.txt sin que tengas que hacerlo para cada parámetro generado por la búsqueda.

Personalizar tu archivo robots.txt es así de fácil.

Para obtener instrucciones paso a paso sobre cómo editar tu archivo robots.txt, consulta este tutorial.

¿Qué es Robots.txt? Tus preguntas frecuentes respondidas

¿Qué es robots.txt?

Un archivo robots.txt es un archivo de texto plano que se coloca en el directorio raíz de un sitio web para proporcionar instrucciones a los bots de los motores de búsqueda y otros rastreadores web sobre qué partes del sitio deben rastrearse o excluirse del rastreo. Actúa como un conjunto de directrices que estos bots deben seguir al interactuar con el contenido del sitio web.

¿Cómo creo un archivo robots.txt?

Puedes crear fácilmente un archivo robots.txt usando un plugin como AIOSEO. Alternativamente, puedes tomar la ruta más larga y crear un archivo de texto plano llamado robots.txt y subirlo al directorio raíz de tu sitio.

¿Puedo usar robots.txt para mejorar el SEO?

Sí, optimizar tu archivo robots.txt puede contribuir a un mejor SEO. Al guiar a los bots de los motores de búsqueda para que rastreen e indexen tu contenido más valioso mientras excluyes contenido duplicado o irrelevante, puedes mejorar la visibilidad y el ranking de tu sitio web en los resultados de búsqueda.

¿Qué es Robots.txt? Ahora que lo sabes, optimízalo

W

Como puedes ver, un archivo robots.txt es una parte crucial de cualquier sitio web. Optimizar el tuyo asegura que tus páginas más importantes sean rastreadas e indexadas, lo que lleva a mejores rankings de búsqueda.

Así que, adelante y usa el editor robots.txt de AIOSEO para optimizar el tuyo.

Esperamos que esta publicación te haya ayudado a saber qué es robots.txt en WordPress y por qué es importante optimizar el tuyo. También puedes consultar otros artículos de nuestro blog, como nuestra guía sobre cómo indexar en Google o nuestros consejos sobre cómo usar las estadísticas de búsqueda para mejorar tus rankings.

Si encontraste útil este artículo, suscríbete a nuestro Canal de YouTube. Encontrarás muchos más tutoriales útiles allí. También puedes seguirnos en Twitter, LinkedIn o Facebook para estar al tanto.

Descargo de responsabilidad: Nuestro contenido es compatible con los lectores. Esto significa que si haces clic en algunos de nuestros enlaces, podemos ganar una comisión. Solo recomendamos productos que creemos que añadirán valor a nuestros lectores.