Möchten Sie wissen, wie Sie robots.txt-Dateien in WordPress generieren?

Als ich anfing, WordPress-Websites zu verwalten, hatte ich keine Ahnung, was eine robots.txt-Datei ist. Meine SEO-Rankings waren inkonsistent, und ich konnte nicht herausfinden, warum Suchmaschinen zufällige Seiten indexierten, während meine wichtigen Inhalte übersehen wurden.

Dann entdeckte ich, dass WordPress keine optimierte robots.txt-Datei automatisch erstellt. Viele Kleinunternehmer stehen vor demselben frustrierenden Problem. Suchmaschinen durchsuchen Ihre Website ineffizient und verschwenden Ihr Crawl-Budget für unwichtige Seiten.

Nachdem ich im Laufe der Jahre Dutzende von WordPress-Websites verwaltet habe, habe ich gelernt, dass eine richtig konfigurierte robots.txt-Datei entscheidend für den SEO-Erfolg ist. Sie teilt Suchmaschinen genau mit, welche Seiten sie durchsuchen und welche sie überspringen sollen.

Die gute Nachricht? Sie benötigen keine Programmierkenntnisse, um Ihre robots.txt-Datei in WordPress zu erstellen und zu optimieren. Es gibt einfache, benutzerfreundliche Tools, die alles für Sie erledigen.

In diesem Leitfaden zeige ich Ihnen genau, wie Sie Ihre robots.txt-Datei mit No-Code-Lösungen generieren und anpassen. Sie erfahren, welche Seiten Sie blockieren, welche Sie priorisieren und wie Sie häufige Fehler vermeiden, die Ihre SEO-Rankings beeinträchtigen könnten.

In diesem Artikel

- Was ist eine Robots.txt-Datei

- Bedeutung einer Robots.txt-Datei

- How to Generate a Robots.txt File In WordPress

- Schritt 1: AIOSEO installieren

- Schritt 2: Greifen Sie auf den Robots.txt-Editor zu

- Schritt 3: Fügen Sie Robots.txt-Direktiven hinzu

- Schritt 4: Importieren Sie Robots.txt-Direktiven von einer anderen Website (optional)

- Schritt 5: Blockieren Sie unerwünschte Bots (optional)

- Schritt 6: Verhindern Sie das Crawling von internen Websuche-URLs (optional)

- Schritt 7: Testen Sie Ihre Robots.txt-Datei

- How to Generate a Robots.txt File In WordPress: Your FAQs Answered

Was ist eine Robots.txt-Datei

Robots.txt ist eine Textdatei, die Website-Besitzer erstellen können, um Suchmaschinen-Bots mitzuteilen, wie sie mit ihren Websites interagieren sollen, hauptsächlich welche Seiten sie crawlen und welche sie ignorieren sollen. Im Wesentlichen fungiert sie als Gatekeeper Ihrer Website und wird im Stammverzeichnis (auch als Hauptordner bezeichnet) Ihrer Website gespeichert.

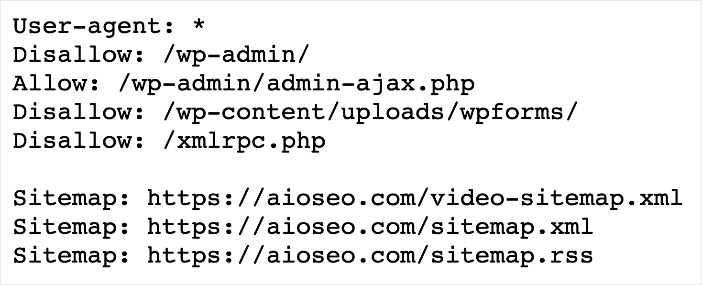

So sieht sie aus:

Sie können leicht auf Ihre robots.txt-Datei zugreifen, indem Sie https://ihre-website.de/robots.txt besuchen.

Dies sollte nicht mit Robots-Meta-Tags verwechselt werden, die HTML-Tags sind, die in den Kopf einer Webseite eingebettet sind. Der Tag gilt nur für die Seite, auf der er sich befindet.

Bedeutung einer Robots.txt-Datei

Hier sind einige Dinge, für die Sie eine robots.txt-Datei verwenden können:

- Crawling steuern

- Indexierung verbessern

- Probleme mit doppelten Inhalten verhindern

- Sensible Informationen schützen

- Optimiert das Crawl-Budget

- Verbessert die Website-Leistung

Trotz der Tatsache, dass es sich um eine einfache Textdatei handelt, kann eine optimierte robots.txt-Datei Ihre SEO erheblich beeinflussen.

So generieren Sie eine Robots.txt-Datei in WordPress

Bereit, robots.txt-Dateien zu generieren?

Hinweis: WordPress generiert automatisch eine robots.txt-Datei für Ihre Website. Aber normalerweise muss die Standarddatei optimiert werden.

In den folgenden Schritten zeige ich Ihnen, wie Sie eine benutzerdefinierte robots.txt-Datei generieren. Keine Sorge. Es sind keine Codes oder technischen Kenntnisse erforderlich.

Schritt 1: AIOSEO installieren

Der erste Schritt zur Generierung benutzerdefinierter robots.txt-Dateien ist die Installation und Aktivierung von All In One SEO (AIOSEO).

AIOSEO ist ein leistungsstarkes und dennoch einfach zu bedienendes SEO-Plugin mit über 3 Millionen aktiven Installationen. Millionen von klugen Bloggern nutzen AIOSEO, um ihr Suchmaschinenranking zu verbessern und qualifizierten Traffic auf ihre Blogs zu lenken. Das Plugin verfügt über viele leistungsstarke Funktionen und Module, die Ihnen helfen, Ihre SEO-Einstellungen richtig zu konfigurieren. Beispiele hierfür sind:

- Cornerstone Content: Hilft Ihnen, thematische Autorität aufzubauen und verbessert Ihre semantische SEO.

- Suchstatistiken: Diese leistungsstarke Google Search Console-Integration ermöglicht es Ihnen, Ihre Keyword-Rankings zu verfolgen und wichtige SEO-Metriken mit einem Klick zu sehen und mehr.

- Erweiterter Robots.txt-Generator: Generieren und passen Sie Ihre robots.txt-Datei einfach an, um das Crawling und Indexing zu verbessern.

- Keyword Rank Tracker: Verfolgen Sie Ihre Keyword-Performance bei Google direkt in Ihrem WordPress-Dashboard.

- KI-Schreibassistent: Identifizieren Sie relevante Keywords, verbessern Sie die Lesbarkeit und optimieren Sie Ihre Inhalte für Suchmaschinen, um sicherzustellen, dass sie in den Suchergebnissen höher ranken.

- Next-gen Schema Generator: Dieser No-Code-Schema-Generator ermöglicht es Benutzern, beliebige Schema-Markup für Ihre Website zu generieren und auszugeben.

- Redirection Manager: Hilft Ihnen, Weiterleitungen zu verwalten und 404-Fehler zu eliminieren, sodass Suchmaschinen Ihre Website leichter crawlen und indexieren können.

- Link Assistant: Leistungsstarkes internes Verknüpfungstool, das die Erstellung von Links zwischen Seiten Ihrer Website automatisiert. Es bietet Ihnen auch eine Überprüfung ausgehender Links.

- Sitemap Generator: Generiert automatisch verschiedene Arten von Sitemaps, um alle Suchmaschinen über Aktualisierungen auf Ihrer Website zu informieren.

- Und mehr

Für eine Schritt-für-Schritt-Anleitung zur Installation von AIOSEO lesen Sie unsere Installationsanleitung.

Und eine der beliebtesten Funktionen ist unser erweiterter robots.txt-Editor. Dieses leistungsstarke Tool erleichtert die Anpassung Ihrer robots.txt-Datei an Ihre Bedürfnisse. Außerdem werden Ihre Sitemap-URLs automatisch zur robots.txt-Datei hinzugefügt!

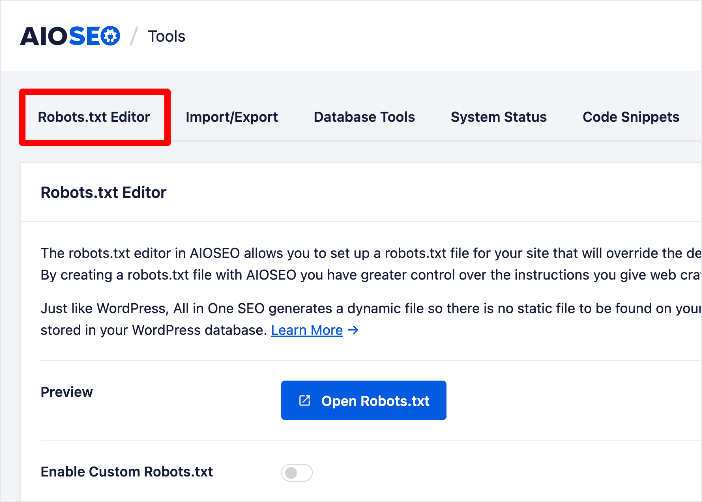

Schritt 2: Greifen Sie auf den Robots.txt-Editor zu

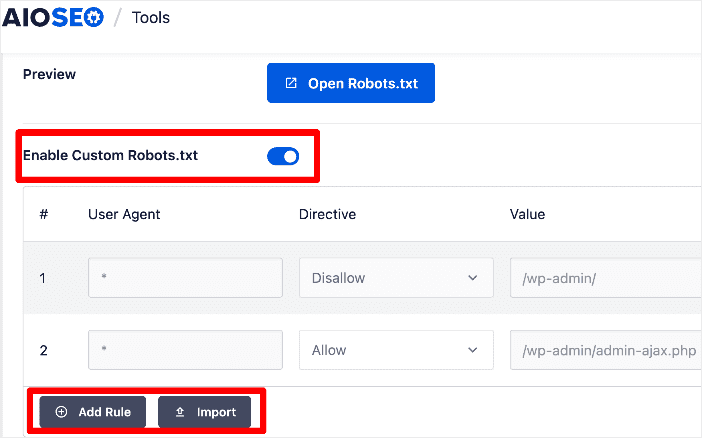

Sobald Sie AIOSEO aktiviert haben, besteht der nächste Schritt darin, auf den Robots.txt-Editor von AIOSEO zuzugreifen. Gehen Sie dazu zu Ihrem AIOSEO-Menü und klicken Sie auf Tools » Robots.txt Editor.

Klicken Sie dann auf den Schalter Benutzerdefinierte Robots.txt aktivieren. Dadurch können Sie Ihre robots.txt-Datei bearbeiten.

Schauen Sie sich unsere Liste der besten robots.txt-Generatoren für weitere robots.txt-Tools an.

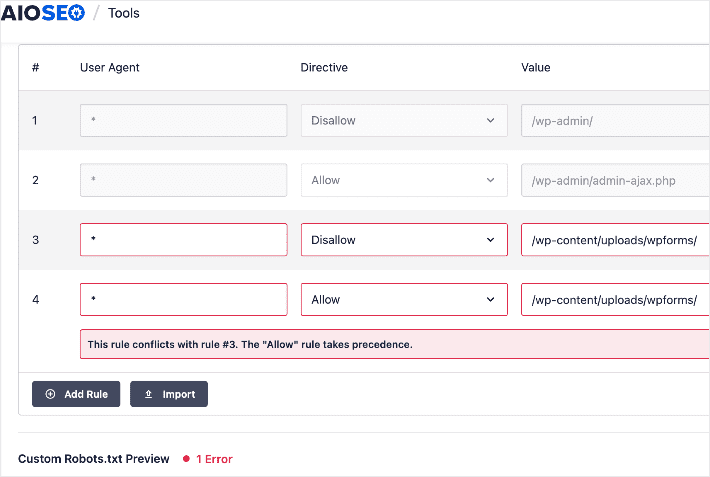

Schritt 3: Fügen Sie Robots.txt-Direktiven hinzu

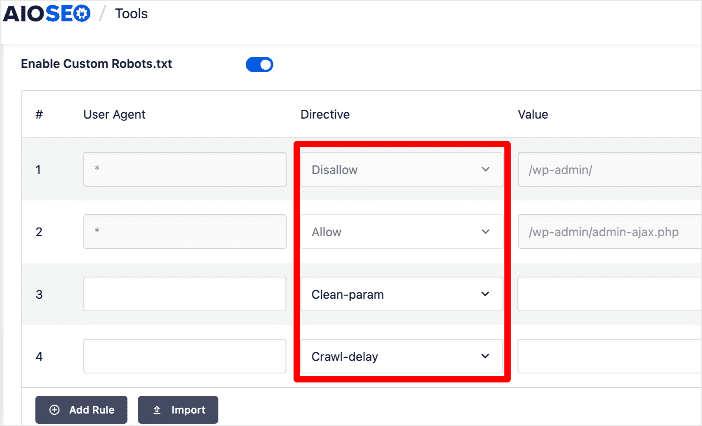

Sobald Sie die Bearbeitung Ihrer robots.txt-Dateien aktiviert haben, besteht der nächste Schritt darin, Ihre benutzerdefinierten Direktiven hinzuzufügen.

Dies sind die Anweisungen, die Suchbots befolgen sollen. Beispiele hierfür sind Allow, Disallow, Clean-param und Crawl delay.

Hier ist die Bedeutung jeder Direktive:

- Allow: Erlaubt User Agents (Bots), die URL zu crawlen.

- Disallow: Verbietet User Agents (Bots), die URL zu crawlen.

- Clean-param: Weist Suchbots an, alle URLs mit den angegebenen URL-Parametern zu ignorieren.

- Crawl-delay: Legt die Intervalle fest, in denen Suchbots die URL crawlen sollen.

In diesem Abschnitt können Sie auch festlegen, welche User Agents die Direktive befolgen sollen. Sie müssen auch den Wert (URL, URL-Parameter oder Häufigkeit) der Direktive angeben.

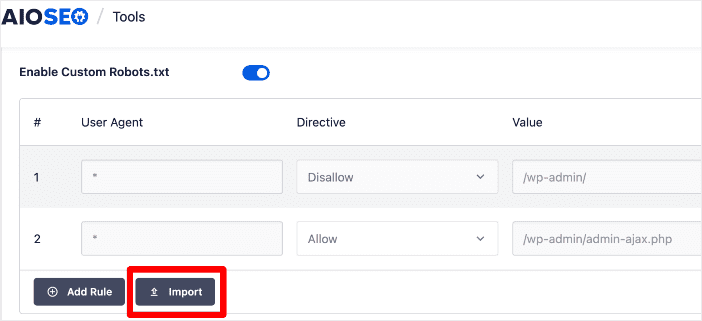

Schritt 4: Importieren Sie Robots.txt-Direktiven von einer anderen Website (optional)

Eine einfachere Methode, robots.txt-Dateien in WordPress zu generieren, ist die Verwendung der Funktion Import.

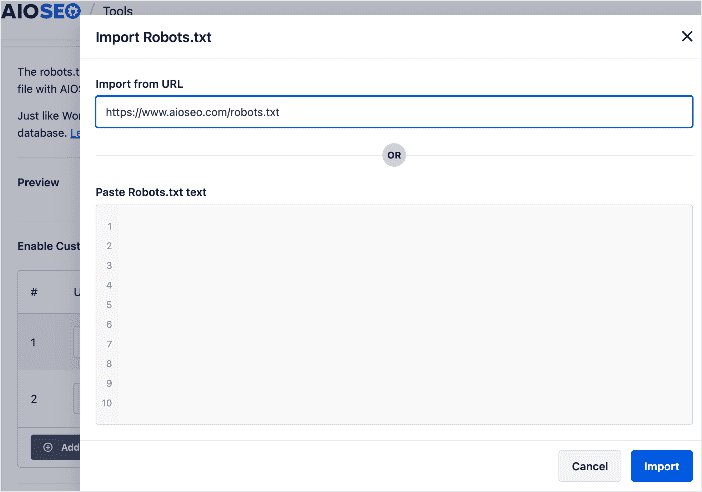

Durch Klicken auf die Schaltfläche Importieren wird ein Fenster mit 2 Optionen zum Importieren Ihrer ausgewählten robots.txt-Datei geöffnet:

Von URL importieren: Fügen Sie einfach die URL der robots.txt-Datei ein, die Sie importieren möchten (https://examplesite.com/robots.txt) und klicken Sie auf Importieren. Die robots.txt-Datei wird auf Ihre Website importiert.

Robots.txt-Text einfügen: Öffnen Sie die URL mit der robots.txt-Datei, die Sie importieren möchten, und kopieren Sie den Text. Gehen Sie dann zurück zu Ihrer Website, fügen Sie ihn in das bereitgestellte Feld ein und klicken Sie auf Importieren.

Diese Methode ist am besten geeignet, wenn die Website, von der Sie die robots.txt-Datei importieren, Direktiven enthält, die Sie auf Ihrer Website implementieren möchten.

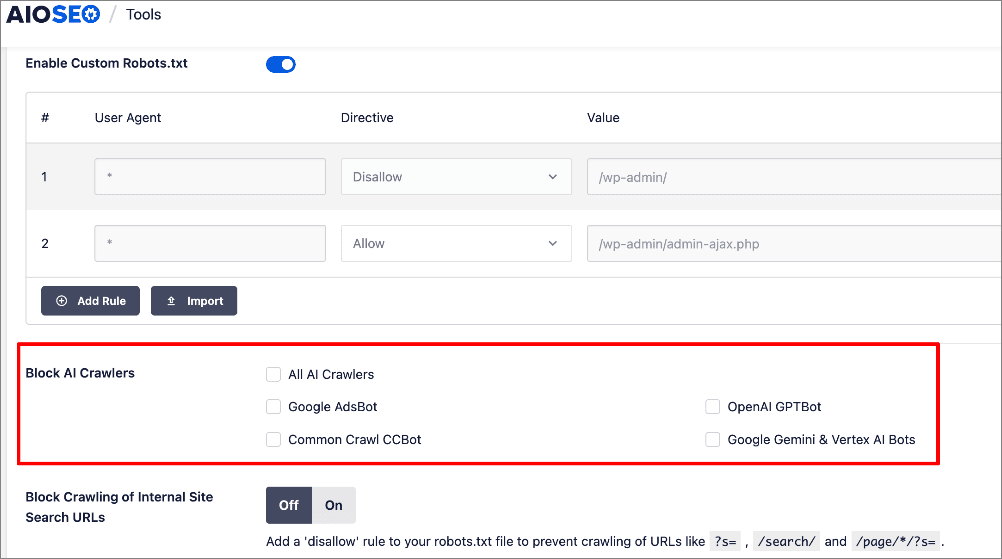

Schritt 5: Blockieren Sie unerwünschte Bots (optional)

Eine weitere supercoole Funktion im Robots.txt-Editor von AIOSEO ist der Abschnitt Block AI Crawlers. Dieser ermöglicht es Ihnen, unbefugte Bots am Crawlen Ihrer Website zu hindern. Diese können zu Leistungsproblemen, Sicherheitsproblemen und SEO-Problemen führen.

Weitere Informationen hierzu finden Sie in unserem Tutorial zum Blockieren unerwünschten Bot-Traffics auf Ihrer Website.

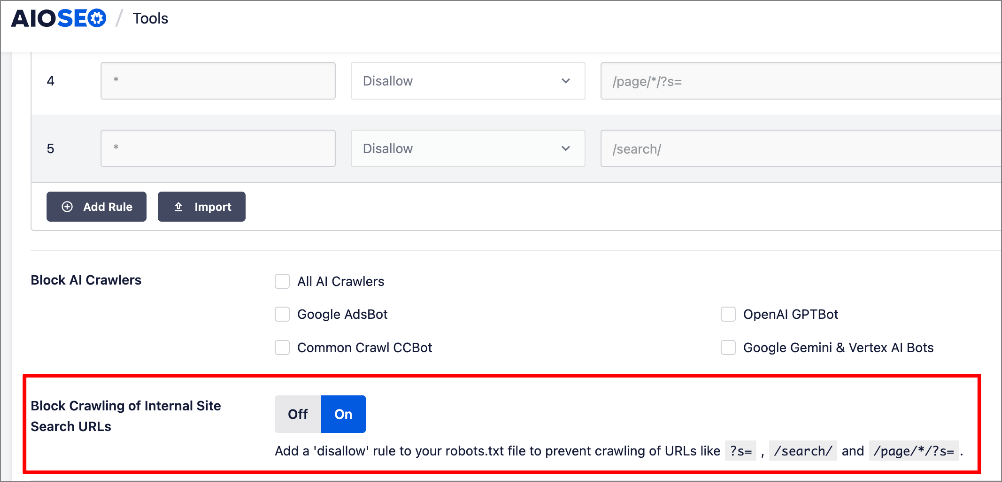

Schritt 6: Verhindern Sie das Crawling von internen Websuche-URLs (optional)

Websites produzieren häufig überflüssige URLs, wenn Besucher interne Suchfunktionen nutzen, um Inhalte oder Produkte zu finden. Diese dynamisch generierten URLs enthalten typischerweise Parameter, die Suchmaschinen als eindeutige Seiten behandeln. Infolgedessen verschwenden Suchmaschinen möglicherweise Zeit mit dem Crawlen dieser unnötigen URLs, was Ihr Crawl-Budget aufbrauchen und potenziell die Indizierung Ihrer wichtigsten Seiten behindern kann.

Sie können dies im Robots.txt-Editor von AIOSEO einfach verhindern.

AIOSEO fügt eine „disallow“-Regel in Ihre robots.txt-Datei ein, ohne dass Sie dies für jeden suchgenerierten Parameter tun müssen.

Weitere Informationen finden Sie in unserem Tutorial zum Bearbeiten Ihrer robots.txt-Datei.

Schritt 7: Testen Sie Ihre Robots.txt-Datei

Sobald Sie Ihre robots.txt-Datei generiert haben, können Sie sie auf Fehler überprüfen. Dies ist jedoch sehr selten, wenn Sie den Robots.txt-Editor von AIOSEO verwenden, da dieser über eine integrierte Regelvalidierung und Fehlerbehandlung verfügt.

Wenn Sie jedoch überprüfen möchten, ob Ihre robots.txt-Datei keine Fehler enthält, können Sie das Robots.txt-Testtool der Google Search Console verwenden. Geben Sie einfach Ihre Property ein, und das Tool zieht automatisch Ihre robots.txt-Datei und hebt alle Fehler hervor.

So generieren Sie eine Robots.txt-Datei in WordPress: Ihre FAQs beantwortet

Was ist der Zweck einer robots.txt-Datei?

Eine robots.txt-Datei gibt Suchmaschinen-Crawlern Anweisungen, welche Teile Ihrer Website sie aufrufen und indizieren dürfen. Sie hilft dabei, die Interaktion von Suchmaschinen mit den Inhalten Ihrer Website zu steuern.

Wie kann ich robots.txt in WordPress generieren?

Sie können eine robots.txt-Datei in WordPress ganz einfach mit einem Plugin wie All In One SEO (AIOSEO) generieren. Sie benötigen dafür keine Programmier- oder technischen Kenntnisse.

Kann ich manuell eine robots.txt-Datei für meine WordPress-Website erstellen?

Ja, Sie können eine robots.txt-Datei manuell mit einem Texteditor erstellen und sie im Stammverzeichnis Ihrer Website platzieren. Dies dauert länger als die Verwendung eines Plugins wie AIOSEO und erfordert fortgeschrittene WordPress-Kenntnisse.

Wir hoffen, dieser Beitrag hat Ihnen geholfen zu verstehen, was robots.txt in WordPress ist und warum es wichtig ist, Ihre zu optimieren. Möglicherweise möchten Sie auch andere Artikel in unserem Blog lesen, wie z. B. unseren Leitfaden zu Crawling und Indexierung und dessen Auswirkungen auf SEO oder unsere Tipps zur Verbesserung Ihrer Indexierung bei Google.

Wenn Sie diesen Artikel hilfreich fanden, abonnieren Sie bitte unseren YouTube-Kanal. Dort finden Sie viele weitere hilfreiche Tutorials. Sie können uns auch auf Twitter, LinkedIn oder Facebook folgen, um auf dem Laufenden zu bleiben.

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.