Möchten Sie alles über WordPress robots.txt-Dateien erfahren?

Robots.txt-Dateien helfen Ihnen zu steuern, wie Such-Bots mit Ihrer Website interagieren. Dies macht sie zu einem sehr nützlichen SEO-Tool für diejenigen, die wissen, wie man sie benutzt.

In diesem Artikel zeigen wir Ihnen alles, was Sie über WordPress robots.txt-Dateien wissen müssen.

In diesem Artikel

- Was sind WordPress Robots.txt-Dateien

- 6 Reasons You Need a WordPress Robots.txt File

- How to Generate a WordPress Robots.txt File

- Tips for Optimizing WordPress Robots.txt Files

- So testen Sie Ihre WordPress Robots.txt-Dateien

- WordPress Robots.txt Files: Your FAQs Answered

- Nutzen Sie die Macht Ihrer WordPress Robots.txt-Datei klug

Was sind WordPress Robots.txt-Dateien

WordPress robots.txt-Dateien sind einfache Textdateien, die Website-Besitzer erstellen, um Suchmaschinen-Bots anzuweisen, wie sie mit ihren Websites interagieren sollen, hauptsächlich welche Seiten gecrawlt und welche ignoriert werden sollen. Die Datei wird im Stammverzeichnis einer Website gespeichert, auch bekannt als Hauptordner.

Im Wesentlichen fungiert eine WordPress robots.txt-Datei als Torwächter Ihrer Website.

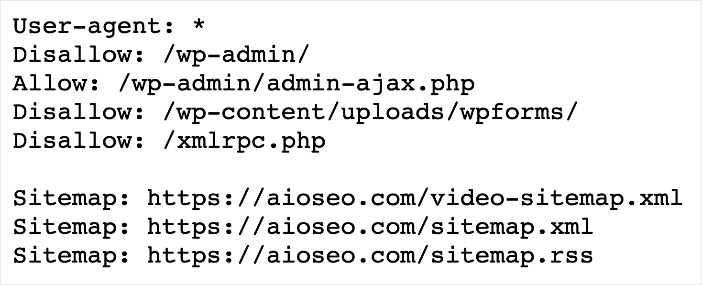

So sieht sie aus:

Sie können auf Ihre robots.txt-Datei zugreifen, indem Sie https://ihredomain.com/robots.txt besuchen.

Dies sollte nicht mit Robots-Meta-Tags verwechselt werden, die HTML-Tags sind, die in den Kopf einer Webseite eingebettet sind. Der Tag gilt nur für die Seite, auf der er sich befindet.

6 Gründe, warum Sie eine WordPress Robots.txt-Datei benötigen

Nachdem Sie nun wissen, was eine WordPress robots.txt-Datei ist, werfen wir einen kurzen Blick darauf, warum Sie eine benötigen.

1. Suchmaschinen-Crawling steuern

Der Hauptzweck einer WordPress robots.txt-Datei ist die Steuerung, welche Teile Ihrer Website Suchmaschinen (und andere Bots) crawlen dürfen und welche nicht. Dies ist entscheidend, um sicherzustellen, dass Suchmaschinen sich auf die Entdeckung der Inhalte konzentrieren, die Sie auf Suchmaschinenergebnisseiten (SERPs) anzeigen möchten, während sensible oder irrelevante Seiten vermieden werden.

2. Indexierung verbessern

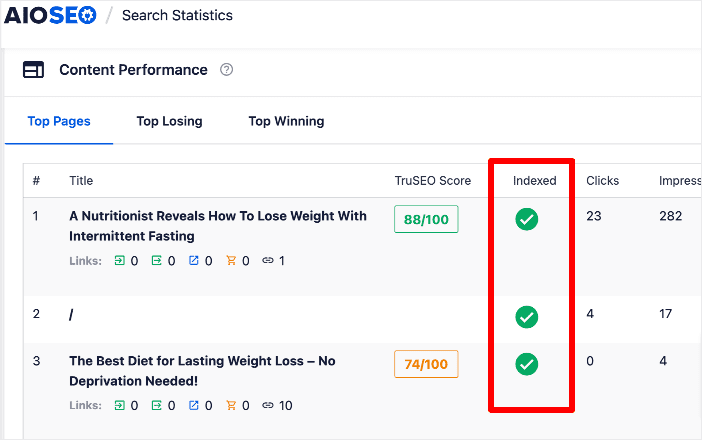

Ein weiterer Grund für die Optimierung Ihrer robots.txt-Datei ist, dass sie hilft, die Indexierung Ihrer Website zu verbessern. Sie können Ihre robots.txt-Datei so konfigurieren, dass das Crawling und die Indexierung wichtiger Seiten priorisiert werden. Infolgedessen wird sichergestellt, dass die Seiten, die für Ihr Unternehmen am wichtigsten sind, eine bessere Chance haben, zu ranken.

Sie können AIOSEO einfach verwenden, um den Indexstatus Ihrer Beiträge und Seiten zu überprüfen.

Dies hilft Ihnen, den Indexstatus Ihrer Seiten leicht im Auge zu behalten.

3. Doppelte Inhalte vermeiden

Doppelte Inhalte beziehen sich auf Seiten oder Beiträge mit exakten oder ähnlichen Inhalten. Dies kann sich negativ auf Ihre SEO auswirken, wenn es nicht richtig gehandhabt wird.

Eine robots.txt-Datei kann verwendet werden, um zu verhindern, dass Suchmaschinen mehrere Versionen desselben Inhalts indexieren. Dies trägt dazu bei, dass die Seite, die Sie ranken möchten, von Suchmaschinen gecrawlt und indexiert wird.

4. Bandbreiten-Schonung

Suchmaschinen-Crawler verbrauchen Serverressourcen und Bandbreite beim Crawlen Ihrer Website. Die Angabe, welche Seiten oder Verzeichnisse gecrawlt werden sollen, kann helfen, Serverressourcen zu schonen und die Leistung Ihrer Website zu verbessern.

Es kann auch verwendet werden, um das Crawl-Budget zu optimieren, da es Ihnen helfen kann, die Seiten und Beiträge zu priorisieren, die gecrawlt werden sollen.

5. Datenschutz

Wenn Sie Teile Ihrer Website haben, die sensible oder vertrauliche Daten enthalten, können Sie verhindern, dass Suchmaschinen diese crawlen und indexieren. Alles, was Sie tun müssen, ist den Zugriff auf diese Bereiche in Ihrer robots.txt zu blockieren, um so Ihre Privatsphäre und Sicherheit zu schützen.

6. Benutzererfahrung verbessern

Durch die Kontrolle, welche Seiten von Suchmaschinen gecrawlt und indexiert werden können, können Sie sicherstellen, dass Benutzer zu den relevantesten und aktuellsten Inhalten Ihrer Website geleitet werden. Dies trägt dazu bei, ihre Gesamterfahrung zu verbessern.

Wie Sie sehen können, ist eine WordPress robots.txt-Datei für die Website-Verwaltung von grundlegender Bedeutung. Richtig konfiguriert, kann sie die Leistung Ihrer Website und ihre Sichtbarkeit in den Suchmaschinenergebnissen erheblich beeinflussen.

So erstellen Sie eine WordPress Robots.txt-Datei

Das Erstellen einer WordPress robots.txt-Datei ist ziemlich einfach. Hier sind die Schritte dazu – es ist kein Code erforderlich.

Schritt 1: AIOSEO installieren

Der erste Schritt zur Generierung benutzerdefinierter robots.txt-Dateien ist die Installation und Aktivierung von All In One SEO (AIOSEO).

AIOSEO ist ein leistungsstarkes und dennoch einfach zu bedienendes SEO-Plugin mit über 3 Millionen aktiven Installationen. Millionen von klugen Bloggern nutzen AIOSEO, um ihr Suchmaschinenranking zu verbessern und qualifizierten Traffic auf ihre Blogs zu lenken. Das liegt daran, dass das Plugin viele leistungsstarke Funktionen und Module bietet, die Ihnen helfen, Ihre SEO-Einstellungen richtig zu konfigurieren. Beispiele hierfür sind:

- Suchstatistiken: Diese leistungsstarke Google Search Console-Integration ermöglicht es Ihnen, Ihre Keyword-Rankings zu verfolgen und wichtige SEO-Metriken mit einem Klick zu sehen und mehr.

- Next-Gen Schema-Generator: Dieser No-Code-Schema-Generator ermöglicht es Benutzern, beliebige Schema-Markup auf Ihrer Website zu generieren und auszugeben.

- Weiterleitungs-Manager: Hilft Ihnen, Weiterleitungen zu verwalten und 404-Fehler zu beheben, sodass Suchmaschinen Ihre Website leichter crawlen und indexieren können.

- Link Assistant: Leistungsstarkes Tool für interne Verlinkungen, das den Aufbau von Links zwischen Seiten Ihrer Website automatisiert. Es gibt Ihnen auch eine Überprüfung der ausgehenden Links.

- SEO-Vorschau: Dies gibt Ihnen einen Überblick über Ihre Such- und Social-Snippets und allgemeine SEO, damit Sie Ihre Optimierung verbessern können.

- IndexNow: Für schnelle Indexierung auf Suchmaschinen, die das IndexNow-Protokoll unterstützen (wie Bing und Yandex).

- Sitemap-Generator: Generiert automatisch verschiedene Arten von Sitemaps, um alle Suchmaschinen über Aktualisierungen auf Ihrer Website zu informieren.

- Und mehr.

Für eine Schritt-für-Schritt-Anleitung zur Installation von AIOSEO lesen Sie unsere Installationsanleitung.

Eine der beliebtesten Funktionen ist der erweiterte Robots.txt-Editor. Dieses leistungsstarke Tool erleichtert die Konfiguration und Anpassung Ihrer WordPress robots.txt-Datei.

Hinweis: WordPress generiert automatisch eine robots.txt-Datei für jede Website. Sie ist jedoch nicht ohne Weiteres anpassbar. Dafür benötigen Sie ein Plugin. Hier kommen Tools wie AIOSEO ins Spiel.

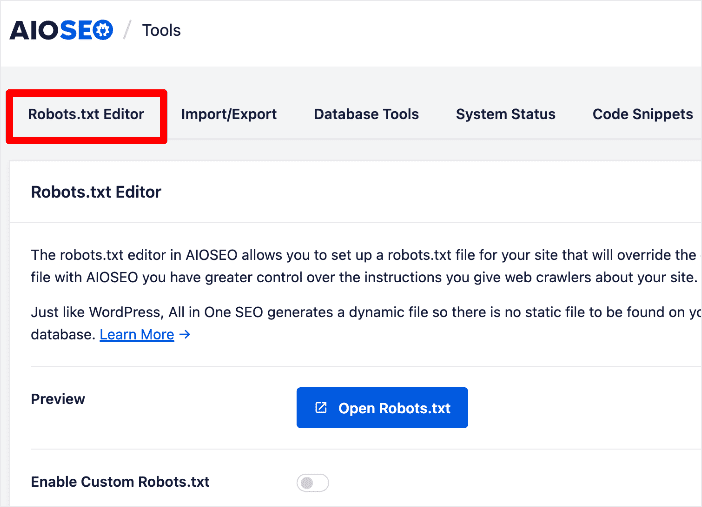

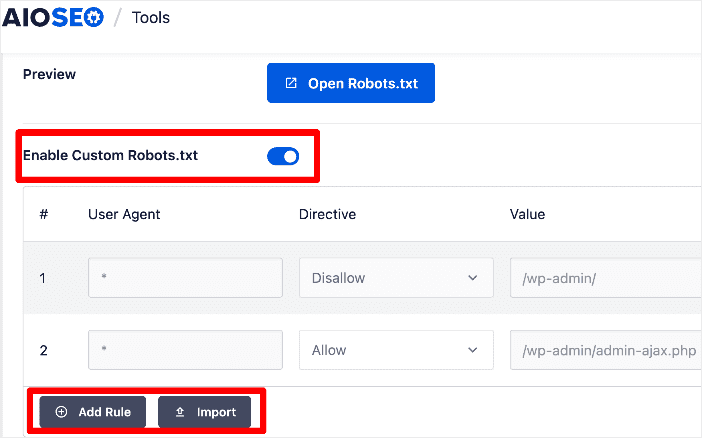

Schritt 2: Öffnen Sie den Editor Ihrer WordPress Robots.txt-Datei

Nachdem Sie AIOSEO aktiviert haben, besteht der nächste Schritt darin, Ihre WordPress robots.txt-Datei im Editor-Modus zu öffnen. Gehen Sie dazu zu Ihrem AIOSEO-Menü und klicken Sie auf Tools » Robots.txt Editor.

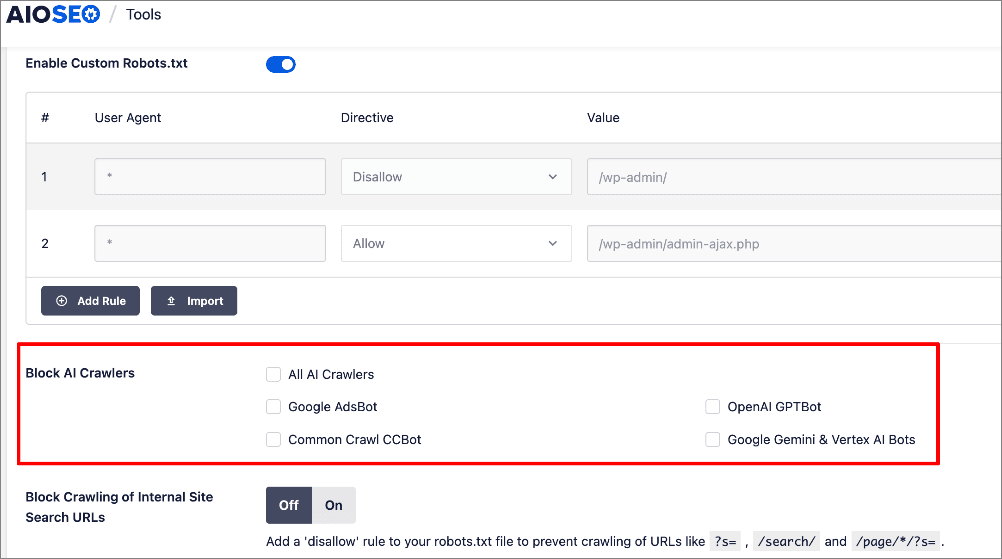

Klicken Sie anschließend auf den Schalter Benutzerdefinierte Robots.txt aktivieren, um die Bearbeitung Ihrer robots.txt-Datei zu ermöglichen.

Sehen Sie sich unsere Liste der besten Robots.txt-Generatoren für weitere Optionen an.

Schritt 3: Konfigurieren Sie Ihre Robots.txt-Anweisungen

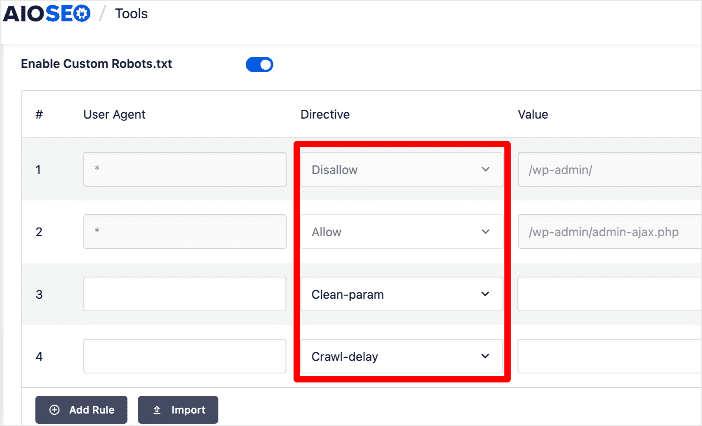

Nachdem Sie die Bearbeitung Ihrer robots.txt-Dateien aktiviert haben, besteht der nächste Schritt darin, benutzerdefinierte Direktiven in Ihrer robots.txt-Datei zu konfigurieren. Sie können auch festlegen, welche User Agents (Bots) diese Direktiven befolgen sollen.

Direktiven sind die Anweisungen, die Suchbots befolgen sollen. Beispiele für Direktiven, die Sie im Robots.txt-Editor von AIOSEO finden, sind Allow, Disallow, Clean-param und Crawl delay.

Hier ist die Bedeutung jeder Direktive:

- Allow: Erlaubt User Agents (Bots), die URL zu crawlen.

- Disallow: Verbietet User Agents (Bots), die URL zu crawlen.

- Clean-param: Weist Suchbots an, alle URLs mit den angegebenen URL-Parametern zu ignorieren.

- Crawl-delay: Legt die Intervalle fest, in denen Suchbots die URL crawlen sollen.

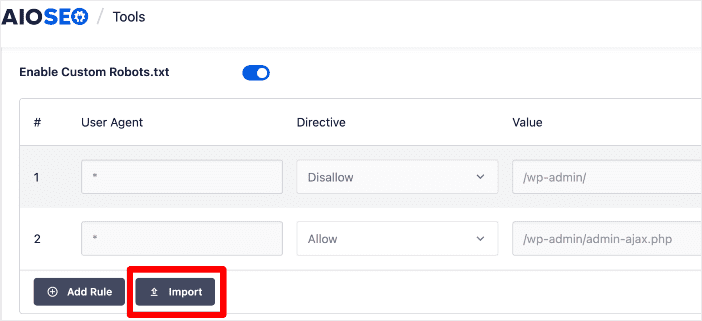

Neben dem manuellen Hinzufügen Ihrer Direktiven können Sie eine vorkonfigurierte robots.txt-Datei von einer anderen Website mit der Funktion Importieren importieren.

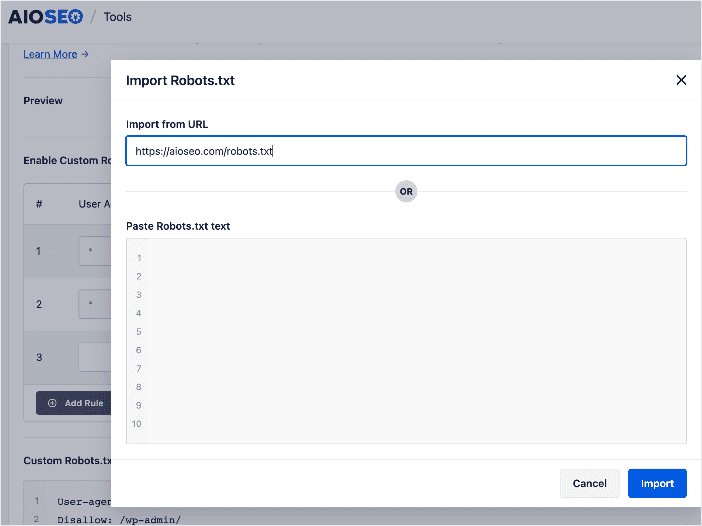

Wenn Sie auf die Schaltfläche Importieren klicken, öffnet sich ein Fenster mit 2 Optionen zum Importieren Ihrer ausgewählten robots.txt-Datei: Aus URL importieren und Robots.txt-Text einfügen.

Diese Methode ist am besten geeignet, wenn die Website, von der Sie die robots.txt-Datei importieren, Direktiven enthält, die Sie auf Ihrer Website implementieren möchten.

4. Unerwünschte Bots blockieren

Eine weitere supercoole Funktion im Robots.txt-Editor von AIOSEO ist der Abschnitt Block AI Crawlers. Dieser ermöglicht es Ihnen, unbefugte Bots am Crawlen Ihrer Website zu hindern. Diese können zu Leistungsproblemen, Sicherheitsproblemen und SEO-Problemen führen.

Weitere Informationen hierzu finden Sie in unserem Tutorial zum Blockieren unerwünschten Bot-Traffics auf Ihrer Website.

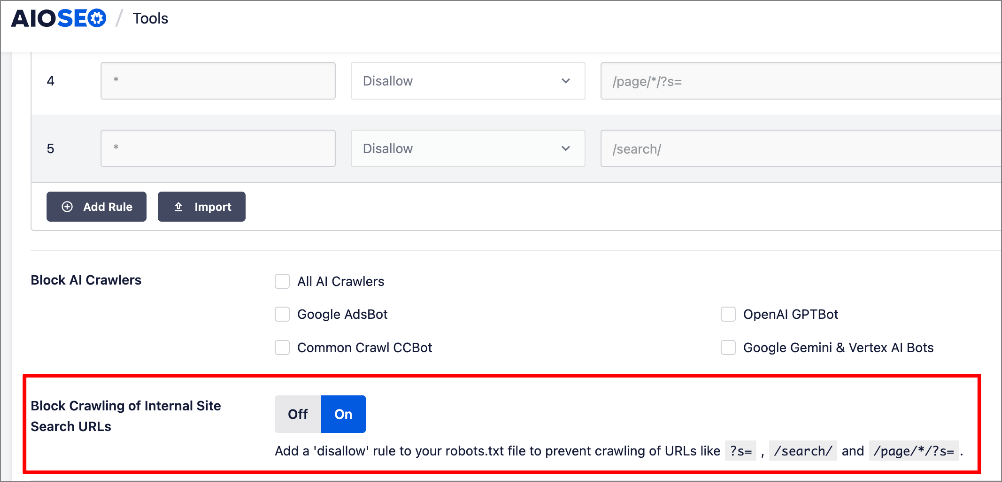

5. Crawling von internen Such-URLs der Website verhindern

Websites generieren oft überflüssige URLs aus internen Suchen, wenn Besucher nach Inhalten oder Produkten suchen. Diese suchgenerierten URLs enthalten Parameter, die Suchmaschinen als eindeutig wahrnehmen, wodurch unnötige Seiten gecrawlt werden. Dies verschwendet Ihr Crawl-Budget und kann verhindern, dass Ihre wichtigsten Seiten indexiert werden.

Sie können dies im Robots.txt-Editor von AIOSEO einfach verhindern.

AIOSEO fügt eine „disallow“-Regel in Ihre robots.txt-Datei ein, ohne dass Sie dies für jeden suchgenerierten Parameter tun müssen.

Weitere Informationen finden Sie in unserem Tutorial zum Bearbeiten Ihrer robots.txt-Datei.

Tipps zur Optimierung von WordPress Robots.txt-Dateien

Fügen Sie Ihre Sitemap-URL hinzu

Das Hinzufügen eines Links zu Ihrer Sitemap ist unerlässlich, damit Such-Bots Ihre wichtigen Seiten crawlen und indexieren können. Auch wenn Sie sie aus Ihrer robots.txt-Datei weglassen, schadet das Ihrer SEO nicht, hat aber zweifellos eine positive Auswirkung. Glücklicherweise fügt AIOSEO automatisch Ihre Sitemap-URL hinzu, wenn es eine robots.txt-Datei generiert, sodass keine zusätzliche Anpassung erforderlich ist.

Wildcards verstehen und klug einsetzen

Ein Platzhalter ist ein Zeichen, das ein oder mehrere Zeichen darstellen kann. Der gebräuchlichste Platzhalter ist das Sternchen (*).

Wenn Sie viele Seiten haben, die Sie blockieren möchten, kann es zeitaufwendig sein, für jede einzelne eine Regel hinzuzufügen. Glücklicherweise können Sie Platzhalter verwenden, um Ihre Anweisungen zu vereinfachen.

Platzhalter sind Sonderzeichen, mit denen Sie musterbasierte Regeln in Ihren WordPress robots.txt-Dateien erstellen können. Sie bieten eine Möglichkeit, Direktiven auf eine Gruppe von URLs anzuwenden, die ein gemeinsames Muster aufweisen, anstatt jede URL einzeln anzugeben. Es gibt zwei Haupttypen von Platzhaltern, die in robots.txt verwendet werden:

- Sternchen (*) Platzhalter: Dieser steht für eine beliebige Zeichenfolge und wird verwendet, um URLs abzugleichen, die einem bestimmten Muster entsprechen. Zum Beispiel bedeutet User-agent: *, dass alle User-Agents die vorgeschriebene Direktive befolgen müssen.

- Dollarzeichen ($) Platzhalter: Dieser wird verwendet, um das Ende einer URL abzugleichen. Angenommen, Sie möchten den Zugriff auf alle URLs blockieren, die auf „.pdf“ enden. Sie können das Dollarzeichen in einer Direktive wie dieser verwenden: Disallow: /*.pdf$.

Platzhalter sollten jedoch mit Vorsicht verwendet werden, da ihre falsche Anwendung unbeabsichtigt den Zugriff auf mehrere Seiten oder Verzeichnisse blockieren oder zulassen kann.

Kommentare zur besseren Übersichtlichkeit verwenden

Fügen Sie Kommentare in Ihre robots.txt-Datei ein, um Ihre Direktiven zu erklären. Dies hilft Ihnen und anderen, den Zweck jeder Regel zu verstehen. Um einen Kommentar hinzuzufügen, setzen Sie ein Hashtag (#) an den Anfang des Kommentars. Such-Bots ignorieren alles nach dem #.

So testen Sie Ihre WordPress Robots.txt-Dateien

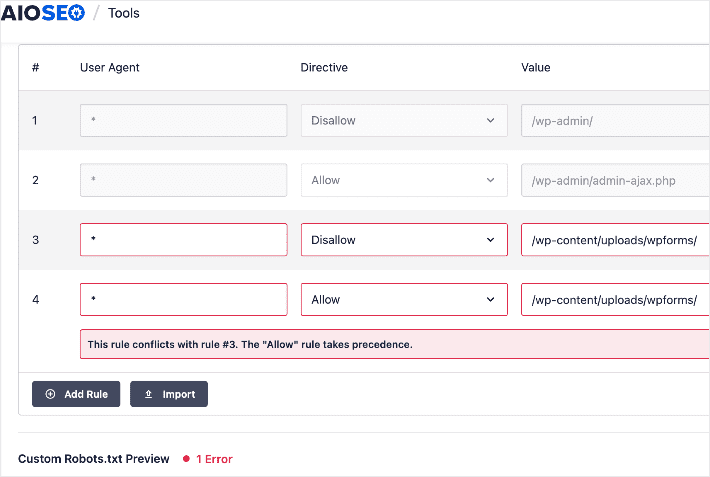

Sobald Sie Ihre WordPress robots.txt-Datei generiert und konfiguriert haben, können Sie sie auf Fehler testen. Sie können Tools wie das robots.txt-Testtool von Google Search Console verwenden.

Sie benötigen diese jedoch nicht, wenn Sie den robots.txt-Editor von AIOSEO verwenden, da dieser über eine integrierte Regelvalidierung und Fehlerbehandlung verfügt.

WordPress Robots.txt-Dateien: Ihre FAQs beantwortet

Was ist eine robots.txt-Datei in WordPress?

Eine robots.txt-Datei ist eine einfache Textdatei, die im Stammverzeichnis einer WordPress-Website platziert wird. Sie weist Suchmaschinen-Crawler an, welche Teile der Website gecrawlt und indexiert werden sollen und welche Teile ausgeschlossen werden sollen.

Wie kann ich robots.txt in WordPress generieren?

Sie können eine robots.txt-Datei in WordPress ganz einfach mit einem Plugin wie All In One SEO (AIOSEO) generieren. Sie benötigen dafür keine Programmier- oder technischen Kenntnisse.

Kann ich robots.txt zur Verbesserung der SEO verwenden?

Ja, die Optimierung Ihrer robots.txt-Datei kann zu einer besseren SEO beitragen. Sie können die Sichtbarkeit und das Ranking Ihrer Website in den Suchergebnissen verbessern, indem Sie Suchmaschinen-Bots anweisen, Ihre wertvollsten Inhalte zu crawlen und zu indexieren, während Sie doppelte oder irrelevante Inhalte ausschließen.

Nutzen Sie die Macht Ihrer WordPress Robots.txt-Datei klug

Ihre WordPress robots.txt-Datei ist ein leistungsstarkes Werkzeug, das Ihnen helfen kann, Ihre Crawlbarkeit, Indexierung und Rankings auf SERPs zu verbessern.

Wir hoffen, dieser Beitrag hat Ihnen geholfen, umfassende Kenntnisse über WordPress robots.txt-Dateien zu erlangen und warum es wichtig ist, Ihre zu optimieren. Möglicherweise möchten Sie auch andere Artikel auf unserem Blog lesen, wie z. B. unseren Leitfaden zur Erstellung von scannbarem Inhalt oder unser Tutorial zur Verwendung eines SEO-Titelgenerators zur Steigerung Ihrer Rankings und CTR.

Wenn Sie diesen Artikel hilfreich fanden, abonnieren Sie bitte unseren YouTube-Kanal. Dort finden Sie viele weitere hilfreiche Tutorials. Sie können uns auch auf X (Twitter), LinkedIn oder Facebook folgen, um auf dem Laufenden zu bleiben.

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.