¿Te gustaría saber todo lo que hay que saber sobre los archivos robots.txt de WordPress?

Los archivos robots.txt te ayudan a controlar cómo interactúan los bots de búsqueda con tu sitio. Esto lo convierte en una herramienta SEO muy útil para quienes saben cómo usarla.

En este artículo, te mostraremos todo lo que necesitas saber sobre los archivos robots.txt de WordPress.

En este artículo

- Qué son los archivos Robots.txt de WordPress

- 6 Reasons You Need a WordPress Robots.txt File

- How to Generate a WordPress Robots.txt File

- Tips for Optimizing WordPress Robots.txt Files

- Cómo probar tus archivos robots.txt de WordPress

- WordPress Robots.txt Files: Your FAQs Answered

- Maneja sabiamente el poder de tu archivo robots.txt de WordPress

Qué son los archivos Robots.txt de WordPress

Los archivos robots.txt de WordPress son archivos de texto plano que los propietarios de sitios web crean para indicar a los bots de los motores de búsqueda cómo interactuar con sus sitios, principalmente qué páginas rastrear y cuáles ignorar. El archivo se almacena en el directorio raíz de un sitio web, también conocido como la carpeta principal.

En esencia, un archivo robots.txt de WordPress actúa como el guardián de tu sitio.

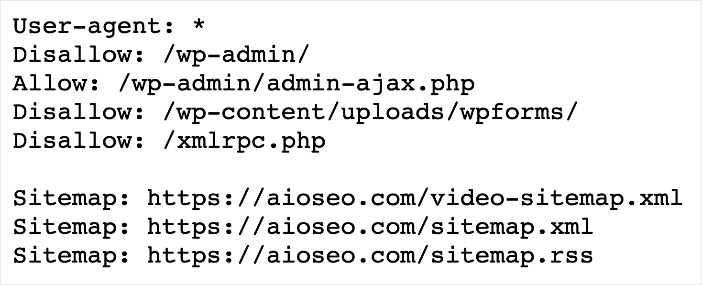

Así es como se ve:

Puedes acceder a tu archivo robots.txt visitando https://tusitio.com/robots.txt.

Esto no debe confundirse con las etiquetas meta robots, que son etiquetas HTML incrustadas en el encabezado de una página web. La etiqueta solo se aplica a la página en la que se encuentra.

6 razones por las que necesitas un archivo robots.txt de WordPress

Ahora que sabes qué es un archivo robots.txt de WordPress, veamos brevemente por qué necesitas uno.

1. Controlar el rastreo de los motores de búsqueda

El propósito principal de un archivo robots.txt de WordPress es controlar qué partes de tu sitio web pueden y no pueden rastrear los motores de búsqueda (y otros bots). Esto es crucial para garantizar que los motores de búsqueda se centren en descubrir el contenido que deseas que aparezca en las páginas de resultados de los motores de búsqueda (SERP) mientras evitan páginas sensibles o irrelevantes.

2. Mejorar la indexación

Otra razón por la que deberías optimizar tu archivo robots.txt es que ayuda a mejorar la indexación de tu sitio. Puedes configurar tu archivo robots.txt para priorizar el rastreo e indexación de páginas importantes. Como resultado, te aseguras de que las páginas que más importan para tu negocio tengan una mejor oportunidad de clasificar.

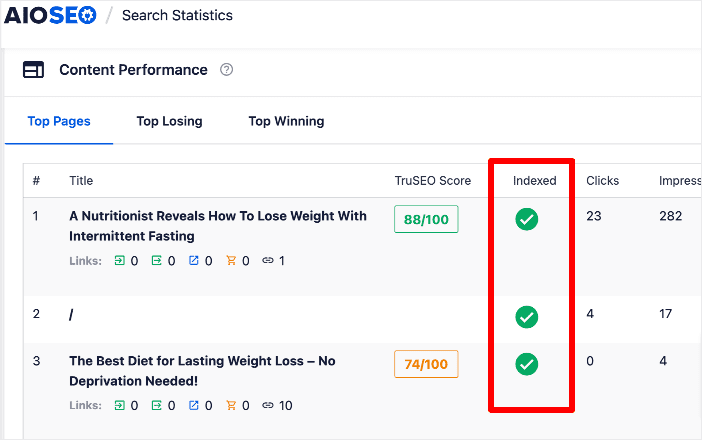

Puedes usar fácilmente AIOSEO para comprobar el estado de indexación de tus publicaciones y páginas.

Esto te ayudará a mantener un registro fácil del estado de indexación de tus páginas.

3. Evitar contenido duplicado

El contenido duplicado se refiere a páginas o publicaciones con contenido idéntico o similar. Esto puede afectar negativamente tu SEO si no se maneja correctamente.

Un archivo robots.txt se puede usar para evitar que los motores de búsqueda indexen varias versiones del mismo contenido. Hacerlo ayudará a garantizar que la página que deseas posicionar sea rastreada e indexada por los motores de búsqueda.

4. Conservación de ancho de banda

Los rastreadores de los motores de búsqueda consumen recursos del servidor y ancho de banda al rastrear tu sitio. Especificar qué páginas o directorios deben rastrearse puede ayudar a conservar los recursos del servidor y mejorar el rendimiento de tu sitio.

También se puede utilizar para optimizar el presupuesto de rastreo, ya que puede ayudarte a priorizar las páginas y publicaciones que se rastrearán.

5. Protección de la privacidad

Si tienes partes de tu sitio web que contienen información sensible o datos confidenciales, puedes evitar que los motores de búsqueda las rastreen e indexen. Todo lo que tienes que hacer es bloquear el acceso a esas áreas en tu robots.txt, ayudando así a proteger tu privacidad y seguridad.

6. Mejorar la experiencia del usuario

Al controlar qué páginas pueden ser rastreadas e indexadas por los motores de búsqueda, puedes asegurarte de que los usuarios sean dirigidos al contenido más relevante y actualizado de tu sitio. Esto ayuda a mejorar su experiencia general.

Como puedes ver, un archivo robots.txt de WordPress es fundamental para la gestión de sitios web. Configurado correctamente, puede tener un impacto significativo en el rendimiento de tu sitio y su visibilidad en los resultados de los motores de búsqueda.

Cómo generar un archivo robots.txt de WordPress

Generar un archivo robots.txt de WordPress es bastante fácil. Aquí tienes los pasos para hacerlo, no se requiere código.

Paso 1: Instalar AIOSEO

El primer paso para generar archivos robots.txt personalizados es instalar y activar All In One SEO (AIOSEO).

AIOSEO es un plugin de SEO potente pero fácil de usar que cuenta con más de 3 millones de instalaciones activas. Millones de bloggers inteligentes utilizan AIOSEO para mejorar sus rankings en los motores de búsqueda y atraer tráfico cualificado a sus blogs. Esto se debe a que el plugin tiene muchas funciones y módulos potentes diseñados para ayudarte a configurar correctamente tus ajustes de SEO. Los ejemplos incluyen:

- Estadísticas de búsqueda: Esta potente integración de Google Search Console te permite rastrear tus rankings de palabras clave y ver métricas SEO importantes con 1 clic, y más.

- Generador de Schema de próxima generación: Este generador de schema sin código permite a los usuarios generar y mostrar cualquier marcado de schema en tu sitio.

- Gestor de Redirecciones: Te ayuda a gestionar redirecciones y a eliminar errores 404, facilitando que los motores de búsqueda rastreen e indexen tu sitio.

- Asistente de Enlaces: Potente herramienta de enlaces internos que automatiza la creación de enlaces entre las páginas de tu sitio. También te proporciona una auditoría de enlaces salientes.

- Vista Previa de SEO: Esto te da una visión general de tus fragmentos de búsqueda y sociales y del SEO general para que puedas mejorar tu optimización.

- IndexNow: Para una indexación rápida en motores de búsqueda que admiten el protocolo IndexNow (como Bing y Yandex).

- Generador de sitemaps: Genera automáticamente diferentes tipos de sitemaps para notificar a todos los motores de búsqueda sobre cualquier actualización en tu sitio.

- Y más.

Para obtener instrucciones paso a paso sobre c ilde{}^{a}mo instalar AIOSEO, consulta nuestra gu ilde{}^{a}a de instalaci ilde{}^{a}n.

Una de las funciones más apreciadas es el editor avanzado de robots.txt. Esta potente herramienta facilita la configuración y personalización de tu archivo robots.txt de WordPress.

Nota: WordPress autogenera un archivo robots.txt para cada sitio. Sin embargo, no es personalizable de fábrica. Para eso, necesitarás un plugin. Aquí es donde entran herramientas como AIOSEO.

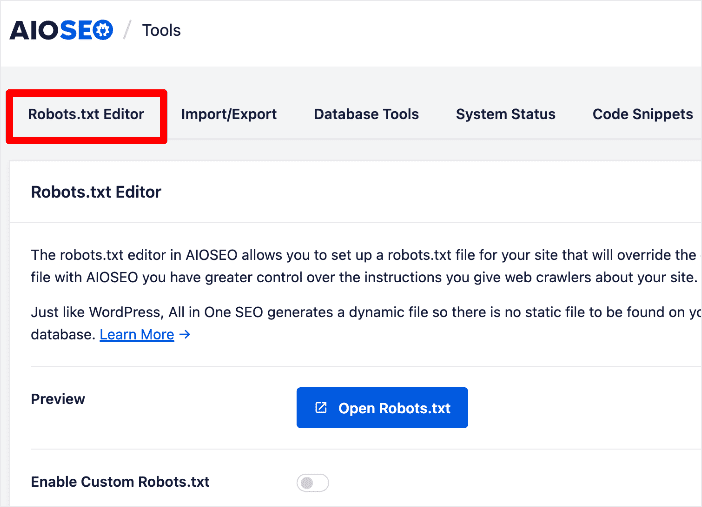

Paso 2: Abre el editor de tu archivo robots.txt de WordPress

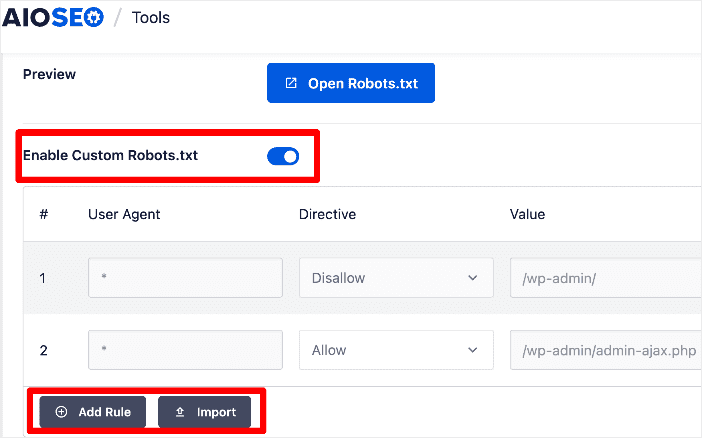

Una vez que hayas activado AIOSEO, el siguiente paso es abrir tu archivo robots.txt de WordPress en modo editor. Para hacerlo, ve a tu menú de AIOSEO y haz clic en Herramientas » Editor de Robots.txt.

A continuación, haz clic en el interruptor Habilitar Robots.txt Personalizado para permitir la edición de tu archivo robots.txt.

Consulta nuestra lista de los mejores generadores de robots.txt para más opciones.

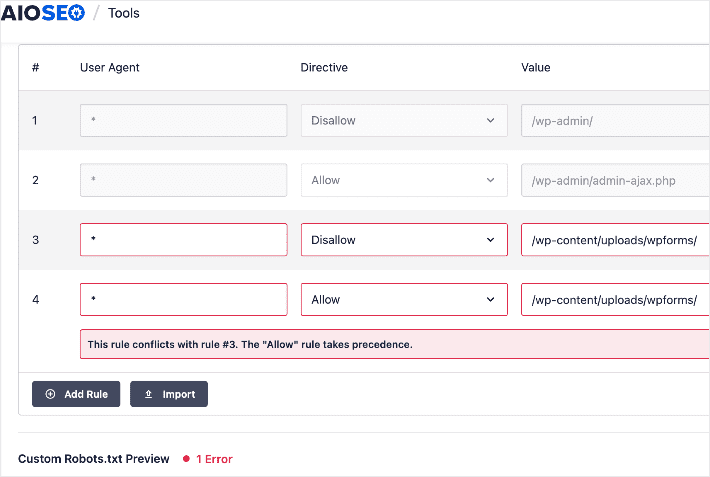

Paso 3: Configura las directivas de tu robots.txt

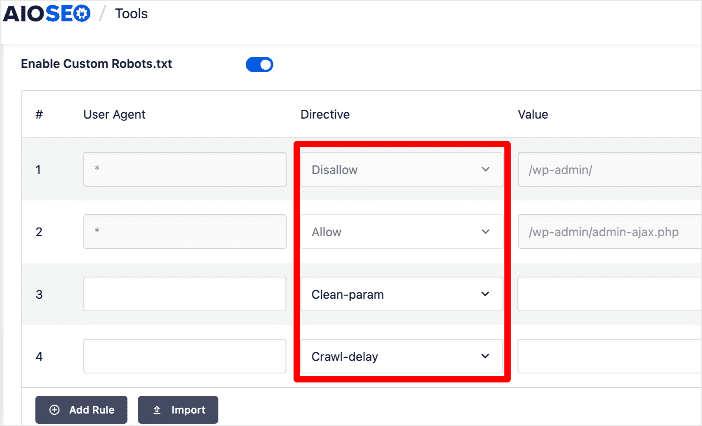

Una vez que hayas habilitado la edición de tus archivos robots.txt, el siguiente paso es configurar directivas personalizadas en tu archivo robots.txt. También puedes establecer qué agentes de usuario (bots) deben seguir dichas directivas.

Las directivas son las instrucciones que quieres que sigan los bots de búsqueda. Ejemplos de directivas que encontrarás en el editor robots.txt de AIOSEO incluyen Allow, Disallow, Clean-param y Crawl delay.

Aquí tienes lo que significa cada directiva:

- Allow: Permite a los agentes de usuario (bots) rastrear la URL.

- Disallow: Prohíbe a los agentes de usuario (bots) rastrear la URL.

- Clean-param: Indica a los bots de búsqueda que ignoren todas las URL con los parámetros de URL especificados.

- Crawl-delay: Establece los intervalos para que los bots de búsqueda rastreen la URL.

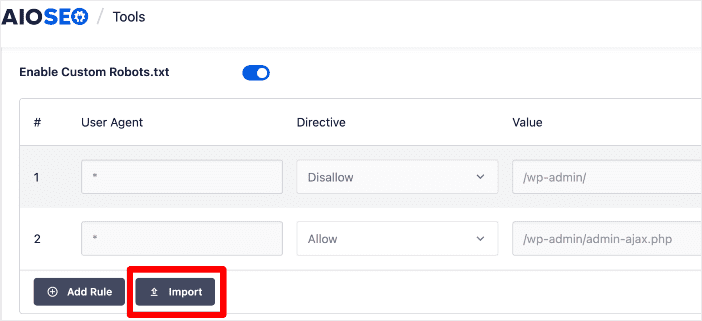

Además de añadir manualmente tus directivas, puedes importar un archivo robots.txt preconfigurado de otro sitio utilizando la función Importar.

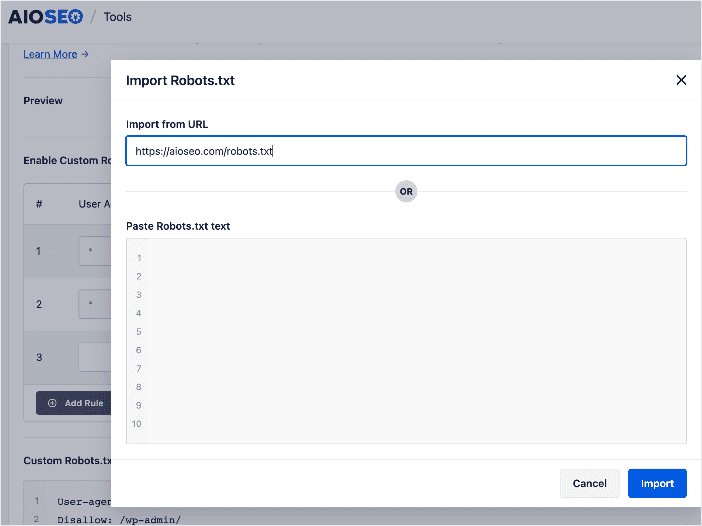

Al hacer clic en el botón Importar, se abrirá una ventana con 2 opciones para importar el archivo robots.txt elegido: Importar desde URL y Pegar texto de Robots.txt.

Este método es el mejor si el sitio desde el que importas el archivo robots.txt tiene directivas que te gustaría implementar en tu sitio.

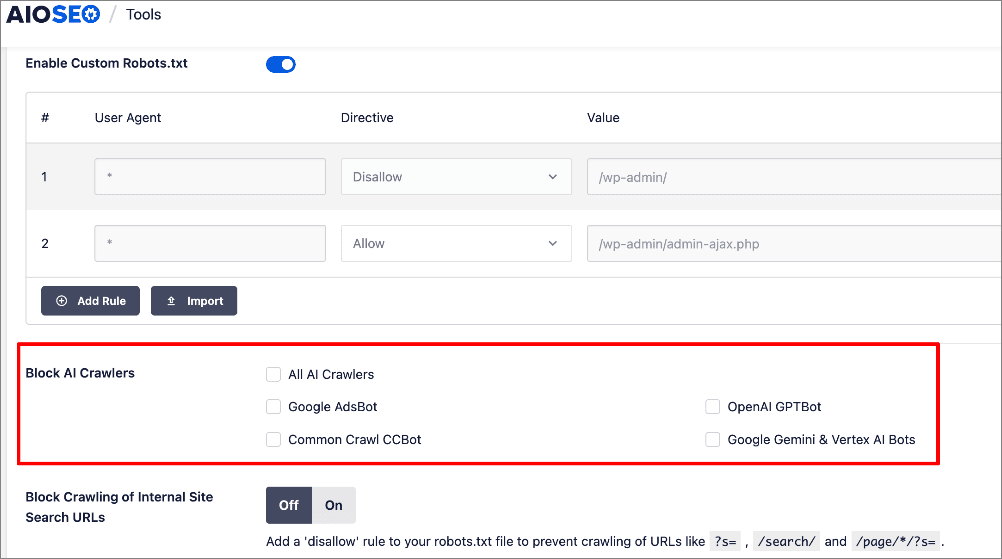

4. Bloquear bots no deseados

Otra característica genial de AIOSEO's Robots.txt Editor es la sección Bloquear rastreadores de IA. Esto te permite bloquear bots no autorizados de rastrear tu sitio. Estos pueden causar problemas de rendimiento, seguridad y SEO.

Para más información, consulta nuestro tutorial sobre cómo bloquear el tráfico no deseado de bots en tu sitio.

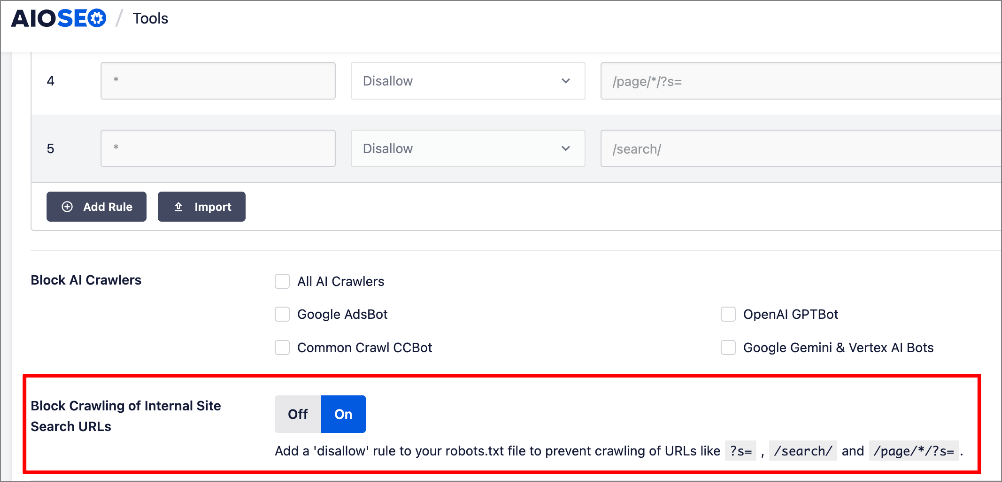

5. Evitar el rastreo de las URL de búsqueda interna del sitio

Los sitios web a menudo generan URLs excesivas a partir de búsquedas internas cuando los visitantes buscan contenido o productos. Estas URLs generadas por búsquedas contienen parámetros que los motores de búsqueda perciben como únicos, lo que hace que rastreen páginas innecesarias. Esto desperdicia tu presupuesto de rastreo y puede impedir que tus páginas más importantes sean indexadas.

Puedes evitar esto fácilmente en AIOSEO's Robots.txt Editor.

AIOSEO añade una regla "disallow" en tu archivo robots.txt sin que tengas que hacerlo para cada parámetro generado por la búsqueda.

Para más información, consulta nuestro tutorial sobre cómo editar tu archivo robots.txt.

Consejos para optimizar los archivos robots.txt de WordPress

Incluye la URL de tu Sitemap

Incluir un enlace a tu sitemap es esencial para ayudar a los bots de búsqueda a rastrear e indexar tus páginas importantes. Si bien omitirlo de tu archivo robots.txt puede no dañar tu SEO, sin duda tiene un impacto positivo. Afortunadamente, AIOSEO agrega automáticamente la URL de tu sitemap cuando genera un archivo robots.txt, por lo que no se requiere ninguna personalización adicional.

Comprende y utiliza los comodines sabiamente

Un comodín es un carácter que puede representar uno o más caracteres. El comodín más común es el asterisco (*).

Si tienes muchas páginas que deseas bloquear, puede llevar mucho tiempo agregar una regla para cada una. Afortunadamente, puedes usar comodines para simplificar tus instrucciones.

Los comodines son caracteres especiales que te permiten crear reglas basadas en patrones en tus archivos robots.txt de WordPress. Proporcionan una forma de aplicar directivas a un grupo de URLs que comparten un patrón común en lugar de especificar cada URL individualmente. Hay dos tipos principales de comodines utilizados en robots.txt:

- Comodín de asterisco (*): Representa cualquier secuencia de caracteres y se utiliza para hacer coincidir URLs que coinciden con un patrón especificado. Por ejemplo, User-agent: * significa que todos los agentes de usuario deben seguir la directiva prescrita.

- Comodín de signo de dólar ($): Se utiliza para hacer coincidir el final de una URL. Digamos que quieres bloquear el acceso a todas las URLs que terminan en “.pdf”, puedes usar el signo de dólar en una directiva como esta: Disallow: /*.pdf$.

Sin embargo, los comodines deben usarse con cautela, ya que un uso indebido puede bloquear o permitir el acceso no intencional a varias páginas o directorios.

Usa comentarios para mayor claridad

Agrega comentarios en tu archivo robots.txt para explicar tus directivas. Esto te ayudará a ti y a otros a comprender el propósito de cada regla. Para agregar un comentario, coloca un hashtag (#) al principio del comentario. Los bots de búsqueda ignorarán todo lo que siga al #.

Cómo probar tus archivos robots.txt de WordPress

Una vez que hayas terminado de generar y configurar tu archivo robots.txt de WordPress, puedes probarlo para detectar errores. Puedes usar herramientas como la herramienta de prueba de robots.txt de Google Search Console.

Sin embargo, no necesitarás estas si usas el editor de robots.txt de AIOSEO, ya que tiene validación de reglas y manejo de errores integrados.

Archivos robots.txt de WordPress: Tus preguntas frecuentes respondidas

¿Qué es un archivo robots.txt en WordPress?

Un archivo robots.txt es un archivo de texto plano colocado en el directorio raíz de un sitio web de WordPress. Indica a los rastreadores de motores de búsqueda qué partes del sitio deben rastrearse e indexarse y qué partes deben excluirse.

¿Cómo puedo generar robots.txt en WordPress?

Puedes generar fácilmente un archivo robots.txt en WordPress usando un plugin como All In One SEO (AIOSEO). Ni siquiera necesitas conocimientos de codificación o técnicos.

¿Puedo usar robots.txt para mejorar el SEO?

Sí, optimizar tu archivo robots.txt puede contribuir a un mejor SEO. Puedes mejorar la visibilidad y el ranking de tu sitio web en los resultados de búsqueda guiando a los bots de los motores de búsqueda a rastrear e indexar tu contenido más valioso, mientras excluyes contenido duplicado o irrelevante.

Maneja sabiamente el poder de tu archivo robots.txt de WordPress

Tu archivo robots.txt de WordPress es una herramienta potente que puede ayudarte a mejorar tu rastreabilidad, indexación y rankings en las SERP.

Esperamos que esta publicación te haya ayudado a obtener un conocimiento exhaustivo de los archivos robots.txt de WordPress y por qué es importante optimizar el tuyo. También puedes consultar otros artículos de nuestro blog, como nuestra guía sobre cómo crear contenido escaneable o nuestro tutorial sobre cómo usar un generador de títulos SEO para impulsar tus rankings y CTR.

Si encontraste útil este artículo, suscríbete a nuestro Canal de YouTube. Encontrarás muchos más tutoriales útiles allí. También puedes seguirnos en X (Twitter), LinkedIn o Facebook para estar al tanto.

Descargo de responsabilidad: Nuestro contenido es compatible con los lectores. Esto significa que si haces clic en algunos de nuestros enlaces, podemos ganar una comisión. Solo recomendamos productos que creemos que añadirán valor a nuestros lectores.