WordPressのrobots.txtファイルについて知っておくべきことをすべて知りたいと思いませんか?

Robots.txtファイルは、検索ボットがサイトとどのようにやり取りするかを制御するのに役立ちます。そのため、使い方を知っている人にとっては非常に便利なSEOツールとなります。

この記事では、WordPressのrobots.txtファイルについて知っておくべきことをすべてご紹介します。

この記事では

WordPressのrobots.txtファイルとは

WordPressのrobots.txtファイルは、ウェブサイトの所有者が検索エンジンのボットにサイトとのやり取り方法、特にどのページをクロールし、どのページを無視するかを指示するために作成するプレーンテキストファイルです。このファイルは、ウェブサイトのルートディレクトリ、つまりメインフォルダに保存されます。

本質的に、WordPressのrobots.txtファイルはサイトのゲートキーパーとして機能します。

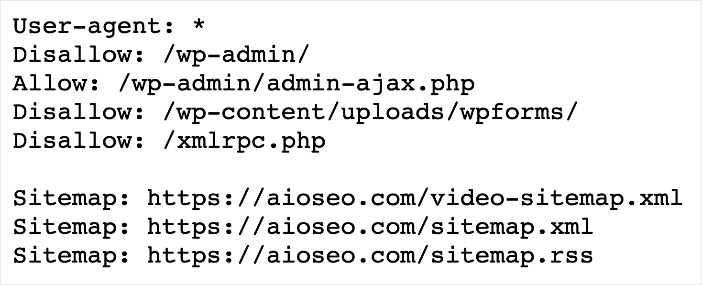

これは次のようなものです:

robots.txtファイルには、https://yoursite.com/robots.txtにアクセスすることでアクセスできます。

これは、ウェブページのhead内に埋め込まれたHTMLタグであるrobotsメタタグと混同しないでください。このタグは、それが配置されているページにのみ適用されます。

WordPressのrobots.txtファイルが必要な6つの理由

WordPressのrobots.txtファイルとは何かを理解したところで、なぜそれが必要なのかを簡単に見てみましょう。

1. 検索エンジンのクロールを制御する

WordPressのrobots.txtファイルの主な目的は、検索エンジン(およびその他のボット)がクロールできる部分とできない部分を制御することです。これにより、検索エンジンが検索結果ページ(SERP)に表示させたいコンテンツの発見に集中し、機密性の高いページや関連性の低いページを回避することが保証されます。

2. インデックス作成の改善

robots.txtファイルを最適化すべきもう1つの理由は、サイトのインデックス作成を改善するのに役立つことです。robots.txtファイルを設定して、重要なページのクロールとインデックス作成を優先させることができます。その結果、ビジネスにとって最も重要なページがランク付けされる可能性が高まります。

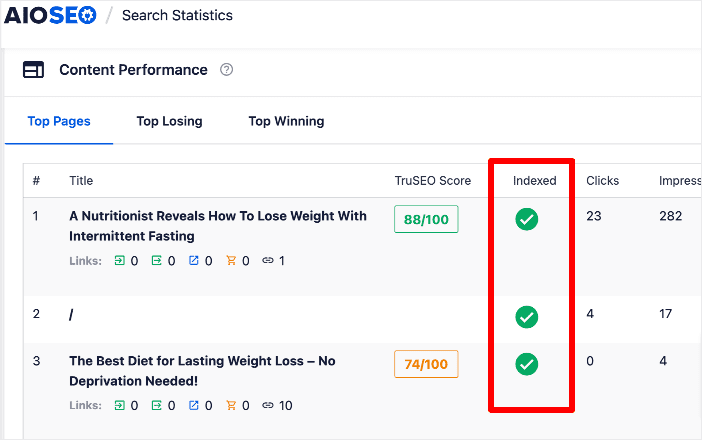

AIOSEOを使用すると、投稿やページのインデックスステータスを確認することができます。

これにより、ページのインデックスステータスを簡単に把握できます。

3. 重複コンテンツを回避する

重複コンテンツとは、完全にまたは類似したコンテンツを持つページや投稿を指します。適切に対処しないと、SEOに悪影響を与える可能性があります。

robots.txtファイルは、検索エンジンが同じコンテンツの複数のバージョンをインデックス作成するのを防ぐために使用できます。これにより、ランク付けしたいページが検索エンジンによってクロールおよびインデックス作成されることが保証されます。

4. 帯域幅の節約

検索エンジンのクローラーは、サイトをクロールする際にサーバーリソースと帯域幅を消費します。クロールするページまたはディレクトリを指定することで、サーバーリソースを節約し、サイトのパフォーマンスを向上させることができます。

また、クロールするページや投稿を優先させるのに役立つため、クロール予算を最適化するためにも使用できます。

5. プライバシー保護

機密情報や機密データを含むウェブサイトの部分がある場合は、検索エンジンがそれをクロールおよびインデックス作成するのを防ぐことができます。robots.txtでそれらの領域へのアクセスをブロックするだけで、プライバシーとセキュリティを保護できます。

6. ユーザーエクスペリエンスの向上

検索エンジンがクロールおよびインデックス作成できるページを制御することで、ユーザーがサイトの最も関連性の高い最新のコンテンツに誘導されることを保証できます。これにより、全体的なエクスペリエンスが向上します。

ご覧のとおり、WordPressのrobots.txtファイルはウェブサイト管理の基本です。適切に設定すれば、サイトのパフォーマンスと検索結果での可視性に大きな影響を与えることができます。

WordPress Robots.txtファイルの生成方法

WordPressのrobots.txtファイルを生成するのは非常に簡単です。コードは不要で、次の手順で行います。

ステップ1:AIOSEOをインストールする

カスタムrobots.txtファイルを生成するための最初のステップは、All In One SEO(AIOSEO)をインストールして有効化することです。

AIOSEOは、300万以上の有効インストール数を誇る、強力でありながら使いやすいSEOプラグインです。何百万人ものスマートブロガーがAIOSEOを使用して、検索エンジンのランキングを向上させ、質の高いトラフィックをブログに誘導しています。これは、プラグインにSEO設定を適切に構成するための強力な機能とモジュールが多数用意されているためです。例としては次のものが挙げられます。

- 検索統計: この強力なGoogle Search Console連携により、キーワードランキングの追跡や重要なSEO指標の確認がワンクリックで行えます。

- 次世代スキーマジェネレーター: このノーコードスキーマジェネレーターを使用すると、サイト上のあらゆるスキーママークアップを生成して出力できます。

- リダイレクトマネージャー: リダイレクトを管理し、404エラーを排除するのに役立ち、検索エンジンがサイトをクロールしてインデックス作成しやすくします。

- リンクアシスタント: サイト内のページ間のリンク構築を自動化する強力な内部リンクツールです。アウトバウンドリンクの監査も提供します。

- SEOプレビュー: 検索スニペットとソーシャルスニペットの概要、および一般的なSEOの概要を確認できるため、最適化を改善できます。

- IndexNow: IndexNowプロトコル(BingやYandexなど)をサポートする検索エンジンでの高速インデックス作成に。

- サイトマップジェネレーター: さまざまな種類のサイトマップを自動生成し、サイトの更新をすべての検索エンジンに通知します。

- その他多数。

AIOSEOのインストール方法については、インストールガイドをご覧ください。

最も愛されている機能の1つは、高度なrobots.txtエディターです。この強力なツールにより、WordPressのrobots.txtファイルを簡単に設定およびカスタマイズできます。

注意: WordPressはすべてのサイトに対してrobots.txtファイルを自動生成します。ただし、標準ではカスタマイズできません。そのためにはプラグインが必要です。ここでAIOSEOのようなツールが登場します。

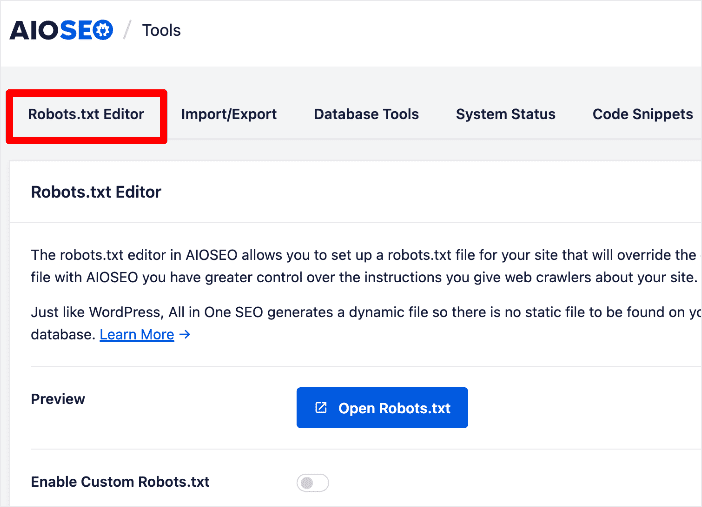

ステップ2:WordPressのrobots.txtファイルエディタを開く

AIOSEOをアクティブ化したら、次にエディターモードでWordPressのrobots.txtファイルを開きます。これを行うには、AIOSEOメニューに移動し、ツール » robots.txtエディターをクリックします。

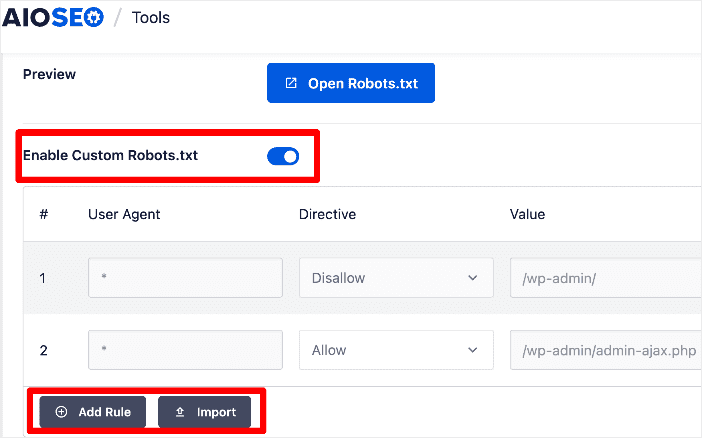

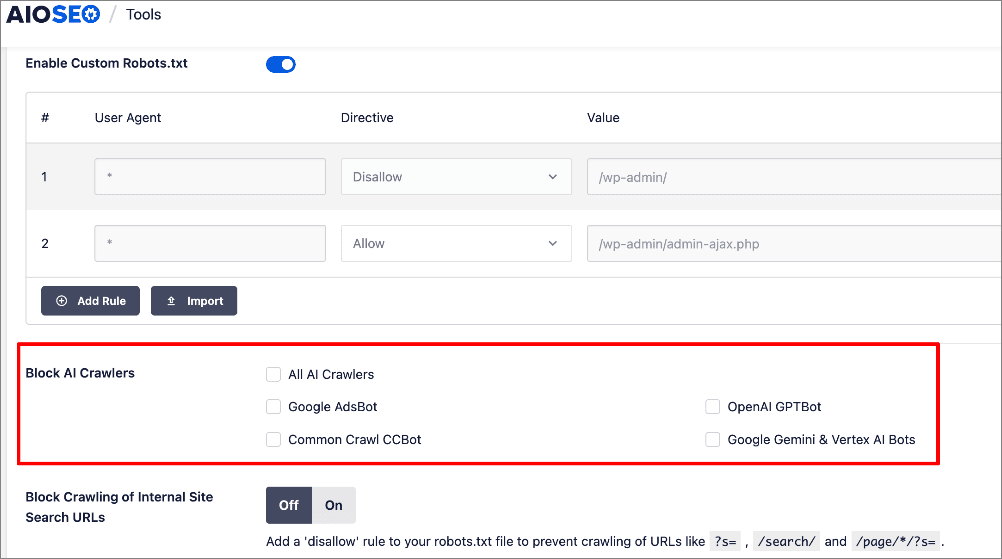

次に、カスタムrobots.txtを有効にするトグルをクリックして、robots.txtファイルの編集を有効にします。

より多くのオプションについては、最高のrobots.txtジェネレーターのリストをご覧ください。

ステップ3:robots.txtディレクティブを設定する

robots.txtファイルの編集を有効にしたら、次にrobots.txtファイルにカスタムディレクティブを設定します。これらのディレクティブに従うべきユーザーエージェント(ボット)を指定することもできます。

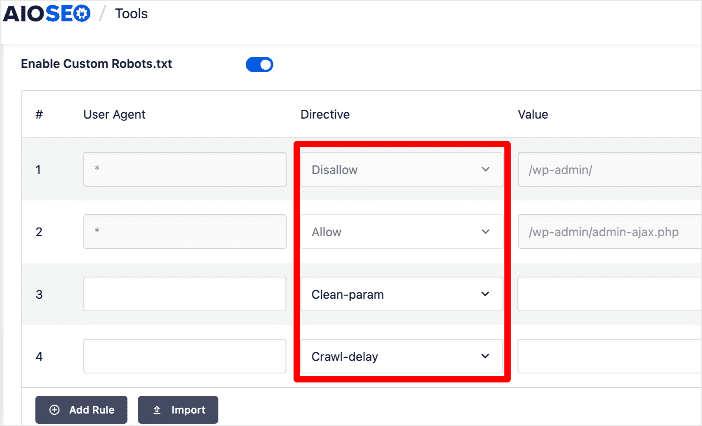

ディレクティブは、検索ボットにフォローさせたい指示です。AIOSEOのrobots.txtエディターで見つかるディレクティブの例には、Allow、Disallow、Clean-param、およびCrawl delayがあります。

各ディレクティブの意味は次のとおりです。

- Allow: ユーザーエージェント(ボット)がURLをクロールすることを許可します。

- Disallow: ユーザーエージェント(ボット)がURLをクロールすることを禁止します。

- Clean-param: 指定されたURLパラメータを持つすべてのURLを無視するように検索ボットに指示します。

- Crawl delay: 検索ボットがURLをクロールする間隔を設定します。

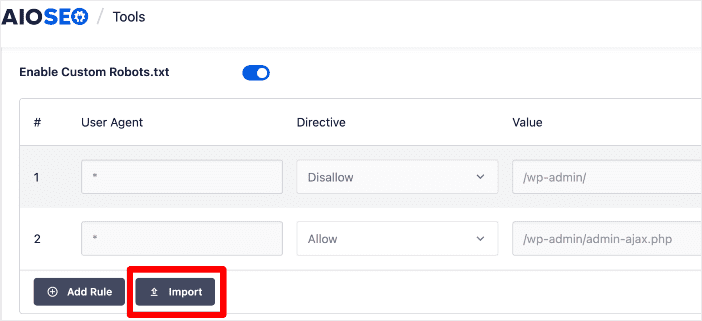

ディレクティブを手動で追加する以外に、インポート機能を使用して、別のサイトから事前に設定されたrobots.txtファイルをインポートできます。

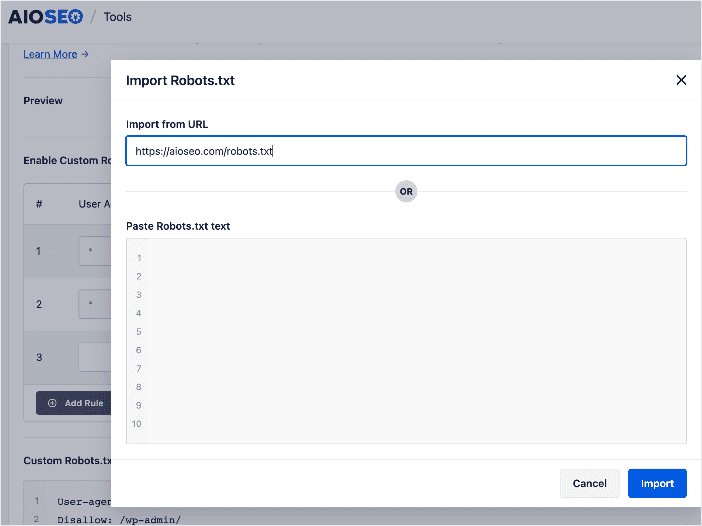

インポートボタンをクリックすると、選択したrobots.txtファイルをインポートするための2つのオプション(URLからインポートおよびrobots.txtテキストを貼り付け)を含むウィンドウが開きます。

この方法は、robots.txtファイルをインポートしようとしているサイトに、ご自身のサイトで実装したいディレクティブがある場合に最適です。

4. 不要なボットをブロックする

AIOSEOのRobots.txtエディターには、もう一つ非常に便利な機能として「AIクローラーをブロック」セクションがあります。これにより、不正なボットがサイトをクロールするのをブロックできます。これらはパフォーマンス、セキュリティ、SEOの問題につながる可能性があります。

これについて詳しくは、サイトで不要なボットトラフィックをブロックする方法に関するチュートリアルをご覧ください。

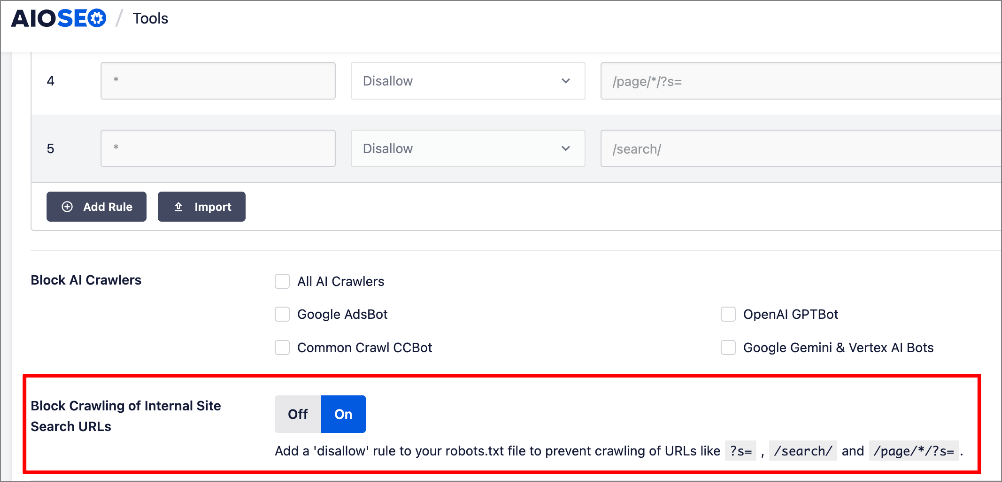

5. サイト内検索URLのクロールを防ぐ

ウェブサイトでは、訪問者がコンテンツや商品を検索する際に、内部検索によって過剰なURLが生成されることがよくあります。これらの検索生成URLにはパラメータが含まれており、検索エンジンはこれをユニークなものと認識するため、不要なページがクロールされてしまいます。これによりクロール予算が無駄になり、最も重要なページがインデックスされない可能性があります。

AIOSEOのRobots.txtエディターでこれを簡単に防ぐことができます。

AIOSEOは、検索生成パラメータごとに手動で設定することなく、robots.txtファイルに「disallow」ルールを追加します。

詳細については、robots.txtファイルを編集する方法に関するチュートリアルをご覧ください。

WordPressのRobots.txtファイルを最適化するためのヒント

サイトマップURLを含める

検索ボットが重要なページをクロールしてインデックスするのを助けるために、サイトマップへのリンクを含めることは不可欠です。robots.txtファイルに含めなくてもSEOに悪影響はないかもしれませんが、間違いなくプラスの影響があります。幸いなことに、AIOSEOはrobots.txtファイルを生成する際にサイトマップURLを自動的に追加するため、追加のカスタマイズは必要ありません。

ワイルドカードを賢く理解して使用する

ワイルドカードは、1つ以上の文字を表すことができる文字です。最も一般的なワイルドカードはアスタリスク(*)です。

ブロックしたいページがたくさんある場合、それぞれにルールを追加するのは時間がかかることがあります。幸いなことに、ワイルドカードを使用して指示を簡略化できます。

ワイルドカードは、WordPressのrobots.txtファイルでパターンベースのルールを作成できる特別な文字です。これらは、個々のURLを指定するのではなく、共通のパターンを共有するURLのグループにディレクティブを適用する方法を提供します。robots.txtで使用されるワイルドカードには、主に2種類あります。

- アスタリスク(*)ワイルドカード:これは任意の文字列を表し、指定されたパターンに一致するURLを照合するために使用されます。たとえば、User-agent: * は、すべてのユーザーエージェントが指定されたディレクティブに従う必要があることを意味します。

- ドル記号($)ワイルドカード:これはURLの末尾を照合するために使用されます。「.pdf」で終わるすべてのURLへのアクセスをブロックしたいとしましょう。このようなディレクティブでドル記号を使用できます — Disallow: /*.pdf$。

ただし、ワイルドカードは注意して使用する必要があります。誤って使用すると、意図せずに複数のページやディレクトリへのアクセスをブロックまたは許可してしまう可能性があります。

明確にするためにコメントを使用する

robots.txtファイルにコメントを追加して、ディレクティブを説明してください。これにより、あなたや他の人が各ルールの目的を理解するのに役立ちます。コメントを追加するには、コメントの先頭にハッシュタグ(#)を付けます。検索ボットは#以降のすべてを無視します。

WordPressのrobots.txtファイルをテストする方法

WordPressのrobots.txtファイルを生成・設定したら、エラーがないかテストできます。Google Search Consoleのrobots.txtテストツールなどのツールを使用できます。

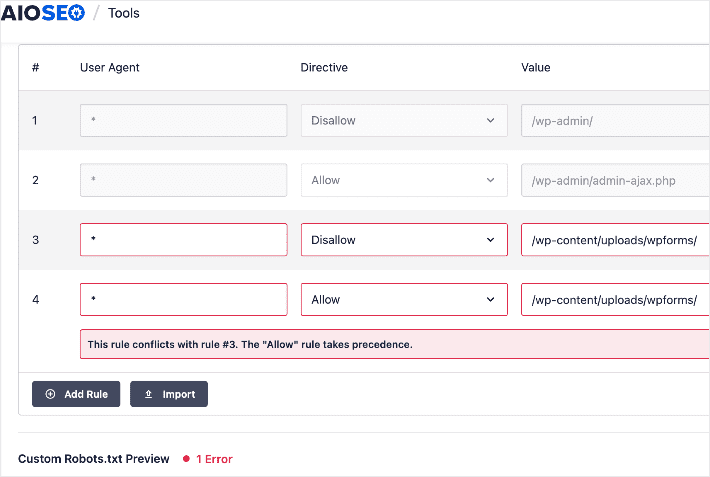

ただし、AIOSEOのrobots.txtエディタを使用する場合は、ルール検証とエラー処理が組み込まれているため、これらは必要ありません。

WordPressのrobots.txtファイル:よくある質問にお答えします

WordPressのrobots.txtファイルとは何ですか?

robots.txtファイルは、WordPressウェブサイトのルートディレクトリに配置されるプレーンテキストファイルです。検索エンジンのクローラーに対し、サイトのどの部分をクロールおよびインデックスすべきか、どの部分を除外すべきかを指示します。

WordPressでrobots.txtを生成するにはどうすればよいですか?

All In One SEO(AIOSEO)のようなプラグインを使用すると、WordPressでrobots.txtファイルを簡単に生成できます。コーディングや技術的な知識は必要ありません。

robots.txtを使用してSEOを改善できますか?

はい、robots.txtファイルを最適化することは、SEOの向上に貢献します。検索エンジンのボットに最も価値のあるコンテンツをクロールおよびインデックスするように誘導し、重複または関連性のないコンテンツを除外することで、検索結果でのウェブサイトの可視性とランキングを向上させることができます。

WordPressのrobots.txtファイルの力を賢く使いこなしましょう

WordPressのrobots.txtファイルは、SERPでのクロール可能性、インデックス作成、ランキングを向上させるのに役立つ強力なツールです。

この投稿が、WordPressのrobots.txtファイルに関する包括的な知識と、最適化がなぜ重要なのかを理解するのに役立ったことを願っています。また、ランキングとCTRを向上させるために、スキャン可能なコンテンツの作成ガイドやSEOタイトルジェネレーターの使用方法のチュートリアルのような、ブログの他の記事もチェックすることをお勧めします。

この記事がお役に立った場合は、YouTubeチャンネルを購読してください。そこには、さらに多くの役立つチュートリアルがあります。また、X(Twitter)、LinkedIn、またはFacebookでフォローして、最新情報を入手することもできます。

開示:当社のコンテンツは読者によってサポートされています。これは、当社のリンクの一部をクリックすると、手数料が発生する可能性があることを意味します。当社は、読者に価値をもたらすと信じる製品のみをお勧めします。