Was ist Crawling und Indexierung in SEO?

Wenn Sie sich diese Frage stellen, sind Sie nicht allein.

Viele SEO-Begriffe werden in Artikeln und Diskussionen locker verwendet, ohne richtig erklärt zu werden.

Crawling und Indexierung sind dafür ausgezeichnete Beispiele. Wenn Sie wissen, was diese Begriffe bedeuten, können Sie SEO besser verstehen und Ihre Website und Inhalte für verbesserte Suchrankings optimieren.

Was ist also Crawling in SEO?

In diesem Artikel beantworten wir diese Frage und schauen uns an, was Indexierung ist.

In diesem Artikel

- Was ist Crawling in SEO?

- Was ist Indexierung in SEO?

- Why are Crawling and Indexing Important for SEO?

- 10 Tips to Improve Your Site’s Crawlability and Indexability

- 1. Beginnen Sie mit der Website-Architektur

- 2. Optimieren Sie Ihre Robots.txt-Datei

- 3. Vergessen Sie Ihre XML-Sitemaps nicht

- 4. Implementieren Sie Schema Markup

- 5. Nutzen Sie Breadcrumbs

- 6. Nutzen Sie IndexNow

- 7. Verwenden Sie den Query Arg Monitor, um unnötige Query Args zu eliminieren

- 8. Verwalten Sie interne Website-Such-URLs

- 9. Finden und beheben Sie defekte Links

- 10. Seien Sie strategisch bei internen Verlinkungen

- What is Crawling and Indexing in SEO?: Your FAQs Answered

- Was ist Crawling in SEO? Jetzt, wo Sie es wissen, optimieren Sie dafür

Was ist Crawling in SEO?

Crawling ist der Prozess, den Suchmaschinen-Bots (auch bekannt als Such-Spider, Crawler oder Googlebot) verwenden, um systematisch das Internet zu durchsuchen, um Webseiten zu entdecken und darauf zuzugreifen. Diese Bots starten von einer Liste bekannter Webadressen (URLs) und folgen dann Links von einer Seite zur nächsten, wodurch effektiv ein riesiges, miteinander verbundenes Netzwerk von Webseiten erstellt wird.

Während die Such-Bots Ihre Website crawlen, greifen sie auf Ihre Beiträge und Seiten zu, lesen den Inhalt und folgen den internen und externen Links auf diesen Seiten. Sie setzen diesen Prozess rekursiv fort und navigieren von einem Link zum nächsten, bis sie einen erheblichen Teil Ihrer Website gecrawlt haben.

Für kleine Websites kann dies für alle URLs erfolgen. Für große Websites crawlen Suchbots die Seiten jedoch nur, wenn sie das Crawl-Budget nicht erschöpfen.

Suchmaschinen verwenden die während des Crawlings gesammelten Daten, um die Struktur von Websites, die enthaltenen Inhalte und die Beziehungen zwischen verschiedenen Webseiten zu verstehen. Die durch das Crawling gewonnenen Informationen werden dann für den nächsten Schritt verwendet: die Indexierung.

Was ist Indexierung in SEO?

Sobald die Crawler Ihre Webseiten gefunden und abgerufen haben, ist der nächste Schritt im Prozess die Indexierung. Bei der Indexierung werden die während des Crawling-Prozesses gesammelten Informationen analysiert und gespeichert. Die gesammelten Daten werden organisiert und in den Index von Google (oder einer anderen Suchmaschine) aufgenommen, eine riesige Datenbank mit Informationen über alle von der Suchmaschine entdeckten Webseiten.

Suchmaschinen verwenden komplexe Algorithmen, um den auf jeder Seite gefundenen Inhalt während der Indexierung zu bewerten und zu kategorisieren. Faktoren wie Schlüsselwörter, Seitenstruktur, Meta-Tags und die allgemeine Relevanz werden während dieses Prozesses berücksichtigt.

Die Indexierung ist wichtig, da sie es Suchmaschinen ermöglicht, relevante Ergebnisse schnell abzurufen, wenn Benutzer eine Suchanfrage stellen. Diese indizierten Ergebnisse werden dann auf den Suchergebnisseiten (SERPs) angezeigt.

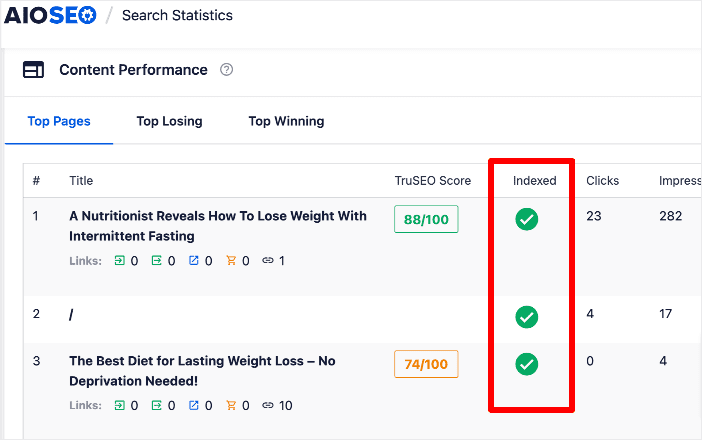

Sie können AIOSEO einfach verwenden, um den Indexstatus Ihrer Beiträge und Seiten zu überprüfen.

Dies hilft Ihnen, den Indexierungsstatus Ihrer Seiten leicht im Auge zu behalten, damit Sie die nicht indizierten Seiten problemlos beheben können.

Es ist wichtig zu beachten, dass nicht alle Webseiten indexiert werden und Suchmaschinen Seiten nach ihrer wahrgenommenen Wichtigkeit, Autorität und Relevanz priorisieren. Webseiten, die aufgrund technischer Probleme nicht zugänglich sind oder als minderwertig eingestuft werden, werden möglicherweise nicht indexiert.

Warum sind Crawling und Indexierung für SEO wichtig?

Crawling und Indexierung sind grundlegende Aspekte von SEO. Sie sind entscheidend dafür, wie gut Ihre Website eingestuft wird und wie sichtbar sie für Suchmaschinen wie Google ist.

Deshalb müssen Sie sicherstellen, dass Ihre Website leicht gecrawlt und indexiert werden kann.

Dies ist mit einem leistungsstarken WordPress-SEO-Plugin wie All In One SEO (AIOSEO) ganz einfach.

AIOSEO ist das beste WordPress-SEO-Plugin auf dem Markt und kann über 3 Millionen aktive Installationen vorweisen. Millionen von versierten Website-Besitzern und Vermarktern vertrauen dem Plugin, um ihnen zu helfen, SERPs zu dominieren und relevanten Website-Traffic zu generieren.

Es verfügt außerdem über viele leistungsstarke SEO-Funktionen und Module, die Ihnen helfen, Ihre Website für Crawlbarkeit und Indexierbarkeit zu optimieren.

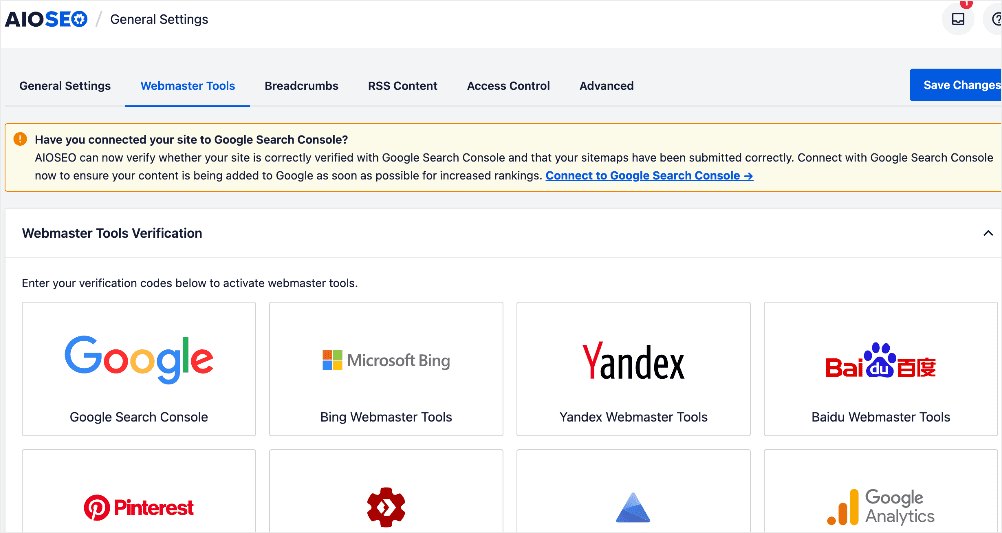

In Bezug auf die Indexierung ist einer der beliebtesten Bereiche die Webmaster Tools-Sektion.

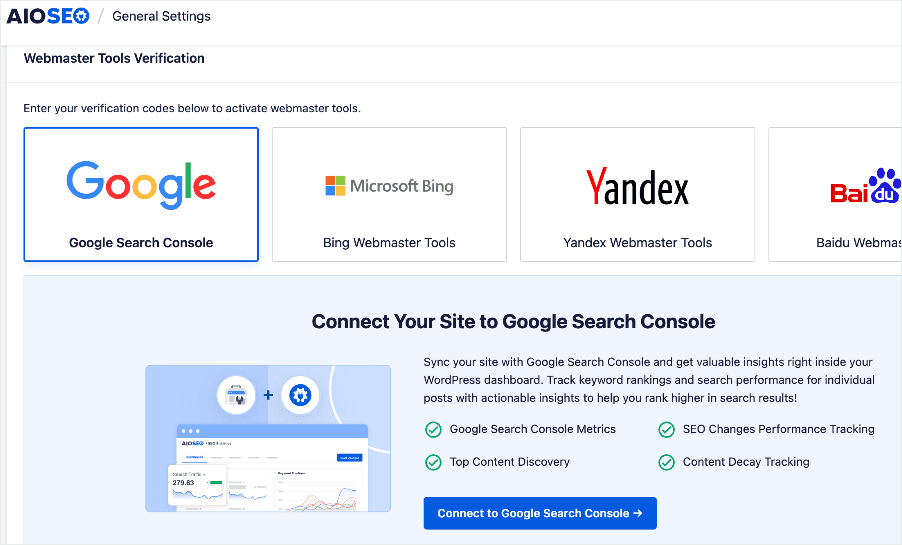

Diese Funktion ermöglicht es Ihnen, Ihre Website mit verschiedenen Plattformen zu verbinden, darunter Google Analytics und die Google Search Console (GSC). Was GSC betrifft, müssen Sie nicht den mühsamen Prozess des Kopierens und Einfügens von Verifizierungscodes durchlaufen. Die Verbindung Ihrer Website mit GSC hilft Ihnen, Ihre Sitemaps und Inhalte zur Indexierung an die Suchmaschine zu übermitteln.

Klicken Sie auf die Schaltfläche „Mit Google Search Console verbinden“, um den Verbindungsassistenten zu starten. Im ersten Schritt müssen Sie das Google-Konto auswählen, das Sie für die Verbindung mit GSC verwenden möchten.

Ausführliche Anweisungen zur Verwendung dieser Funktion finden Sie in unserem Tutorial zum Verbinden Ihrer Website mit der Google Search Console.

Schritt-für-Schritt-Anleitungen zur Installation von AIOSEO finden Sie in unserem detaillierten Installationshandbuch.

Warum sollten Sie Ihre Website für Crawling und Indexierung optimieren?

Lassen Sie uns tiefer eintauchen, warum Sie Ihre Website für Such-Bots optimieren sollten, damit diese Ihre Website crawlen und indexieren können.

Erhöhte Auffindbarkeit

Wenn Suchmaschinen Ihre Website crawlen und indexieren, haben Ihre Webseiten eine bessere Chance, von Nutzern entdeckt zu werden. Wenn eine Seite nicht gecrawlt und indexiert wird, erscheint sie nicht in den Suchergebnissen, was sie für potenzielle Besucher und Nutzer praktisch unsichtbar macht. Richtiges Crawling stellt sicher, dass Suchmaschinen die Inhalte Ihrer Website finden und indexieren können, sodass sie in relevanten Suchanfragen erscheinen.

Bessere Suchrankings

Nachdem eine Webseite indexiert wurde, ist sie berechtigt, in den SERPs zu erscheinen. Allein die Indexierung garantiert jedoch keine gute Platzierung. Suchmaschinen verwenden komplexe Algorithmen, um die Relevanz und Autorität von Webseiten in Bezug auf bestimmte Suchanfragen zu bestimmen.

Je zugänglicher und verständlicher Ihre Inhalte für Suchmaschinen-Crawler sind, desto höher ist die Wahrscheinlichkeit, für relevante Suchanfragen gut platziert zu werden. Darüber hinaus stellt die richtige Indexierung sicher, dass alle Seiten Ihrer Website für die Platzierung berücksichtigt werden, was Ihre Chancen erhöht, in den SERPs höher zu ranken.

Aktualität und Updates

Die meisten Websites fügen häufig neue Inhalte hinzu, aktualisieren bestehende Seiten oder entfernen veraltete. Ohne ordnungsgemäßes Crawling und Indexierung werden Suchmaschinen die Änderungen und Aktualisierungen, die Sie auf Ihrer Website vornehmen, nicht bemerken.

Rechtzeitiges Crawling und Indexierung stellen sicher, dass Suchmaschinen über die neuesten Inhalte Ihrer Website auf dem Laufenden bleiben. Dies ermöglicht es ihnen, die aktuellsten und relevantesten Informationen in den Suchergebnissen widerzuspiegeln. Frische und regelmäßig aktualisierte Inhalte können sich auch positiv auf Ihre SEO auswirken, da Suchmaschinen oft neue und relevante Informationen priorisieren.

10 Tipps zur Verbesserung der Crawlbarkeit und Indexierbarkeit Ihrer Website

Jetzt wissen Sie, was Crawling und Indexierung im SEO-Bereich bedeuten. Als Nächstes sehen wir uns an, wie Sie Suchmaschinen helfen können, Ihre Website und deren Inhalte besser zu crawlen und zu indexieren.

1. Beginnen Sie mit der Website-Architektur

Einer der ersten Ansatzpunkte bei der Optimierung Ihrer Website für Crawling und Indexierung ist Ihre Website-Architektur. Das bedeutet, Ihre Beiträge und Seiten so zu organisieren, dass Suchmaschinen und Leser sie leicht navigieren können. Dazu gehören:

- Optimieren Sie die URL-Struktur: Organisieren Sie Ihre Inhalte in einer klaren und logischen Hierarchie. Teilen Sie Ihre Inhalte in Kategorien und Unterkategorien auf, damit Suchmaschinen leicht folgen und verstehen können, worum es bei jeder URL geht.

- Klare Navigation: Streben Sie eine flache Navigationsstruktur an, bei der jede Seite von der Homepage aus mit wenigen Klicks erreichbar ist. Dies stellt sicher, dass wichtige Seiten für Benutzer und Suchmaschinen-Crawler leicht zugänglich sind.

- Beschreibende URLs: Verwenden Sie beschreibende und benutzerfreundliche URLs, die relevante Schlüsselwörter enthalten. Vermeiden Sie lange Zeichenketten von Zahlen oder Symbolen, die für Benutzer oder Suchmaschinen keinen Kontext bieten.

Lesen Sie diesen Leitfaden für weitere Details zur besten Permalink-Struktur in WordPress.

2. Optimieren Sie Ihre Robots.txt-Datei

Eine robots.txt-Datei steuert das Crawling-Verhalten von Suchmaschinen-Bots und anderen Web-Crawlern auf Ihrer Website. Sie dient als Anweisungssatz, der Bot-Suchmaschinen mitteilt, welche Seiten oder Teile Ihrer Website sie crawlen und indexieren dürfen oder nicht dürfen.

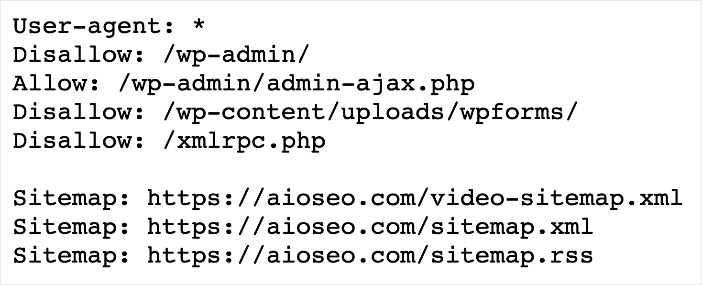

Hier ist ein Beispiel für eine robots.txt-Datei:

Der wichtigste Vorteil der Optimierung Ihrer robots.txt-Datei ist die Verbesserung der Crawl-Effizienz. Denn sie teilt den Suchmaschinen-Bots mit, welche URLs sie beim Crawlen Ihrer Website priorisieren sollen. Sie gibt auch Anweisungen, welche Seiten sie nicht crawlen sollen. Auf diese Weise verbringen sie mehr Zeit auf Ihren wichtigeren Seiten, was die Wahrscheinlichkeit erhöht, dass diese ordnungsgemäß indexiert und den Benutzern angezeigt werden.

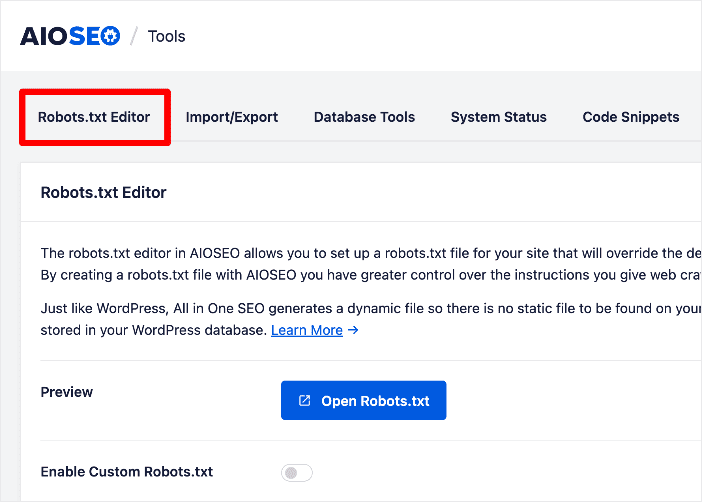

Auch wenn dies sehr technisch klingt, ist es mit dem robots.txt-Editor von AIOSEO super einfach zu machen. Sie können darauf im Werkzeugbereich des Plugins zugreifen.

Alles, was Sie tun müssen, um Ihre robots.txt-Datei anzupassen, ist, auf Benutzerdefinierte Robots.txt aktivieren zu klicken. Dann erhalten Sie 4 Anweisungen, die Sie auf Ihrer Website anwenden können, nämlich:

- Zulassen

- Verweigern

- Parameter löschen

- Crawl-Verzögerung

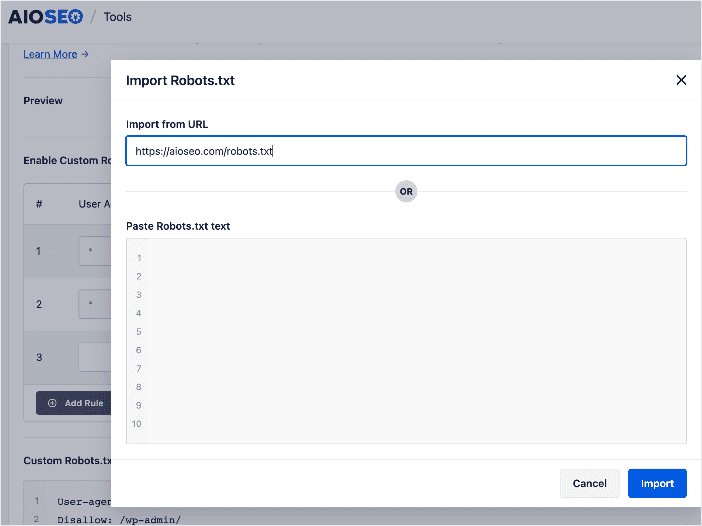

Und wenn die Website, deren robots.txt-Datei Sie bearbeiten, einer anderen ähnelt, können Sie die robots.txt-Datei der anderen einfach über die URL importieren oder sie kopieren und einfügen.

Eine gut optimierte robots.txt-Datei stellt sicher, dass Ihre Prioritätsseiten zuerst gecrawlt werden, was die Wahrscheinlichkeit erhöht, dass sie für relevante Schlüsselwörter indexiert und den Benutzern angezeigt werden.

Tipps zur Bearbeitung Ihrer robots.txt-Datei finden Sie in diesem Artikel.

Der Robots.txt-Editor von AIOSEO ermöglicht es Ihnen auch, unerwünschte Web-Crawler zu blockieren und erleichtert die Verwaltung von internen Website-Such-URLs.

3. Vergessen Sie Ihre XML-Sitemaps nicht

Eine weitere Möglichkeit, die Crawlbarkeit Ihrer Website zu verbessern, ist die Optimierung Ihrer XML-Sitemap.

Eine XML-Sitemap ist eine Datei, die alle wichtigen Seiten und URLs Ihrer Website in einem XML-Format auflistet. Sie dient als Fahrplan für Suchmaschinen-Crawler, um die Inhalte auf Ihrer Website effektiver zu entdecken und zu indexieren.

Das Erstellen und Optimieren einer XML-Sitemap ist mit dem Sitemap-Generator von AIOSEO einfach.

Einige der Vorteile der Erstellung einer Sitemap sind:

- Informiert Suchmaschinen über Ihre Inhalte: Eine XML-Sitemap enthält Informationen über jede Seite Ihrer Website, einschließlich wann sie erstellt wurde, wann sie zuletzt geändert wurde und ihre Bedeutung im Verhältnis zu anderen Seiten auf Ihrer Website.

- Hilft Suchmaschinen, Ihre neuen Seiten zu entdecken: Sie informiert Suchmaschinen über Ihre neuen Seiten und wann Sie einen neuen Blogbeitrag auf Ihrer Website veröffentlicht haben.

- Erhöhte Seiten- und Crawl-Priorität: Sie ändert die relative Priorität von Seiten auf Ihrer Website. Sie können beispielsweise ein Tag in Ihrer Sitemap hinzufügen, das angibt, welche Seiten am wichtigsten sind, und Bots werden sich auf das Crawlen dieser Prioritätsseiten konzentrieren.

- Listet die URLs Ihrer Website auf: Sie können eine Liste aller URLs für Ihre Website übermitteln. Dies ist von Vorteil, da es Suchmaschinen erleichtert, Ihre wichtigen URLs zu entdecken.

Sobald Sie Ihre Sitemap erstellt haben, übermitteln Sie sie an Google über die Google Search Console (GSC). Sie können sie auch an Bing und andere Suchmaschinen übermitteln.

Sehen Sie sich dieses Tutorial an für Schritt-für-Schritt-Anleitungen zur Erstellung einer XML-Sitemap.

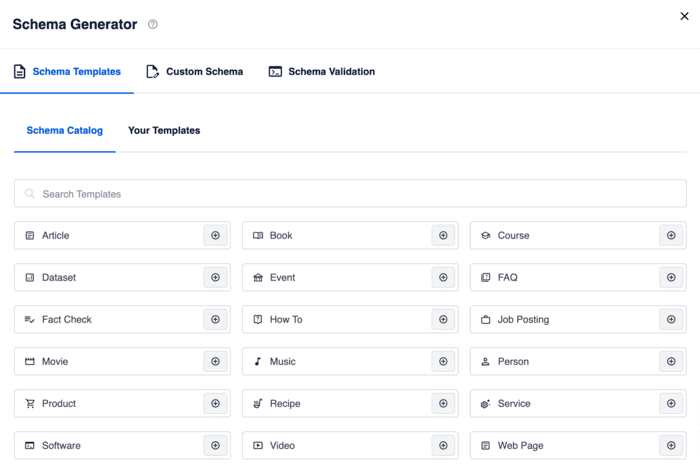

4. Implementieren Sie Schema Markup

Schema-Markup ist eine semantische Sprache, die Suchmaschinen hilft, Ihre Inhalte besser zu verstehen. Sie verwendet Tags (strukturierte Daten), die Suchmaschinen mehr Kontext zu Ihren Seiten oder Beiträgen geben.

Das Hinzufügen von Schema-Markup zu Ihren Seiten hat viele Vorteile, darunter:

- Verbessert die Indexierung

- Verbessert Rankings

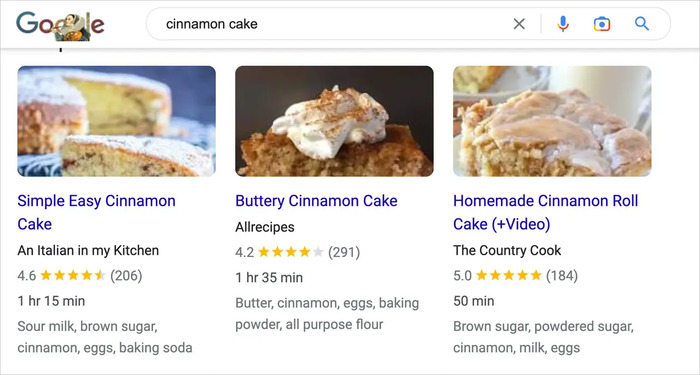

- Kann zu Rich Snippets führen

- Verbessert die organischen Klickraten (CTR)

Seiten mit Schema-Markup können von einer erhöhten Sichtbarkeit profitieren, dank interaktiverer Suchergebnisse.

Die Implementierung von Schema-Markup ist mit dem Next-Gen Schema Generator von AIOSEO einfach.

Sie benötigen nicht einmal Programmier- oder technische Kenntnisse, um Schema zu Ihrer Website hinzuzufügen. Es sind nur ein paar Klicks erforderlich, und Sie sind fertig. Detaillierte Anleitungen dazu finden Sie in diesem Tutorial.

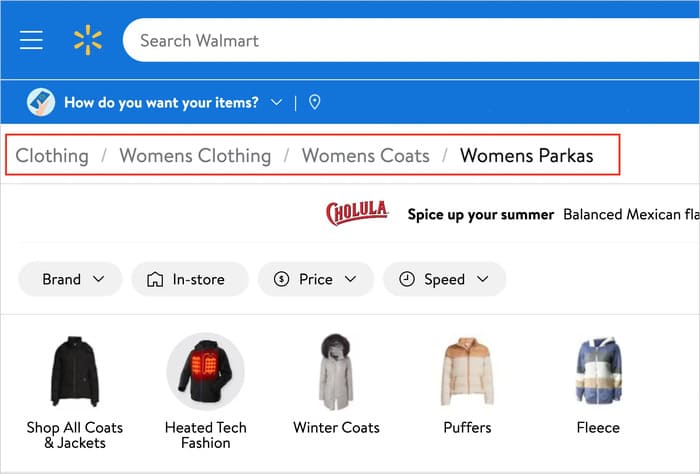

5. Nutzen Sie Breadcrumbs

Breadcrumbs sind winzige Navigationslinks, die den Nutzern einen klaren und hierarchischen Navigationspfad bieten. Suchmaschinen-Bots können Ihren Breadcrumbs auch folgen, um Ihre Website effizienter zu durchsuchen.

Breadcrumbs bieten ein strukturiertes Navigationssystem, indem sie den hierarchischen Pfad von der Homepage zur aktuellen Seite anzeigen. Diese Struktur hilft Suchmaschinen-Bots, die Organisation der Inhalte Ihrer Website und deren Beziehungen zu verstehen. Dadurch können sie Ihre Seiten leichter und effektiver crawlen und indexieren.

Um mehr über Breadcrumbs und deren Hinzufügung zu Ihrer Website zu erfahren, sehen Sie sich dieses Tutorial an.

6. Nutzen Sie IndexNow

Das IndexNow-Protokoll macht das Internet effizienter, indem es teilnehmende Suchmaschinen sofort über Änderungen auf Ihrer Website informiert. Wenn Sie beispielsweise Inhalte ändern oder einen neuen Beitrag oder eine neue Seite hinzufügen, benachrichtigt das IndexNow-Protokoll Suchmaschinen über diese Änderungen.

Dadurch werden Ihre Änderungen von den Suchmaschinen schneller gecrawlt und indexiert.

Das bedeutet, dass IndexNow ein leistungsstarkes Werkzeug ist, das Ihnen hilft, Ihre Inhalte schneller indexieren zu lassen, was zu besseren Rankingchancen führt.

Das IndexNow-Protokoll ist ein leistungsstarkes Werkzeug, mit dem Sie Ihre Inhalte schnell indexieren lassen können.

Ein weiterer wesentlicher Vorteil von IndexNow ist, dass, wenn eine Suchmaschine, die an der IndexNow-Initiative teilnimmt, benachrichtigt wird, alle anderen Suchmaschinen über neue Inhalte informiert werden. Infolgedessen werden Ihre Inhalte schnell in den Suchergebnissen für relevante Suchanfragen angezeigt.

Das Beste daran ist, dass das Hinzufügen von IndexNow zu Ihrer Website einfach ist. Befolgen Sie einfach diese einfachen Schritte.

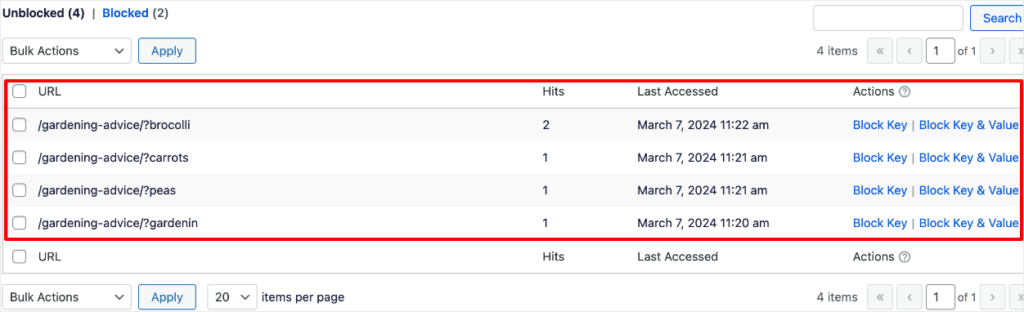

7. Verwenden Sie den Query Arg Monitor, um unnötige Query Args zu eliminieren

Wenn Ihre Website wächst und sich weiterentwickelt, sammelt sie unweigerlich eine Sammlung von URLs an, die nicht zu Ihrem SEO beitragen. Wenn überhaupt, können einige der URLs für Ihr SEO schädlich sein, da sie das Crawl-Budget verschwenden. Beispiele hierfür sind URLs mit Abfrageargumenten, auch bekannt als URL-Parameter. Abfrageargumente sind jeder Teil einer Webadresse nach einem Fragezeichen (?) und einem Kaufmannszeichen (&).

Betrachten Sie das folgende Beispiel:

https://www.example.com/search?q=robots&category=tech&page=1In diesem Fall lautet das Abfrageargument q=robots&category=tech&page=1

Das Problem mit Abfrageargumenten ist, dass sie zu mehreren URLs für dieselbe Seite führen. Infolgedessen crawlen Suchmaschinen dieselbe Seite mehrmals, da Abfrageargumente sie irreführen und sie denken, es seien unterschiedliche Seiten.

Um diese Verschwendung von Crawl-Budget zu vermeiden, können Sie den Query Arg Monitor von AIOSEO verwenden, um Abfrageargumente aus Ihren URLs zu entfernen.

Der Query Arg Monitor protokolliert Ihre URL-Parameter und kann so konfiguriert werden, dass diese Informationen für einen bestimmten Zeitraum aufbewahrt werden. Alle protokollierten Abfrageargumente werden in einer Tabelle angezeigt.

Um das Crawling Ihrer Abfrageargumente zu verhindern, wählen Sie die Aktion aus, die Sie ausführen möchten, in diesem Fall das Blockieren derjenigen, die Sie nicht crawlen lassen möchten. Sie können dies für ein einzelnes Abfrageargument tun oder Abfrageargumente in großen Mengen blockieren.

Sehen Sie sich dieses Tutorial an für weitere Details, wie Crawl Cleanup funktioniert.

8. Verwalten Sie interne Website-Such-URLs

Websites generieren oft unnötige URLs aus internen Suchen, die Besucher durchführen, wenn sie nach Informationen oder Produkten suchen. Suchmaschinen crawlen diese URLs, da sie sie als einzigartig betrachten, was zu einem verschwendeten Crawl-Budget (und potenziellem Spam) führt. Glücklicherweise können Sie diese ganz einfach mit der Funktion Crawl Cleanup von AIOSEO verwalten.

Dieses leistungsstarke Tool ermöglicht es Ihnen zu steuern, wie Suchmaschinen mit Ihren Website-Such-URLs interagieren. Sobald aktiviert, können Sie:

- Eine maximale Zeichenbegrenzung für Suchanfragen festlegen, um überladene Such-URLs zu verhindern.

- Emojis und Sonderzeichen automatisch herausfiltern, um unübersichtliche oder unsinnige Suchbegriffe zu vermeiden.

- Gängige Spam-Muster blockieren, damit Junk-Suchen keine unnötigen indexierbaren URLs erstellen.

Crawl Cleanup ist der perfekte Weg, um die potenziellen Gefahren Ihrer internen Seitensuche zu mindern und sicherzustellen, dass Suchmaschinen nur relevante Seiten crawlen.

Crawl Cleanup kann jedoch mehr als das. Es kann Ihnen auch helfen, Ihre RSS-Feeds zu verwalten und unerwünschte Bots auf Ihrer Website zu blockieren.

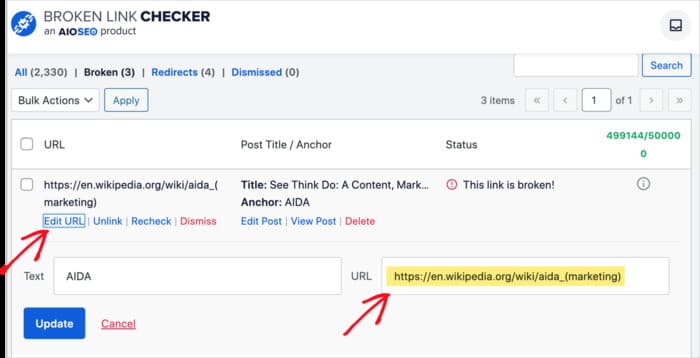

9. Finden und beheben Sie defekte Links

Defekte Links sind schlecht für SEO, da sie zu Crawling-Fehlern führen. Dies liegt daran, dass defekte Links den normalen Ablauf des Crawling-Prozesses stören. Anstatt Links effizient von einer Seite zur anderen zu verfolgen, stößt der Crawler auf Sackgassen. Dies kann zu verschwendeten Crawling-Ressourcen führen und möglicherweise dazu, dass andere Seiten unerforscht bleiben.

Deshalb sollten Sie Ihre Website regelmäßig auf defekte Links überprüfen. Dies kann einfach mit dem Broken Link Checker von AIOSEO erfolgen, einem Tool, das Ihre Website crawlt, um defekte Links zu finden.

Dieses leistungsstarke Tool findet nicht nur defekte Links. Es bietet Ihnen auch Lösungen zur Behebung.

Da der Broken Link Checker Ihre Website automatisch auf defekte Links überprüft, reduzieren Sie das Auftreten von Crawling-Fehlern.

Für detaillierte Anweisungen zur Verwendung dieses leistungsstarken Tools zum Finden und Beheben defekter Links sehen Sie sich dieses Tutorial an.

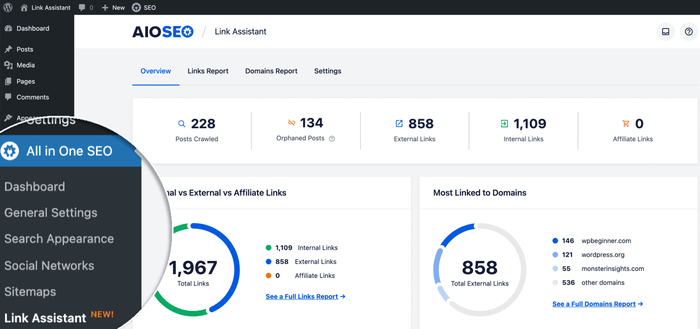

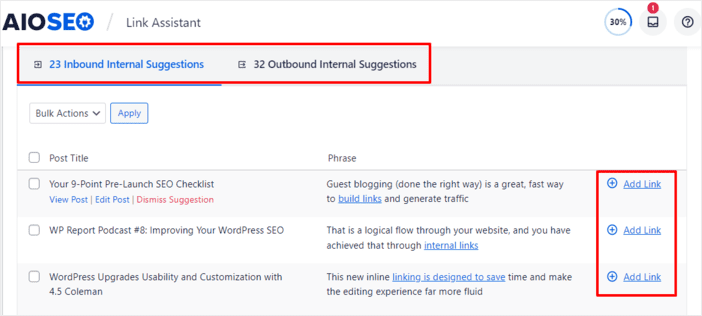

10. Seien Sie strategisch bei internen Verlinkungen

Eine weitere Möglichkeit, Ihre Website für die Crawlbarkeit und damit für die Indexierung zu optimieren, ist die strategische Gestaltung Ihres internen Linkaufbaus. Eine Möglichkeit, dies zu tun, ist die Erstellung einer logischen internen Verknüpfungsstruktur, die Ihre Seiten verbindet. Dies hilft Suchmaschinen, neue Inhalte zu entdecken und die Hierarchie und Bedeutung Ihrer Seiten zu verstehen.

Ein großartiges Werkzeug, das Ihnen dabei helfen kann, dies zu automatisieren, ist Link Assistant.

Dies ist ein KI-gestütztes Tool, das Ihre Website crawlt und verwandte Inhalte findet, die Sie miteinander verknüpfen können. Das Tool ist so leistungsfähig, dass es auch Vorschläge für Ankertexte bietet.

Strategisches internes Verlinken hilft Suchmaschinen auch zu verstehen, welches das primäre Thema Ihrer Website ist. Dies erleichtert es ihnen, Ihre Seiten richtig zu indexieren und sie für relevante Suchanfragen auszuliefern.

Was sind Crawling und Indexierung in SEO?: Ihre FAQs beantwortet

Was ist der Unterschied zwischen Crawling und Indexierung?

Crawling ist der Entdeckungsprozess, den Suchmaschinen verwenden, um Inhalte auf Ihrer Website zu finden. Indexierung ist der Prozess der logischen Speicherung dieser Inhalte in der Datenbank der Suchmaschine.

Was ist das beste Tool zur Verbesserung des Crawlings und der Indexierung meiner Website?

All In One SEO (AIOSEO) ist das beste Tool, das Ihnen hilft, Ihre Website und Inhalte für Crawling und Indexierung zu optimieren. Es verfügt über viele Funktionen, die Suchmaschinen das Crawlen, Entdecken und Indexieren Ihrer URLs erleichtern.

Was ist der Vorteil von Crawling in SEO?

Crawling erleichtert es Suchmaschinen, Ihre Inhalte zu entdecken und sie Nutzern für relevante Suchanfragen bereitzustellen.

Was ist Crawling in SEO? Jetzt, wo Sie es wissen, optimieren Sie dafür

Nachdem Sie nun wissen, was Crawling und Indexierung sind und warum sie wichtig sind, optimieren Sie Ihre Website für Suchmaschinen. Denken Sie daran, mit AIOSEO erhalten Sie viele Funktionen und Tools, die Ihnen dabei helfen.

Wir hoffen, dieser Beitrag hat Ihnen geholfen zu verstehen, was Crawling und Indexierung sind und warum sie für Ihre SEO wichtig sind. Möglicherweise möchten Sie auch andere Artikel in unserem Blog lesen, wie z. B. unser Tutorial zur Verwendung der primären Kategorie zur Anpassung von Breadcrumbs oder unseren Leitfaden dazu, wie lange SEO dauert.

Wenn Sie diesen Artikel hilfreich fanden, abonnieren Sie bitte unseren YouTube-Kanal. Dort finden Sie viele weitere hilfreiche Tutorials. Sie können uns auch auf Twitter, LinkedIn oder Facebook folgen, um auf dem Laufenden zu bleiben.

Offenlegung: Unsere Inhalte werden von den Lesern unterstützt. Das bedeutet, wenn Sie auf einige unserer Links klicken, können wir eine Provision verdienen. Wir empfehlen nur Produkte, von denen wir glauben, dass sie unseren Lesern einen Mehrwert bieten.